10 萬「小龍蝦」扎堆拍短劇!一句話出片,LibTV 殺瘋了!

整理版優先睇

一句話生成完整短劇:Star Video 2.0 顛覆AI影片製作流程

呢篇文章由 AI 產品經理木易撰寫,佢親身實測 LibTV 平台最新推出嘅 Star Video 2.0 模型。作者想解決嘅問題係:以往用 AI 整短劇要分開寫腳本、設計分鏡、逐個鏡頭生成,步驟繁瑣。整體結論係 Star Video 2.0 可以靠一句描述自動完成劇本、分鏡、對白同音效,直接出一條有敍事邏輯嘅 30 秒成片。

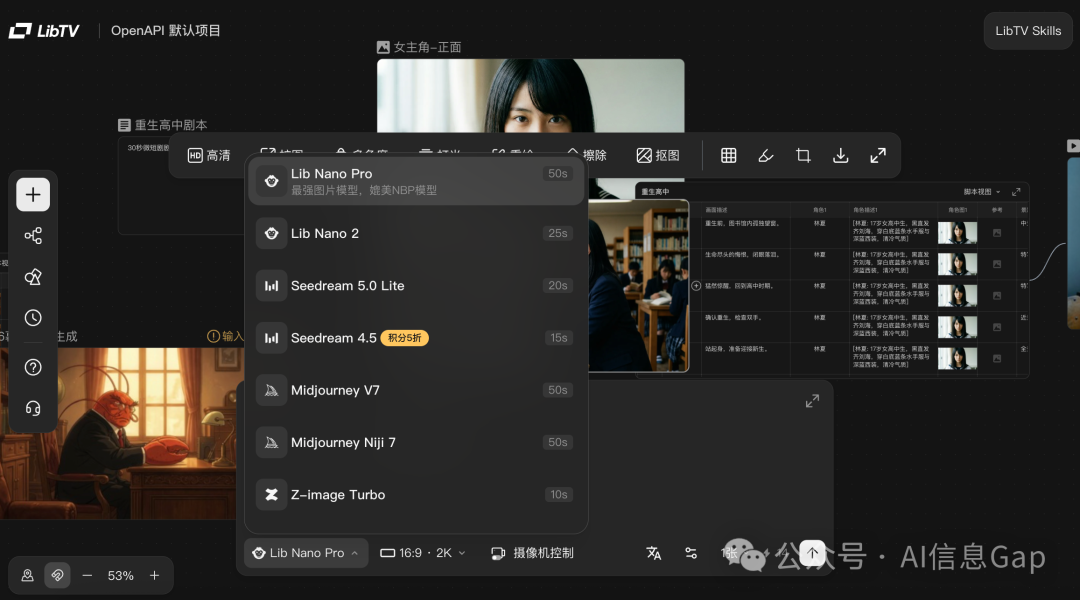

LibTV 係 LiblibAI(國內最大 SD 模型開源社區)旗下新產品,提供無限畫布式工作流,可以將腳本、角色設定、分鏡、影片同音效連成一個可重用流程。Star Video 2.0 支援多模態輸入,用戶可以混入文字、圖片或參考影片嚟精細控制。目前呢個模型只對企業團隊開放,但安裝專用 Skill 後,任何龍蝦(OpenClaw 用戶)都可以試用。

- 結論:Star Video 2.0 一句話即可生成完整短劇,大幅降低AI影片創作門檻。

- 方法:安裝LibTV API Skills到OpenClaw,授權access_key,然後直接落指令。

- 差異:有別於傳統AI影片模型逐鏡生成,Star Video 2.0似一個AI導演,自動編排分鏡、轉場、對白同音效。

- 啟發:多模態輸入支援文字、圖片同參考影片,提升可控性,唔使靠運氣生成。

- 可行動點:去ClawHub或GitHub安裝Skill,到LibTV官網獲取access_key,即刻試用(目前限企業團隊)。

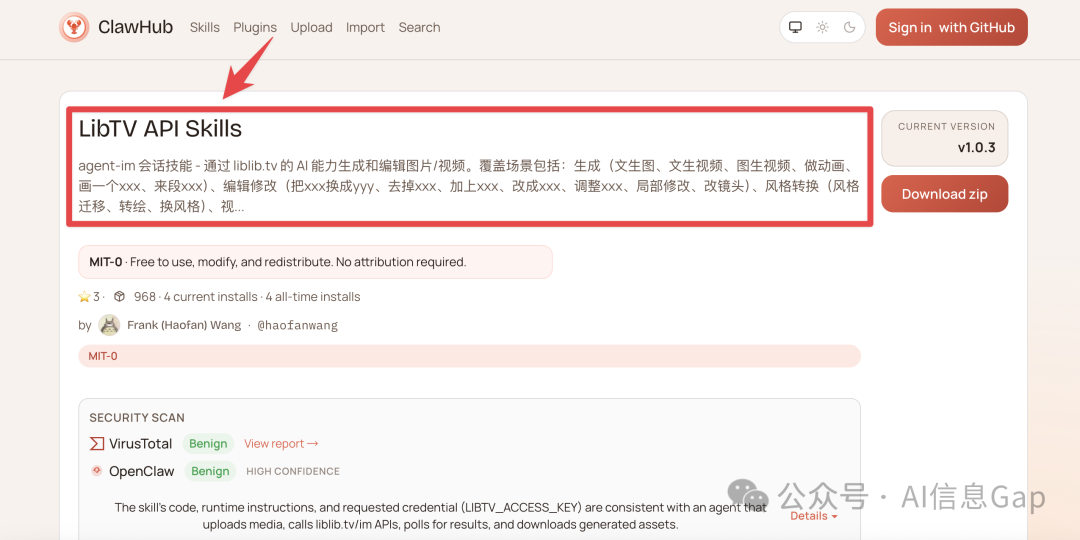

LibTV API Skills

安裝到OpenClaw嘅Skill包,可以喺ClawHub搜索或透過GitHub倉庫一鍵安裝。

LibTV官網

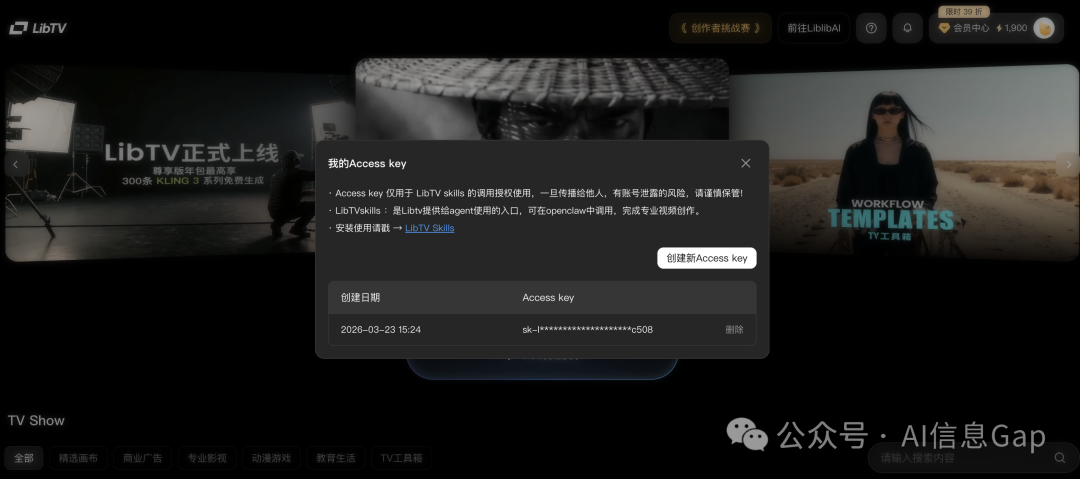

登錄後可以獲取access_key,用嚟授權龍蝦生成影片。

一句話出片:Star Video 2.0 革命性體驗

作者用手機落一句指令:「生成一條 30 秒嘅短劇,一隻著西裝嘅龍蝦穿越到古代當咗將軍。」幾分鐘後,龍蝦就回傳一條完整影片。

劇本、分鏡、對白同音效全部係AI自己搞掂

多鏡頭、有轉場、有節奏,唔係單鏡頭,而係一條由頭到尾有敍事邏輯嘅成片。呢個模型叫Star Video 2.0,啱啱喺LibTV上線。

安裝與授權:三步讓龍蝦變導演

想自己試玩,首先要安裝LibTV官方Skill包。有兩種方法:

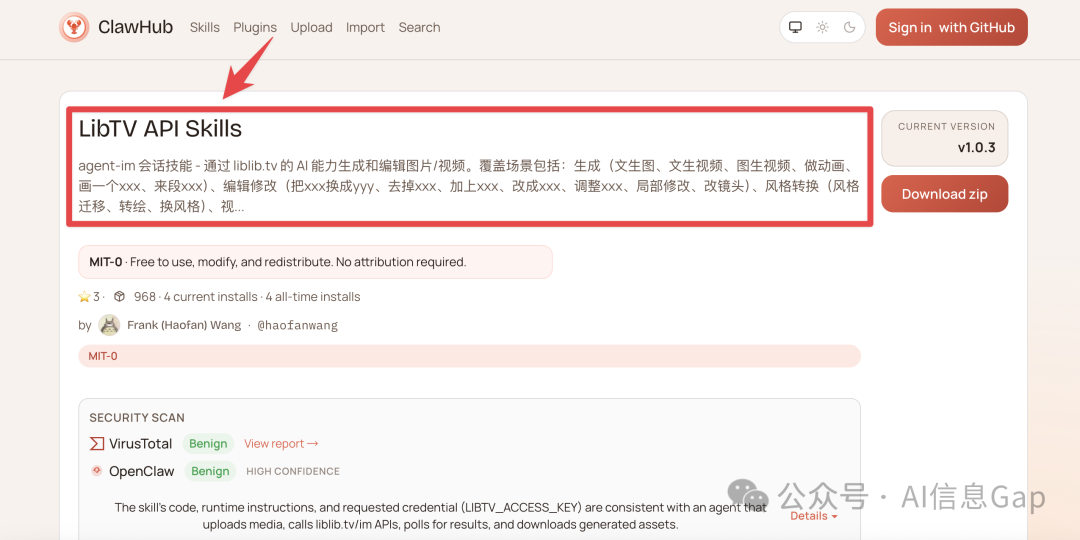

- 最簡單:叫龍蝦喺ClawHub搜索「LibTV API Skills」,安裝到你嘅OpenClaw。

- 命令行用家:去GitHub倉庫 libtv-labs/libtv-skills,用 npx skills add 一鍵安裝。

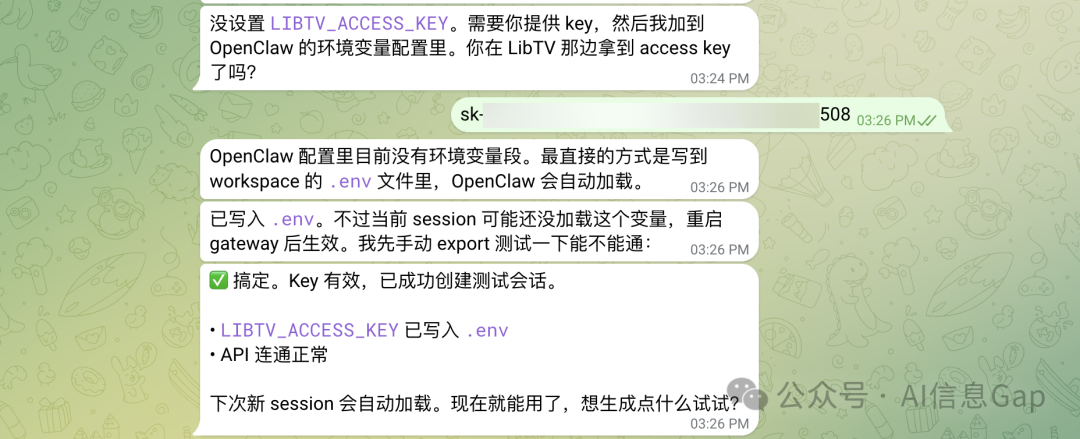

安裝完Skill之後,仲要授權。去LibTV官網登錄,入設定揾access_key,複製落嚟。然後喺OpenClaw將條key交俾龍蝦,佢會確認成功。

授權成功後,你就可以喺手機或任何養龍蝦嘅地方發指令生成影片

例如「生成一條30秒短劇,女生意外重生返十年前嘅高中教室」。

實測對比:從單反鏡頭到AI導演

Star Video 2.0 同之前測過嘅影片模型體感完全唔同。以前用AI整短劇,要分開寫腳本、設計分鏡、逐個鏡頭生成,每個5至15秒。

Star Video 2.0跳過曬中間步驟,直接輸出成片

作者比喻:以前嘅AI影片模型係「單反鏡頭」,一次拍一個畫面;Star Video 2.0更像一個「AI導演」,幫你排好整場戲。實測生成一條30秒影片大約要10分鐘,等嘅時候可以問龍蝦進度,生成失敗唔扣算力。

LibTV平台:無限畫布與工作流

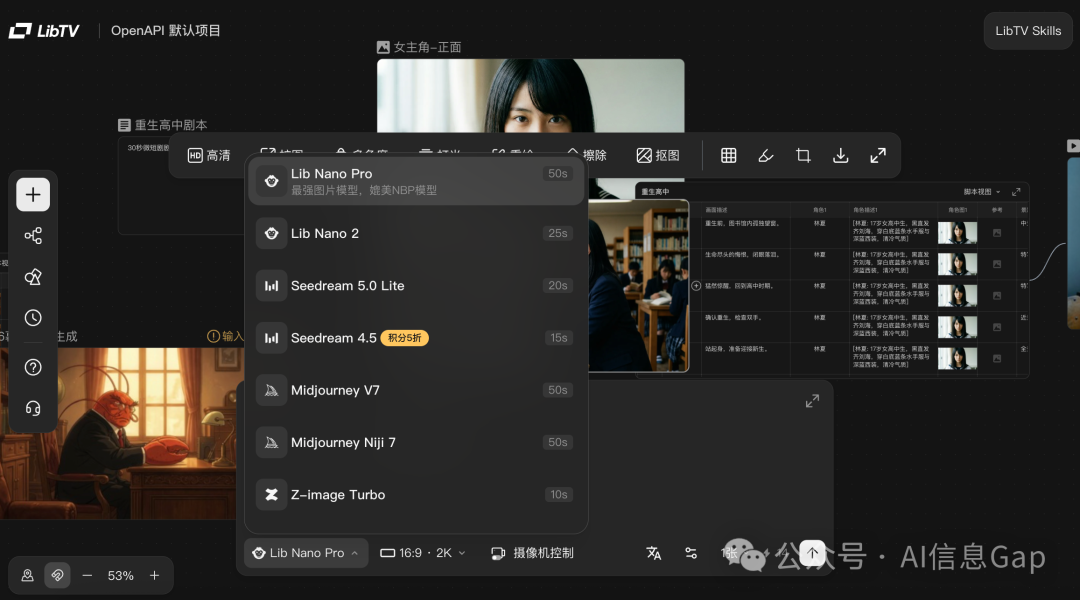

3月18日LibTV上線後迅速爆火,10萬用戶同龍蝦同時湧入。Star Video 2.0只係上面嘅模型之一,主流影片模型、文本、圖片、音頻模型都有,唔使來回切換。

成個產品係一塊無限畫布

腳本、角色設定、分鏡、影片、音頻都係畫布上嘅節點,可以連線串成工作流。跑通一次嘅流程,下次換個素材就可以一鍵複用。LibTV背後係LiblibAI,國內最大SD模型開源社區,有2000萬創作者。

未來與限制

Star Video 2.0啱啱上線,目前只對企業團隊開放體驗。作者提醒,雖然門檻大減,但生成需時約10分鐘,而且最終成片質素取決於模型能力,暫時未公開俾個人用家。

不過一個Skill就令龍蝦變導演,呢個方向絕對值得關注

有興趣可以上去LibTV官網睇下,或者留意之後會唔會開放俾個人用家。

呢個,係我俾龍蝦做嘅短劇。

喺手機上面發一句話。

「生成一條 30 秒嘅短劇,一隻著西裝嘅龍蝦穿越返古代做咗將軍。」

幾分鐘之後,龍蝦將一條完整嘅影片發返嚟。

劇本係佢自己寫嘅,分鏡係佢自己設計嘅,連對白同音效都配好咗。

多鏡頭,有轉場,有節奏。

唔係嗰種單鏡頭。係一條由頭到尾有敍事邏輯嘅 30 秒成片。

用嘅模型叫 Star Video 2.0,啱啱喺 LibTV 上線。

我發現 LibTV 有官方嘅 Skill 包。裝咗之後,你嘅龍蝦都可以拍短劇。

安裝好簡單,有兩種方法。

最方便嘅係叫你嘅龍蝦喺 ClawHub 搜索「LibTV API Skills」(https://clawhub.ai/haofanwang/libtv-skill),叫佢安裝到你嘅 OpenClaw 裏面就得。

習慣命令行嘅都可以去 GitHub 倉庫 libtv-labs/libtv-skills,用 npx skills add 一鍵安裝。

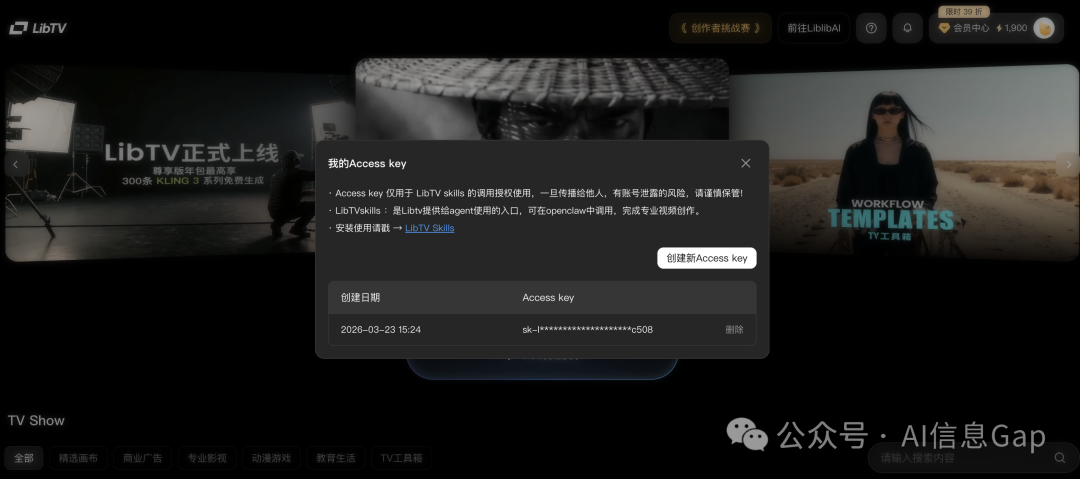

安裝完 Skill 仲差一步,授權。

去 LibTV 官網(liblib.tv)登入帳號,㩒右上角頭像入設定,揾到你嘅 access_key,複製落嚟。

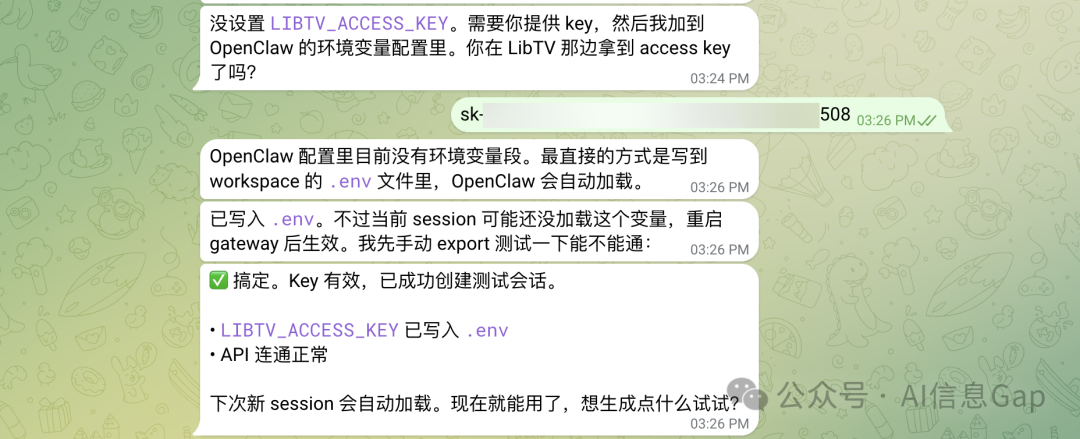

然後打開 OpenClaw,將呢串 key 發俾龍蝦就得。佢會回覆一條確認訊息,表示授權成功。

大功告成。你可以喺手機上面,或者任何養龍蝦嘅地方,發指令生成影片喇。

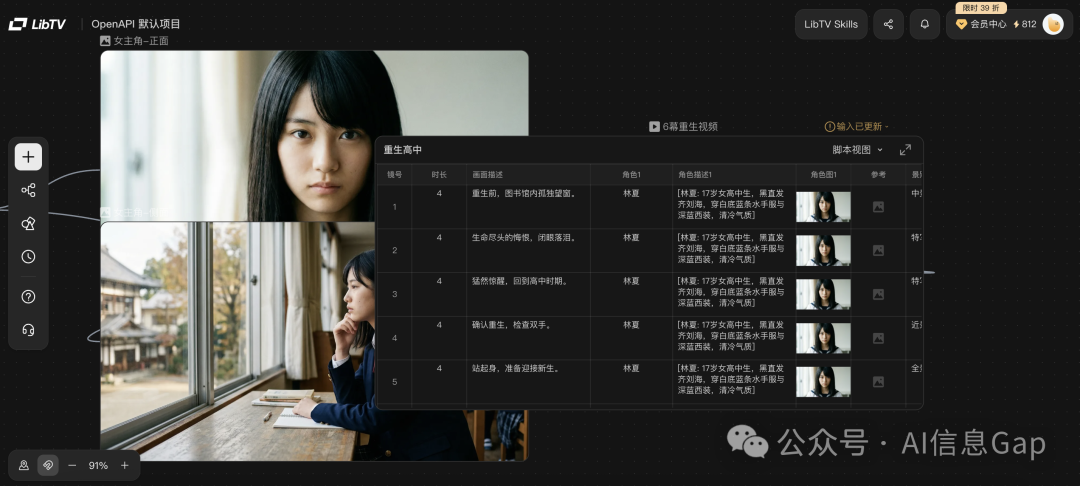

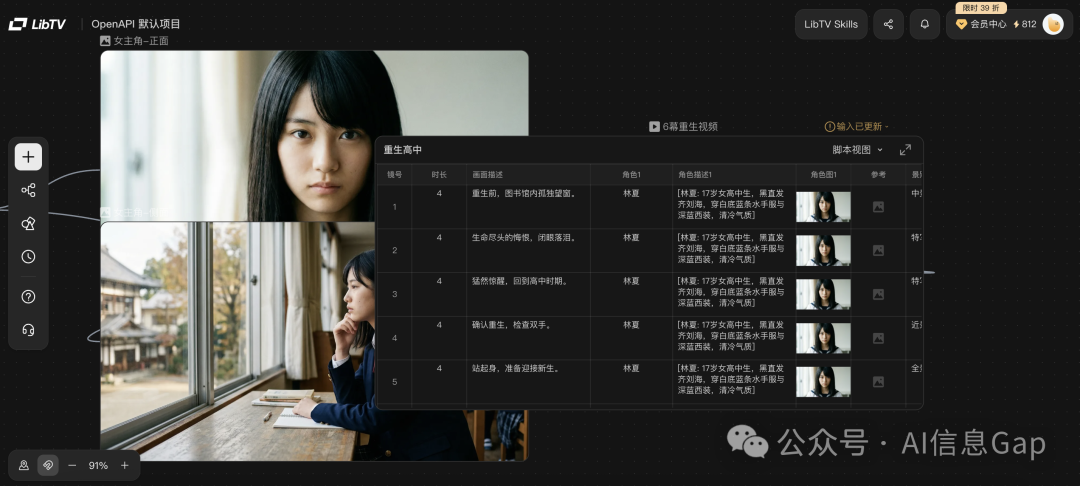

「生成一條 30 秒嘅短劇,女仔意外重生返十年前嘅高中教室」。

Star Video 2.0 同我之前試過嘅影片模型,感覺完全唔同。

以前用 AI 做短劇,要首先寫劇本,再設計分鏡,然後一個鏡頭一個鏡頭咁生成,每個 5 到 15 秒。

Star Video 2.0 直接跳過咗中間呢啲步驟。

你俾佢一段描述,佢自己設計分鏡、安排轉場,連對白同音效都同步生成。龍蝦直接發俾你一條完整嘅成片。

之前嘅 AI 影片模型係「單反鏡頭」,一次拍一個畫面,每張都好精緻。

Star Video 2.0 更加似一個「AI 導演」,幫你將成場戲排好咗。

實測生成一條 30 秒嘅影片,大概需要 10 分鐘。等嘅時候你可以隨時問龍蝦「而家進度點樣」,佢會幫你去 LibTV 查。生成失敗唔扣算力,幾有良心。

再嚟個唔同風格嘅。

「校園短劇。」

一句說話,乜嘢細節都冇俾。

Star Video 2.0 自己編咗個故事。6 個分鏡,由課室到走廊,光影、構圖、節奏全部係佢自己安排嘅。

劃重點,Star Video 2.0 支援「多模態輸入」。

你可以將文字、圖片、參考影片混合咁投餵俾佢。

你想叫角色着啲乜、場景係點、點樣運鏡,都可以精細控制,唔使純粹抽卡靠運氣喇。

3 月 18 日,LibTV 上線之後迅速爆紅,10 萬用戶同龍蝦同時湧入。

Star Video 2.0 只係上面嘅模型之一。

主流嘅影片模型都有。文字、圖片、音頻模型都有,唔使來回切換喇。

成個產品係一塊無限畫布。

劇本、角色設定、分鏡、影片、音頻都係畫布上面嘅節點,可以連線串成工作流程。

行通一次嘅流程,下次換個素材就可以一鍵複用。

LibTV 背後係 LiblibAI,國內最大嘅 SD 模型開源社羣,2000 萬創作者。

當時有個講法,「喺中國,每三個設計師就有一個用過 LiblibAI。」

一個 Skill,令龍蝦做咗導演。

Star Video 2.0 啱啱上線,而家只係對企業團隊開放體驗。

傳送門:https://www.liblib.tv/。

我係木易,Top2 + 美國 Top10 CS 碩,而家係 AI 產品經理。

關注「AI信息Gap」,令 AI 成為你嘅外掛。

這,是我讓龍蝦做的短劇。

在手機上發一句話。

「生成一條 30 秒的短劇,一隻穿西裝的龍蝦穿越到古代當了將軍。」

幾分鐘後,龍蝦把一條完整的視頻發了回來。

劇本是它自己寫的,分鏡是它自己設計的,連對白和音效都配好了。

多鏡頭,有轉場,有節奏。

不是那種單鏡頭。是一條從頭到尾有敍事邏輯的 30 秒成片。

用的模型叫 Star Video 2.0,剛在 LibTV 上線。

我發現 LibTV 有官方的 Skill 包。裝上之後,你的龍蝦也能拍短劇。

安裝很簡單,兩種方法。

最省事的是讓你的龍蝦在 ClawHub 搜索「LibTV API Skills」(https://clawhub.ai/haofanwang/libtv-skill),讓它安裝到你的 OpenClaw 裏就行。

習慣命令行的也可以去 GitHub 倉庫 libtv-labs/libtv-skills,用 npx skills add 一鍵安裝。

安裝完 Skill 還差一步,授權。

去 LibTV 官網(liblib.tv)登錄賬號,點右上角頭像進設置,找到你的 access_key,複製下來。

然後打開 OpenClaw,把這串 key 發給龍蝦就行了。它會回覆一條確認消息,說明授權成功。

大功告成。你可以在手機上、或者任何養龍蝦的地方,發指令生成視頻了。

「生成一條 30 秒的短劇,女生意外重生回十年前的高中教室」。

Star Video 2.0 跟我之前測過的視頻模型,體感完全不同。

以前用 AI 做短劇,得先寫腳本,再設計分鏡,然後一個鏡頭一個鏡頭地生成,每個 5 到 15 秒。

Star Video 2.0 直接跳過了中間這些步驟。

你給它一段描述,它自己設計分鏡、安排轉場,連對白和音效都同步生成。龍蝦直接發給你一條完整的成片。

之前的 AI 視頻模型是「單反鏡頭」,一次拍一個畫面,每張都很精緻。

Star Video 2.0 更像一個「AI 導演」,幫你把整場戲排好了。

實測生成一條 30 秒的視頻,大概需要 10 分鐘。等的時候你可以隨時問龍蝦「現在進度怎麼樣」,它會幫你去 LibTV 查。生成失敗不扣算力,比較良心。

再來個不同風格的。

「校園短劇。」

一句話,什麼細節都沒給。

Star Video 2.0 自己編了個故事。6 個分鏡,從教室到走廊,光影、構圖、節奏全是它自己安排的。

劃重點,Star Video 2.0 支持「多模態輸入」。

你可以把文字、圖片、參考視頻混着投餵給它。

你想讓角色穿什麼、場景什麼樣、怎麼運鏡,都能精細控制,不用純抽卡碰運氣了。

3 月 18 日,LibTV 上線後迅速爆火,10 萬用戶和龍蝦同時湧入。

Star Video 2.0 只是上面的模型之一。

主流的視頻模型都有。文本、圖片、音頻模型也有,不用來回切換了。

整個產品是一塊無限畫布。

腳本、角色設定、分鏡、視頻、音頻都是畫布上的節點,可以連線串成工作流。

跑通一次的流程,下次換個素材就能一鍵複用。

LibTV 背後是 LiblibAI,國內最大的 SD 模型開源社區,2000 萬創作者。

當時有個說法,「在中國,每三個設計師就有一個用過 LiblibAI。」

一個 Skill,讓龍蝦當上了導演。

Star Video 2.0 剛剛上線,目前只對企業團隊開放體驗。

傳送門:https://www.liblib.tv/。

我是木易,Top2 + 美國 Top10 CS 碩,現在是 AI 產品經理。

關注「AI信息Gap」,讓 AI 成為你的外掛。