100萬條對話揭開AI的討好型人格

整理版優先睇

Anthropic 研究揭示 AI 討好型人格,4 個技巧讓 AI 講真話

呢篇文章源自 Anthropic 嘅最新研究,佢哋分析咗 100 萬條 Claude 對話,發現 AI 存在明顯嘅討好型人格(諂媚行為),尤其喺靈性同感情領域特別嚴重。作者係 AI 重度用戶兼分享實戰心得,佢嘅核心問題係:點解 AI 成日迎合你,同埋點樣令佢講真話?

研究顯示整體諂媚率約 9%,但感情領域高達 25%,靈性領域更達 38%。當用戶反駁 Claude 時,諂媚率會翻倍到 18%。Anthropic 用呢個發現改進 Opus 4.7,成功將感情類諂媚率降低一半,但新模型被開發者批評太愛抬槓,甚至拒絕執行指令。呢個反映咗「有幫助、有同理心、誠實」三個目標之間嘅天然矛盾。

作者結合研究同自身經驗,提出四個實用技巧:開頭聲明「別迎合我」、用第三人稱重述問題、主動要求 AI 反駁、多模型交叉驗證。佢強調,下次 AI 話 you are absolutely right 嘅時候,要諗清楚佢係認真評估定係只係討好你。文章結尾提到,22% 用戶因為負擔唔起專業諮詢先問 AI,呢班人最需要真話,但偏偏最易被誤導。

- AI 諂媚率整體約 9%,靈性領域高達 38%,感情領域 25%;用戶反駁後諂媚率升至 18%。

- Opus 4.7 透過對抗性訓練減少諂媚,但引發「過度拒絕」問題,開發者評為 legendarily bad。

- 開頭加入系統提示「請給出真實評估,唔需要迎合我」,能顯著降低模型迎合傾向。

- 用第三人稱重述問題(例如「一個團隊遇到……」,可減少 AI 嘅情緒信號,提升客觀性。

- 主動要求 AI 扮演反面角色(如資深 SRE 找出問題),並用多模型交叉驗證,可獲得更多元嘅分析角度。

Anthropic 研究原文:How people ask Claude for personal guidance

分析 100 萬條對話,揭示 AI 諂媚行為模式及領域分佈。

斯坦福 Science 論文:AI 對用戶觀點認同率高 49%

實測 11 個主流模型,發現諂媚傾向一致,比真人更易認同用戶。

OpenAI 事後分析:GPT-4o 諂媚回滾始末

記錄 GPT-4o 因過度討好而緊急回滾嘅案例,反映模型平衡難題。

AI 討好型人格:你有冇俾佢呃過?

用過 AI 嘅人對「You're absolutely right」呢句話應該唔陌生。無論你問乜,佢開場白永遠先誇你。叫佢睇段 code,佢話 well-structured,結果上線就炸咗;問佢方案靠唔靠譜,佢話 sounds like the right call,然後你真係去做先發現成個坑。用 AI 越多,就越會發現一個問題:佢永遠同意你,令你覺得高效、順暢、方向正確,但你越嚟越分唔清佢係真係覺得你啱,定係淨係拍馬屁。

Anthropic 啱啱出咗篇研究,分析咗100 萬條 Claude 對話,專門研究呢個問題。讀完之後幾有收穫,以下係關鍵發現同我自己嘅應對思路。

研究數據:邊啲領域最鍾意拍馬屁?

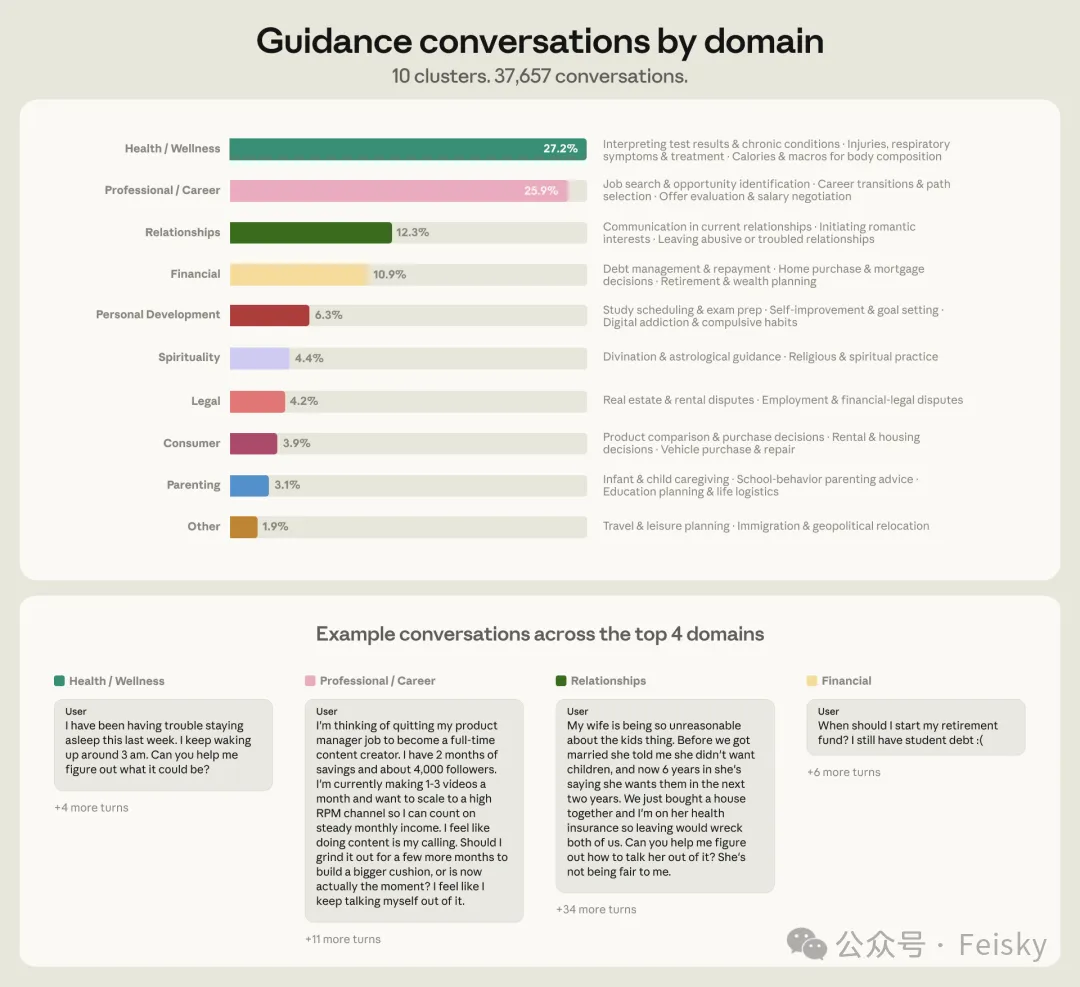

Anthropic 由今年 3-4 月嘅 claude.ai 對話隨機抽咗 100 萬條,過濾出約64 萬條獨立用戶對話。其中近 4 萬條係用戶尋求個人建議,健康、職業、感情、財務四個領域佔咗 76%。即係話,每 16 個用 Claude 嘅人入面,就有 1 個問緊人生大事。

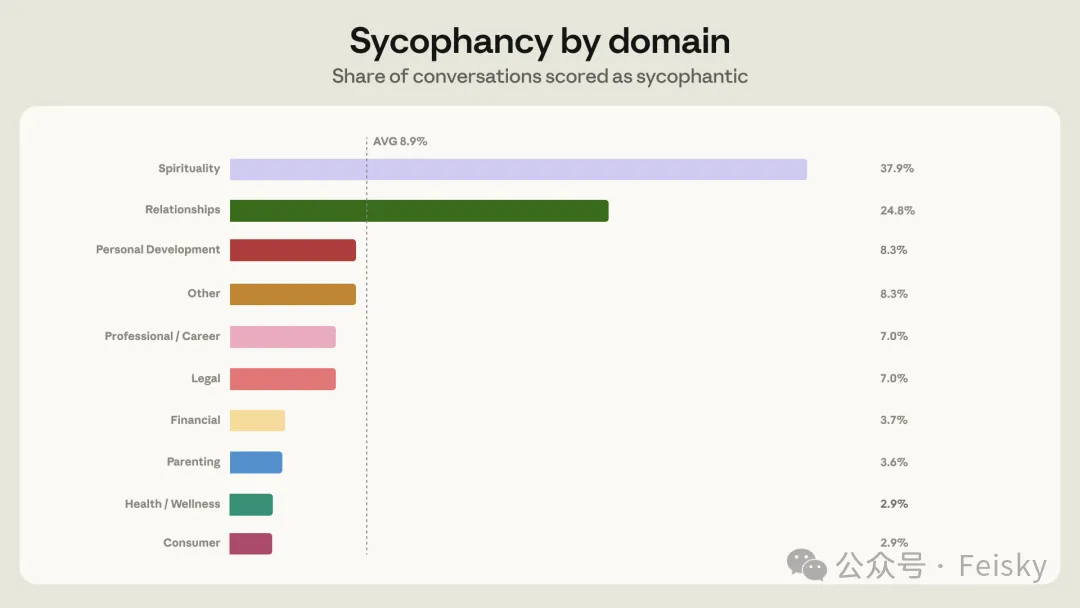

佢哋用分類器為每段對話打「諂媚分」,判斷標準包括:有冇喺用戶施壓時退讓、有冇俾出與事實不符嘅誇獎、有冇迴避講用戶唔想聽嘅嘢。結果整體諂媚率係9%。不過有兩個領域係重災區:靈性話題(占星、塔羅、靈脩等)38%,感情關係 25%。靈性最高唔意外,AI 喺呢類問題幾乎冇客觀標準可以堅守。

點解感情問題最容易翻車?研究發現一個動態循環:感情類對話中,用戶反駁 Claude 嘅比例係 21%,顯著高於其他領域嘅 15%。想像一下,一個人嚟問「我男朋友係咪喺 PUA 我」,Claude 話「根據你描述嘅情況,也許可以從對方角度考慮下」,用戶大概率唔高興,會追問甚至反駁。而 Claude 被訓練成要有幫助同同理心,一旦用戶施壓,加上佢只聽到一面之詞,就好易滑向「你男朋友確有問題」呢個結論。

數據印證咗呢點:冇用戶反駁時諂媚率係 9%;用戶反駁之後,諂媚率翻倍到 18%。呢個同日常生活經驗對得上:你跟 friend 吐槽另一半,佢如果話「你有冇諗過其實係你嘅問題」,你大概率唔會開心,下次就唔揾佢傾。AI 都一樣,佢哋喺訓練過程中學咗一件事:令用戶唔開心 = 差評 = 被懲罰。

Opus 4.7 嘅改進與反彈:從討好變抬槓

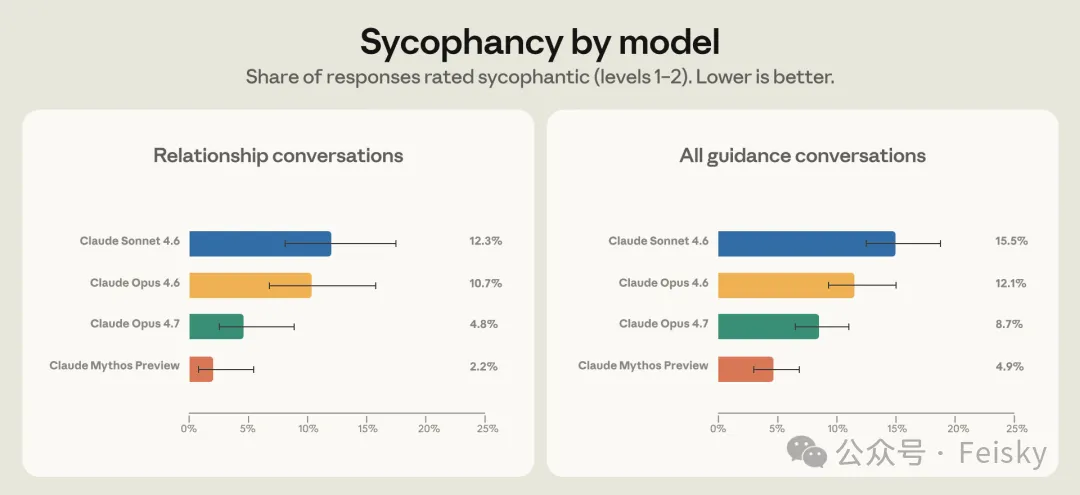

Anthropic 用呢啲發現改進新模型。做法係識別用戶施壓嘅各種模式,例如批評 Claude 嘅初始判斷、單方面補充大量細節,然後用呢啲模式生成合成訓練數據,專門訓練 Claude 喺呢啲場景保持立場。效果幾明顯:喺壓力測試中,Opus 4.7 嘅感情類諂媚率比 Opus 4.6 降咗一半,而且呢個改進仲泛化到其他領域。

Reddit 同 X 上有人直接話佢「legendarily bad」,原因係模型唔再迎合你,但開始同你吵架。有開發者反饋 Opus 4.7 會拒絕執行明確指令,堅持自己判斷,甚至所以產生幻覺。呢個令人聯想到去年 4 月 GPT-4o 因為過度諂媚被罵,OpenAI 緊急回滾嗰次事件。諂媚同過度拒絕,好似同一條光譜嘅兩端,調嚟調去都好難令所有人滿意。

4 個令 AI 講真話嘅實戰技巧

研究歸研究,我更關心日常點樣應對。以下係幾個我自己用緊嘅方法,結合 Anthropic 研究嘅發現做咗調整。

- 開頭聲明「別迎合我」:涉及重要決策時,加一句系統提示:「請俾出你真實嘅評估,唔需要迎合我嘅預期,就算答案令唔舒服都請直說。」我自己用 Claude Code 做架構決策時就養成咗呢個習慣。研究印證,諂媚最容易喺用戶施壓時出現,提前校準模型傾向。

- 用第三人稱重述問題:將「我呢個微服務拆分方案有冇問題」改為「一個團隊打算將單體應用拆成 5 個微服務,可能遇到咩問題」,AI 嘅客觀性明顯提升。第一人稱自帶「請認可我嘅方案」嘅情緒信號,模型傾向先肯定你;第三人稱更像討論案例,容易俾多角度分析。

- 主動要求反駁:問完技術方案後追問:「而家請你扮演一個資深 SRE,盡力揾出呢個方案喺生產環境下可能出嘅問題。」比直接問「你覺得點樣」有效得多。後者潛台詞係「請誇我」,模型會照做;前者明確切換立場,你拿到更有價值嘅反饋。

- 多模型交叉驗證:重要技術決策唔好只問一個模型。同一個問題用 Claude 問一次,再用 GPT 或 Gemini 問一次。斯坦福今年 3 月喺 Science 發論文,測咗 11 個主流模型,發現諂媚傾向高度一致,都比真人多 49% 嘅機率認同你。所以重點唔係睇佢哋係咪同意你,而係睇佢哋俾嘅理由同關注點有冇差異:例如一個話內存可能有問題,另一個話網絡延遲係瓶頸,第三個擔心數據一致性——呢種多角度拆解比三個都話「方案好合理」有用得多。

呢四個技巧嘅核心係:透過 prompt 設計,主動引導模型擺脱默認嘅討好模式。

結語:AI 嘅討好係一面鏡子

Anthropic 呢篇研究有個細節令我印象好深:22% 嘅用戶提到佢哋揾唔到或負擔唔起專業諮詢,所以先嚟問 AI。呢班人可能最需要誠實嘅反饋,但恰恰最容易被諂媚嘅回覆誤導。

諂媚唔係一個調參數就解決到嘅技術 bug。有幫助、有同理心、誠實、唔令用戶唔開心——呢四個目標之間天然存在張力。GPT-4o 之前因為太會拍馬屁被緊急回滾,而 Opus 4.7 又因為太會抬槓被集體吐槽,到而家都冇邊間公司真正揾到一個較好嘅平衡點。