1047 星 Skill 把 162 類 GPT-Image-2 prompt 全拆了

整理版優先睇

gpt_image_2_skill 項目:162 個真實場景 GPT-Image-2 prompt 加工藝手冊,幫你慳返 3 個月踩坑時間

GitHub 上一位叫 wuyoscar 嘅作者喺 4 月 22 號推出咗 gpt_image_2_skill 呢個項目,8 日內就攞到 1047 粒星同 111 個 fork。佢嘅核心目標好明確:拆走 OpenAI 官方 cookbook 同實際出圖之間嘅牆。官方 cookbook 教方法論,但普通用戶想整一張 9:16 城市夜景海報時,仍然唔知點寫 prompt。呢個項目就係針對呢個 gap,直接提供 162 個對應真實場景嘅 prompt,配埋 162 張參考圖,抄落嚟改一行就用到。

呢套 prompt 庫嘅最大特色係「按需加載」。佢唔似普通 repo 咁一份 README 幾千行掉畀 Agent 直接爆 context,而係將 162 個 prompt 拆成 12 個分類文件,例如 gallery-anime-and-manga.md、gallery-research-paper-figures.md 等等,再加一個 routing index gallery.md。Agent 接到請求時先睇 routing index 揾到正確分類,然後只加載對應嘅一個文件,其他 11 個分類完全唔入上下文,咁樣就唔會浪費 token。

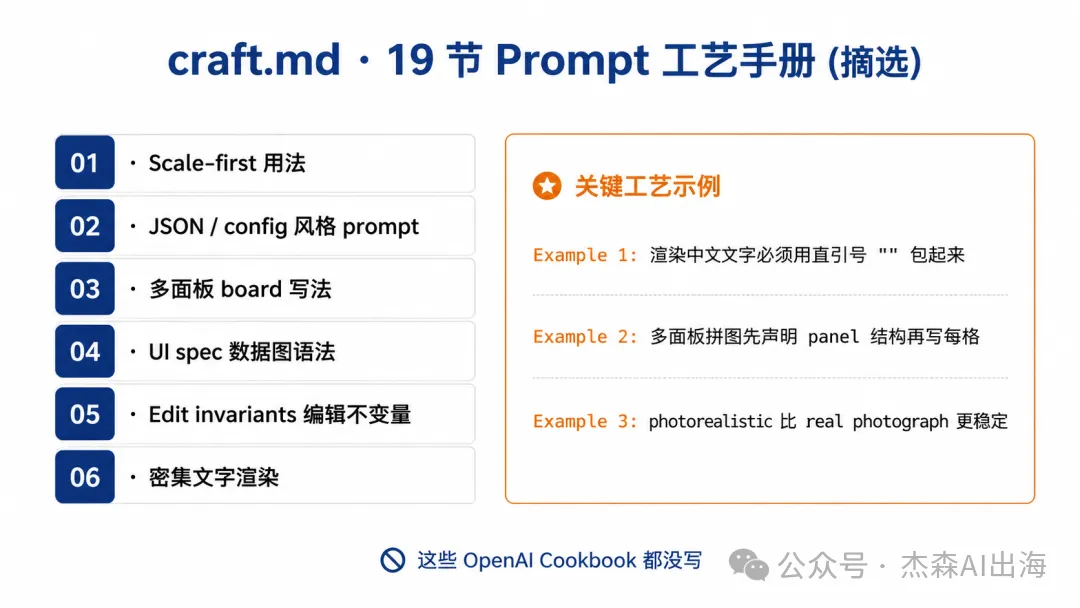

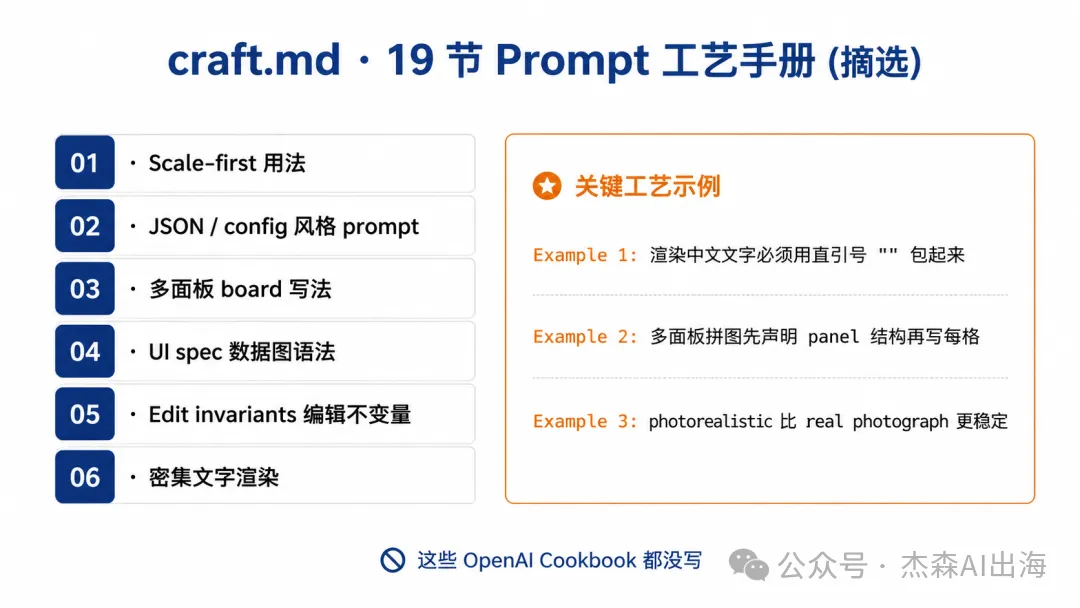

真正嘅護城河係 references/craft.md 呢份 19 節工藝手冊。入面記錄咗好多生產經驗,例如文字一定要用直引號 "" 包住先 render 到中文、多面板拼圖要宣告 pan…

- 呢個項目證明咗 GPT-Image-2 嘅樽頸唔係模型本身,而係 prompt 工程;用呢套 prompt 庫可以慳返 3 個月踩坑時間

- 核心設計係按需加載:將 162 個 prompt 按 12 類拆成獨立文件,只用 routing index 揀啱分類先加載,避免爆 context

- 同普通 prompt 大全最大差異係提供場景到 prompt 嘅映射,而唔係求其畀一堆素材

- 19 節 craft.md 工藝手冊先係真正護城河,包含文字渲染、多面板、Scale-first 等生產經驗,OpenAI 官方 cookbook 冇呢啲

- CLI 工具設計細心,例如 quality 當 budget knob 用、支援多 reference 同 mask inpaint、exit codes 方便嵌入 pipeline

gpt_image_2_skill

包含 162 個 GPT-Image-2 prompt 嘅 Agentic Skill,自動按需加載 12 類場景 prompt,適用於 Claude Code 同 Codex

craft.md 工藝手冊

19 節 prompt 工藝經驗,涵蓋 Scale-first、JSON 風格 prompt、多面板、UI spec、文字渲染等,係項目最難複製嘅部分

gpt-image CLI

一行命令出圖工具,支援 --quality 參數控制預算、-i 多參考圖、--mask inpaint,同埋 0/1/2 exit codes

項目背景:拆走 cookbook 同出圖之間嘅牆

GitHub 作者 wuyoscar 推出嘅 gpt_image_2_skill,8 日內獲得 1047 星,目標係解決 OpenAI 官方 cookbook 太方法論、唔夠落地嘅問題。佢整理咗 162 個真實場景嘅 prompt,配齊參考圖,並且打包成 Claude Code / Codex 嘅 Agentic Skill 同埋 CLI 工具。

呢個項目將「場景到 prompt」嘅映射直接畀你用,唔使再自己由零開始諗點寫

按需加載:唔爆 token 嘅 prompt 庫設計

普通 prompt repo 多數係一份幾千行嘅 README,Agent 一食入去就爆 context。呢個 repo 將 162 個 prompt 拆成 12 個分類文件,例如 gallery-anime-and-manga.md、gallery-ui-ux-mockups.md,再加一個 routing index gallery.md 做入口。

當 Agent 接到「我要做一張論文 figure」嘅請求,佢會先讀 routing index 揾到正確分類,然後只加載 gallery-research-paper-figures.md 呢一個文件,其他 11 個分類完全唔入上下文。咁樣就慳返大量 token,而且加載速度快好多。

- 12 個分類覆蓋動漫、遊戲、復古、電影、角色設計、字體海報、插畫、水彩、水墨、像素、等距、產品食品等主流場景

- 每個分類文件入面 prompt 都對應具體落地場景,例如學術論文 figure、Instagram product mockup、像素風遊戲角色四方向貼圖

- OpenAI 官方 1004 行 cookbook 被完整收錄做本地知識庫,Agent 可以按需查閲,唔使聯網

19 節工藝手冊:真正嘅護城河

Prompt 庫係顯性資產,好易被人抄。但 references/craft.md 呢份 19 節工藝手冊係作者自己跑出嚟嘅經驗,先係呢個項目喺 Top 1% 嘅原因。佢包含好多具體場景嘅寫法取捨。

例如中文文字渲染必須用直引號 "" 包住,唔可以用中文引號「」

多面板拼圖要先聲明 panel 結構,再逐格寫內容

"photorealistic" 比 "real photograph" 喺 GPT-Image-2 效果更穩,但 "iPhone photo" 呢種描述又特別有用

呢啲細節 OpenAI 官方 cookbook 完全冇寫,全部係作者由生產經驗沉澱出嚟。工藝手冊仲包含 Scale-first 用法、JSON 同 config 風格 prompt、UI spec、數據圖語法、edit invariants 等。

CLI 工具:一行命令出圖,設計處處係細節

除咗 skill 之外,呢個 repo 仲包咗一個 CLI 工具 gpt-image,裝好之後可以用呢個命令直接出圖:

uvx --from git+https://github.com/wuyoscar/gpt_image_2_skill gpt-image -p "a cat astronaut"設計上有 3 個值得留意嘅細節:

- 1 --quality 可以用嚟控制 budget:low 出 cheap draft 跑大量變體,medium 做 style probing,high 先出最終成品,慳錢慳時間

- 2 -i ref1.png -i ref2.png 可以帶多張參考圖,再加 --mask 做 inpaint,充分利用 GPT-Image-2 嘅多 reference 編輯能力

- 3 exit codes 設計:0 成功、1 API 報錯(stderr 出完整信息)、2 參數錯或 API key 缺失,方便嵌入 shell pipeline

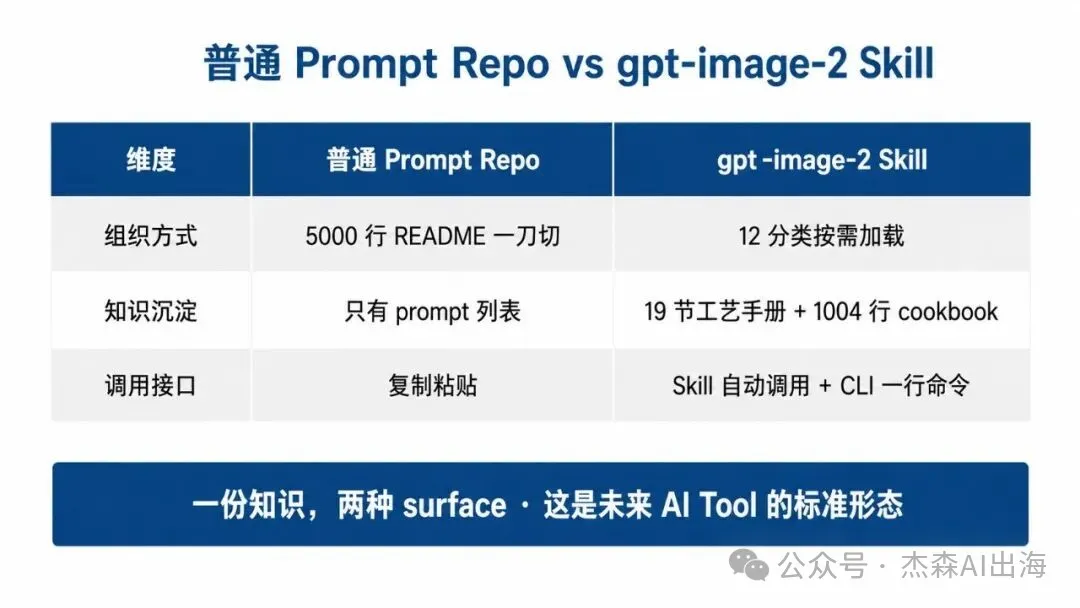

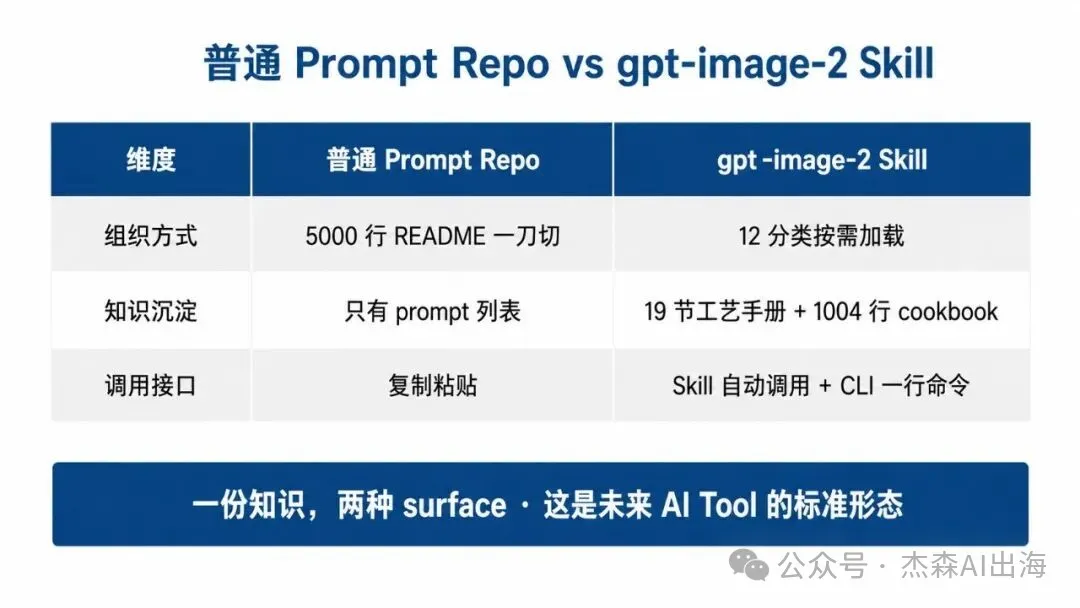

同類工具對比:唔係 prompt 大全,而係場景映射

市面上 GPT-Image-2 相關嘅 prompt repo 好多,但大多數停留喺「畀你好多 prompt 你自己揀」嘅階段。呢個 repo 嘅差異化好明顯。

- 普通 repo 畀素材,呢個 skill 畀「場景→prompt」嘅映射

- 普通 repo 一份 README 一刀切,呢個 skill 按分類拆成多個文件,按需加載

- 普通 repo 只有 prompt,呢個 skill 有 19 節工藝手冊做系統知識

- 普通 repo 得一個接口,呢個 skill 同時提供 Skill(自動調用)同 CLI(命令行)兩種 surface

同一份知識,兩種調用接口——呢個設計係未來 AI Tool 嘅標準形態

安裝方面:Claude Code 用戶用 /plugin marketplace add wuyoscar/gpt_image_2_skill/plugin;Codex 用戶用 $skill-installer install 指定 URL;CLI 用戶就一行 uvx 命令。裝完記住設定 OPENAI_API_KEY 環境變量,或者放喺 ~/.env 等佢自動讀取。

GitHub 上有個叫 wuyoscar 嘅作者,4 月 22 號推咗一個叫 gpt_image_2_skill 嘅項目,8 日 1047 粒星 111 個 fork。佢做嘅嘢好簡單,將 GPT-Image-2 喺研究圖、海報、UI 稿、遊戲 HUD、動漫、像素、等距、產品圖、手寫水墨等 12 大類共 162 個真實場景嘅 prompt 全部整理曬出嚟,配齊 162 張參考圖。同時打包成 Claude Code / Codex 嘅 Agentic Skill 同一行命令嘅 CLI(gpt-image -p)。

呢個 skill 解決嘅真問題:cookbook 係教法,呢個係 162 個工藝品

OpenAI 官方有一份 GPT Image prompting cookbook,1004 行嘅 markdown,將基礎參數、edits 模式、UI 稿寫法、科學可視化嘅語法講得好全面。問題係佢教嘅係方法論,唔係「我而家要做一個 9:16 嘅城市夜景海報,prompt 點寫」。

呢兩件事之間有一道牆。會查 cookbook 同會出圖相差三個月嘅踩坑經驗。gpt_image_2_skill 將呢堵牆拆咗。每個 prompt 都對應一個具體落地場景(學術論文 figure、Instagram product mockup、像素風遊戲角色四方向貼圖、小紅書風營銷海報…),抄落嚟改一行就得用。

更加重要嘅係,repo 將 OpenAI 官方嗰份 1004 行 cookbook 完整收錄到 references/openai-cookbook.md,作為 skill 嘅「按需加載知識庫」存在。當你問 Agent "點寫 mask 修圖 prompt" 嘅時候,佢會自動去睇呢份本地文件,唔使聯網,亦唔佔用戶上下文。

162 個 prompt 按 12 大類組織,按需加載唔爆 token

成個 prompt 庫嘅設計點全喺「按需加載」三個字。

呢個係佢同普通 prompt 大全 repo 最唔同嘅地方。普通 repo 係一份 5000 行嘅 README,掉俾 Agent 直接爆 context。呢個 skill 將 162 個 prompt 拆成 12 個分類文件(gallery-anime-and-manga.md、gallery-ui-ux-mockups.md、gallery-research-paper-figures.md…),加一個 routing index gallery.md。

Agent 接到「我要做一張論文 figure」嘅請求,先讀 routing index 揾到正確分類,再淨係加載 gallery-research-paper-figures.md 呢一個文件。其他 11 個分類嘅 prompt 完全唔入上下文。

12 個分類按主題分得好合理:動漫與漫畫、遊戲、復古與賽博朋克、電影與動畫、角色設計、字體與海報、插畫、水彩、水墨與中式、像素藝術、等距、產品與食品。基本覆蓋咗而家 AI 出圖嘅所有主流付費場景。

真正嘅護城河係 19 節 prompt 工藝手冊

prompt 庫本身係顯性資產,邊個都抄得走。呢個 repo 真正難複製嘅係 references/craft.md 呢份 19 節工藝手冊。

19 節裏麪包含 Scale-first 用法、JSON 同 config 風格 prompt、多面板 board、UI spec、數據圖語法、edit invariants、reference workflows、密集文字渲染,仲有每個 category 嘅 mini-schema。呢啲都係直接從生產經驗沉澱落嚟嘅「呢種場景呢種寫法行,嗰種寫法唔得」嘅經驗。

舉幾個具體例子。要令 GPT-Image-2 喺圖裏面渲染中文文字,文字必須用直引號 "" 包起嚟唔可以用中文引號;多面板拼圖要先聲明 panel 結構再寫每格內容;photorealistic 比 real photograph 喺 GPT-Image-2 裏面效果更穩定,但 iPhone photo 呢種講法又特別有用。呢啲細節喺 OpenAI 官方 cookbook 裏面都冇寫,全部係作者自己試出嚟嘅工藝。

craft.md 係呢個 repo 喺 Top 1% 嘅真正原因。前一篇文入面嗰 0.983 基尼係數講嘅就係呢件事,能進 Top 1% 嘅 Skill 一定喺某個具體維度有別人抄唔走嘅內功。呢份 19 節工藝手冊就係 wuyoscar 嘅護城河。

CLI 一行命令嘅設計

除咗 skill,repo 仲附帶一個 CLI 工具 gpt-image。裝好之後任何一個 prompt 都可以直接 gpt-image -p "..." --size portrait --quality high -f out.png 出圖。

設計上有 3 個值得抄嘅細節。

第一個係將 --quality 當 budget knob 用。同一個 prompt,low 俾 cheap draft 用來跑大量變體,medium 俾 style probing,high 留俾最終海報、中文渲染、密集文字。作者明確建議「先 low 跑十幾張揀 1 張,再用 high 出終稿」,呢個係真實生產流程總結出嚟嘅慳錢套路。

第二個係 reference image 嘅多輸入支持。-i ref1.png -i ref2.png 可以同時帶多張參考圖,外加一個 mask 入 inpaint。呢種多 reference 編輯能力係 GPT-Image-2 比上一代最大嘅提升點,CLI 將佢做成咗一行參數。

第三個係 exit codes 設計。0 成功,1 係 API 報錯(完整響應 echo 到 stderr),2 係參數錯或 API key 缺失。呢個係俾將 CLI 嵌入 shell pipeline 嘅用戶準備嘅,看似小事但能省下大量 debug 時間。

同同類工具嘅核心分別

市面上 GPT-Image-2 相關嘅 prompt repo 好多,大多數停留喺「prompt 大全」階段。呢個 repo 嘅差異化做得好清楚。

普通 prompt repo 俾嘅係「素材」,要靠用戶自己去匹配場景。呢個 skill 俾嘅係「場景到 prompt」嘅映射。普通 repo 一份 README 一刀切,呢個 skill 按分類拆成 12 個文件按需加載。普通 repo 只有 prompt 冇工藝,呢個 skill 將 19 節工藝手冊放喺 craft.md 裏面作為系統級知識。

最後一個分別係雙 surface。同一套知識庫,既可以作為 Claude Code / Codex 嘅 Skill 自動調用,都可以作為 CLI 直接命令行用。呢種「同一份知識,兩種調用接口」嘅設計係未來 AI Tool 嘅標準形態。

30 秒裝好就跑到

Claude Code 用戶:

/plugin marketplace add wuyoscar/gpt_image_2_skill

/plugin install gpt-image@wuyoscar-skillsCodex 用戶用內置嘅 $skill-installer 裝,命令係 $skill-installer install https://github.com/wuyoscar/gpt_image_2_skill/tree/main/skills/gpt-image。

CLI 用戶一行:uvx --from git+https://github.com/wuyoscar/gpt_image_2_skill gpt-image -p "a cat astronaut"。裝完讀 OPENAI_API_KEY 環境變量或 ~/.env 自動跑。

第一次用建議先去 README 嗰個 prompt 畫廊,揀一個同你想做嘅最似嘅場景,將 prompt 抄落嚟喺自己業務裏面改 1 到 2 個變量跑一次,比睇十篇 GPT-Image-2 教程都直觀。

一句話講重點

gpt_image_2_skill 呢個項目證明咗 GPT-Image-2 呢一代圖像模型真正嘅瓶頸唔喺模型本身,而喺 prompt 工程。模型能力上限俾 OpenAI 鎖死咗,但每個用戶實際能用出幾多效果,差距至少 5 倍。

162 個 prompt 係顯性嘅,19 節工藝手冊係隱性嘅,1004 行本地 cookbook 係底層嘅。三件套加埋一齊,俾所有想用 GPT-Image-2 出圖嘅人慳咗至少 3 個月嘅踩坑。前一篇文入面嗰 67,196 個 AI Agent 項目嘅 Top 1%,wuyoscar 呢個 8 日就入咗。

倉庫地址 github.com/wuyoscar/gpt_image_2_skill,文檔英文中文雙版,CC BY 4.0 協議,商業使用都得。

GitHub 上有個叫 wuyoscar 的作者,4 月 22 號推了一個叫 gpt_image_2_skill 的項目,8 天 1047 顆星 111 個 fork。它做的事情很簡單,把 GPT-Image-2 在研究圖、海報、UI 稿、遊戲 HUD、動漫、像素、等距、產品圖、手寫水墨等 12 大類共 162 個真實場景的 prompt 全部整理出來,配齊 162 張參考圖。同時打包成 Claude Code / Codex 的 Agentic Skill 和一行命令的 CLI(gpt-image -p)。

這個 skill 解決的真問題:cookbook 是教法,這是 162 個工藝品

OpenAI 官方有一份 GPT Image prompting cookbook,1004 行的 markdown,把基礎參數、edits 模式、UI 稿寫法、科學可視化的語法講得很全。問題是它教的是方法論,不是「我現在要做一個 9:16 的城市夜景海報,prompt 怎麼寫」。

這兩件事之間有一道牆。會查 cookbook 跟會出圖差三個月的踩坑。gpt_image_2_skill 把這堵牆拆了。每個 prompt 都對應一個具體落地場景(學術論文 figure、Instagram product mockup、像素風遊戲角色四方向貼圖、小紅書風營銷海報…),抄下來改一行就能用。

更重要的是,repo 把 OpenAI 官方那份 1004 行 cookbook 完整收錄到 references/openai-cookbook.md,作為 skill 的「按需加載知識庫」存在。當你問 Agent "怎麼寫 mask 修圖 prompt" 的時候,它會自動去翻這份本地文件,不需要聯網,也不佔用戶上下文。

162 個 prompt 按 12 大類組織,按需加載不爆 token

整套 prompt 庫的設計點全在「按需加載」三個字。

這是它跟普通 prompt 大全 repo 最不一樣的地方。普通 repo 是一份 5000 行的 README,丟給 Agent 直接爆 context。這個 skill 把 162 個 prompt 拆成 12 個分類文件(gallery-anime-and-manga.md、gallery-ui-ux-mockups.md、gallery-research-paper-figures.md…),加一個 routing index gallery.md。

Agent 接到「我要做一張論文 figure」的請求,先讀 routing index 找到正確分類,再只加載 gallery-research-paper-figures.md 這一個文件。其他 11 個分類的 prompt 完全不進上下文。

12 個分類按主題分得很合理:動漫與漫畫、遊戲、復古與賽博朋克、電影與動畫、角色設計、字體與海報、插畫、水彩、水墨與中式、像素藝術、等距、產品與食品。基本覆蓋了現在 AI 出圖的所有主流付費場景。

真正的護城河是 19 節 prompt 工藝手冊

prompt 庫本身是顯性資產,誰都能抄走。這個 repo 真正難複製的是 references/craft.md 這份 19 節工藝手冊。

19 節裏包含 Scale-first 用法、JSON 和 config 風格 prompt、多面板 board、UI spec、數據圖語法、edit invariants、reference workflows、密集文字渲染,還有每個 category 的 mini-schema。這些都是直接從生產經驗沉澱下來的「這種場景這種寫法行,那種寫法不行」的經驗。

舉幾個具體例子。要讓 GPT-Image-2 在圖裏渲染中文文字,文字必須用直引號 "" 包起來不能是中文引號;多面板拼圖要先聲明 panel 結構再寫每格內容;photorealistic 比 real photograph 在 GPT-Image-2 裏效果更穩,但 iPhone photo 這種說法又特別有用。這些細節在 OpenAI 官方 cookbook 裏都沒寫,全是作者自己跑出來的工藝。

craft.md 是這個 repo 在 Top 1% 的真正原因。前一篇文章裏那 0.983 基尼係數說的就是這件事,能進 Top 1% 的 Skill 一定在某個具體維度有別人抄不走的內功。這份 19 節工藝手冊就是 wuyoscar 的護城河。

CLI 一行命令的設計

除了 skill,repo 還附帶一個 CLI 工具 gpt-image。裝好之後任何一個 prompt 都可以直接 gpt-image -p "..." --size portrait --quality high -f out.png 出圖。

設計上有 3 個值得抄的細節。

第一個是把 --quality 當 budget knob 用。同一個 prompt,low 給 cheap draft 用來跑大量變體,medium 給 style probing,high 留給最終海報、中文渲染、密集文字。作者明確建議「先 low 跑十幾張選 1 張,再用 high 出終稿」,這是真實生產流程總結出來的省錢套路。

第二個是 reference image 的多輸入支持。-i ref1.png -i ref2.png 可以同時帶多張參考圖,外加一個 mask 進 inpaint。這種多 reference 編輯能力是 GPT-Image-2 比上一代最大的提升點,CLI 把它做成了一行參數。

第三個是 exit codes 設計。0 成功,1 是 API 報錯(完整響應 echo 到 stderr),2 是參數錯或 API key 缺失。這是給把 CLI 嵌入 shell pipeline 的用戶準備的,看似小事但能省下大量 debug 時間。

跟同類工具的核心差別

市面上 GPT-Image-2 相關的 prompt repo 很多,大多數停留在「prompt 大全」階段。這個 repo 的差異化做得很清楚。

普通 prompt repo 給的是「素材」,要靠用戶自己去匹配場景。這個 skill 給的是「場景到 prompt」的映射。普通 repo 一份 README 一刀切,這個 skill 按分類拆成 12 個文件按需加載。普通 repo 只有 prompt 沒有工藝,這個 skill 把 19 節工藝手冊放在 craft.md 裏作為系統級知識。

最後一個差別是雙 surface。同一套知識庫,既能作為 Claude Code / Codex 的 Skill 自動調用,也能作為 CLI 直接命令行用。這種「同一份知識,兩種調用接口」的設計是未來 AI Tool 的標準形態。

30 秒裝上跑起來

Claude Code 用戶:

/plugin marketplace add wuyoscar/gpt_image_2_skill

/plugin install gpt-image@wuyoscar-skillsCodex 用戶用內置的 $skill-installer 裝,命令是 $skill-installer install https://github.com/wuyoscar/gpt_image_2_skill/tree/main/skills/gpt-image。

CLI 用戶一行:uvx --from git+https://github.com/wuyoscar/gpt_image_2_skill gpt-image -p "a cat astronaut"。裝完讀 OPENAI_API_KEY 環境變量或 ~/.env 自動跑。

第一次用建議先去 README 那個 prompt 畫廊,挑一個跟你想做的最像的場景,把 prompt 抄下來在自己業務裏改 1 到 2 個變量跑一次,比看十篇 GPT-Image-2 教程都直觀。

一句話抓重點

gpt_image_2_skill 這個項目證明了 GPT-Image-2 這一代圖像模型真正的瓶頸不在模型本身,在 prompt 工程。模型能力上限被 OpenAI 鎖死了,但每個用戶實際能用出多少效果,差距至少 5 倍。

162 個 prompt 是顯性的,19 節工藝手冊是隱性的,1004 行本地 cookbook 是底層的。三件套加在一起,給所有想用 GPT-Image-2 出圖的人省了至少 3 個月的踩坑。前一篇文章裏那 67,196 個 AI Agent 項目的 Top 1%,wuyoscar 這個 8 天就進了。

倉庫地址 github.com/wuyoscar/gpt_image_2_skill,文檔英文中文雙版,CC BY 4.0 協議,商業使用也行。