2026年AI產品設計的五個關鍵詞

整理版優先睇

2026年AI產品設計將從「功能導向」轉向「關係協作」,人機交互的核心在於自然語言驅動與用戶絕對控制權。

這篇文章探討了 2026 年 AI 產品設計的五大核心趨勢,背景基於 AI 技術從單純的工具屬性向「數字員工」與「生活夥伴」轉型的關鍵節點。作者旨在解決當前 AI 產品中用戶信任度下降、交互門檻高以及組織效能受限等問題,並提出了一套全新的產品設計框架。

文章指出,未來的 AI 產品將不再要求人類去適應複雜的代碼或指令語法,而是由 AI 主動適應人類的自然語言表達。整體的結論是:AI 與人的關係正被重新定義為「協作」,而這種協作必須建立在人始終作為最終決策者、AI 作為執行者與放大器的基礎之上。

作者透過對 Vibe Testing、用戶控制權、陪伴感、Agent 團隊及社區驗證等維度的深度分析,預示了產品經理與設計師需要從「功能設計」轉向「關係設計」,這將是下一個 AI 產品週期的勝負關鍵。

- Vibe Testing 崛起:自然語言將取代傳統測試代碼,AI 透過理解人類意圖自動執行場景測試,實現「AI 適應人」的交互範式。

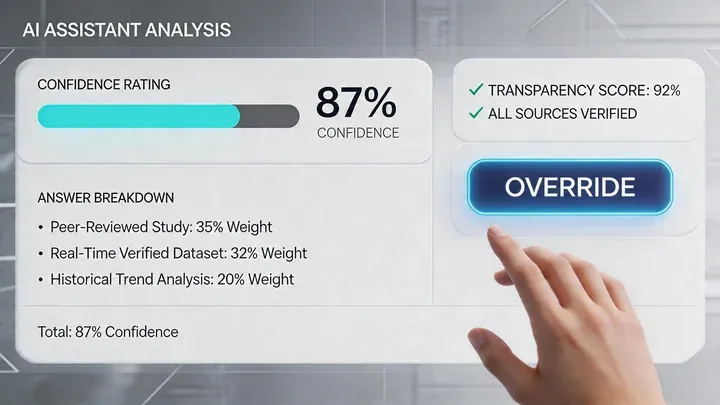

- 強化用戶控制權:產品設計必須包含可解釋輸出、置信度顯示及幹預機制,確保人類在 AI 自主行動時仍保有最終決策權與信任感。

- 從工具轉向陪伴:AI 產品將具備長期記憶與跨會話歷史,衡量標準從單純的「任務完成率」轉向「用戶留存率」與關係深度。

- 個人化 Agent 團隊:組織結構將被打破,個人可配置多個具備獨立身份與角色的 AI Agent 協作,將個人能力放大至團隊規模。

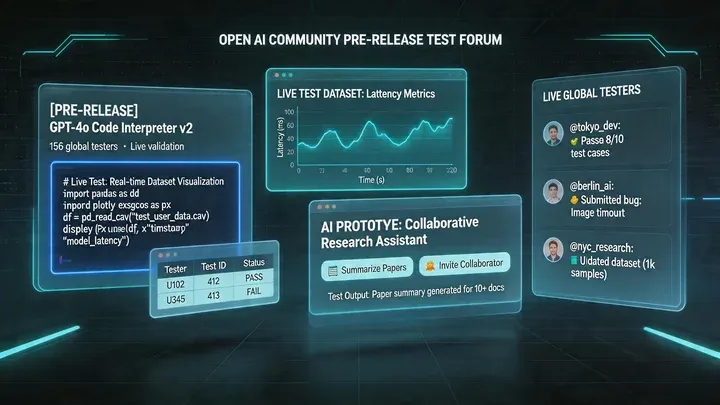

- 社區驅動驗證:前沿 AI 能力的驗證將依賴社區的「靜默發佈」與真實場景反饋,而非官方宣傳,代碼與數據集的公開成為核心指標。

testRigor / TestGrid

支持自然語言描述測試場景,無需編寫代碼即可自動執行測試的 AI 工具。

Agentic Team 工作流

將 AI Agent 視為數字員工管理,配置研究、執行、檢查等不同角色的協作模式。

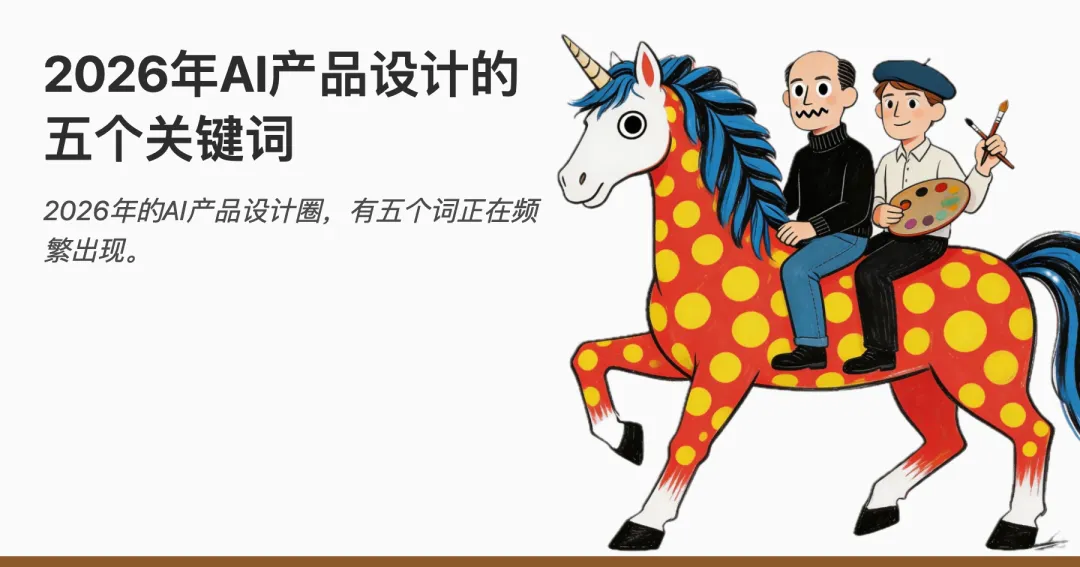

自然語言成為新界面:從 Vibe Coding 到 Testing

傳統的軟體測試需要編寫複雜的自動化腳本,但在 2026 年,這套邏輯將被徹底反轉。AI 開始適應人的表達方式,而非讓人去適應 AI 的語法。

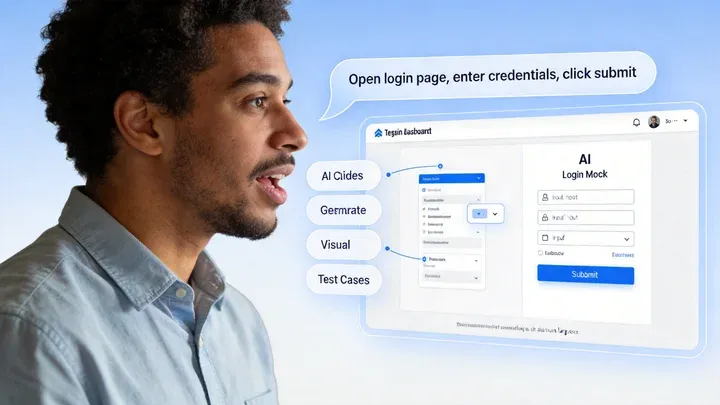

拒絕 AI 黑盒:重奪產品控制權與信任

當用戶對 AI 的盲目輸出感到失控時,信任度便會下降。未來的產品設計必須重新重視「用戶控制權」,讓 AI 的決策過程透明化。

可解釋輸出、置信度顯示、幹預機制是 2026 年 AI 產品的三大標配設計。

組織邊界的瓦解:個人即團隊

未來的組織將把每個 AI Agent 當作獨立的數字員工。一個人可以同時指揮多個 Agent,分別負責研究、執行與審核,極大化個人產出。

Role: Research Agent (負責資料蒐集)

Role: Execution Agent (負責代碼/內容生成)

Role: Review Agent (負責品質把控與衝突檢查)

Workflow: Human -> Research -> Execution -> Review -> Human Approval

2026年嘅 AI 產品設計,有五個詞語正喺度頻繁出現。

Vibe Testing、

User Control、

Companionship、

Agentic Team、

Community Prototype。

每個詞都代表緊一種新嘅人機關係。唔係功能,唔係技術,而係人同 AI 之間正在重新定義嘅協作方式。

A futuristic tech workspace where a human collaborates with five glowing AI orbs, each representing a different interaction paradigm — testing, control, companionship, team, and prototype. Clean minimal 2026 design language.

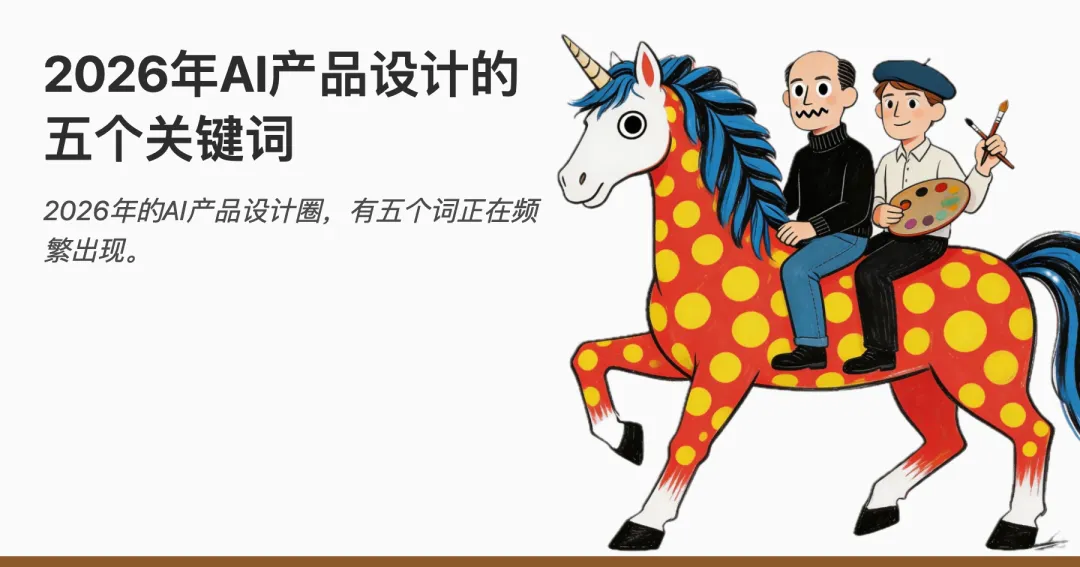

Vibe Testing:自然語言開始驅動 AI

傳統嘅測試,係技術活。

寫測試用例、寫測試代碼、用 Selenium 或者 Appium,測試工程師要識寫程式、識框架、識自動化工具。

2026年,呢套邏輯開始反轉。

testRigor、TestGrid 呢啲工具推出咗一種新嘅測試方式——你用自然語言描述測試場景,AI 自動執行測試,唔需要寫 code。

「打開登入頁面,輸入正確帳號密碼,撳登入」——呢個就已經係一個完整嘅測試用例,唔使寫成代碼,AI 聽得明,亦都識執行。

呢個轉變背後嘅邏輯係:AI 開始去適應人嘅表達方式,而唔係要人去適應 AI 嘅語法。

Vibe Coding 係同樣嘅邏輯——你描述你想要啲咩,AI 幫你生成代碼。Vibe Testing 將呢個邏輯延伸到咗測試領域。Vibe Coding,國內第一本書

兩個 Vibe 加埋一齊講緊嘅係同一件事:自然語言正在成為人機協作嘅新界面。

A person speaking naturally to an AI interface saying "Open login page, enter credentials, click submit" while AI instantly generates visual test cases on screen. No code visible — the AI adapts to human language. Modern testing dashboard with flowing conversation UI.

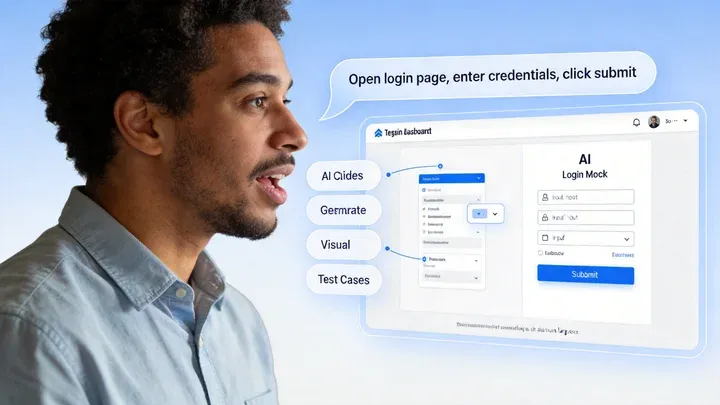

User Control:用戶越來越唔想被 AI 主導

呢個係 2026 年最明顯嘅產品設計轉折。

2024 到 2025 年,AI 產品嘅主流思路係「AI 俾答案你,你接受就得」。結果係用戶覺得越來越失控 —— AI 俾錯咗唔知、AI 自己做咗嘢又冇問過用戶、同樣嘅輸入有時會有唔同嘅輸出。

信任度下降咗。

2026 年嘅產品設計開始重新重視一件事:用戶控制權。

可解釋輸出—— AI 唔單止係俾答案,仲要話你知佢係點樣得出呢個答案,等用戶可以自己判斷信唔信。

置信度顯示—— AI 話俾用戶知佢對呢個答案有幾大把握,係高置信度定係低置信度。

干預機制—— 用戶可以撤銷 AI 嘅操作,可以直接修改 AI 生成嘅內容,可以喺任何時候踩迫力。

呢三個設計加埋一齊,回答緊嘅係同一個問題:

當 AI 越來越能夠自主行動嘅時候,人點樣保持控制?

答案係:

唔係去限制 AI 做啲咩,而係要確保人永遠係最終決策者。

A sleek AI interface displaying a confidence meter and explanation panel — showing '87% confidence' with a breakdown of how the answer was derived. A human hand reaching toward the 'override' button, symbolizing user control. Clean futuristic dashboard with trust indicators and transparency metrics around the AI output.

Companion:由工具變做陪伴者

AI companion 市場喺 2025 年係 377 億美元,2026 年預計會達到 495 億美元,複合增長率有 31%。

呢個數字背後係一種產品形態嘅轉變。

傳統工具嘅邏輯係:用完即走。

每次打開都係由零開始,AI 唔識你,唔知你之前做過啲咩,亦都唔記得你嘅偏好。

陪伴型 AI 就唔同。

佢會記住跨會話(session)嘅歷史,建立長期記憶檔案,在意你同佢之間嘅關係。

唔係答完問題就完咗,而係喺呢個過程入面累積對你嘅理解。下一次你返嚟,佢知你關心啲咩、你識啲咩、你踩過邊啲坑。

有一個預測講得好直接:

今年會成為 AI 生活陪伴者嘅元年。

呢個唔係一個功能上嘅變化。係產品底底層邏輯嘅變化 —— 由功能設計轉向關係設計。

衡量一個工具好唔好,睇嘅係任務完成率。衡量一個陪伴型 AI 好唔好,睇嘅係用戶留存率 —— 用戶願唔願意持續同佢互動?

呢個標準嘅轉變,意味住成個產品設計都要重新思考。

Two silhouettes of a person and an AI companion in a warm glowing circle — the AI has accumulated layers of memory cards, journal entries, and shared history around it. The person is looking at a timeline showing past conversations, preferences, and learned habits. A heart symbol connecting both. Intimate yet technological atmosphere, soft lighting, 2026 design aesthetic.

Agentic Team:個人開始擁有團隊能力

以前要一間公司先可以有團隊。因為團隊需要人,而人需要人工、福利、培訓同埋管理成本。

2026 年,呢個邏輯開始被打破。

HBR 喺一篇文章入面講:組織應該將每個 AI Agent 當做一個獨立嘅「數字員工」嚟管理——每個 Agent 有自己嘅身份、憑證同埋角色。

一個人可以配置自己嘅 Agent 團隊:一個 Agent 負責研究,一個負責執行,一個負責檢查,直接向你匯報。

每個 Agent 有自己嘅角色定義,可以調用唔同嘅工具,可以訪問唔同嘅數據源。佢哋會協作、可能會起衝突、亦都係需要管理。

呢樣嘢代表啲咩?

代表住傳統嘅公司層級開始被打破。

一個人嘅能力唔再受限於自己嘅時間同精力,而係可以被 Agent 團隊無限放大。

當然,呢個轉變亦都帶嚟咗新嘅挑戰:

邊個嚟為 Agent 嘅產出負責?點樣建立 Agent 之間嘅衝突處理機制?點樣確保 Agent 嘅行為喺人嘅掌控之下?

呢啲問題暫時未有標準答案。但佢哋已經係正在發生緊嘅事實,而唔係假設性嘅場景。

Agent Team,從零構建 Claude Code Agent 工作流

A single person at a command center overseeing three AI agents working in parallel — one researching, one executing tasks, one reviewing — each as an autonomous digital avatar with distinct roles connected by neural network. One human orchestrator in the center, not the worker.

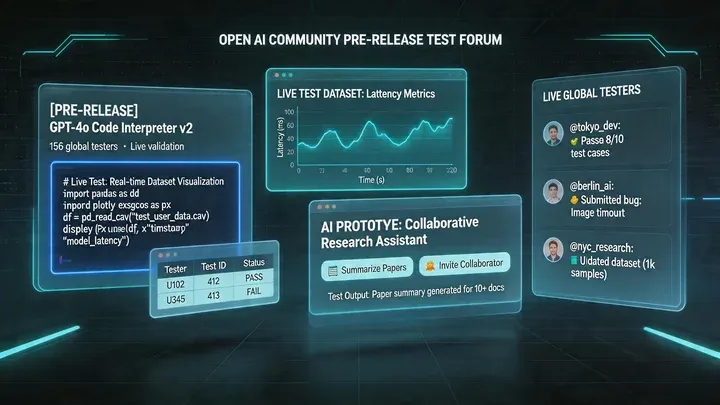

Community Prototype:社區成為驗證場

最後一個詞,講嘅係 AI 前沿方向嘅驗證方式。

以前驗證一個 AI 新能力係靠啲咩?

靠廠商發佈、靠媒體報導、靠專家評測。

2026 年,前沿實驗室開始傾向於「靜默發佈」—— 唔係開新聞發佈會,而係喺用戶不知不覺之間替換模型,等用戶透過行為變化自己去發現新能力。

ChatGPT 多咗個能力、Claude 嘅行為模式變咗—— 呢啲嘢最早被發現嘅地方係社區,而唔係官方公告。

社區成為咗發現者,亦都成為咗驗證者。

一個論文方向值唔值得做原型(prototype)?

有三個標準可以判斷:有代碼公開、有數據集、有明確嘅應用場景。

滿足呢三個條件嘅,社區會先跑一遍,然後反饋返嚟話呢個方向到底行唔行得通。

呢個唔係話社區比專家更加權威。

而係社區提供咗一樣嘢:

真實使用者喺真實場景入面嘅反饋。呢樣嘢同廠商嘅宣傳完全係兩回事。

An open community forum visualization with floating code snippets, datasets, and app prototypes being tested in real-time by invisible global users. Community members discovering and validating new AI capabilities before official announcements. Transparent collaborative testing environment.

五個詞語喺度講緊同一件事

Vibe Testing 講嘅係工作流入面嘅話語權——係 AI 適應人,而唔係人適應 AI。

User Control 講嘅係決策鏈條嘅控制權——人永遠係最終決策者。

Companion 講嘅係關係嘅持續性——AI 唔再係用完即走,而係會識得你、記住你。

Agentic Team 講嘅係組織邊界——個人可以擁有團隊級別嘅能力。

Community Prototype 講嘅係驗證機制——真實使用者嘅反饋比廠商嘅宣傳更加可信。

呢五個詞由唔同角度回答咗同一個根本問題:AI 同人到底係咩關係?

係 AI 取代人?AI 輔助人?定係 AI 同人協作?

2026 年嘅答案正喺度變得清晰:唔係取代,唔係輔助,而係協作。

而協作嘅前提係——人始終係主導者,AI 係執行者、夥伴、放大器。

記住呢五個詞。佢哋代表嘅唔單止係五個功能點,而係 AI 產品設計嘅下一個週期。

如果你喺度關注緊 AI 產品嘅下一個方向,歡迎加入 MixLab 無界社區。呢度聚集住最先觸達未來嗰一小部分人,正喺度一齊研究呢五個關鍵詞點樣落地成為真實嘅產品。

參考

[1] Top 11 Vibe Testing Tools 2026 — TestGrid Blog

[2] Vibe Testing Tools 2026 — testRigor Blog

[3] AI in 2026: 5 Product Shifts Redefining Digital UX — The Gradient

[4] 2026 will be the year of the AI living companion — Fast Company

[5] To Scale AI Agents Successfully, Think of Them Like Team Members — HBR

[6] How frontier AI labs actually ship new capabilities — Twitter @realarmaansidhu

2026年的AI產品設計,有五個詞正在頻繁出現。

Vibe Testing、

User Control、

Companionship、

Agentic Team、

Community Prototype。

每個詞都代表一種新的人機關係。不是功能,不是技術,是人和AI之間正在重新定義的協作方式。

A futuristic tech workspace where a human collaborates with five glowing AI orbs, each representing a different interaction paradigm — testing, control, companionship, team, and prototype. Clean minimal 2026 design language.

Vibe Testing:自然語言開始驅動AI

傳統的測試,是技術活。

寫測試用例、寫測試代碼、用Selenium或者Appium,測試工程師要懂編程、懂框架、懂自動化工具。

2026年,這套邏輯開始反轉。

testRigor、TestGrid這些工具推出了一種新測試方式—— 你用自然語言描述測試場景,AI自動執行測試,不需要寫代碼。

"打開登錄頁,輸入正確賬號密碼,點擊登錄"—— 這就是一個完整的測試用例,不需要寫成代碼,AI能理解,能執行。

這個變化背後的邏輯是:AI開始適應人的表達方式,而不是讓人去適應AI的語法。

Vibe Coding是同樣的邏輯—— 你描述你想要什麼,AI幫你生成代碼。Vibe Testing把這個邏輯延伸到了測試領域。Vibe Coding,國內第一本書

兩個Vibe加起來說的是同一件事:自然語言正在成為人機協作的新界面。

A person speaking naturally to an AI interface saying "Open login page, enter credentials, click submit" while AI instantly generates visual test cases on screen. No code visible — the AI adapts to human language. Modern testing dashboard with flowing conversation UI.

User Control:用戶越來越不想被AI主導

這是2026年最明顯的產品設計轉折。

2024到2025年,AI產品的主流思路是"AI給你答案,你接受就行"。結果是用戶感覺越來越失控 —— AI給錯了不知道、AI自己做了沒問過用戶、同樣的輸入有時候有不一樣的輸出。

信任下降了。

2026年的產品設計開始重新重視一件事:用戶控制權。

可解釋輸出—— AI不只是給答案,還要告訴你它怎麼得出這個答案,讓用戶自己能判斷信不信。

置信度顯示—— AI告訴用戶它對這個答案有多大的把握,高置信度還是低置信度。

干預機制—— 用戶可以撤銷AI的操作,可以直接修改AI生成的內容,可以在任何時候踩剎車。

這三個設計加在一起,回答的是同一個問題:

當AI越來越能自主行動的時候,人怎麼保持控制?

答案是:

不是限制AI做什麼,而是確保人永遠是最終決策者。

A sleek AI interface displaying a confidence meter and explanation panel — showing '87% confidence' with a breakdown of how the answer was derived. A human hand reaching toward the 'override' button, symbolizing user control. Clean futuristic dashboard with trust indicators and transparency metrics around the AI output.

Companion:從工具到陪伴者

AI companion市場2025年是377億美元,2026年預計達到495億美元,31%的複合增長率。

這個數字背後是一個產品形態的轉變。

傳統工具的邏輯是:用完即走。

每次打開都是從零開始,AI不認識你,不知道你之前做過什麼,不記得你的偏好。

陪伴型AI不一樣。

它記住跨會話的歷史,建立長期記憶檔案,在意你和它的關係。

不是回答完問題就結束了,而是在這個過程中積累對你的理解。下一次你回來,它知道你關心什麼、你知道什麼、你踩過哪些坑。

一個預測說得很直接:

今年會成為AI生活陪伴者的年份。

這不是一個功能變化。是產品底層邏輯的變化 —— 從功能設計到關係設計。

衡量一個工具好不好,看的是任務完成率。衡量一個陪伴型AI好不好,看的是用戶留存率 —— 用戶願意持續和它交互嗎?

這個標準的轉變,意味着整個產品設計都要重新思考。

Two silhouettes of a person and an AI companion in a warm glowing circle — the AI has accumulated layers of memory cards, journal entries, and shared history around it. The person is looking at a timeline showing past conversations, preferences, and learned habits. A heart symbol connecting both. Intimate yet technological atmosphere, soft lighting, 2026 design aesthetic.

Agentic Team:個人開始擁有團隊能力

以前一個公司才能有團隊。因為團隊需要人,人需要薪資、福利、培訓、管理成本。

2026年,這個邏輯開始被打破。

HBR在一篇文章裏說:組織應該把每個AI Agent當作一個獨立的數字員工來管理——每個Agent有自己的身份、憑證和角色。

一個人可以配置自己的Agent團隊:一個Agent負責研究,一個負責執行,一個負責檢查,直接彙報給你。

每個Agent有自己的角色定義,可以調用不同的工具,可以訪問不同的數據源。它們協作、它們可能衝突、它們需要管理。

這意味着什麼?

意味着傳統的公司層級開始被打破。

一個人的能力不再受限於自己的時間和精力,而是可以被Agent團隊放大。

當然,這個變化帶來新的挑戰:

誰來為Agent的產出負責?怎麼建立Agent之間的衝突處理機制?怎麼確保Agent的行為在人的掌控之下?

這些問題沒有標準答案。但它們已經是正在發生的事情,不是假設場景。

Agent Team,從零構建 Claude Code Agent 工作流

A single person at a command center overseeing three AI agents working in parallel — one researching, one executing tasks, one reviewing — each as an autonomous digital avatar with distinct roles connected by neural network. One human orchestrator in the center, not the worker.

Community Prototype:社區成為驗證場

最後一個詞,說的是AI前沿方向的驗證方式。

以前驗證一個AI新能力靠什麼?

靠廠商發佈、靠媒體報道、靠專家評測。

2026年,前沿實驗室開始傾向於靜默發佈—— 不是開新聞發佈會,而是在用戶不知不覺中替換模型,用戶通過行為變化自己發現新能力。

ChatGPT多了一個能力、Claude的行為模式變了—— 這些最早被發現的地方是社區,不是官方公告。

社區成為發現者,也成為驗證者。

一個論文方向值不值得做原型?

有三個標準可以判斷:有代碼公開、有數據集、有明確應用場景。

滿足這三個條件的,社區會先跑一遍,然後反饋說這個方向到底行不行。

這不是說社區比專家更權威。

而是社區提供了一個東西:

真實使用者在真實場景裏的反饋。這和廠商宣傳不是一回事。

An open community forum visualization with floating code snippets, datasets, and app prototypes being tested in real-time by invisible global users. Community members discovering and validating new AI capabilities before official announcements. Transparent collaborative testing environment.

五個詞在說同一件事

Vibe Testing說的是工作流裏的話語權——是AI適應人,不是人適應AI。

User Control說的是決策鏈條的控制權——人永遠是最終決策者。

Companion說的是關係的持續性——AI不再用完即走,而是認識你記住你。

Agentic Team說的是組織邊界——個人可以擁有團隊能力。

Community Prototype說的是驗證機制——真實使用者的反饋比廠商宣傳更可信。

五個詞從不同角度回答了同一個根本問題:AI和人到底是什麼關係?

是AI替代人?AI輔助人?還是AI和人協作?

2026年的答案正在變得清晰:不是替代,不是輔助,是協作。

而協作的前提是——人始終是主導者,AI是執行者、夥伴、放大器。

記住這五個詞。它們代表的不只是五個功能點,是AI產品設計的下一個週期。

如果你在關注AI產品的下一個方向,歡迎加入 MixLab 無界社區。這裏聚集着最先觸達未來的那一小部份人,正在一起研究這五個關鍵詞怎麼落地成真實產品。

參考

[1] Top 11 Vibe Testing Tools 2026 — TestGrid Blog

[2] Vibe Testing Tools 2026 — testRigor Blog

[3] AI in 2026: 5 Product Shifts Redefining Digital UX — The Gradient

[4] 2026 will be the year of the AI living companion — Fast Company

[5] To Scale AI Agents Successfully, Think of Them Like Team Members — HBR

[6] How frontier AI labs actually ship new capabilities — Twitter @realarmaansidhu