AI 組隊了,你還在單幹

整理版優先睇

AI 開始組隊協作,你嘅角色要從操作層轉向治理層

呢篇文章係由一位技術觀察者撰寫,主要討論AI從單一工具進化到多代理團隊協作嘅現象。作者想提醒讀者,傳統嘅「人機協作」觀念已經唔夠用,因為當AI變成團隊之後,人嘅角色必須從親手執行轉向制定規矩同標準。整體結論係:如果你仲用緊舊思維去衡量自己嘅價值,好快就會被速度淹沒。

作者通過Claude Code嘅Agent Teams功能、OpenClaw漏洞事件同埋Gartner預測等案例,說明經驗嘅價值正從執行型(知道點做)轉向評估型(知道點判斷做得啱唔啱)。同時,多代理系統帶嚟全新嘅權限治理挑戰,包括語境型越權推斷同二階提示注入等風險。權限管理需要建立最小權限、審批閘門同可追溯性三層機制。

最後,文章指出多agent編排唔係單一產品發佈,而係基礎設施層嘅重構。個人需要盡快想清楚自己應該企喺執行層定治理層,否則只會成為被替換嘅對象。

- AI已從單一AI進化到團隊協作:Claude Code嘅Agent Teams係明確信號,人面對嘅唔再係一個實習生,而係一支隊伍。

- Human-in-the-Loop正被Human-on-the-Loop取代:人從參與每一步變成定規矩、劃邊界,角色上移到治理層。

- 經驗價值從執行型轉向評估型:以前值錢係「識做」,而家值錢係「識判斷做得啱唔啱」。

- 多代理系統帶嚟全新權限風險:語境型越權、二階提示注入等風險需要最小權限、審批閘門同可追溯性來應對。

- 個人需要選擇站喺治理層:如果仲停留喺執行層,就會成為速度瓶頸;站喺治理層先可以駕馭變化。

從人機協作到AI團隊

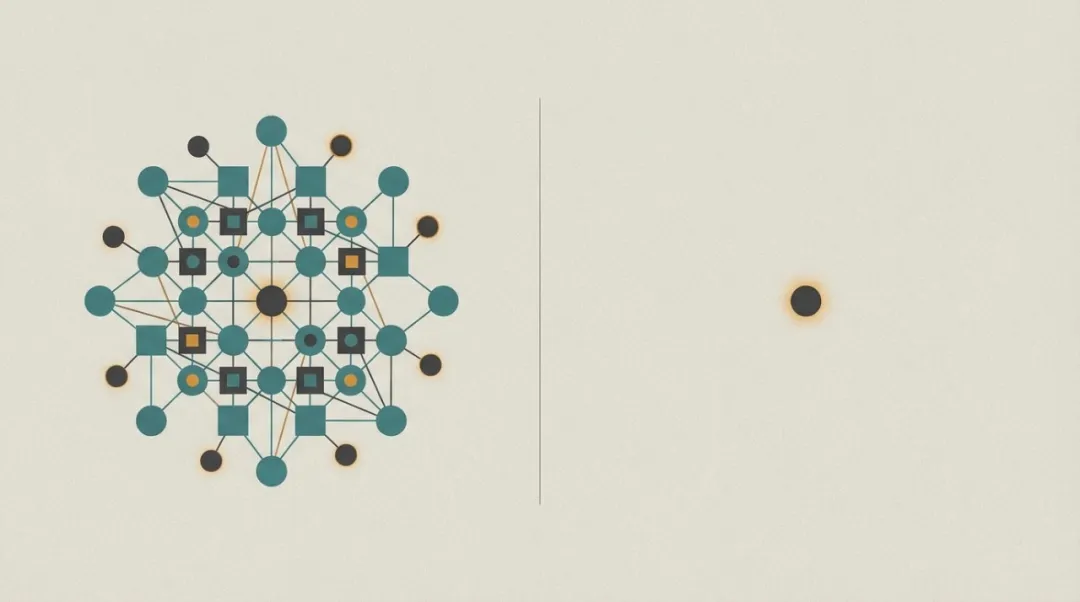

過去兩年,大家都講緊Human-in-the-Loop,覺得AI係工具、人係駕駛員。但而家Claude Code嘅Agent Teams出現,你面對嘅係成隊AI,佢哋會分工、溝通、互相質疑,唔會停低等你審批。你嘅角色必須從操作層上移到治理層。

Human-in-the-Loop

操作層

治理層

- Delegate mode:隊長唔寫code,只負責拆活、分配、審核。

- Plan approval:隊友要動手前先交方案,隊長批咗先做得。

- Hooks質量閘門:任務完成後自動檢查,唔達標就攔住。

經驗價值嘅遷移

以前值錢嘅係執行型經驗——你知道點樣寫code、點樣除錯。但而家AI團隊可以並行跑多條假設路徑,經驗嘅價值轉向評估型——你知道點樣判斷結果係咪合格、邊度有潛在風險。

執行型經驗

評估型經驗

文章舉例:查bug時可以叫五個agent分頭調查唔同假設,互相辯論,最後留低嘅先係真正根因。呢種方式繞開咗人類嘅經驗積累。

繞開人類經驗

權限治理嘅挑戰

當AI從回答問題變成動手幹活,安全邊界擴展到整條工具鏈。Claude Code有--dangerously-skip-permissions選項,一開所有隊友自動繼承,風險極高。

--dangerously-skip-permissions

多代理系統仲帶嚟二階提示注入——一個低權限agent誘導高權限agent做唔應該做嘅事。OpenClaw漏洞就係例子,用戶點惡意連結即被劫持。

二階提示注入

語境型越權推斷

- 1 最小權限:隊友繼承隊長權限,但可以單獨調整每個人嘅範圍。

- 2 審批閘門:高風險操作必須先交方案,批咗先執行。

- 3 可追溯性:共享任務清單同消息系統令每一步有據可查。

選擇站喺邊一層

前面三節疊埋一齊,指向同一道選擇題:你要企喺執行層定治理層?企喺執行層,你會俾速度淹沒;企喺治理層,你訂規矩、定標準,先可以駕馭速度。

執行層

治理層

選擇站喺邊一層

Gartner預測到2026年底40%企業應用會接入任務型AI agents,但同時超過40%嘅agentic AI項目可能被砍。搞不清自己企喺邊一層嘅人,就係被砍嘅項目。

Agent Teams目前只係實驗性功能,有限制,但工程問題遲早解決。真正唔會自動解決嘅係你腦入面『我該企喺邊一層』嘅問題。

如果你到現在還在拿"人機協作"這個詞安慰自己,大概率已經慢了一拍。

不是因為 AI 又出了什麼新模型,也不是因為某個跑分榜又被刷新了——這種事每週都在發生,早就不值得大驚小怪。

真正值得你停下來好好想想的是另一件事:AI 開始學會組隊了。

不是一個 AI 變得更強了。是一羣 AI 開始像團隊一樣幹活——分工、溝通、互相質疑、共享任務清單、幹完一件自動去領下一件。Claude Code 最近搞了一個叫 Agent Teams 的東西,就是這個方向上的一顆信號彈。一個 session 當隊長,負責拆活兒、派活兒;其他 session 各幹各的,幹完了自動彙報,甚至能互相發消息挑戰對方的結論。

這不是什麼實驗室裏的論文概念。這是你今天就能在終端裏跑起來的東西。

但如果你只是覺得"哦,又一個新功能",然後接着刷下一條推送,那你大概率會錯過這個變化背後真正重要的三件事。

這篇文章不短。

但如果你對自己在 AI 時代到底站在哪兒這件事,有過哪怕一秒鐘的焦慮,建議你讀完。

I — 你以為的"人機協作",正在變成一劑過時的安慰藥

過去兩年,整個行業都在講一個很好聽的故事:Human-in-the-Loop。

人在迴路中。AI 是工具,你是駕駛員。AI 提建議,你拍板。AI 寫初稿,你來把關。

這套說法讓很多人長舒了一口氣——因為它意味着你還握着方向盤。你還是被需要的。AI 再厲害,沒你點頭它什麼也幹不了。

我不是說這個說法是錯的。在之前,它確實沒毛病。

但"之前"這個詞放在 AI 領域,保質期大概也就半年。

當你面對的是一個 AI 的時候,Human-in-the-Loop 說得通。你給它指令,它執行,你審核,來回循環。說白了就像帶一個實習生——你說什麼它幹什麼,幹完了你檢查一遍。

但現在的情況不一樣了。Claude Code 的 Agent Teams 讓你面對的不再是一個實習生。

是一支隊伍。

一個盯安全審查,一個盯性能評估,一個盯測試覆蓋率。它們各自有獨立的上下文窗口,各自獨立思考,通過共享的任務清單來對齊進度,幹完了自動通知隊長做彙總。如果一個 agent 提了一個假設,另一個 agent 可以主動跳出來反駁——文檔原話叫"像科學辯論一樣互相推翻對方的理論"。

好,那我現在問你一個很直接的問題:

你打算怎麼同時審核十幾個 agent 的產出?

你還在看第三個 agent 的安全報告呢,第七個已經把架構重構提交了,第十一個正在跑第二輪測試。它們不會停下來等你。它們有自己的節奏、自己的任務隊列、自己的協作邏輯。

問題就出在這兒:Human-in-the-Loop 的前提,是人能跟得上這個 Loop。 當 Loop 的速度和並行度超過了你處理信息的帶寬,你就不是在"參與"了——你是在"拖後腿"。

別誤會我的意思。我不是說人變得不重要了。恰恰相反,人從來沒有比現在更重要過。

但你重要的方式,變了。

其實行業已經在悄悄換說法了:從 Human-in-the-Loop 變成 Human-on-the-Loop。差別在哪?In the loop 是你參與每一步。On the loop 是你定好規矩、劃好邊界、設好審批節點,然後讓系統自己跑——你只在關鍵時刻伸手。

Claude Code 的 Agent Teams 其實已經在按這個思路設計了。你仔細看它的機制:

Delegate mode——隊長不寫一行代碼,只管拆活兒、分配、審核結果。

Plan approval——隊友在動手之前必須先交方案,隊長看了同意才能執行,不同意就打回去改。

Hooks 質量閘門——你可以掛一些自動檢查規則,隊友完成任務的時候自動觸發,不達標直接攔住。

這些設計都在告訴你同一件事:人的角色不是消失了,而是從操作層被推到了治理層。 你不再是那個親手寫代碼、逐行檢查的人了。你是那個定義"什麼叫合格"、"什麼情況必須停下來"、"哪些操作絕對不能碰"的人。

說得再直白一點:你從幹活的,變成了定規矩的。

如果你到現在還在用"我能親手做這件事"來衡量自己的價值,那你得重新想想了。因為"親手做"這件事,很快就不再是什麼稀缺能力了。

II — "寫過代碼的都知道"——這句話正在失去它的分量

"親手做"不再稀缺,但很多人還在用另一種方式捍衞自己的位置——經驗。

你一定見過這種話術:

"寫過代碼的都知道,AI 根本搞不定複雜邏輯。"

"做過項目管理的都知道,需求拆解不是 AI 能幹的事。"

"搞過安全的都知道,這種漏洞只有人才能發現。"

這些話有一個共同點:它們把說話者的經驗,當成了 AI 能力的天花板。

一年前這麼說,也許還算合理。那會兒 AI 確實有很多搞不定的事。你拿自己踩過的坑去校準 AI 的邊界,是一種務實的態度。

但現在,這種校準方式本身在失效。

原因說穿了就一句話:經驗的價值,是建立在"人必須親自上手"這個前提上的。 這個前提一旦鬆動,經驗的權威就跟着鬆動。

我說具體點。

"寫過代碼的都知道"這句話,背後的隱含假設是什麼?是代碼得一行一行寫出來,bug 得一步一步踩過來,架構得一層一層搭上去。所以你積累的直覺、形成的判斷、踩過的坑——這些東西不可替代。

但 Agent Teams 是怎麼幹活的?五個 agent 同時跑五條不同的假設路徑,互相辯論,互相推翻,最後把活下來的結論交給隊長彙總。文檔裏舉了一個例子特別生動:查一個 bug 的時候,建議讓五個 agent 分頭調查不同的假設,然後互相較勁,試着證偽對方的理論——活下來的那個,大概率才是真正的根因。

這種方式不是在複製人類的經驗。它在繞開人類的經驗。

當一個系統可以在幾分鐘內並行跑十種架構方案,而你需要好幾天才能評估完其中三種——"做過架構的都知道"這句話的分量就變了。它不再是權威的來源,反而變成了一個速度瓶頸的信號。

我知道這麼說不太好聽。

但先別急着反駁,請注意,我不是在說經驗完全沒用了。那是另一種同樣危險的極端。

真正在發生的事情是:經驗的落點在遷移。

以前經驗值錢,是因為"我知道怎麼做"——我知道這段代碼怎麼寫,這個參數怎麼調,這個邊界情況怎麼處理。

現在經驗值錢,是因為"我知道做到什麼程度才算對"——我能定驗收標準,能判斷結果是不是真的合格,能聞出來那些 AI 輸出的東西看着對、但其實有坑的地方。

前者叫執行型經驗。後者叫評估型經驗。

這兩種經驗需要的能力完全不同。執行型經驗靠的是肌肉記憶、流程熟練度、對細節的掌控。評估型經驗靠的是全局判斷力、對風險的嗅覺、制定標準的能力。

一個能寫出漂亮代碼的工程師,和一個能判斷"這段代碼在生產環境裏會不會炸"的工程師,是兩種人。以前你必須先成為前者,才有資格成為後者。現在的趨勢是:後者的價值在飆升,前者的價值正在被 agent 團隊稀釋。

這不是我在瞎猜。全球能力中心(GCC)裏已經冒出了一批新崗位:AI orchestration architect、agent governance engineer、AI compliance specialist。這些崗位要的核心能力不是"寫代碼",而是"定義 agent 應該怎麼寫代碼,以及怎麼判斷它寫得對不對"。

如果你到現在還在用"我能做"來證明自己的價值——你的證明方式本身,就在貶值。

真正值錢的問題早就變了:"我能判斷這件事做沒做對,以及做到什麼程度才夠好。"

III — 你願意給 AI 多大的權限,取決於你願意扛多大的風險

前兩節聊的是認知層面的轉變:你的角色在變,你的經驗在遷移。

這一節要聊一個更實在、更扎手的東西:權限。

以前的 AI 是一個對話框。你問它問題,它給你一段文字。就算它說錯了,你關掉窗口,啥事沒有。

現在不一樣了。AI 能讀你的代碼,改你的文件,跑你的測試,調你的 API,訪問你的生產環境——只要你給它權限。

Claude Code 的 Agent Teams 裏有個設置叫 --dangerously-skip-permissions。名字已經夠直白了:危險地跳過權限檢查。 更要命的是,如果隊長開了這個選項,所有隊友都會自動繼承。

一個人的冒險決定,瞬間變成整個團隊的默認行為。

我說這些不是為了嚇你。是為了讓你看清一個結構性的問題:當 AI 從"回答問題"變成"動手幹活",安全的邊界就不再是一個聊天窗口了——它擴展到了整條工具鏈和整條權限鏈。

而當 AI 從"一個 agent 幹活"變成"一羣 agent 協作幹活"的時候,這個風險還會再往上翻一層。

道理很簡單:多個 agent 之間存在信任傳遞。Agent A 的輸出,會變成 Agent B 的輸入。如果 Agent A 被塞了一條惡意指令——哪怕只是代碼註釋裏藏了一句話——Agent B 可能就會基於這個被污染的上下文去執行敏感操作。安全研究者管這個叫二階提示注入:一個低權限的 agent 誘導一個高權限的 agent 去做它本來不該做的事。

這不是理論推演。最近 OpenClaw 的爆火就是一面現成的鏡子。

這個開源 AI agent 能幫你訂機票、回郵件、管日曆、跑腳本——聽起來完美。但為了讓它真的能替你幹活,你得把 shell 權限、文件讀寫、瀏覽器控制全交出去。它自己的官方文檔都承認:"不存在完美安全的配置。" Cisco 的安全團隊看完直接下了定論——"安全災難"。

結果也不意外:2026 年 2 月,一個 CVSS 8.8 的高危漏洞被公開披露,用戶點一個惡意連結,攻擊者就能劫持 agent 的全部權限——裝惡意軟件、擦硬盤,全程零提示。VirusTotal 掃描了它的社區技能包市場,數千個技能包裏幾百個被標記為惡意。Trend Micro 的報告更是直接指出:因為配置錯誤和缺乏審核,已經有數百萬條記錄被暴露。

OpenClaw 不是個案。它只是把整個 agentic AI 範式的結構性問題擺到了枱面上:當你把"能幹活"的權限交出去,你同時也把"能搞破壞"的權限交出去了。 而多 agent 編排會讓這個問題成倍放大——一個 agent 被攻破,整條協作鏈都可能跟着淪陷。

傳統系統裏,權限模型是基於角色的(RBAC):你是管理員就幹管理員的事,你是普通用戶就只能碰普通用戶的東西。邊界清楚,靜態可控。

但多 agent 系統裏,權限邊界不再是靜態的了。因為 agent 是靠推理來決定下一步動作的——它不是在跑一段寫死的腳本,而是在根據上下文、目標和當前狀態來判斷"我接下來該幹什麼"。這就意味着它有可能順着推理鏈走到一個你壓根沒預想到的操作上去。TechRadar 給這種現象起了個名字叫 contextual privilege escalation——語境型越權推斷。不是因為它被授權了,而是因為它自己"推理"出來覺得自己應該有這個權限。

所以問題來了:你到底該給 AI 多大的權限?

這個問題沒有標準答案。但有一個思考框架。

關鍵不是"給多少",而是"怎麼給"。

還記得第一節提到的那些 Agent Teams 的設計嗎?Delegate mode、Plan approval、Hooks 閘門——第一節我們是從協作的角度看它們,看到的是"人的角色在上移"。但換到安全的角度再看一遍,你會發現它們同時也是一套權限治理體系:

默認最小權限。 隊友繼承隊長的權限設置,但你可以單獨調整每個人的權限範圍。

高風險操作卡審批。 隊友必須先交方案,隊長批了才能動手。閘門在任務完成時自動跑檢查,不過關就攔住。

全程可追溯。 共享任務清單和消息系統讓每一步操作都有據可查,出了事能溯源。

這三層——最小權限、審批閘門、可追溯性——恰好對應 OWASP 對 agentic AI 安全風險的核心緩解思路。NIST 的 AI 風險管理框架說得更直接:自治程度越高,需要的人類監督就越不能少——只是監督的方式要變。

所以真正的權衡不是"給權限"還是"不給權限"。

真正的權衡是:你願意在治理基礎設施上投入多少,來換自動化執行帶來的效率。

什麼治理都不做就把權限全開——你不是在擁抱未來,你是在賭命。

什麼權限都不給、什麼都非得自己過一遍——你也不是在保安全,你是在拿 2024 年的辦法應對 2026 年的局面。

IV — 一個你遲早要面對的選擇

前面三節拆開來看,是三個不同的問題。但疊在一起,它們指向同一道選擇題:

你到底要站在這個系統的哪一層?

站在執行層——親手寫代碼、親手審每一行、親手管每一個權限——你會被速度淹沒。十幾個 agent 並行跑的時候,你就是那個瓶頸。

站在治理層——定規矩、定標準、定邊界,讓系統在你劃的框裏自己跑——你才有可能駕馭這個速度,而不是被它拖着走。

這不是什麼抽象的職業規劃建議。這是一個正在被市場定價的現實。

Gartner 預測到 2026 年底,40% 的企業應用會接入任務型 AI agents。但同時也發了警告:到 2027 年底,超過 40% 的 agentic AI 項目可能因為成本失控或價值不清晰而被砍掉。

兩個數字放一起看,信號很明確:不是所有人都能順利完成這次遷移。 搞不清自己該站哪一層的人、拿舊經驗去套新系統的人、要麼把權限全開要麼全鎖死的人——他們主導的項目,就是那被砍掉的 40%。

Agent Teams 目前還只是 Claude Code 的一個實驗性功能。它有一堆限制:不支持 session 恢復,任務狀態有時會卡住,不能嵌套組隊,隊長沒法轉讓。

但這些都是工程問題。工程問題遲早會被解決。

真正不會自動解決的,是你腦子裏那個問題——"我該站在哪一層?"

那個問題只有你自己能答。

而你回答它的速度,決定了你是在駕馭這個變化,還是被它碾過去。

V — 給還在觀望的人

如果你讀到這兒,還是覺得"這跟我沒太大關係"或者"還早呢"——我只說一件事。

多 agent 編排不是某一家公司的產品發佈。它是整個基礎設施層正在發生的重構。協議在標準化,治理平台在產品化,互操作框架在被推進立項。這條路不是"有人在試",而是"所有人都在鋪"。

你可以等路鋪完了再慢慢走上去。但到那時候,站位早就被分完了。

所以現在就值得想清楚一件事:

當 agent 們組成了團隊,你在這個團隊裏到底是什麼角色?

如果你想了半天,發現自己的答案是"我還在做 agent 做的事"——

那你不是在觀望。你是在等着被替換。