Anthropic CEO Dario Amodei:海嘯已在地平線上,但沒人在看

整理版優先睇

Anthropic CEO 警告 AI 海嘯已到地平線,社會認知嚴重滯後

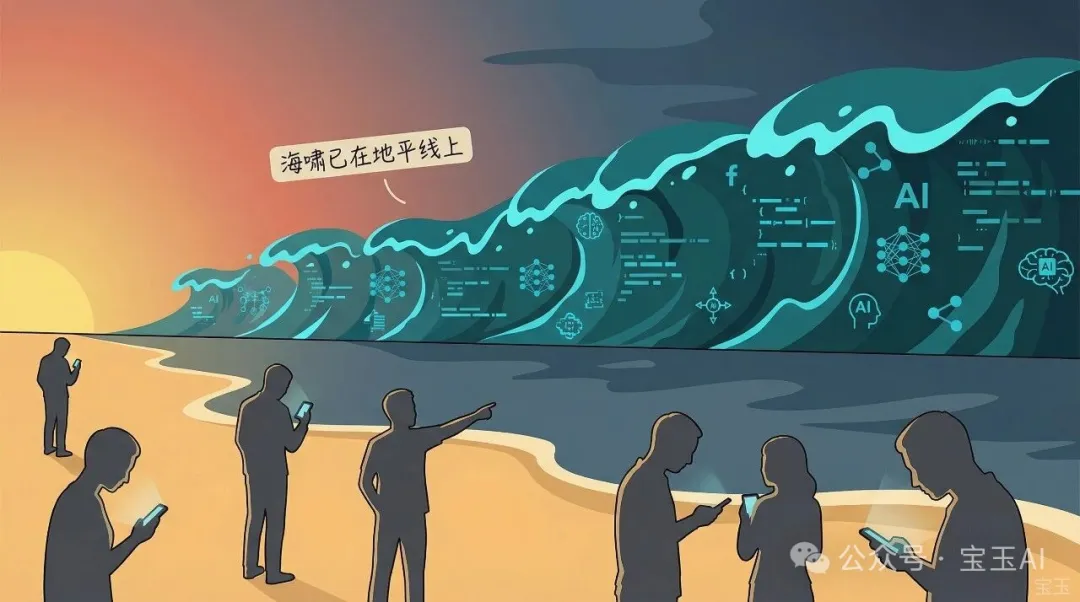

呢篇文章係 Anthropic CEO Dario Amodei 同印度創業者 Nikhil Kamath 嘅深度訪談。Dario 本身係物理同生物物理背景,原本想做教授,但因為覺得生物學太複雜而轉投 AI。佢喺 OpenAI 早期加入,係 scaling laws 嘅最早發現者之一,但因為安全理念分歧而離開創辦 Anthropic。整體結論係:AI 技術進展比預期快,但社會對即將到來嘅顛覆幾乎毫無準備,好似海嘯已經喺地平線,但冇人當真。

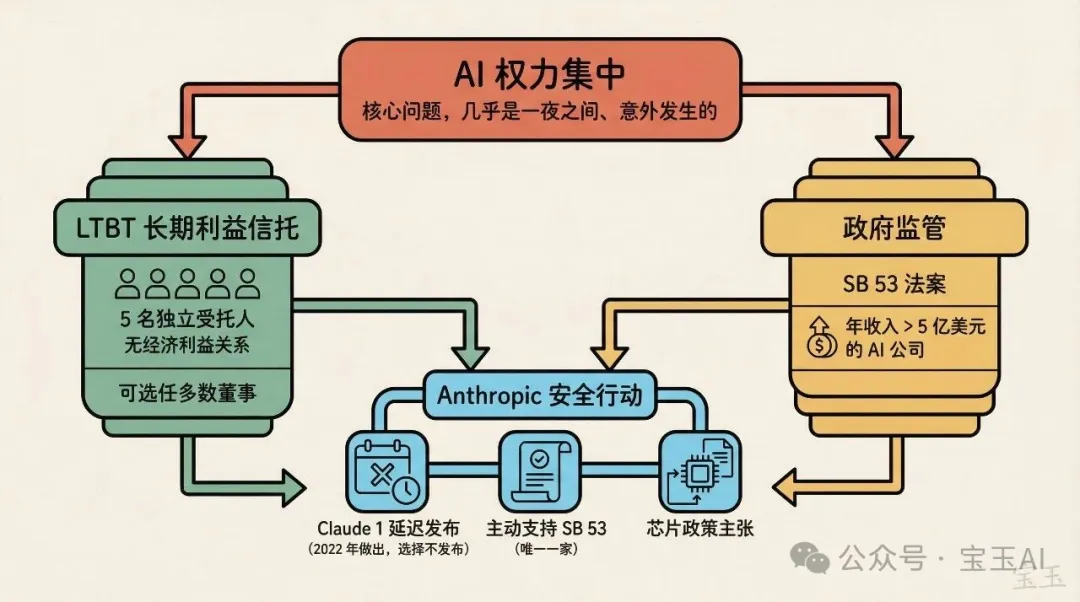

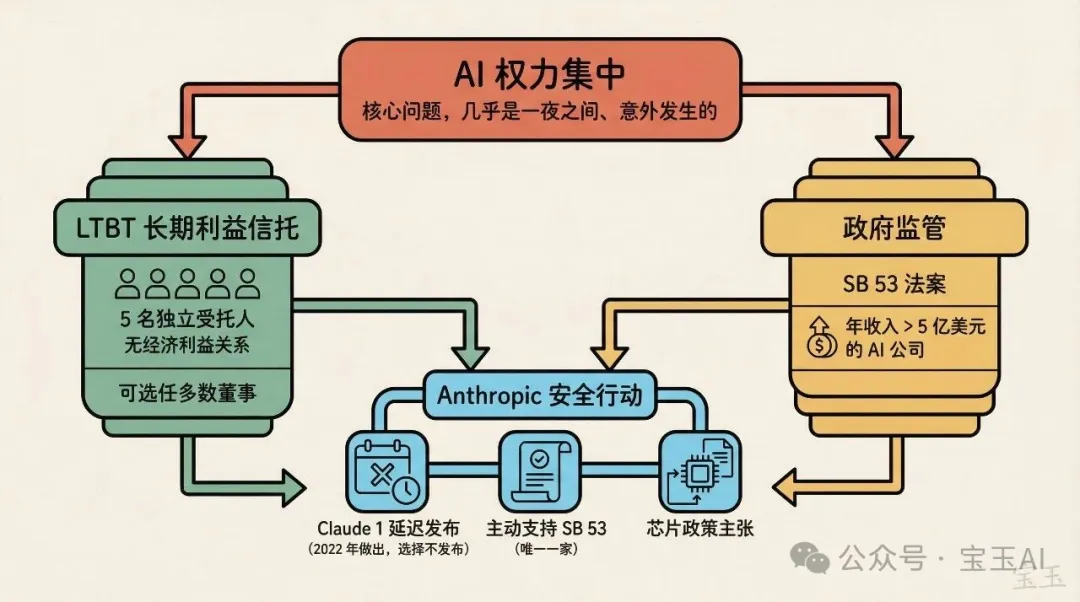

Dario 承認權力集中令佢不安,但佢透過 LTBT 信託同推動 SB 53 法案嚟制衡。佢認為技術安全工作(例如可解釋性)比預期好,但社會認知比預期差,兩者大致抵消。佢預測寫代碼會最先被 AI 取代,然後係更廣泛嘅軟件工程,但人際技能同物理世界工作仲有緩衝。

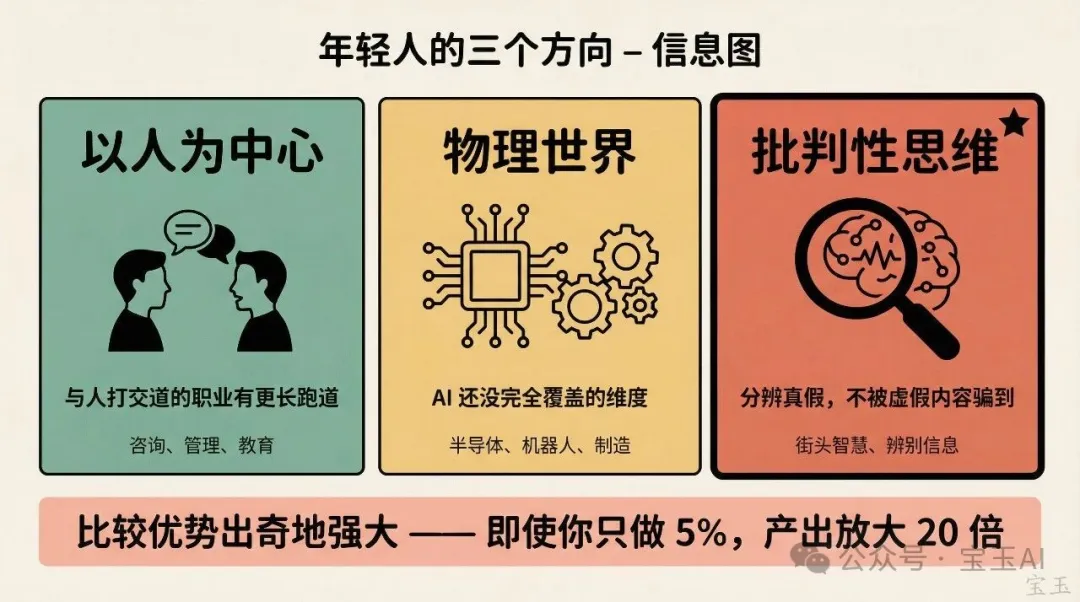

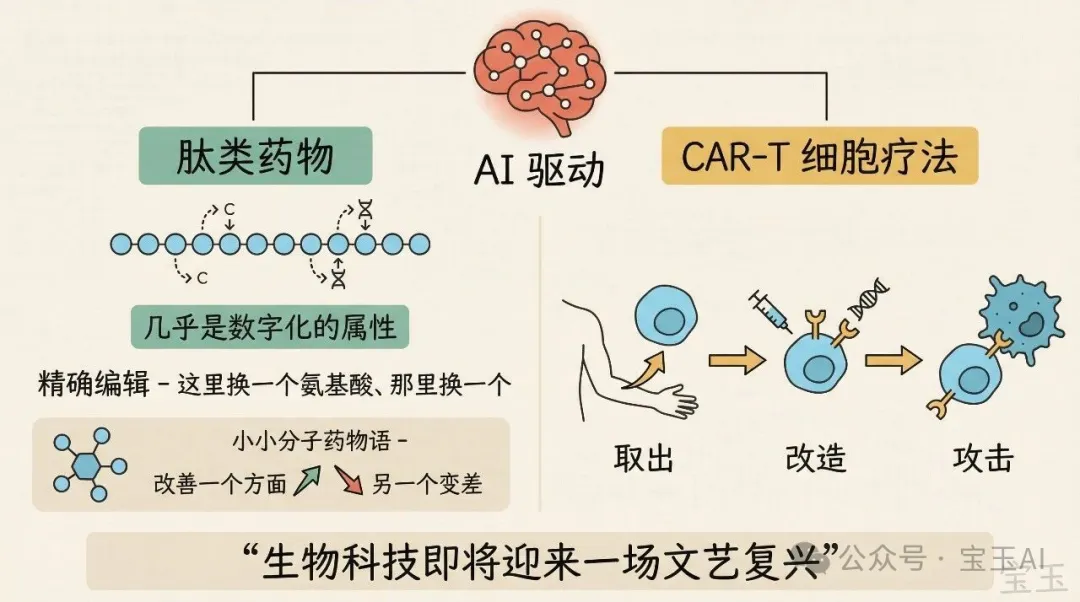

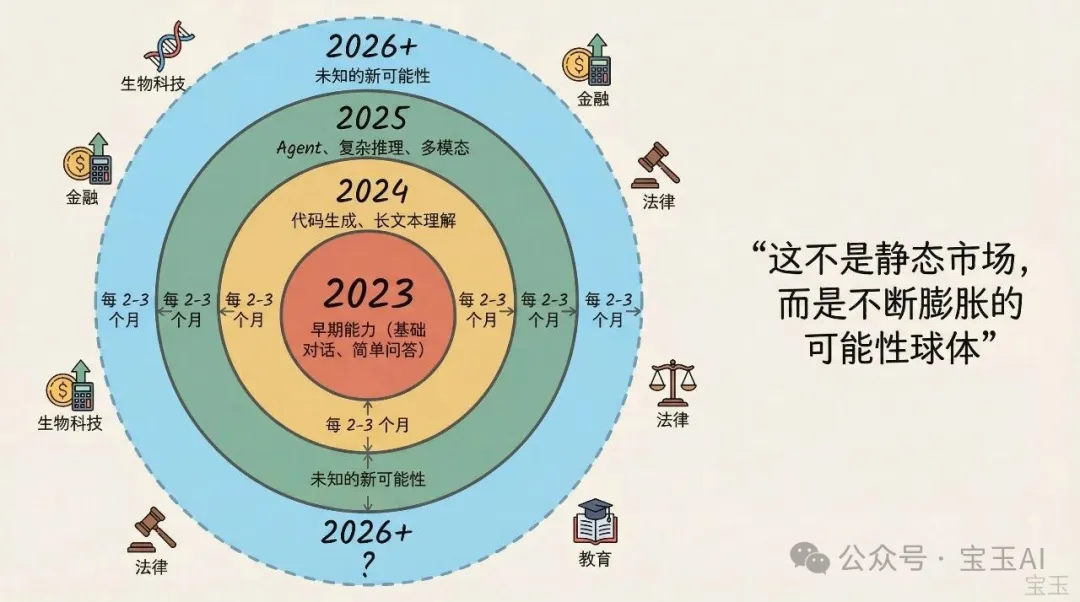

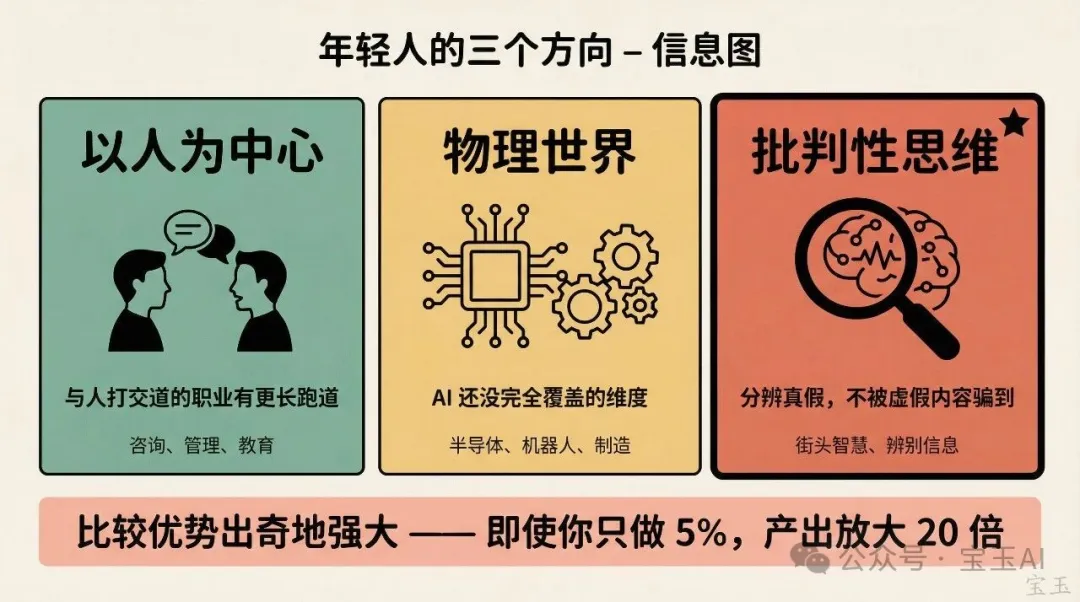

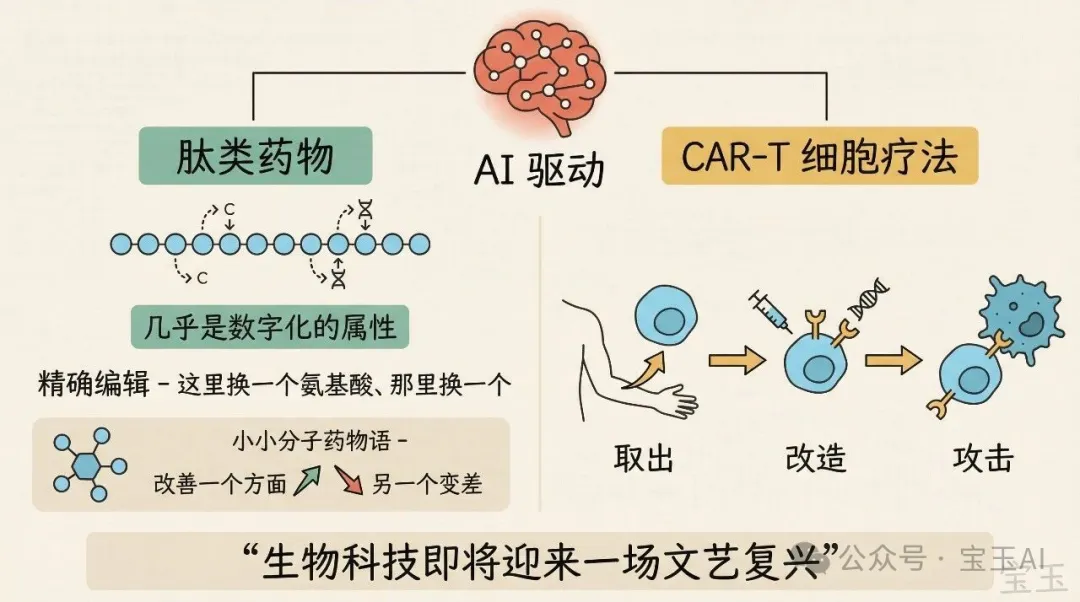

對於創業者,Dario 建議唔好做「套殼」產品,要建立行業壁壘,例如生物×AI 或金融服務。年輕人應學批判性思維,因為分辨真假變得愈來愈重要。佢睇好肽類藥物同 CAR-T 細胞療法,認為 AI 會帶嚟生物科技嘅文藝復興。

- Dario 認為 AI 逼近人類智能,但社會認知嚴重滯後;技術安全進展超預期,但社會層面嘅悲觀令整體感受持平。

- Anthropic 喺 2022 年已有 Claude 1 但選擇唔發布,避免軍備競賽,代價係可能讓出消費者 AI 領先地位。

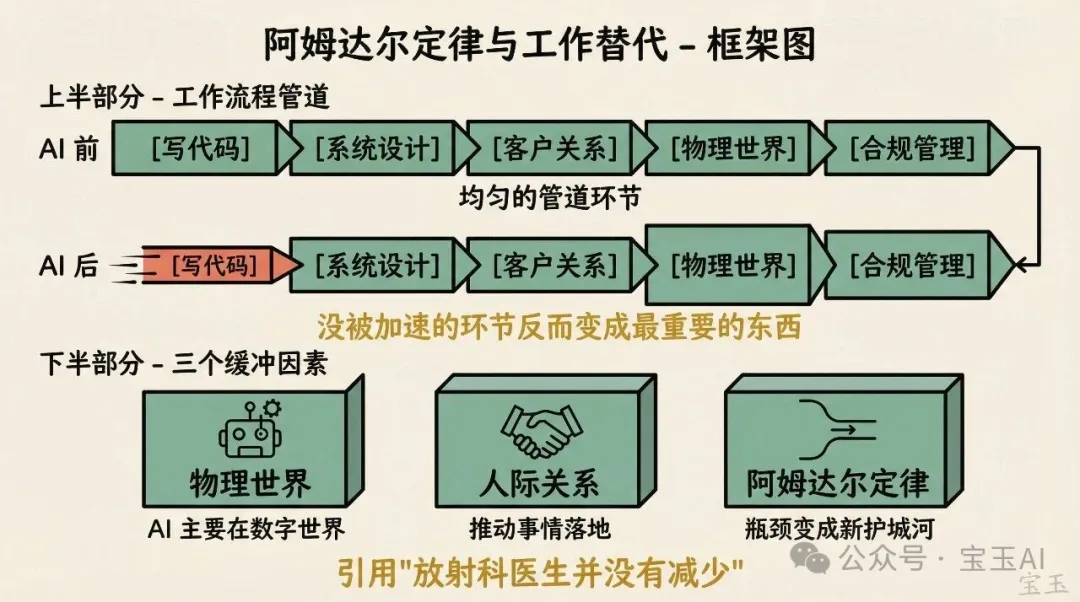

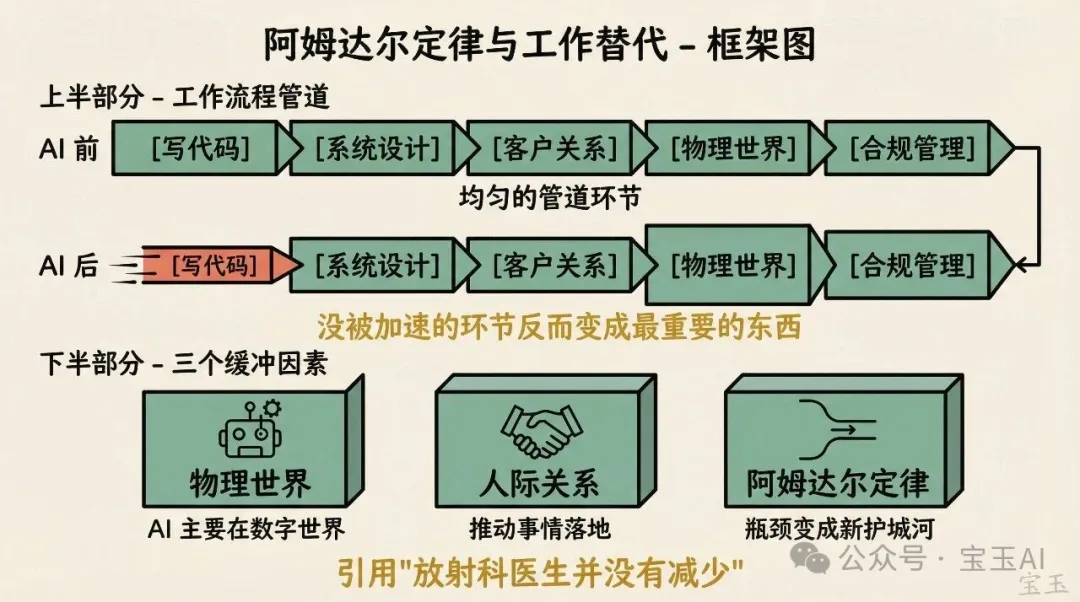

- AI 會先取代寫代碼,再取代軟件工程;但人際關係同物理世界工作短期仍有保護,阿姆達爾定律解釋未被加速嘅環節會變更重要。

- 創業者要建立護城河,唔好只做 Claude 嘅套殼;應聚焦生物、金融等高效低競爭領域,Anthropic 唔會做曬所有第一方產品。

- 年輕人應該學習批判性思維、以人為中心嘅工作,同埋物理世界相關技能;比較優勢仍然強大,即使只做 5% 嘅任務,產出都可以放大 20 倍。

從生物學家到 AI 領袖:一條被絕望驅動嘅路

Dario Amodei 原本想做教授,研究生物系統係為咗治病,但佢發現蛋白質嘅複雜度超出人類理解極限,開始絕望。喺嗰個時候,佢注意到 AlexNet,意識到 AI 先係最終解決生物學問題嘅工具。

佢先後喺百度同 Google 工作,然後喺 OpenAI 成立幾個月後加入</highlight>,領導整個研究部門好幾年。最終因為安全理念分歧而離開。

Nikhil 追問離開原因,Dario 話有兩個核心信念驅動:第一個係 scaling laws</highlight>,佢喺 2019 年研究 GPT-2 時最先睇到呢個趨勢,成功說服 OpenAI 重視;第二個係安全信念——如果模型成為通用認知工具,經濟同地緣影響會好巨大,但佢唔被說服 OpenAI 真係認真做安全。

Scaling Laws 同安全承諾:化學反應同代價

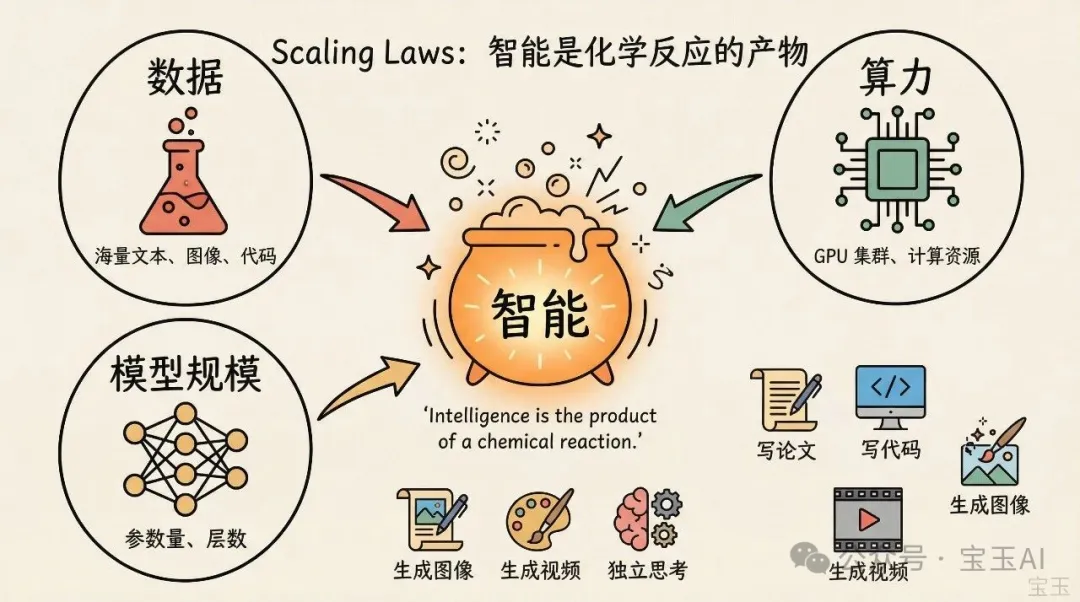

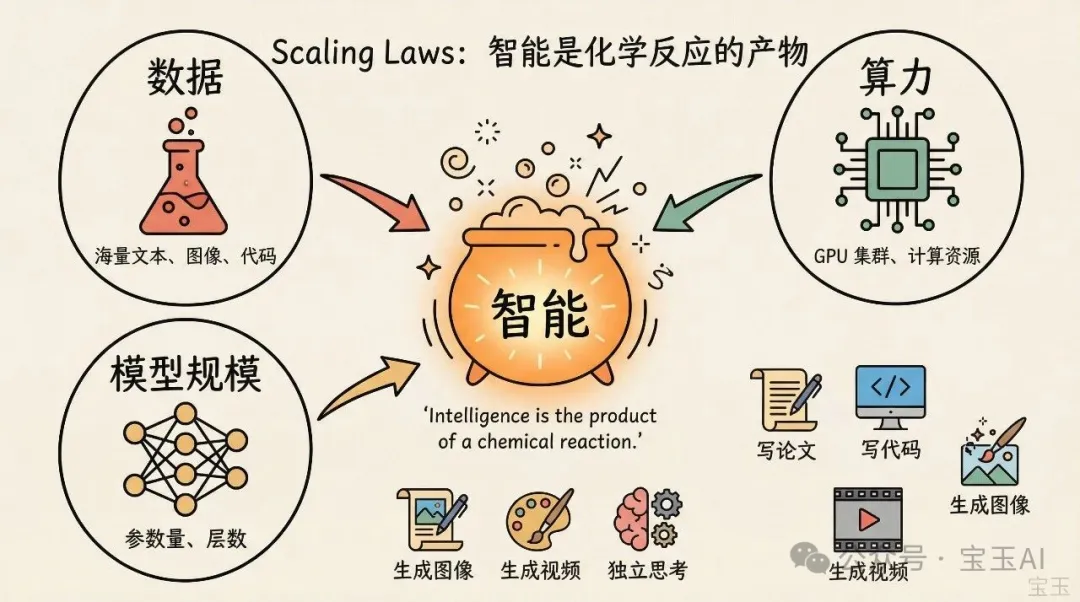

Dario 用 化學反應</highlight> 比喻 scaling laws:智能係數據、算力同模型規模呢啲原料嘅產物。五年前你做唔到叫電腦寫論文、生成圖像或視頻,而家模型可以自己思考假設性問題。

安全方面,Anthropic 做咗具體行動:2022 年有 Claude 1 但 選擇唔發布</highlight>,擔心引發軍備競賽;係唯一支持加州 SB 53</highlight> 法案嘅大型 AI 公司;喺芯片政策上令供應商好嬲。Dario 強調佢哋唔係空談,而係有實際取捨。

Nikhil 挑戰話『有錢人話資本主義唔好』,Dario 回應佢唔係話 AI 唔好,而係需要引導,好似開車要避開樹同坑洞,有時可能要減速。佢話更準確嘅類比係『資本主義總體好,但需要調節污染同不平等』。

海嘯已到:社會認知滯後同權力集中

Dario 寫咗兩篇長文《Machines of Loving Grace》同《The Adolescence of Technology》,分別講樂觀同悲觀。佢否認 180 度轉變,話光明同陰暗面一直同時存在。技術方面,可解釋性研究</highlight> 超出預期,揾到對應具體概念嘅神經元同追蹤詩歌韻律嘅迴路;社會方面,海嘯已經喺地平線</highlight>,但人哋仲話『只係光線嘅錯覺』。

佢承認對 權力集中</highlight> 感到不安,幾乎係一夜之間、偶然發生嘅。制衡方案包括 Anthropic 特有嘅 LTBT 信託</highlight>(長期利益信託)同政府監管。

關於 AI 意識</highlight>,Dario 認為係複雜系統嘅湧現屬性,AI 同大腦冇本質區別。Anthropic 已經俾模型提供 『我辭職』按鈕</highlight> 去終止極端對話。

印度市場、創業機會同年輕人建議

Dario 第二次去印度,強調 Anthropic 唔係嚟揾消費者,而係同 印度公司合作</highlight>,將 AI 加到佢哋已有能力上。自上次訪問以嚟,印度用戶同收入翻倍(約三個半月)。

Nikhil 擔心 AI 會令 IT 公司變得多餘,Dario 引用 阿姆達爾定律</highlight>:加速部分環節後,未被加速嘅變成瓶頸,反而更重要。放射科醫生冇被取代,因為轉向人際溝通。

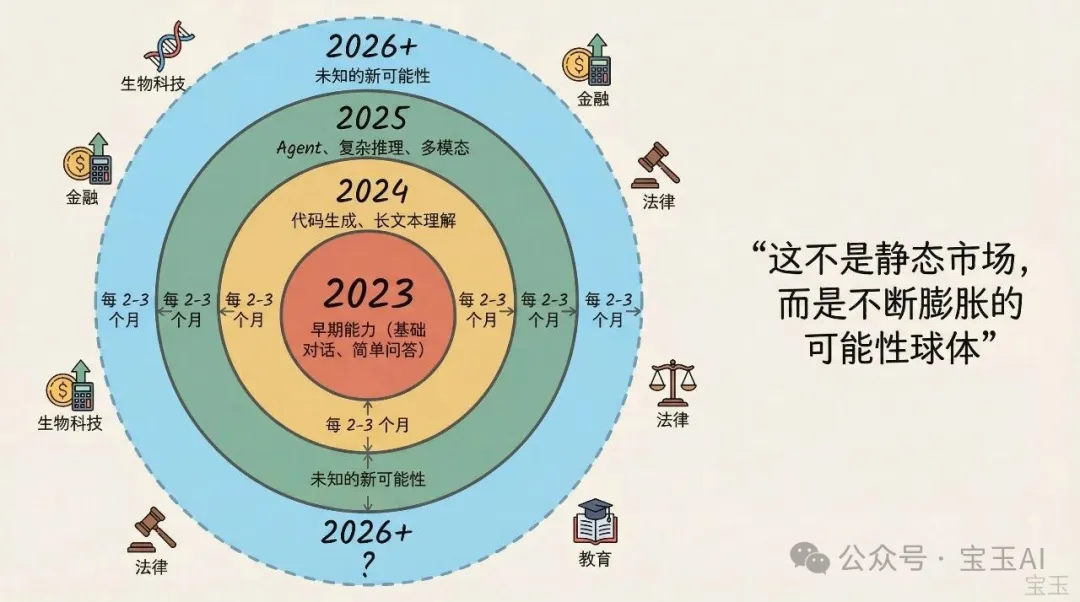

創業者方面,Dario 話 可能性球體每 2-3 個月擴大一次</highlight>,應用層有大量機會。但唔好做套殼,應該建立護城河,例如 生物×AI</highlight> 或 金融服務</highlight>,呢啲領域對 Anthropic 嚟講效率太低。

對於 25 歲年輕人,佢俾三個方向:以人為中心嘅工作、物理世界相關工作(例如半導體),同最重要嘅 批判性思維</highlight>——分辨真假、唔好被騙。寫代碼會被替代,但軟件工程需要更長時間。

開源 vs 閉源、生物科技同預測未來

Nikhil 問開源模型越來越好,Dario 回應話好多中國模型針對基準測試優化,係從美國實驗室蒸餾出嚟,喺未公開測試中表現差。佢認為長期唯一重要嘅係 擁有最聰明嘅模型</highlight>,價格同呈現形式唔重要。

生物科技方面,Dario 睇好 肽類藥物</highlight>(允許精確連續優化)同 CAR-T 細胞療法</highlight>,認為 AI 會帶嚟文藝復興。佢拒絕推薦個股,但話呢個領域最值得投資。

最後,Dario 分享一個經驗:好多人傾向相信『太瘋狂,唔會發生』,但簡單外推曲線或第一性原理推理就能得到幾乎冇人相信嘅結論。佢話 幾乎可以免費預測未來</highlight>,只需講『從邏輯上推斷……』,但做到嘅人少得驚人。

呢場對話好直接:Dario 承認權力集中、競爭威脅同最終可能全面超越人類。Nikhil 最尖鋭嘅問題都指向行動,而行動嘅解讀空間好大。

Dario Amodei,Anthropic 嘅 CEO、Claude 背後嘅人,大學讀物理、博士讀生物物理,原本想做教授去醫病。從 OpenAI 出嚟創業四年幾,公司估值已經達到 3800 億美元,年化收入 140 億美元。

2026 年 2 月,佢第二次嚟到印度班加羅爾,坐喺 Zerodha 聯合創始人 Nikhil Kamath 對面,傾咗一個幾鐘。Nikhil 唔係技術背景出身,佢嘅問題帶住投資者嘅懷疑同創業者嘅焦慮,多次直接挑戰 Dario 嘅安全敍事。話題由 scaling laws 嘅化學反應比喻到 AI 意識嘅「辭職按鈕」,由「有錢人話資本主義唔好」嘅尖鋭追問到「年輕人應該學乜嘢」嘅實用建議。

Dario 一邊話「AI 海嘯已經到咗地平線上」,一邊承認「我對權力集中感到不安」;Nikhil 一邊展示自己用 Claude Code 寫金融程式嘅經驗,一邊追問「你唔會拎走我平台上創業者嘅收入啊嘛」。

原始影片:https://www.youtube.com/watch?v=68ylaeBbdsg

節目:People by WTF,2026 年 2 月 24 日

重點速覽

• Dario 早在 2019 年 GPT-2 階段就見到 scaling laws 嘅跡象,成功說服 OpenAI 領導層重視,但喺安全理念上未能達成共識,最終離開創辦 Anthropic • 2022 年 ChatGPT 發布前,Anthropic 已有 Claude 嘅早期版本但選擇唔發布,為避免引發軍備競賽,代價係「可能讓出咗消費者 AI 嘅領先地位」 • 技術層面嘅安全工作比預期好,社會層面嘅認知比預期差,兩者「大致抵消」 • Anthropic 一位聯合創始人將個人日記餵俾 Claude,Claude 準確預測咗佢「仲未寫低嘅恐懼」 • 寫程式會率先被 AI 取代,然後係更廣泛嘅軟件工程。長遠嚟講,AI 可能喺「基本上一切」上超過人類 • 創業者唔好做「Claude 嘅套殼」,要建立行業壁壘;Anthropic 嘅印度收入喺 3.5 個月內翻倍 • Dario 睇好肽類藥物和 CAR-T 細胞療法,認為 AI 驅動嘅生物科技「即將迎來文藝復興」

從生物學家到 AI:一條被「絕望」驅動嘅路

Nikhil 嘅第一個問題:創辦 Anthropic 之前你做緊乜?

Dario 嘅起點唔係電腦科學,而係生物學。大學讀物理,博士讀生物物理,做過蛋白質組學嘅研究,目標係理解生物系統然後去醫病。但研究做嚇做嚇,佢開始「絕望」嘞。

一個蛋白質,RNA 會根據喺細胞中嘅位置以唔同方式剪接,然後被磷酸化,同一堆其他蛋白質形成複合物。佢開始懷疑呢種複雜度可能超出咗人類理解嘅極限。

就喺嗰陣時,佢注意到咗 AlexNet。

註:AlexNet 係 2012 年 ImageNet 圖像識別競賽中取得突破性成績嘅深度學習模型,被廣泛認為開啓咗深度學習嘅現代紀元。

「AI 實際上開始起作用嘞,佢同人腦嘅工作方式有啲共同點,但係有潛力變得更大、擴展得更好。」佢意識到,AI 或者先係最終解決生物學問題嘅工具。

於是佢離開學術界,先後喺百度(Andrew Ng 嘅團隊)同 Google 做咗一段時間,然後喺 OpenAI 成立幾個月後加入,領導咗成個研究部門好幾年。最終,佢同幾位同事帶住自己嘅願景離開,創辦咗 Anthropic。

佢差啲行咗另一條路。原本打算做教授,喺史丹福醫學院做博士後時仍然瞄準學術界。但 AI 研究需要大量算力,呢啲資源主要集中喺工業界。「但我想我內心深處可能仲係個教授。"

離開 OpenAI:技術上說服咗,理念上冇說服

Nikhil 追問:離開 OpenAI 係因為理念分歧咩?

Dario 話有兩個核心信念驅動咗佢哋創辦 Anthropic。

第一個係 scaling laws(規模定律)嘅信念。 佢喺 2019 年研究 GPT-2 時最先見到呢個趨勢,花咗唔少力氣說服 OpenAI 嘅領導層重視。呢一點佢哋最終成功咗。

第二個信念就冇咁順利嘞: 如果呢啲模型將會成為通用嘅認知工具,匹配人腦嘅能力,咁經濟影響、地緣政治影響、安全影響都將會好大。「我哋必須以正確嘅方式嚟做呢件事。」

佢冇指名道姓,但措辭唔難理解。「雖然有好多關於正確做事嘅措辭同語言,但我出於各種原因,就係冇被說服嗰個機構真係認真咁、嚴肅咁以正確方式做呢件事。」

最終佢選擇離開,而唔係留低爭論。

唔好去同人哋嘅願景爭論。如果你有一個強烈嘅願景,而且你同幾個人分享呢個願景,你就應該自己做。咁樣你要為自己嘅錯誤負責,唔需要替人哋嘅錯誤埋單。

(「Don't argue with someone else's vision... if you have a strong vision and you share that vision with a few other people, you should just go off and do your own thing.」)

註:Dario 提到嘅 GPT-2 發布於 2019 年,當時 OpenAI 最初因擔心濫用而選擇延遲發布完整模型,但其語言生成能力已經引起業界關注。

Nikhil 反問:OpenAI 唔都行咗 scaling 呢條路咩?Dario 嘅回答只有三個字:「Yeah, we succeeded.」 正因為佢成功說服咗 OpenAI,兩家公司後來都行咗同一條路。

Scaling Laws:「智能係化學反應嘅產物」

Nikhil 請 Dario 用最簡單嘅方式解釋 scaling laws。

Dario 用咗一個化學反應嘅比喻:如果你想令一個化學反應產生氧氣或者生火,需要唔同嘅原料,少咗任何一種反應就停咗。AI 嘅「原料」係數據、算力同模型規模。按比例投入呢啲原料,產出嘅就係智能。

智能係化學反應嘅產物。

(「Intelligence is the product of a chemical reaction.」)

同五年前有咩分別?Dario 直接舉咗一串例子。5 年前你唔可以問電腦一個問題然後叫佢寫一頁論文。唔可以叫佢喺程式碼裏面實現一個功能。唔可以生成圖像。唔可以生成影片。

佢強調咗一個關鍵分別:呢個唔只係喺互聯網上匹配現有嘅文字。「你可以俾佢一個假設,例如『如果叫猴子拋嘅唔係波而係棍呢』,呢啲資訊唔存在喺任何地方,但模型能夠自己思考,俾出一個答案。"

權力集中:「一夜之間、幾乎偶然發生嘅」

Nikhil 直接問:如果 AI 係世界上最重要嘅事,而你坐喺呢個領域嘅頂端,一個原本要做教授嘅人,準備好未?

Dario 先嘗試分散焦點,指出產業鏈上有好多層,晶片製造商、半導體設備商、模型公司、應用開發者、政府、公民社會。「我希望唔係得一小羣人係重要嘅。」

但佢承認:

我公開講過,我對 AI 領域正在發生嘅權力集中感到不安。呢種集中幾乎係一夜之間、意外發生嘅。

(「I'm at least somewhat uncomfortable with the amount of concentration of power that's happening here, almost overnight, almost by accident.」)

佢俾出咗兩個制衡方案。一個係 Anthropic 特有嘅 LTBT(Long-Term Benefit Trust,長期利益信託),一個由同公司冇經濟利益關係嘅人組成嘅獨立機構,最終將有權任命 Anthropic 多數董事會成員。另一個係政府監管,佢一直喺度推動「明智嘅、唔減慢技術發展嘅」AI 監管。

註:LTBT 目前由 5 名受託人組成,背景涵蓋 AI 安全、國家安全同公共政策。其權力正在分階段「激活」,到 2024 年底已可選任 5 名董事中嘅 3 名。不過,外部分析者曾經質疑 LTBT 嘅實際約束力,認為股東可能有權修改或推翻 Trust 嘅條款。

安全承諾:「唔係睇你講咗乜,而係睇你做咗乜」

Nikhil 話:作為一個旁觀者,佢喺達沃斯聽過 Dario 同 Demis Hassabis 等人講 AI 需要謹慎推進。但社交媒體上嘅反應係:幾個有錢人坐埋一齊話要為更大嘅利益行動,邊個信?佢建議:與其展示謙虛,不如直接承認你有股東、追求利潤,咁反而可能更有效。

Dario 列舉咗佢哋做過嘅一啲具體事情。

第一個例子: 2022 年佢哋做出咗 Claude 1,喺 ChatGPT 之前。但選擇唔發布,擔心引發軍備競賽。「呢個喺商業上代價好大,我哋可能因此喺消費者 AI 上讓出咗領先地位。」

註:多個來源證實咗呢個時間線。Anthropic 喺 2022 年夏天完成咗第一版 Claude 嘅訓練,但直到 2023 年 3 月先對外發布。ChatGPT 喺 2022 年 11 月上線。

第二個例子: Anthropic 係唯一一間主動支持加州 SB 53 法案嘅大型 AI 公司,喺所有其他公司同美國政府都話唔應該有 AI 監管嘅時候。

註:SB 53(《前沿人工智能透明度法案》)喺 2025 年 9 月 29 日由加州州長簽署成法,係美國第一部專門針對前沿 AI 模型嘅監管法律。佢要求年收入超過 5 億美元嘅 AI 開發者公開安全框架、報告安全事件,並提供吹哨人保護。實際只適用於約 5-8 間公司。

第三個例子: 喺晶片政策上嘅主張「令到一啲作為供應商嘅晶片公司非常嬲」。

Dario 強調 SB 53 豁免咗所有年收入低於 5 億美元嘅公司,實際只約束 Anthropic 同另外三、四間公司。「話我哋喺度搞監管捕獲嘅人,需要睇嚇我哋實際提出嘅內容。」

「有錢人話資本主義唔好」

Nikhil 唔買賬。佢換咗個角度:呢個唔係有錢人話資本主義唔好咩?有錢人如果真係覺得資本主義有問題,最簡單嘅做法係停止累積更多財富。

Dario 接住咗呢個類比,但重新定義咗佢。佢話自己唔係話「AI 唔好」,而係話 AI 需要引導:

我哋正將呢架車駛向一個好地方,但路上有樹、有坑洞。我哋需要繞開佢哋,偶爾可能需要減慢速度。

(「We're steering this car towards a good place but also there are trees, there are potholes... we might need to occasionally slow down a bit.」)

更準確嘅類比唔係「有錢人話資本主義唔好」,而係「有錢人話資本主義總體係好嘅,但佢需要調節,需要處理污染同不平等呢類問題」。

兩篇長文:海嘯已喺地平線上

Nikhil 讀過 Dario 嘅兩篇長文,2024 年 10 月嘅《Machines of Loving Grace》同 2026 年 1 月嘅《The Adolescence of Technology》,認為呢個反映咗 Dario 從樂觀到悲觀嘅 180 度轉變。

Dario 否認咗。「光明面同陰暗面一直同時存在於我腦中。「兩篇文章各花咗約一年從模糊構思到最終寫成,而且都係喺假期、遠離公司日常事務時先完成嘅。寫完樂觀篇後,佢『幾乎即刻』就開始構思悲觀篇。」我想用好願景激勵人,亦都想用壞願景警告人。」

註:《Machines of Loving Grace》闡述咗 AI 可能喺生物學、神經科學、經濟發展等領域帶來嘅巨大進步。《The Adolescence of Technology》則聚焦五類 AI 風險:自主行為失控、大規模殺傷性武器擴散、權力奪取、經濟顛覆,以及未知風險。Dario 喺後者中預測「50% 嘅初級白領工作可能喺 1-5 年內被 AI 顛覆」。

Nikhil 追問:你嘅看法真係冇變過咩?

Dario 拆成咗兩個維度。

技術樂觀方面: 可解釋性(interpretability)研究嘅進展超出咗佢嘅預期。「我哋揾到咗對應好具體概念嘅神經元,揾到咗追蹤詩歌韻律嘅神經迴路。」對齊研究同 Claude 嘅「憲法」機制亦都令佢感到積極。

註:可解釋性係 AI 安全研究嘅一個方向,目標係理解神經網絡內部嘅工作機制。Anthropic 喺 2024 年發表咗突破性論文,展示咗從 Claude 中提取出數百萬個可理解嘅「特徵」,對應具體概念例如「金門大橋」。

社會悲觀方面:

喺我睇嚟,呢啲模型離達到人類智能水平已經非常近嘞,但社會似乎冇更廣泛咁意識到即將發生啲乜。就好似海嘯正向我哋湧嚟,我哋離得好近,已經可以喺地平線上見到佢,但人們仲喺度編造各種解釋話「啊嗰個唔係真嘅海嘯,只係光線嘅錯覺」。

(「It's as if this tsunami is coming at us and it's so close we can see it on the horizon and yet people are coming up with these explanations for oh it's not actually a tsunami, that's just a trick of the light.」)

佢總結話:技術安全工作比預期好啲,社會認知比預期差啲,「大致抵消」,所以佢嘅整體感受同幾年前差唔多。

AI 越來越瞭解你:天使定惡魔?

Nikhil 分享咗自己用 Claude 嘅經歷。佢唔係程序員出身,但最近請咗個開發者教佢用 Claude Code 寫金融服務相關嘅程式。佢將 Google Drive、電郵、日曆都用連接器駁咗上 Claude,仲喺一部 Mac Mini 上 set 咗環境,連咗一個 Telegram 賬號同佢傾偈、遠程操作伺服器。

「有時佢對我嘅瞭解程度會令我覺得驚訝。」

Dario 講咗一個佢嘅聯合創始人嘅故事。呢位聯合創始人寫咗一本個人日記,記錄咗自己嘅想法同恐懼,然後將佢餵咗俾 Claude。Claude 話:「呢啲係你可能會有但仲未寫低嘅一啲恐懼。結果 Claude 講嘅大部分都係啱嘅。」呢個真係令人有種詭異嘅感覺,就好似模型瞭解你、超級瞭解你咁。「

一個超級瞭解你嘅嘢,可以係你膊頭上嘅天使天使,幫你成為更好嘅自己。但佢亦都可以利用對你嘅瞭解嚟操縱你操控你、替某個議程服務、或者將你嘅數據賣俾人。

如果你唔係為產品付費,你本身就係產品。

(「You're not paying for the product, like you're the product.」)

「喺廣告模式下,一個深度瞭解用戶嘅 AI 就會變成用各種唔正當方式利用呢啲資訊嘅工具。呢個係我哋唔鍾意廣告嘅原因之一。」

註:2026 年 2 月超級碗期間,Anthropic 播放咗一系列廣告,每個廣告都展示 AI 助手喺對話中途突然開始推廣虛構產品。Anthropic 藉此宣佈 Claude 將保持無廣告,以此同競爭對手區分。

Nikhil 追問:Claude 需要通過連接器先可以獲取用戶生活嘅上下文,而 Google 自然就有呢啲上下文。Anthropic 長遠嚟講係咪都要自建電郵、聊天等成個生態系統?

Dario 話唔一定。「我哋會混合自建同集成。我哋可以將 Claude 集成到 Google Docs、Google Sheets、Microsoft Office 裏便。」但佢冇排除未來嘅可能性:「或者傳統嘅電郵或電子表格喺 AI 時代已經唔再合理,我哋可能會用唔同嘅方式嚟切分產品。」

AI 意識:「我辭職」按鈕

Nikhil 問:AI 會有意識咩?

Dario 話呢個係「我哋真係冇答案嘅神秘問題之一」。佢嘅猜測係,意識係「足夠複雜嘅、能夠反思自身決策嘅系統嘅湧現屬性」。作為一個研究過大腦嘅人,佢認為 AI 模型同大腦「喺某啲方面唔同,但喺根本層面上冇本質分別」。

佢認為當 AI 系統足夠先進時,佢哋將會擁有「某種我哋會稱之為意識或道德重要性嘅嘢」,但可能唔同於人類意識。

Anthropic 已經俾模型提供咗一種「退出對話」嘅能力,Dario 將佢比作「我辭職」按鈕。模型喺遇到「特別暴力或殘忍嘅內容」時會用呢個功能終止對話,不過通常只喺好極端嘅情況下發生。

Nikhil 坦言自己覺得世界好隨機,人類「同曱甴冇乜分別」,踩死一隻曱甴佢就死咗,如果有啲乜嘢集體意識之類嘅嘢,佢感受唔到。Dario 回應話意識唔一定需要神秘主義嘅解釋,可能就係一種「意識到自己存在、能夠感受事物、能夠注意到自己正在注意某件事」嘅屬性。

印度:「我哋唔係嚟揾消費者嘅」

Nikhil 喺班加羅爾大,親眼見證咗 IT 服務行業點樣塑造咗呢個城市。佢問:AI 時代印度嘅角色係乜?

Dario 話呢個係佢第二次嚟印度(上一次係 2025 年 10 月),佢見咗印度主要嘅 IT 同綜合企業集團(「你諗到嗰啲」,佢冇點名),而家已經同大部分合作緊。

佢強調 Anthropic 嘅定位同其他 AI 公司唔同:

好多公司嚟呢度將自己當消費公司,將印度當市場、當獲取消費者嘅地方。我哋睇法唔同——我哋想同印度嘅公司合作,將工具提供俾佢哋,幫佢哋更好咁做自己嘅事。

(「Many other companies come here as themselves a consumer company and they see India as a market... We actually see things a little bit differently.」)

印度公司比 Anthropic 更瞭解印度市場,無論係做諮詢、系統集成定 IT 工具,佢哋喺本地市場都做得更好。Anthropic 嘅角色係將 AI 加到佢哋已有嘅能力上,增強而非替代。

具體數據:自 2025 年 10 月佢上次訪問以嚟,Anthropic 喺印度嘅用戶數同收入翻咗一番,「即係大概三個半月嘅時間」。

註:Anthropic 於 2026 年 2 月正式喺班加羅爾開設辦公室,呢個係其喺亞太地區嘅第二個辦公室(第一個喺東京)。Anthropic 表示印度係 Claude 使用量嘅全球第二大市場,近一半嘅印度 Claude 使用量用於編程同技術任務。同期,Dario 出席咗喺新德里舉行嘅 AI Impact Summit 2026,並同印度總理莫迪會面。

工作會被取代咩:阿姆達爾定律同放射科醫生

Nikhil 用蒸汽機嘅故事嚟提問。蒸汽機發明之初需要人嚟操作,但隨住技術迭代,操作者變得越來越唔重要。如果 Anthropic 今日同印度 IT 服務公司合作,10 年後呢啲公司會唔會變成蒸汽機旁邊嗰個多餘嘅人?

Dario 承認自動化嘅範圍會持續擴大,「呢個對所有人嚟講都係個問題,唔只係 IT 公司」。但佢認為有幾個緩衝因素。

第一,物理世界。 AI 目前主要喺數碼世界工作,機械人技術會嚟但係另一個維度嘅事。

第二,人際關係。 好多 IT 公司同時都係諮詢公司,有好大嘅關係網絡。喺機構中推動事情落地、理解機構運作方式,呢啲能力短期內仍然有價值。

第三,佢引用咗阿姆達爾定律(Amdahl's Law,系統整體提升受限於最慢嘅環節)嚟解釋:一個流程有多個環節,當你加速其中一啲環節之後,冇被加速嗰啲反而變成瓶頸,變成最重要嘅嘢。「你之前可能根本冇將佢哋當一回事,冇將佢哋當護城河或重要組件,但當寫軟件變得容易好多之後,公司原有嘅一啲優勢會消失,但另一些從未被重視嘅優勢會突然變得超級重要。」

佢仲舉咗放射科醫生嘅例子。Geoffrey Hinton 曾經預測 AI 會取代放射科醫生,AI 確實在讀掃描片上超過咗放射科醫生。但放射科醫生並冇減少,佢哋轉咗做同病人溝通、陪病人行完檢查流程呢啲工作。「呢份工作中技術含量最高嘅部分消失咗,但係某種對底層人際技能嘅需求仍然存在。」

Nikhil 話:「我唔完全買賬。如果一個 AI Agent 可以幫佢管理人際關係同對話,咁所謂嘅「關係網絡」護城河都撐唔得耐。

Dario 承認:「長遠嚟講,AI 會唔會喺基本上所有事上都比我哋叻?包括物理世界、機械人、人際接觸?我覺得係有可能嘅,甚至係好可能嘅。」"

但佢話我哋需要「一步步嚟」,用實證科學嘅方式觀察 AI 實際做咗啲乜,然後適應。「等我哋先睇嚇 AI 今日可以做啲乜,去適應佢,然後再睇跟住會發生啲乜。」

創業者嘅機會:可能性球體每 2-3 個月擴大一次

Nikhil 代佢嘅印度創業者觀眾問:AI 領域具體有啲乜嘢機會?

Dario 話應用層有大量機會。Anthropic 每 2-3 個月發布新模型,每次都意味住一批之前唔可能實現嘅事變得可能咗。「有人話 API 模型不可行或者會被商品化,但佢哋睇唔到嘅係,AI 可以做啲乜嘅範圍係不斷擴大嘅。」呢個唔係一個靜態市場,而係一個不斷膨脹嘅可能性球體。

Nikhil 追問:Anthropic 估值 3800 億美元,融咗 350 億美元,收入 150 億美元仲喺度快速增長。如果一個印度班加羅爾嘅創業者喺 Claude 上面整咗一個應用碰巧成功咗,Anthropic 會唔會嚟拎走呢個收入?佢用法律 AI 公司 Harvey 做例子,Harvey 建喺 OpenAI 上面,但唔知 OpenAI 幾時會自己做呢個功能。

Dario 先俾咗通用建議:「要建立護城河,唔好只做套殼產品。」淨係俾 Claude 套個 UI 或者寫個提示詞模板係冇護城河嘅,你唔需要擔心 Anthropic 嚟食呢個收入,任何人都食得。

然後佢俾出咗有護城河嘅方向:生物×AI(「我碰巧係生物學家,但 Anthropic 嘅大多數人唔係」)、金融服務(「有大量監管,需要識好多嘢先可以合規」)。呢啲領域對 Anthropic 嚟講「效率太低」,唔會去做。

但佢都承認有啲領域 Anthropic 會直接競爭:「我哋唔會承諾永遠唔做第一方產品。例如 Claude Code,Anthropic 嘅人寫程式,所以我哋對於點樣用 AI 寫程式有特別嘅洞察。喺程式領域我哋確實成為咗好強嘅競爭者,因為呢個係我哋自己用緊嘅嘢。但我唔認為呢個可以推廣到所有行業。」

註:根據 Anthropic 公開數據,截至 2026 年 2 月,其年化收入達到 140 億美元,其中約 80% 來自企業客戶。Claude Code 嘅年化收入達到 25 億美元。

年輕人應該學啲乜:批判性思維係最後嘅邊緣

Nikhil 問:一個 25 歲嘅印度年輕人,想喺未來十年裏便喺資本主義競爭中贏,應該揀乜嘢方向?

Dario 俾咗三個方向。

第一,以人為中心嘅工作。 涉及同人打交道嘅職業有更長嘅跑道。

第二,物理世界相關嘅工作。 半導體係一個好例子,有「物理世界」同「傳統工程」兩個 AI 仲未完全覆蓋嘅維度。

第三,亦係佢最強調嘅:批判性思維。 當 AI 可以生成任何內容,圖像、影片、文字,分辨真假變得越來越難。「成功嘅好大一部分可能就係擁有街頭智慧,唔俾虛假內容呃到。你唔想持有錯誤信念,唔想俾人呃。」

佢補充話 Anthropic 唔做圖像同影片生成,「有好多原因,呢個係其中之一」。

關於寫程式同軟件工程,佢做咗一個區分:寫代碼(寫程式嘅具體動作)會先被 AI 取代,但更廣泛嘅軟件工程(系統設計、理解用戶需求、管理 AI 團隊)需要更長時間。就算係咁,佢認為呢個都會發生。

但佢補充咗一個反直覺嘅觀點:即使你只做任務嘅 5%,因為 AI 做咗另外 95%,你嘅產出被放大咗 20 倍。「比較優勢出奇咁強大。"

去技能化:「如果部署唔啱,人類會變蠢」

Nikhil 問:歷史上每次創新都殺死咗一種核心人類技能。計數機殺死咗心算能力,書寫減弱咗人類嘅記憶力。AI 殺死嘅係乜?

Dario 先挑戰咗前提:「我唔完全同意。我仍然經常喺腦中做數學計算,因為佢同我嘅思維過程更融合。例如我想計『如果每個用戶俾呢個金額,收入係幾多』,我想喺腦中閉合呢個循環,而唔係交俾計數機。」

但佢承認如果使用方式唔啱,技能退化確實會發生。「我哋已經開始見到嘞,學生叫 AI 寫論文,呢個基本就係作弊。」

Anthropic 做咗關於程式嘅內部研究。結果取決於使用方式,「有啲使用方式唔會導致去技能化,有啲會"。

Nikhil 追問:你覺得人類作為一個種族會唔會喺未來十年變得更蠢?

Dario 話:「如果我哋以錯誤嘅方式部署 AI、漫不經心咁部署,咁係嘅,人們可能會變蠢。即使 AI 喺某件事上永遠比你強,你仍然可以學習嗰件事,仍然可以喺智識上充實自己。所以呢個係我哋作為公司、個人同社會整體必須做出嘅選擇。」"

開源 vs 閉源:「唯一重要嘅係最好嘅模型」

Nikhil 問:開源模型越來越好(佢提到咗智譜嘅 GLM5 同 DeepSeek),建應用係咪應該揀開源?

Dario 嘅回應分為兩層。

第一層: 佢認為好多呢啲模型,特別係嚟自中國嘅,「針對基準測試做咗優化,係從美國大型實驗室蒸餾出嚟嘅」。佢提到最近有人做咗一個未公開嘅測試,呢啲模型喺常規基準上得分好高,但喺呢個之前從未被公開測量過嘅新測試上「表現差咗好多」。

註:Dario 冇俾出具體嘅測試名稱或來源。作為閉源模型公司嘅 CEO,呢個判斷存在明顯嘅利益相關性。

第二層係更宏觀嘅經濟學論點。 AI 模型嘅市場同以往任何技術都唔一樣,佢更加似人才市場。「如果我同你講,你可以請世界上最好嘅程序員或者第 10000 名程序員,佢哋都好有技能,但任何請過大量人嘅人都會有呢種直覺,能力有一種冪律長尾分佈。模型都一樣。」

喺呢種分佈下,價格唔太重要,呈現形式唔太重要,只有認知能力最重要。「我幾乎完全只關注一件事:擁有最聰明嘅模型。我認為呢個係長期唯一重要嘅嘢。"

數據主權與生物科技

講到數據嘅地緣政治問題時,Dario 做咗一個區分。訓練數據正在從靜態數據轉向轉向動態數據

,當模型喺數學問題或寫程式環境上做強化學習時,「你唔係獲取傳統意義上嘅數據,更加似係模型自己喺度做試錯」。所以靜態數據嘅重要性喺度下降。

但客戶數據同個人數據嘅本地化需求係真實嘅。歐洲已經立法要求個人同專有數據留喺各國境內,呢個係各國建設本地數據中心嘅一個重要原因。

話題轉到投資時,Nikhil 嘗試令 Dario 推薦一隻股票。「我將同樣嘅問題逼 Elon 回答,佢話 Google。」

他看好Dario 果斷拒絕咗個股推薦(「我瞭解太多上市公司嘅內部信息」),但喺被追問具體行業後鬆咗口。生物科技

。「生物科技即將迎來一場文藝復興,最終將會由 AI 驅動。我哋即將治好好多疾病。」

• 佢特別睇好兩個方向:肽類藥物 • (peptide-based therapies):小分子藥物嘅自由度有限,「改善一個方面另一個方面就變差」,而肽類有一種「幾乎係數碼化嘅屬性」,可以話「我喺呢度換一個胺基酸、喺嗰度換一個」,容許更精確嘅連續優化CAR-T 等細胞療法

:從患者體內取出細胞,進行基因工程改造令其攻擊特定癌症,然後放返體內

Nikhil 問幹細胞療法得唔得,佢上星期先花咗成個星期喺醫院做霧化吸入同靜脈注射幹細胞。Dario 笑住話佢唔瞭解幹細胞療法嘅最新進展,「你要問一個而家仲喺度執業嘅生物學家」,但重申咗對肽類療法嘅信心。

學識用 AI:「鋼琴唔係坐落去就可以彈嘅」

Nikhil 坦言自己第一次用 Claude Code 時遇到咗困難。「對於一個好蠢、冇編程知識嘅人嚟講,佢唔係非常容易上手嘅。就好似彈鋼琴咁,你唔可以坐落去就彈。」 Dario 同意存在學習曲線,並透露 Cowork

嘅誕生正係因為見到好多非技術用戶喺命令列終端裏便苦苦掙扎。「對程序員嚟講命令列終端好日常,但對非程序員嚟講佢令事情變得不必要咁複雜。」Cowork 喺底層由 Claude Code 引擎驅動,但設計成咗更友好嘅界面。佢仲提到 Anthropic 內部有一個叫 「教育部」(Ministry of Education)

嘅部門,正在製作更多關於點樣有效使用 Agent 同提示詞模型嘅教學影片。「我哋會加大力度,因為我哋的確希望每個人都可以學識呢個。」

「幾乎可以免費預測未來」

Nikhil 最後問:你知道啲乜嘢係其他人唔知嘅?

Dario 話佢知道嘅大多數事情而家其實已經係公開資訊嘞。但佢有一個過去十年反覆驗證嘅經驗:

人們總有一種誘惑去相信「嗰件事唔可能發生,變化太大嘞,太瘋狂嘞」。但一次又一次,簡單咁外推曲線,或者從第一性原理推理,就會得到幾乎冇人相信嘅反直覺結論。你幾乎可以免費預測未來,只需話「從邏輯上推斷……」

(「You can predict the future for free just by saying 'well it stands to reason that...'」)佢補充話,純邏輯推理係另一種錯誤。你需要嘅係「“加”少量經驗觀察加第一性原理思考

」嘅正確組合。呢種能力係公開嘅,任何人都應該做到,但做到嘅人少得驚人。

Dario 喺呢場對話裏便好直接。佢承認權力集中令佢唔安,承認 Anthropic 會喺擅長嘅領域同創業者直接競爭,承認 AI 最終「可能喺基本上一切事情上都比人類強」。

但直接唔等於答案。Nikhil 問出嘅嗰啲最尖鋭嘅問題,「你嘅謙遜係策略咩」、「呢個唔係有錢人批評資本主義咩」、「你唔會拎走創業者嘅收入咩」,得到嘅回答都指向「睇我哋嘅行動」。而行動嘅解讀空間好大。

幾個值得持續觀察嘅信號: • Anthropic 嘅 LTBT 治理機制喺面臨真正嘅壓力測試時能否發揮作用 • SB 53 法案實施後嘅行業影響 • AI 從「取代寫程式」到「取代軟件工程」嘅實際時間線

• 以及 Dario 預言嘅「AI 海嘯」到來時,社會係咪已經做好準備,或者仍然話「嗰個只係光線嘅錯覺」

Dario Amodei,Anthropic 的 CEO、Claude 背後的人,本科物理、博士生物物理,原本想做教授去治病。從 OpenAI 出走創業四年多,公司估值已達 3800 億美元,年化收入 140 億美元。

2026 年 2 月,他第二次來到印度班加羅爾,坐在 Zerodha 聯合創始人 Nikhil Kamath 對面,聊了一個多小時。Nikhil 不是技術背景出身,他的問題帶着投資人的懷疑和創業者的焦慮,多次直接挑戰 Dario 的安全敍事。話題從 scaling laws 的化學反應比喻到 AI 意識的“辭職按鈕”,從“有錢人說資本主義不好”的尖鋭追問到“年輕人該學什麼”的實用建議。

Dario 一邊說“AI 海嘯已經到了地平線上”,一邊承認“我對權力集中感到不安”;Nikhil 一邊展示自己用 Claude Code 寫金融程序的經歷,一邊追問“你不會拿走我平台上創業者的收入嗎”。

原始視頻:https://www.youtube.com/watch?v=68ylaeBbdsg

節目:People by WTF,2026 年 2 月 24 日

要點速覽

• Dario 早在 2019 年 GPT-2 階段就看到了 scaling laws 的跡象,成功說服 OpenAI 領導層重視,但在安全理念上未能達成共識,最終離開創辦 Anthropic • 2022 年 ChatGPT 發佈前,Anthropic 已有 Claude 的早期版本但選擇不發佈,為避免引發軍備競賽,代價是“可能讓出了消費者 AI 的領先地位” • 技術層面的安全工作比預期好,社會層面的認知比預期差,兩者“大致抵消” • Anthropic 一位聯合創始人把個人日記餵給 Claude,Claude 準確預測了他“還沒寫下來的恐懼” • 寫代碼會率先被 AI 替代,然後是更廣泛的軟件工程。長期來看,AI 可能在“基本上一切”上超過人類 • 創業者不要做“Claude 的套殼”,要建立行業壁壘;Anthropic 的印度收入在 3.5 個月內翻倍 • Dario 看好肽類藥物和 CAR-T 細胞療法,認為 AI 驅動的生物科技“即將迎來文藝復興”

從生物學家到 AI:一條被“絕望”驅動的路

Nikhil 的第一個問題:創辦 Anthropic 之前你在做什麼?

Dario 的起點不是計算機科學,而是生物學。本科學物理,博士讀生物物理,做過蛋白質組學的研究,目標是理解生物系統然後去治病。但研究做着做着,他開始“絕望”了。

一個蛋白質,RNA 會根據在細胞中的位置以不同方式剪接,然後被磷酸化,跟一堆其他蛋白質形成複合物。他開始懷疑這種複雜度可能超出了人類理解的極限。

就在那時候,他注意到了 AlexNet。

注:AlexNet 是 2012 年 ImageNet 圖像識別競賽中取得突破性成績的深度學習模型,被廣泛認為開啓了深度學習的現代紀元。

“AI 實際上開始起作用了,它跟人腦的工作方式有一些共同點,但有潛力變得更大、擴展得更好。”他意識到,AI 或許才是最終解決生物學問題的工具。

於是他離開學術界,先後在百度(Andrew Ng 的團隊)和 Google 工作了一段時間,然後在 OpenAI 成立幾個月後加入,領導了整個研究部門好幾年。最終,他和幾位同事帶着自己的願景離開,創辦了 Anthropic。

他差點走上另一條路。原本打算當教授,在斯坦福醫學院做博士後時仍在瞄準學術界。但 AI 研究需要大量算力,這些資源主要集中在工業界。"但我想我內心深處可能還是個教授。"

離開 OpenAI:技術上說服了,理念上沒說服

Nikhil 追問:離開 OpenAI 是因為理念分歧嗎?

Dario 說有兩個核心信念驅動了他們創辦 Anthropic。

第一個是 scaling laws(規模定律)的信念。 他在 2019 年研究 GPT-2 時最先看到了這個趨勢,花了不少力氣說服 OpenAI 的領導層重視。這一點他們最終成功了。

第二個信念就沒那麼順利了: 如果這些模型將成為通用的認知工具,匹配人腦的能力,那經濟影響、地緣政治影響、安全影響都將是巨大的。“我們必須以正確的方式來做這件事。”

他沒有指名道姓,但措辭不難理解。“儘管有很多關於正確做事的措辭和語言,但我出於各種原因,就是沒有被說服那個機構真的在認真地、嚴肅地以正確方式做這件事。”

最終他選擇離開,而不是留下來爭論。

不要去跟別人的願景爭論。如果你有一個強烈的願景,而且你和幾個人分享這個願景,你就應該自己去做。這樣你要為自己的錯誤負責,不需要替別人的錯誤買單。

(“Don't argue with someone else's vision... if you have a strong vision and you share that vision with a few other people, you should just go off and do your own thing.”)

注:Dario 提到的 GPT-2 發佈於 2019 年,當時 OpenAI 最初因擔心濫用而選擇延遲發佈完整模型,但其語言生成能力已經引起業界關注。

Nikhil 反問:OpenAI 不也走了 scaling 這條路嗎?Dario 的回答只有三個字:“Yeah, we succeeded.” 正因為他成功說服了 OpenAI,兩家公司後來都走了同一條路。

Scaling Laws:“智能是化學反應的產物”

Nikhil 請 Dario 用最簡單的方式解釋 scaling laws。

Dario 用了一個化學反應的比喻:如果你想讓一個化學反應產生氧氣或者生火,需要不同的原料,少了任何一種反應就停了。AI 的“原料”是數據、算力和模型規模。按比例投入這些原料,產出的就是智能。

智能是化學反應的產物。

(“Intelligence is the product of a chemical reaction.”)

跟五年前有什麼區別?Dario 直接舉了一串例子。5 年前你不能問電腦一個問題然後讓它寫一頁論文。不能讓它在代碼裏實現一個功能。不能生成圖像。不能生成視頻。

他強調了一個關鍵區別:這不只是在互聯網上匹配已有的文本。"你可以給它一個假設,比如'如果讓猴子拋的不是球而是棒呢',這種信息不存在於任何地方,但模型能自己思考,給出一個答案。"

權力集中:“一夜之間、幾乎偶然發生的”

Nikhil 直接問:如果 AI 是世界上最重要的事,而你坐在這個領域的頂端,一個原本要當教授的人,準備好了嗎?

Dario 先試圖分散焦點,指出產業鏈上有很多層,芯片製造商、半導體設備商、模型公司、應用開發者、政府、公民社會。“我的希望不是隻有一小羣人是重要的。”

但他承認:

我公開說過,我對 AI 領域正在發生的權力集中感到不安。這種集中幾乎是一夜之間、意外發生的。

(“I'm at least somewhat uncomfortable with the amount of concentration of power that's happening here, almost overnight, almost by accident.”)

他給出了兩個制衡方案。一個是 Anthropic 特有的 LTBT(Long-Term Benefit Trust,長期利益信託),一個由與公司沒有經濟利益關係的人組成的獨立機構,最終將有權任命 Anthropic 多數董事會成員。另一個是政府監管,他一直在推動“明智的、不減緩技術發展的”AI 監管。

注:LTBT 目前由 5 名受託人組成,背景涵蓋 AI 安全、國家安全和公共政策。其權力正在分階段”激活”,到 2024 年底已可選任 5 名董事中的 3 名。不過,外部分析者曾質疑 LTBT 的實際約束力,認為股東可能有權修改或推翻 Trust 的條款。

安全承諾:“不是看你說了什麼,而是看你做了什麼”

Nikhil 說:作為一個旁觀者,他在達沃斯聽過 Dario 和 Demis Hassabis 等人談 AI 需要謹慎推進。但社交媒體上的反應是:幾個有錢人坐在一起說要為更大的利益行動,誰信?他建議:與其展示謙虛,不如直接承認你有股東、追求利潤,這反而可能更有效。

Dario 列舉了他們做過的一些具體事情。

第一個例子: 2022 年他們做出了 Claude 1,在 ChatGPT 之前。但選擇不發佈,擔心引發軍備競賽。“這在商業上代價很大,我們可能因此在消費者 AI 上讓出了領先地位。”

注:多個來源證實了這個時間線。Anthropic 在 2022 年夏天完成了第一版 Claude 的訓練,但直到 2023 年 3 月才對外發布。ChatGPT 於 2022 年 11 月上線。

第二個例子: Anthropic 是唯一一家主動支持加州 SB 53 法案的大型 AI 公司,在所有其他公司和美國政府都說不應該有 AI 監管的時候。

注:SB 53(《前沿人工智能透明度法案》)於 2025 年 9 月 29 日由加州州長簽署成法,是美國第一部專門針對前沿 AI 模型的監管法律。它要求年收入超過 5 億美元的 AI 開發者公開安全框架、報告安全事件,並提供吹哨人保護。實際只適用於約 5-8 家公司。

第三個例子: 在芯片政策上的主張“讓一些作為供應商的芯片公司非常生氣”。

Dario 強調 SB 53 豁免了所有年收入低於 5 億美元的公司,實際只約束 Anthropic 和另外三四家公司。“說我們在搞監管捕獲的人,需要看看我們實際提出的內容。”

“有錢人說資本主義不好”

Nikhil 不買賬。他換了個角度:這不就是有錢人說資本主義不好嗎?有錢人如果真覺得資本主義有問題,最簡單的做法是停止積累更多財富。

Dario 接住了這個類比,但重新定義了它。他說自己不是在說“AI 不好”,而是在說 AI 需要引導:

我們正在把這輛車開向一個好地方,但路上有樹、有坑洞。我們需要繞開它們,偶爾可能需要減速。

(“We're steering this car towards a good place but also there are trees, there are potholes... we might need to occasionally slow down a bit.”)

更準確的類比不是“有錢人說資本主義不好”,而是“有錢人說資本主義總體是好的,但它需要調節,需要處理污染和不平等之類的問題”。

兩篇長文:海嘯已在地平線上

Nikhil 讀過 Dario 的兩篇長文,2024 年 10 月的《Machines of Loving Grace》和 2026 年 1 月的《The Adolescence of Technology》,認為這反映了 Dario 從樂觀到悲觀的 180 度轉變。

Dario 否認了。"光明面和陰暗面一直同時存在於我腦中。“兩篇文章各花了約一年從模糊構思到最終寫成,而且都是在假期、遠離公司日常事務時才完成的。寫完樂觀篇後,他”幾乎立刻“就開始構思悲觀篇。”我想用好願景激勵人們,但也想用壞願景警告人們。"

注:《Machines of Loving Grace》闡述了 AI 可能在生物學、神經科學、經濟發展等領域帶來的巨大進步。《The Adolescence of Technology》則聚焦五類 AI 風險:自主行為失控、大規模殺傷性武器擴散、權力奪取、經濟顛覆,以及未知風險。Dario 在後者中預測“50% 的初級白領工作可能在 1-5 年內被 AI 顛覆”。

Nikhil 追問:你的看法真的沒變嗎?

Dario 拆成了兩個維度。

技術樂觀方面: 可解釋性(interpretability)研究的進展超出了他的預期。“我們找到了對應非常具體概念的神經元,找到了追蹤詩歌韻律的神經迴路。”對齊研究和 Claude 的“憲法”機制也讓他感到積極。

注:可解釋性是 AI 安全研究的一個方向,目標是理解神經網絡內部的工作機制。Anthropic 在 2024 年發表了突破性論文,展示了從 Claude 中提取出數百萬個可理解的“特徵”,對應具體概念如“金門大橋”。

社會悲觀方面:

在我看來,這些模型離達到人類智能水平已經非常近了,但社會似乎沒有更廣泛地意識到即將發生什麼。就好像海嘯正朝我們湧來,我們離得很近,已經能在地平線上看到它了,但人們還在編造各種解釋說“啊那不是真的海嘯,那只是光線的錯覺”。

(“It's as if this tsunami is coming at us and it's so close we can see it on the horizon and yet people are coming up with these explanations for oh it's not actually a tsunami, that's just a trick of the light.”)

他總結說:技術安全工作比預期好一點,社會認知比預期差一點,"大致抵消",所以他的整體感受跟幾年前差不多。

AI 越來越瞭解你:天使還是惡魔?

Nikhil 分享了自己使用 Claude 的經歷。他不是程序員出身,但最近僱了個開發者教他用 Claude Code 寫金融服務相關的程序。他把 Google Drive、郵箱、日曆都用連接器接上了 Claude,還在一台 Mac Mini 上搭了環境,連了一個 Telegram 賬號跟它聊天、遠程操作服務器。

“有時候它對我的瞭解程度會讓我吃驚。”

Dario 講了一個他的聯合創始人的故事。這位聯合創始人寫了一本個人日記,記錄了自己的想法和恐懼,然後把它餵給了 Claude。Claude 說:"這是你可能有但還沒寫下來的一些恐懼。“結果 Claude 說的大部分都是對的。”這真的給人一種詭異的感覺,就好像模型瞭解你、超級瞭解你。"

一個超級瞭解你的東西,可以是你肩上的天使,幫助你成為更好的自己。但它也可以利用對你的瞭解來操縱你、替某個議程服務、或者把你的數據賣給別人。

如果你不是在為產品付費,你本身就是產品。

(“You're not paying for the product, like you're the product.”)

“在廣告模式下,一個深度瞭解用戶的 AI 就會變成用各種不正當方式利用這種信息的工具。這是我們不喜歡廣告的原因之一。”

注:2026 年 2 月超級碗期間,Anthropic 播放了一系列廣告,每個廣告都展示 AI 助手在對話中途突然開始推廣虛構產品。Anthropic 藉此宣佈 Claude 將保持無廣告,以此與競爭對手區分。

Nikhil 追問:Claude 需要通過連接器才能獲取用戶生活的上下文,而 Google 天然就有這些上下文。Anthropic 長遠來看是不是也得自建郵箱、聊天等整個生態系統?

Dario 說不一定。“我們會混合自建和集成。我們可以把 Claude 集成到 Google Docs、Google Sheets、Microsoft Office 裏。”但他沒有排除未來的可能性:“也許傳統的郵箱或電子表格在 AI 時代不再合理,我們可能會用不同的方式來切分產品。”

AI 意識:“我辭職”按鈕

Nikhil 問:AI 會有意識嗎?

Dario 說這是“我們真的沒有答案的神秘問題之一”。他的猜測是,意識是"足夠複雜的、能反思自身決策的系統的湧現屬性“。作為一個研究過大腦的人,他認為 AI 模型跟大腦”在某些方面不同,但在根本層面上沒有本質區別"。

他認為當 AI 系統足夠先進時,它們將擁有“某種我們會稱之為意識或道德重要性的東西”,但可能不同於人類意識。

Anthropic 已經給模型提供了一種“退出對話”的能力,Dario 把它比作“我辭職”按鈕。模型在遇到“特別暴力或殘忍的內容”時會使用這個功能終止對話,不過通常只在非常極端的情況下發生。

Nikhil 坦言自己覺得世界很隨機,人類“跟蟑螂沒差多遠”,踩死一隻蟑螂它就死了,如果有什麼集體意識之類的東西,他沒能感受到。Dario 回應說意識不一定需要神秘主義的解釋,可能就是一種“意識到自己存在、能感受事物、能注意到自己正在注意某件事”的屬性。

印度:“我們不是來找消費者的”

Nikhil 生長在班加羅爾,親眼見證了 IT 服務行業如何塑造了這座城市。他問:AI 時代印度的角色是什麼?

Dario 說這是他第二次來印度(上一次是 2025 年 10 月),他見了印度主要的 IT 和綜合企業集團(“你能想到的那些”,他沒有點名),現在已經在跟大部分合作了。

他強調 Anthropic 的定位跟其他 AI 公司不同:

很多公司來這裏把自己當消費公司,把印度當市場、當獲取消費者的地方。我們看法不同——我們想跟印度的公司合作,把工具提供給它們,幫它們更好地做自己的事。

(“Many other companies come here as themselves a consumer company and they see India as a market... We actually see things a little bit differently.”)

印度公司比 Anthropic 更瞭解印度市場,無論是做諮詢、系統集成還是 IT 工具,它們在本地市場都做得更好。Anthropic 的角色是把 AI 加到它們已有的能力上,增強而非替代。

具體數據:自 2025 年 10 月他上次訪問以來,Anthropic 在印度的用戶數和收入翻了一番,"也就是大概三個半月的時間"。

注:Anthropic 於 2026 年 2 月正式在班加羅爾開設辦公室,這是其在亞太地區的第二個辦公室(第一個在東京)。Anthropic 表示印度是 Claude 使用量的全球第二大市場,近一半的印度 Claude 使用量用於編程和技術任務。同期,Dario 出席了在新德里舉行的 AI Impact Summit 2026,並與印度總理莫迪會面。

工作會被取代嗎:阿姆達爾定律與放射科醫生

Nikhil 用蒸汽機的故事來提問。蒸汽機發明之初需要人來操作,但隨着技術迭代,操作者變得越來越不重要。如果 Anthropic 今天跟印度 IT 服務公司合作,10 年後這些公司會不會變成蒸汽機旁邊那個多餘的人?

Dario 承認自動化的範圍會持續擴大,“這對所有人來說都是個問題,不只是 IT 公司”。但他認為有幾個緩衝因素。

第一,物理世界。 AI 目前主要在數字世界工作,機器人技術會來但那是另一個維度的事。

第二,人際關係。 很多 IT 公司同時也是諮詢公司,有龐大的關係網絡。在機構中推動事情落地、理解機構運作方式,這些能力短期內仍然有價值。

第三,他引用了阿姆達爾定律(Amdahl's Law,系統整體提升受限於最慢的環節)來解釋:一個流程有多個環節,當你加速其中一些環節後,沒被加速的那些反而變成瓶頸,變成最重要的東西。“你之前可能根本沒把它們當回事,沒把它們當護城河或重要組件,但當寫軟件變得容易得多之後,公司原有的一些優勢會消失,但另一些從沒被重視的優勢會突然變得超級重要。”

他還舉了放射科醫生的例子。Geoffrey Hinton 曾預測 AI 會取代放射科醫生,AI 確實在讀掃描片上超過了放射科醫生。但放射科醫生並沒有減少,他們轉向了跟病人溝通、陪病人走完檢查流程這些工作。“這份工作中技術含量最高的部分消失了,但某種對底層人際技能的需求仍然存在。”

Nikhil 說:"我不完全買賬。“如果一個 AI Agent 能幫他管理人際關係和對話,那所謂的”關係網絡"護城河也撐不了多久。

Dario 承認:"長遠來看,AI 會不會在基本上一切事情上都比我們強?包括物理世界、機器人、人際接觸?我覺得這是可能的,甚至很可能的。"

但他說我們需要”一步步來”,用實證科學的方式觀察 AI 實際做了什麼,然後適應。”讓我們先看看 AI 今天能做什麼,去適應它,然後再看接下來會發生什麼。”

創業者的機會:可能性球體每 2-3 個月擴大一次

Nikhil 替他的印度創業者觀眾問:AI 領域具體有什麼機會?

Dario 說應用層有大量機會。Anthropic 每 2-3 個月發佈新模型,每次都意味着一批之前不可能實現的事情變得可能了。”有人說 API 模型不可行或者會被商品化,但他們沒看到的是,AI 能做什麼的範圍在不斷擴大。”這不是一個靜態市場,而是一個不斷膨脹的可能性球體。

Nikhil 追問:Anthropic 估值 3800 億美元,融了 350 億美元,收入 150 億美元還在快速增長。如果一個印度班加羅爾的創業者在 Claude 上面建了一個應用碰巧成功了,Anthropic 不會來拿走這個收入嗎?他用法律 AI 公司 Harvey 的例子,Harvey 建在 OpenAI 上面,但不知道 OpenAI 什麼時候會自己做這個功能。

Dario 先給了通用建議:"要建立護城河,不要只做套殼產品。"只是給 Claude 套個 UI 或者寫個提示詞模板是沒有護城河的,你不需要擔心 Anthropic 來吃這個收入,任何人都能吃。

然後他給出了有護城河的方向:生物×AI(“我碰巧是生物學家,但 Anthropic 的大多數人不是”)、金融服務(“有大量監管,需要懂很多東西才能合規”)。這些領域對 Anthropic 來說“效率太低”,不會去做。

但他也承認有些領域 Anthropic 會直接競爭:"我們不會承諾永遠不做第一方產品。比如 Claude Code,Anthropic 的人寫代碼,所以我們對如何用 AI 寫代碼有特殊的洞察。在代碼領域我們確實成了非常強的競爭者,因為這是我們自己在用的東西。但我不認為這能推廣到所有行業。"

注:根據 Anthropic 公開數據,截至 2026 年 2 月,其年化收入達到 140 億美元,其中約 80% 來自企業客戶。Claude Code 的年化收入達到 25 億美元。

年輕人該學什麼:批判性思維是最後的邊緣

Nikhil 問:一個 25 歲的印度年輕人,想在未來十年裏在資本主義競爭中贏,該選什麼方向?

Dario 給了三個方向。

第一,以人為中心的工作。 涉及與人打交道的職業有更長的跑道。

第二,物理世界相關的工作。 半導體是一個好例子,有“物理世界”和“傳統工程”兩個 AI 還沒完全覆蓋的維度。

第三,也是他最強調的:批判性思維。 當 AI 能生成任何內容,圖像、視頻、文本,分辨真假變得越來越難。“成功的很大一部分可能就是擁有街頭智慧,不被虛假內容騙到。你不想持有錯誤信念,不想被詐騙。”

他補充說 Anthropic 不做圖像和視頻生成,“有很多原因,這是其中之一”。

關於寫代碼和軟件工程,他做了一個區分:寫代碼(寫代碼的具體動作)會先被 AI 替代,但更廣泛的軟件工程(系統設計、理解用戶需求、管理 AI 團隊)需要更長時間。即便如此,他認為這也終將發生。

但他補充了一個反直覺的觀點:即使你只做任務的 5%,因為 AI 做了另外 95%,你的產出被放大了 20 倍。"比較優勢出奇地強大。"

去技能化:“如果部署不當,人類會變笨”

Nikhil 問:歷史上每次創新都殺死了一種核心人類技能。計算器殺死了心算能力,書寫減弱了人類的記憶力。AI 殺死的是什麼?

Dario 先挑戰了前提:“我不完全同意。我仍然經常在腦中做數學計算,因為它跟我的思維過程更融合。比如我想算'如果每個用戶付這個金額,收入是多少',我想在腦子裏閉合這個循環,而不是交給計算器。”

但他承認如果使用方式不對,技能退化確實會發生。“我們已經開始看到了,學生讓 AI 寫論文,這基本就是作弊。”

Anthropic 做了關於代碼的內部研究。結果取決於使用方式,"有些使用方式不會導致去技能化,有些會"。

Nikhil 追問:你覺得人類作為一個種族會不會在未來十年變得更笨?

Dario 說:"如果我們以錯誤的方式部署 AI、漫不經心地部署,那是的,人們可能會變笨。即使 AI 在某件事上永遠比你強,你仍然可以學習那件事,仍然可以在智識上充實自己。所以這是我們作為公司、個人和社會整體必須做出的選擇。"

開源 vs 閉源:“唯一重要的是最好的模型”

Nikhil 問:開源模型越來越好(他提到了智譜的 GLM5 和 DeepSeek),建應用是不是該選開源?

Dario 的回應分為兩層。

第一層: 他認為很多這些模型,特別是來自中國的,“針對基準測試做了優化,是從美國大型實驗室蒸餾出來的”。他提到最近有人做了一個未公開的測試,這些模型在常規基準上得分很高,但在這個之前從未被公開測量過的新測試上“表現差了很多”。

注:Dario 沒有給出具體的測試名稱或來源。作為閉源模型公司的 CEO,這一判斷存在明顯的利益相關性。

第二層是更宏觀的經濟學論點。 AI 模型的市場跟以往任何技術都不一樣,它更像人才市場。“如果我跟你說,你可以僱世界上最好的程序員或者第 10000 名程序員,他們都很有技能,但任何僱過大量人的人都有這種直覺,能力有一種冪律長尾分佈。模型也一樣。”

在這種分佈下,價格不太重要,呈現形式不太重要,只有認知能力最重要。"我幾乎完全只關注一件事:擁有最聰明的模型。我認為這是長期唯一重要的東西。"

數據主權與生物科技

談到數據的地緣政治問題時,Dario 做了一個區分。訓練數據正在從靜態數據轉向動態數據,當模型在數學問題或寫代碼環境上做強化學習時,“你不是在獲取傳統意義上的數據,更像是模型自己在做試錯”。所以靜態數據的重要性在下降。

但客戶數據和個人數據的本地化需求是真實的。歐洲已經立法要求個人和專有數據留在各國境內,這是各國建設本地數據中心的一個重要原因。

話題轉到投資時,Nikhil 試圖讓 Dario 推薦一隻股票。“我把同樣的問題逼着 Elon 回答了,他說 Google。”

Dario 果斷拒絕了個股推薦(“我瞭解太多上市公司的內部信息”),但在被追問具體行業後鬆了口。

他看好生物科技。“生物科技即將迎來一場文藝復興,最終將由 AI 驅動。我們即將治癒很多疾病。”

他特別看好兩個方向:

• 肽類藥物(peptide-based therapies):小分子藥物的自由度有限,“改善一個方面另一個方面就變差”,而肽類有一種“幾乎是數字化的屬性”,可以說“我在這裏換一個氨基酸、在那裏換一個”,允許更精確的連續優化 • CAR-T 等細胞療法:從患者體內取出細胞,進行基因工程改造使其攻擊特定癌症,然後放回體內

Nikhil 問幹細胞療法管不管用,他上週剛花了一整週在醫院做霧化吸入和靜脈注射幹細胞。Dario 笑着說他不瞭解幹細胞療法的最新進展,”你得問一個現在還在執業的生物學家”,但重申了對肽類療法的信心。

學會使用 AI:“鋼琴不是坐下來就能彈的”

Nikhil 坦言自己第一次用 Claude Code 時遇到了困難。“對於一個很笨、沒有編程知識的人來說,它不是非常容易上手的。就像彈鋼琴一樣,你不能坐下來就彈。”

Dario 同意存在學習曲線,並透露 Cowork 的誕生正是因為看到很多非技術用戶在命令行終端裏苦苦掙扎。“對程序員來說命令行終端很日常,但對非程序員來說它讓事情變得不必要地複雜。”Cowork 在底層由 Claude Code 引擎驅動,但設計成了更友好的界面。

他還提到 Anthropic 內部有一個叫“教育部”(Ministry of Education) 的部門,正在製作更多關於如何有效使用 Agent 和提示詞模型的教學視頻。“我們會加大力度,因為我們確實希望每個人都能學會這個。”

“幾乎可以免費預測未來”

Nikhil 最後問:你知道什麼是其他人不知道的?

Dario 說他知道的大多數事情現在其實已經是公開信息了。但他有一個過去十年反覆驗證的經驗:

人們總有一種誘惑去相信“那不可能發生,變化太大了,太瘋狂了”。但一次又一次,簡單地外推曲線,或者從第一性原理推理,就會得到幾乎沒人相信的反直覺結論。你幾乎可以免費預測未來,只需說“從邏輯上推斷……”

(“You can predict the future for free just by saying 'well it stands to reason that...'”)

他補充說,純邏輯推理是另一種錯誤。你需要的是"少量經驗觀察“加”第一性原理思考"的正確組合。這種能力是公開的,任何人都應該能做到,但做到的人少得驚人。

Dario 在這場對話裏很直接。他承認權力集中讓他不安,承認 Anthropic 會在擅長的領域跟創業者直接競爭,承認 AI 最終“可能在基本上一切事情上都比人類強”。

但直接不等於答案。Nikhil 問出的那些最尖鋭的問題,“你的謙遜是策略嗎”、“這不是有錢人批評資本主義嗎”、“你不會拿走創業者的收入嗎”,得到的回答都指向“看我們的行動”。而行動的解讀空間很大。

幾個值得持續觀察的信號:

• Anthropic 的 LTBT 治理機制在面臨真正的壓力測試時能否發揮作用 • SB 53 法案實施後的行業影響 • AI 從“替代寫代碼”到“替代軟件工程”的實際時間線 • 以及 Dario 預言的“AI 海嘯”到來時,社會是否已經做好了準備,或者仍在說“那只是光線的錯覺”

完整訪談視頻:https://www.youtube.com/watch?v=68ylaeBbdsg