AutoPreso:用語音實時驅動白板,讓演示內容自動畫出來

整理版優先睇

AutoPreso:用語音實時驅動白板,讓演示內容自動畫出來

呢篇文章係由前Meta、Microsoft工程師 @kunchenguid 開發嘅開源工具 AutoPreso 嘅介紹。作者想解決傳統演示製作需要手動繪圖、調整佈局嘅痛點,提出咗一種「語音即演示」嘅全新交互範式。整體結論係:AutoPreso 能夠喺頭腦風暴、需求溝通、教學等場景大幅降低可視化嘅門檻,雖然目前處於Alpha階段,有繪製偏差、語音延遲等侷限,但代表咗AI工具從「做演示」轉向「說演示」嘅方向。

AutoPreso 嘅核心係利用OpenAI嘅實時語音模型(GPT-Realtime-2),配合Excalidraw畫布,達到「你講話,白板自動畫」嘅效果。佢支援Staging(預熱)同Live(直播)雙模式,仲可以本地部署,保護私隱。安裝簡單,用npm全局安裝即可啟動,瀏覽器內操作直觀。

文章亦理性分析咗工具嘅優勢同侷限:優勢係Hands-free、智能預熱、靈活部署;侷限係依賴模型能力、語音識別延遲、本地支持以Mac最好。作者建議用家做好前期準備、說話節奏適中、結合迭代使用,並強調呢個工具唔係取代PowerPoint,而係提供新交互方式。

- AutoPreso 實現語音實時驅動白板,唔使手動畫圖,專注表達即可。

- 雙模式設計:Staging 預熱階段放種子內容,Live 模式 AI 根據語音動態繪圖。

- 支援雲端(OpenAI API)同本地(Moonshine+Ollama)部署,私隱友好。

- 目前 Alpha 階段,複雜場景可能繪製偏差,語音太快會滯後,Mac 支持最好。

- 前期準備充分、說話清晰分段、必要時暫停調整,可以提升體驗。

AutoPreso GitHub 倉庫

項目原始碼及文檔,包含安裝指引、配置說明同使用示範。

語音即演示嘅新玩法

今日介紹嘅開源小神器 AutoPreso,由前Meta、Microsoft工程師開發,利用OpenAI實時語音模型,做到「你講話,白板自動畫」嘅核心體驗。唔使再一邊講一邊手忙腳亂畫圖,啱曬頭腦風暴、產品需求溝通、課堂教學呢類場景。

四大核心亮點

AutoPreso 有幾個好實用嘅設計,值得停低睇清楚。

真正Hands-free,唔需要手動操作

- 1 Staging + Live 雙模式:Staging階段可以手動丟入標題、議程、參考圖片做「種子內容」;Live模式AI會根據實時語音動態繪圖、標註、調整位置。

- 2 智能預熱機制:進入Live前AI會針對Staging內容預熱循環,避免第一句話後模型發愣,提升連貫性。

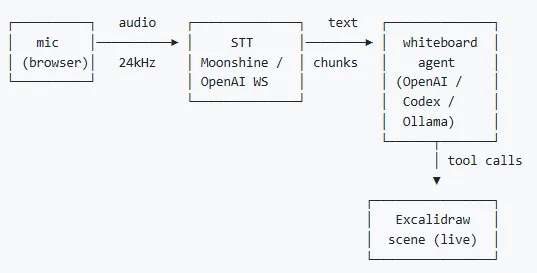

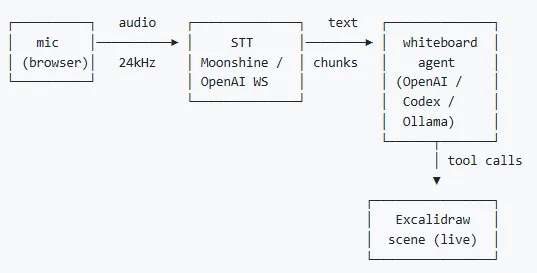

- 3 靈活部署:雲端用OpenAI API Key,本地可以用Moonshine語音轉文字 + Ollama大模型,完全離線運行(Mac支持更好)。

- 4 本地安全服務器只綁定127.0.0.1,唔會向外網上傳演講內容。

呢啲設計令到成個體驗好流暢,演示視頻入面見到說話同時文字實時轉錄,AI快速生成圖表同連接。

點樣用?安裝同操作流程

安裝非常簡單,推薦用npm方式。

npm install -g autopreso

autopreso唔想安裝都可以直接用 npx autopreso 啟動。啟動後自動打開瀏覽器訪問 http://127.0.0.1:3210。

- 1 Staging階段:喺左側Excalidraw畫布拖入或手繪種子內容(標題、關鍵點、參考圖等)。

- 2 配置:右側面板揀麥克風、語音轉文字模型、代理模型,仲可以填寫自定義Agent Instructions(最多10萬字符)。

- 3 進入Live:撳「Start Preso」開始講話,白板會實時響應。

- 4 隨時切換:可以返去Staging模式或Reset Session,過程流暢。

潛力與侷限

AutoPreso 喺頭腦風暴、需求溝通、教學場景有好大潛力,邊講邊可視化,極大降低溝通成本。個人思考嘅時候亦可以即時得到視覺回饋。加上開源可本地運行,私隱友好,成本可控。

複雜場景下可能出現繪製偏差或佈局混亂

不過佢始終係Alpha階段,有幾個侷限:依賴模型能力,用戶要用口頭引導修正;語音識別延遲同白板更新同步係潛在瓶頸,講得太快會覆蓋或滯後;目前Mac本地支持最完善,其他平台推薦用OpenAI Realtime。整體嚟講,呢個工具唔可能完全取代PowerPoint,而係提供一種「說演示」嘅新範式。

使用建議

- Staging階段多放清晰嘅種子元素,Agent Instructions寫得越具體越好,例如「優先使用流程圖、保持佈局清晰、用顏色區分模塊」。

- 說話節奏適中,清晰分段,避免過多語氣詞,必要時用引導語如「而家畫一個柱狀圖比較A同B」。

- Live過程中發現問題,可以暫停、回Staging調整再繼續。

- 如果有Ollama環境,優先本地部署,降低成本同私隱顧慮。

你覺得呢種「語音即演示」嘅方式會唔會改變你嘅工作或學習流程?歡迎一齊探討。

今日想同大家分享一個啱啱出現嘅開源小神器:AutoPreso。佢由前Meta、Microsoft工程師 @kunchenguid 開發,利用OpenAI最新嘅實時語音模型(GPT-Realtime-2),實現你講嘢,白板自動畫嘅核心體驗。

唔使一邊講一邊手忙腳亂咁畫圖、調整佈局、插入箭頭。只要開聲講諗法,白板就好似有咗生命咁,實時生成結構圖、流程圖、柱狀圖,甚至自動重排佈局。呢啲對腦震盪、產品需求溝通、課堂教學嚟講,簡直係降維打擊。

一、AutoPreso 核心亮點

1. 真正Hands-free(唔需要手動操作)

語音直接驅動AI代理編輯Excalidraw畫布。你只需要專注表達,AI負責可視化呈現。2. Staging + Live雙模式 ◦ Staging(預熱階段):好似普通白板咁,先手動放入標題、議程、參考圖片或草圖,作為「種子內容」。 ◦ Live(直播模式):撳「Start Preso」之後,AI會接管畫布。根據你嘅實時語音,會動態繪圖、標註、調整位置等。 3. 智能預熱機制

進入Live前,AI會針對你嘅Staging內容進行預熱循環,避免第一句說話講完之後模型仲喺度「發呆」。咁樣極大提升咗連貫性。4. 靈活部署 ◦ 雲端:用自己嘅OpenAI API Key(支援Realtime語音同GPT-5.5等代理模型)。 ◦ 本地:Moonshine本地語音轉文字 + Ollama本地大模型,完全離線運行(目前Mac支援比較好)。

而且項目本身完全免費開源。5. 本地安全

伺服器只綁定127.0.0.1,本地網絡內運行,唔會向外網上傳你嘅演講內容。

二、點樣用?

安裝非常簡單(推薦npm方式):

# 全局安裝(推薦)

npm install -g autopreso

# 然後直接運行

autopreso

或者唔使安裝,直接用 npx autopreso 啓動就得。啓動之後會自動打開瀏覽器,訪問 http://127.0.0.1:3210。

瀏覽器入面操作流程:

1. Staging階段:喺左側Excalidraw畫布上,拖入或者手繪你嘅種子內容(標題、關鍵點、參考圖等)。你可以自由編輯。 2. 配置:右邊面板選擇麥克風、語音轉文字模型(Moonshine或OpenAI Realtime)、代理模型(OpenAI/Codex/Ollama),仲可以填寫自定義Agent Instructions(智能體身份規則,持久保存,最多10萬個字符)。 3. 進入Live:撳「Start Preso」。而家開始講嘢,白板就會實時回應。 4. 隨時切換:覺得需要調整,可以返去Staging模式,或者Reset Session。

成個過程好流暢,示範片入面見到講嘢嘅同時,文字實時轉錄,AI快速生成圖表同連接,效果非常自然。

三、分析:潛力同限制

優勢同適用場景:

• 腦震盪/需求溝通:邊傾邊可視化,結構圖、流程圖自動出現,極大降低溝通成本。 • 教學場景:老師講課時,知識點隨講隨畫,學生可以直觀睇到知識結構嘅動態構建。 • 個人思考:一個人自言自語整理思路嗰陣,都可以得到實時視覺反饋。 • 開源+可以本地運行,私隱友好,成本可控。

目前限制(Alpha階段):

• 依賴模型能力,複雜場景下可能出現繪製偏差或者佈局混亂,需要用家口頭引導修正。 • 語音識別延遲同白板更新同步係潛在瓶頸,講得太快嘅時候,可能出現覆蓋或者滯後。 • 目前Mac本地支援最完善,其他平台建議優先使用OpenAI Realtime。 • 作為早期項目,穩定性仲喺度迭代中,唔適合極度正式嘅高壓演示場景(可以作為輔助工具)。

總括嚟講,佢唔可能完全取代PowerPoint,而係提供咗一種全新互動範式:由「做演示」轉向「講演示」。呢個符合AI工具演進嘅方向,令技術隱形,令人類專注核心價值。

四、使用建議

1. 前期準備充足:Staging階段多放清晰嘅種子元素,Agent Instructions寫得越具體越好(例如「優先使用流程圖、保持佈局清晰、用顏色區分模塊」)。 2. 講話節奏適中:清晰、分段,避免太多語氣詞。必要時用「而家畫一個柱狀圖比較A同B」噉樣嘅引導語。 3. 結合迭代:Live過程中發現問題,可以暫停、返Staging調整,再繼續。 4. 本地優先嘗試:如果有Ollama環境,優先本地部署,降低成本同私隱顧慮。

項目地址:https://github.com/kunchenguid/autopreso

你覺得呢種「語音即演示」嘅方式會改變你嘅工作/學習流程嗎?我哋下期繼續傾更多前沿開源AI工具!

(本文基於GitHub公開資訊同示範片整理,觀點中立,僅供參考。AI工具發展迅速,建議親身體驗最新版本。)

今天想和大家分享一個剛剛冒出來的開源小神器:AutoPreso。它由前Meta、Microsoft工程師 @kunchenguid 開發,利用OpenAI最新的實時語音模型(GPT-Realtime-2),實現你說話,白板自動畫的核心體驗。

不需要一邊講一邊手忙腳亂地畫圖、調整佈局、插入箭頭。只要開口講想法,白板就像有了生命一樣,實時生成結構圖、流程圖、柱狀圖,甚至自動重排佈局。這對頭腦風暴、產品需求溝通、課堂教學來說,簡直是降維打擊了。

一、AutoPreso 核心亮點

1. 真正Hands-free(不需要手動操作)

語音直接驅動AI代理編輯Excalidraw畫布。你只需專注表達,AI負責可視化呈現。2. Staging + Live雙模式 ◦ Staging(預熱階段):像普通白板一樣,先手動丟入標題、議程、參考圖片或草圖,作為“種子內容”。 ◦ Live(直播模式):點擊“Start Preso”後,AI會接管畫布。根據你的實時語音,會動態繪圖、標註、調整位置等。 3. 智能預熱機制

進入Live前,AI會針對你的Staging內容進行預熱循環,避免第一句話說完後模型還在“發愣”。這極大提升了連貫性。4. 靈活部署 ◦ 雲端:用自己的OpenAI API Key(支持Realtime語音和GPT-5.5等代理模型)。 ◦ 本地:Moonshine本地語音轉文字 + Ollama本地大模型,完全離線運行(目前Mac支持更好)。

而且項目本身完全免費開源。5. 本地安全

服務器只綁定127.0.0.1,本地網絡內運行,不會向外網上傳你的演講內容。

二、如何使用?

安裝非常簡單(推薦npm方式):

# 全局安裝(推薦)

npm install -g autopreso

# 然後直接運行

autopreso

或者不用安裝,直接用 npx autopreso 啓動即可。啓動後會自動打開瀏覽器,訪問 http://127.0.0.1:3210。

瀏覽器內操作流程:

1. Staging階段:在左側Excalidraw畫布上,拖入或手繪你的種子內容(標題、關鍵點、參考圖等)。你可以自由編輯。 2. 配置:右側面板選擇麥克風、語音轉文字模型(Moonshine或OpenAI Realtime)、代理模型(OpenAI/Codex/Ollama),還可以填寫自定義Agent Instructions(智能體身份規則,持久保存,最多10萬字符)。 3. 進入Live:點擊“Start Preso”。現在開始說話,白板就會實時響應。 4. 隨時切換:覺得需要調整,可以回到Staging模式,或Reset Session。

整個過程流暢,演示視頻裏能看到說話的同時,文字實時轉錄,AI快速生成圖表和連接,效果非常自然。

三、分析:潛力與侷限

優勢與適用場景:

• 頭腦風暴/需求溝通:邊聊邊可視化,結構圖、流程圖自動出現,極大降低溝通成本。 • 教學場景:老師講課時,知識點隨講隨畫,學生能直觀看到知識結構的動態構建。 • 個人思考:一個人自言自語梳理思路時,也能得到實時視覺反饋。 • 開源+可本地運行,隱私友好,成本可控。

當前侷限(Alpha階段):

• 依賴模型能力,複雜場景下可能出現繪製偏差或佈局混亂,需要用戶口頭引導修正。 • 語音識別延遲和白板更新同步是潛在瓶頸,講得太快時,可能出現覆蓋或滯後。 • 目前Mac本地支持最完善,其他平台推薦優先用OpenAI Realtime。 • 作為早期項目,穩定性還在迭代中,不適合極致正式的高壓演示場景(可作為輔助工具)。

總體來說,它不可能完全取代PowerPoint,而是提供了一種全新交互範式:從“做演示”轉向“說演示”。這符合AI工具演進的方向,讓技術隱形,讓人類專注核心價值。

四、使用建議

1. 前期準備充分:Staging階段多放清晰的種子元素,Agent Instructions寫得越具體越好(例如“優先使用流程圖、保持佈局清晰、用顏色區分模塊”)。 2. 說話節奏適中:清晰、分段,避免過多語氣詞。必要時用“現在畫一個柱狀圖比較A和B”這樣的引導語。 3. 結合迭代:Live過程中發現問題,可以暫停、回Staging調整,再繼續。 4. 本地優先嚐試:如果有Ollama環境,優先本地部署,降低成本和隱私顧慮。

項目地址:https://github.com/kunchenguid/autopreso

你覺得這種“語音即演示”的方式會改變你的工作/學習流程嗎?我們下期繼續聊更多前沿開源AI工具!

(本文基於GitHub公開信息和演示視頻整理,觀點中立,僅供參考。AI工具發展迅速,建議親自體驗最新版本。)