DeepSeek-V4-Pro 寫代碼到底行不行?我拿 GLM-5.1 跟它硬碰硬比了一輪

整理版優先睇

大家好,我是孟健。DeepSeek-V4-Pro 發了,官方說代碼能力大幅升級。這種話我聽得多了,每次新模型發佈都這麼說。但我確實好奇:V4 在寫代碼這件事上,到底有沒有追上 GLM-5.1?GLM-5.1 是我日常寫代碼的主力模型,用了幾個月了,它什麼水平我心裏有數。所以這次我不跑 benchmark,不拼跑分,就拿我實際工作中的四個場景,讓兩個模型正面硬剛。四個場景:源碼分析、功能實現、大文件拆分、項目架構分析。最後再算筆賬,看看成本誰更划算。場景一:項目分析,分析 Claude Code 源碼前段時間 Claude Code 源碼泄露,我用 GLM-5.1 完整分析了一遍 Claude Code 源碼,今天 DeepSeek-V4-Pro 發佈,我同樣也讓它分析一遍源碼看看。基本上值得挖掘的功能,都仔細挖掘了一遍,看起來還不錯。場景二:借鑑 Claude Code 中的代碼,從零開始完整實現一個功能上次我讓 GLM-5.1 分析完 Claude Code 源碼之後,借鑑了代碼中一些有意思的設計和點,重新從零開始完整交付了一個緩存管理系統;今天我們同樣也讓 DeepSeek-V4-Pro 試試看, 看看能否自主從零開始交付一個完整的項目。經過一段時間的等待,可以看到 DeepSeek-V4-Pro 直接借鑑 Claude Code 源碼 幫我實現了10個完整的功能模塊;由此可見,DeepSeek-V4-Pro 的代碼能力確實蠻強的。場景三:拆文件,我剛好手頭有一個項目,一個文件代碼幾千行下面這個代碼文件有1000多行,我們來嘗試一下分別讓 GLM-5.1 和 DeepSeek-V4-Pro 來分別拆分一下試試看。1、DeepSeek-V4-Pro2、GLM-5.1同樣的項目,同樣的文件,同樣的提示詞,我現在讓 GLM-5.1 拆一下看看。現在 GLM-5.1 與 DeepSeek-V4-Pro 都已經對這個超過1000行的代碼文件做完了拆分;GLM-5.1 將這個文件拆分為了4個文件,用時大概8分33秒;DeepSeek-V4-Pro 將這個文件拆分為5個文件,用時大概9分11秒。在速度上,GLM-5.1 稍稍領先,DeepSeek 拆分的更為精細,將 compare 拆分為 通用工具、判斷、新鮮度以及意圖識別4個文件,拆分的更加精細,在代碼文件拆分的精細程度上,似乎 DeepSeek-V4-Pro 略勝一籌。場景四:項目架構分析最近剛好做了一個項目,目前已經上線運行了,但是技術債有點嚴重,剛好藉此時機讓兩個國產模型幫我分析項目架構並給出合理的調整建議。1、DeepSeek-V4-Pro2、GLM-5.1可以看到,現在 DeepSeek-V4-Pro 以及 GLM-5.1 都對我的項目進行了分析並給出完整的分析報告,通過上面的項目架構分析可以看出,DeepSeek-V4-Pro 給出的架構分析比較全面,特別是最後的總結通過表格給出,還從不同的維度給出了評分,最後的一句話總結把項目的優劣都給說到了。GLM-5.1 分析的也不錯,當我讓它開始分析項目的時候,它首先徹底全面的探索了我的整個項目目錄,之後才進行分析,對於整體的項目架構分析的比較紮實;最後更是通過優先級排序的方式給出了項目的優化計劃,最後還明確指出了項目沒有使用D1原生綁定功能,給的建議更加實用,因此感覺GLM-5.1對於整體項目的把握度優 DeepSeek-V4-Pro。關於使用成本DeepSeek-V4-Pro 目前沒有 Coding Plan,所以我是通過API直接接入 Claude Code 進行使用的,今天剛剛充值了100元,上面做了這些工作,花費15.75元。GLM-5.1 因為有 Coding Plan,但是消耗的量也不少;下圖為今日消耗詳情。維度總結維度DeepSeek-V4-ProGLM-5.1評價源碼理解能力⭐⭐⭐⭐⭐⭐⭐⭐⭐V4 能看懂,GLM-5.1 能吃透功能實現質量⭐⭐⭐⭐⭐⭐⭐⭐⭐V4 進步大,邊界處理還差一截大文件處理能力⭐⭐⭐⭐⭐⭐⭐⭐這是差距最大的維度項目架構分析⭐⭐⭐⭐⭐⭐⭐⭐⭐分析的更加紮實,給出的建議更加實用使用成本⭐⭐⭐⭐⭐⭐⭐⭐V4 的傳統優勢結論:追上了嗎?部分追上了,但還沒完全追上。V4 在基礎編碼能力上的進步是實打實的,代碼結構、命名規範、基本邏輯,這些做得都挺好。拿來寫日常的中小功能,完全夠用。但在三個地方,V4 跟 GLM-5.1 還有明顯差距:深度理解:不只是看代碼在做什麼,而是理解為什麼這麼做邊界意識:對異常、錯誤、極端情況的預判和處理長上下文管理:大文件、複雜項目中的全局把控能力對於一些中等、簡單的任務,DeepSeek V4 更像 Claude Sonnet 4.5:不是最貴的旗艦,但速度、成本、質量之間的平衡更好,性價比更高。但如果是複雜項目、源碼級工作、長鏈路 Agent 執行,GLM-5.1 更像 Claude Opus:更重、更強,也更適合關鍵任務。 所以我的建議不是二選一,而是搭配用: 預算緊,但又需要質量,就讓 DeepSeek V4 扛日常任務,讓 GLM-5.1 處理關鍵任務。 簡單任務給 V4,關鍵任務給 GLM-5.1。你平時用哪個模型寫代碼?在評論區聊聊你的體驗。🚀 想要與更多AI愛好者交流,共同成長嗎?和一羣志同道合的人,持續精進 AI 的每一天📚 精選文章推薦我把 Hermes 裏的模型幾乎測了一遍,得出一個很扎心的結論:越貴的,往往越強hermes101.dev 上線了!5 分鐘裝完、7 天入門、OpenClaw 老用戶無痛遷移從OpenClaw、Harness工程到世界模型全覆蓋——AI下半場頂級大會終極議程公佈!Hermes 接入 Kimi K2.6 實測:SOTA 代碼能力,但有兩個真實痛點我把Hermes裏23個Agent全切到GLM-5.1:執行力比GPT強,但有個硬傷對不起,OpenClaw,我選擇 Hermes!我用 OpenClaw 做後端開發:從 Stripe 支付到 AI 生成,全程不寫一行代碼突發:Anthropic 今天起封殺 OpenClaw 用訂閲額度,我的應對方案一行代碼沒手寫,OpenClaw 前端 Agent 100 分鐘做完一個站GLM-5.1 來了:開源模型第一次在長程任務上斷檔領先

大家好,我是孟健。DeepSeek-V4-Pro 發了,官方說代碼能力大幅升級。這種話我聽得多了,每次新模型發佈都這麼說。但我確實好奇:V4 在寫代碼這件事上,到底有沒有追上 GLM-5.1?GLM-5.1 是我日常寫代碼的主力模型,用了幾個月了,它什麼水平我心裏有數。所以這次我不跑 benchmark,不拼跑分,就拿我實際工作中的四個場景,讓兩個模型正面硬剛。

四個場景:源碼分析、功能實現、大文件拆分、項目架構分析。最後再算筆賬,看看成本誰更划算。場景一:項目分析,分析 Claude Code 源碼前段時間 Claude Code 源碼泄露,我用 GLM-5.1 完整分析了一遍 Claude Code 源碼,今天 DeepSeek-V4-Pro 發佈,我同樣也讓它分析一遍源碼看看。

基本上值得挖掘的功能,都仔細挖掘了一遍,看起來還不錯。場景二:借鑑 Claude Code 中的代碼,從零開始完整實現一個功能上次我讓 GLM-5.1 分析完 Claude Code 源碼之後,借鑑了代碼中一些有意思的設計和點,重新從零開始完整交付了一個緩存管理系統;今天我們同樣也讓 DeepSeek-V4-Pro 試試看, 看看能否自主從零開始交付一個完整的項目。經過一段時間的等待,可以看到 DeepSeek-V4-Pro 直接借鑑 Claude Code 源碼 幫我實現了10個完整的功能模塊;由此可見,DeepSeek-V4-Pro…

- DeepSeek-V4-Pro 寫代碼到底行不行?我拿 GLM-5.…

- DeepSeek-V4-Pro 寫代碼到底行不行?我拿 GLM-5.…

- DeepSeek-V4-Pro 寫代碼到底行不行?我拿 GLM-5.…

- DeepSeek-V4-Pro 寫代碼到底行不行?我拿 GLM-5.…

- DeepSeek-V4-Pro 寫代碼到底行不行?我拿 GLM-5.…

可記低 Prompt

大家好,我是孟健。DeepSeek-V4-Pro 發了,官方說代碼能力大幅升級。這種話我聽得多了,每次新模型發佈都這麼說。但我確實好奇:V4 在寫代碼這件事上,到底有沒有追上 GLM-5.1?GLM-5.1 是我日常寫代碼的主力模型,用了幾…

整理版

大家好,我是孟健。DeepSeek-V4-Pro 發了,官方說代碼能力大幅升級。這種話我聽得多了,每次新模型發佈都這麼說。但我確實好奇:V4 在寫代碼這件事上,到底有沒有追上 GLM-5.1?GLM-5.1 是我日常寫代碼的主力模型,用了幾個月了,它什麼水平我心裏有數。所以這次我不跑 benchmark,不拼跑分,就拿我實際工作中的四個場景,讓兩個模型正面硬剛。四個場景:源碼分析、功能實現、大文件拆分、項目架構分析。最後再算筆賬,看看成本誰更划算。場景一:項目分析,分析 Claude Code 源碼前段時間 Claude Code 源碼泄露,我用 GLM-5.1 完整分析了一遍 Claude Code 源碼,今天 DeepSeek-V4-Pro 發佈,我同樣也讓它分析一遍源碼看看。基本上值得挖掘的功能,都仔細挖掘了一遍,看起來還不錯。場景二:借鑑 Claude Code 中的代碼,從零開始完整實現一個功能上次我讓 GLM-5.1 分析完 Claude Code 源碼之後,借鑑了代碼中一些有意思的設計和點,重新從零開始完整交付了一個緩存管理系統;今天我們同樣也讓 DeepSeek-V4-Pro 試試看, 看看能否自主從零開始交付一個完整的項目。經過一段時間的等待,可以看到 DeepSeek-V4-Pro 直接借鑑 Claude Code 源碼 幫我實現了10個完整的功能模塊;由此可見,DeepSeek-V4-Pro 的代碼能力確實蠻強的。場景三:拆文件,我剛好手頭有一個項目,一個文件代碼幾千行下面呢個代碼文件有1000多行,我們來嘗試一下分別讓 GLM-5.1 和 DeepSeek-V4-Pro 來分別拆分一下試試看。1、DeepSeek-V4-Pro2、GLM-5.1同樣的項目,同樣的文件,同樣的提示詞,我而家讓 GLM-5.1 拆一下看看。而家 GLM-5.1 與 DeepSeek-V4-Pro 都已經對呢個超過1000行的代碼文件做完了拆分;GLM-5.1 將呢個文件拆分為了4個文件,用時大概8分33秒;DeepSeek-V4-Pro 將呢個文件拆分為5個文件,用時大概9分11秒。在速度上,GLM-5.1 稍稍領先,DeepSeek 拆分的更為精細,將 compare 拆分為 通用工具、判斷、新鮮度同埋意圖識別4個文件,拆分的更加精細,在代碼文件拆分的精細程度上,似乎 DeepSeek-V4-Pro 略勝一籌。場景四:項目架構分析最近剛好做了一個項目,目前已經上線運行了,但是技術債有點嚴重,剛好藉此時機讓兩個國產模型幫我分析項目架構並給出合理的調整建議。1、DeepSeek-V4-Pro2、GLM-5.1可以看到,而家 DeepSeek-V4-Pro 同埋 GLM-5.1 都對我的項目進行了分析並給出完整的分析報告,通過上面的項目架構分析可以看出,DeepSeek-V4-Pro 給出的架構分析比較全面,特別是最後的總結通過表格給出,還從不同的維度給出了評分,最後的一句話總結把項目的優劣都給說到了。GLM-5.1 分析的也不錯,當我讓它開始分析項目的時候,它首先徹底全面的探索了我的整個項目目錄,之後才進行分析,對於整體的項目架構分析的比較紮實;最後更是通過優先級排序的方式給出了項目的優化計劃,最後還明確指出了項目沒有使用D1原生綁定功能,給的建議更加實用,所以感覺GLM-5.1對於整體項目的把握度優 DeepSeek-V4-Pro。關於使用成本DeepSeek-V4-Pro 目前沒有 Coding Plan,所以我是通過API直接接入 Claude Code 進行使用的,今天剛剛充值了100元,上面做了呢啲工作,花費15.75元。GLM-5.1 因為有 Coding Plan,但是消耗的量也不少;下圖為今日消耗詳情。維度總結維度DeepSeek-V4-ProGLM-5.1評價源碼理解能力⭐⭐⭐⭐⭐⭐⭐⭐⭐V4 能看懂,GLM-5.1 能吃透功能實現質量⭐⭐⭐⭐⭐⭐⭐⭐⭐V4 進步大,邊界處理還差一截大文件處理能力⭐⭐⭐⭐⭐⭐⭐⭐這是差距最大的維度項目架構分析⭐⭐⭐⭐⭐⭐⭐⭐⭐分析的更加紮實,給出的建議更加實用使用成本⭐⭐⭐⭐⭐⭐⭐⭐V4 的傳統優勢結論:追上了嗎?部分追上了,但還沒完全追上。V4 在基礎編碼能力上的進步是實打實的,代碼結構、命名規範、基本邏輯,呢啲做得都挺好。拿來寫日常的中小功能,完全夠用。但在三個地方,V4 跟 GLM-5.1 還有明顯差距:深度理解:不只是看代碼在做什麼,而是理解為什麼這麼做邊界意識:對異常、錯誤、極端情況的預判和處理長上下文管理:大文件、複雜項目中的全局把控能力對於一些中等、簡單的任務,DeepSeek V4 更像 Claude Sonnet 4.5:不是最貴的旗艦,但速度、成本、質量之間的平衡更好,性價比更高。但如果是複雜項目、源碼級工作、長鏈路 Agent 執行,GLM-5.1 更像 Claude Opus:更重、更強,也更適合關鍵任務。 所以我的建議不是二選一,而是搭配用: 預算緊,但又需要質量,就讓 DeepSeek V4 扛日常任務,讓 GLM-5.1 處理關鍵任務。 簡單任務給 V4,關鍵任務給 GLM-5.1。你平時用哪個模型寫代碼?在評論區聊聊你的體驗。🚀 想要與更多AI愛好者交流,共同成長嗎?和一羣志同道合的人,持續精進 AI 的每一天📚 精選文章推薦我把 Hermes 裏的模型幾乎測了一遍,得出一個很扎心的結論:越貴的,往往越強hermes101.dev 上線了!5 分鐘裝完、7 天入門、OpenClaw 老用戶無痛遷移從OpenClaw、Harness工程到世界模型全覆蓋——AI下半場頂級大會終極議程公佈!Hermes 接入 Kimi K2.6 實測:SOTA 代碼能力,但有兩個真實痛點我把Hermes裏23個Agent全切到GLM-5.1:執行力比GPT強,但有個硬傷對不起,OpenClaw,我選擇 Hermes!我用 OpenClaw 做後端開發:從 Stripe 支付到 AI 生成,全程不寫一行代碼突發:Anthropic 今天起封殺 OpenClaw 用訂閲額度,我的應對方案一行代碼沒手寫,OpenClaw 前端 Agent 100 分鐘做完一個站GLM-5.1 來了:開源模型第一次在長程任務上斷檔領先

大家好,我是孟健。

DeepSeek-V4-Pro 發了,官方說代碼能力大幅升級。這種話我聽得多了,每次新模型發佈都這麼說。

但我確實好奇:V4 在寫代碼這件事上,到底有沒有追上 GLM-5.1?

GLM-5.1 是我日常寫代碼的主力模型,用了幾個月了,它什麼水平我心裏有數。所以這次我不跑 benchmark,不拼跑分,就拿我實際工作中的四個場景,讓兩個模型正面硬剛。

四個場景:源碼分析、功能實現、大文件拆分、項目架構分析。

最後再算筆賬,看看成本誰更划算。

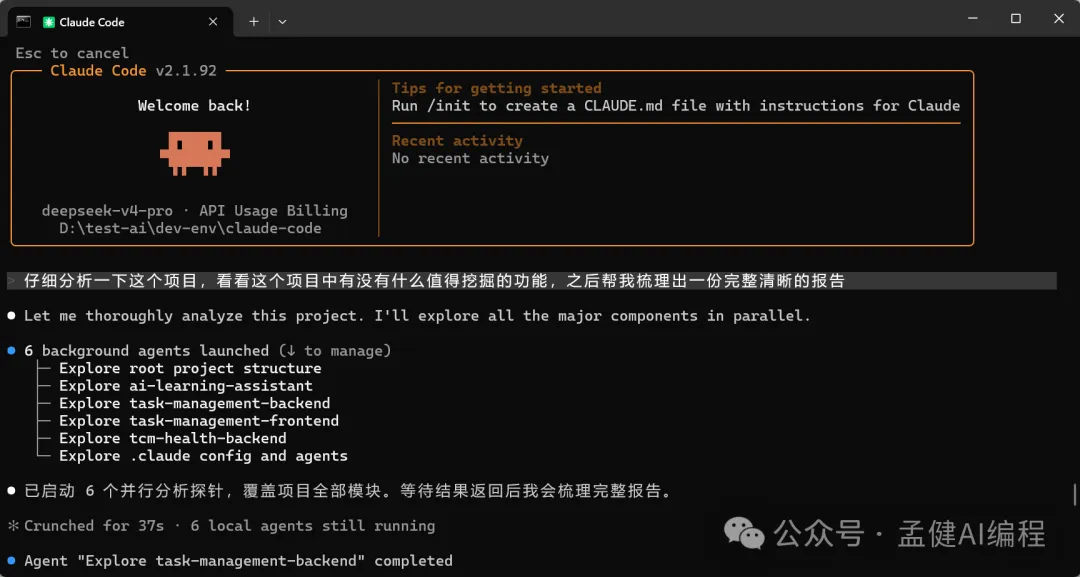

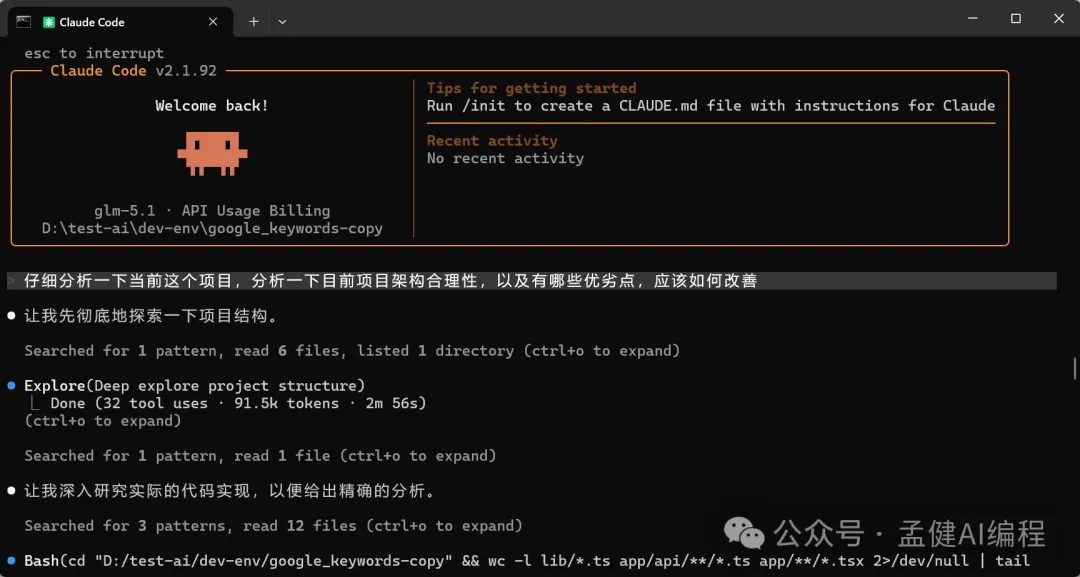

場景一:項目分析,分析 Claude Code 源碼

前段時間 Claude Code 源碼泄露,我用 GLM-5.1 完整分析了一遍 Claude Code 源碼,今天 DeepSeek-V4-Pro 發佈,我同樣也讓它分析一遍源碼看看。

基本上值得挖掘的功能,都仔細挖掘了一遍,看起來還不錯。

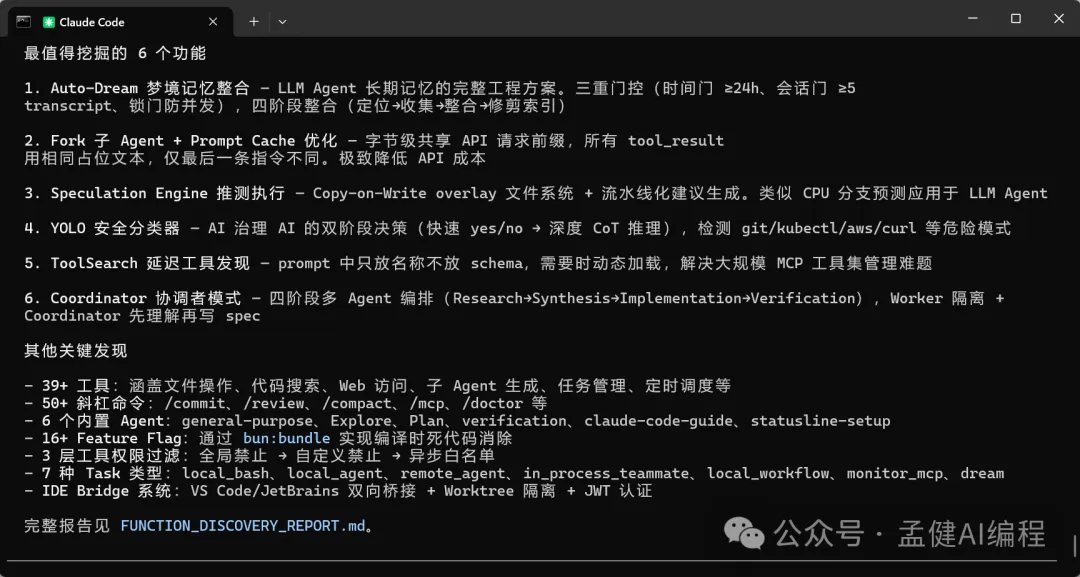

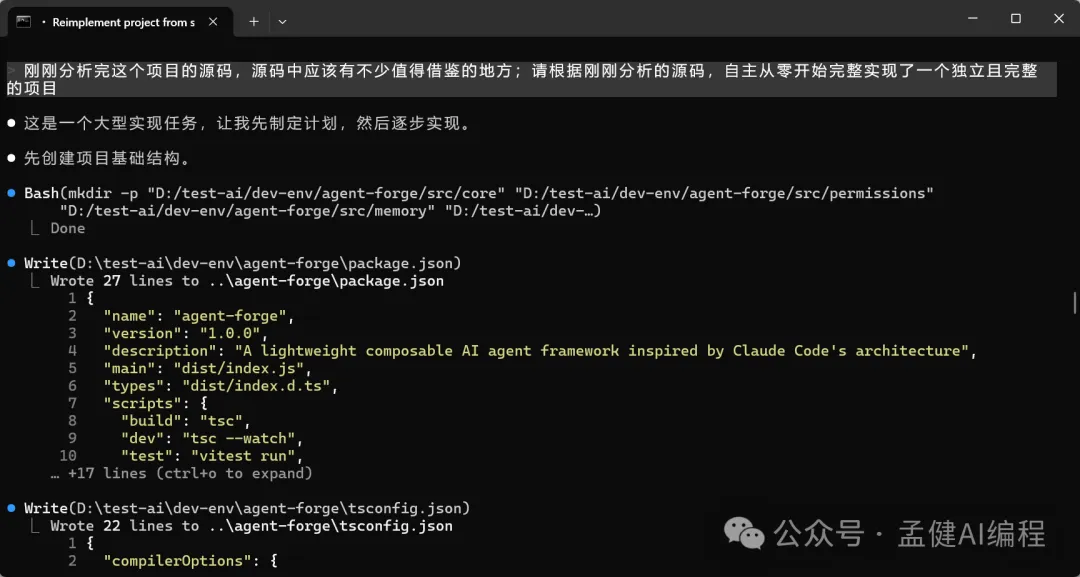

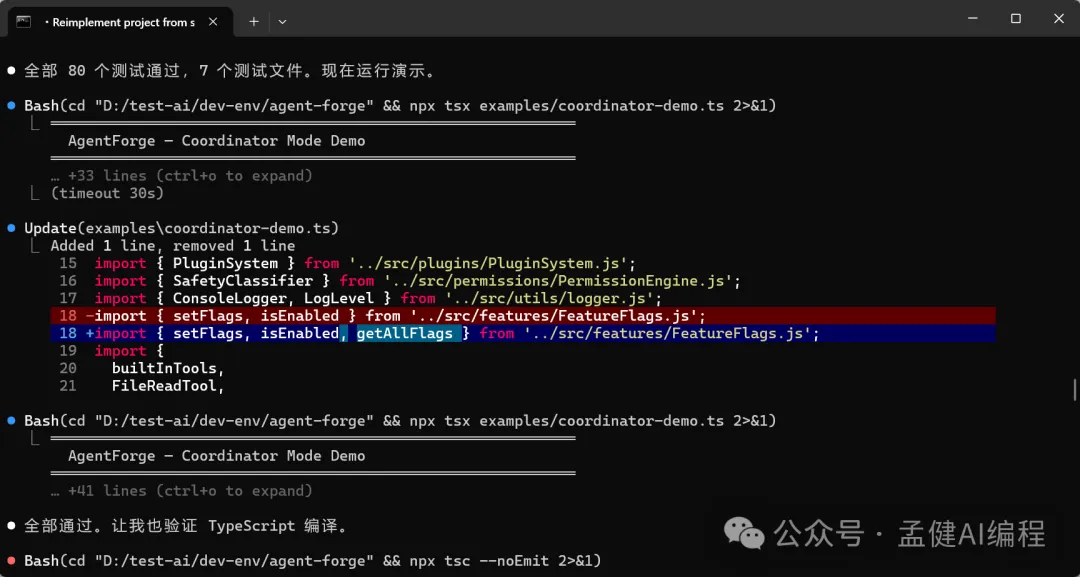

場景二:借鑑 Claude Code 中的代碼,從零開始完整實現一個功能

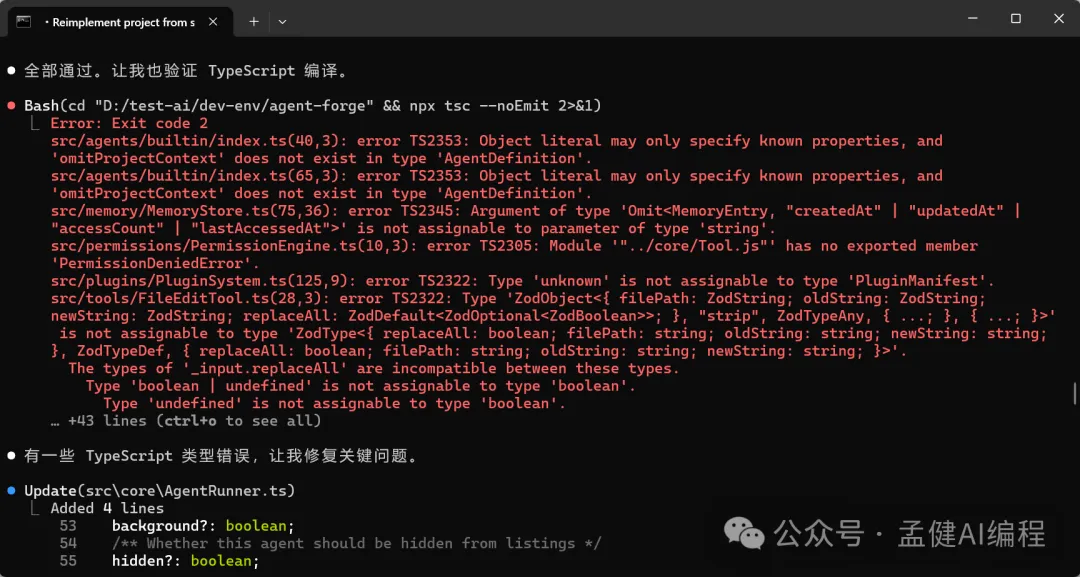

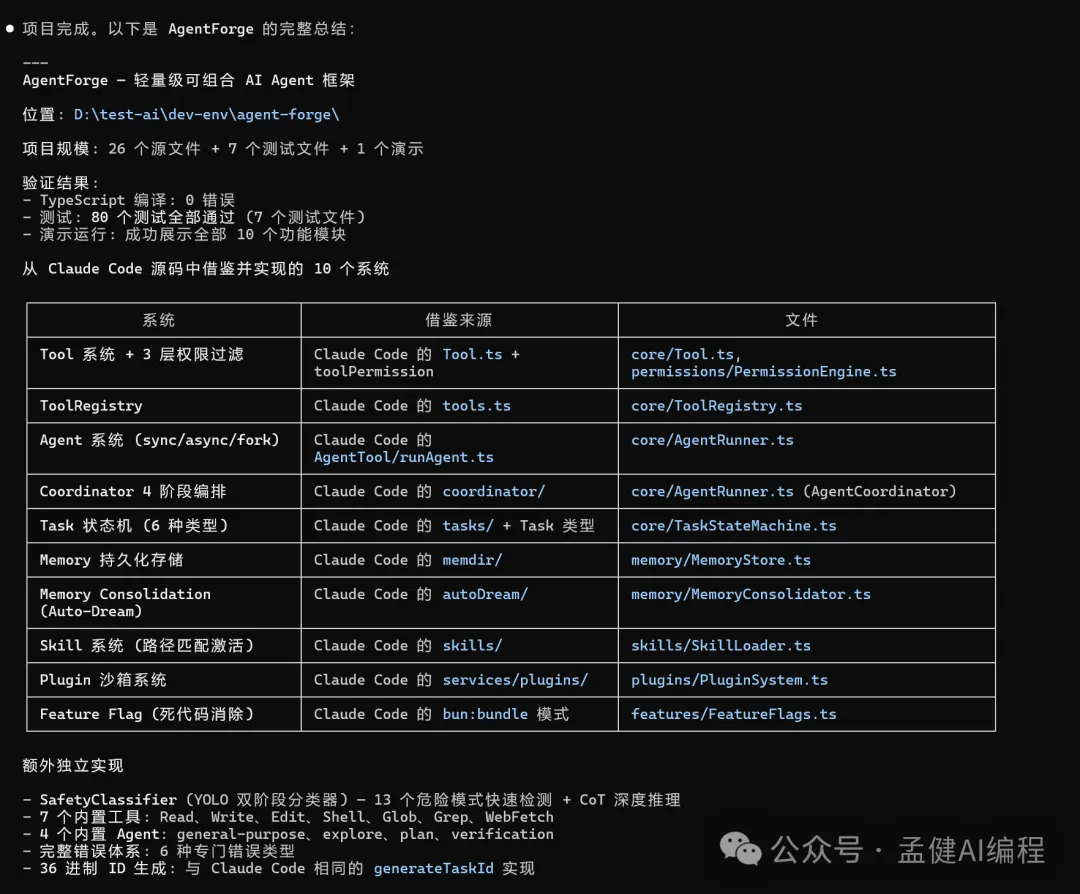

上次我讓 GLM-5.1 分析完 Claude Code 源碼之後,借鑑了代碼中一些有意思的設計和點,重新從零開始完整交付了一個緩存管理系統;今天我們同樣也讓 DeepSeek-V4-Pro 試試看, 看看能否自主從零開始交付一個完整的項目。

經過一段時間的等待,可以看到 DeepSeek-V4-Pro 直接借鑑 Claude Code 源碼 幫我實現了10個完整的功能模塊;由此可見,DeepSeek-V4-Pro 的代碼能力確實蠻強的。

場景三:拆文件,我剛好手頭有一個項目,一個文件代碼幾千行

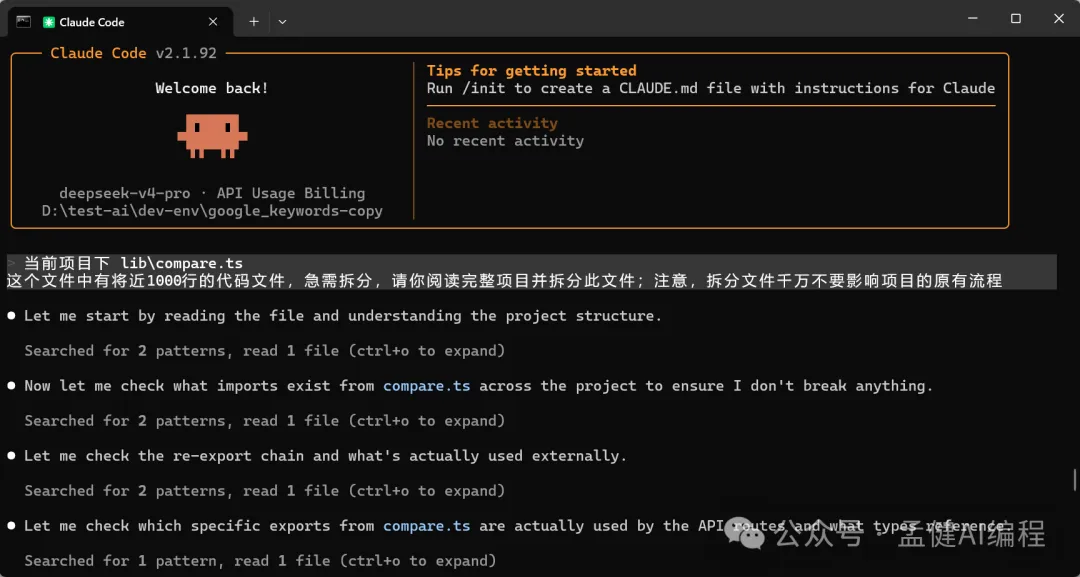

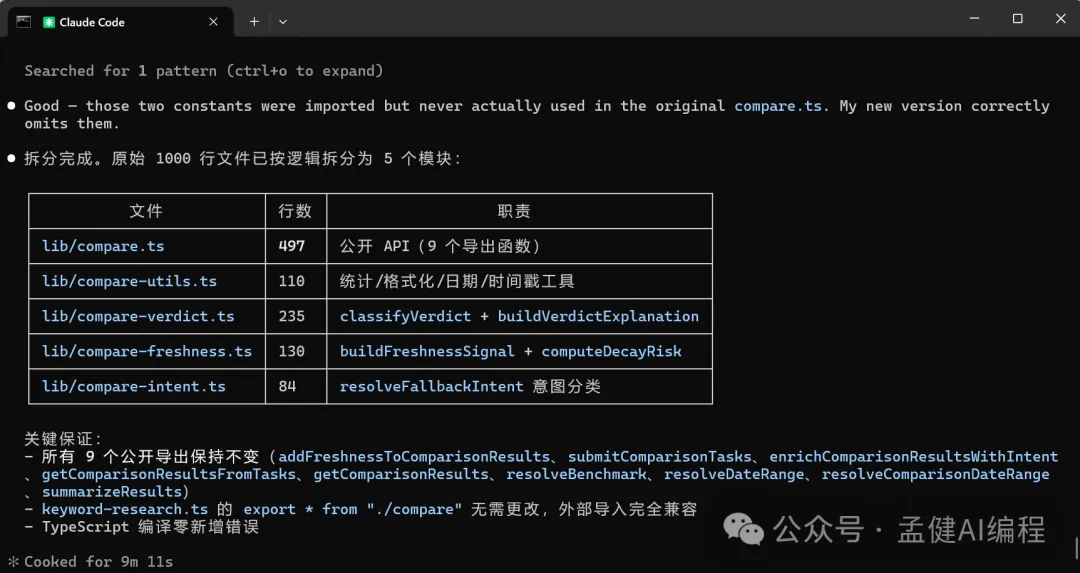

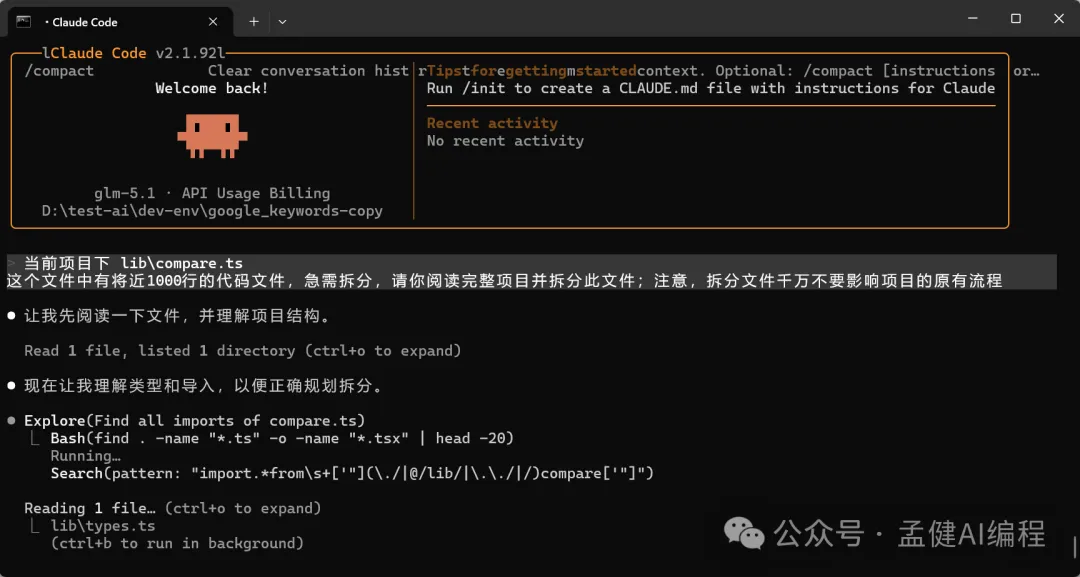

下面這個代碼文件有1000多行,我們來嘗試一下分別讓 GLM-5.1 和 DeepSeek-V4-Pro 來分別拆分一下試試看。

1、DeepSeek-V4-Pro

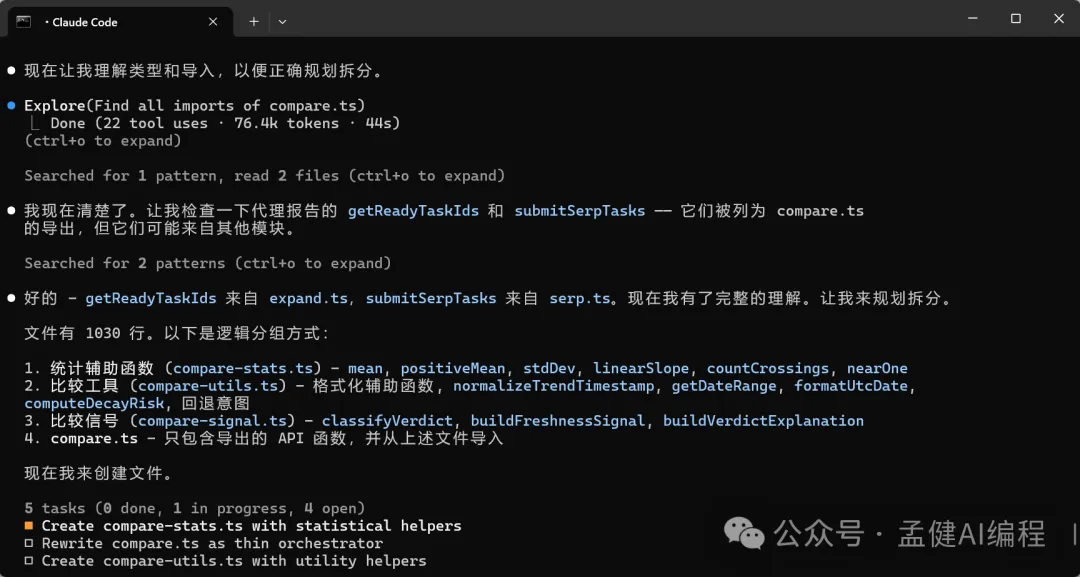

2、GLM-5.1

同樣的項目,同樣的文件,同樣的提示詞,我現在讓 GLM-5.1 拆一下看看。

現在 GLM-5.1 與 DeepSeek-V4-Pro 都已經對這個超過1000行的代碼文件做完了拆分;GLM-5.1 將這個文件拆分為了4個文件,用時大概8分33秒;DeepSeek-V4-Pro 將這個文件拆分為5個文件,用時大概9分11秒。

在速度上,GLM-5.1 稍稍領先,DeepSeek 拆分的更為精細,將 compare 拆分為 通用工具、判斷、新鮮度以及意圖識別4個文件,拆分的更加精細,在代碼文件拆分的精細程度上,似乎 DeepSeek-V4-Pro 略勝一籌。

場景四:項目架構分析

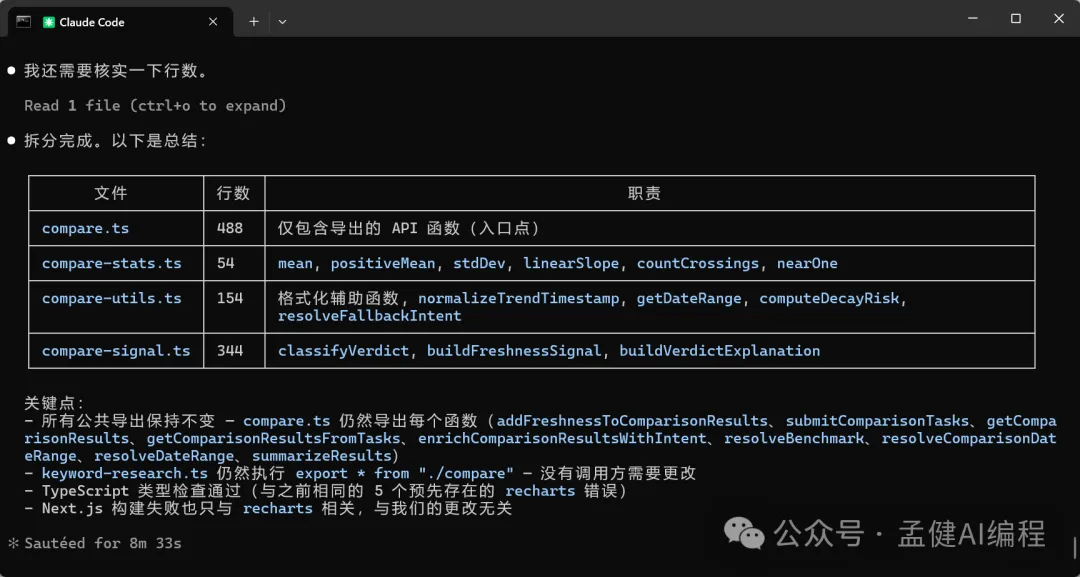

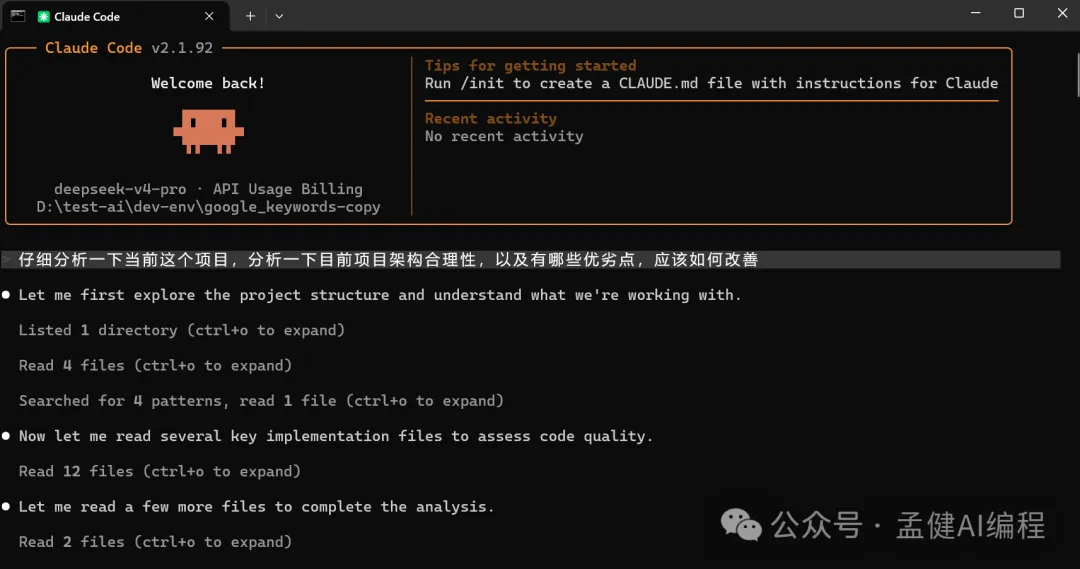

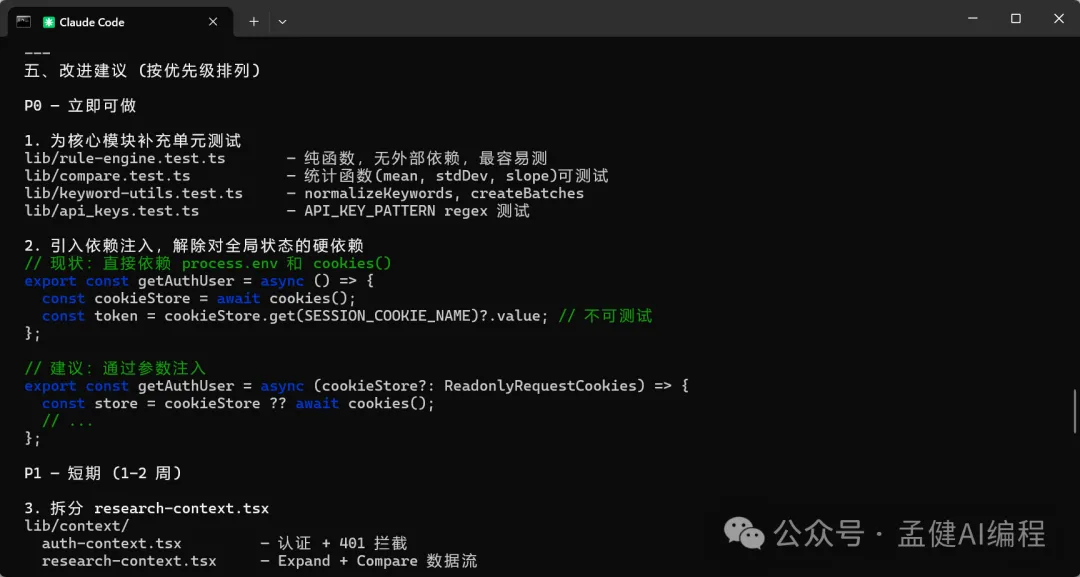

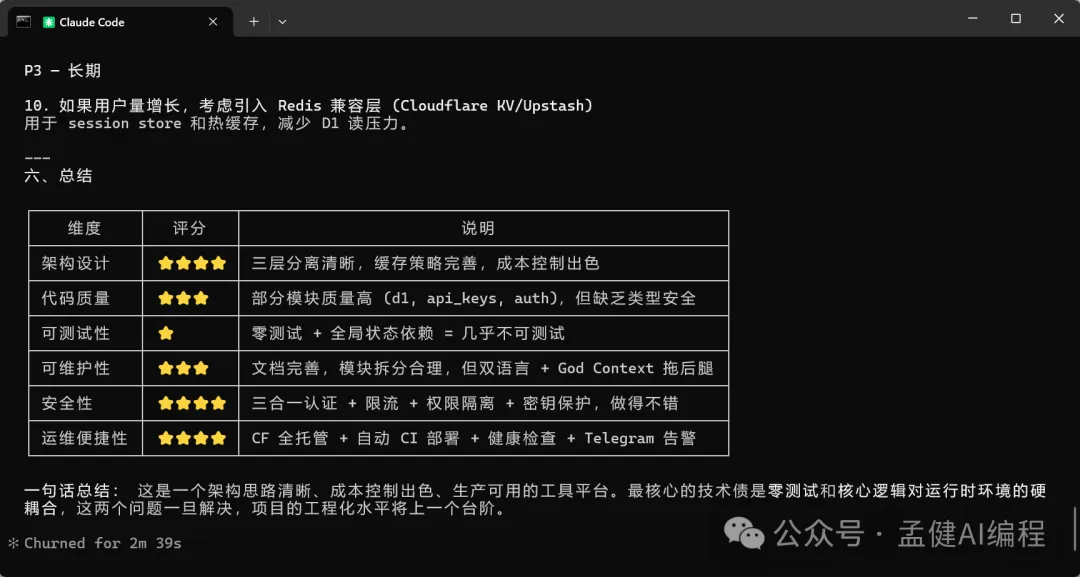

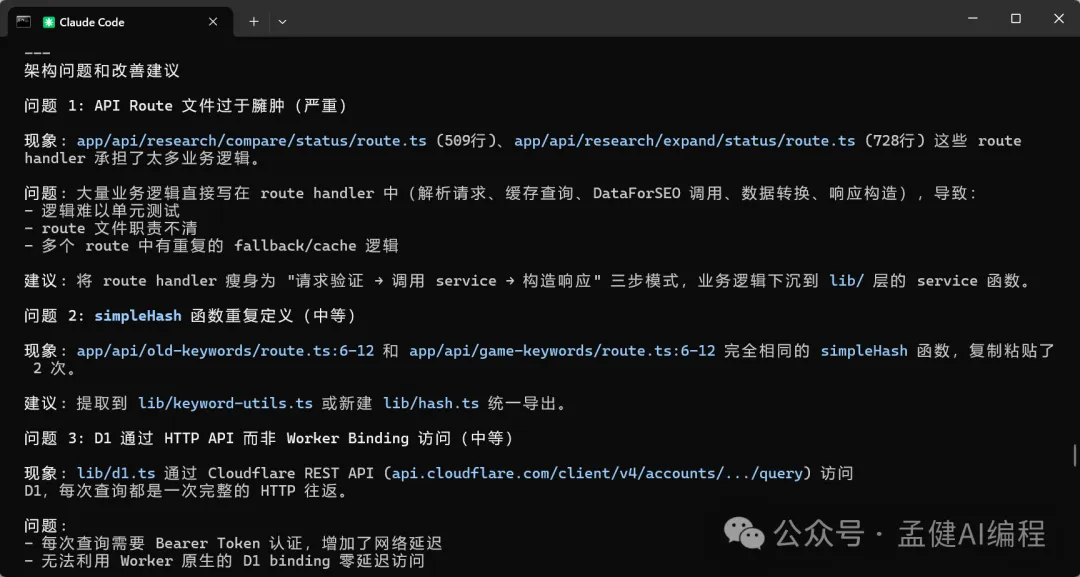

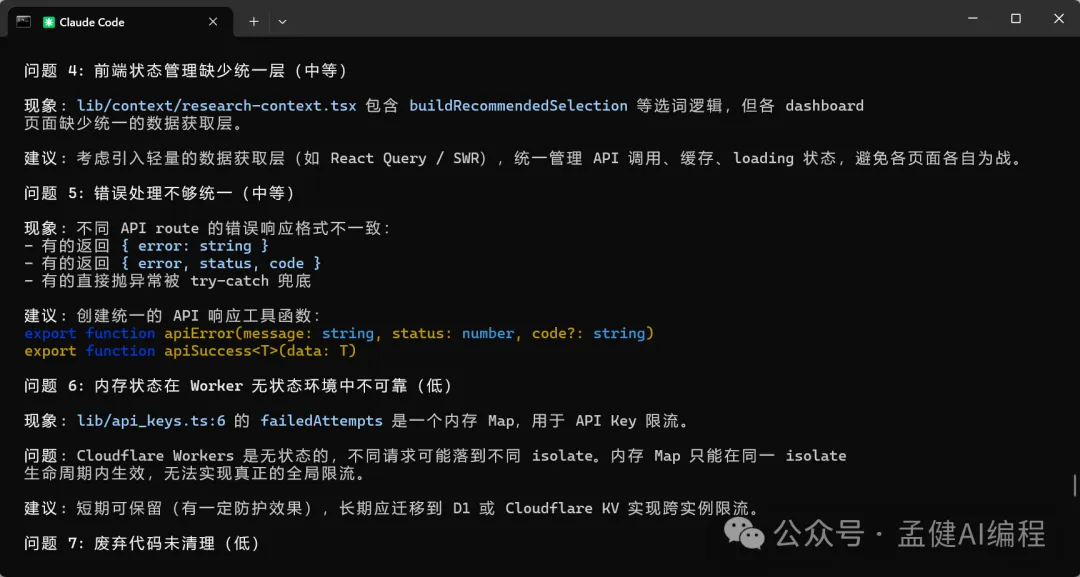

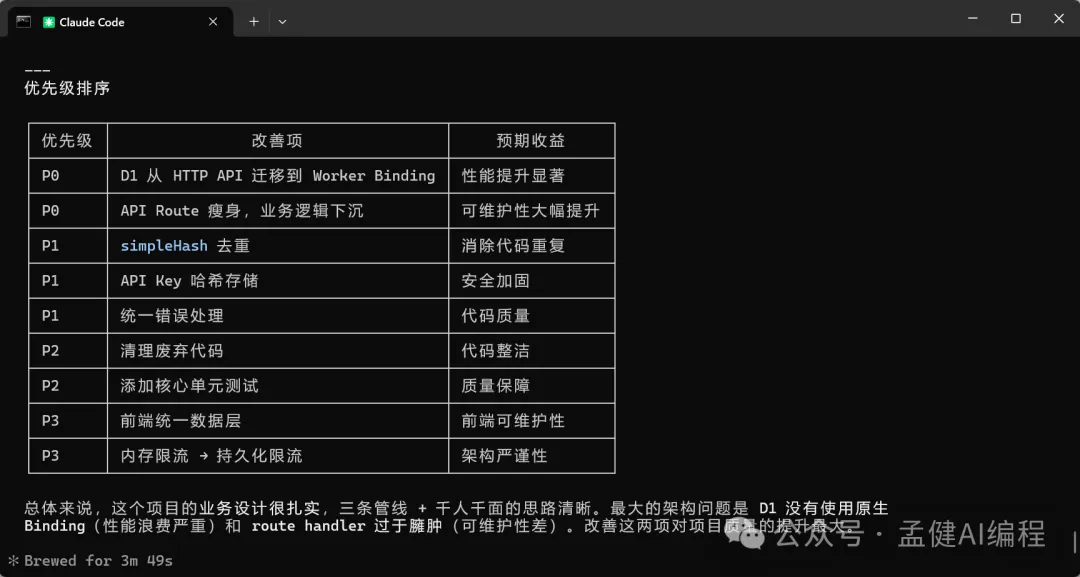

最近剛好做了一個項目,目前已經上線運行了,但是技術債有點嚴重,剛好藉此時機讓兩個國產模型幫我分析項目架構並給出合理的調整建議。

1、DeepSeek-V4-Pro

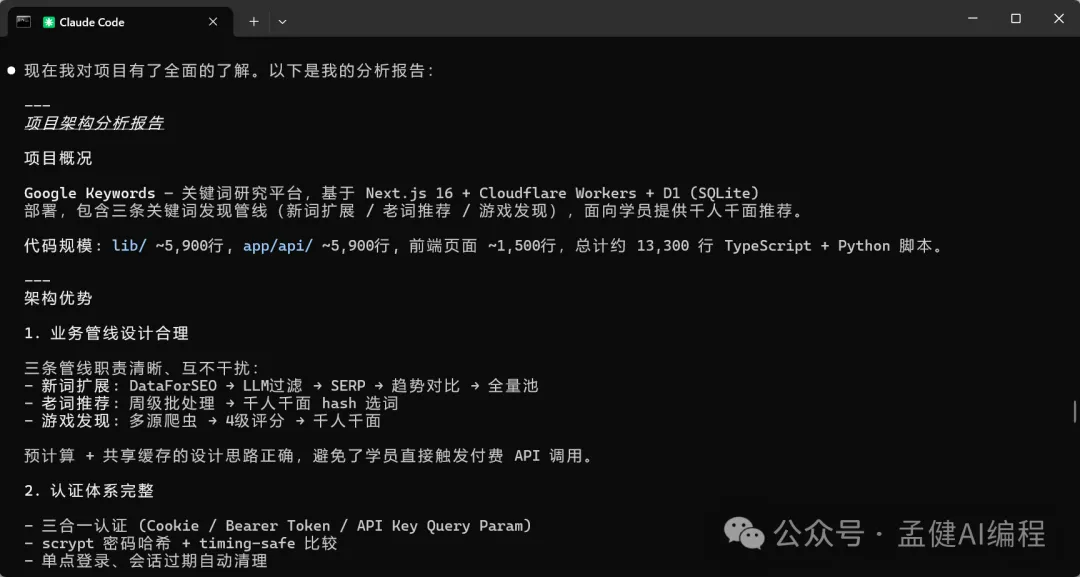

2、GLM-5.1

可以看到,現在 DeepSeek-V4-Pro 以及 GLM-5.1 都對我的項目進行了分析並給出完整的分析報告,通過上面的項目架構分析可以看出,DeepSeek-V4-Pro 給出的架構分析比較全面,特別是最後的總結通過表格給出,還從不同的維度給出了評分,最後的一句話總結把項目的優劣都給說到了。

GLM-5.1 分析的也不錯,當我讓它開始分析項目的時候,它首先徹底全面的探索了我的整個項目目錄,之後才進行分析,對於整體的項目架構分析的比較紮實;最後更是通過優先級排序的方式給出了項目的優化計劃,最後還明確指出了項目沒有使用D1原生綁定功能,給的建議更加實用,因此感覺GLM-5.1對於整體項目的把握度優 DeepSeek-V4-Pro。

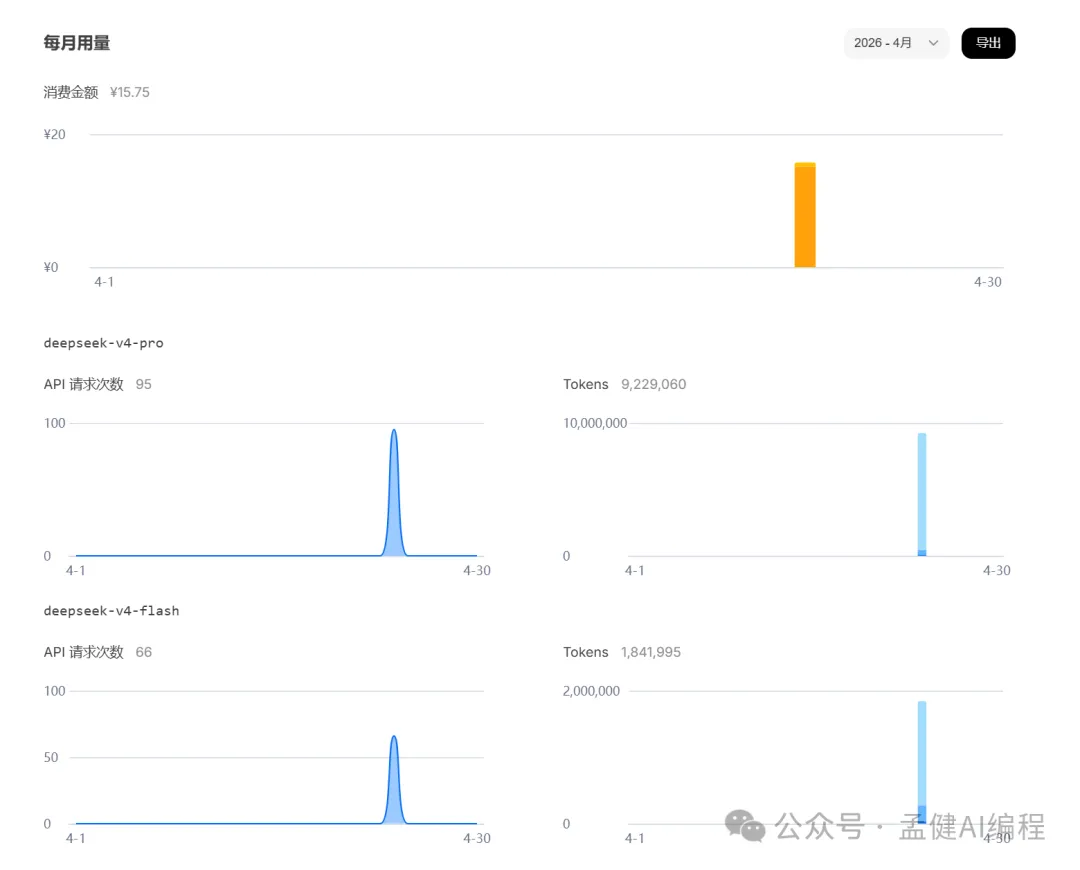

關於使用成本

DeepSeek-V4-Pro 目前沒有 Coding Plan,所以我是通過API直接接入 Claude Code 進行使用的,今天剛剛充值了100元,上面做了這些工作,花費15.75元。

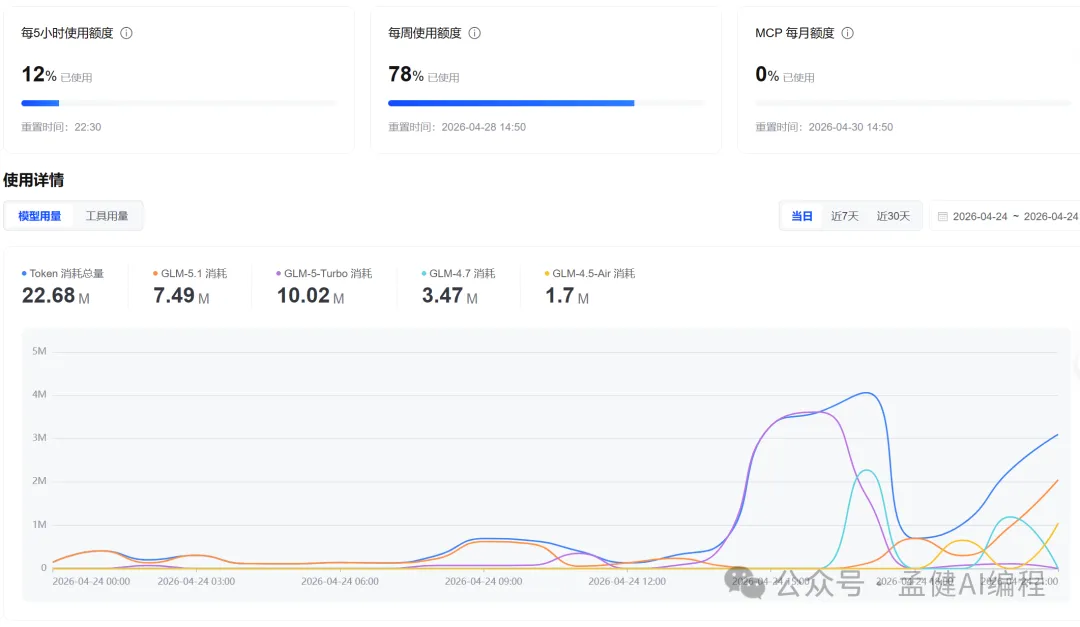

GLM-5.1 因為有 Coding Plan,但是消耗的量也不少;下圖為今日消耗詳情。

維度總結

結論:追上了嗎?

部分追上了,但還沒完全追上。

V4 在基礎編碼能力上的進步是實打實的,代碼結構、命名規範、基本邏輯,這些做得都挺好。拿來寫日常的中小功能,完全夠用。

但在三個地方,V4 跟 GLM-5.1 還有明顯差距:

深度理解:不只是看代碼在做什麼,而是理解為什麼這麼做

邊界意識:對異常、錯誤、極端情況的預判和處理

長上下文管理:大文件、複雜項目中的全局把控能力

所以我的建議不是二選一,而是搭配用:

預算緊,但又需要質量,就讓 DeepSeek V4 扛日常任務,讓 GLM-5.1 處理關鍵任務。

簡單任務給 V4,關鍵任務給 GLM-5.1。

你平時用哪個模型寫代碼?在評論區聊聊你的體驗。

🚀 想要與更多AI愛好者交流,共同成長嗎?

📚 精選文章推薦

我把 Hermes 裏的模型幾乎測了一遍,得出一個很扎心的結論:越貴的,往往越強 hermes101.dev 上線了!5 分鐘裝完、7 天入門、OpenClaw 老用戶無痛遷移 從OpenClaw、Harness工程到世界模型全覆蓋——AI下半場頂級大會終極議程公佈! Hermes 接入 Kimi K2.6 實測:SOTA 代碼能力,但有兩個真實痛點 我把Hermes裏23個Agent全切到GLM-5.1:執行力比GPT強,但有個硬傷 對不起,OpenClaw,我選擇 Hermes! 我用 OpenClaw 做後端開發:從 Stripe 支付到 AI 生成,全程不寫一行代碼 突發:Anthropic 今天起封殺 OpenClaw 用訂閲額度,我的應對方案 一行代碼沒手寫,OpenClaw 前端 Agent 100 分鐘做完一個站 GLM-5.1 來了:開源模型第一次在長程任務上斷檔領先