Karpathy 最新訪談:「思考」可以外包,但「理解」不行

整理版優先睇

Karpathy 話「思考」可以外包,但「理解」唔得 —— AI 編程範式轉變嘅核心啟示

Andrej Karpathy 係前 Tesla 自動駕駛同 OpenAI 創辦人之一,佢最近話自己作為 programmer 從未覺得咁落後。佢喺去年12月休假時發現,最新 AI 模型生成嘅代碼已經唔只係「湊合能用」,而係一段接一段咁生成,佢幾乎唔記得幾時最後一次親手改 code。佢形容呢種感覺係「越來越信任個系統,然後一直氛圍編程」。

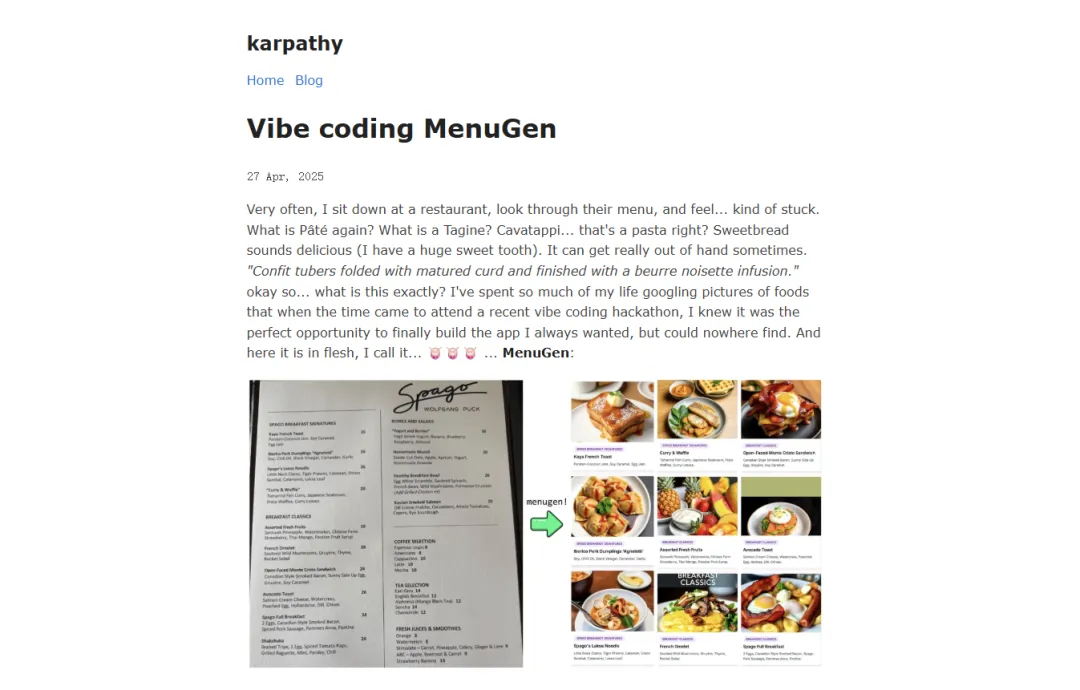

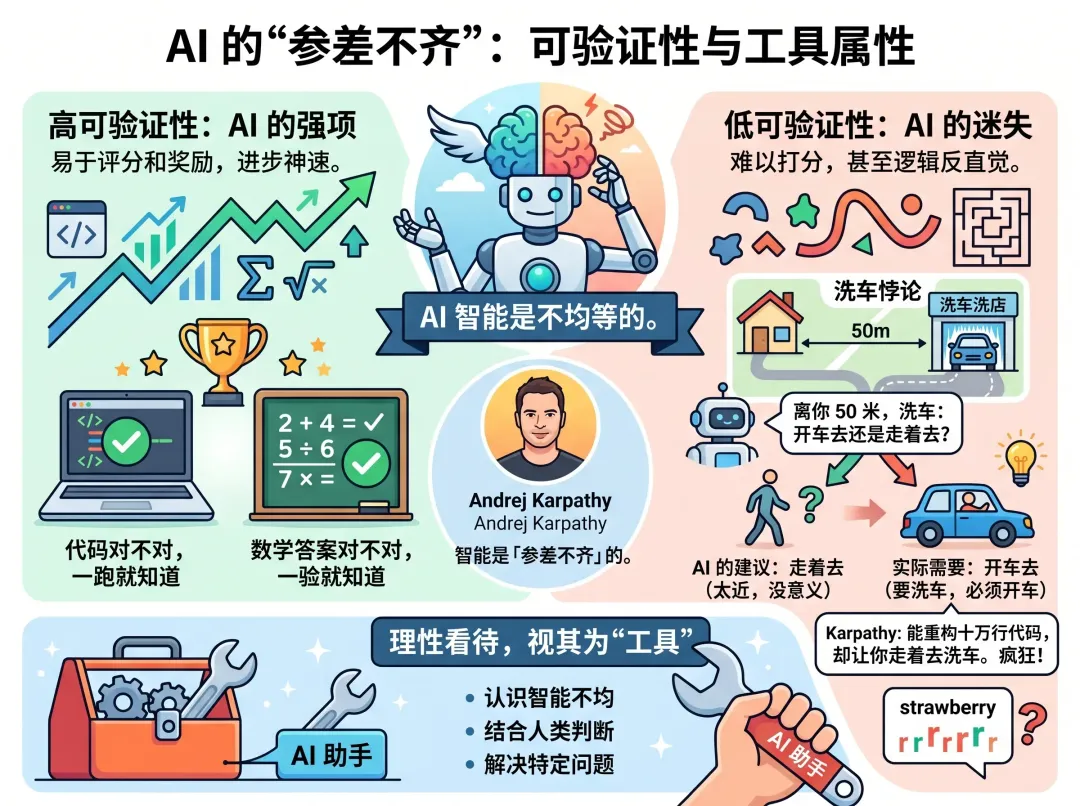

Karpathy 提出一個框架:軟件 1.0(寫 code 規則)、2.0(機器學習)、3.0(寫 prompt,上下文窗口係槓桿)。佢用 MenuGen 例子說明轉變:自己整咗個 app 識別菜單菜名配圖,但另一個人直接將相片扔俾 Gemini,一句指令就做到,成個 app 根本唔應該存在。呢啲例子顯示新範式令以前唔可能嘅事變成可能。佢仲講到「可驗證性」——AI 喺編程、數學呢啲可以快速驗證嘅領域進步好快,但問佢「strawberry 有幾個 r」或者洗車例子(50米路叫你行過去)就會犯低級錯誤。所以智能係參差不齊,要當工具唔係神。

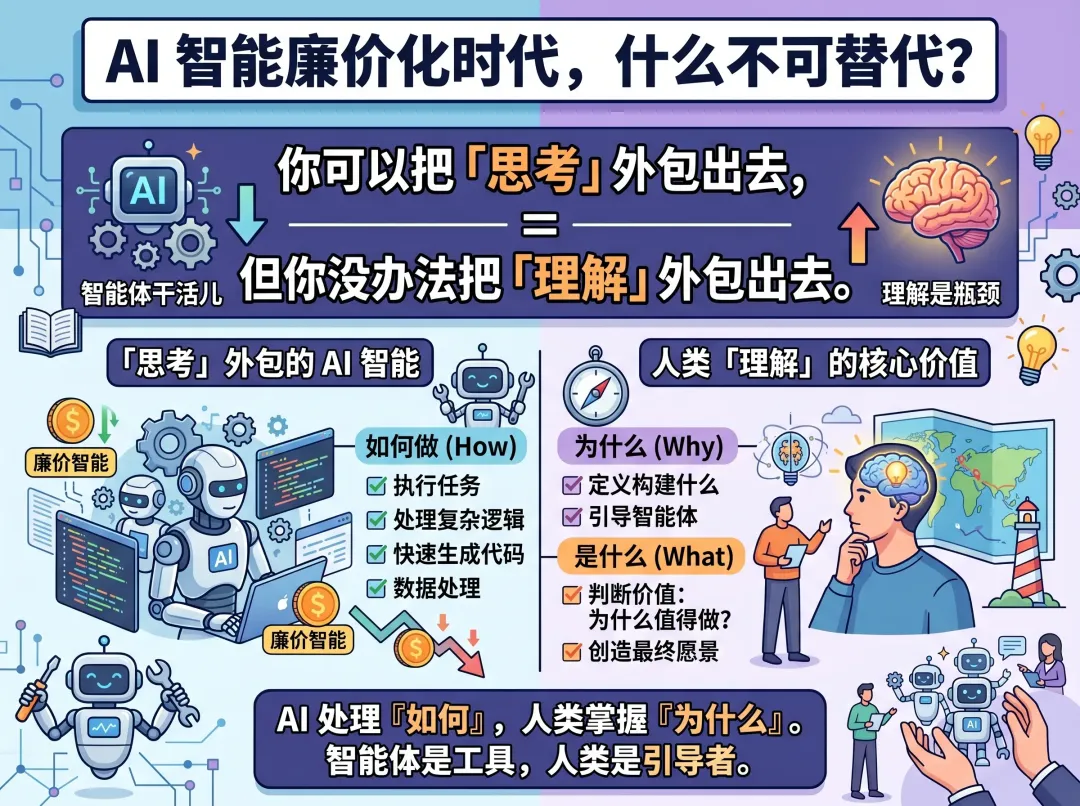

對於創業者,應該揾「可驗證」但未被大實驗室關注嘅領域。Vibe Coding 同智能體工程嘅分別:前者拉高下限,後者保持專業。人類嘅價值在於品味、判斷力、設計同寫規範。智能體好似實習生,需要清晰指引。最後,理解係核心瓶頸——思考可以外包,但理解唔得。Karpathy 建議建立自己嘅知識庫幫助消化。

- Karpathy 提出軟件範式從 1.0(寫 code)到 2.0(機器學習)再到 3.0(寫 prompt),3.0 嘅核心係善用「上下文窗口」控制 AI 輸出。

- AI 喺「可驗證性」高嘅領域(如編程)表現極佳,但喺常識推理(如洗車要開車去)卻好差,反映智能參差不齊。

- Vibe Coding 令普通人可以寫到 code,但智能體工程要求保持代碼質量,避免安全同結構問題。

- 人類喺 AI 時代嘅不可取代能力係品味、判斷力、設計能力同寫規範,智能體需要清晰頂層設計。

- 「理解」係最終瓶頸,AI 可以幫手思考同整理資料,但真正嘅理解一定要自己消化,建立個人知識庫。

Karpathy 點解話自己落後?

Andrej Karpathy 曾經親手搭建 Tesla 自動駕駛、參與創立 OpenAI,係業界公認嘅高手。但佢公開話自己作為 programmer 從未覺得咁落後,因為 AI 嘅進化速度實在太快。

時間節點係去年12月,佢放假時有大把時間搞業餘項目。佢發現最新模型生成嘅代碼唔只「湊合能用」,而係一段接一段,佢幾乎冇再親手改 code。佢話呢種感覺係「越來越信任個系統,然後一直 氛圍編程」。

軟件範式嘅三次跳躍

Karpathy 提出一個框架:軟件 1.0 係自己寫 code 規則;軟件 2.0 係機器學習時代,你整理數據、訓練模型;軟件 3.0 係寫 prompt,上下文窗口就係控制 AI 呢台解釋器嘅唯一槓桿。

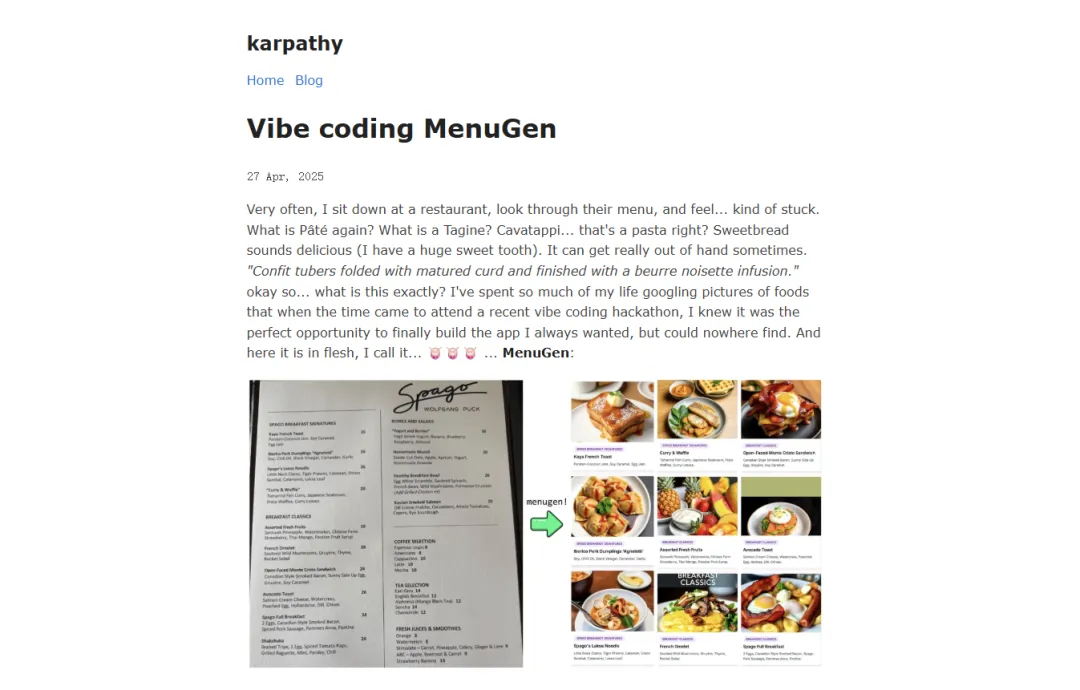

佢用 MenuGen 例子說明轉變:佢自己整咗個 app 影菜單相、OCR 識別菜名、調圖像生成器、部署上 Vercel,整套流程跑通。但另一個人直接影相扔俾 Gemini,話「將菜品圖疊加到菜單上」,Gemini 就返咗張渲染圖。Karpathy 話「震驚」,因為佢整嗰套系統根本唔應該存在——新範式下 神經網絡接管咗幾乎所有嘢,中間應用層係多餘嘅。

AI 嘅智能點解參差不齊?

你有冇發現 AI 寫 code、做數學好勁,但問佢「strawberry 有幾個 r」或者「洗車店離你50米,應該點去」呢啲常識問題就會亂講?Karpathy 解釋背後係 可驗證性法則:AI 實驗室訓練模型時,喺容易打分嘅領域(code 啱唔啱一跑就知)進步特別快,而打分難嘅領域就磕磕絆絆。

佢用洗車例子:最先進模型會話「行過去」,因為太近開車冇意義。但 你要洗車就要開車去。模型可以重構十萬行 code 庫、發現零日漏洞,但呢個低級錯誤反映智能係 參差不齊嘅。你必須當佢係工具,唔係全知全能嘅神。

- 對於創業者,應該揾「可驗證」但 未被大實驗室關注嘅領域,因為你可以自己搭建強化學習環境微調模型。

- 大實驗室唔會 cover 所有地方,有明確驗證標準嘅場景就係機會。Karpathy 話有具體例子但唔公開,留咗懸念。

智能體時代,人仲要做乜?

主持人問 Vibe Coding 同 智能體工程 嘅分別。Karpathy 話 Vibe Coding 拉高普通人下限,但唔講究質量標準;智能體工程係保持專業水準下跑得更快,唔可以因為用 AI 就引入安全漏洞、寫一蹋糊塗嘅 code。你仍然要對 code 嘅質量負責。

人類仲要保留嘅係 品味、判斷力、設計能力,同埋 寫規範嘅能力。智能體而家好似個實習生,記憶力好但會犯奇怪錯誤。佢舉 MenuGen 例子:用戶用 Google 賬號註冊,用 Stripe 付款,兩個郵箱可能唔同,智能體嘗試用郵箱匹配付款記錄,結果關聯唔到。有經驗嘅工程師一眼就見到問題,但智能體繼續錯。

Karpathy 話見到智能體寫嘅 code 有時心臟病發作——又臃腫又複製粘貼,抽象方式奇怪,能跑但難睇。佢希望未來模型會改善,但目前呢啲仲未納入 強化學習獎勵體系,所以改進會好慢。

「理解」先係最終瓶頸

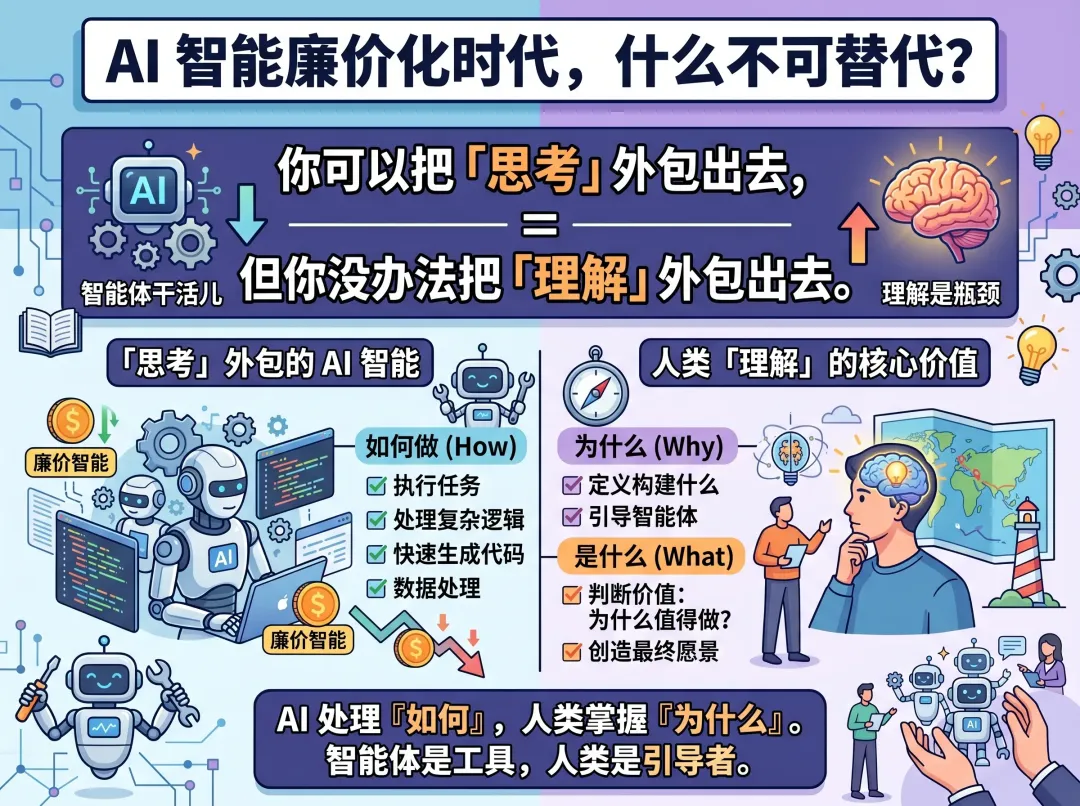

主持人問當 AI 智能變得廉價時,仲有乜值得學?Karpathy 話佢成日諗起一條推文:「你可以將 思考 外包出去,但冇辦法將 理解 外包出去。」理解而家仍然係系統嘅瓶頸。

佢解釋:智能體可以幫手幹活,但你必須知道點解件事值得做、最終要構建乜、點樣引導呢啲智能體。呢啲答案必須進入自己個腦,冇得畀 AI 代勞。佢而家習慣讀文章做項目時順手用 AI 幫手整理成個人知識庫 Wiki,從唔同角度投射信息,幫自己真正消化。

你一定諗唔到,一個曾經親手整特斯拉自動駕駛、參與創立 OpenAI 嘅人,有一日會公開話「我作為程序員,從來未試過覺得自己咁落後」。

講呢句話嘅人就係 Andrej Karpathy。

舊年佢整咗個「氛圍編程」呢個詞,結果冇耐,佢自己先俾 AI 嘅進化速度打懵咗。

話說佢意識到唔對路嘅時間點,係舊年12月。

嗰陣時佢喺放假,有大把時間搞自己嘅業餘項目。佢開始發現,最新嘅模型生成嘅代碼唔只係「勉強用到」咁簡單,而係一段接一段自動生成,佢幾乎唔記得上一次自己親手改代碼係幾時。

佢形容嗰種感覺,就係「越嚟越信任呢個系統,然後一路氛圍編程」。

由嗰陣開始,佢嘅業餘項目文件夾就再冇空過。

咁佢講嘅呢啲對普通人又意味住啲乜呢?我哋繼續睇落去~

呢次訪談入面,Karpathy 拎咗一套佢一直諗緊嘅框架,簡稱做軟件 1.0、2.0、3.0。

◆ 1.0 係你自己寫代碼、寫規則;

◆ 2.0 係機器學習嗰個時代,你唔直接寫規則㗎喇,改為你整理數據、訓練模型;

◆ 去到 3.0,事情又變咗,你嘅編程方式變咗做寫提示詞,「上下文窗口」就係你控制 AI 呢部解釋器嘅唯一槓桿。

佢用一個好具體嘅例子嚟說明呢個轉變。

佢之前做咗一個叫 MenuGen 嘅小應用,思路好簡單:影一張餐廳菜單嘅相,因為唔識嘅菜名太多喇,所以佢希望 AI 可以幫佢將菜名辨識出嚟,再俾每道菜配返張圖,咁你就知上枱嘅大概係乜嘢嚟㗎喇。

呢個應用佢用 Vibe Coding 嘅方式一路做出嚟,OCR 辨識菜名、調圖像生成器、喺 Vercel 上完成部署,整套流程 run 通咗,佢自己都幾滿意。

之後,佢見到另一個嘅做法。嗰個人就係:影張相,掟俾 Gemini,話「將菜式圖疊加到菜單上面」,Gemini 直接回咗一張圖,就係喺原來嘅菜單相上面,每道菜旁邊都多咗一張佢嘅渲染圖。

Karpathy 自己當時嘅感受係「震驚」。

佢意識到,佢之前寫嘅嗰成個 MenuGen 系統其實根本唔應該存在。嗰個應用係喺舊思維模式之下解決問題,而新嘅範式之下,神經網絡接管咗幾乎所有嘢,中間嗰個應用層係多餘嘅。

佢話,呢個唔只係令「以前嘅嘢做得快咗」,而係令「以前根本冇可能存在嘅嘢,而家變成可能喇」。呢個先係最值得興奮嘅部分。

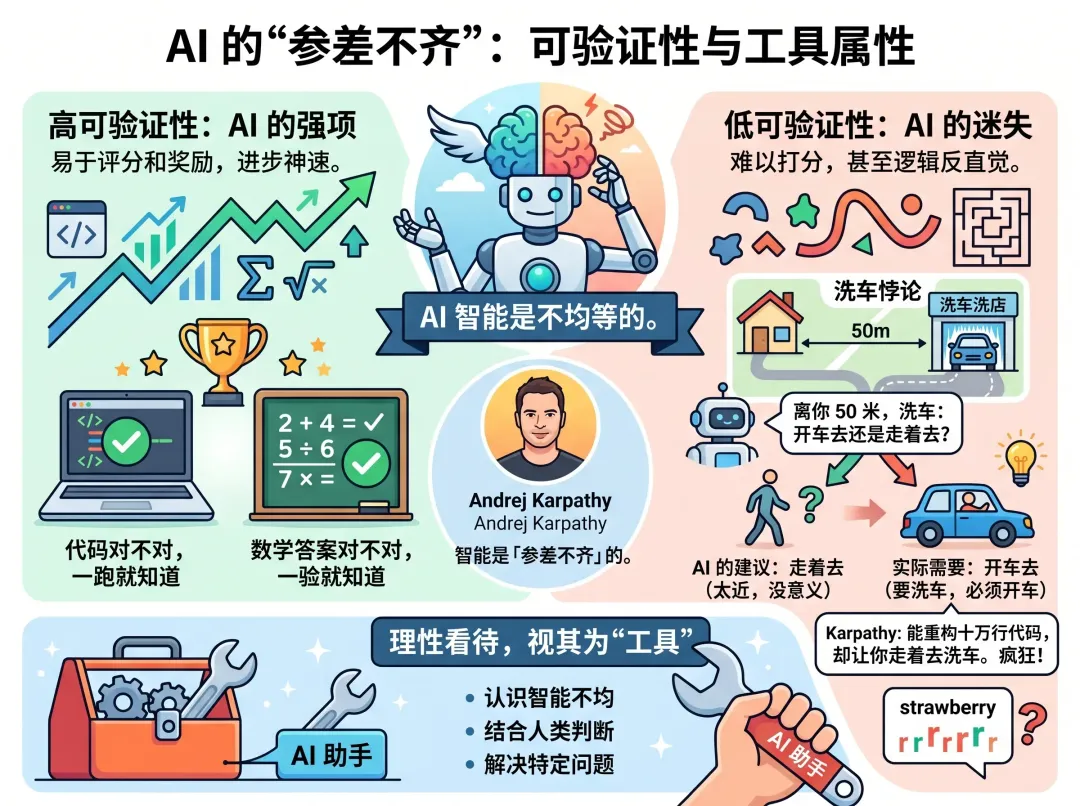

然後佢又講到一個我覺得好得意嘅概念,叫「可驗證性」。

你有冇覺得奇怪,AI 喺寫代碼、做數學題呢啲地方簡直勁到離曬譜,但你隨口問佢「strawberry 呢個詞入面有幾個字母 r」嘅時候,佢竟然開始亂噏廿四...

Karpathy 話,呢個背後有一個邏輯:AI 實驗室喺訓練模型嘅時候,要俾模型打分數、俾獎勵,呢個分數打起身越容易嘅領域,AI 進步越快。代碼啱唔啱,一 run 就知;數學答案啱唔啱,一驗就知。所以 AI 喺呢啲「可驗證」嘅領域突飛猛進,但喺嗰啲打分好難嘅領域就顯得跌跌撞撞。

佢舉咗個新例子。

比上面嗰個 strawberry 更加能夠說明問題:例如而家有間洗車舖離你 50 米,你問 AI 係應該揸車去定係行路去。最新進嘅模型會話你知行路去,因為佢太近喇,揸車冇意思。咁睇邏輯上冇問題,係咪?但問題係,你要去洗車,只有揸車先去到先洗到。

Karpathy 話,模型同時可以重構十萬行代碼庫、又可以發現軟件零日漏洞,但係竟然話你知行路去洗車,呢個簡直太癲喇。

所以佢想講嘅意思係,呢啲模型嘅智能係「參差不齊」的。

某啲方面極之耀眼,某啲地方卻低得離曬譜。你用嘅時候一定要帶住呢個認知,將佢當做「工具」嚟對待,而唔係當做「全知全能」嘅神。

講到呢度嘅時候,佢又拉返去一個好實際嘅問題度:咁對於而家嘅普通人、或者創業者嚟講應該點做呢?

佢嘅觀點係,你要去揾嗰啲「可驗證」但係仲未俾大實驗室重點關注嘅領域。

因為可驗證就意味住你可以自己搭建強化學習環境,自己微調模型,呢個係一個你可以真正利用嘅槓桿。

大實驗室冇可能兼顧到所有地方,而嗰啲佢哋仲未覆蓋到、但又有明確驗證標準嘅場景,就係機會所在。

佢話佢個腦入面其實係有啲具體例子嘅,但係唔想喺台上透露答案,當係俾大家留返個懸念。

然後主持人繼續問佢,咁你覺得「氛圍編程」同「智能體工程」有咩分別呢?

佢嘅回答我覺得係值得單獨記錄低嘅。

氛圍編程,係將普通人嘅下限拉高

以前唔識編程嘅人,而家都可以憑感覺俾 AI 寫出行到嘅代碼,呢件係好叻嘅事,但佢唔係好講究質量標準。

而智能體工程,係喺保持專業水準嘅前提下跑得更快

你唔可以因為用咗 AI 就引入好多安全漏洞、將代碼寫到一塌糊塗,你仍然要對代碼嘅質量負責,只不過你嘅執行速度可以比以前快好多倍。佢話,而家再用「10 倍工程師」呢個講法已經唔夠用喇,真正擅長智能體工程嘅人,上限要比嗰個高得多。

咁喺呢種模式之下,人仲要做啲乜呢?

Karpathy 嘅答案係:品味、判斷力、設計能力,以及寫規範嘅能力。

佢話呢啲智能體而家就好似個實習生,記憶力好好,API 細節都記得一清二楚,但會犯好奇怪嘅錯誤。

佢都係舉咗自己嗰個 MenuGen 嘅例子。

用戶用 Google 賬號註冊,用 Stripe 賬號俾錢,呢兩個賬號嘅電郵地址可能係唔同嘅,但佢嘅智能體喺關聯用戶同付款記錄嘅時候,試圖用電郵地址去做匹配。結果用戶換咗個電郵俾錢,錢就關聯唔到喇。

呢種錯誤,如果換成一個有經驗嘅工程師一眼就睇得出唔對路,但智能體就係睇唔到,會繼續向嗰個錯誤嘅方向行。

所以你要做嘅係,喺智能體開始做嘢之前,將規範寫到好清楚,將頂層設計諗明白。

API 細節、函數寫法、keepdim 定 keepdims 呢啲問題,交俾智能體就得,佢記得比你清楚。但呢個系統從架構上點解要有唯一嘅用戶 ID 嚟綁定所有關係,呢種判斷一定要你嚟做。

智能體目前仲未具備呢種「品味」。

佢都好坦率咁講,代碼質量呢件事而家確實仲係一個問題。

佢話有時見到智能體寫出嚟嘅代碼,差啲心臟病發。又臃腫、又係一堆複製貼上、抽象方式都好奇怪,行到但好難睇。

佢希望將來嘅模型可以喺呢方面有進步。但佢都明確講咗,而家仲未俾納入強化學習嘅獎勵體系入面,所以改善會好慢。

喺呢場訪談嘅最後,有一句說話我覺得係成個對話入面最值得記低嘅。

主持人問佢,當 AI 智能變得越嚟越平嘅時候,仲有啲乜嘢值得人們好好去學嘅嗎?

佢話佢最近見到一條 tweet,幾乎隔一日就會諗起一次,大意係咁嘅:

你可以將「思考」外判出去,但你冇辦法將「理解」外判出去。

佢解釋話,理解而家仲係成個系統入面嘅一個瓶頸。

智能體可以幫佢做嘢,但佢一定要知道呢件事點解值得做、最終要構建啲乜、點樣去引導呢啲智能體。

呢啲問題嘅答案,一定要真正進入佢自己個腦,冇辦法俾 AI 代佢理解。

佢仲講到佢而家嘅一個習慣,就係睇咩文章、做咩項目,都順手用 AI 幫佢將資訊梳理成自己嘅知識庫 Wiki,不斷從唔同角度投射同一批資訊,幫自己真正消化。

所以佢嘅結論係,理解本身仍然係最核心嘅瓶頸,而好嘅工具應該係幫你加深理解,而唔係幫你繞開理解。

最後,祝大家五一節快樂,食好、玩好、學好!

既然睇到呢度,如果覺得都唔錯,幫忙隨手點個「讚」、「在看」、「轉發」三連;如果想第一時間收到推送,亦都可以幫我加個星標★,多謝曬!

你肯定想不到,一個曾經親手搭建特斯拉自動駕駛、參與創立 OpenAI 的人,有一天會公開說「我作為程序員,從來沒感覺自己這麼落後過」。

說出這話的人就是 Andrej Karpathy。

去年他造出了「氛圍編程」這個詞,結果沒過多久,他自己先被 AI 的進化速度打懵了。

說讓他意識到不對勁的時間節點,是去年12月。

那時候他在休假,有大把時間折騰自己的業餘項目。他開始發現,最新的模型生成的代碼不只是「湊合能用」了,而是一段接一段地生成,他幾乎忘了上一次親手改代碼是什麼時候。

他描述那種感覺,就是「越來越信任這個系統,然後一直氛圍編程」。

從那之後,他的業餘項目文件夾就再也沒空過。

那他說的這些對普通人又意味着什麼呢?我們繼續往下看~

這次訪談裏,Karpathy 拿出了一套他一直在思考的框架,簡稱為軟件 1.0、2.0、3.0。

◆ 1.0 是你自己寫代碼、寫規則;

◆ 2.0 是機器學習那個時代,你不直接寫規則了,改成你整理數據、訓練模型;

◆ 到了 3.0,事情又變了,你的編程方式變成了寫提示詞,「上下文窗口」就是你控制 AI 這台解釋器的唯一槓杆。

他用一個很具體的例子來說明這個轉變。

他之前做了一個叫做 MenuGen 的小應用,思路特別簡單:拍一張餐廳菜單的照片,因為不認識的菜名太多了,所以他希望 AI 能幫他把菜名識別出來,再給每道菜配上圖,這樣你就知道端上來的大概是什麼玩意兒了。

這個應用他用 Vibe Coding 的方式一路做出來,OCR 識別菜名、調圖像生成器、在 Vercel 上完成部署,整套流程跑通了,他自己挺滿意的。

之後,他看到了另一個人的做法。那個人就是:拍張照,扔給 Gemini,說"把菜品圖疊加到菜單上",Gemini 直接返回了一張圖,就是在原來的菜單照片上,每道菜旁邊都多了一張它的渲染圖。

Karpathy 自己當時的感受是「震驚」。

他意識到,他之前寫的那整套 MenuGen 系統其實根本不應該存在。那個應用是在舊思維模式下解決問題,而新的範式下,神經網絡接管了幾乎所有活兒,中間那個應用層是多餘的。

他說,這不只是讓「以前的事情做得更快了」,而是讓「以前根本不可能存在的東西,現在變成可能了」。這才是最值得興奮的部分。

然後他又聊到了一個我覺得特別有意思的概念,叫「可驗證性」。

你有沒有覺得奇怪,AI 在寫代碼、做數學題這些地方簡直強到離譜,但你隨手問它"strawberry 這個詞裏有幾個字母 r"時,它確開始胡說八道了...

Karpathy 說,這背後有一個邏輯:AI 實驗室在訓練模型的時候,要給模型打分、給獎勵,這個分打起來越容易的領域,AI 進步越快。代碼對不對,一跑就知道;數學答案對不對,一驗就知道。所以 AI 在這些「可驗證」的領域突飛猛進,但在那些打分很難的領域卻顯得磕磕絆絆。

他舉了個新例子。

比上面那個 strawberry 更能說明問題:比如現在有家洗車店離你 50 米,你問 AI 是該開車去還是走着去。最先進的模型會告訴你走着去,因為它太近了,開車沒意義。這麼看邏輯上沒有毛病,對吧?但問題是,你要去洗車,只有開車去才能洗上。

Karpathy 說,模型同時能重構十萬行代碼庫、也能發現軟件零日漏洞,卻告訴你走着去洗車,這簡直太瘋狂了。

所以他想說的意思是,這些模型的智能是「參差不齊」的。

某些方面極其耀眼,某些地方卻低得離譜。你用的時候必須要帶着這個認知,把它當「工具」對待,而不是當成「全知全能」的神。

聊到這裏的時候,他又拉回到一個很實際問題上:那對於現在的普通人、或者創業者來講該怎麼辦呢?

他的觀點是,你要去找那些「可驗證」但還沒被大實驗室重點關注的領域。

因為可驗證就意味着你可以自己搭建強化學習環境,自己微調模型,這是一個你可以真正利用的槓桿。

大實驗室不可能顧到所有地方,而那些他們還沒覆蓋到、但又有明確驗證標準的場景,就是機會所在。

他說他腦子裏其實是有一些具體例子的,但不想在台上透露答案,算是給大家留了個懸念。

然後主持人繼續問他,那你覺得「氛圍編程」和「智能體工程」有什麼區別呢?

他的回答我覺得是值得單獨記錄一下的。

氛圍編程,是把普通人的下限拉高

以前不會編程的人,現在也能憑感覺讓 AI 寫出能跑的代碼,這是一件很了不起的事兒,但它不太講究質量標準。

而智能體工程,是在保持專業水準的前提下跑得更快

你不能因為用了 AI 就引入很多安全漏洞、把代碼寫得一塌糊塗,你仍然要對代碼的質量負責,只不過你的執行速度可以比以前快上很多倍。他說,現在再用「10 倍工程師」這個說法已經不夠用了,真正擅長智能體工程的人,上限要比那高得多。

那在這種模式下,人還要幹什麼呢?

Karpathy 的答案是:品味、判斷力、設計能力,以及寫規範的能力。

他說這些智能體現在就像個實習生,記憶力極好,API 細節也都能記得一清二楚,但會犯很奇怪的錯誤。

他還是舉了自己那個 MenuGen 的例子。

用戶用 Google 賬號註冊,用 Stripe 賬號付款,這兩個賬號的郵箱可能是不一樣的,但他的智能體在關聯用戶和付款記錄的時候,試圖用郵箱地址去做匹配。結果用戶換了個郵箱付款,錢就關聯不上了。

這種錯誤,如果換成一個有經驗的工程師一眼就能看出來不對勁,但智能體就是看不到,會繼續往那個錯誤的方向走。

所以你要做的是,在智能體開始幹活之前,把規範寫得非常清楚,把頂層設計想明白。

API 細節、函數寫法、keepdim 還是 keepdims 這種問題,交給智能體就好,它記得比你清楚。但這個系統從架構上為什麼要有唯一的用戶 ID 來綁定所有關係,這種判斷必須你來做。

智能體目前還不具備這種「品味」。

他也坦率地講,代碼質量這件事兒現在確實還是個問題。

他說有時候看到智能體寫出來的代碼,差點心臟病發作。又臃腫、又是一堆複製粘貼、抽象方式也很奇怪,能跑但很難看。

他希望未來的模型能在這方面有所進步。但他也明確說了,目前還沒有被納入強化學習的獎勵體系內,所以改進會很慢。

在這場訪談的最後,有一句話我覺得是整個對話中最值得記下來的。

主持人問他,當 AI 智能變得越來越廉價時,還有什麼值得人們好好去學的東西嗎?

他說他最近看到一條推文,幾乎每隔一天就會想起一次,大意是這樣的:

你可以把「思考」外包出去,但你沒辦法把「理解」外包出去。

他解釋說,理解現在仍然是整個系統裏的一個瓶頸。

智能體能幫他幹活兒,但他必須知道這件事兒為什麼值得做、最終要構建什麼、怎麼去引導這些智能體。

這些問題的答案,必須真正進入他自己的大腦,沒有辦法讓 AI 替他理解。

他還聊到他現在的一個習慣,就是讀什麼文章、做什麼項目,都順手用 AI 幫他把信息梳理成自己的知識庫 Wiki,不斷從不同角度投射同一批信息,幫助自己真正消化。

所以他的結論是,理解本身仍然是最核心的瓶頸,而好的工具應該是幫你加深理解,而不是幫你繞開理解。

最後,祝大家五一節快樂,吃好、玩好、學好!

既然看到這兒了,如果覺得還不錯,幫忙隨手點個「贊」、「在看」、「轉發」三連;如果想第一時間收到推送,也可給我加個星標★,非常感謝!