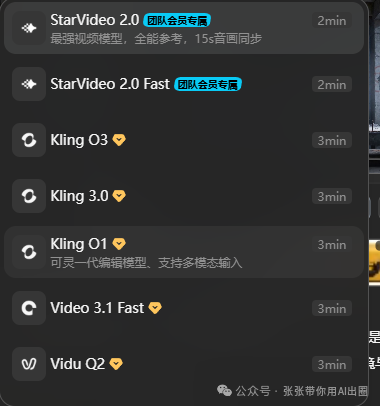

LibTV發佈新模型Star Video 2.0,我的漫劇工作流,被壓縮到了3小時

整理版優先睇

LibTV Star Video 2.0 將漫劇創作壓縮到3小時,多鏡頭音畫一鍵生成

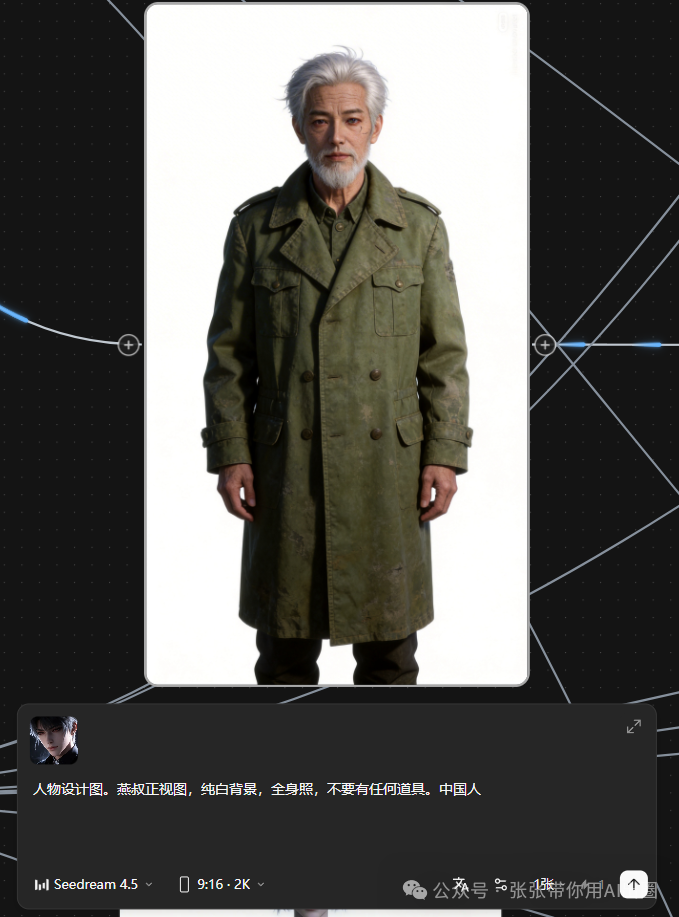

作者張張係一個AIGC內容教練,平時成日做AI漫劇,之前嘅工作流好繁瑣:要逐個鏡頭生成圖片、轉視頻、補幀、高清化,再導入剪輯軟件加音效字幕,搞一個短劇隨時要成日。佢發現LibTV新出嘅Star Video 2.0模型可以大幅簡化呢個流程——只要喺畫布度輸入描述,等幾分鐘就收到一條完整嘅多鏡頭短劇,連背景音效同對話都自動生成。

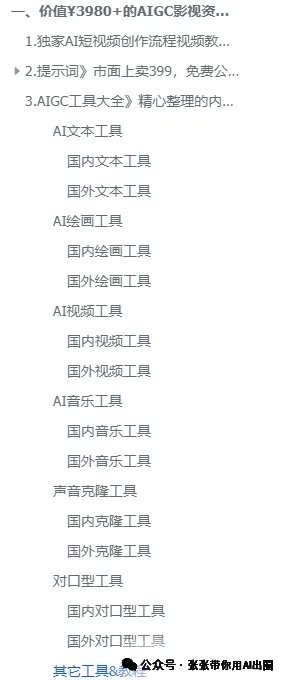

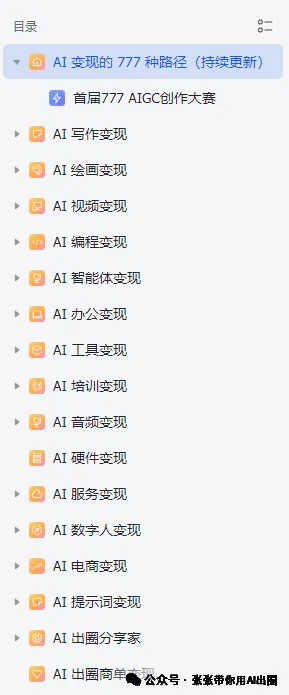

呢篇文章主要分享Star Video 2.0嘅三大特點:多鏡頭視頻生成、音畫一體、多模態參考,同埋用佢做漫劇嘅實戰步驟。作者親測由傳統嘅1小時抽卡變成幾分鐘搞掂,仲展示咗一個2分鐘漫劇嘅完整創作過程,總共唔使3個鐘。結論係呢個模型對劇情類AI視頻創作特別友好,尤其適合漫劇工作室。

- Star Video 2.0 支援一次生成最多9個分鏡視頻,最長15秒,連音效對話一齊出。

- 傳統流程要逐個鏡頭生成圖片>轉視頻>補幀>剪輯>加音效,新模型直接由文字描述跳到成品。

- 多模態參考可以同時輸入人物、場景、道具圖片,甚至音頻同視頻作為參考。

- 實戰中要將劇本切分成多個15秒片段,並為每個分鏡簡單改寫腳本,留少少空間畀AI自由發揮。

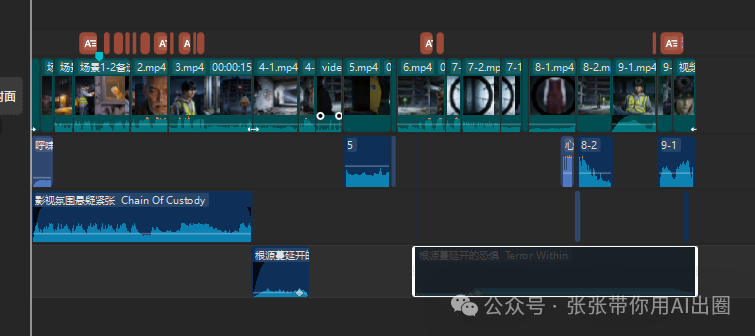

- 成個創作流程喺一個畫布完成,唔使重複上傳素材,後期修改都好方便。

Star Video 2.0 係乜嘢?

Star Video 2.0 係LibTV最新嘅視頻生成模型,專為劇情類創作設計。佢嘅核心能力係將複雜嘅多鏡頭短劇一鍵生成,唔使逐個鏡頭分開搞。

多鏡頭視頻生成(最長15秒,穩定出8-9個分鏡)

佢仲有音畫一體功能,聲音同畫面同步生成,唔使後期再對口型。另外可以透過畫布將人物、場景、道具參考圖連接到視頻節點,甚至連音頻同視頻都得。

點樣用Star Video 2.0 做漫劇?

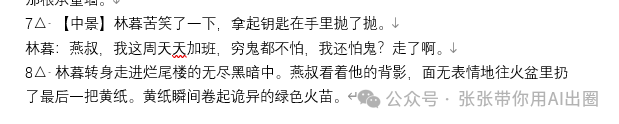

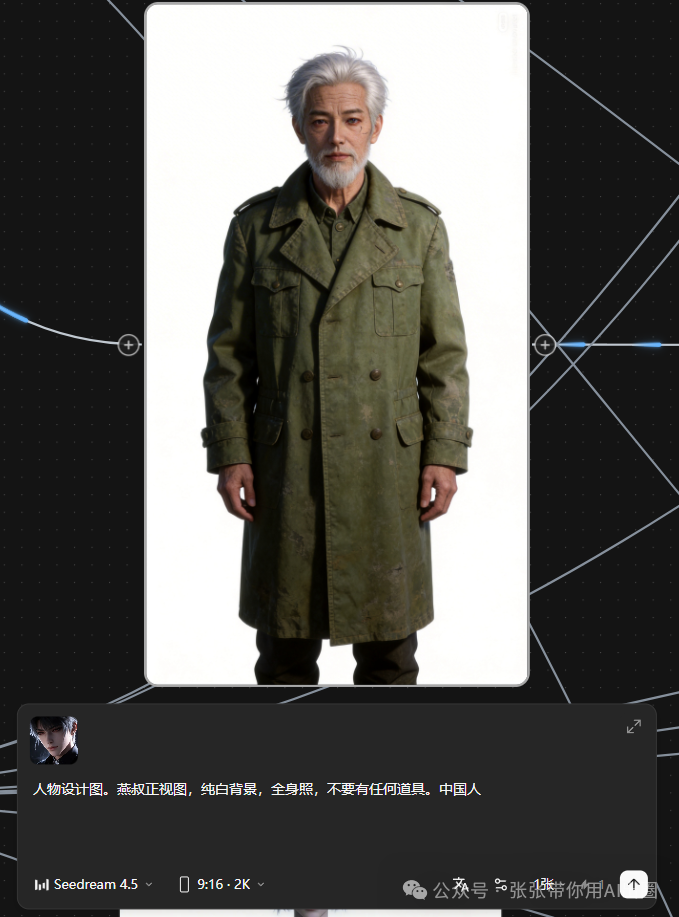

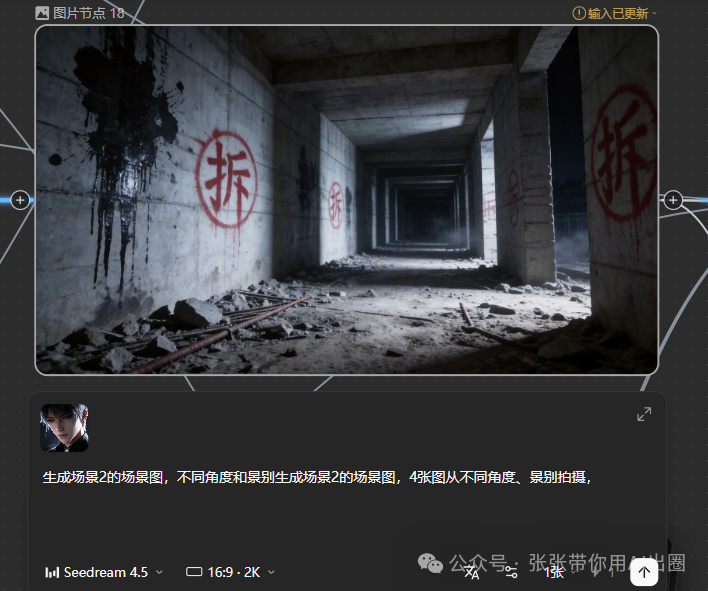

首先將劇本切分成8-9個15秒嘅片段,留少少餘地。然後每個場景拎出嚟,改寫成分鏡腳本,再梳理需要用嘅人物、道具同場景。

- 1 將參考圖(人物、場景、道具)連接去視頻生成節點。

- 2 輸入分鏡腳本,開頭可以標註@圖1係邊個,方便AI識別。

- 3 結尾加一句「自然的運鏡與切鏡」等AI自由發揮。

- 4 每個素材開始時重複人物位置,或者從上一個片段截圖做位置參考,提高連貫性。

將劇本直接連入圖片生成框,AI會自動根據劇本生成參考圖

作者習慣喺分鏡腳本入面加多啲具體描述,例如「@圖3揹着@圖5」,令AI更準確。

每個素材開始時加一句位置描述,連貫性會好啲

LibTV vs 傳統創作效率

傳統方式要分別用唔同模型生成圖片、轉視頻、補幀,然後剪輯加音效,搞一個短劇隨時要成日。而家用Star Video 2.0,所有步驟喺一個畫布完成,唔使重複上傳素材。

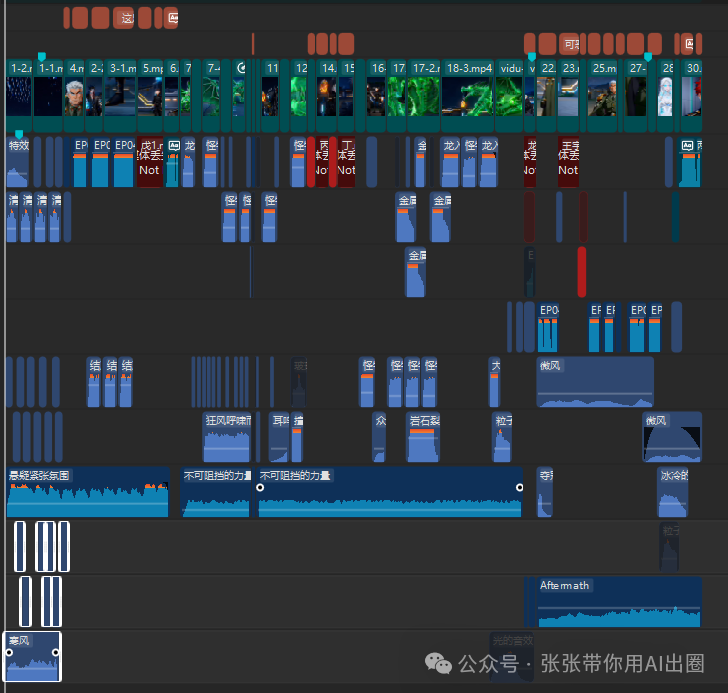

畫布入面可以直接組合劇本、圖片、視頻、音頻,唔使另外整理素材

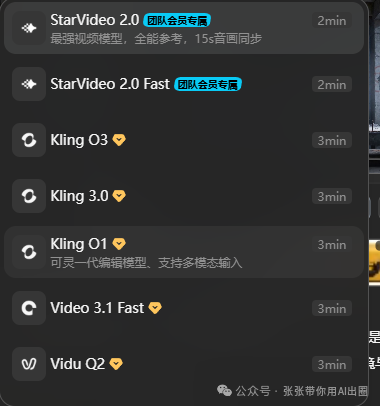

目前Star Video 2.0只開放畀團隊會員使用,比較適合漫劇工作室或者公司。

多模態參考係最關鍵嘅功能,連音頻同視頻都可以做參考

做AI漫劇,最崩潰嘅瞬間唔係AI生成質量差,而係流程太麻煩。

行一個Model,出一張圖。再行另一個Model,圖轉視頻。再行另一個Model,補幀、高清化。再導入剪輯軟件,加音效、加字幕;做配音。

呢個係我之前做AI視頻嘅日常,亦都係好多AI創作者嘅日常。

但係尋日,我用LibTV嘅新Model Star Video 2.0,重新行咗一次呢個流程。今次,我只係做咗一件事——輸入一段描述,等幾分鐘,收到一條完整嘅多鏡頭短劇。

1.乜嘢係Star Video 2.0

什麼是Star Video 2.0?用文字解釋太乾,我直接放一個例子。

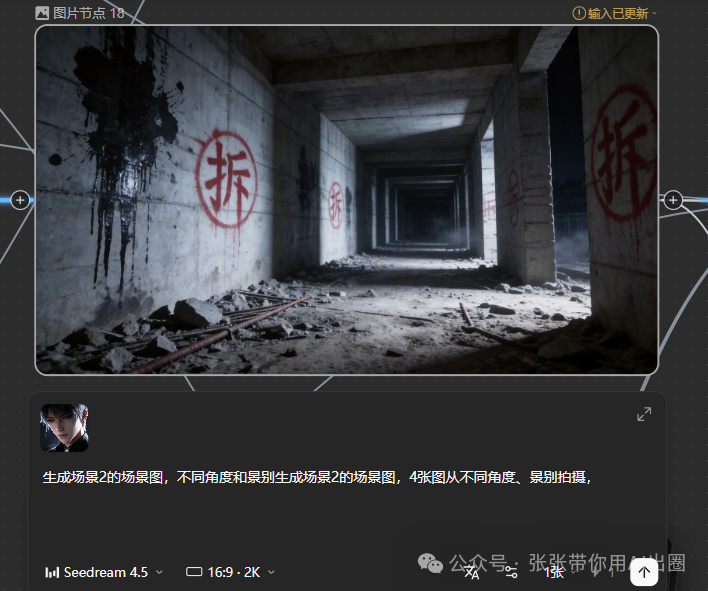

呢個15秒嘅視頻素材,係我喺LibTV用Star Video 2.0一鍵生成嘅。其中包含:6個分鏡頭,4個細分場景,以及背景音效同對話。

傳統嘅創作方式需要單獨生成每個鏡頭嘅人物/場景融合圖片,再單獨去行每個分鏡嘅視頻素材,最後拼埋一齊,再後期加音效、配音、BGM、轉場效果等等。

而且整圖片或視頻素材仲有抽卡唔穩定嘅情況,基本上要成1個鐘先整到出嚟。但我而家用Star Video 2.0前後只用了幾分鐘。

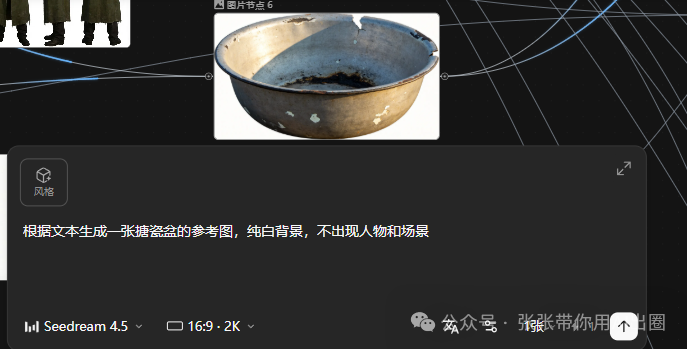

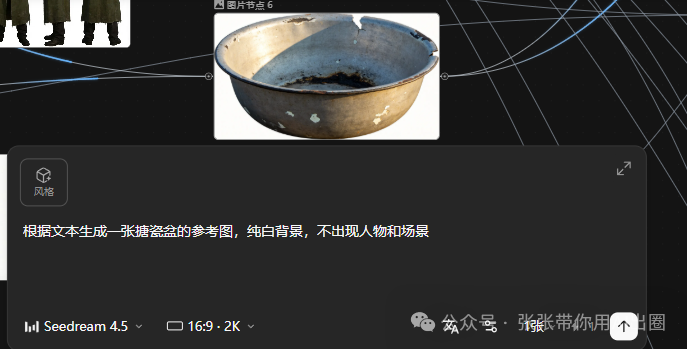

Star Video 2.0嘅工作流程係,喺LibTV嘅畫布入面,將場景圖、人物圖、道具圖連到視頻生成節點上,然後輸入呢個場景嘅分鏡腳本就可以得到咁嘅效果。

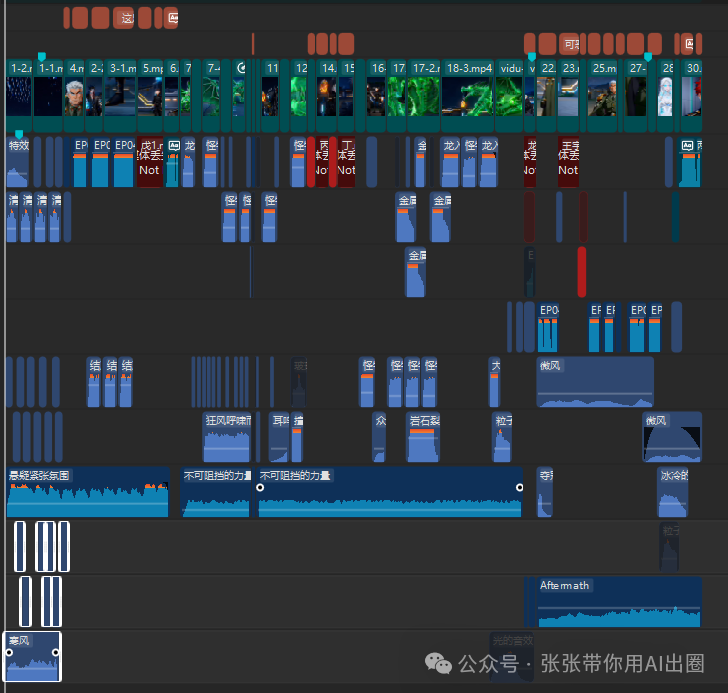

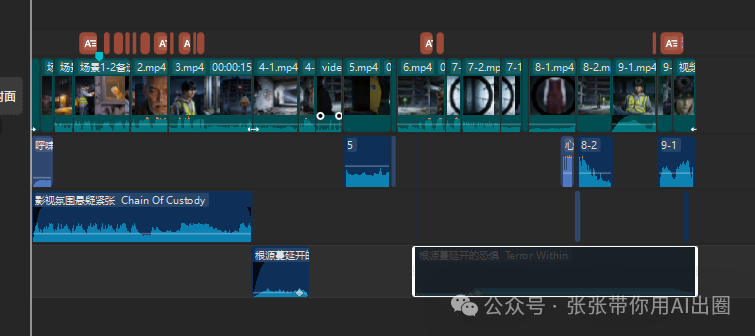

畫布節點截圖

總結嚟講,Star Video 2.0嘅三大特點:

1、多鏡頭視頻生成(一次性生成多個分鏡視頻,最長15秒,實測最多可以穩定生成8-9個分鏡頭冇問題)

2、音畫一體,聲音(包括音效同對話)同視頻畫面可以一齊生成,大幅降低後期剪輯嘅成本同壓力

除咗圖片,音視頻都可以作為參考元素

3、多模態參考,可以透過畫布將人物、場景、道具參考圖一齊連到視頻節點,參考呢啲要素去生成最後嘅視頻。除咗圖片,我哋都可以將音頻(例如場景音效、BGM等)、視頻本身都作為參考素材(參考運鏡、角色、風格等),引入到視頻生成度。

多模態例子

Star Video 2.0對於AI視頻創作,尤其係做長篇劇情類嘅視頻(例如電影/短劇等)特別友好。

2.Demo作品實操展示

成品作品展示

START

START

做AI漫劇,最崩潰的瞬間不是AI生成質量差,而是流程太繁瑣。

跑一個模型,出了一張圖。再跑一個模型,圖轉視頻。再跑一個模型,補幀、高清化。再導到剪輯軟件,加音效、加字幕;做配音。

這是我之前做AI視頻的日常,也是很多AI創作者的日常。

但昨天,我用LibTV的新模型Star Video 2.0,重新走了一遍這個流程。這次,我只做了一件事——輸了一段描述,等幾分鐘,收到一條完整的多鏡頭短劇。

1.什麼是Star Video 2.0

什麼是Star Video 2.0?用文字說明太乾癟了,我直接放一個案例。

這個15s的視頻素材,是我在LibTV用Star Video 2.0一鍵生成的。其中包含:6個分鏡頭,4個細分場景,以及背景音效和對話。

傳統的創作方作需要單獨生成每個鏡頭的人物/場景融合圖片,在單獨去跑每個分鏡的視頻素材,最後拼接在一起,在後期去加音效、配音bgm轉場效果等等。

而且做圖片或視頻素材還有抽卡不穩定的情況,基本上需要1個小時才能做出來。但我現在用Star Video 2.0前後只用了幾分鐘。

Star Video 2.0的工作流程是,在LibTV的畫布裏面,把場景圖,人物圖,道具圖連到視頻生成節點上,然後輸入這個場景的分鏡腳本就可以得到這樣的效果。

畫布節點截圖

總結來說,Star Video 2.0的三大特點:

1、多鏡頭視頻生成(一次性生成多個分鏡視頻,最長15s,實測下來最多可以穩定生成8-9個分鏡頭沒有問題)

2、音畫一體,聲音(包含音效和對話)和視頻畫面可以一起生成,大大降低後期剪輯的成本和壓力

除了圖片,音視頻也可以作為參考元素

3、多模態參考,可以通過畫布把人物、場景、道具參考圖一起連到視頻節點,參考這些要素去生成最後的視頻。除了圖片,我們也可以把音頻(如場景音效,bgm等)、視頻本身也作為參考素材(參考運鏡、角色、風格等),引入到視頻生成中。

多模態案例

Star Video 2.0對於AI視頻創作,尤其是做長篇劇情類的視頻(如電影/短劇等)尤其友好。

2.Demo作品實操展示

成片作品展示

START

START