OpenClaw 與 Hermes 的競爭在Harness上

整理版優先睇

AI Agent競爭轉向Harness:Anthropic託管 vs Hermes自進化

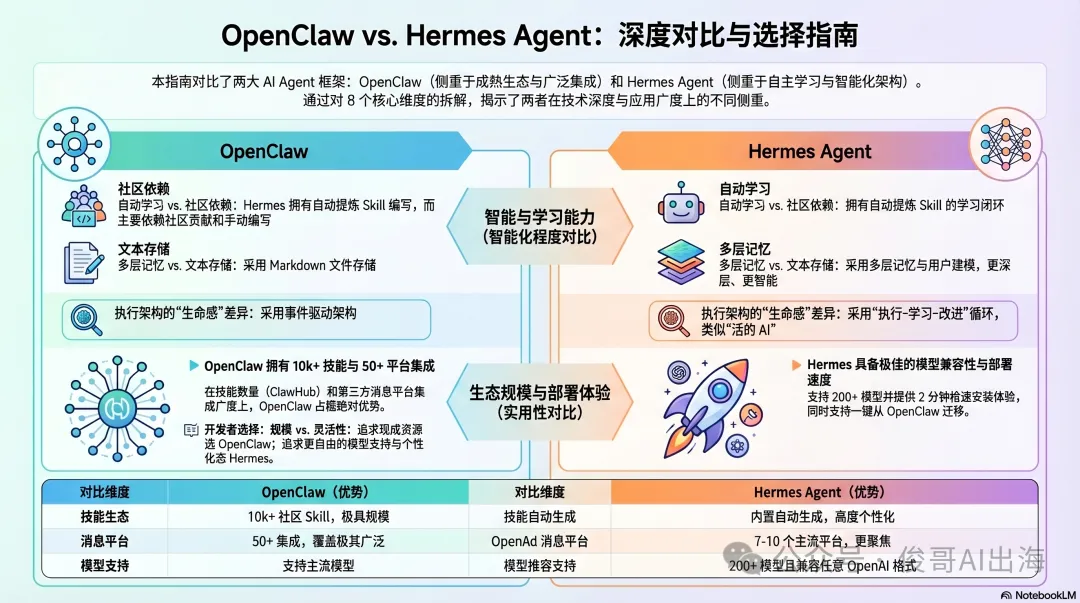

呢篇文章係由前字節跳動員工、AI編程教練俊哥AI寫嘅。佢本身用緊OpenClaw配合Claude Code做建站自動化,有一次AI自動完成咗SEO優化,改代碼部署上線,令佢好震撼。但後來佢發現OpenClaw有CPU卡死問題,令佢想遷移到Hermes。同一周佢讀咗兩個新資訊,改變咗佢對Agent嘅睇法。

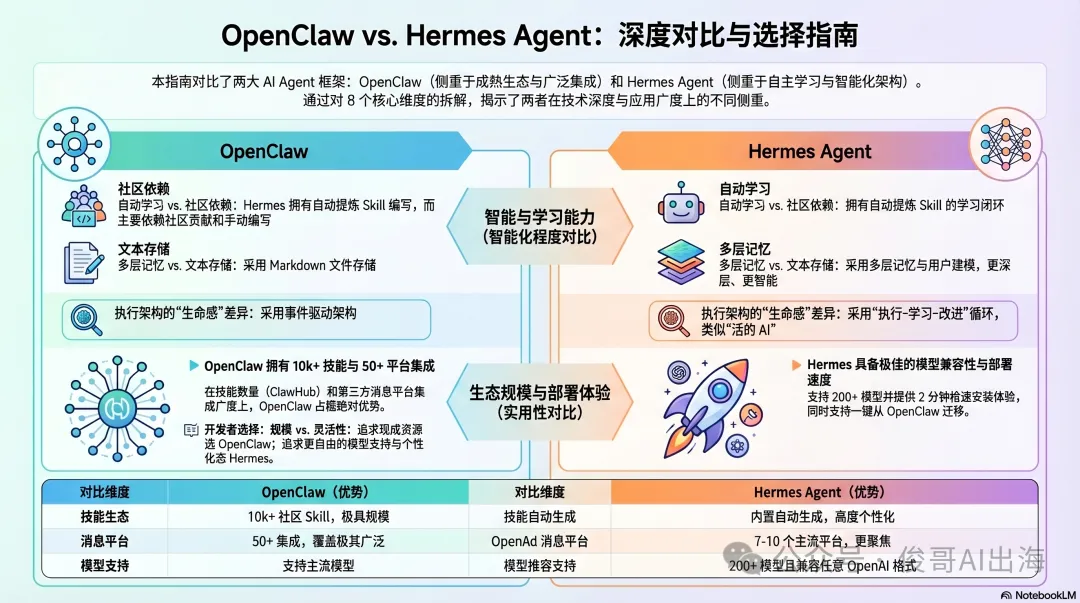

第一個係Hermes,由Nous Research做嘅開源Agent框架。佢最特別嘅地方係完成複雜任務後,會將整個解決過程沉澱成一份結構化技能文檔,下次類似任務直接加載,唔使從頭推理。而且技能會自我迭代,兩小時內可以生成三份文檔,重複任務速度提升40%。呢個同OpenClaw靠人工寫技能嘅路線完全唔同。第二個係Anthropic發佈嘅Claude Managed Agents,即係託管Agent運行服務。Anthropic工程師馬東錫指出,自己維護Harness隨模型升級會變成累贅,不如交給平台優化。

文章結論係:AI Agent嘅競爭已經唔再係模型本身,而係在Harness上。Anthropic同Hermes雖然路徑唔同,但都指向同一個判斷:Harness係關鍵。自己死磕Harness可能等模型升級就變成累贅,更值得做嘅係跑在Harness上面嘅場景、流程同交付標準。呢啲先係別人替代唔到嘅。

- Agent競爭已從模型轉向Harness(編排引擎),Anthropic提供託管服務,Hermes讓Agent自我進化。

- Hermes會將解決過程沉澱為技能文檔,自動迭代,兩小時內生成三份文檔,重複任務速度提升40%。

- 自己維護Harness會隨模型升級變成累贅,Anthropic的Managed Agents按用量收費,自動優化。

- Managed Agents採用「大腦和手分離」架構:推理、執行、記憶獨立,首次響應延遲降60%,安全隔離憑證。

- 真正值得投入的是場景中的交付標準,明確「做完了」的判斷標準,教會Agent,而非底層基礎設施。

一個意外嘅SEO優化任務

俊哥AI本身用緊OpenClaw配合Claude Code做建站自動化。有一次佢叫AI去做SEO優化,唔係寫meta描述咁簡單,而係真係改代碼、部署上線。

佢只係去咗倒杯水,返嚟AI已經做曬。

呢件事令佢意識到,以前需要打開IDE、找到對應文件、改好、跑CI、推上去、等deploy、再返嚟檢查嘅整條鏈路,Agent自己跑完咗。

整條鏈路Agent自己跑完

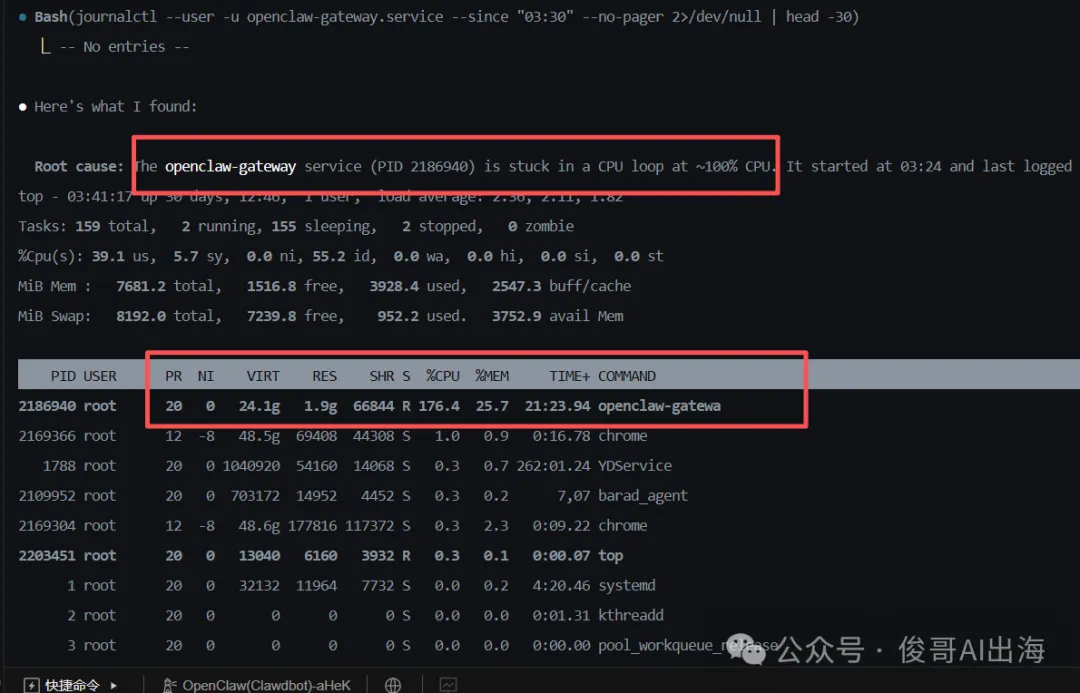

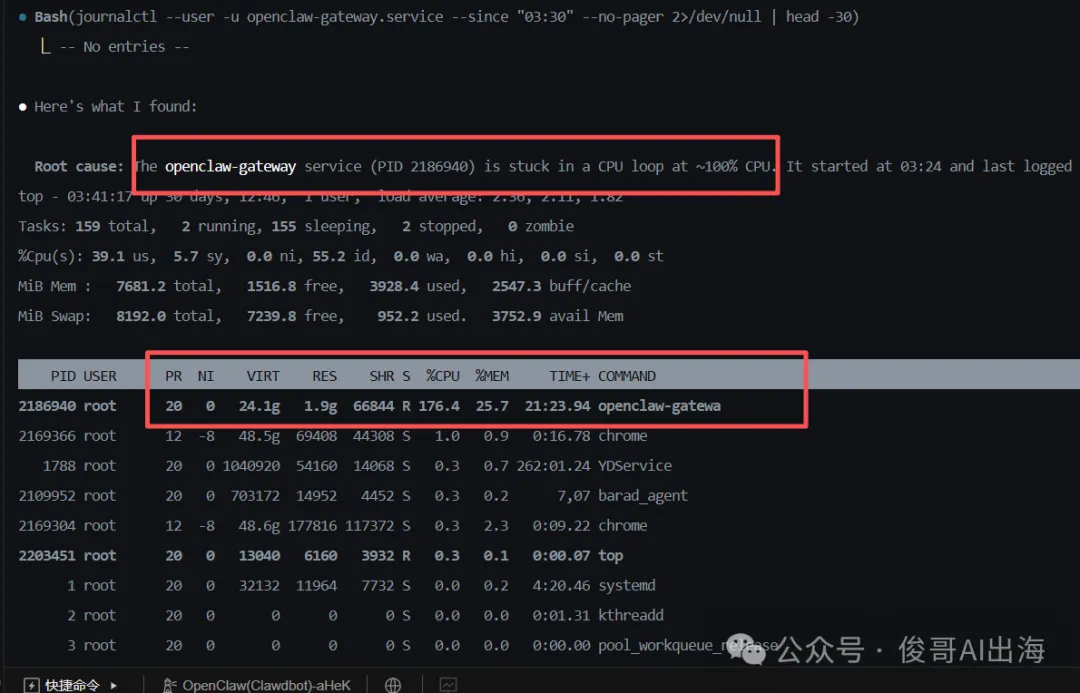

不過後來OpenClaw更新後成日唔回覆,經Claude定位發現係CPU卡死,令佢決定遷移到Hermes。

CPU卡死造成事件無法回覆

Hermes:Agent自己寫操作手冊

Hermes係Nous Research做嘅開源Agent框架。佢同OpenClaw最大嘅分別係,完成複雜任務之後,會將整個解決過程沉澱成一份結構化技能文檔,存成Markdown。

將整個解決過程沉澱成結構化技能文檔

下次遇到類似任務,直接加載呢份文檔,唔使從頭推理。

直接加載文檔,唔使從頭推理

更關鍵係,呢啲技能會自我迭代。Agent發現更好嘅方法,會自動更新文檔。有Reddit用戶測試,兩小時內Hermes自己生成了三份技能文檔,重複性研究任務速度提升40%。

技能自我迭代,兩小時生成三份文檔,速度提升40%

相反,OpenClaw嘅技能系統主要靠人工寫同社區貢獻。Hermes係將「寫技能」呢件事都交畀Agent自己。

OpenClaw靠人工寫技能,Hermes教Agent自己造工具

Managed Agents:Anthropic幫你管Harness

Anthropic發佈咗Claude Managed Agents,係一套可組合API,用嚟構建同部署雲託管AI Agent。

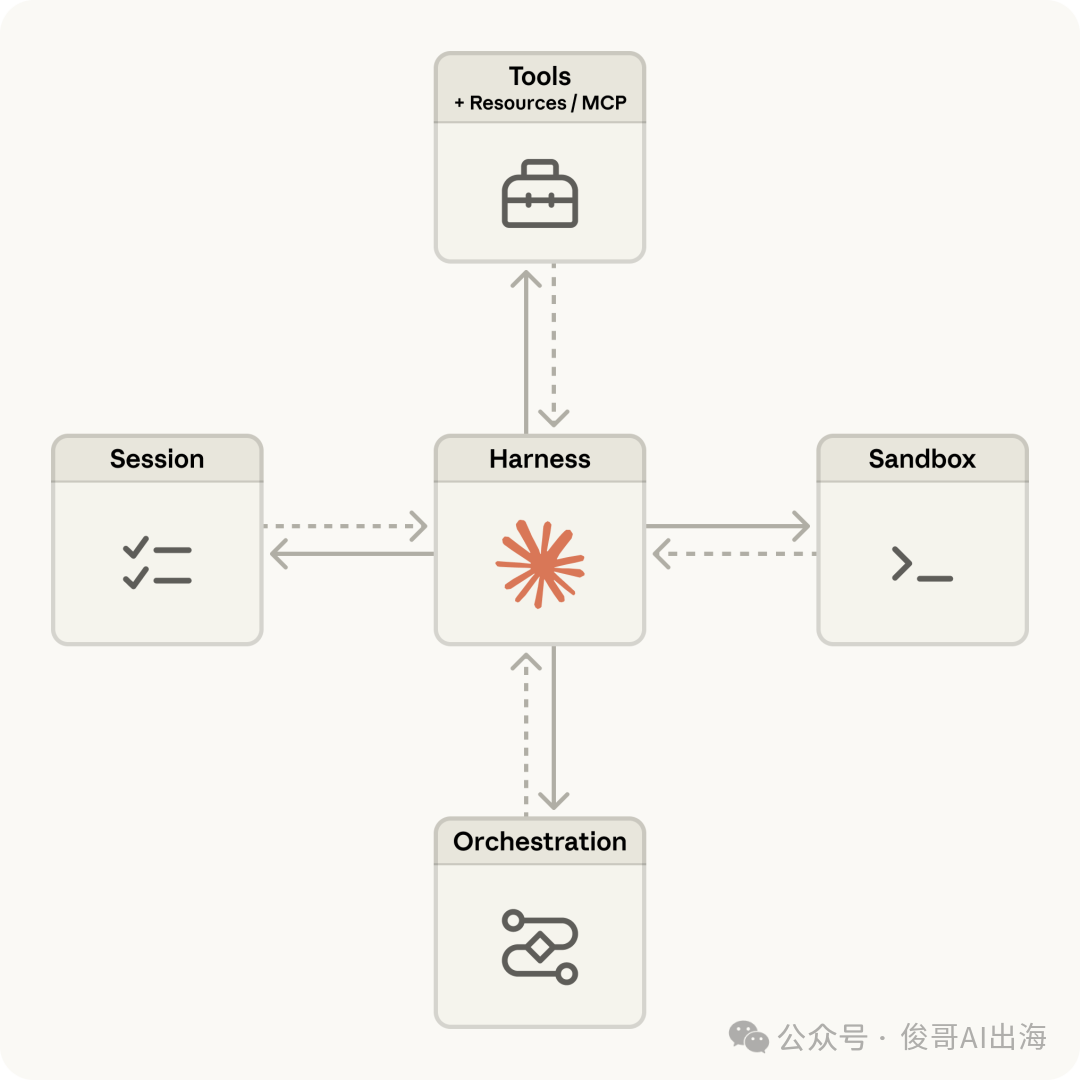

核心係賣Harness(Agent編排引擎)

呢個Harness係一個經過調優嘅編排循環,自動處理工具調用決策、上下文管理、錯誤恢復,並隨模型能力升級自動演進。

自動處理工具調用決策、上下文管理、錯誤恢復

馬東錫指出:「你對住模型當前侷限性設計嘅啲嘢,模型升級之後係累贅。」

馬東錫:模型升級後自建Harness係累贅

舉例:Claude Sonnet 4.5快到上下文極限時會「焦慮」,Anthropic加咗上下文重置;Claude Opus 4.5出咗後問題消失,之前嘅補丁變成多餘。

模型升級後舊補丁變多餘

Managed Agents同Claude Code嘅分別:Claude Code跑喺你電腦,關機就停;Managed Agents跑喺雲端,24小時不間斷。產品可以內嵌Agent能力,例如Notion、Sentry、Rakuten嘅案例。

從AWS到Agent:基礎設施商品化

文章將Agent Harness嘅商品化比作AWS。2006年前要自己買服務器,AWS出現後基礎設施變成外包商品。

基礎設施從核心競爭力變成外包商品

Anthropic而家賣託管好嘅Agent運行服務,包括sandbox、execution、memory、完整runtime。年經常性收入突破300億美元,係去年12月嘅三倍。

年經常性收入突破300億美元

華爾街開始擔心傳統SaaS會被呢類產品取代。

傳統SaaS可能被Agent取代

作者提醒:AI Agent唔再比誰更聰明,而係比誰嘅系統更會跑,比誰嘅經驗積累更快,比誰更清楚喺真實場景裏面「做完」意味着乜。

模型係腦,Harness係系統

唔係幫我寫 meta 描述,唔係生成關鍵詞列表嗰種。

係真嘅,改 code,部署上線。

我去斟咗杯水,返嚟,啲工做曬。

睇住個 mon 睇咗一陣,講唔出嘢。

唔係因為技術有幾勁,而係嗰一瞬間我意識到,呢件事以前需要我打開 IDE,揾到對應文件,改好,跑 CI,推上去,等 deploy,再返嚟檢查。成條鏈路,Agent 自己跑曬。

我用嘅係 OpenClaw,配合 Claude Code,做建站自動化跑咗一段時間。一開始半信半疑,用嚇用嚇好難返轉頭。

坦白講,嗰陣時我覺得我大概知道 Agent 係點嘅一回事,更強嘅模型,加上更多嘅工具,加上更耐用嘅上下文管理。大腦更聰明,手更多,記性更好。

然後同一星期,我睇咗兩個嘢,想法變咗。

仲有 openclaw 更新完最新版,成日唔覆我,用 claude 幫我定位咗問題,最後係 100% CPU 卡死,做成事件無法覆我。我都要遷移到 Hermes 愛馬仕喇。

第一個係 Hermes。

Nous Research 做嘅開源 Agent 框架,國內中文資料唔多。

老實講,開頭我以為又係一個「支援 40 個工具、15 個平台、MCP 接 6000+ 應用」嘅 Agent 框架,呢種開局我睇到麻木曬。

但有一個細節令到我停咗。

Hermes 完成一個複雜任務之後,涉及五次以上工具調用嗰啲,會將成個解決過程沉澱成一份結構化嘅技能文檔,存成 Markdown 文件。下次遇到類似任務,直接加載呢份文檔,唔使由頭推理。

更關鍵嘅係,呢啲技能喺執行過程中會自我迭代。Agent 發現咗更好嘅方法,會自動更新嗰份文檔。有 Reddit 用戶測試過,兩個鐘內 Hermes 自己生成了三份技能文檔,之後重複性研究任務嘅速度提升咗 40%。

我睇到呢度停咗一下。

因為我突然間明佢喺度做緊乜。

佢唔係等緊模型變聰明,佢係喺度自己建立自己嘅操作手冊。每次做完一件複雜嘅事,就將經驗固化落嚟,下次唔使由頭推理,直接調用。用耐咗嘅 Agent,會越來越識做嗰啲事。

呢個同 OpenClaw 嘅路線完全唔同。OpenClaw 嘅技能系統主要靠人工寫同社區貢獻,ClawHub 上有個技能市場,揾到啱嘅裝上去用。Hermes 呢邊就將「寫技能」呢件事本身,都交咗畀 Agent 自己。

如果話 OpenClaw 係將工具交畀 Agent,Hermes 係喺度教 Agent 自己造工具。

然後我喺 X 上刷到 Anthropic 發佈 Claude Managed Agents 嘅消息。

然後見到馬東錫發嘅嗰條推。補充返,呢個唔係韓國演員嗰個馬東錫。

「本地嘅 Harness 係徒勞嘅,因為隨住模型迭代將問題本身解決,針對舊模型侷限而精心設計嘅 harness,就失去咗存在嘅意義。換句話講,模型嘅侷限廠家最清楚,佢可以完全按照模型嘅特性設計唔同嘅 harness,然後打包賣畀你。呢個包,就係 Managed Agents。」

我嗰陣時就停咗落嚟。

因為呢句話係講緊我。

我一直以為,想令 Agent 跑得好,需要自己將調度邏輯搭好,自己設計 Harness,自己想清楚點樣管上下文、點樣處理工具調用嘅邊界。呢啲我覺得係「用好 Agent」應該要做嘅事。

但馬東錫講嘅係,你對住模型當前侷限設計嗰啲嘢,模型升級之後係累贅。

Anthropic 工程博客有個真實案例。Claude Sonnet 4.5 快到上下文窗口極限時會「焦慮」,草草結束任務,佢哋專門喺調度框架入面加咗上下文重置嚟應對。Claude Opus 4.5 出咗之後,呢個毛病消失咗,之前嗰個補丁反而變成多餘嘅邏輯。

你自己維護 Harness,每次模型升級你都要跟住改。交畀 Anthropic,佢哋幫你優化,打包賣畀你。

咁 Managed Agents 到底係啲乜?

一句講曬,你話畀 Anthropic 聽想要咩嘢嘅 AI Agent,佢幫你喺雲端度跑起嚟,基礎設施全包,按用量收費。

同 Claude Code 嘅分別好直接。Claude Code 係喺你自己電腦度運行,熄咗電腦就停咗。Managed Agents 係喺 Anthropic 嘅雲端度運行,24 小時唔間斷,斷線咗都唔會丟失進度,你嘅產品可以直接內嵌 Agent 能力。

Notion 令用戶喺工作區入面直接將任務分配畀 Claude Agent,Agent 喺後台跑完將結果交返嚟,全程唔使離開 Notion。Sentry 做咗由發現 bug 到提交修復代碼嘅全自動流程,幾個星期就上線咗。Rakuten 喺工程、產品、銷售、財務各部門都部署咗專項 Agent,每個一個星期內上線,透過 Slack 同 Teams 接任務,交返嚟嘅係表格、PPT、App 呢啲實際交付物。

之前呢啲事,需要成個工程師團隊做幾個月。

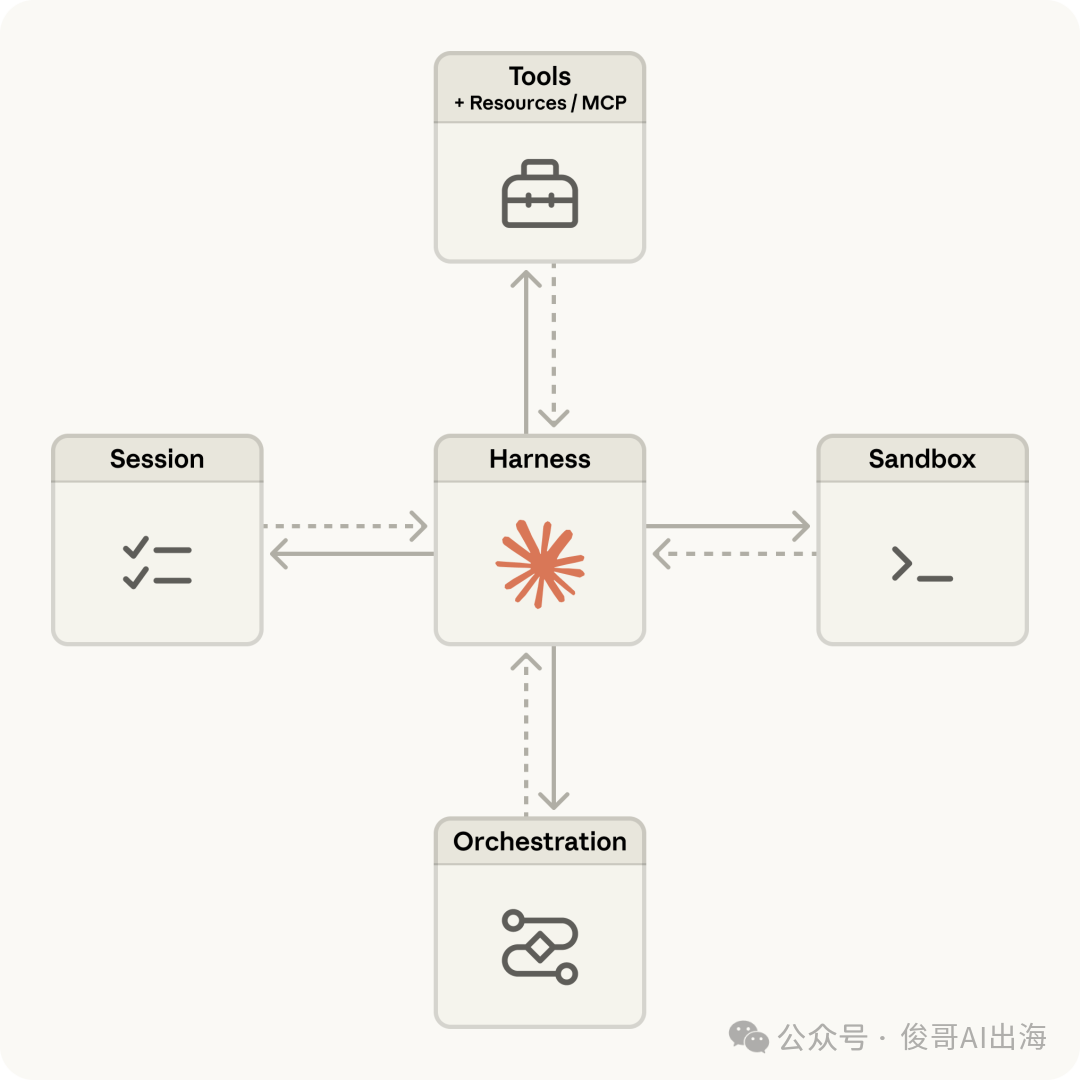

背後嘅架構,Anthropic 叫佢做「大腦同手分離」。

最早佢哋將所有嘢塞曬入一個容器,AI 嘅推理循環、Code 執行環境、會話記錄,全部喺埋一齊。好處係簡單,壞處係雞蛋全部喺同一個籃度,容器一死,成個會話就冇咗。

後來做咗一個關鍵拆解。大腦係 Claude 同調度框架,負責思考同決策。手係沙盒同各種工具,負責執行。記憶係獨立嘅會話日誌,記錄發生嘅一切。三者互不依賴,任何一個死咗都唔會影響另外兩個。

呢個拆解帶嚟幾個實際嘅好處。首先係快,只有 Agent 真係需要跑 Code 時先按需啟動沙盒,首次響應延遲中位數降咗約 60%,極端情況降咗超過 90%。然後係安全,Code 喺沙盒度運行,訪問外部系統嘅憑證存在沙盒外面嘅安全保險箱度,兩邊物理隔離,Agent 全程唔經手憑證本身。仲有靈活,工程博客入面有句話我覺得講得好好,調度框架唔知沙盒到底係一個容器、一部手機、定係一個寶可夢模擬器,只要符合「名字同輸入入去,字符串出嚟」嘅接口就得。

你夠唔夠膽信???寶可夢模擬器嗰句唔係我老作嘅,原文就係咁寫嘅。

我將呢兩件事擺埋一齊諗咗一下。

Hermes 同 Managed Agents,一個係 5 美元 VPS 就跑到嘅開源框架,一個係 Anthropic 賣畀企業嘅雲端託管服務,睇起嚟毫無關係。

但佢哋喺度解決同一個問題,邊個嚟管 Harness?

Anthropic 嘅答案,我嚟管,雲端運行,打包賣畀你。

Hermes 嘅答案,Agent 自己嚟管,將經驗沉澱成 Skill,Harness 隨住使用越來越掂。

兩個完全唔同嘅路徑,收斂到同一個判斷。

Agent 嘅競爭,已經唔係喺模型本身喇。

真正嘅戰場,係喺 Harness 上面。

Anthropic 發佈嘅 Claude Managed Agents 係一套可組合嘅 API,用嚟構建同部署雲託管嘅 AI Agent。但同市面上嘅 Agent 框架唔同,Anthropic 賣嘅核心係 Harness(Agent 編排引擎):一個經過調校嘅編排循環,自動處理工具調用決策、上下文管理、錯誤恢復,並且隨住模型能力升級自動演進

呢個令我想起 AWS。

2006 年之前,想跑一個互聯網服務,要自己買 Server、租機房、配網絡。AWS 出咗之後,呢啲事全包曬。

但 AWS 真正改變嘅唔單止係慳咗買 Server 嘅錢,而係令到「搭基礎設施」呢件事本身,由核心競爭力變成咗可以外包嘅商品。

嗰批做託管機房嘅公司,業務空間開始被壓縮。

真正賺到錢嘅,係嗰啲諗清楚咗「只有喺雲上先跑到嘅產品係啲乜」嘅人。

而家,同樣嘅事正在 Agent 呢條賽道上面發生。

Anthropic 喺度賣託管好嘅 Agent 運行服務,唔只賣 token,而係賣 sandbox,賣 execution,賣 memory,賣完整嘅 Agent runtime。OpenAI 都推出咗自己嘅 Agent 平台 Frontier。呢條賽道嘅競爭啱啱開始。順便講嚇,Anthropic 嘅年經常性收入啱啱突破 300 億美元,係去年 12 月嘅三倍,大部分增長嚟自企業客戶。華爾街已經開始緊張,WSJ 話投資者對傳統 SaaS 公司嘅股價越來越小心,擔心呢類產品會令到一啲傳統軟件服務變得多餘。

嗰批做通用 Agent 調度框架、通用 orchestration 封裝嘅團隊,日子開始難過,因為上游平台喺度將呢一層慢慢食咗。

真正嘅問題變成咗,你諗清楚咗未,乜嘢係只有 Agent 跑起嚟先交到嘅嘢?

我回頭諗咗諗我做嘅建站自動化。

我叫 Agent 做 SEO 優化,佢改咗 code,部署上線,啲工做曬。

呢件事真正難嘅唔係 Agent 調用咗幾多個工具,而係呢個任務有一個明確嘅「做曬」嘅標準,部署成功,SEO 指標改咗,code 冇死,就算做好咗。

Agent 最能夠發揮價值嘅地方,往往就係呢種有明確交付物、可以驗證結果嘅場景。做站、SEO 優化、QA 跑測試、外鏈檢查,呢啲有個共同點,你可以清楚知道佢有冇做好。呢啲比起「幫我想嚇有冇咩好生意」呢種任務,對 Agent 嚟講容易得太多。

所以我而家反而唔擔心 Agent 基礎設施嗰一層喇。Anthropic 喺度做,Hermes 喺度做,呢層會越來越好,越來越平,越來越唔需要自己操心。

我更在意嘅係,喺你嘅行業,喺你嘅具體場景入面,嗰個「做曬」嘅標準係乜,以及可唔可以將呢個判斷標準教畀 Agent。

嗰先係值得花時間嘅事。

點樣講呢,兩件事加埋一齊,畀咗我一個有啲意外嘅結論。

AI Agent 唔再鬥邊個更加聰明。

佢係喺度鬥邊個嘅系統更識跑,鬥邊個嘅經驗積累更快,鬥邊個更清楚喺真實場景入面「做完」代表啲乜。

模型係入面嗰個腦,Harness 先係令佢真正做到嘢嗰套系統。

而 Harness 呢件事,一係交畀 Anthropic,一係交畀 Hermes 嘅自進化循環,一係自己死磕,然後等模型升級,發現自己寫嗰啲 code 變咗累贅。

更加值得做嘅,係跑喺 Harness 上面嗰一層,你嘅場景,你嘅流程,你嘅交付標準。

嗰啲,係人哋取代唔到嘅。

永遠對世界保持好奇。

以上,既然睇到呢度,如果覺得唔錯,順手點個讚、睇睇、轉發三連啦,如果想第一時間收到推送,都可以畀我個星標⭐~

俊哥AI 前字節牛馬 AI編程教練 連結我入交流羣

不是幫我寫 meta 描述,不是生成關鍵詞列表那種。

是真的,改代碼,部署上線。

我去倒了杯水,回來,活兒做完了。

盯着屏幕看了一會兒,說不出話來。

不是因為技術有多牛,而是那一瞬間我意識到,這件事以前需要我打開 IDE,找到對應文件,改好,跑 CI,推上去,等 deploy,再回來檢查。整條鏈路,Agent 自己跑完了。

我用的是 OpenClaw,配合 Claude Code,做建站自動化跑了一段時間了。一開始半信半疑,用着用着很難回去了。

坦率的講,那時候我覺得我大概知道 Agent 是怎麼回事了,更強的模型,加上更多的工具,加上更耐用的上下文管理。大腦更聰明,手更多,記性更好。

然後同一周,我讀了兩個東西,想法變了。

還有 openclaw 更新完最新版,經常不回覆我,用claude給我定位了問題,最後是100% cpu卡死,造成事件無法回覆我。我也要遷移到Hermes 愛馬仕了

第一個是 Hermes。

Nous Research 做的開源 Agent 框架,國內中文資料不多。

老實說,開頭我以為又是一個「支持 40 個工具、15 個平台、MCP 接 6000+ 應用」的 Agent 框架,這種開局我看麻了。

但有一個細節讓我停住了。

Hermes 完成一個複雜任務之後,涉及五次以上工具調用的那種,會把整個解決過程沉澱成一份結構化的技能文檔,存成 Markdown 文件。下次遇到類似任務,直接加載這份文檔,不用從頭推理。

更關鍵的是,這些技能在執行過程中會自我迭代。Agent 發現了更好的方法,會自動更新那份文檔。有 Reddit 用戶測試過,兩小時內 Hermes 自己生成了三份技能文檔,之後重複性研究任務的速度提升了 40%。

我看到這裏停了一下。

因為我突然明白它在幹什麼。

它不是在等模型變聰明,它是在自己建自己的操作手冊。每做完一件複雜的事,就把經驗固化下來,下次不用從頭推理,直接調用。用久了的 Agent,會越來越會做那些事。

這跟 OpenClaw 的路子完全不一樣。OpenClaw 的技能系統主要靠人工寫和社區貢獻,ClawHub 上有個技能市場,找到合適的裝上去用。Hermes 這邊是把「寫技能」這件事本身,也交給了 Agent 自己。

如果說 OpenClaw 是把工具交給 Agent,Hermes 是在教 Agent 自己造工具。

然後我在 X 上刷到了 Anthropic 發佈 Claude Managed Agents 的消息。

然後看到了馬東錫發的那條推。對了,這個不是韓國演員的馬東錫

「本地的 Harness 是徒勞的,因為隨着模型迭代把問題本身解決,針對舊模型侷限而精心設計的 harness,便失去了存在的意義。換句話說,模型的侷限性廠家最清楚,它可以完全按照模型的特性設計不同的 harness,然後打包賣給你。這個包,就是 Managed Agents。」

我當時就停下來了。

因為這句話在說我。

我一直以為,想讓 Agent 跑得好,需要自己把調度邏輯搭好,自己設計 Harness,自己想清楚怎麼管上下文、怎麼處理工具調用的邊界。這些我覺得是「用好 Agent」應該做的事。

但馬東錫說的是,你對着模型當前侷限性設計的那些東西,模型升級之後是累贅。

Anthropic 工程博客有個真實案例。Claude Sonnet 4.5 快到上下文窗口極限時會「焦慮」,草草結束任務,他們專門在調度框架里加了上下文重置來應對。Claude Opus 4.5 出來後,這個毛病消失了,之前那個補丁反而成了多餘的邏輯。

你自己維護 Harness,每次模型升級你都得跟着改。交給 Anthropic,他們替你優化,打包賣給你。

那 Managed Agents 到底是什麼?

一句話,你告訴 Anthropic 想要什麼樣的 AI Agent,它幫你在雲端跑起來,基礎設施全包,按用量收費。

和 Claude Code 的區別很直接。Claude Code 跑在你自己電腦上,關了電腦就停了。Managed Agents 跑在 Anthropic 的雲上,24 小時不間斷,斷線了也不丟進度,你的產品可以直接內嵌 Agent 能力。

Notion 讓用戶在工作區裏直接把任務分配給 Claude Agent,Agent 在後台跑完把結果交回來,全程不用離開 Notion。Sentry 做了從發現 bug 到提交修復代碼的全自動流程,幾周就上線了。Rakuten 在工程、產品、銷售、財務各部門都部署了專項 Agent,每個一週內上線,通過 Slack 和 Teams 接任務,交回來的是表格、PPT、App 這些實際交付物。

之前這些事,需要一整個工程師團隊幹幾個月。

背後的架構,Anthropic 管它叫「大腦和手分離」。

最早他們把所有東西塞進一個容器,AI 的推理循環、代碼執行環境、會話記錄,全在一起。好處是簡單,壞處是雞蛋全在一個籃子裏,容器一掛,整個會話就沒了。

後來做了一個關鍵拆分。大腦是 Claude 和調度框架,負責思考和決策。手是沙盒和各種工具,負責執行。記憶是獨立的會話日誌,記錄發生的一切。三者互不依賴,任何一個掛了都不影響另外兩個。

這個拆分帶來幾個實際的好處。首先是快,只有 Agent 真的需要跑代碼時才按需啓動沙盒,首次響應延遲中位數降了約 60%,極端情況降了超過 90%。然後是安全,代碼跑在沙盒裏,訪問外部系統的憑證存在沙盒外面的安全保險箱裏,兩邊物理隔離,Agent 全程不經手憑證本身。還有靈活,工程博客裏有句話我覺得說得很好,調度框架不知道沙盒到底是一個容器、一部手機、還是一個寶可夢模擬器,只要符合「名字和輸入進去,字符串出來」的接口就行。

你敢信???寶可夢模擬器那句不是我瞎編的,原文就這麼寫的。

我把這兩件事放在一起想了一下。

Hermes 和 Managed Agents,一個是 5 美元 VPS 就能跑的開源框架,一個是 Anthropic 賣給企業的雲端託管服務,看起來毫無關係。

但它們在解決同一個問題,誰來管 Harness?

Anthropic 的答案,我來管,雲端運行,打包賣給你。

Hermes 的答案,Agent 自己來管,把經驗沉澱成 Skill,Harness 隨着使用越來越好。

兩個截然不同的路徑,收斂到了同一個判斷。

Agent 的競爭,已經不在模型本身了。

真正的戰場,在 Harness 上。

Anthropic 發佈的 Claude Managed Agents 是一套可組合的 API,用於構建和部署雲託管的 AI Agent。但跟市面上的 Agent 框架不同,Anthropic 賣的核心是 Harness(Agent 編排引擎):一個經過調優的編排循環,自動處理工具調用決策、上下文管理、錯誤恢復,並且隨模型能力升級自動演進

這讓我想到了 AWS。

2006 年之前,想跑一個互聯網服務,得自己買服務器、租機房、配網絡。AWS 出來之後,這些事全包了。

但 AWS 真正改變的不只是省了買服務器的錢,而是讓「搭基礎設施」這件事本身,從核心競爭力變成了可以外包的商品。

那批做託管機房的公司,業務空間開始被壓縮。

真正賺到錢的,是那些想清楚了「只有在雲上才能跑的產品是什麼」的人。

現在,同樣的事正在 Agent 這個賽道上發生。

Anthropic 在賣託管好的 Agent 運行服務,不只賣 token,而是賣 sandbox,賣 execution,賣 memory,賣完整的 Agent runtime。OpenAI 也推出了自己的 Agent 平台 Frontier。這個賽道的競爭剛剛開始。順便說一下,Anthropic 的年經常性收入剛突破 300 億美元,是去年 12 月的三倍,大部分增長來自企業客戶。華爾街已經開始緊張了,WSJ 說投資者對傳統 SaaS 公司的股價越來越謹慎,擔心這類產品會讓一些傳統軟件服務變得多餘。

那批做通用 Agent 調度框架、通用 orchestration 封裝的團隊,日子開始難過了,因為上游平台在把這一層慢慢吃掉。

真正的問題變成了,你想清楚了沒有,什麼是隻有 Agent 跑起來才能交付的東西?

我回頭想了想我做的建站自動化。

我讓 Agent 做 SEO 優化,它改了代碼,部署上線,活做完了。

這件事真正難的不是 Agent 調用了多少個工具,而是這個任務有一個明確的「做完了」的標準,部署成功,SEO 指標改了,代碼沒掛,就算做好了。

Agent 最能發揮價值的地方,往往就是這種有明確交付物、可以驗證結果的場景。做站、SEO 優化、QA 跑測試、外鏈檢查,這些有個共同點,你可以清楚地知道它有沒有做好。這比「幫我想想有沒有什麼好生意」這種任務,對 Agent 來說容易太多了。

所以我現在反而不擔心 Agent 基礎設施那一層了。Anthropic 在做,Hermes 在做,這層會越來越好,越來越便宜,越來越不需要自己操心。

我更在意的是,在你的行業,在你的具體場景裏,那個「做完了」的標準是什麼,以及能不能把這個判斷標準教給 Agent。

那才是值得花時間的事。

怎麼說呢,兩件事加在一起,給了我一個有點意外的結論。

AI Agent 不再比誰更聰明瞭。

它在比誰的系統更會跑,比誰的經驗積累更快,比誰更清楚在真實場景裏「做完」意味着什麼。

模型是裏面那顆腦子,Harness 才是讓它真正能幹活的那套系統。

而 Harness 這件事,要麼交給 Anthropic,要麼交給 Hermes 的自進化循環,要麼自己死磕,然後等模型升級,發現自己寫的那些代碼成了累贅。

更值得做的,是跑在 Harness 上的那一層,你的場景,你的流程,你的交付標準。

那些,是別人替代不了的。

永遠對世界保持好奇。

以上,既然看到這裏了,如果覺得不錯,隨手點個贊、在看、轉發三連吧,如果想第一時間收到推送,也可以給我個星標⭐~

俊哥AI 前字節牛馬 AI編程教練 連結我進交流羣