Sam Altman 與開發者的一小時:GPT-5 搞砸了、招聘放緩、以及 2026 年最擔心的事

整理版優先睇

Sam Altman 坦承 GPT-5 寫作失誤、招聘放緩,警告生物安全風險,強調軟技能比具體技能更重要。

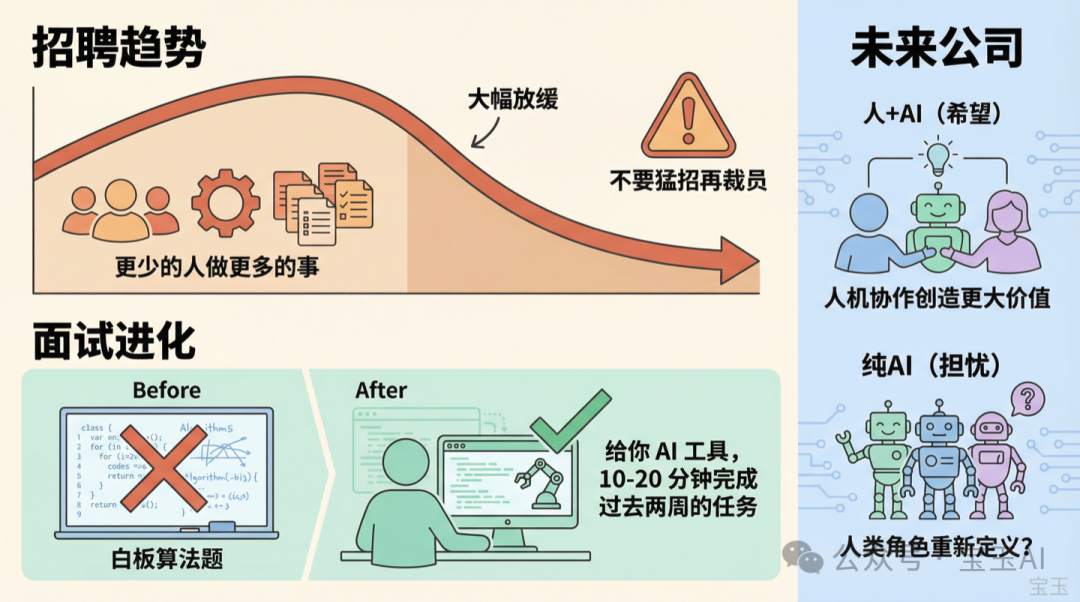

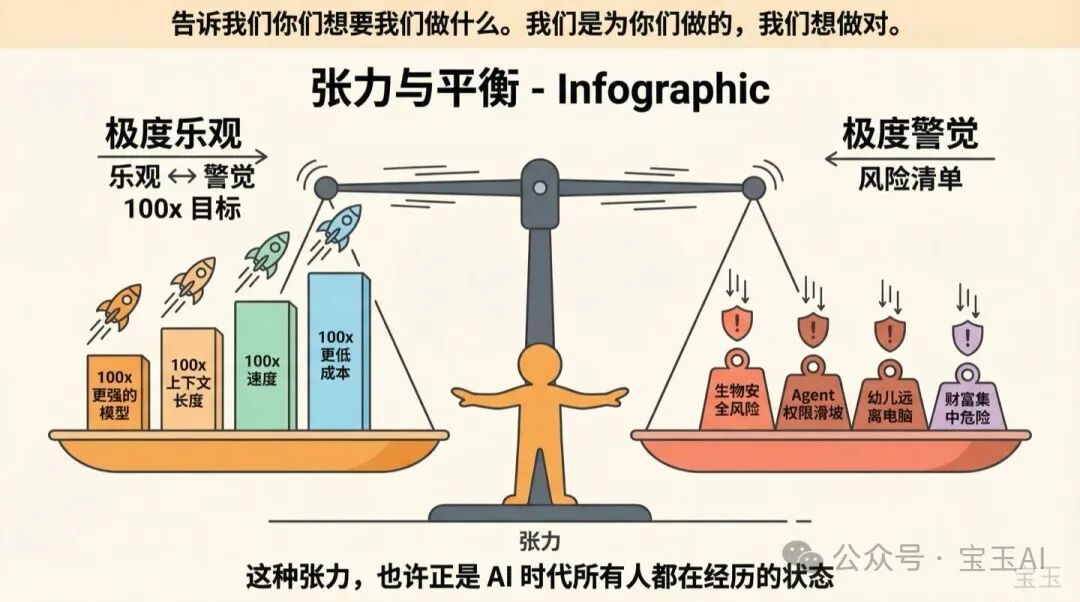

呢篇文章係 2026 年 1 月 27 日 OpenAI 開發者 Town Hall 嘅直播整理,CEO Sam Altman 回應咗 23 條問題。佢直接承認 GPT-5 喺寫作方面「搞咗鑊」,話係因為資源分配取捨,將主要精力擺咗喺智能、推理同編程上。Altman 同時宣佈 OpenAI 會大幅放慢招聘速度,因為佢哋認為可以用更少人做更多事。對於 2026 年嘅風險,佢話如果 AI 出大問題,「生物安全係合理嘅押注」,建議全世界由「阻斷」轉向「韌性」思維。整體而言,Altman 對技術能力極度樂觀,但對風險保持高度警覺,認為人類注意力仍然係稀缺品。

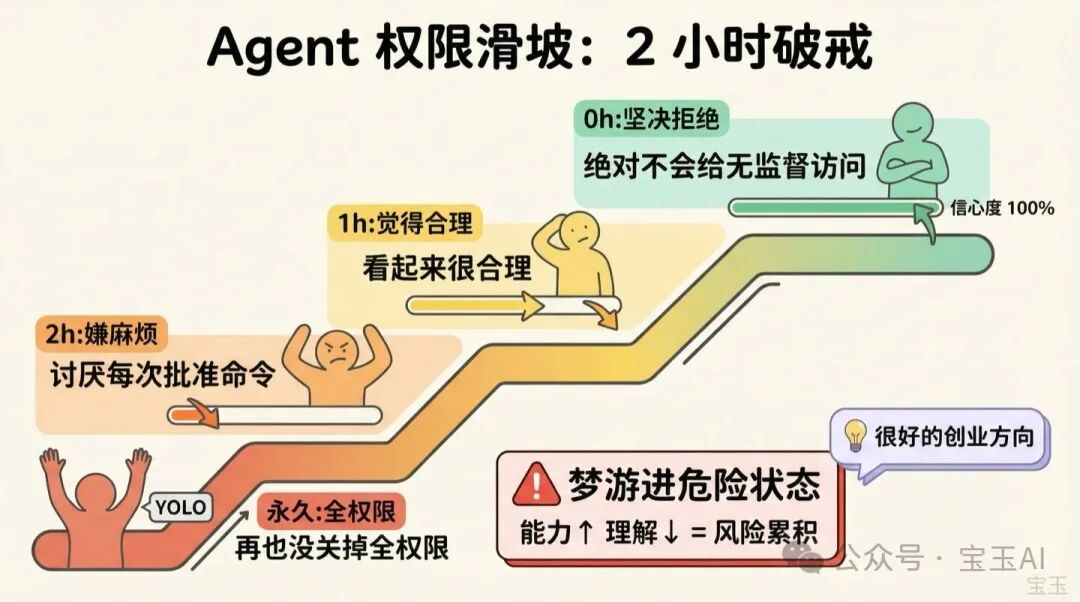

Altman 探討咗軟件工程嘅變化——佢認為 AI 會引發「傑文斯悖論」,令更多人定製個人軟件,但 GTM 仍然係最難環節。佢強調創業公司嘅護城河冇變,應該做「希望模型變強」嘅產品,而唔係打補丁式嘅方向。關於經濟,佢認為 AI 會帶嚟通縮,但可能集中權力,需要政策防止不平等。安全方面,佢提到自己用 Codex 時「兩小時就破戒」俾咗無監督訪問權限,擔心用戶會因為能力太強而「夢遊」進入危險狀態。

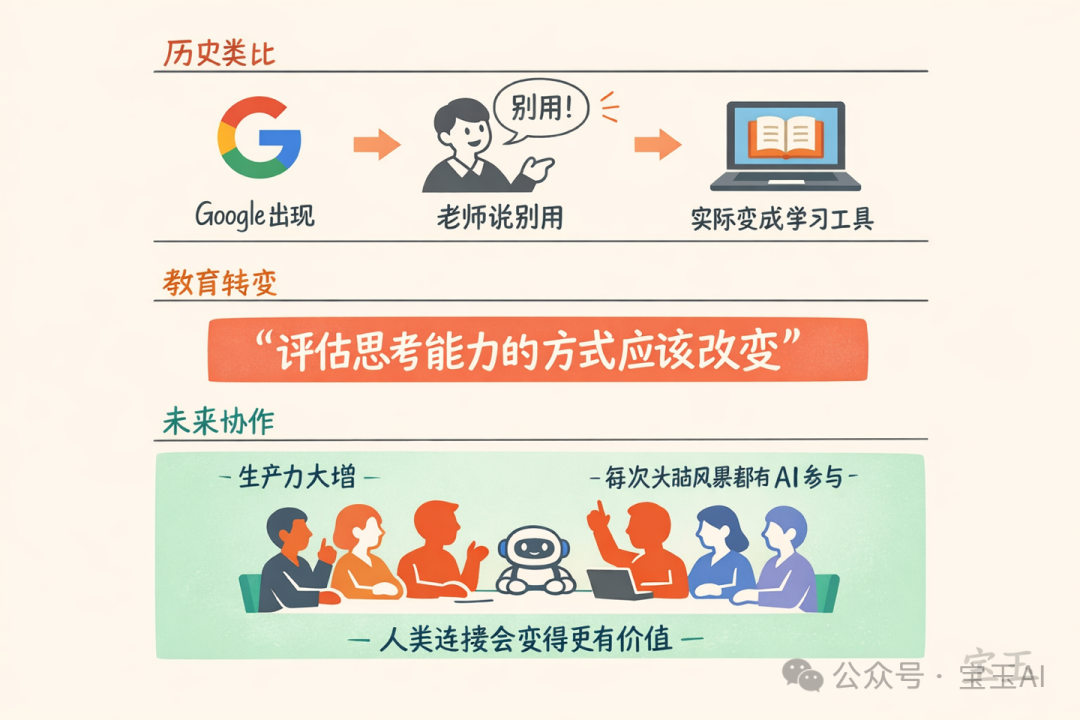

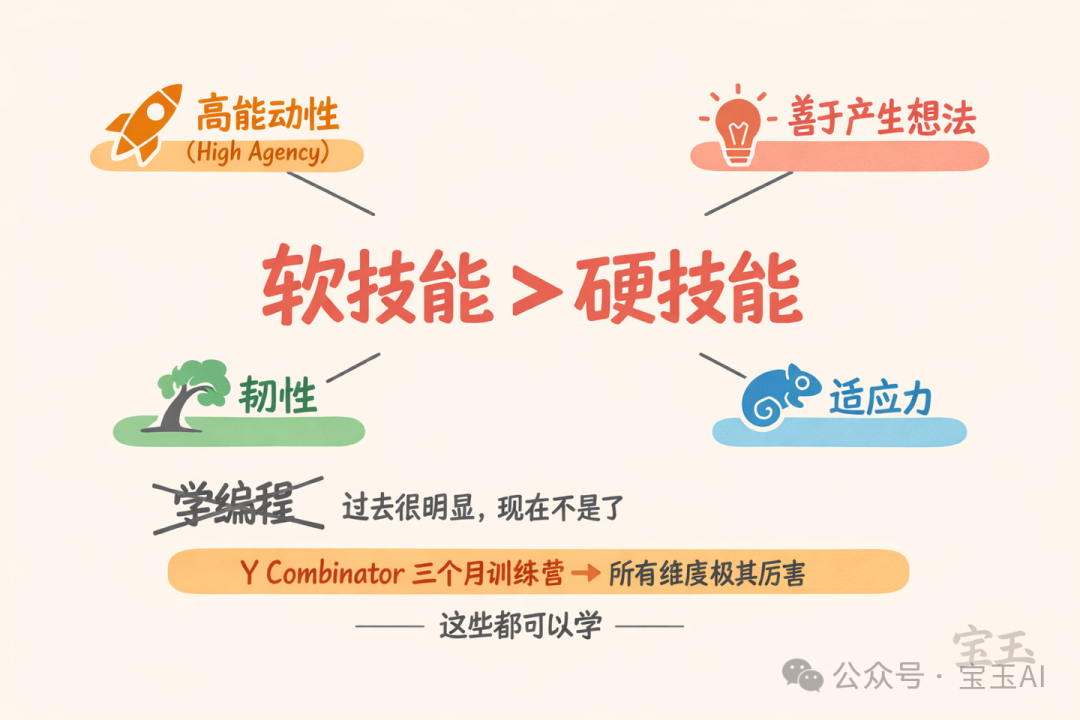

最後佢回應咗教育同技能問題:AI 時代最重要嘅唔係編程,而係軟技能——高能動性、產生想法、韌性同適應力,呢啲都係可以訓練嘅。佢透露 OpenAI 內部高度採用 Codex,每個人都有自己的小工具,未來會有更多「為一個人寫嘅軟件」。呢場 Town Hall 展現咗 AI 時代嘅張力…

- GPT-5 寫作問題源於資源分配取捨,未來會改善但短期通用模型優先。

- 軟件工程會因 AI 變得更多人參與定製軟件,但 GTM 仍然係最難。

- AI 會帶嚟通縮,但可能集中權力,政策需防止不平等。

- 創業公司護城河仍在,應做「希望模型變強」嘅產品。

- 未來最重要技能係軟技能:高能動性、產生想法、韌性、適應力。

模型能力取捨:GPT-5 寫作「搞咗鑊」

Altman 直接承認 GPT-5 寫作表現差,係因為團隊將大部分精力放喺 智能、推理同編程上。佢話「我哋頻寬有限,有時候專注一件事就會忽略另一件」,但強調未來模型會喺所有維度都好強,因為 智能係可轉移嘅。

對於模型專精 vs 通用嘅問題,Altman 認為即使想做超強編程模型,寫作好啲都有用,例如生成完整應用時需要好嘅文案。佢希望推動模型喺 所有維度都強,唔需要用戶喺能力之間取捨。

經濟與創業:傑文斯悖論同 GTM 挑戰

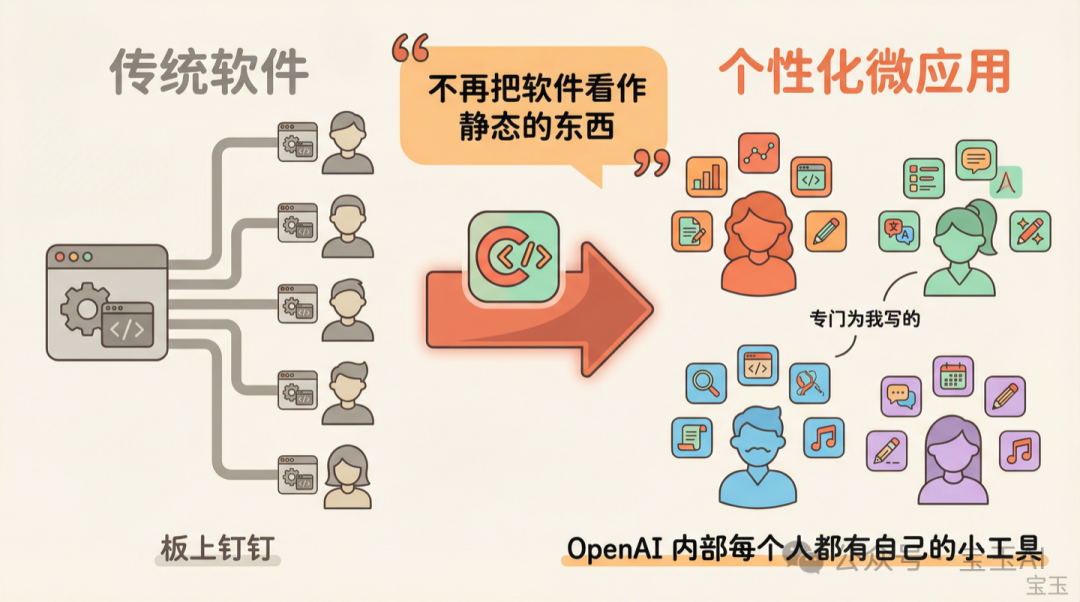

Altman 預測軟件工程嘅含義會巨大變化,更多人會用 AI 定製 為一個人或極少數人寫嘅軟件,令從事軟件工程嘅人增加,GDP 佔比上升。但佢強調 GTM 仍然係最難環節,因為 人類注意力永遠係稀缺品。

- 創業公司護城河冇變:獲取用戶、解決 GTM、提供粘性仍然重要,AI 只係令做產品更快。

- 一個判斷框架:如果 GPT-6 更新,你會高興定難過?應該做「希望模型變強」嘅產品,而唔係打補丁式方向。

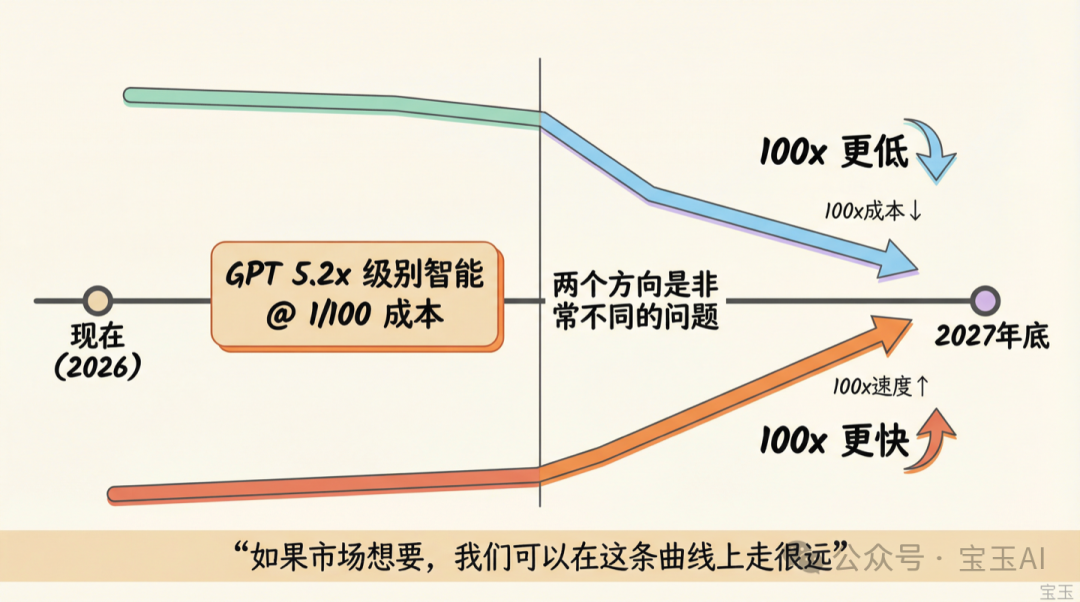

- 成本下降路線:Altman 預測到 2027 年底,能以至少 100 倍更低成本提供 GPT-5.2 級別智能,但市場亦要求速度,兩者係不同問題。

對於幫人想出好點子嘅工具,Altman 透露內部用嘅 GPT-5.2 特殊版本已經令科學家話「科學進展不再微不足道」,認為能產生新科學洞察嘅模型都可以用唔同方式產生 新產品洞察。

風險與安全:從阻斷轉向韌性

Altman 認為 2026 年 AI 最可能出大問題嘅領域係 生物安全,現有策略(限制訪問、分類器)唔會持久,世界需要轉向韌性基礎設施。佢用火嘅歷史做比喻:由「宵禁」轉向消防規範、阻燃材料。

- AI 會成為生物恐怖主義同網絡安全嘅真正問題,但同時 AI 都係解決方案。

- 採用 AI 工具嘅壓力非常大,因為快感同能力太強,用戶好易滑入「YOLO 希望冇事」嘅心態。

- OpenAI 大幅放緩招聘,因為認為可以用更少人做更多事,避免將來 AI 取代人手時要裁員。

Altman 預告,如果今年 AI 出大問題,生物係合理押注;到明年後年,可以想象 好多其他事情都會出大問題。佢呼籲全社會共同努力建設韌性基礎設施。

人類技能與教育:軟技能比編程更重要

被問到 AI 時代最重要嘅技能,Altman 話全部係軟技能:高能動性、產生想法、韌性同適應力,呢啲比具體技能重要,而且可以透過訓練提升。佢用創業投資做例子,發現三個月嘅訓練營就可以令人在呢啲維度上極其厲害。

對於創業建議,Altman 話自己都係大學輟學,父母用咗十年先停止問幾時返去。佢認為如果係有野心嘅 AI 建設者,而家唔係留喺大學嘅最好時機,因為世界變化太快。佢仲透露 OpenAI 正在思考 多人加 AI 嘅協作體驗,未來每次頭腦風暴都會有 AI 參與。

最後 Altman 強調,公司必須快速大規模採用 AI,否則會被純 AI 公司打敗。佢認為未來贏家係「有人類同事加 AI同事」嘅混合模式,而唔係完全冇人嘅公司。

“我原本堅決認為絕對不會給 Codex 無監督訪問我的電腦。結果大概撐了兩個小時就放棄了。”

這是 Sam Altman 在 OpenAI 開發者 Town Hall 上的自嘲。2026 年 1 月 27 日,這場面向開發者的直播持續了約一小時,Altman 回答了從模型能力到公司戰略到個人隱私觀的廣泛問題。承認了 GPT-5 在寫作上“搞砸了”,宣佈 OpenAI 將大幅放緩招聘,警告如果 2026 年 AI 出大問題,"生物安全可能是個合理的押注"。

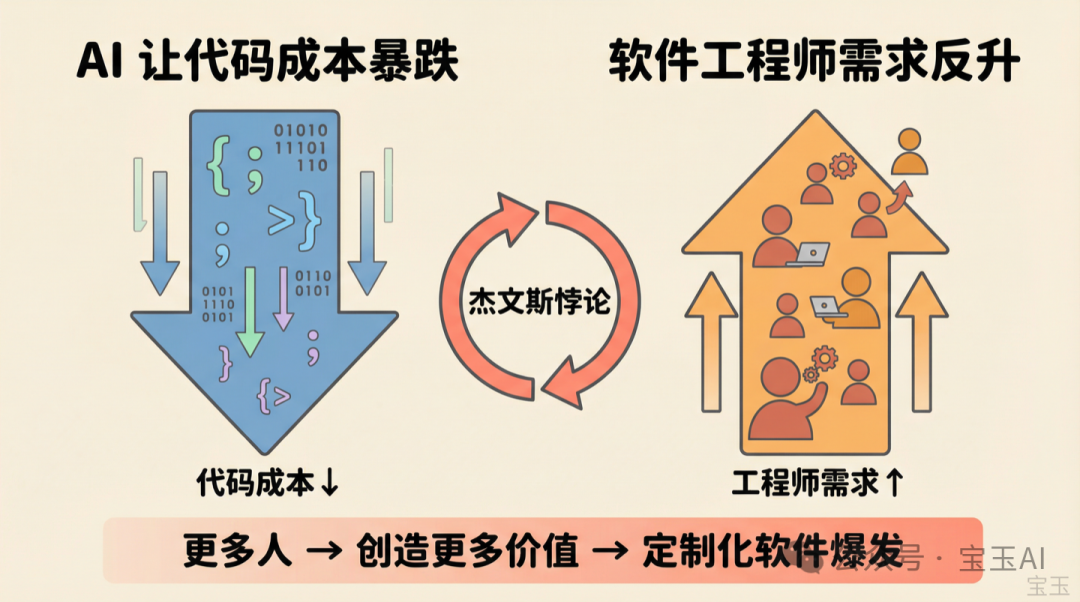

1. 軟件工程的傑文斯悖論

Altman 以一個 Twitter 問題開場:如果 AI 讓代碼創作變得極其便宜,軟件工程師的需求會減少,還是會因為定製軟件的爆發而保持高位?

"我認為工程師的含義會發生巨大變化。“Altman 說,”會有更多人創造更多價值、獲取更多價值,讓計算機做他們想做的事,為其他人做有用的事。但這份工作的形態,你花在敲代碼、調試上的時間,會非常不同。"

他指出這種變化在工程領域已經發生過很多次,每次都讓更多人能夠加入併產出價值。"我的猜測是,未來很多人會使用專門為一個人或極少數人編寫的軟件,而且我們會不斷定製自己的軟件。"

如果把這也算作軟件工程,那麼從事這項工作的人會大大增加,世界 GDP 中由此創造和消費的比例也會上升。

2. AI 時代的 GTM 挑戰

一位開發者提到,現在用 Codex、Lovable 或 Cursor 能很快做出產品,但真正的瓶頸變成了 GTM(go-to-market,市場推廣)。

"在我做 Y Combinator 的時候,創始人們反覆說的一件事就是:我以為最難的是做產品,結果最難的是讓任何人在乎它、使用它。“Altman 回應道,”現在做東西變得容易太多,這種落差感更強烈了。"

他沒有給出簡單答案。“所有老規則依然適用。你得找到差異化價值,得搞定 GTM。AI 能讓創造軟件變得容易,但不意味着其他事情也變容易了。”

不過他補充,AI 也開始被用於自動化銷售和營銷。"但我覺得這會一直很難,因為即使在極度富足的世界裏,人類注意力依然是稀缺品。你永遠在和其他人競爭。"

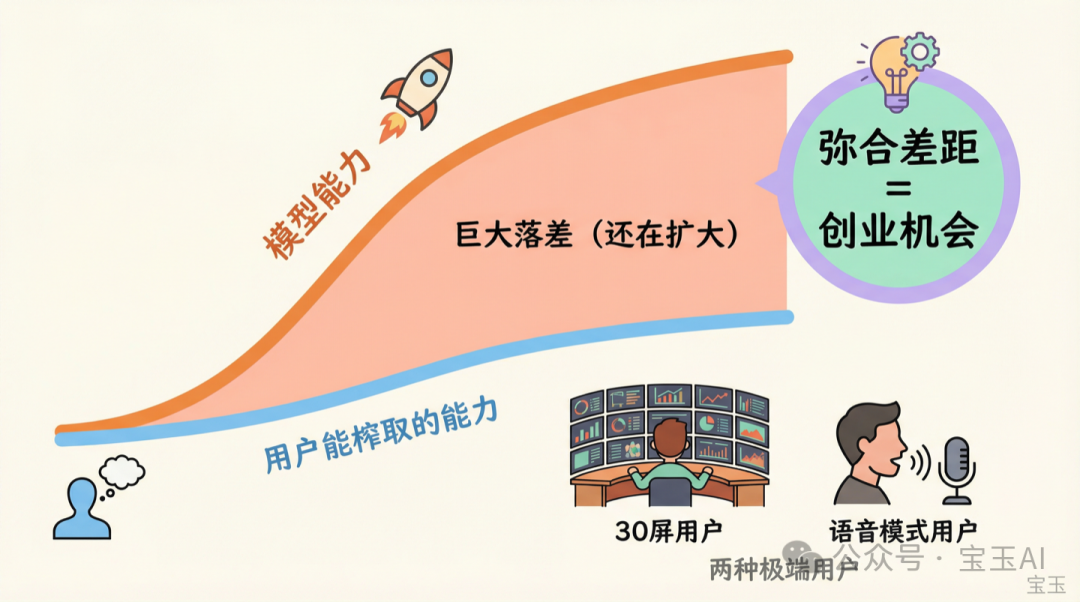

3. 多 Agent 編排與界面願景

一位 solo 開發者正在用 Codex SDK 做多 Agent 編排工具,問 OpenAI 的 Agent Builder 會不會把這塊市場吃掉。

"我們不知道正確的界面是什麼樣的。“Altman 坦言,”我們見過有人做出很棒的多 Agent 設置,也見過有人就用一個很好的單線程交互。我們不會自己搞清楚所有這些,而且不是每個人都想要同樣的東西。"

他描述了兩種極端場景:有人會像老電影裏那樣面對 30 塊屏幕,同時操控各種東西;也有人只想在語音模式下每小時跟電腦說一句話,讓它自己搞定,不想時刻盯着一堆 Agent。

"現在有一個巨大的落差,模型能做到的事和大多數人能從中榨取的能力之間的差距,而且這個差距還在擴大。誰能做出工具來彌合這個差距,誰就有機會。我們也會做自己的版本,但這個領域空間很大。"

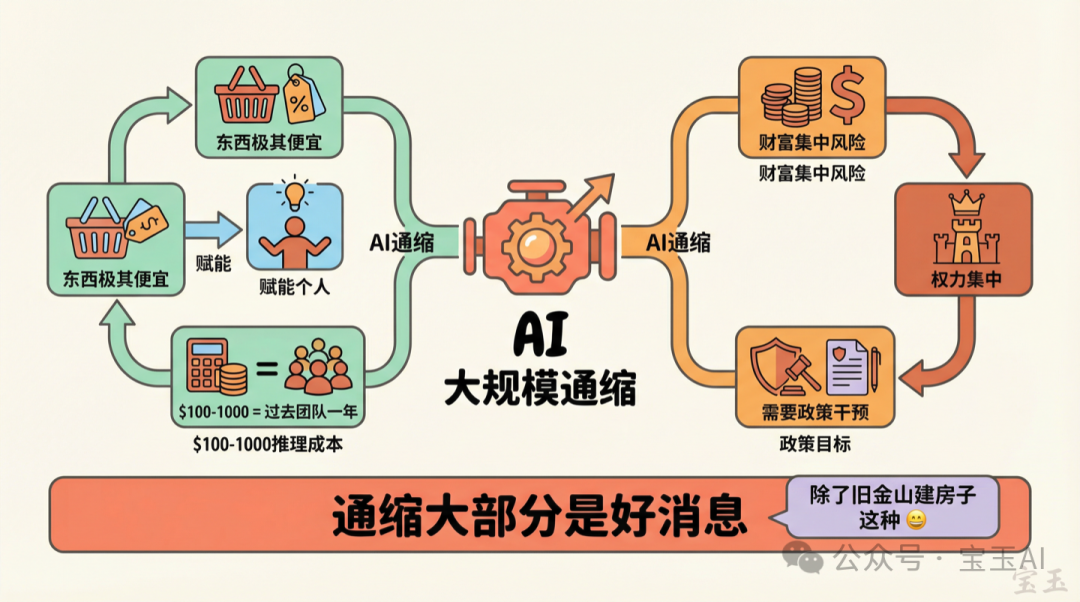

4. AI 能縮小經濟差距嗎?

一位正在 OpenAI 平台上做產品的創業者問:AI 能否幫助解決長期存在的經濟不平等,比如性別薪酬差距?

"好消息是,AI 會帶來大規模通縮。“Altman 說,”我對此反覆思考過,因為你可以想象一些奇怪的情況,比如全世界的錢都流向自我複製的數據中心。但從目前來看,無論是電腦前的工作還是即將到來的機器人技術,通縮壓力會非常強。"

他說這“大部分是好消息”,因為東西會變得極其便宜,除了那些受社會或政策阻礙的領域,比如在舊金山建房子。

"我仍然很難理解這個經濟變化的規模。到今年年底,100 到 1000 美元的推理成本,加上一個好想法,你就能創造出過去需要團隊花一年時間做的軟件。"

這應該是一種賦能,讓那些沒有被公平對待的人也能獲得機會。但他也警告:"你可以想象 AI 真正集中權力和財富的世界。阻止這種情況發生,應該是政策的主要目標之一。"

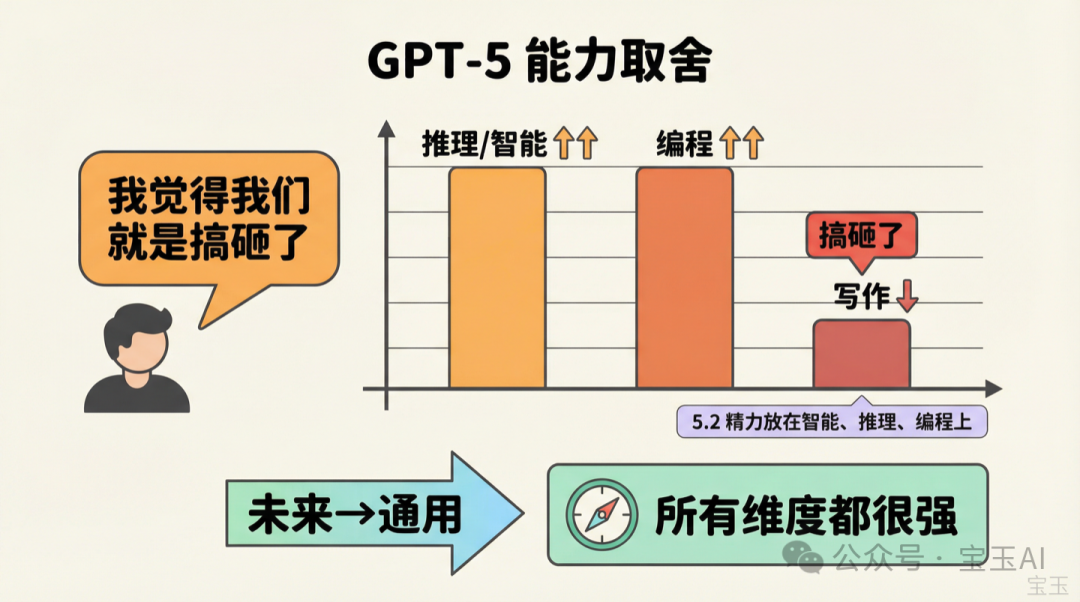

5. 模型應該專精還是通用?

一位 CTO 提了個尖鋭問題:GPT 4.5 是他見過的第一個“寫作真正好”的模型,但 GPT-5 的寫作被很多人吐槽“難讀”“不自然”。模型是不是變得更“尖刺”了,某些能力飆升,某些能力下降?

"我覺得我們就是搞砸了。“Altman 直接承認,”我們會讓 GPT 5.x 的未來版本在寫作上比 4.5 更好。我們確實決定,有充分理由,把 5.2 的大部分精力放在智能、推理、編程上。我們帶寬有限,有時候專注一件事就會忽略另一件。"

但他強調未來還是通用模型為主。“即使你想做一個超強的編程模型,寫作好一點也是好的。你想讓它生成完整應用時,裏面的文案也得好;你想讓它交互時有深思熟慮、表達清晰的個性。”

"我的希望是,我們會推動未來的模型在所有這些維度上都很強。智能是一種可轉移的東西,我們可以在單一模型中做到所有這些。"

GPT-5 於 2025 年 8 月發佈後,確實引發了大量用戶抱怨。Reddit 上一個批評帖子獲得了數千條評論,用戶稱其“寫作冰冷”“回覆過短”“個性喪失”。OpenAI 甚至被迫恢復了 GPT-4o 的可選項。Altman 當時承認自動路由系統“壞了”。這次 Town Hall 是他首次公開將寫作問題歸因於有意的資源分配取捨。

6. 成本下降路線圖

一家做 GTM 自動化的公司 CTO 問:Altman 說過“智能便宜到不用計量”,但他們運行千萬級 Agent 的瓶頸就是成本。OpenAI 怎麼看?

"到 2027 年底,我們應該能以至少 100 倍更低的成本提供 GPT 5.2x 級別的智能。"Altman 給出了具體預測。

但他提到了一個新維度:"我們歷史上沒太想過的是速度。現在模型輸出變得複雜,更多人在推我們,不是更便宜,而是同樣的輸出能不能快 100 倍,哪怕價格更高。"

“這兩個方向是非常不同的問題。但如果市場想要成本下降,我們可以在這條曲線上走很遠。”

7. 個性化軟件與微應用

Altman 唸了一個 Twitter 問題:當前界面不是為 Agent 設計的,但我們看到了“為我而建的應用”的興起。定製化界面的創新會如何加速微應用的趨勢?

"這是我最近自己用 Codex 時注意到的。我不再把軟件看作靜態的東西了。 有個小問題,我就期望電腦馬上寫點代碼解決。"

他預測整個計算機和操作系統的使用方式都會改變。“不是說每次編輯文檔都會現場生成一個新的 Word 處理器,我們太習慣界面了,那個按鈕得在老地方。但很多其他事情,我們會期望軟件是專門為我們寫的。”

他透露 OpenAI 內部已經高度採用 Codex,"每個人都有自己的小工具,使用方式完全不同“。這個方向看起來”板上釘釘",是個很好的創業方向。

8. 創業公司的護城河

Twitter 問題:當模型更新可以快速取代創業公司的功能時,創業者該怎麼想耐久性?有沒有哪層你們保證不吃?

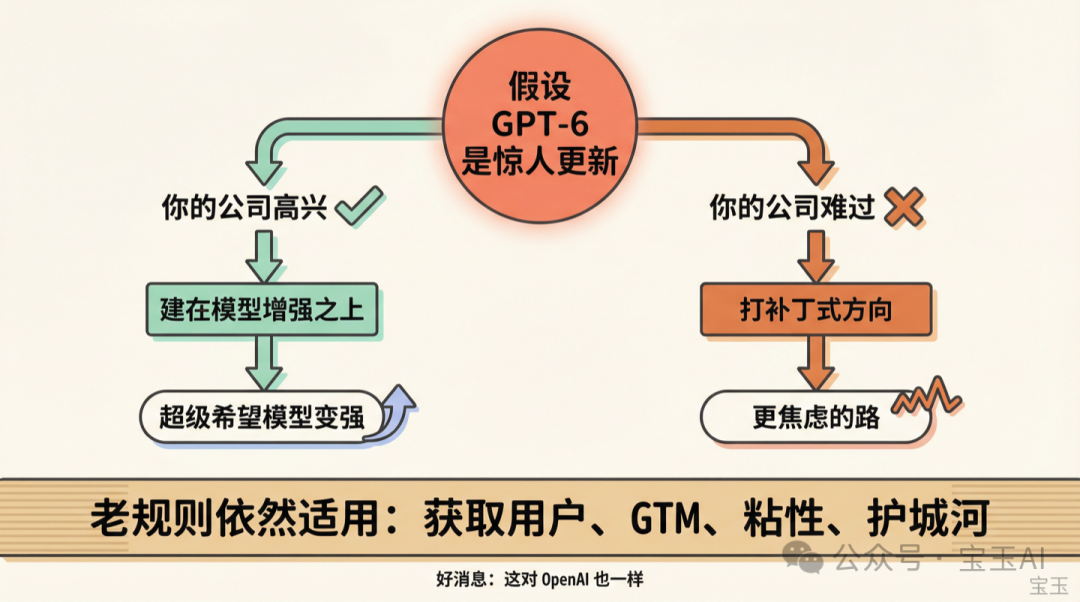

“很容易假設商業的物理定律完全變了,但其實還沒有。”Altman 說,“變的是你能更快地做東西、創造新軟件。但其他規則,獲取用戶、解決 GTM、提供粘性、有某種護城河,都沒變。”

“好消息是,這對我們也一樣。很多創業公司做了我們本應更早做的事,但太晚了,人們已經建立了持久優勢。”

他給出一個框架:"如果 GPT-6 是一次驚人的更新,你的公司會高興還是難過? 我鼓勵人們去做那種『超級希望模型變強』的東西。有很多這樣的機會。那些打補丁式的方向,如果你在模型升級前建立了足夠優勢也能成功,但這是一條更艱難、更焦慮的路。"

9. 自主 Agent 時間線

“能長時間自主運行工作流、不需要人類持續干預的 Agent,現實的時間線是什麼?”

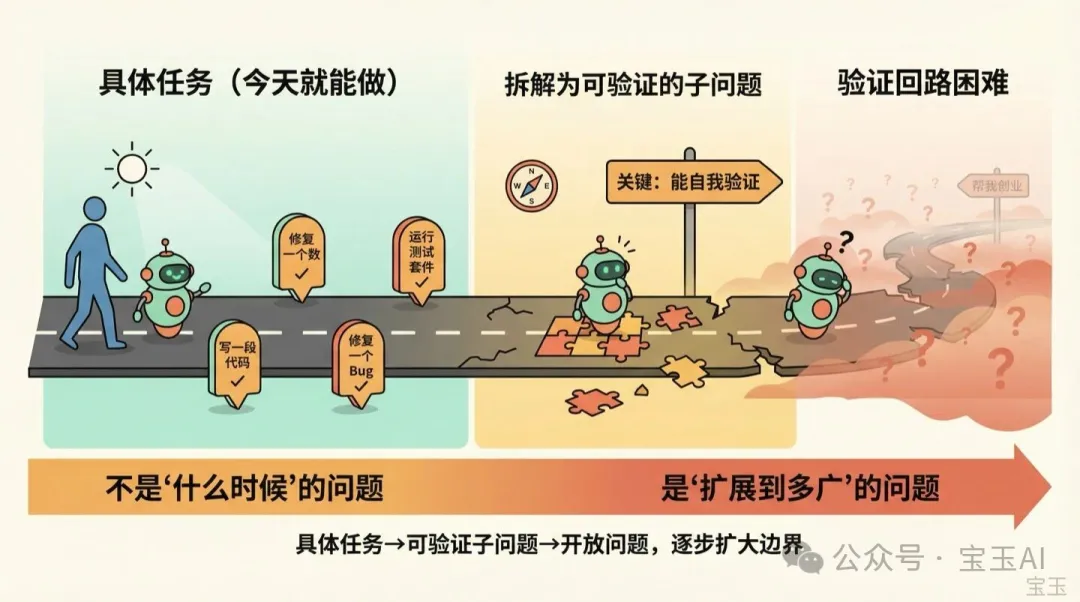

一位 OpenAI 員工回答:"這取決於任務類型。現在 OpenAI 內部就有人用特殊方式 prompt Codex,或者用 SDK 做自定義工具不斷讓它繼續,基本上能一直運行。所以這不是'什麼時候'的問題,而是'擴展到多廣'的問題。"

他建議:“如果你有一個非常具體、你理解得很透徹的任務,今天就試試。如果你想的是『讓模型幫我創業』這種開放問題,驗證迴路就難得多。想想怎麼把它拆解成 Agent 能自我驗證的子問題,然後逐步擴大它能做的事。”

10. 幫人想出好點子的工具

一位幫 AI 公司做 GTM 的從業者說,很多時候產品本身就不值得用戶關注。能不能做工具來提升人們想法的質量?

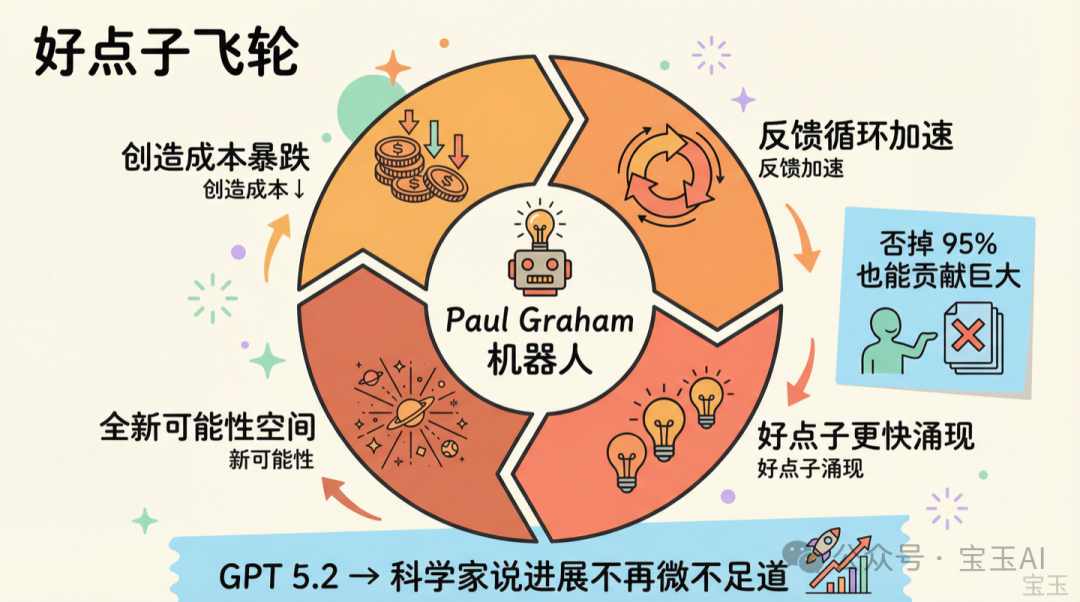

“人造的 slop(注水內容)也很多,不只是 AI 生成的。想出好的新點子一直很難。”Altman 說,"我越來越相信我們是在工具的邊界上思考。我們應該做工具來幫人想出好點子。"

他說隨着創造成本暴跌,反饋循環會變得極其緊密,好點子會更快被發現。“而且 AI 能發現新科學、寫複雜代碼庫,我相信一定有全新的可能性空間。”

他提到自己生命中遇到過三四個人,"每次跟他們聊完都帶着一堆點子離開。他們特別擅長提問,或者給你種子讓你發展。Paul Graham 在這方面簡直驚人。"

“如果我們能做出一個 Paul Graham 機器人,讓你能有同樣的互動來生成新點子,即使大多數是壞的,即使你否掉 95%,我覺得這會對世界上好東西的數量有很大貢獻。”

他透露 OpenAI 內部用的 GPT 5.2 特殊版本,"第一次讓科學家們說這些模型的科學進展不再是微不足道的了“。”我無法相信一個能產生新科學洞察的模型,不能用不同的方式來產生新產品洞察。"

11. 讓模型適應新技術

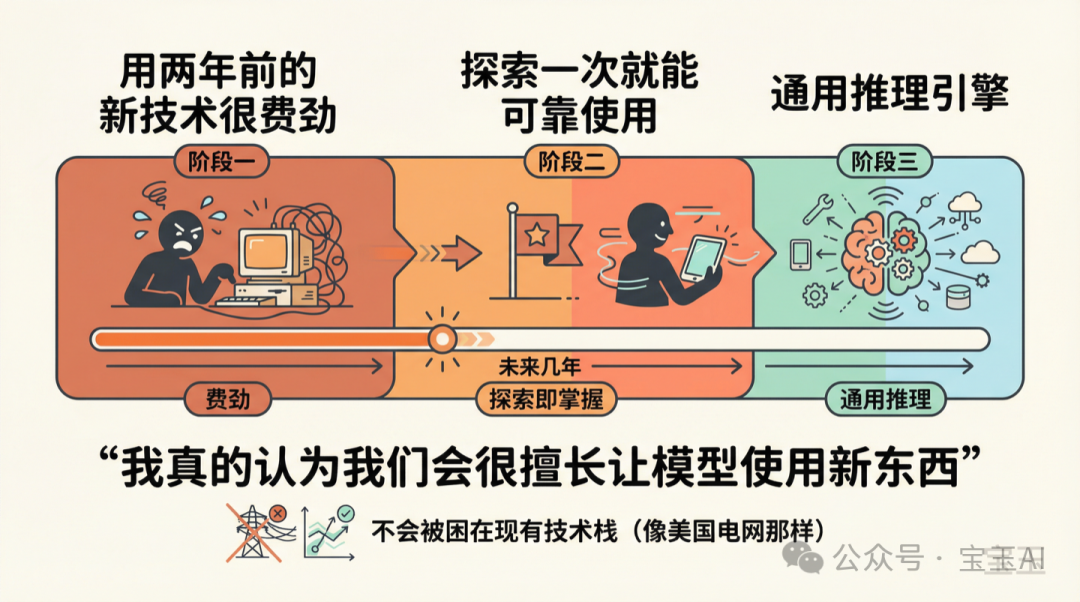

知名開發者 YouTuber Theo 問了個技術問題:他擔心隨着模型和工具變強,我們會被困在現有技術棧裏,就像美國電網那樣,想改也改不了。現在讓模型用兩年前的新技術都很費勁,以後會不會更難?

“我真的認為我們會很擅長讓模型使用新東西。”Altman 說,"如果我們正確使用這些模型,它們是通用推理引擎。現在的架構確實內置了大量世界知識,但我認為方向是對的。"

"一個我們會非常自豪的里程碑是:模型被展示一個全新環境、新工具、新技術,探索一次就能超級可靠地使用它。 這感覺不會太遠了,未來幾年吧。"

12. AI 做科研:從無限博士後到自動濕實驗室

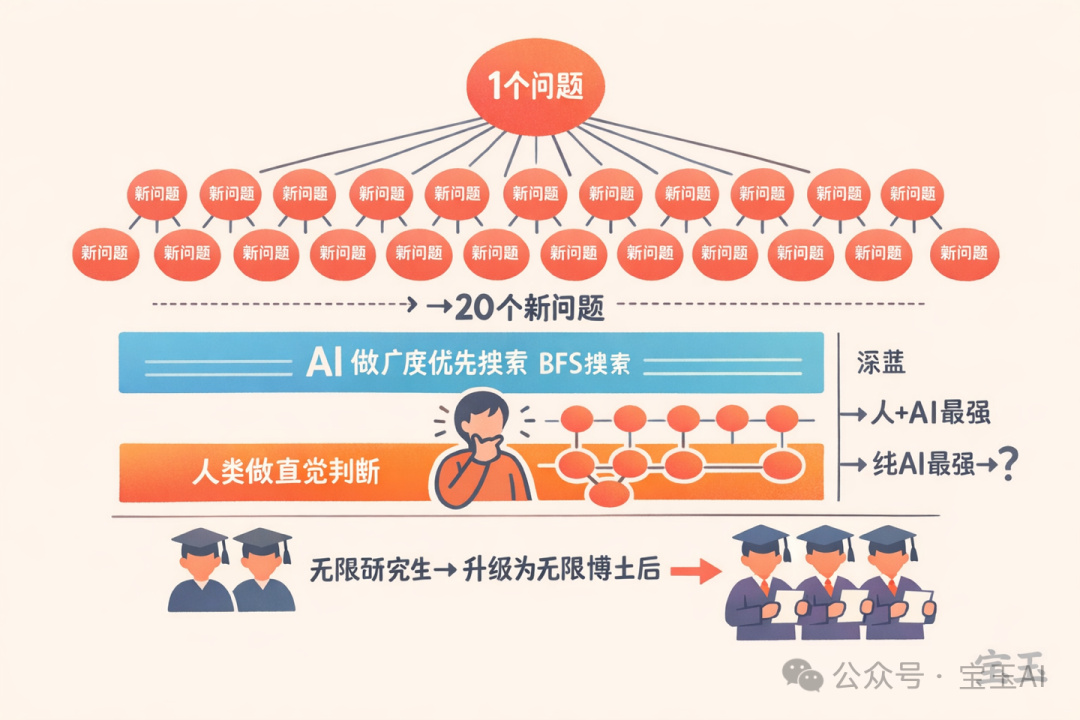

一位年長的科學家問:科研項目會呈指數級產生新問題,但科學家的時間是線性減少的。AI 能接管整個科研流程嗎?

“完全閉環的自主研究,在大多數領域還相當遙遠。”Altman 說,“拿數學來說,不需要濕實驗室或物理輸入,也許能靠純思考取得很大進展。但現在用模型做數學進展最快的人,仍然深度參與看中間結果,說『這個感覺不對,我直覺覺得另一條路更好』。”

他提到見過幾位數學家,現在整天都在跟最新模型協作,進展很快,但他們做的事跟模型做的非常不同。

"老實說,這讓我想起國際象棋史上那個階段:深藍打敗卡斯帕羅夫,然後有一段時間人類加 AI、人類從 AI 的 10 步棋中選最好的那步,比純 AI 更強,但很快 AI 又超過了,人類反而在幫倒忙。"

“我覺得很多研究領域會發生類似的事。事情會變得太複雜,AI 能理解多步驟的東西比所有人都強。但現在這代模型在創造力、直覺、判斷力上,我們還差得很遠。我想不出任何原則性障礙說我們到不了那兒,所以我假設我們會到。但現在不是讓 GPT-6 去解決數學就行的狀態。”

關於有效的科研工作流,他提到:"現在能跑起來的方式是,你解決一個問題,它打開 20 個新問題,然後用 AI 做廣度優先搜索,不在任何一個上深入。有人把這形容為'無限研究生'。我最近把他們升級成了'無限博士後'。"

他還透露 OpenAI 內部“反覆討論是否應該為各學科建自動化濕實驗室”。但看到科學界對 GPT 5.2 的擁抱程度和貢獻數據的意願,“也許讓世界來做實驗、提供設備更好,更分佈式、更多聰明人、更多不同設備”。

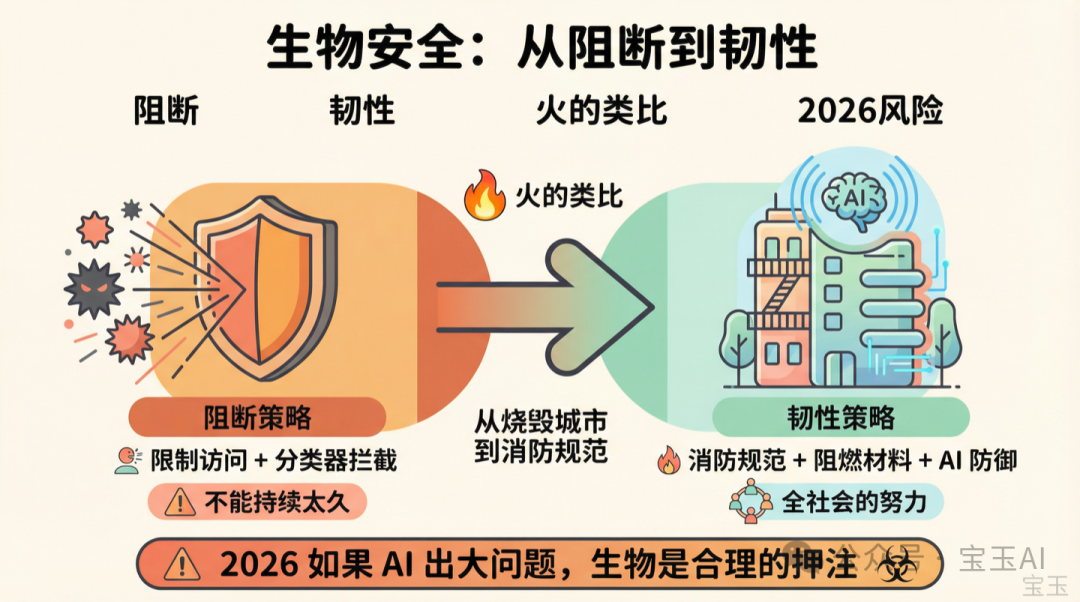

13. 生物安全與韌性策略

一位斯坦福學生在做生物安全創業,她問:安全在 OpenAI 2026 路線圖中佔什麼位置?

“2026 年 AI 可能出問題的方式很多,我們相當緊張的一個是生物。”Altman 說,“模型在生物方面相當強。現在大部分策略是限制誰能訪問、用分類器阻止人們製造新型病原體。”

"我不認為這能持續太久。"

他說世界需要從“阻斷”轉向“韌性”。"我聯合創始人 Voychuk 有個我很喜歡的類比:火為社會做了很多好事,然後開始燒燬城市。 我們試圖各種限制火,我剛知道 curfew(宵禁)這個詞就是來自不允許生火的年代,然後我們學會了韌性,有了消防規範、阻燃材料等等。現在社會在這方面做得很好了。"

Altman 的詞源說法是準確的。Curfew 來自古法語 couvre-feu,意為“蓋火”,中世紀歐洲要求在晚鐘響起後熄滅或覆蓋爐火,以防木結構房屋引發大火。

“我認為 AI 需要同樣思考。AI 會成為生物恐怖主義的真正問題,會成為網絡安全的真正問題,但 AI 也是這些問題的解決方案。我們需要全社會的努力來建設這種韌性基礎設施,不是靠我們信任的實驗室永遠阻斷它們該阻斷的東西。”

"如果今年 AI 出了可見的大問題,我認為生物是一個合理的押注。然後到明年和後年,你可以想象很多其他事情也會出大問題。"

14. 教育與人機協作

一位參加過 ChatGPT 教育實驗室的學生問:如果 AI 能回答一切,為什麼還要花時間、承受摩擦去問真人?人類協作會怎樣?

“我比你們大多數人老多了,但我也是在 Google 出來的時候上中學的。”Altman 說,"老師試圖讓孩子們保證不用它,因為覺得如果什麼都能查到,為什麼還要上歷史課、背任何東西。我當時覺得這完全瘋了。我想的是:我會變得更聰明,學得更多,做得更多,這是我成年後會用的工具。"

“我對 AI 工具的感覺一樣。我理解在當前教學方式下 AI 工具是個問題,但這說明我們需要改變教學方式,而不是假裝可以讓 ChatGPT 幫你寫東西的世界不存在。”

他說寫作的練習對學習思考很重要,“但我們評估思考能力的方式應該改變了”。

關於協作,他說目前沒有證據表明 AI 在破壞人際連接,"但我懷疑在充滿 AI 的世界裏,人類連接會變得更有價值而不是更少"。

他透露 OpenAI 在思考自己的硬件和設備時,“甚至可能首先想的是多人加 AI 的協作體驗會是什麼樣”。

“雖然還沒人完全搞定,但我們會驚訝於 AI 能以其他技術從未實現的方式支持協作。你可以有五個人圍坐在桌邊,一個小機器人也在那兒,作為一個團隊你們的生產力會高得多。每次頭腦風暴、每次解決問題,都會有 AI 參與,幫助團隊做得更好。”

15. Agent 在生產環境的失敗模式

一位開發者問:隨着 Agent 進入生產系統,最被低估的失敗模式是什麼?

“到處都是問題。”Altman 說,“讓我個人驚訝的一件事是,當我第一次用 Codex 時,我說:我不知道會怎樣,但我絕對不會給這東西無監督訪問我的電腦。我對此超級自信。”

"結果我大概撐了兩個小時。"

“然後我就想:這東西看起來很合理,它做的事都很合理,我討厭每次都批准這些命令,我就開一會兒看看會怎樣。然後我再也沒關掉全權限。我覺得其他人也有類似經歷。”

他說這正是他擔心的:"這些工具的能力和便利性太高,失敗率也許是災難性的,但頻率太低,我們會滑入『yolo 吧希望沒事(管他呢先用着再說)』的狀態。"

“然後模型變得更強、更難理解它在做什麼,如果模型有對齊問題,如果幾周或幾個月的使用後出現複雜問題,你在做的東西里埋了安全漏洞……”

"我擔心的是,採用這些工具的壓力,不只是壓力,是快感和能力,會太強,人們會被拉着走,不夠認真地想他們怎麼運行這些東西、他們設的沙箱到底安不安全。能力會急劇上升,我們會習慣模型在某個水平的表現然後決定信任它們,而沒有建立很好的安全基礎設施,我們會夢遊進某種狀態。"

“這會是一個很好的創業方向。”

16. 幼兒與技術

一位 UC Berkeley 認知科學學生問:作為父親,Altman 怎麼看 AI 在幼兒園和小學教育中的角色?

"總體來說,我支持讓電腦遠離幼兒園。“Altman 說,”幼兒園的孩子應該在外面跑、玩實物、學習跟人互動。不只是 AI,我不會在大多數幼兒園放電腦。"

“我們仍然不完全理解技術對幼兒的影響。社交媒體對青少年的影響已經寫了很多,看起來相當糟糕。但我有種感覺,很多技術對幼兒的影響可能更糟得多,卻討論得相對很少。在我們更好理解之前,幼兒園的孩子大概不需要用太多 AI。”

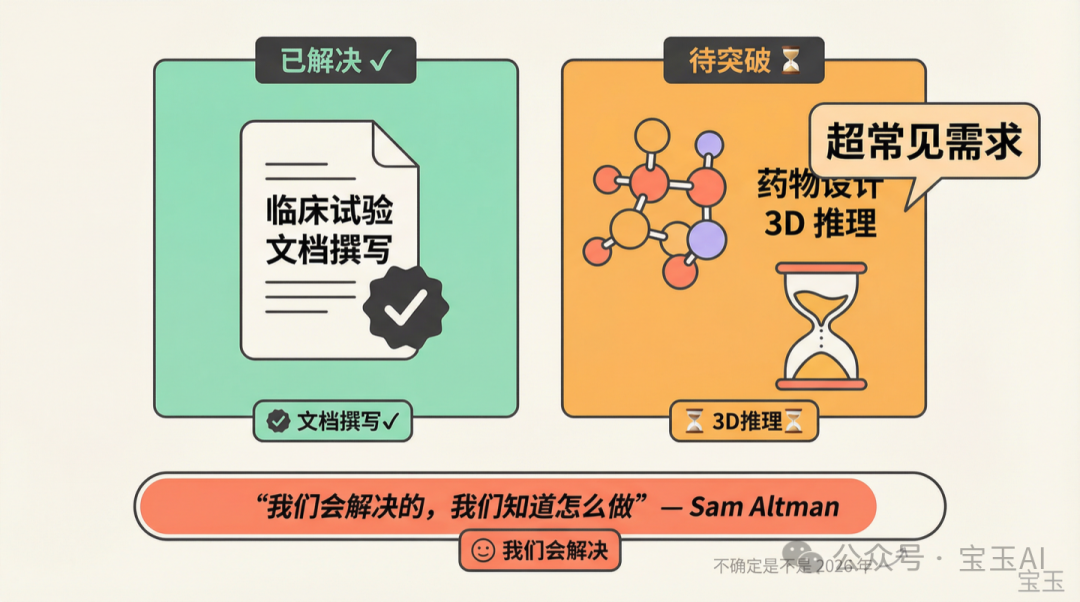

17. 3D 推理與生物醫藥

一位生物醫藥從業者說,生成式 AI 在臨牀試驗文檔撰寫上幫助很大,但在藥物設計、化合物的 3D 推理上遇到了瓶頸。

"我們會解決的。“Altman 說,”我不知道是不是 2026 年的事,但這是一個超常見的需求。我覺得我們知道怎麼做,只是有很多其他緊急的方向要推。"

18. 給輟學創業者的建議

一位剛從倫敦大學輟學加入 Y Combinator W26 批次的學生問:父母還在催他回去讀書,他該怎麼辦?順便問一句,Altman 還做天使投資嗎?

“我也從大學輟學了,我父母花了十年才停止問我什麼時候回去。”Altman 說,“父母就是這樣,他們愛你,試圖給你他們認為最好的建議。你就得一直跟他們解釋:你隨時可以回去,但世界現在不一樣了,以後會更不一樣。”

"每個人都得做自己的決定。我個人覺得,如果你是 AI 領域的建設者,現在大概不是待在大學裏的最佳時機。如果你是那種有野心、有行動力、有自驅力的人,這是一個不尋常的時期。你以後總可以回去的。"

至於天使投資:“我尊重這種拼勁,但不做了。OpenAI 太忙了,而且如果投的公司成了 OpenAI 大客戶,事情會變得奇怪。”

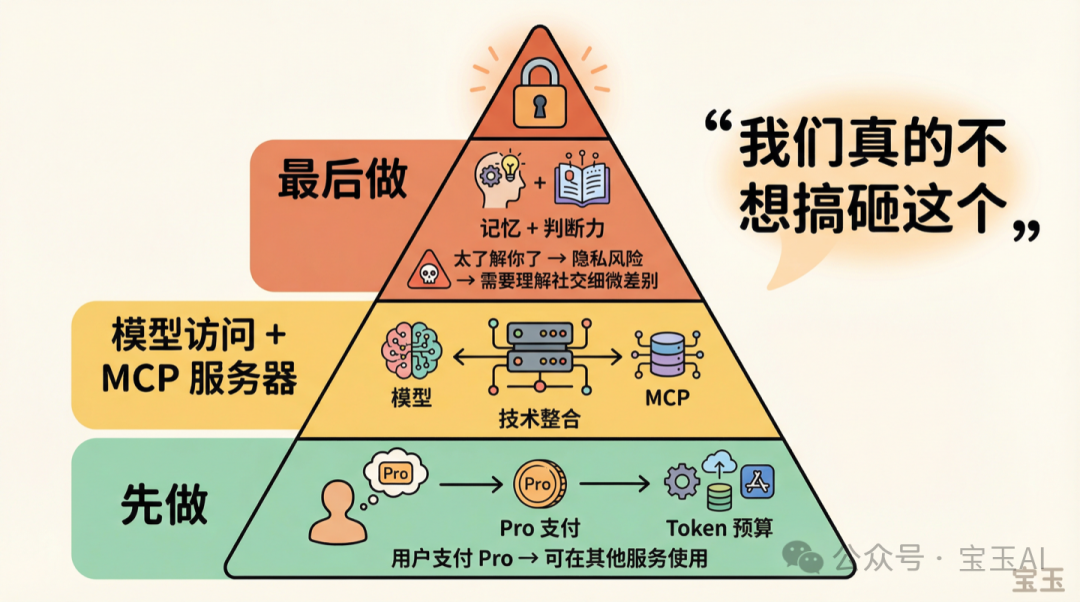

19. 身份認證與個性化

一位做身份認證的公司創始人提了個功能請求:Sign in with ChatGPT。

“我們會做的,很多人一直在問。”Altman 確認,“你們需要什麼?用戶帶自己的 token 預算?還是帶 ChatGPT 的記憶?”

對方回答:肯定要帶賬户和可用模型,但也想知道用戶的 MCP 服務器、ChatGPT 對他的記憶、他在做什麼項目。“ChatGPT 從工作和個人角度都太瞭解我了。”

“這很嚇人。”Altman 說,“因為 ChatGPT 確實太瞭解你了。如果你告訴一個親近的人很多秘密,你可以相信他們知道精確的社交細微差別,什麼時候跟誰分享什麼、什麼時候某件事覆蓋另一件事。”

“我們的模型還沒完全到那兒,雖然越來越好了。如果我把 ChatGPT 賬户連到一堆網站然後說『用你的判斷決定什麼時候分享你從我所有聊天記錄裏知道的關於我的信息』,我會覺得不舒服。”

"但等我們做到的時候,這顯然是個很酷的功能。現在至少可以先做 token 預算,如果我付了 Pro 版,就能在其他服務上用。我們會先做這個,然後想辦法把信息共享做對。我們真的不想搞砸這個。"

20. 招聘與面試的未來

一位開發者注意到 LinkedIn 上 OpenAI 還在招軟件工程師,問面試流程有什麼變化。

"我們會繼續招軟件工程師。但我們是第一次,我知道每家公司和每家創業公司都在想這個,我們計劃大幅放緩招聘速度,因為我們認為能用更少的人做更多的事。"

“我覺得我們不應該做的,也希望其他公司不要做的,是猛招人,然後突然發現 AI 能做很多事、需要更少的人,然後不得不進行非常不舒服的對話。正確的做法是招得慢一點,但繼續招。”

關於面試,他說“還沒有像應該的那樣改變”,但今天剛開過會討論這個。"我們基本上想讓你坐下來,給你一個去年這個時候一個人兩週都做不到的任務,然後看你 10 分鐘或 20 分鐘做完。"

“軟件工程面試一直很糟糕,可能不太相關,現在更不相關了。”

他還談到了一個更大的問題:未來是“公司有很多 AI 同事但人也不少”,還是“贏家公司完全是 AI、一架 GPU 沒有人”?

“我真的希望是前者。但如果公司不積極採用 AI,不弄清楚怎麼招能有效使用工具的人,最終會被純 AI 公司打敗,那種不需要應對阻止大公司用 AI 的愚蠢政策的公司。這對社會會是非常不穩定的事。”

"我們一直在想怎麼說這個,因為從我們嘴裏說出來聽起來像是為自己說話。但我認為公司快速、大規模採用 AI 非常重要。"

21. 創意身份與 AI 生成藝術

一位創作者和攝影師問:AI 改變了講故事的方式,也因此改變了我們看待自己的方式。人類創意身份和 AI 輔助創作的關係會怎樣發展?

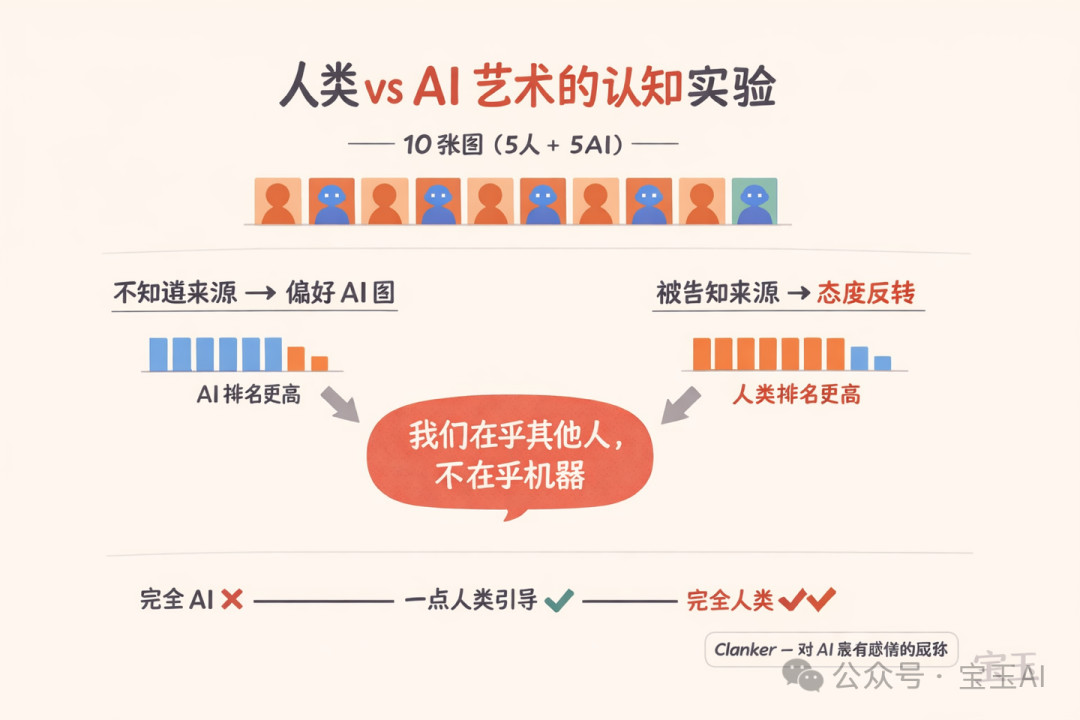

“我們能研究和學習最多的領域是圖像生成,它存在最久,創意社區對它又愛又恨。”Altman 說。

"有很多有趣的觀察,其中一個是:圖像的消費者報告說,如果被告知是人做的,他們的欣賞度、滿意度會高得多。"

“我認為這會是未來幾十年的一個深層趨勢:我們非常在乎其他人,我們不太在乎機器。在所有 AI 的蔑稱裏,clanker 是我最喜歡的一個,它太能喚起人們的情感反應了。”

Clanker 是近年來出現的對 AI 的貶義稱呼,意指 AI 只是“叮噹作響的金屬”。

他提到去年網上有個實驗:找那些說“我討厭 AI 生成的圖像,而且我能認出來,因為它們很爛”的人,給他們看 10 張圖,讓他們排名最喜歡的。一半是人做的,一半是 AI 做的。“相當一致地,他們把 AI 的排在前面。然後一被告知,他們就說:其實我不喜歡這個,這不是我想要的。”

“當我讀完一本我喜歡的書,第一件想做的事就是查作者、瞭解他們的人生、這本書是怎麼來的,因為我對這個不認識的人產生了連接感。如果我讀了一本很棒的小說,最後發現是 AI 寫的,我會有點傷心、有點失落。”

“然而,如果藝術哪怕只有一點點人類引導,多少算夠可能需要時間來搞清楚,人們似乎就沒有那麼強烈的情感反應。這類事已經持續很久了,數字藝術家用 Photoshop,人們仍然喜歡他們的作品。”

"我的預期是,根據我們現在從創作者和消費者那裏看到的行為,那個人、他們的人生故事、他們的編輯或策展,會非常重要。我們不會想要完全 AI 生成的藝術,至少從圖像領域能學到的是這樣。"

22. 個性化與數字生活訪問

一位舊金山州立大學畢業生問:個性化和記憶功能會怎麼演進?能不能有更細粒度的控制,比如分組記憶,這是我的工作身份,這是我的個人身份?

“我們會大力推進記憶和個性化,顯然人們想要它,它能讓工具好用得多。”Altman 說。

"我自己在這方面也有演變。現在我準備好讓 ChatGPT 看我整個電腦、整個互聯網,知道一切。價值太高了,我不再像以前那樣感到不舒服。"

“我真的希望所有 AI 公司都認真對待安全和隱私,也希望整個社會如此。因為效用太大了,AI 會知道我整個人生,我不會去阻礙這件事。我還沒準備好戴那種一直錄像的眼鏡,那出於各種原因還是不舒服。但我準備好說:你可以訪問我的電腦,搞清楚發生了什麼,對我有用,理解一切,擁有我數字生活的完美表徵。”

"我很懶,我覺得大多數用戶也很懶。我不想坐在那兒分組:這是工作記憶,這是個人記憶。我想要的,也是我相信可能的,是讓 AI 深刻理解我生活中複雜的規則、交互、層級,知道什麼時候用什麼、什麼時候暴露什麼。我們最好搞清楚這個,因為我覺得這是大多數用戶想要的。"

23. AI 時代最重要的技能

最後一個問題來自一位越南國際學校的學生:AI 時代最重要的技能是什麼?

"都是軟技能。“Altman 說,”沒有一個像『學編程』那樣明顯,那在近期一直是很明顯正確的事,現在不是了。"

"變得高能動性(high agency)、善於產生想法、非常有韌性、非常能適應快速變化的世界,我認為這些會比任何具體技能都重要。而且我認為這些都是可以學的。"

“做創業投資讓我驚訝的一件事是:你可以把人放進一個三個月的訓練營式項目,讓他們在所有這些維度上變得極其厲害。這對我是很大的認知更新。這些技能可能最重要,而且相當可學。”

尾聲

Town Hall 結束前,Altman 向在場開發者描繪了 OpenAI 的目標:100 倍更強的模型、100 倍的上下文長度、100 倍的速度、100 倍更低的成本、完美的工具調用、極致的長任務連貫性。

“告訴我們你們想要我們做什麼。我們是為你們做的,我們想做對。”

Altman 承認了 GPT-5 的失誤,承認了自己對 Agent 權限“兩小時破戒”的經歷,宣佈了招聘放緩,警告了生物安全風險,同時也展示了對個人數據開放到“整個數字生活”的新態度。對技術能力極度樂觀,對風險極度警覺;準備讓 AI 知道自己的一切,同時認為幼兒園不應該有電腦。這種張力,也許正是 AI 時代所有人都在經歷的狀態。