Voice-Pro全面開源免費,六步流水線,每一步都踩在主流引擎上

整理版優先睇

Voice-Pro全面開源免費,六步流水線整合主流引擎,提供一站式YouTube多語言配音

呢篇文章介紹咗一個叫Voice-Pro嘅開源項目,完全免費,專為YouTube影片提供多語言配音。作者abus-korea設計咗一個六步流水線:一鍵下載、去除人聲、轉錄、翻譯、聲音克隆同重新配音。每個步驟都用了業界主流嘅開源引擎,例如yt-dlp、Demucs、Whisper、F5-TTS等。呢個工具嘅目標係令個人創作者同小團隊可以零門檻試錯,唔使俾昂貴嘅ElevenLabs月費。

不過,免費唔等於零成本。Voice-Pro需要NVIDIA顯卡,CosyVoice2模型約9GB,首次下載可能超過一個鐘。另外,翻譯同部分語音合成依賴在線API(Deep-Translator同Edge-TTS),斷網就唔用得。想完全離線就要自己替換成本地模型,門檻會高啲。整體嚟講,硬件同網絡條件有要求,但對於有GPU嘅用戶,呢個工具的確係免費午餐。

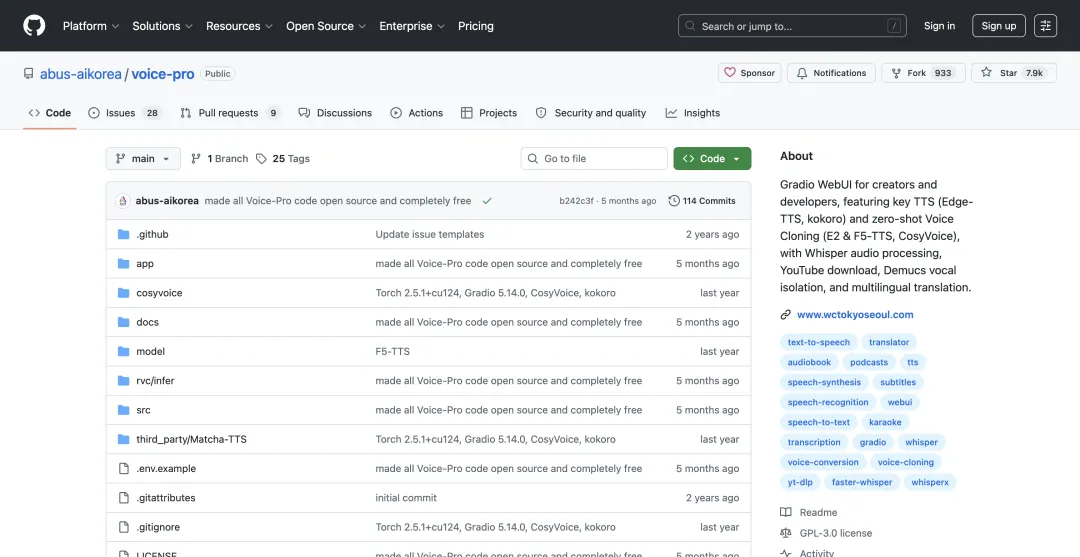

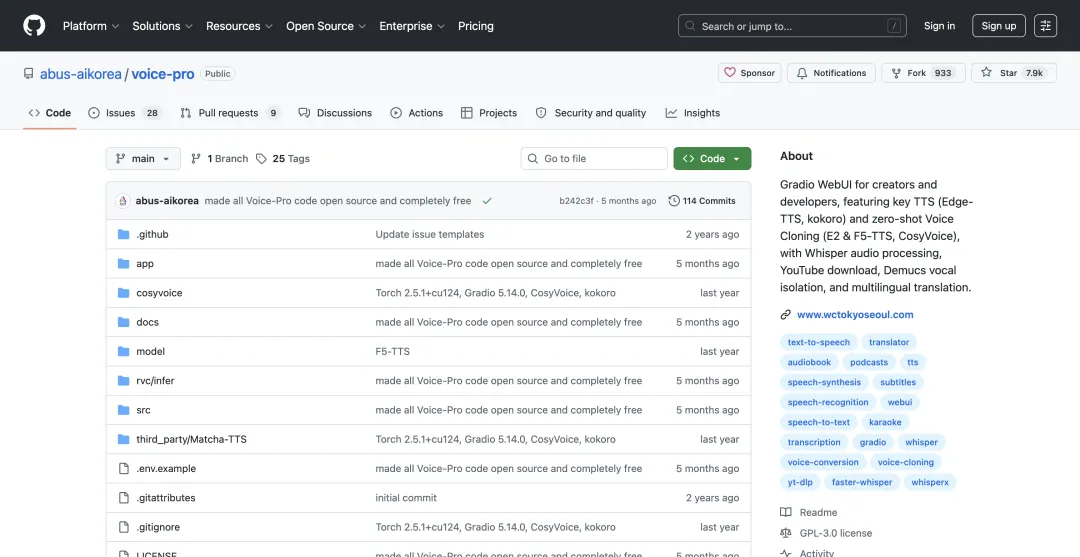

開源社羣對呢個項目反應熱烈,GitHub上有7.9k star。雖然開發者暫時停止咗開發,但係代碼已經完全以LGPL協議開源,社羣仲持續提交PR,修復bug同加入Linux支援。對比商業工具ElevenLabs,Voice-Pro冇唇形同步功能,但係免費同開源係佢嘅最大武器,慢慢撬動緊定價。

- Voice-Pro整合六步流水線,每個環節都用咗業界主流開源引擎,完全免費開源。

- 硬件門檻唔低:需要NVIDIA顯卡,CosyVoice2模型約9GB,首次下載可能要一個鐘。

- 部分功能依賴在線API,想完全離線可以替換成本地模型,但門檻會提高。

- 早期有授權爭議,v3.2以LGPL全面開源,社羣積極貢獻,Linux支援已加入。

- 對比ElevenLabs免費但冇唇形同步,適合個人創作者同小團隊,刀係免費+開源。

Voice-Pro GitHub

項目主頁,包含代碼、文檔同使用說明

六步流水線:主流引擎一覽

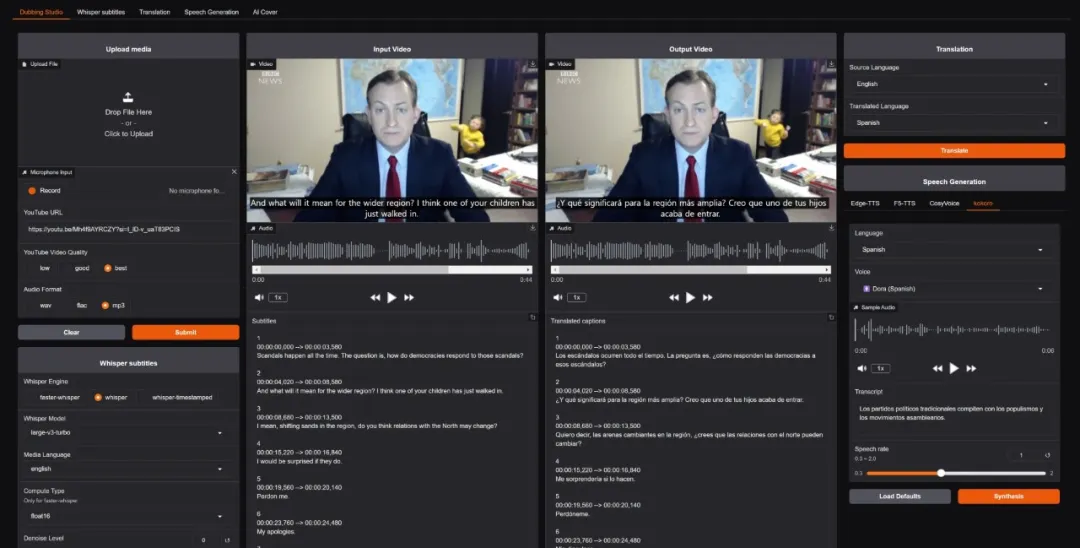

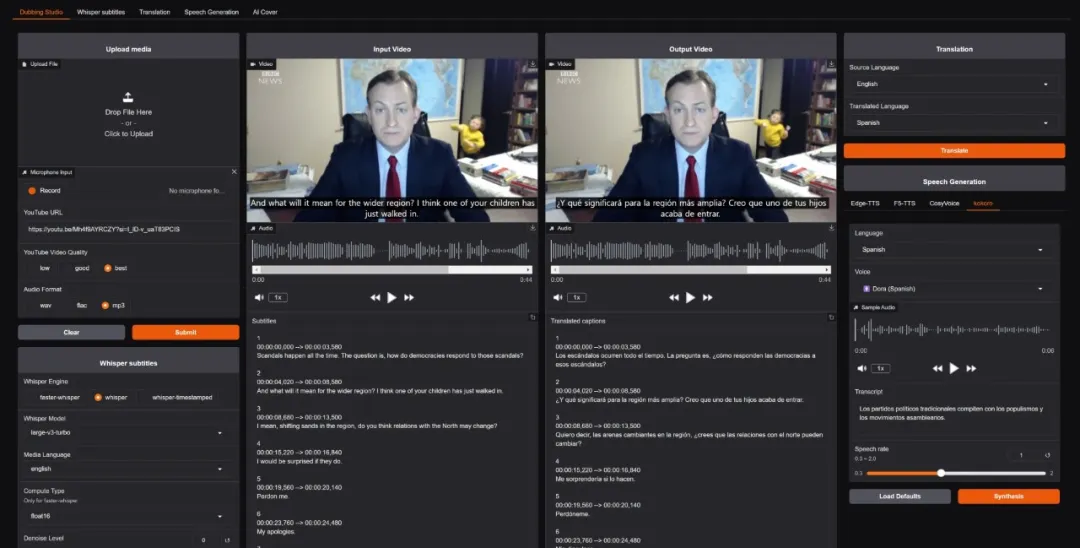

Voice-Pro將多語言配音拆成六個步驟,每個步驟都對接了業界最常用嘅開源方案,唔使自己逐個揾。

下載用yt-dlp,分離人聲用Demucs,轉錄用Whisper,翻譯用Deep-Translator,聲音克隆用F5-TTS或CosyVoice,語音合成用Edge-TTS或kokoro。

- 1 下載影片:用yt-dlp,YouTube下載嘅標配工具,GitHub 40k+ star。

- 2 人聲分離:用Meta開源嘅Demucs,HDC Seps模式專門處理流行音樂,效果比傳統算法好。

- 3 語音轉錄:用OpenAI嘅Whisper家族,支援Faster-Whisper、Whisper-Timestamped、WhisperX,可按需取捨精度同速度。

- 4 翻譯原文:用Deep-Translator,封裝Google Translate、DeepL、Microsoft Translator等接口,支援100多種語言,免費但需要連線。

- 5 聲音克隆:用F5-TTS或CosyVoice,零樣本克隆,畀幾秒音頻就模仿到音色同語調,Fine-tuned模型覆蓋十大語種。

- 6 語音合成:用Edge-TTS(微軟在線接口,400多種聲音)或kokoro(HuggingFace TTS Arena排名第二嘅開源引擎,完全本地),付費用戶可解鎖Azure TTS。

免費嘅代價:硬件同網絡要求

雖然Voice-Pro完全免費,但唔代表零成本。首先要有NVIDIA顯卡,因為底層要用PyTorch 2.5同CUDA 12.4。

CosyVoice2-0.5B模型約9GB,首次下載耗時一小時以上。

消費級RTX 4090已經夠跑推理,唔需要訓練級算力。

另外,翻譯同語音合成兩個環節依賴在線服務。Deep-Translator封裝咗Google Translate等API,Edge-TTS調用微軟雲端接口,斷網就用唔到。

想完全離線,可以自己將Deep-Translator換成本地翻譯模型,Edge-TTS換成kokoro,但就唔係一鍵搞掂喇。

開源爭議同社羣信任

Voice-Pro喺Hacker News上引發過唔少爭議,主要集中喺定性問題。

有用戶質疑佢用Edge-TTS係「借用Microsoft Edge嘅API key」,微軟法務隨時可以追責。

亦有人話安裝腳本畀Windows Defender報木馬,README嘅試用說明埋得太深,感覺有可疑。

早期版本授權表述模糊,但v3.2最終以LGPL全面開源,爭議先畫上句號。而家代碼全公開,PR審核透明,開發者嘅YouTube頻道有多個示範影片。

開源社區嘅信任機制,有時比商業公司嘅合規聲明更實在。

社羣接棒:從Issue到官方支援

GitHub上曾經有個Issue標題「Ubuntu Support」,得12個reaction。開發者忙其他嘢冇時間理,但社區自己搞掂。

2026年4月28日,Melancbot提交咗Linux綜合補丁,仲順手修咗YouTube下載器失效、VAD路徑錯誤、Gradio 5.x兼容性等多個問題。

PR描述寫:「呢個係個好程式,我好需要一個配音工具,所以我整返好佢。」用Kimi Code修嘅。

之後v3.2正式支援Windows、Mac、Linux。一個頂咗12次嘅Issue,從社區呼聲變成官方功能。

開源vs商業:差距與啟發

Voice-Pro唔係唯一嘅開源配音工具,但以7.9k star獨佔鰲頭。商業端ElevenLabs係絕對頭部,月費5-99美元,有唇形同步同API穩定性。

Voice-Pro冇唇形同步,只做音頻。但對於個人創作者同內容出海,完全免費意味住零門檻試錯。

ElevenLabs嘅護城河係質量+穩定性+生態;Voice-Pro嘅刀係免費+開源。呢把刀慢慢撬動緊定價。

做YouTube影片嘅人,成日俾多語言配音搞到好頭痕。

外包好貴,ElevenLabs每個月要22美金起跳,自己搞AI模型門檻又高。

而家GitHub上有個項目,將呢件事做到免費。

Voice-Pro,有7.9k粒星。一鍵下載YouTube影片,抽走人聲,轉錄,翻譯,克隆原聲,重新配音。六個步驟,一個界面,一撳就搞掂。

完全開源,完全免費。LGPL協議,任你改,任你用。

啲Code係真嘅。技術棧係真嘅。7.9k粒星都係真嘅。

Voice-Pro嘅pipeline設計唔複雜,但每個環節都用咗業界最常用嘅方案。

yt-dlp 下載影片,呢個係YouTube下載嘅標配工具,GitHub有40k+粒星。Demucs 分離人聲同伴奏,Meta開源嘅音頻分離模型,有30k+粒星,HDC Seps模式專門處理流行音樂嘅人聲去除,效果比傳統算法好一截。Whisper 轉錄原文,OpenAI嘅Whisper家族,支援Faster-Whisper、Whisper-Timestamped、WhisperX三個變體,精度同速度可以按需要取捨。

翻譯走 Deep-Translator,封裝咗Google Translate、DeepL、Microsoft Translator等接口,支援100幾種語言。免費,但要靠線上API。

跟住係核心環節——聲音克隆。F5-TTS 和 同CosyVoice,都係零樣本克隆,唔需要額外訓練,俾幾秒鐘原始音頻,直接模仿音色同語調。Fine-tuned嘅模型涵蓋英語、中文、日語、韓語、法語、西班牙語、俄語等十大語種。

最後係語音合成,Edge-TTS 和 同kokoro 兩個免費引擎可以揀。Edge-TTS調用微軟線上接口,支援100幾種語言,400幾種聲;kokoro係HuggingFace TTS Arena排名第二嘅開源引擎,完全喺本地行。付費用戶仲可以解鎖Azure TTS。

六個環節串埋一齊,一個 Gradio 5.14 Web UI,全程自動化。用戶只需要將YouTube連結貼上去,揀目標語言,撳開始。

底層係Python 3.10 + PyTorch 2.5,CUDA 12.4。硬件門檻:需要有NVIDIA顯卡。CosyVoice2-0.5B模型大約9GB,第一次下載可能要成個鐘以上。

消費級RTX 4090就夠行。訓練級算力唔需要,淨係做推理就得。

"完全免費"係真,但"零成本"就唔係

Voice-Pro喺X上面傳播嗰陣,最熱嘅講法係"100%本地行,完全免費"。

v3.2版本出咗之後,呢個講法基本上成立咗。開發者明確宣佈:所有Code開源(LGPL),完全免費,可以自由分發同修改。

但"免費"同"零成本"係兩回事。

硬件門檻唔低。 底層係Python 3.10 + PyTorch 2.5 + CUDA 12.4,需要有NVIDIA顯卡。CosyVoice2-0.5B模型大約9GB,第一次下載要成個鐘以上。冇GPU,行唔鬱。

部分環節仲要靠線上服務。 翻譯用Deep-Translator,本質係Google Translate等線上服務嘅封裝。Edge-TTS調用微軟嘅雲端接口。Code係本地嘅,但翻譯同語音合成兩步,斷咗網就做唔到。

想完全離線?可以將Deep-Translator換成本地翻譯模型,Edge-TTS換成kokoro。自主權完全喺自己手,但已經唔係"一鍵"搞掂。

Azure TTS同Azure Translator仍然係要俾錢嘅高級選項。但對大部分用戶嚟講,Edge-TTS + kokoro + 本地模型已經夠用。

免費午餐係有嘅。不過你自己要先買張枱。

HN上面嘅靈魂拷問

Voice-Pro喺Hacker News上出過三次Show HN。留言區嘈得最勁嘅,唔係功能,而係定性。

一位叫 gpm 有啲用戶直接開火:MIT協議喺repo入面擺咗喺度,但佢用嘅Edge-TTS,本質上係"借用Microsoft Edge嘅API key",微軟法務隨時可以追究。一位叫 baystep 嘅用戶仲直接:安裝要行bat script,Windows Defender仲會報木馬,README入面提過一句30分鐘試用,但收得好埋——"just feels suspicious to me"。

仲有用戶 codetrotter 質疑"開源"兩個字:早期README寫嘅係demo,Code係咪完整,有冇閉源組件喺運行時下載?

呢啲爭議唔係空穴來風。早期版本確實有授權表述模糊嘅問題。v3.2最終以LGPL協議全面開源,爭議先至算畫咗句號。

但講返轉頭,7.9k粒星嘅項目,Code全部喺GitHub,PR公開審核,Issue透明討論。開發者嘅YouTube頻道有好多個完整嘅示範影片,由韓語→德語、英語→中文都有實際效果展示。

有用戶直接喺Issue度寫:"請問有字幕轉語音嗎?呢個功能如果有嘅話絕對王炸。"——呢啲係真實需求,唔係水軍。

開源社區嘅信任機制,有時比商業公司嘅合規聲明更實在。

開發停咗,項目冇死

abuskorea喺GitHub上明確表示,而家重心喺另一個項目 WeConnect 上面,Voice-Pro "暫時冇辦法繼續開發同更新"。

但喺2026年初推出嘅v3.2版本入面,開發者做咗一個重要決定:將所有Code完全開源,取消收費限制,改用LGPL協議。

項目由一個"停更嘅商業工具"變成一個"真正嘅開源項目"。

但GitHub上面嘅活動冇停過。

2026年4月21日,一位叫 octo-patch 嘅用戶修咗Demucs子進程崩潰檢測。4月28日,另一位叫 Melancbot 嘅用戶提交咗綜合補丁——YouTube下載器失效、VAD路徑錯誤、Gradio 5.x相容性、安裝腳本構建失敗、torchaudio缺失、cmake配置問題,同埋:Linux支援。

PR描述入面一句話:"This is a great program, I needed badly a dubber, so I got it fixed."

用Kimi Code修嘅。

同一日,octo-patch仲修咗Azure SDK相容性問題。5月4日——就係今日——仲有用戶喺度提Turkish語言支援嘅Issue。

一個開發停咗半年嘅項目,靠社區維持住活躍。呢啲情況喺AI工具領域唔算常見。

大部分開源AI項目,作者一停,star升勢就放慢。Voice-Pro嘅star曲線冇斷崖式下跌。

社區接棒:由12個👍到官方支援

GitHub上曾經有個Issue,標題得四個字——"Ubuntu Support"。

12個reaction,10個👍,2個🚀。開發者忙緊WeConnect,冇時間理。

社區冇等。4月28日,Melancbot提交咗Linux綜合補丁(詳情睇上節)。v3.2隨後正式宣佈支援Windows、Mac、Linux。

一個被頂咗12次嘅Issue,由社區呼聲變成官方功能。

開源社區對跨平台支援嘅渴望,遠比商業公司想像嘅更強烈。Windows獨佔?Linux用戶自己修,修到開發者直接採納。

開源 vs 商業,差距喺收窄

Voice-Pro唔係唯一嘅開源配音工具。GitHub上仲有AutoDub、Pollyduble、AI Video Dubbing,但star數都係10到幾十之間。

Voice-Pro以 7.9k star 獨佔鰲頭。功能最完整,文檔最齊,UI最成熟。

商業方面,ElevenLabs係絕對龍頭。月費5到99美金,企業版另計。優勢在於語音質量、唇形同步、API穩定性。Voice-Pro冇唇形同步——佢淨係做音頻,唔做影片對口型。

但對個人創作者、小團隊、內容出海需求嚟講,完全免費意味住零門檻試錯。幫YouTube影片做個多語言版本,幫TikTok短影片加個配音,Voice-Pro夠用。

ElevenLabs嘅護城河係質量 + 穩定性 + 生態。Voice-Pro嘅刀係:免費 + 開源。

呢把刀,正在慢慢撬動定價。

ElevenLabs每個月收費,開源社區直接免費供應。

開源嘅武器,從來唔係Code本身。係社區願意為佢續命嘅意願。

Voice-Pro開發停咗,Code開源咗,star仲喺度升。社區仲喺度修bug,仲喺度提feature,Linux支援都有埋。

下一個PR,可能就係你嘅。

Voice-Pro項目地址:https://github.com/abus-aikorea/voice-pro

Macaron 🧁 | ElevenLabs每個月收費,開源社區直接免費供應。

做 YouTube 視頻的人,苦多語言配音久矣。

外包貴,ElevenLabs 月費 22 美元起步,自己折騰 AI 模型門檻高。

現在 GitHub 上有個項目,把這事兒幹到了免費。

Voice-Pro,7.9k star。一鍵下載 YouTube 視頻,去掉人聲,轉錄,翻譯,克隆原聲,重新配音。六個步驟,一個界面,點擊即跑。

完全開源,完全免費。LGPL 協議,隨便改,隨便用。

代碼是真的。技術棧是真的。7.9k star 也是真的。

Voice-Pro 的 pipeline 設計不復雜,但每個環節都接了業界最常用的方案。

yt-dlp 下載視頻,這是 YouTube 下載的標配工具,GitHub 40k+ star。Demucs 分離人聲和伴奏,Meta 開源的音頻分離模型,30k+ star,HDC Seps 模式專門處理流行音樂的人聲去除,效果比傳統算法好一截。Whisper 轉錄原文,OpenAI 的 Whisper 家族,支持 Faster-Whisper、Whisper-Timestamped、WhisperX 三個變體,精度和速度可以按需取捨。

翻譯走 Deep-Translator,封裝了 Google Translate、DeepL、Microsoft Translator 等接口,100 多種語言。免費,但依賴在線 API。

然後是核心環節——聲音克隆。F5-TTS 和 CosyVoice,都是零樣本克隆,不需要額外訓練,給幾秒鐘原始音頻,直接模仿音色和語調。Fine-tuned 模型覆蓋英語、中文、日語、韓語、法語、西班牙語、俄語等十大語種。

最後是語音合成,Edge-TTS 和 kokoro 兩個免費引擎可選。Edge-TTS 調用微軟在線接口,100 多種語言,400 多種聲音;kokoro 是 HuggingFace TTS Arena 排名第二的開源引擎,完全本地運行。付費用戶還可以解鎖 Azure TTS。

六個環節串起來,一個 Gradio 5.14 Web UI,全程自動化。用戶只需要把 YouTube 連結粘貼進去,選目標語言,點擊開始。

底層是 Python 3.10 + PyTorch 2.5,CUDA 12.4。硬件門檻:需要 NVIDIA 顯卡。CosyVoice2-0.5B 模型約 9GB,首次下載可能耗時一小時以上。

消費級 RTX 4090 夠跑。訓練級算力不需要,推理就行。

"完全免費"是真的,但"零成本"不是

Voice-Pro 在 X 上傳播時,最火的說法是"100% 本地運行,完全免費"。

v3.2 版本發佈後,這個說法基本成立了。開發者明確宣佈:所有代碼開源(LGPL),完全免費,可自由分發和修改。

但"免費"和"零成本"是兩回事。

硬件門檻不低。 底層是 Python 3.10 + PyTorch 2.5 + CUDA 12.4,需要 NVIDIA 顯卡。CosyVoice2-0.5B 模型約 9GB,首次下載耗時一小時以上。沒有 GPU,跑不動。

部分環節仍依賴在線服務。 翻譯用的 Deep-Translator,本質是 Google Translate 等在線服務的封裝。Edge-TTS 調的是微軟的雲端接口。代碼是本地的,但翻譯和語音合成兩步,斷網跑不了。

想徹底離線?可以把 Deep-Translator 換成本地翻譯模型,Edge-TTS 換成 kokoro。自主權全在自己手裏,但已經不是"一鍵"了。

Azure TTS 和 Azure Translator 仍是付費高級選項。但對於大多數用戶,Edge-TTS + kokoro + 本地模型已經夠用。

免費午餐存在了。只是你自己得先買張桌子。

HN 上的靈魂拷問

Voice-Pro 在 Hacker News 上發過三次 Show HN。評論區吵得最兇的,不是功能,是定性。

一位叫 gpm 的用戶直接開炮:MIT 協議在 repo 裏放着,但它用的 Edge-TTS,本質上是"借用 Microsoft Edge 的 API key",微軟法務隨時可以追責。一位叫 baystep 的用戶更直接:安裝要跑 bat 腳本,Windows Defender 還會報木馬,README 裏提了一嘴 30 分鐘試用,但埋得很深——"just feels suspicious to me"。

還有用戶 codetrotter 質疑"開源"二字:早期 README 寫的是 demo,代碼是否完整,是否有閉源組件在運行時下載?

這些爭議不是空穴來風。早期版本確實存在授權表述模糊的問題。v3.2 最終以 LGPL 協議全面開源,爭議才算畫上句號。

但話說回來,7.9k star 的項目,代碼全在 GitHub,PR 公開審核,Issue 透明討論。開發者的 YouTube 頻道有多個完整的演示視頻,從韓語→德語、英語→中文都有實際效果展示。

有用戶直接在 Issue 裏寫:"請問有字幕轉語音嗎?這個功能要是有絕對王炸。"——這是真實需求,不是水軍。

開源社區的信任機制,有時候比商業公司的合規聲明更實在。

開發停了,項目沒死

abuskorea 在 GitHub 上明確表示,目前重心在另一個項目 WeConnect 上,Voice-Pro "暫時無法繼續開發和更新"。

但在 2026 年初發布的 v3.2 版本中,開發者做了一個重要決定:將所有代碼完全開源,取消付費限制,改用 LGPL 協議。

項目從一個"停更的商業工具"變成了一個"真正的開源項目"。

但 GitHub 上的活動沒停。

2026 年 4 月 21 日,一位叫 octo-patch 的用戶修了 Demucs 子進程崩潰檢測。4 月 28 日,另一位叫 Melancbot 的用戶提交了綜合補丁——YouTube 下載器失效、VAD 路徑錯誤、Gradio 5.x 兼容性、安裝腳本構建失敗、torchaudio 缺失、cmake 配置問題,以及:Linux 支持。

PR 描述裏一句話:"This is a great program, I needed badly a dubber, so I got it fixed."

用 Kimi Code 修的。

同一天,octo-patch 還修了 Azure SDK 兼容性問題。5 月 4 日——就是今天——還有用戶在提 Turkish 語言支持的 Issue。

一個開發暫停半年的項目,靠社區維持着活躍。這在 AI 工具領域不算常見。

大多數開源 AI 項目,作者一停,star 漲速就放緩。Voice-Pro 的 star 曲線沒有斷崖。

社區接棒:從 12 個👍到官方支持

GitHub 上曾有個 Issue,標題四個字——"Ubuntu Support"。

12 個 reaction,10 個👍,2 個🚀。開發者在忙 WeConnect,沒空管。

社區沒等。4 月 28 日,Melancbot 提交了 Linux 綜合補丁(詳見上節)。v3.2 隨後正式宣佈支持 Windows、Mac、Linux。

一個被頂了 12 次的 Issue,從社區呼聲變成了官方功能。

開源社區對跨平台支持的渴望,遠比商業公司想象的更強烈。Windows 獨佔?Linux 用戶自己修,修到開發者直接採納。

開源 vs 商業,差距在縮窄

Voice-Pro 不是唯一的開源配音工具。GitHub 上還有 AutoDub、Pollyduble、AI Video Dubbing,但 star 數都在 10 到幾十之間。

Voice-Pro 以 7.9k star 獨佔鰲頭。功能最完整,文檔最全,UI 最成熟。

商業端,ElevenLabs 是絕對頭部。月費 5 到 99 美元,企業版另算。優勢在於語音質量、唇形同步、API 穩定性。Voice-Pro 沒有唇形同步——它只做音頻,不做視頻對口型。

但對於個人創作者、小團隊、內容出海需求來說,完全免費意味着零門檻試錯。給 YouTube 視頻做個多語言版本,給 TikTok 短視頻加個配音,Voice-Pro 夠用。

ElevenLabs 的護城河是質量 + 穩定性 + 生態。Voice-Pro 的刀是:免費 + 開源。

這把刀,正在慢慢撬動定價。

ElevenLabs 按月收費,開源社區直接白給。

開源的武器,從來不是代碼本身。是社區願意為它續命的意願。

Voice-Pro 開發停了,代碼開源了,star 還在漲。社區還在修 bug,還在提 feature,Linux 支持也有了。

下一個 PR,可能就是你的。

Voice-Pro 項目地址:https://github.com/abus-aikorea/voice-pro

Macaron 🧁 | ElevenLabs 按月收費,開源社區直接白給。