一張圖生成一個實時回應你的對話視頻角色 Runway 讓視頻生成走進了對話現場

整理版優先睇

一張參考圖生成實時對話視頻角色,Runway Characters 將視頻生成推向對話場景

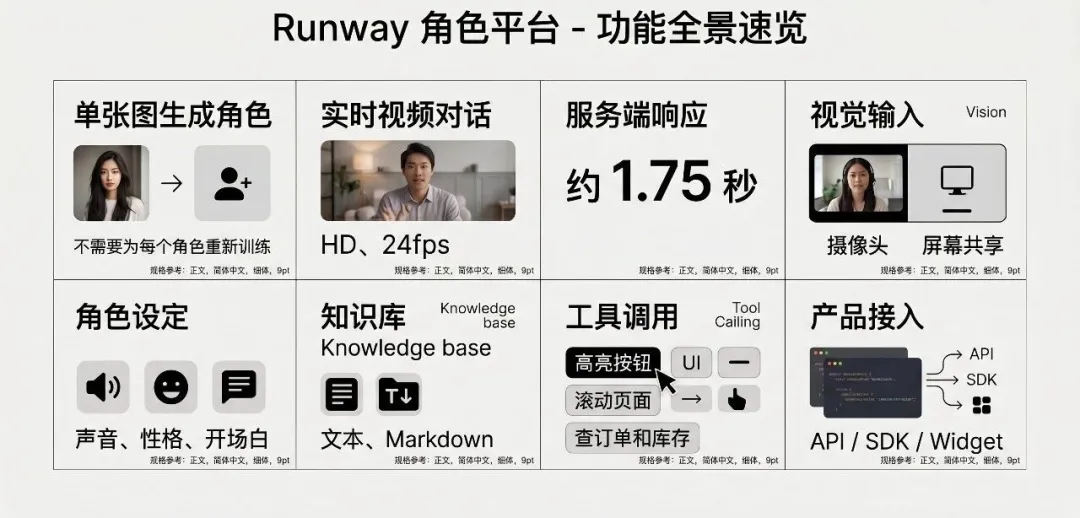

小互AI呢篇文章深度解讀Runway最新推出嘅Characters功能。以前嘅視頻生成係離線等渲染,而家Runway Characters可以俾你畀一張參考圖,就生成一個能夠同你實時對話嘅視頻角色。作者從產品角度分析咗呢個新功能嘅核心價值:唔係單純嘅數字人,而係一個有視覺、有聲音、有知識庫、有工具調用能力嘅實時視頻Agent。文章亦比較咗市面上其他類似產品,指出Runway嘅優勢在於單圖生成、風格自由同GWM-1模型路線,適合品牌Mascot、遊戲NPC、課程助教呢類非真人角色,而唔係直接取代傳統客服。

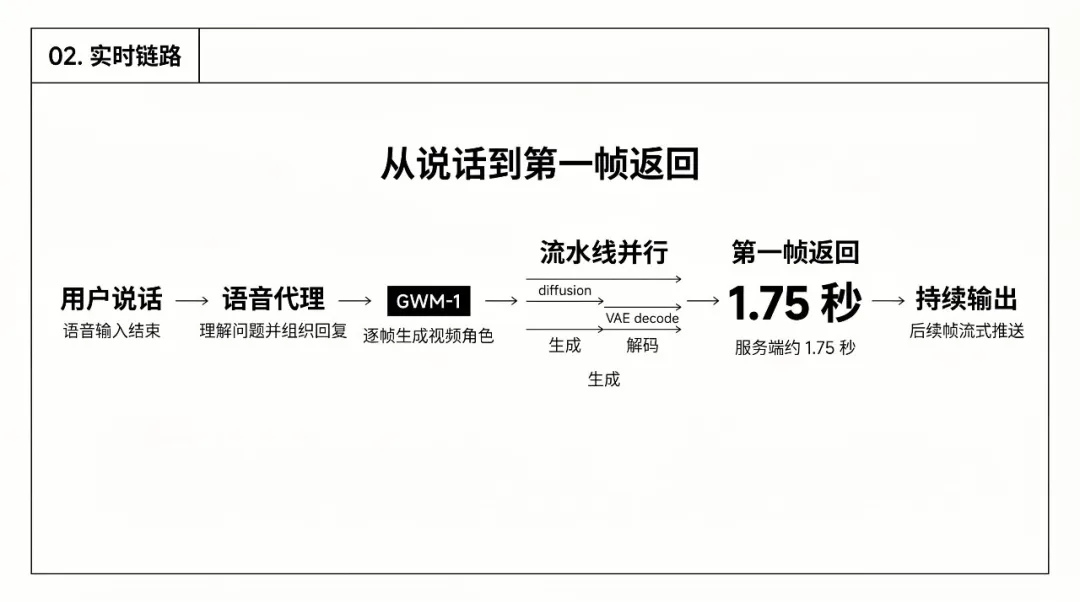

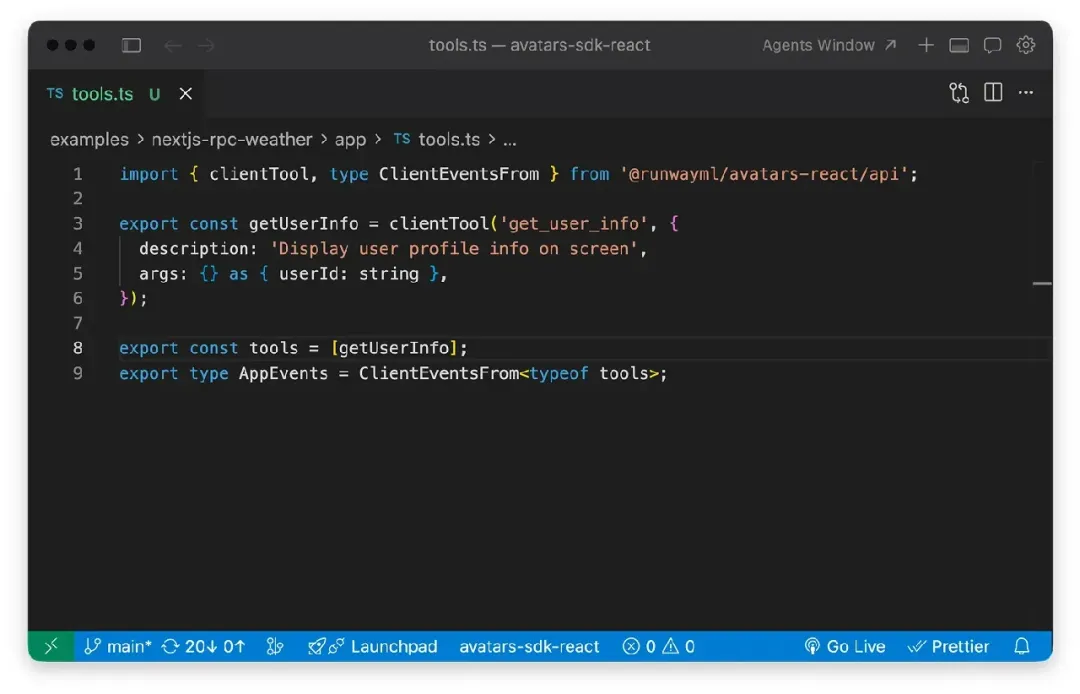

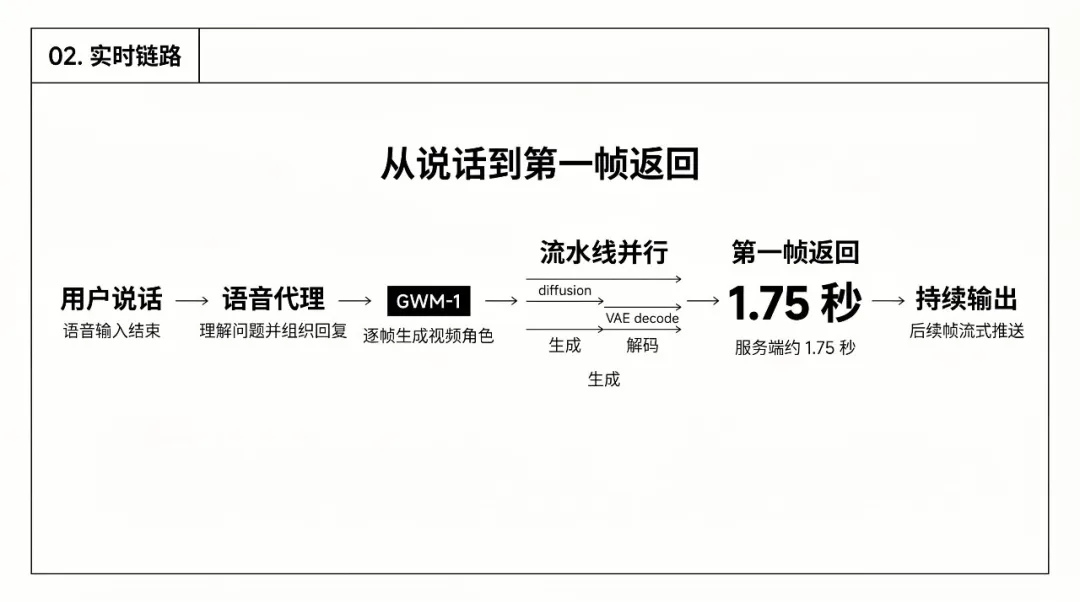

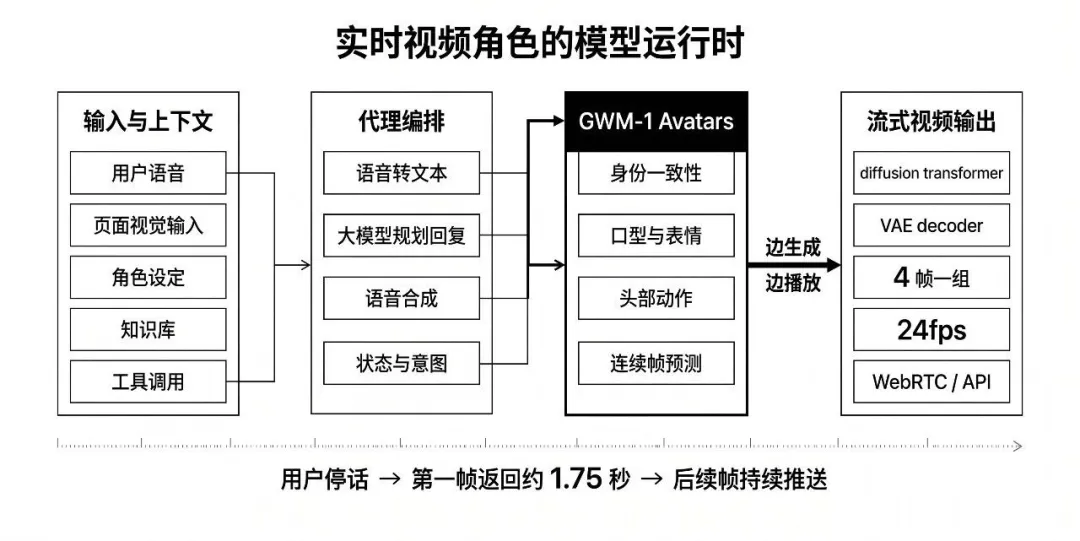

技術上,Runway Characters基於GWM-1模型,用逐幀生成同流式輸出,實現邊生成邊播放,用戶停口後約1.75秒角色就開始回應。佢支援睇攝像頭、屏幕共享,可以配置聲音、性格、開場白,仲可以接入文本或Markdown知識庫同調用工具(例如高亮按鈕、查訂單)。API價格約0.20美元/分鐘,對Demo唔算貴,但長時間使用就要認真計數。

整體嚟睇,Runway Characters嘅真正信號係:AI視頻正從「生成內容」走向「實時參與對話」,評價標準會從清晰度、真實感轉向延遲、連續性、可控性同系統接入能力。呢個變化可能會改變教育、客服、遊戲、會議等好多領域嘅交互方式。

- Runway Characters 用一張參考圖生成可實時對話嘅視頻角色,將視頻生成從離線推入實時交互場景。

- 基於 GWM-1 模型,逐幀生成同流式輸出實現邊生成邊播放,服務端延遲約 1.75 秒。

- 角色具備視覺(睇鏡頭/屏幕共享)、知識庫(文本/Markdown)、工具調用(高亮按鈕、查訂單)等 Agent 能力,唔只係會鬱嘅頭像。

- 定位有別於 HeyGen、Tavus 等產品,更適合非真人角色(品牌 Mascot、NPC、課程助教)而唔係正式客服。

- API 價格約 $0.20/分鐘,適合低風險場景初期驗證,唔建議用喺醫療、法律、金融等高合規領域。

Runway Characters 官方公告

Runway 官方介紹 Characters 功能嘅文章

GWM-1 技術報告

Runway General World Model 嘅技術細節

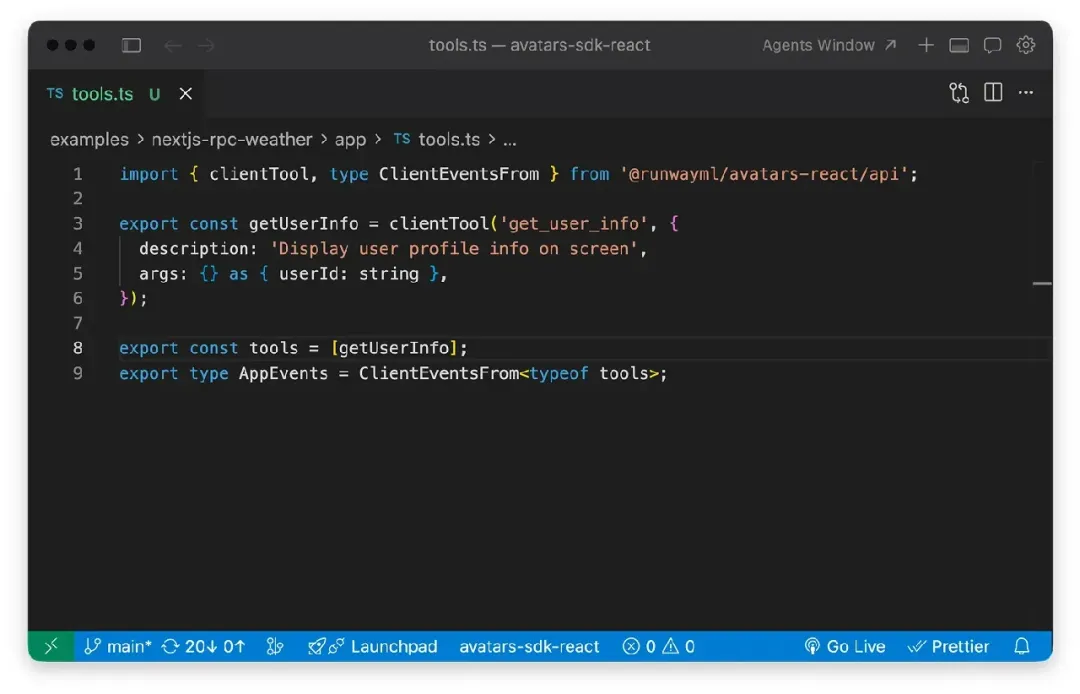

Characters API 文檔

開發者文檔,包括 API、React SDK、Widget 使用方式

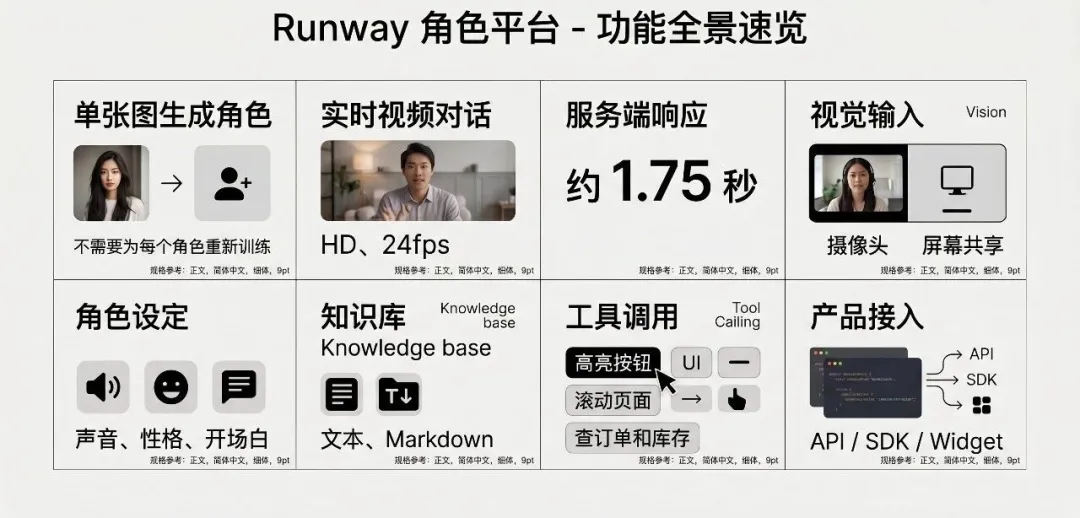

核心功能:從離線生成到實時對話

Runway Characters 嘅核心係一張參考圖生成一個可以同你實時對話嘅視頻角色。你唔使為每個角色重新訓練模型,官方話支援 HD 同 24fps。用戶停口之後,角色開始返回第一幀嘅服務端時間約 1.75 秒。

- 一張參考圖生成角色,唔使逐個訓練。

- 角色可以睇 攝像頭,亦可以睇 屏幕共享。

- 可以配置 聲音、性格、開場白,仲可以生成或克隆自定義聲音。

- 可以接 文本或 Markdown 知識庫,按資料回答。

- 可以調用 工具,例如高亮網頁按鈕、滾動頁面、打開彈窗,或者去後端查訂單同庫存。

- 可以透過 API、React SDK、網頁 Widget 接入自己嘅產品。

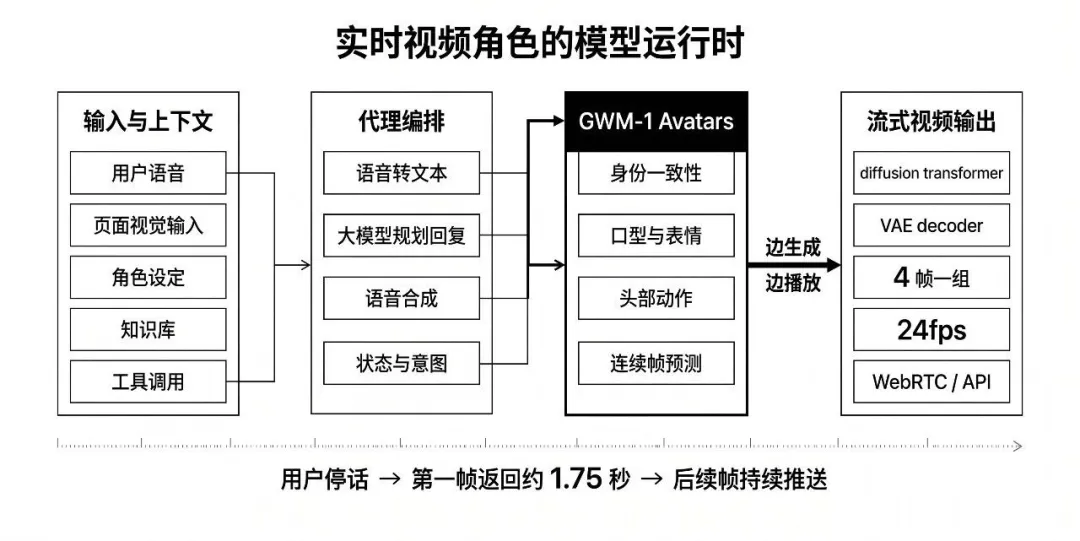

技術難點:邊生成邊回應

一般視頻生成好似煮一圍菜,你點完單廚房慢慢煮,煮好先一次過上枱。但實時視頻角色似開放式廚房,你一邊講需求佢一邊煮一邊上菜。Runway Characters 嘅做法係 逐幀生成同流式輸出,簡單講就係「邊拍邊直播」。

官網技術拆解提到,Characters 基於 GWM-1,一次迭代生成 4 幀。24fps 下 4 幀約 167ms。diffusion transformer 約 151ms,VAE decoder 約 119ms。為咗控制時間,Runway 將兩段做成流水線:上一批幀解碼時,下一批幀已經開始生成。呢種做法同過去「先拍完再放映」嘅模型好唔同。

視頻 Agent:唔只係一個會講嘢嘅頭像

Runway Characters 仲有 眼睛、資料 同 手。佢可以睇鏡頭同屏幕共享,可以接知識庫按文檔回答,仲可以透過 Tool Calling 調用動作,例如顯示字幕、彈出知識卡片、更新遊戲狀態,甚至去後端查訂單狀態。

呢幾件事加埋,令佢唔再只係一個會鬱嘅頭像,而係一個 產品入口。想像一個 SaaS 新手頁,用戶一入嚟就見到一個品牌角色,問「我該從邊度開始?」佢睇到當前頁面,自動滾到對應區域,高亮「新建項目」掣,仲解釋點解要先點呢度。呢種體驗將講解、問答、頁面引導同工具調用放埋喺一次視頻對話裏面。

所以 Runway Characters 嘅定位唔係「AI 口播視頻生成器」,而係一個 有視覺形象、有聲音、有知識庫、有工具調用能力嘅實時視頻 Agent。

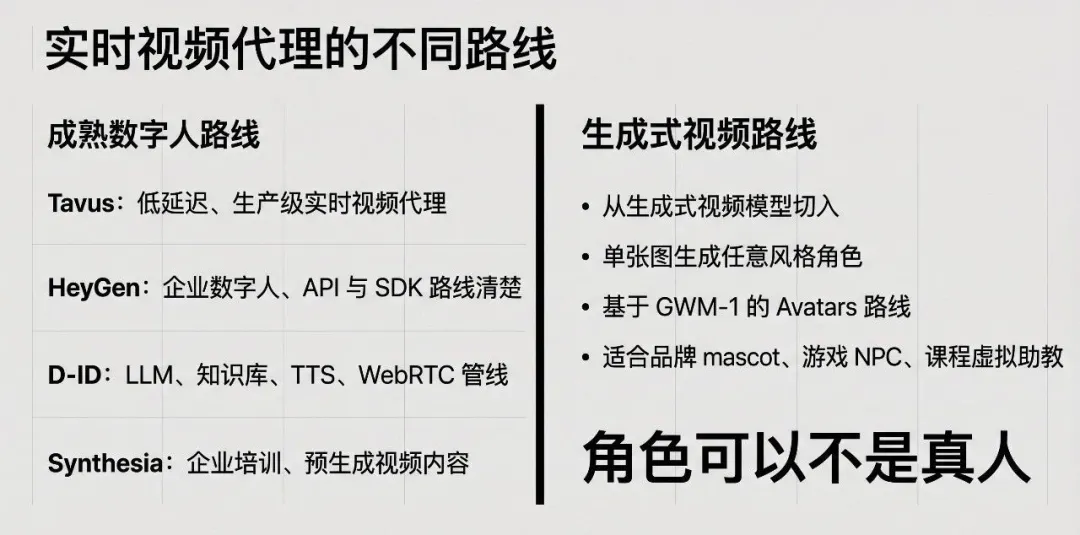

市場定位:同類產品點揀?

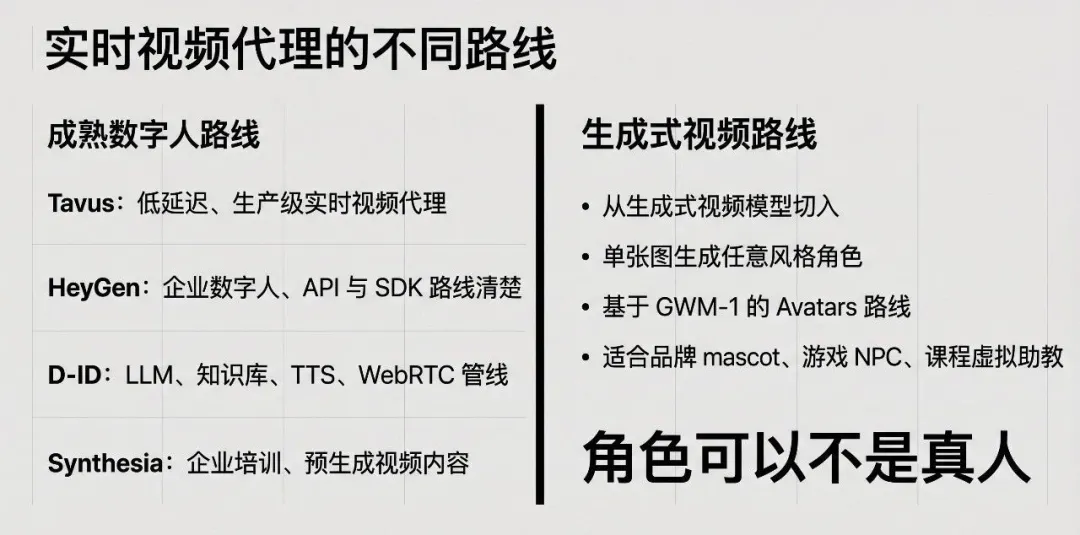

Runway Characters 同 Tavus、HeyGen、D-ID、Synthesia 呢啲產品定位唔同。Tavus CVI 更強調低延遲同生產級實時視頻代理;HeyGen LiveAvatar 係成熟嘅企業數字人平台;D-ID 已經將 LLM、知識庫、TTS、WebRTC 打包成可配置系統;Synthesia 偏向企業培訓同預生成視頻。

Runway 嘅強項唔一定係最低延遲或最成熟嘅企業數字人流程,而係 單圖生成、風格自由度 同 GWM-1 背後嘅路線。呢會影響適用場景:真人客服、真人講師、企業口播可以揀 HeyGen、Tavus、Synthesia;而品牌 Mascot、遊戲 NPC、課程虛擬助教、虛構人物、2D 風格角色就更適合 Runway Characters。

使用方式、成本同注意事項

Runway 提供三個入口:Web App(最長 2 分鐘)、Developer Platform(最長 5 分鐘)、API Integration(最長 30 分鐘)。價格方面,API 口徑係 gwm1_avatars:2 credits upfront + 2 credits / 6 秒。1 credit = $0.01,所以約 $0.20 / 分鐘。30 分鐘會話約 $6.02。

暫時最適合嘅場景係低風險、強展示、邊界清楚嘅:官網互動講解員、課程助教、展會品牌 Mascot、遊戲 NPC、內部知識庫。唔建議放喺正式客服、付費銷售、醫療法律金融建議、心理諮詢呢啲高風險領域。

合規都要注意:Runway 嘅使用政策限制未經許可使用他人圖像、影片或聲音,亦限制冒充同誤導。Characters 額外限制 未成年人形象、面向未成年嘅角色、醫療/法律/金融建議。最好由虛構角色、品牌角色或明確授權嘅形象開始。

小互AI · 深度解讀

Runway Characters:視頻生成走進咗對話現場

Runway 發佈咗 Runway Characters,你俾佢一張參考圖,佢就可以生成一個同用戶實時講嘢嘅視頻角色。

Runway Characters 將 AI 視頻從傳統嘅離線生成,推向實時互動場景。透過單張參考圖,用戶可以生成一個可以實時回應嘅對話視頻角色。

今次更新嘅核心亮點係,佢唔單止令圖像「鬱起嚟」,仲令視頻角色具備參與對話、調用工具、接入知識庫嘅能力。

先捉住呢幾項功能,後面再詳細講:

你可能覺得,呢個咪即係「數字人」囉。上傳一張面,等佢眨眼、開口、讀稿,過去幾年大家都見過好多。

但 Runway Characters 唔係重複做呢樣嘢。

佢想將視頻生成由「等模型出片」,推到「現場接話」。

用戶唔係等一段生成好嘅視頻,而係同屏幕裏面嘅角色傾偈。呢個角色要聽得明你、見到你睇緊嘅嘢、按資料回答,仲可以在產品入面做啲動作。

呢個先係今次發佈最值得睇嘅變化:視頻角色開始由展示層,走入產品互動層。

我哋繼續睇落去...

01

以前係等一段片,而家係接住一句話

大多數視頻生成工具,運作方式都好相似。

你寫提示詞,上傳參考圖,按生成,然後等。模型行幾十秒,俾你幾秒視頻。你覺得唔滿意,再改提示詞,再等一輪。

呢個流程入面,慢啲可以接受,因為你本來就係等一個素材。

Runway Characters 換咗場景。

你唔係叫佢生成一段視頻交差,而係同一個角色互動。

你問一句,佢要接住。

你共享屏幕,佢要睇得明,你問「呢個掣喺邊」,佢最好指俾你睇。

你問訂單狀態,佢唔可以亂作一句,而要去後台攞數據。

呢個時候,延遲就唔再係小問題...

聊天框慢兩秒,用戶可能仲忍到。一個視頻角色停咗成五六秒,現場感即刻斷咗。因為你見到嘅係一塊面。一塊面停喺度唔答嘢,比文字氣泡慢啲更令人齣戲。

所以 Runway 今次不停強調 real-time。

官方俾出嘅關鍵數字係:24fps,37ms 有效模型時間每幀;由用戶停咗講嘢到角色開始返第一幀,服務端大約 1.75 秒。

1.75 秒唔係你喺電腦前感受到嘅完整等待時間。佢係 server-side turn-around。網絡、裝置、客戶端播放都會再增加延遲。Runway 自己都話,連線品質會影響體驗。

但呢個數字依然重要。佢說明 Runway 唔係做緊「更快生成視頻」,而係做緊「視頻能唔能夠進入對話節奏」。

02

難點唔係相片開口,而係邊生成邊回應

普通視頻生成好似做一枱菜。

你落完單,廚房慢慢煮,全部煮好先攞出嚟。只要最後結果唔錯,你等一陣都接受到。

實時視頻角色更加似開放式廚房。

你一邊講需求,佢一邊做,一邊攞出嚟。你又補一句「轉個講法」,佢仲要跟得上。

Runway Characters 面對嘅就係呢個難點。角色要聽你講嘢,要俾大模型組織回覆,要合成把聲,仲要生成口型、表情、頭部動作同視頻幀。

佢唔可以等成段視頻生成曬先播。咁樣每問一句,都好似等一次渲染。

Runway 嘅做法係逐幀生成同串流輸出。

簡單講,就係邊生成邊播放。

官方技術拆解入面提到,Characters 基於 GWM-1,一次疊代生成 4 幀。24fps 下,4 幀大約對應 167ms。官方測量入面,diffusion transformer 大約 151ms,VAE decoder 大約 119ms。如果順序行,時間會超。Runway 將兩段做成流水線:上一批幀喺解碼嘅時候,下一批幀已經開始生成。

唔使記 DMD、KV cache、CUDA Graphs 呢啲技術名詞。

記住一個人話版本就得:以前嘅視頻模型係「拍完先放映」,Runway Characters 更加似「邊拍邊直播」。

呢個就係佢同普通圖生視頻嘅分別。

03

由「視頻角色」到「視頻 Agent」

更加有趣嘅係,Runway Characters 唔單止係一個會講嘢嘅頭像,佢仲有其他能力,類似而家 AI 模型嘅 Agent 能力。

佢有眼:Vision 令角色可以睇到鏡頭同屏幕共享。你喺設計稿上停低,佢可以圍繞當前畫面話邊度擠迫;你喺產品後台揾唔到入口,佢可以望住屏幕話畀你聽下一步㩒邊度。

佢有資料:Knowledge base 令角色接入文字或 Markdown,按你嘅產品文檔、FAQ、內部規則回答。如果唔係,角色再自然,都只係一個帶塊面嘅聊天機械人。

佢有手:Tool Calling 令角色可以調用動作,開發者可以畀角色定義可調用工具,例如顯示字幕、彈出知識卡、更新遊戲狀態,亦可以調用後台介面查詢訂單狀態、預計送達時間等資訊。

佢可以自訂聲音:支援 text-to-voice,亦支援由音頻樣本做 instant voice cloning,然後將把聲綁定畀角色,保持多輪對話入面把聲一致。

呢幾件事連埋一齊,正正係佢最大嘅分別,更加似一個產品入口。

想像一個 SaaS 新手頁。

用戶第一次入嚟,唔知點創建項目。以前佢可能要睇幫助文檔、㩒引導浮層、問客服聊天框,甚至去搜教學。

或者你可以一邊打機,一邊有人幫你講解,或者帶入 Zoom、Google Meet 或 Teams 嘅真實會議入面,等佢哋可以實時睇、聽同回應。

Runway Characters 想做嘅型態係:一個品牌角色出現喺頁面角落。用戶問「我應該由邊度開始?」佢見到當前頁面,碌到對應區域,高亮「新建項目」掣,然後解釋點解要先㩒呢度。

用戶繼續問「免費版同專業版有咩分別?」佢查知識庫。

用戶問「我上次買嘅套餐仲喺度嗎?」佢調後台介面。

呢個時候佢就唔係一個淨係會講嘢嘅頭像喇。佢將講解、問答、頁面引導同工具調用,放咗入一次視頻對話入面。

咁樣睇,佢更加似一個可以入產品介面嘅新互動層

以前嘅 AI 互動主要係文字框入面。後來有語音助手,有靜態頭像,有會鬱嘅數字人。Runway Characters 再推前一步:角色可以睇、聽、講、調用工具,仲可以嵌入網頁同會議入面。

落到產品入面,「幫助中心」「新手引導」「在線講解」「虛擬主持人」都會多一個視頻入口,唔使只係停喺聊天窗口入面。

呢啲能力連埋一齊睇,Runway Characters 嘅定位就好清楚喇。

佢唔係一個「AI 口播視頻生成器」。

佢更加似一個有視覺形象、有把聲、有知識庫、有工具調用能力嘅實時視頻 Agent。

04

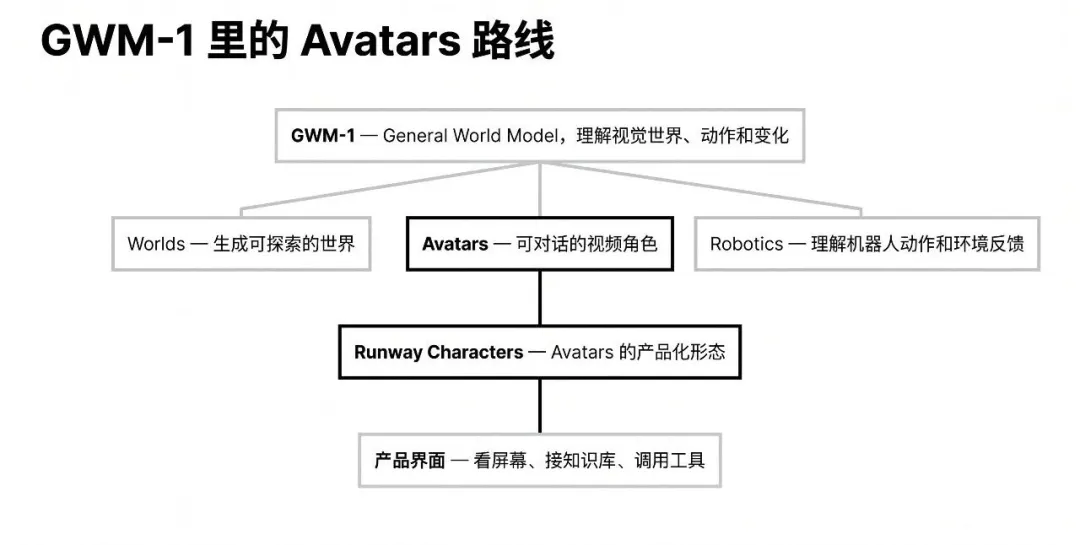

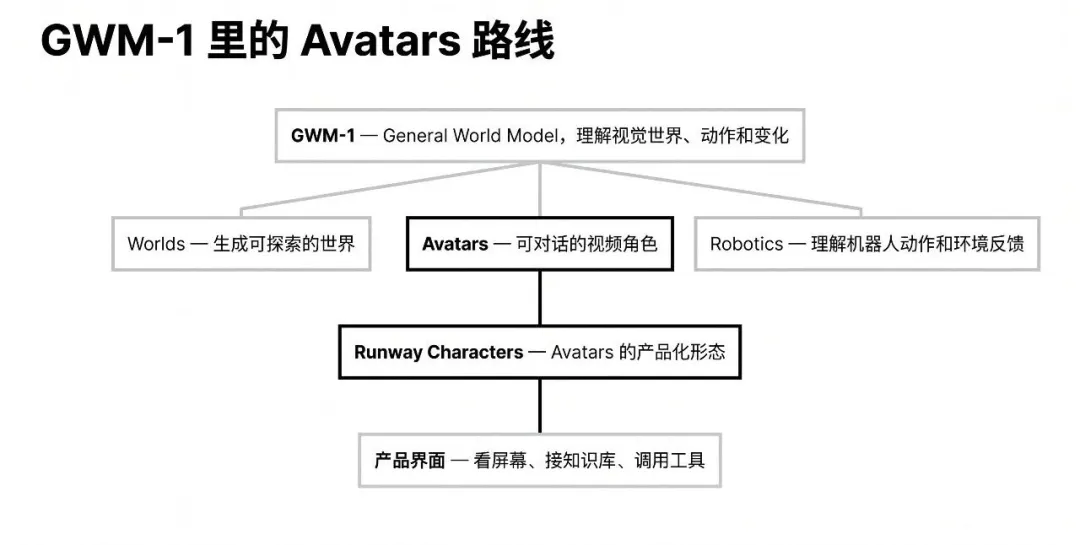

GWM-1 令佢唔只係數字人

Runway Characters 基於佢哋嘅 GWM-1 模型,即係 Runway 嘅 General World Model。

呢個背景唔使講得太玄。可以直接理解成:Runway 唔滿足於淨係令 AI 生成一段靚視頻,佢想令模型理解畫面入面嘅世界、動作同變化。

Runway 之前將 GWM-1 拆成幾個方向:Worlds、Avatars、Robotics。

Worlds 係生成可以探索嘅世界。Robotics 係令模型理解機械人動作同環境反饋。Characters 對應 Avatars,即係可對話角色。

放喺呢條線入面睇,Characters 唔係 Runway 順手做咗個數字人工具。

佢係將視頻生成推向互動產品:視頻唔再只係輸出結果,亦可以成為用戶操作產品、理解頁面、查詢資料嘅入口。

呢個都係佢同 Tavus、HeyGen、D-ID 嘅位置差異。

Tavus CVI 更強調低延遲同生產級實時視頻代理。HeyGen LiveAvatar 更加似成熟嘅企業數字人平台。D-ID Realtime Agents 已經將 LLM、知識庫、TTS、WebRTC 呢條管線打包成可設定系統。Synthesia 更偏向企業培訓同預生成視頻。

Runway 嘅強項唔一定係最低延遲,亦唔一定係最成熟嘅企業數字人流程。

佢更加似由生成式視頻模型切入實時代理,優勢係單圖生成、風格自由度同 GWM-1 背後嘅路線。

呢個會影響適合邊啲場景:

真人客服、真人講師、企業口播,HeyGen、Tavus、Synthesia 呢啲產品各有成熟路徑。Runway Characters 更適合品牌吉祥物、遊戲 NPC、課程虛擬助教、虛構人物、2D 風格角色,甚至某種產品擬人化入口。

佢嘅強項唔係「似真人」,而係「角色可以唔係真人」。

呢一點好容易被低估。未來好多視頻代理未必都係客服代表樣,佢哋可能係一個產品吉祥物,一個課程入面嘅助教,一個遊戲世界入面嘅 NPC,一個設計工具入面嘅陪練角色。

05

暫時唔好攞佢取代客服

Runway Characters 而家最適合嘅第一批場景,唔係正式客服主入口。

更適合嘅係低風險、強展示、邊界清晰嘅場景。

例如官網互動講解員,用戶唔使翻 FAQ,直接問角色:呢個產品適合邊個?點開始?價格點計?同其他工具爭喺邊?

例如課程或教程助教。角色可以睇屏幕、睇課件、睇步驟,幫用戶理解一個概念,或者引導佢行下一步。

例如展會、發佈會、品牌活動。一個吉祥物企喺度,可以同觀眾傾偈,介紹產品,回答固定資料入面嘅問題,本身已有展示價值。

例如遊戲 NPC 或互動故事。Runway 嘅風格自由度喺呢度會更明顯。真人客服唔一定需要幻想角色,但遊戲、互動活動、品牌 IP 就好需要。

例如內部知識庫。公司可以將角色先接到固定文檔入面,等佢回答新員工成日問嘅問題。呢個場景唔公開面對客戶,風險更低,亦適合早期驗證。

暫時唔好急住將佢放入正式客服、付費銷售、醫療法律金融建議、心理輔導,或者任何授權唔清嘅真人樣同真人聲場景。

呢啲地方唔係「識講嘢」就得。佢哋要求穩定、合規、可追責、低誤答、低延遲,仲要處理大量邊界情況。

06

點樣用?成本點計?

Runway 而家畀咗幾個入口:web app、Developer Platform、API integration,亦提供 API、React SDK 同網頁 Widget。

Web App 適合初步體驗,最長 2 分鐘;Developer Platform 適合帶自訂設定嘅測試,最長 5 分鐘;API integration 面向生產集成,最長 30 分鐘。

Web App:最長 2 分鐘 Developer Platform:最長 5 分鐘 API Integration:最長 30 分鐘

價格點計?

Runway API 價格頁寫,gwm1_avatars 係 2 credits upfront,再按 2 credits / 6 秒計費。1 credit 等於 0.01 美元,粗略計約 0.20 美元一分鐘,再加每次會話嘅 upfront 成本。自訂聲音生成會另外收 credits。

- 基礎價格:2 credits / 6 秒,約 20 credits / 分鐘

- 折美元:1 credit = $0.01,所以約 $0.20 / 分鐘

- API 口徑:gwm1_avatars 是 2 credits 起步費 + 2 credits / 6 秒

- 1 分鐘 API 會話:約 22 credits,即 $0.22

- 30 分鐘 API 會話:約 602 credits,即 $6.02

呢個價格對 demo 嚟講唔誇張,但對客服、銷售、教育陪練,就要認真計數。實時視頻角色唔係文字傾偈,佢消耗嘅係持續嘅視頻生成時間。

合規更加唔可以亂嚟:

Runway 嘅使用政策限制未經許可就用他人嘅圖像、視頻或聲音,亦限制冒充同誤導。Characters 仲有額外邊界:未成年人形象、面向未成年人嘅角色、醫療法律金融建議、治療或輔導類用途,都唔係可以隨便試嘅地方。

實時視頻角色越似真人,授權同誤導風險就越高。

如果要試,最好由虛構角色、品牌角色、明確授權嘅形象開始。唔好用真人樣同真人聲做灰色測試。

07

AI 視頻正由內容生成走向互動基建

Runway 一直係 AI 視頻領域嘅重要公司。

好多人關注 Runway,係因為佢嘅視頻生成效果、鏡頭控制能力、影視級工作流。

但 Runway Characters 釋放嘅訊號更偏底層。

AI 視頻正由「生成一段內容」進入「實時參與對話」。

呢個會改變視頻模型嘅評價標準。

以前大家睇嘅係清晰度、真實感、運動穩定性、鏡頭美感。

跟住落嚟仲要睇延遲、連續性、可控性、對話一致性、角色身份穩定性、系統接入能力。

一個模型生成嘅視頻再好,如果冇辦法實時互動,佢就更適合內容創作。

一個模型嘅視覺質量未必電影級,但如果佢可以穩定、低延遲、可部署咁參與對話,就有可能進入教育、客服、遊戲、會議、直播同企業應用。

Runway Characters 今次真正值得關注嘅地方就係呢度。

佢將視頻生成由「作品」推向「介面」。

參考連結

[1] https://runwayml.com/news/building-runway-characters: https://runwayml.com/news/building-runway-characters

[2] https://runwayml.com/news/introducing-runway-characters: https://runwayml.com/news/introducing-runway-characters

[3] https://runwayml.com/research/introducing-runway-gwm-1: https://runwayml.com/research/introducing-runway-gwm-1

[4] https://docs.dev.runwayml.com/characters: https://docs.dev.runwayml.com/characters

[5] https://docs.dev.runwayml.com/guides/models/: https://docs.dev.runwayml.com/guides/models/

[6] https://docs.dev.runwayml.com/guides/pricing: https://docs.dev.runwayml.com/guides/pricing

[7] https://help.runwayml.com/hc/en-us/articles/49557780326163-Runway-Characters: https://help.runwayml.com/hc/en-us/articles/49557780326163-Runway-Characters

[8] https://help.runwayml.com/hc/en-us/articles/17944787368595-Runway-s-Usage-Policy: https://help.runwayml.com/hc/en-us/articles/17944787368595-Runway-s-Usage-Policy

[9] https://docs.tavus.io/sections/conversational-video-interface: https://docs.tavus.io/sections/conversational-video-interface

[10] https://help.heygen.com/en/articles/12758516-introducing-liveavatar: https://help.heygen.com/en/articles/12758516-introducing-liveavatar

[11] https://docs.d-id.com/docs/realtime-overview: https://docs.d-id.com/docs/realtime-overview

— END —

小互AI · 深度解讀

Runway Characters:視頻生成走進了對話現場

Runway 發佈了 Runway Characters,你給它一張參考圖,它就能生成一個可以和用戶實時說話的視頻角色。

Runway Characters 將 AI 視頻從傳統的離線生成,推向實時交互場景。通過單張參考圖,用戶可以生成一個能實時回應的對話視頻角色。

這次更新的核心亮點在於,它不僅讓圖像“動起來”,還讓視頻角色具備參與對話、調用工具、接入知識庫的能力。

先抓這幾項功能,後面再展開:

你可能覺得,這不就是“數字人”嗎。上傳一張臉,讓它眨眼、張嘴、讀稿,過去幾年大家已經看過很多。

但 Runway Characters 不是在重複這件事。

它想把視頻生成從“等模型出片”,往前推到“現場接話”。

用戶不是等一段生成好的視頻,而是在和屏幕裏的角色說話。這個角色要能聽懂你、看見你正在看的東西、按資料回答,還能在產品裏做一點動作。

這才是這次發佈最值得看的變化:視頻角色開始從展示層,往產品交互層走。

咱們繼續往下看...

01

以前是等一段片子,現在是接住一句話

大多數視頻生成工具,工作方式都很像。

你寫提示詞,上傳參考圖,點生成,然後等。模型跑幾十秒,給你幾秒視頻。你覺得不滿意,再改提示詞,再等一輪。

這個流程裏,慢一點可以接受,因為你本來就在等一個素材。

Runway Characters 換了場景。

你不是讓它生成一段視頻交差,而是在和一個角色互動。

你問一句,它要接住。

你共享屏幕,它要看懂,你問“這個按鈕在哪”,它最好能指給你。

你問訂單狀態,它不能編一句像樣的話,而要去查後端數據。

這時候,延遲就不再是小瑕疵...

聊天框慢兩秒,用戶可能還能忍。一個視頻角色停住五六秒,現場感馬上斷掉。因為你看到的是一張臉。一張臉停在那裏不回話,比文字氣泡慢一點更讓人出戏。

所以 Runway 這次反覆強調 real-time。

官方給出的關鍵數字是:24fps,37ms 有效模型時間每幀;從用戶停止說話到角色開始返回第一幀,服務端約 1.75 秒。

1.75 秒不是你在電腦前感受到的完整等待時間。它是 server-side turn-around。網絡、設備、客戶端播放都會繼續增加延遲。Runway 自己也提到,連接質量會影響體驗。

但這個數字仍然重要。它說明 Runway 不是在做“更快生成視頻”,而是在做“視頻能不能進入對話節奏”。

02

難點不在照片開口,而在邊生成邊回應

普通視頻生成像做一桌菜。

你點完單,廚房慢慢做,全部做好再端出來。只要最後結果不錯,你等一會兒也能接受。

實時視頻角色更像開放式廚房。

你一邊說需求,它一邊做,一邊端出來。你又補一句“換個說法”,它還得跟上。

Runway Characters 面對的就是這個難點。角色要聽你說話,要讓大模型組織回覆,要合成聲音,還要生成口型、表情、頭部動作和視頻幀。

它不能先把整段視頻生成完再播放。那樣每問一句,都像等一次渲染。

Runway 的做法是逐幀生成和流式輸出。

簡單說,就是邊生成邊播放。

官方技術拆解裏提到,Characters 基於 GWM-1,一次迭代生成 4 幀。24fps 下,4 幀大約對應 167ms。官方測量裏,diffusion transformer 約 151ms,VAE decoder 約 119ms。如果順着跑,時間會超。Runway 把兩段做成流水線:上一批幀在解碼時,下一批幀已經開始生成。

不用記 DMD、KV cache、CUDA Graphs 這些技術名詞。

記住一個人話版本就行:過去的視頻模型是“先拍完再放映”,Runway Characters 更像“邊拍邊直播”。

這就是它和普通圖生視頻的分界。

03

從“視頻角色”到“視頻 Agent”

更有意思的是,Runway Characters 並不只是一個會說話的頭像,它還擁有一些其他的能力,類似目前的AI模型具備的你Agent的能力。

它有眼睛:Vision 讓角色可以看攝像頭和屏幕共享。你在設計稿上停住,它可以圍繞當前畫面說哪裏擁擠;你在產品後台找不到入口,它可以看着屏幕告訴你下一步點哪裏。

它有資料:Knowledge base 讓角色接文本或 Markdown,按你的產品文檔、FAQ、內部規則回答。否則角色再自然,也只是一個帶臉的聊天機器人。

它有手:Tool Calling 讓角色能調用動作,開發者可以給角色定義可調用工具,比如顯示字幕、彈出知識卡片、更新遊戲狀態,也可以調用後端接口查詢訂單狀態、預計送達時間等信息。

它可以自定義聲音:支持 text-to-voice,也支持從音頻樣本進行 instant voice cloning,然後把聲音綁定給角色,保持多輪會話裏的聲音一致。

這幾件事連起來,正是它最大的區別,更像是一個產品入口。

想象一個 SaaS 新手頁。

用戶第一次進來,不知道怎麼創建項目。過去他可能要看幫助文檔、點引導浮層、問客服聊天框,甚至去搜教程。

或者你可以一邊玩遊戲,一邊有人給你解說,或者帶入 Zoom、Google Meet 或 Teams 的真實會議中,讓他們能夠實時觀看、傾聽並做出響應。

Runway Characters 想做的形態是:一個品牌角色出現在頁面角落。用戶問“我該從哪開始?”它看見當前頁面,滾動到對應區域,高亮“新建項目”按鈕,然後解釋為什麼先點這裏。

用戶繼續問“免費版和專業版差在哪?”它查知識庫。

用戶問“我上次買的套餐還在嗎?”它調後端接口。

這時候它就不是一個會說話的頭像了。它把講解、問答、頁面引導和工具調用,放進了一次視頻對話裏。

這麼看它更像一個能進產品界面的新交互層

以前的 AI 交互主要在文本框裏。後來有語音助手,有靜態頭像,有會動的數字人。Runway Characters 再往前推一步:角色可以看、聽、說、調用工具,還能嵌到網頁和會議裏。

落到產品裏,“幫助中心”“新手引導”“在線講解”“虛擬主持人”都會多一個視頻入口,不必只停在聊天窗口裏。

這些能力連起來看,Runway Characters 的定位就很清楚了。

它不是一個“AI 口播視頻生成器”。

它更像一個有視覺形象、有聲音、有知識庫、有工具調用能力的實時視頻 Agent。

04

GWM-1 讓它不只是數字人

Runway Characters 基於其 GWM-1模型,也就是 Runway 的 General World Model。

這個背景不用講得太玄。可以直接理解成:Runway 不滿足於讓 AI 生成一段漂亮視頻,它想讓模型理解畫面裏的世界、動作和變化。

Runway 之前把 GWM-1 拆成幾個方向:Worlds、Avatars、Robotics。

Worlds 是生成可以探索的世界。Robotics 是讓模型理解機器人動作和環境反饋。Characters 對應 Avatars,也就是可對話角色。

放在這條線裏看,Characters 不是 Runway 順手做了個數字人工具。

它是在把視頻生成往交互產品裏推:視頻不再只是輸出結果,也可以成為用戶操作產品、理解頁面、查詢資料的入口。

這也是它和 Tavus、HeyGen、D-ID 的位置差異。

Tavus CVI 更強調低延遲和生產級實時視頻代理。HeyGen LiveAvatar 更像成熟的企業數字人平台。D-ID Realtime Agents 已經把 LLM、知識庫、TTS、WebRTC 這套管線打包成可配置系統。Synthesia 更偏企業培訓和預生成視頻。

Runway 的強項不一定是最低延遲,也不一定是最成熟的企業數字人流程。

它更像從生成式視頻模型切進實時代理,優勢在單圖生成、風格自由度和 GWM-1 背後的路線。

這會影響適用哪些場景:

真人客服、真人講師、企業口播,HeyGen、Tavus、Synthesia 這些產品各有成熟路徑。Runway Characters 更適合品牌 mascot、遊戲 NPC、課程虛擬助教、虛構人物、2D 風格角色,甚至某種產品擬人化入口。

它的強項不是“像真人”,而是“角色可以不是真人”。

這一點很容易被低估。未來很多視頻代理未必都長成客服代表,它們可能是一個產品吉祥物,一個課程裏的助教,一個遊戲世界裏的 NPC,一個設計工具裏的陪練角色。

05

先別拿它替代客服

Runway Characters 現在最適合的第一批場景,不是正式客服主入口。

更適合的是低風險、強展示、邊界清楚的場景。

比如官網互動講解員,用戶不用翻 FAQ,直接問角色:這個產品適合誰?怎麼開始?價格怎麼算?和別的工具差在哪?

比如課程或教程助教。角色可以看屏幕、看課件、看步驟,幫用戶理解一個概念,或者引導他完成下一步。

比如展會、發佈會、品牌活動。一個 mascot 站在那裏,能和觀眾聊天,能介紹產品,能回答固定資料裏的問題,本身就有展示價值。

比如遊戲 NPC 或互動故事。Runway 的風格自由度在這裏會更明顯。真人客服不一定需要幻想角色,但遊戲、互動活動、品牌 IP 很需要。

比如內部知識庫。公司可以先把角色接到固定文檔裏,讓它回答新員工常問的問題。這個場景不公開面對客戶,風險更低,也適合早期驗證。

暫時不要急着把它放進正式客服、付費銷售、醫療法律金融建議、心理諮詢,或者任何授權不清的真人臉和真人聲音場景。

這些地方不是“能說話”就夠了。它們要求穩定、合規、可追責、低誤答、低延遲,還要能處理大量邊界情況。

06

如何用?成本如何?

Runway 現在給了幾個入口:web app、Developer Platform、API integration,也提供 API、React SDK 和網頁 Widget。

Web App 適合初步體驗,最長 2 分鐘;Developer Platform 適合帶自定義設置的測試,最長 5 分鐘;API integration 面向生產集成,最長 30 分鐘。

Web App:最長 2 分鐘 Developer Platform:最長 5 分鐘 API Integration:最長 30 分鐘

價格如何?

Runway API 價格頁寫,gwm1_avatars 是 2 credits upfront,再按 2 credits / 6 秒計費。1 credit 等於 0.01 美元,粗算約 0.20 美元一分鐘,外加每次會話的 upfront 成本。自定義聲音生成還會另外收 credits。

- 基礎價格:2 credits / 6 秒,約 20 credits / 分鐘

- 折美元:1 credit = $0.01,所以約 $0.20 / 分鐘

- API 口徑:gwm1_avatars 是 2 credits 起步費 + 2 credits / 6 秒

- 1 分鐘 API 會話:約 22 credits,即 $0.22

- 30 分鐘 API 會話:約 602 credits,即 $6.02

這個價格對 demo 不誇張,但對客服、銷售、教育陪練,就必須認真算賬。實時視頻角色不是文本聊天,它消耗的是持續的視頻生成時間。

合規更不能隨便來:

Runway 的使用政策限制未經許可使用他人的圖像、視頻或聲音,也限制冒充和誤導。Characters 還有額外邊界:未成年人形象、面向未成年人的角色、醫療法律金融建議、治療或諮詢類用途,都不是可以隨便試的地方。

實時視頻角色越像真人,授權和誤導風險就越高。

如果要試,最好從虛構角色、品牌角色、明確授權的形象開始。不要拿真人臉和真人聲音做灰色測試。

07

AI 視頻正在從內容生成走向交互基礎設施

Runway 過去一直是 AI 視頻領域的重要公司。

很多人關注 Runway,是因為它的視頻生成效果、鏡頭控制能力、影視級工作流。

但 Runway Characters 釋放的信號更偏底層。

AI 視頻正在從“生成一段內容”進入“實時參與對話”。

這會改變視頻模型的評價標準。

過去大家看的是清晰度、真實感、運動穩定性、鏡頭美感。

接下來還要看延遲、連續性、可控性、對話一致性、角色身份穩定性、系統接入能力。

一個模型生成的視頻再好,如果沒法實時互動,它就更適合內容創作。

一個模型的視覺質量未必電影級,但如果它能穩定、低延遲、可部署地參與對話,它就可能進入教育、客服、遊戲、會議、直播和企業應用。

Runway Characters 這次真正值得關注的點就在這裏。

它把視頻生成從“作品”推向了“界面”。

參考連結

[1] https://runwayml.com/news/building-runway-characters: https://runwayml.com/news/building-runway-characters

[2] https://runwayml.com/news/introducing-runway-characters: https://runwayml.com/news/introducing-runway-characters

[3] https://runwayml.com/research/introducing-runway-gwm-1: https://runwayml.com/research/introducing-runway-gwm-1

[4] https://docs.dev.runwayml.com/characters: https://docs.dev.runwayml.com/characters

[5] https://docs.dev.runwayml.com/guides/models/: https://docs.dev.runwayml.com/guides/models/

[6] https://docs.dev.runwayml.com/guides/pricing: https://docs.dev.runwayml.com/guides/pricing

[7] https://help.runwayml.com/hc/en-us/articles/49557780326163-Runway-Characters: https://help.runwayml.com/hc/en-us/articles/49557780326163-Runway-Characters

[8] https://help.runwayml.com/hc/en-us/articles/17944787368595-Runway-s-Usage-Policy: https://help.runwayml.com/hc/en-us/articles/17944787368595-Runway-s-Usage-Policy

[9] https://docs.tavus.io/sections/conversational-video-interface: https://docs.tavus.io/sections/conversational-video-interface

[10] https://help.heygen.com/en/articles/12758516-introducing-liveavatar: https://help.heygen.com/en/articles/12758516-introducing-liveavatar

[11] https://docs.d-id.com/docs/realtime-overview: https://docs.d-id.com/docs/realtime-overview

— END —