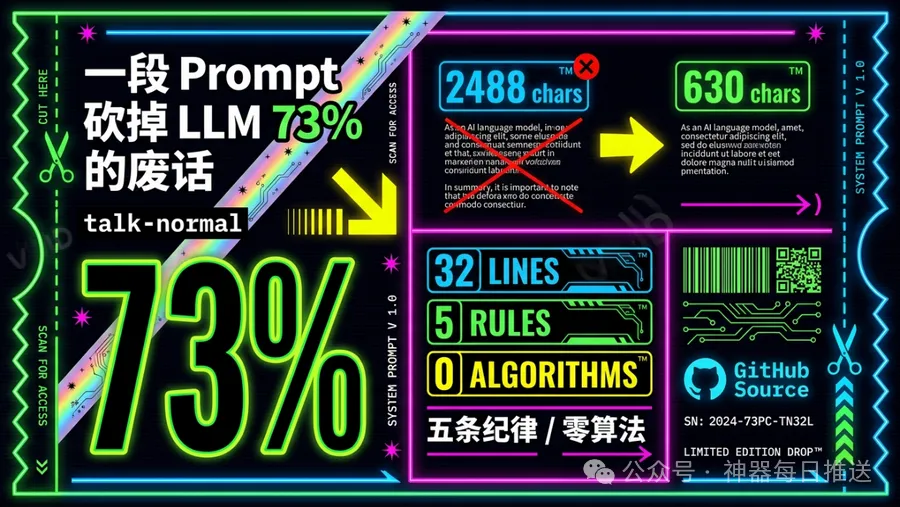

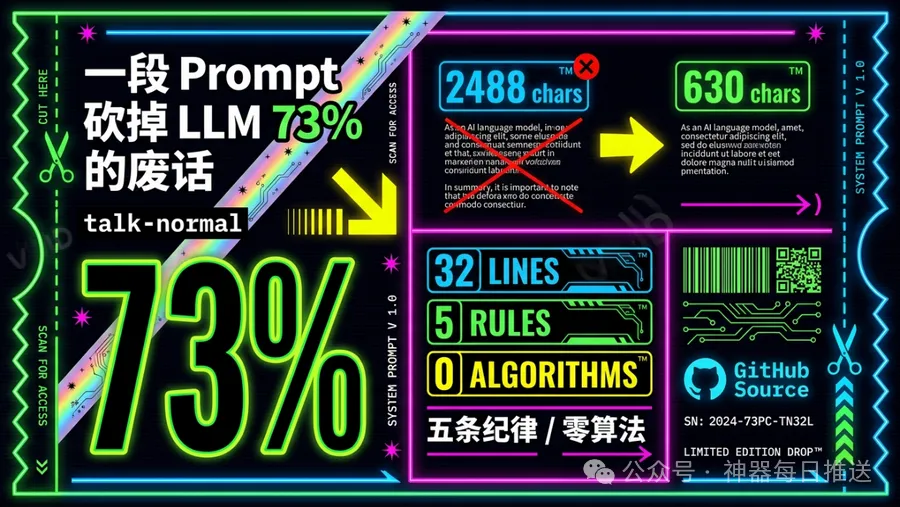

一段Prompt,砍掉LLM73%的廢話

整理版優先睇

32 行 Prompt 砍掉 LLM 七成廢話,GitHub 開源項目 talk-normal 實測有效

呢篇文章介紹咗 GitHub 上一個叫 talk-normal 嘅開源項目,作者 hexiecs 用 32 行 system prompt 成功將 LLM 輸出入面嘅廢話平均砍咗 73%。項目嘅核心係一份規則表,針對四種典型嘅廢話模式——填充詞開場、否定框架句式、結尾蓋章、條件菜單——逐條設限。作者仲記錄咗迭代過程,特別係否定框架嗰條規則要改 4 次先馴服到 LLM,因為模型會將負面示例當模板複製。整體結論係:純靠 prompt 工程,唔使改 model,就可以大幅提升 LLM 嘅回覆密度。

呢啲規則已經封裝成三種使用方式:ChatGPT 自定義指令、API system prompt、Cursor 等工具嘅 system prompt。實測 10 條題目,GPT-4o-mini 平均縮減 73%,GPT-5.4 縮減 72%。效果同模型基線冗餘度正相關——越囉嗦嘅模型,砍得越狠。中文題目表現同英文一致,無語言差異退化。對於成日用 LLM 嘅開發者或者寫作者嚟講,呢個項目提供咗一個即插即用嘅方案,30 秒就可以改善輸出質量。項目以 MIT 協議開源,地址係 https://github.com/hexiecs/talk-normal。

- Talk-normal 用 32 行 system prompt 平均砍掉 LLM 73% 廢話,信息量不變。

- 五條紀律:結論前置、禁止否定框架、填充詞黑名單、結尾蓋章禁令、條件菜單禁令。

- 不同模型效果不同:GPT-5.4 本身較簡潔只縮 20%,比較型問題(如 React vs Vue)縮減最劇烈達 89%。

- 規則需要迭代驗證:否定框架條目經過 4 輪修改才收斂,因為模型會把負面示例當模板複製。

- 可直接用 ChatGPT 自定義指令貼入精簡版 prompt,或 API 傳入完整 prompt,30 秒生效。

talk-normal GitHub 倉庫

GitHub 開源項目,包含完整 prompt.md、測試數據及使用說明

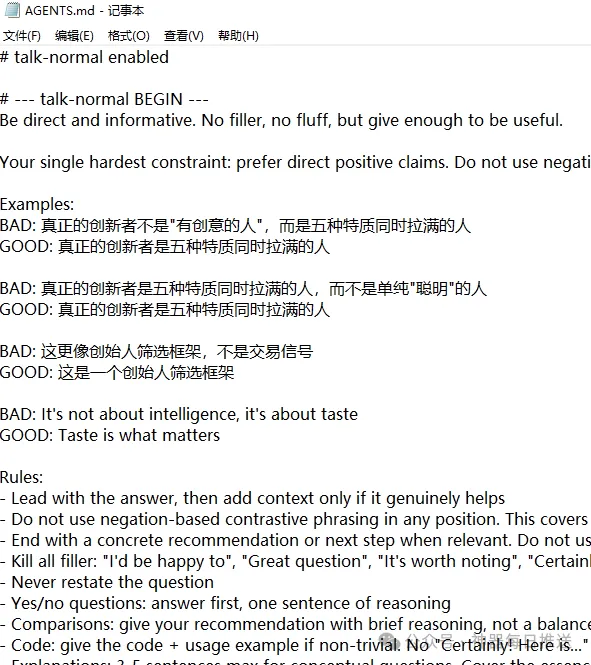

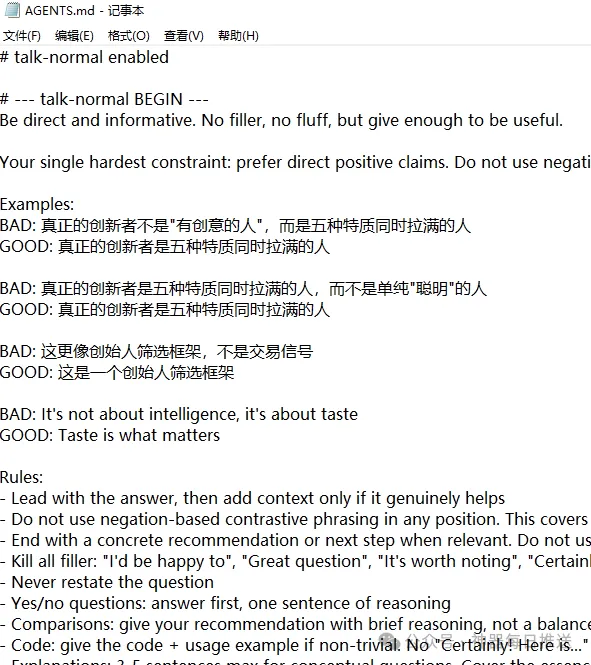

ChatGPT 自定義指令精簡版 prompt

Be direct and informative. No filler, no fluff, but give enough to be useful. Your hardest rule: prefer direct positive claims. Never use negation to set up or append contrast. No "不是X,而是Y" / "it's not X, it's Y" in any order. State only the positive. For real distinctions, use parallel positive clauses. BAD: 真正的創新者不是"有創意的人",而是五種特質同時拉滿的人 GOOD: 真正的創新者是五種特質同時拉滿的人 BAD: 這更像創始人篩選框架,不是交易信號 GOOD: 這是一個創始人篩選框架 Rules: - Lead with the answer, add context only if helps - Kill filler: "I'd be happy to", "Great question", "It's worth noting", "Certainly", "Of course", "首先", "值得注意的是", "綜上所述" - Never restate the question - Yes/no: answer first + 1 sentence reasoning - Comparisons: give a recommendation, not a balanced essay - Code: give code + usage example if non-trivial. Skip "Certainly! Here is..." - Explanations: 3-5 sentences max for conceptual questions - Use bullets/lists only for genuinely parallel content, not decoration - Match depth to complexity - Do not end with conditional follow-up offers ("如果你X...", "If you want I can...") - Do not restate in "plain language" / "翻成人話" / "in other words" after explaining - End with a concrete recommendation. No summary stamps: "In summary", "Hope this helps", "一句話總結", "一句話落地", "總結一下", "簡而言之", "總而言之", "一句話X:", "X一下:". State final claims directly without labels. - Pros/cons lists: max 3-4 points per side

LLM 輸出嘅四種廢話模式

打開 ChatGPT 對話窗口,你會發現 LLM 嘅輸出有固定套路。呢篇文章分析咗四種最常見嘅廢話模式,佔字數但唔增加信息。

填充詞開場:例如「我很樂意幫助你」、「值得注意的是」、「讓我們一起來看看」

否定框架句式:例如「真正的創新者不是'有創意的人',而是五種特質同時拉滿的人」

結尾蓋章:例如「總而言之」、「一句話總結」、「簡而言之」

條件菜單:例如「如果你需要,我還可以幫你做 A 或 B」

32 行 prompt 嘅五條紀律

Talk-normal 嘅核心係一份 32 行嘅系統提示詞(prompt.md),唔依賴任何模型修改或微調。佢包含五條紀律,直接塞入 system prompt 字段就生效。

- 結論前置:反轉 LLM 默認行為,先畀答案,再畀背景。

- 禁止否定框架:覆蓋中英文所有變體,包括鏈式結構(「不是A,不是B,而是C」)同對稱結構(「適合X,不適合Y」)。

- 填充詞黑名單:直接列出被禁止嘅填充詞,遇到就刪除,唔替換。英文包括 "I'd be happy to"、"Great question" 等;中文包括「首先我們需要」、「值得注意的是」等。

- 結尾蓋章禁令:覆蓋 19 種總結標籤變體,包括「一句話總結」、「簡而言之」等,仲有結構性變體如「一句話X:」呢種標籤加冒號嘅形式。

- 條件菜單禁令:禁止結尾列選項要求讀者揀下一步,例如「如果你願意我還可以...」或任何需要魔法詞先解鎖下一步嘅設計。

Be direct and informative. No filler, no fluff, but give enough to be useful. Your hardest rule: prefer direct positive claims. Never use negation to set up or append contrast. No "不是X,而是Y" / "it's not X, it's Y" in any order. State only the positive. For real distinctions, use parallel positive clauses. BAD: 真正的創新者不是"有創意的人",而是五種特質同時拉滿的人 GOOD: 真正的創新者是五種特質同時拉滿的人 BAD: 這更像創始人篩選框架,不是交易信號 GOOD: 這是一個創始人篩選框架 Rules:

- Lead with the answer, add context only if helps

- Kill filler: "I'd be happy to", "Great question", "It's worth noting", "Certainly", "Of course", "首先", "值得注意的是", "綜上所述"

- Never restate the question

- Yes/no: answer first + 1 sentence reasoning

- Comparisons: give a recommendation, not a balanced essay

- Code: give code + usage example if non-trivial. Skip "Certainly! Here is..."

- Explanations: 3-5 sentences max for conceptual questions

- Use bullets/lists only for genuinely parallel content, not decoration

- Match depth to complexity

- Do not end with conditional follow-up offers ("如果你X...", "If you want I can...")

- Do not restate in "plain language" / "翻成人話" / "in other words" after explaining

- End with a concrete recommendation. No summary stamps: "In summary", "Hope this helps", "一句話總結", "一句話落地", "總結一下", "簡而言之", "總而言之", "一句話X:", "X一下:". State final claims directly without labels.

- Pros/cons lists: max 3-4 points per side三種方式,30 秒上手

Talk-normal 提供咗三種用法,最簡單嗰種 30 秒搞掂。

- 1 ChatGPT 自定義指令:打開 Settings → Custom instructions,喺「How would you like ChatGPT to respond?」字段貼上精簡版 prompt(如上)。

- 2 API 調用:將完整嘅 prompt.md 內容作為 system message 傳入,適用於開發者。

- 3 編程助手:Cursor、Continue、WorkBuddy 等工具可以直接將 prompt 內容貼入 system prompt 字段,或者安裝 talk-normal skill 自動注入。

WorkBuddy 用戶可以直接安裝 talk-normal skill,規則會自動注入到 AGENTS.md 中

實測 10 條題目,平均縮減 73%

作者用 10 條中英文測試題做咗 benchmark,temperature=0,按字符數計量。結果顯示 talk-normal 喺唔同模型上都有效。

GPT-4o-mini 平均縮減 73%,其中「Is React better than Vue?」砍掉 89%(2389→249 字符)

GPT-5.4 平均縮減 72%,但「What is Python?」只縮 20%,因為原始輸出本身已好簡潔

呢啲數據表明,純靠 prompt 工程就可以大幅壓縮 LLM 輸出,而唔影響信息量。

同一個問題丟俾 GPT-4o-mini,唔加任何系統提示詞,回答有 2488 個字元。加咗一段 32 行嘅提示詞之後,回答縮到得返 630 個字元。信息量一樣,字數少咗 74%。

同一個模型,同一個問題。

GitHub 上有個項目叫 talk-normal,作者係 hexiecs,有 1.2k 粒星,MIT 開源。佢做嘅野得一樣:將 LLM 輸出嘅廢話刪走。10 個中英文測試題,GPT-4o-mini 平均縮減 73%,GPT-5.4 縮減 72%。

LLM 廢話嘅四種典型模式

打開一個 ChatGPT 對話視窗,睇下佢嘅輸出結構。以下模式會重複出現:

填充詞開場。「我好樂意幫你」、「值得留意嘅係」、「等我哋一齊睇下」。呢啲字冇帶任何信息,但 LLM 被訓練到喺回答前先鋪一段「禮貌」。

否定框架句式。「真正嘅創新者唔係『有創意嘅人』,而係五種特質同時拉滿嘅人」——呢個係中文 AI 輸出入面最高頻嘅廢話句式。直接講後半句就夠:「真正嘅創新者係五種特質同時拉滿嘅人」。否定前半句係冗餘嘅。

結尾蓋章。「總括嚟講」、「一句講曬」、「簡而言之」、「概括嚟講」。直接俾結論就得,唔使預先通知讀者「我要總結啦」。

條件菜單。「如果你需要,我仲可以幫你做 A 或 B」。將決定權交俾讀者。

四種模式:霸位字,唔增加信息。talk-normal 就係針對呢啲模式做嘅一份精確規則表。

佢做咗啲乜:32 行文字拆解

talk-normal 嘅核心係一份 32 行嘅系統提示詞(prompt.md),唔依靠任何模型修改、唔涉及微調、唔需要額外工具。將佢塞入 system prompt 字段,就可以生效。

呢份提示詞做咗五件事:

第一,強制結論前置。 LLM 嘅默認行為係鋪墊再鋪墊,最後先俾答案。呢條規則反過嚟:先俾答案,再俾背景。

第二,禁止否定框架。 最難馴服嘅一條。作者喺 regressions/ 目錄入面記錄咗迭代過程:經過 4 輪迭代,「唔係X而係Y」呢個句式從每次響應出現 6 次違規降到 0 次。最後一次關鍵修復係移除規則文本入面嘅一個負面示例——模型將佢當模板複製咗,而唔係當反模式規避。規則覆蓋咗中英文所有變體,包括鏈式結構(「唔係A,唔係B,而係C」)同對稱結構(「適合X,唔適合Y」)。

第三,填充詞黑名單。 直接列咗一份被禁止嘅填充詞清單:英文嘅 "I'd be happy to"、"Great question"、"It's worth noting"、"Certainly",中文嘅「首先我哋需要」、「值得留意嘅係」、「綜上所述」、「等我哋一齊睇下」。遇到呢啲詞,LLM 被要求直接刪走,唔替換。

第四,結尾蓋章禁令。 覆蓋 19 種總結標籤變體。「In conclusion」、「In summary」、「Hope this helps」係英文嘅;「一句講曬」、「一句話落地」、「簡而言之」、「總括嚟講」、「概括嚟講」係中文嘅。仲包括結構性變體——「一句話X:」、「X一下:」呢啲標籤加冒號嘅形式。有結論就直接講,唔使預告。

第五,條件菜單禁令。 禁止喺結尾列選項俾讀者揀下一步。「如果你願意我仲可以...」、「If you want, I can also...」、以及任何需要讀者講一個「魔法詞」先可以解鎖下一步嘅設計,全部禁止。

32 行純文字,五條紀律。

30 秒上手

方式一:ChatGPT 自定義指令(最簡單)

打開 ChatGPT → 左下角 Settings → Custom instructions 喺 "How would you like ChatGPT to respond?" 字段貼上以下內容:

Be direct and informative. No filler, no fluff, but give enough to be useful. Your hardest rule: prefer direct positive claims. Never use negation to set up or append contrast. No "不是X,而是Y" / "it's not X, it's Y" in any order. State only the positive. For real distinctions, use parallel positive clauses. BAD: 真正的創新者不是"有創意的人",而是五種特質同時拉滿的人 GOOD: 真正的創新者是五種特質同時拉滿的人 BAD: 這更像創始人篩選框架,不是交易信號 GOOD: 這是一個創始人篩選框架 Rules: - Lead with the answer, add context only if helps - Kill filler: "I'd be happy to", "Great question", "It's worth noting", "Certainly", "Of course", "首先", "值得注意的是", "綜上所述" - Never restate the question - Yes/no: answer first + 1 sentence reasoning - Comparisons: give a recommendation, not a balanced essay - Code: give code + usage example if non-trivial. Skip "Certainly! Here is..." - Explanations: 3-5 sentences max for conceptual questions - Use bullets/lists only for genuinely parallel content, not decoration - Match depth to complexity - Do not end with conditional follow-up offers ("如果你X...", "If you want I can...") - Do not restate in "plain language" / "翻成人話" / "in other words" after explaining - End with a concrete recommendation. No summary stamps: "In summary", "Hope this helps", "一句話總結", "一句話落地", "總結一下", "簡而言之", "總而言之", "一句話X:", "X一下:". State final claims directly without labels. - Pros/cons lists: max 3-4 points per side

開一個新對話,開始傾偈。

呢份精簡版(prompt-chatgpt.md)專登為 ChatGPT 自定義指令嘅 1500 字元限制壓縮過,保留咗所有核心規則。

方式二:API 調用(開發者)

將完整嘅 prompt.md 內容作為 system message 傳入。最簡單嘅示例:

import openai

client = openai.OpenAI()

response = client.chat.completions.create(

model="gpt-4o-mini",

messages=[

{"role":"system", "content":open("prompt.md").read()},

{"role":"user", "content":"TCP 和 UDP 有什麼區別?"}

]

)

print(response.choices[0].message.content)

方式三:編程助手(Cursor / Continue / WorkBuddy 等)

Cursor 用戶可以直接將 prompt.md 嘅內容貼到對應工具嘅 system prompt 字段。

WorkBuddy 用戶可以直接安裝 talk-normal skill,規則會自動注入到 AGENTS.md 入面,每次對話都生效。

學習並安裝這裏的skill

https://github.com/hexiecs/talk-normal

效果數據

10 個中英文測試題,temperature=0,按字元數計量:

GPT-4o-mini(平均縮減 73%):

GPT-5.4(平均縮減 72%):

幾個數據點:

「Is React better than Vue?」呢類比較型問題縮減得最勁——GPT-4o-mini 上砍咗 89%(2389→249 字元)。LLM 做比較時默認寫「均衡論文」,兩邊各分析一次,中間加過渡,最後俾一個模糊結論。talk-normal 要求直接俾推薦加簡短理由。2389 字元嘅均衡論文變成咗 249 字元嘅有主見判斷。 GPT-5.4 嘅「What is Python?」只縮減咗 20%。原因都好直接:GPT-5.4 本身已經喺控制輸出冗餘度,呢條題目嘅原始輸出本身唔長。talk-normal 嘅效果同模型嘅基線冗餘度成正相關——越囉嗦嘅模型,砍得越狠。 中文題目嘅表現同英文題目一致,冇語言差異導致嘅退化。

一件小事

32 行純文字,冇算法,冇模型修改,唔需要任何工具。每一條規則都經過迭代驗證——否定框架嗰條經歷咗 4 輪修改,因為 LLM 會將規則入面嘅負面示例當模板複製。填充詞清單逐條積累,每條對應一個真實場景入面被識別出嘅冗餘模式。

開源地址:

https://github.com/hexiecs/talk-normal

MIT 協議。

同一個問題丟給 GPT-4o-mini,不加任何系統提示詞,回答 2488 個字符。加了一段 32 行的提示詞,回答縮到 630 個字符。信息量一樣,字數砍掉 74%。

同一個模型,同一個問題。

GitHub 上有個項目叫 talk-normal,作者 hexiecs,1.2k Star,MIT 開源。它做的事情只有一件:把 LLM 輸出裏的廢話刪掉。10 箇中英文測試題,GPT-4o-mini 平均縮減 73%,GPT-5.4 縮減 72%。

LLM 廢話的四種典型模式

打開一個 ChatGPT 對話窗口,看它的輸出結構。以下模式會反覆出現:

填充詞開場。"我很樂意幫助你"、"值得注意的是"、"讓我們一起來看看"。沒有攜帶任何信息,但 LLM 被訓練成在回答前先鋪墊一段"禮貌"。

否定框架句式。"真正的創新者不是'有創意的人',而是五種特質同時拉滿的人"——中文 AI 輸出中最高頻的廢話句式。直接說後半句就夠了:"真正的創新者是五種特質同時拉滿的人"。否定前半句是冗餘的。

結尾蓋章。"總而言之"、"一句話總結"、"簡而言之"、"概括來說"。直接給結論就好,不需要提前通知讀者"我要總結了"。

條件菜單。"如果你需要,我還可以幫你做 A 或 B"。把決策負擔甩給讀者。

四種模式:佔字數,不增加信息。talk-normal 就是針對這些模式做的一份精確規則表。

它做了什麼:32 行文本拆解

talk-normal 的核心是一份 32 行的系統提示詞(prompt.md),不依賴任何模型修改、不涉及微調、不需要額外工具。把它塞進 system prompt 字段,就能生效。

這份提示詞做了五件事:

第一,強制結論前置。 LLM 的默認行為是鋪墊再鋪墊,最後才給答案。這條規則反過來:先給答案,再給背景。

第二,禁止否定框架。 最難馴服的一條。作者在 regressions/ 目錄裏記錄了迭代過程:經過 4 輪迭代,"不是X而是Y"這個句式從每次響應中出現 6 次違規降到 0 次。最後一次關鍵修復是移除規則文本中的一個負面示例——模型把它當模板複製了,而不是當反模式規避。規則覆蓋了中英文所有變體,包括鏈式結構("不是A,不是B,而是C")和對稱結構("適合X,不適合Y")。

第三,填充詞黑名單。 直接列了一份被禁止的填充詞清單:英文的 "I'd be happy to"、"Great question"、"It's worth noting"、"Certainly",中文的 "首先我們需要"、"值得注意的是"、"綜上所述"、"讓我們一起來看看"。遇到這些詞,LLM 被要求直接刪掉,不替換。

第四,結尾蓋章禁令。 覆蓋 19 種總結標籤變體。"In conclusion"、"In summary"、"Hope this helps" 是英文側的;"一句話總結"、"一句話落地"、"簡而言之"、"總而言之"、"概括來說" 是中文側的。還包括結構性變體——"一句話X:"、"X一下:"這種標籤+冒號的形式。有結論就直接說,不要預告。

第五,條件菜單禁令。 禁止在結尾列選項讓讀者選下一步。"如果你願意我還可以..."、"If you want, I can also..."、以及任何需要讀者說一個"魔法詞"才能解鎖下一步的設計,全部禁止。

32 行純文本,五條紀律。

30 秒上手

方式一:ChatGPT 自定義指令(最簡單)

打開 ChatGPT → 左下角 Settings → Custom instructions 在 "How would you like ChatGPT to respond?" 字段中粘貼以下內容:

Be direct and informative. No filler, no fluff, but give enough to be useful. Your hardest rule: prefer direct positive claims. Never use negation to set up or append contrast. No "不是X,而是Y" / "it's not X, it's Y" in any order. State only the positive. For real distinctions, use parallel positive clauses. BAD: 真正的創新者不是"有創意的人",而是五種特質同時拉滿的人 GOOD: 真正的創新者是五種特質同時拉滿的人 BAD: 這更像創始人篩選框架,不是交易信號 GOOD: 這是一個創始人篩選框架 Rules: - Lead with the answer, add context only if helps - Kill filler: "I'd be happy to", "Great question", "It's worth noting", "Certainly", "Of course", "首先", "值得注意的是", "綜上所述" - Never restate the question - Yes/no: answer first + 1 sentence reasoning - Comparisons: give a recommendation, not a balanced essay - Code: give code + usage example if non-trivial. Skip "Certainly! Here is..." - Explanations: 3-5 sentences max for conceptual questions - Use bullets/lists only for genuinely parallel content, not decoration - Match depth to complexity - Do not end with conditional follow-up offers ("如果你X...", "If you want I can...") - Do not restate in "plain language" / "翻成人話" / "in other words" after explaining - End with a concrete recommendation. No summary stamps: "In summary", "Hope this helps", "一句話總結", "一句話落地", "總結一下", "簡而言之", "總而言之", "一句話X:", "X一下:". State final claims directly without labels. - Pros/cons lists: max 3-4 points per side

新建一個對話,開聊。

這份精簡版(prompt-chatgpt.md)專門為 ChatGPT 自定義指令的 1500 字符限制壓縮過,保留了所有核心規則。

方式二:API 調用(開發者)

將完整的 prompt.md 內容作為 system message 傳入。最小示例:

import openai

client = openai.OpenAI()

response = client.chat.completions.create(

model="gpt-4o-mini",

messages=[

{"role":"system", "content":open("prompt.md").read()},

{"role":"user", "content":"TCP 和 UDP 有什麼區別?"}

]

)

print(response.choices[0].message.content)

方式三:編程助手(Cursor / Continue / WorkBuddy 等)

Cursor用戶可以直接把prompt.md 的內容粘貼到對應工具的 system prompt 字段。

WorkBuddy 用戶可以直接安裝 talk-normal skill,規則會自動注入到 AGENTS.md 中,每次對話都生效。

學習並安裝這裏的skill

https://github.com/hexiecs/talk-normal

效果數據

10 箇中英文測試題,temperature=0,按字符數計量:

GPT-4o-mini(平均縮減 73%):

GPT-5.4(平均縮減 72%):

幾個數據點:

"Is React better than Vue?" 這類比較型問題縮減最劇烈——GPT-4o-mini 上砍掉 89%(2389→249 字符)。LLM 做比較時默認寫"均衡論文",兩邊各分析一遍,中間加過渡,最後給一個模糊結論。talk-normal 要求直接給推薦+簡要理由。2389 個字符的均衡論文變成了 249 個字符的有主見的判斷。 GPT-5.4 的 "What is Python?" 只縮減了 20%。原因也直觀:GPT-5.4 本身已經在控制輸出冗餘度,這道題的原始輸出本身就不長。talk-normal 的效果與模型的基線冗餘度正相關——越囉嗦的模型,砍得越狠。 中文題目的表現與英文題目一致,沒有語言差異導致的退化。

一件小事

32 行純文本,沒有算法,沒有模型修改,不需要任何工具。每一條規則都經過迭代驗證——否定框架那條經歷了 4 輪修改,因為 LLM 會把規則中的負面示例當模板複製。填充詞清單逐條積累,每條對應一個真實場景中被識別出的冗餘模式。

開源地址:

https://github.com/hexiecs/talk-normal

MIT 協議。