三分鐘搞定:iPhone 上直接跑 Gemma 4 大模型,端側 AI 徹底變天了

整理版優先睇

Google AI Edge Gallery 讓 iPhone 三分鐘離線跑 Gemma 4,端側 AI 正式進入人人可用時代。

呢篇文章出自一位 AI 工具開發者嘅角度,佢親身測試咗 Google 最新推出嘅 AI Edge Gallery App,體驗 Gemma 4 模型喺 iPhone 上離線運作。作者想解決嘅問題係:一般人點樣可以低門檻、免費、私隱安全咁試用大模型,而唔需要煩惱 API key、雲端費用或者網絡依賴。整體結論係:Gemma 4 配上 AI Edge Gallery,令端側 AI 從概念變成現實,而且安裝只需三分鐘,完全離線支援中文同工具調用。

文章先對比傳統雲端 API 方式同呢個新方式嘅門檻差異,突出後者嘅易用性同成本優勢。然後重點介紹 Agent Skills 功能,話呢個先係真正嘅殺手鐧——模型唔止識傾偈,仲可以調用工具做實際行動,例如查天氣、搜維基。最後實測中文能力,結論係日常對話完全可用,仲有 Thinking Mode 展示推理過程。

作者認為 Google 呢步係搶佔端側 AI 入口,令開發者未來可以考慮唔再接 API,直接用手機模型做應用。文章分析咗呢件事對行業嘅影響:AI 基礎設施由雲端轉向裝置端,用戶數據主權返返自己手。

- App Store 搜「Google AI Edge Gallery」即可下載,三分鐘內離線跑 Gemma 4,無需科學上網或 API Key。

- Agent Skills 令模型具備工具調用能力,可查維基百科、生成地圖、顯示信息卡,唔再淨係傾偈。

- Gemma-4-E2B-it 中文能力完全可用,日常對話、知識問答、摘要推理流暢;複雜數學同長篇代碼表現一般。

- Thinking Mode 顯示逐步推理過程,係理解 AI 邏輯嘅視窗;Ask Image 可識別圖片內容。

- 端側 AI 格局改寫:開發者未來可零成本用手機模型做應用,唔洗靠 API,用戶數據唔出設備。

三分鐘搞掂:iPhone 離線跑 Gemma 4

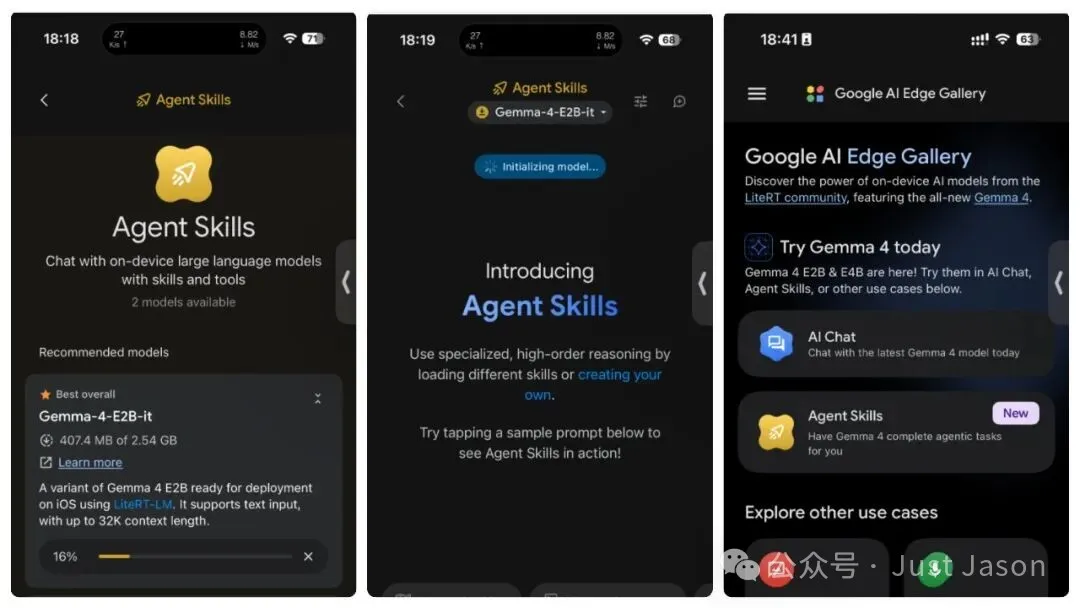

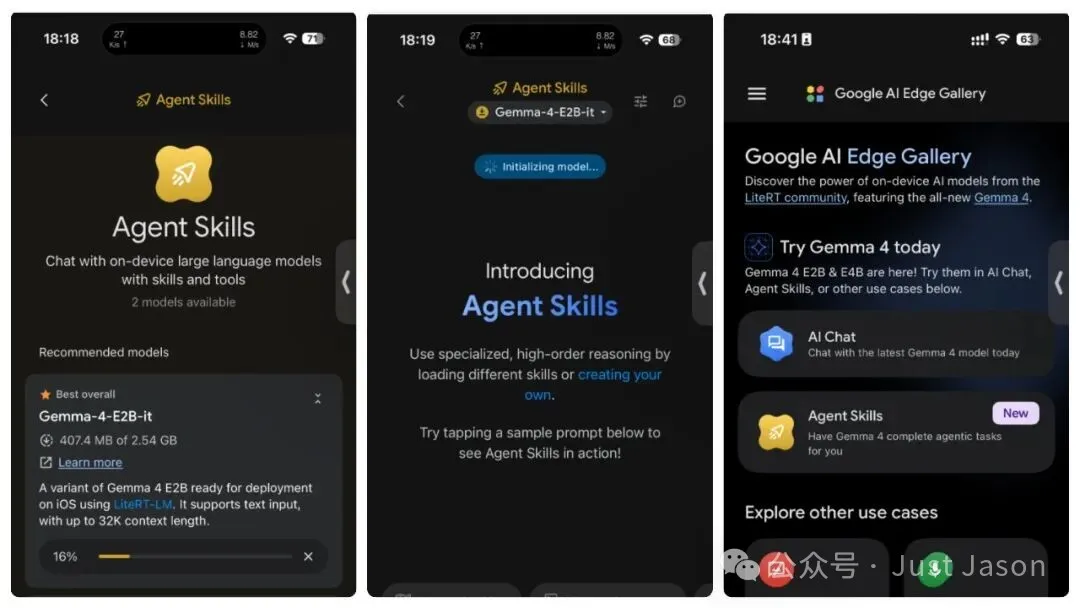

Google AI Edge Gallery 係 App Store 搜到嘅免費 App,安裝之後點「Agent Skills」下載 Gemma-4-E2B-it 模型(約 2.54GB),等兩三分鐘就用到。唔使註冊、登錄、API Key 或信用卡,模型行喺手機 chip 上,完全離線工作,數據唔使出設備。

呢個係我見過門檻最低嘅大模型體驗方式,沒有之一。

- 1 App Store 搜「Google AI Edge Gallery」下載安裝,30 秒。

- 2 打開 App,點「Agent Skills」,5 秒。

- 3 揀 Gemma-4-E2B-it,下載 2.54GB,2-3 分鐘搞定。

對比傳統雲端 API 方式:以前要註冊賬號、申請 API Key、綁信用卡、仲要連線,依家門檻得一個——你部 iPhone 仲有冇 3GB 位。

Agent Skills 先係真正殺手鐧

大多數人以為大模型淨係用嚟傾偈,但 Google AI Edge Gallery 嘅核心係 Agent Skills——模型可以主動調用工具幫你做事,唔係淨係生成文字。

佢令手機上嘅模型第一次具備「行動能力」。

- AI Chat:多輪對話,支援 Thinking Mode 展示推理過程。

- Agent Skills:工具調用,例如查維基百科、生成地圖、展示信息卡片。

- Ask Image:影相或揀相,模型直接睇圖回答問題。

- Audio Scribe:語音實時轉文字,支援翻譯。

- Prompt Lab:調 temperature、top-k 參數,測試特定場景。

舉例:你問「上海聽日天氣點樣」,傳統模型可能亂作答案,但 Agent Skills 嘅 Gemma 4 會調用真實天氣工具再整理畀你。社羣仲喺 GitHub Discussions 分享自定義 Skill,可以透過 URL 加載第三方 Skill。

中文實測:日常對話完全可用

好多人對端側模型嘅印象停留喺「英文得,中文唔掂」。實測 Gemma-4-E2B-it,中文能力完全可用。日常對話、知識問答、文本摘要、簡單推理表現都超出預期。

E2B 係等效 2B 參數輕量模型,複雜數學同長篇代碼唔係強項。

- 日常中文對話:流暢自然。

- 知識問答:基本準確。

- 文本摘要:抓重點能力強。

- 簡單推理:邏輯清晰。

- 複雜數學:偶有錯誤。

- 長篇代碼:不如大參數模型。

- 圖片理解:識別準確,中文描述。

另一個驚喜係 Thinking Mode,打開後模型會展示逐步推理過程,你可以睇到佢點樣「諗嘢」。Ask Image 功能:對住菜單影相,模型直接講每道菜係咩、大概幾錢,全部離線完成。

端側 AI 格局正在重寫

谷歌嘅意圖好清楚:將 AI 入口由雲端拉返去裝置端。蘋果嘅 Apple Intelligence 仲喺度磨蹭,谷歌已經將 Gemma 4 送入 iPhone。呢個唔係技術 PR——係喺蘋果地盤搶佔端側 AI 入口。

恕唔支援 table type,用 bullet 代替

- 雲端時代:模型入口係瀏覽器/API,算力喺數據中心,成本按量計費,數據主權由平台控制,可用性依賴網絡。

- 端側時代:模型入口係手機 App,算力喺手機芯片,成本一次下載無限使用,數據主權歸用戶自持,可用性隨時隨地。

更深層嘅影響:當每部手機都行到大模型,AI 基礎設施就由「雲」變「端」。API 調用模式唔會消失,但唔再係唯一選擇。用戶有咗第二條路——免費、離線、數據唔出設備。

AI 從雲端遷移到口袋

由 Gemma 4 開源發佈到三分鐘喺 iPhone 跑起,谷歌用 48 小時完成咗從「模型發佈」到「人人可用」嘅閉環。下載一個 App,三分鐘,你就擁有一個永遠在線、永遠免費嘅 AI 助手。

端側 AI 唔再係實驗室嘅玩具,而係每個人手中嘅工具。

呢篇文章仲提到作者自家產品 Zaokit AI,不過呢度唔展開。

昨日先寫完 Gemma 4 開源發佈,今日就有人問我:呢樣嘢喺 iPhone 上跑唔跑到?

得。仲簡單到離曬譜添。

App Store 搜「Google AI Edge Gallery」→ 下載 → 打開 → 㩒 Agent Skills → 下載模型 → 搞掂。 三分鐘,唔使科學上網,唔使 API Key,唔使配任何環境。

端側大模型唔再係 PPT 上面嘅概念。Gemma 4 喺 iPhone 上跑,完全離線,支援中文,有工具調用——呢件事今日每個人都做到。徹底變曬天。

先講結論——呢個係我見過門檻最低嘅大模型體驗方式,冇之一。

下載完就用得。冇註冊、冇登錄、冇 Token 額度限制。 模型跑喺你手機嘅晶片上面,數據唔出設備,完全離線工作。

對比一下傳統方式:

以前想體驗大模型,門檻係技術;而家門檻淨係得一個——你部 iPhone 嘅儲存空間夠唔夠放 3GB 模型。

二、唔止係傾偈——Agent Skills 先係真正嘅殺手鐧

大多數人用大模型就係「傾偈」。但 Google AI Edge Gallery 嘅核心功能唔係 AI Chat——係 Agent Skills。

即係咩意思?模型唔止回答你嘅問題,佢仲可以主動調用工具幫你做事。

| AI Chat | |

| Agent Skills | |

| Ask Image | |

| Audio Scribe | |

| Prompt Lab |

重點講 Agent Skills。佢令手機上面嘅模型第一次具備「行動能力」——唔止係生成文字,而係可以好似一個助手噉操作工具、查資訊、組合行動。

舉個例:你問佢「上海聽日天氣點樣」,傳統傾偈模型淨係識得作個答案。但係帶 Agent Skills 嘅 Gemma 4,可以調用工具去查真實數據,再將結果整理畀你。

社區仲喺 GitHub Discussions 上分享自訂 Skill,你甚至可以經 URL 加載第三方 Skill。呢個唔係一個傾偈 App——呢個係一個可擴展嘅端側 AI Agent 平台。

當模型跑喺手機上,仲可以調工具、查資訊、做決策——「AI Agent」就唔再係需要伺服器支撐嘅概念。佢已經裝咗入你個袋。

三、中文實測:到底用唔用得?

好多人對端側模型嘅印象仲停留喺「英文仲可以,中文好差」。

實測結論:Gemma-4-E2B-it 嘅中文能力完全用得。 日常對話、知識問答、文本摘要、簡單推理——表現超出預期。

當然,E2B 始終係等效 2B 參數嘅輕量模型,複雜數學推理同長篇程式碼生成唔係佢嘅強項。 但作為一個跑喺手機上嘅離線助手,佢嘅性價比無敵:

另一個令我驚喜嘅功能係 Thinking Mode。 開咗之後,模型會展示逐步推理過程——你可以見到佢點樣「諗嘢」。呢個唔止係一個 debug 工具,更加係理解 AI 推理邏輯嘅窗口。

仲有 Ask Image 功能:對住一張餐牌影相,模型直接話畀你知每道菜係咩、大概幾多錢。喺手機上,離線狀態下。

端側模型嘅中文能力已經跨過咗「用得」嘅門檻。對於唔想按 Token 俾錢、唔想數據上雲嘅用戶嚟講,呢個就係最好嘅選擇。

四、呢個代表咩?端側 AI 格局正在改寫

Google 做呢件事嘅意圖好清楚——將 AI 嘅入口由雲端拉返去設備端。

蘋果嘅 Apple Intelligence 仲喺度拖拖拉拉,Google 已經將 Gemma 4 送入咗 iPhone。呢個唔係技術 PR——呢個係喺蘋果嘅地盤上搶佔端側 AI 嘅入口。

更深層嘅影響在於:當每部手機都跑到大模型時,AI 嘅基礎設施就由「雲」變咗做「端」。 API 調用模式唔會消失,但佢唔再係唯一選擇。用戶有咗第二條路——免費、離線、數據唔出設備。

對開發者嚟講,呢個代表一件事:你嘅下一個 AI 應用,唔一定要接 API。 Gemma 4 + AI Edge Gallery 嘅組合,已經可以支撐相當多嘅應用場景,而且零成本。

端側 AI 唔係雲端 AI 嘅降級替代品——佢係另一條路。當 Google 將 Gemma 4 塞入 iPhone 時,呢條路已經鋪好咗。Apple 應該緊張啦。

寫在最後

由尋日 Gemma 4 開源發佈,到今日三分鐘喺 iPhone 上跑起——Google 用 48 小時完成咗由「模型發佈」到「人人可用」嘅閉環。

我一個人打造嘅 Zaokit AI[1] 正在內測,前 1000 名用戶贈送價值 150 RMB 嘅 Pro 計劃,助力大家高效完成圖文創作同 PPT 生成,唯一網站:zaokit.app[1]。

AI 正由雲端搬到口袋裏。Gemma 4 跑喺 iPhone 上呢件事,標誌住一個時代嘅分水嶺——端側 AI 唔再係實驗室嘅玩具,而係每個人手中嘅工具。下載一個 App,三分鐘,你就擁有咗一個永遠在線、永遠免費嘅 AI 助手。

相關閲讀

AI 模型與端側部署系列

• 太誇張,Google 凌晨直接王炸:Gemma 4 開源,本地跑,推理成本接近零 • Apple 終於鬆口:Mac 外接 AMD / NVIDIA 顯示卡驅動正式放行 • Apple 無心插柳:Mac Studio 就快斷貨,因為 Token 已經係生產力

引用連結

[1] Zaokit AI: https://zaokit.app

昨天剛寫完 Gemma 4 開源發佈,今天就有人問我:這東西能在 iPhone 上跑嗎?

能。而且簡單到離譜。

App Store 搜索「Google AI Edge Gallery」→ 下載 → 打開 → 點 Agent Skills → 下載模型 → 完事。 三分鐘,不需要科學上網,不需要 API Key,不需要配任何環境。

端側大模型不再是 PPT 上的概念。Gemma 4 跑在 iPhone 上,完全離線,支持中文,帶工具調用——這件事今天每個人都能做到。徹底變天了。

先說結論——這是我見過門檻最低的大模型體驗方式,沒有之一。

下載完就能用。沒有註冊、沒有登錄、沒有 Token 額度限制。 模型跑在你手機的芯片上,數據不出設備,完全離線工作。

對比一下傳統方式:

以前想體驗大模型,門檻是技術;現在門檻只剩一個——你的 iPhone 儲存空間夠不夠放 3GB 模型。

二、不只是聊天——Agent Skills 才是真正的殺器

大多數人用大模型就是「聊天」。但 Google AI Edge Gallery 的核心功能不是 AI Chat——是 Agent Skills。

什麼意思?模型不只是回答你的問題,它還能主動調用工具幫你做事。

| AI Chat | |

| Agent Skills | |

| Ask Image | |

| Audio Scribe | |

| Prompt Lab |

重點說 Agent Skills。它讓手機上的模型第一次具備了「行動能力」——不只是生成文本,而是能像一個助手一樣操作工具、查詢信息、組合行動。

舉個例子:你問它「上海明天天氣怎麼樣」,傳統聊天模型只能瞎編一個答案。但帶 Agent Skills 的 Gemma 4,可以調用工具去查真實數據,再把結果整理給你。

社區還在 GitHub Discussions 上分享自定義 Skill,你甚至可以通過 URL 加載第三方 Skill。這不是一個聊天 App——這是一個可擴展的端側 AI Agent 平台。

當模型跑在手機上,還能調工具、查信息、做決策——「AI Agent」就不再是需要服務器支撐的概念了。它已經裝進了你的口袋。

三、中文實測:到底能不能用?

很多人對端側模型的印象還停留在「英文還行,中文拉胯」。

實測結論:Gemma-4-E2B-it 的中文能力完全可用。 日常對話、知識問答、文本摘要、簡單推理——表現超出預期。

當然,E2B 畢竟是等效 2B 參數的輕量模型,複雜數學推理和長篇代碼生成不是它的強項。 但作為一個跑在手機上的離線助手,它的性價比無敵:

另一個讓我驚喜的功能是 Thinking Mode。 打開後,模型會展示逐步推理過程——你能看到它是怎麼「想」的。這不只是一個 debug 工具,更是理解 AI 推理邏輯的窗口。

還有 Ask Image 功能:對着一張菜單拍照,模型直接告訴你每道菜是什麼、大概多少錢。在手機上,離線狀態下。

端側模型的中文能力已經跨過了「能用」的門檻。對於不想按 Token 付費、不想數據上雲的用戶來說,這就是最好的選擇。

四、這意味着什麼?端側 AI 格局正在重寫

谷歌做這件事的意圖很清楚——把 AI 的入口從雲端拉回設備端。

蘋果的 Apple Intelligence 還在磨磨蹭蹭,谷歌已經把 Gemma 4 送進了 iPhone。這不是技術PR——這是在蘋果的地盤上搶佔端側 AI 的入口。

更深層的影響在於:當每台手機都能跑大模型時,AI 的基礎設施就從「雲」變成了「端」。 API 調用模式不會消失,但它不再是唯一選擇。用戶有了第二條路——免費、離線、數據不出設備。

對開發者來說,這意味着一件事:你的下一個 AI 應用,不一定要接 API。 Gemma 4 + AI Edge Gallery 的組合,已經可以支撐相當多的應用場景,而且零成本。

端側 AI 不是雲端 AI 的降級替代品——它是另一條路。當谷歌把 Gemma 4 塞進 iPhone 時,這條路已經鋪好了。蘋果該緊張了。

寫在最後

從昨天 Gemma 4 開源發佈,到今天三分鐘在 iPhone 上跑起來——谷歌用 48 小時完成了從「模型發佈」到「人人可用」的閉環。

我一個人打造的 Zaokit AI[1] 正在內測,前 1000 名用戶贈送價值 150 RMB 的 Pro 計劃,助力大家高效完成圖文創作和 PPT 生成,唯一網站:zaokit.app[1]。

AI 正在從雲端遷移到口袋裏。Gemma 4 跑在 iPhone 上這件事,標誌着一個時代的分水嶺——端側 AI 不再是實驗室的玩具,而是每個人手中的工具。下載一個 App,三分鐘,你就擁有了一個永遠在線、永遠免費的 AI 助手。

相關閲讀

AI 模型與端側部署系列

• 太捲了,谷歌凌晨直接王炸:Gemma 4 開源,本地跑,推理成本接近零 • 蘋果終於鬆口了:Mac 外接 AMD / NVIDIA 顯卡驅動正式放行 • 蘋果無心插柳:Mac Studio 快斷貨了,因為 Token 已經是生產力

引用連結

[1] Zaokit AI: https://zaokit.app