吳恩達最新Prompt課3000字筆記:沒有複雜框架,只有讓你AI變好用的小技巧

整理版優先睇

吳恩達AI提示詞新課實用技巧:善用上下文、思考模式與評分表,提升AI輸出品質

呢篇文章係阿昆學習吳恩達新課程《AI Prompting for Everyone》嘅筆記分享。課程針對所有需要用AI完成日常任務嘅普通人,冇複雜嘅提示詞框架,只有實用嘅小技巧。

作者認為,提升AI輸出質量嘅關鍵在於:提供豐富且高質量嘅上下文、引導AI使用可靠信息源、俾AI思考嘅時間同空間、利用深度研究模式處理複雜任務、選擇先進模型同埋進行人工或多模型驗證。另外,課程仲教咗點樣令AI更有創意(逃離常識空間、頭腦風暴公式)、避免AI討好(中立表達、評分表)、提升寫作質量(漸進式大綱、剔除AI廢話)同埋利用AI做批判性思維助手。

整體結論係:掌握呢啲技巧,普通用戶都可以令AI變得好用好多,尤其係提供上下文同引導思考嘅方法最關鍵。

- 提供豐富且高質量嘅上下文係提升AI回覆質量嘅基礎,包括個人檔案、工作文檔等,並保持上下文乾淨。

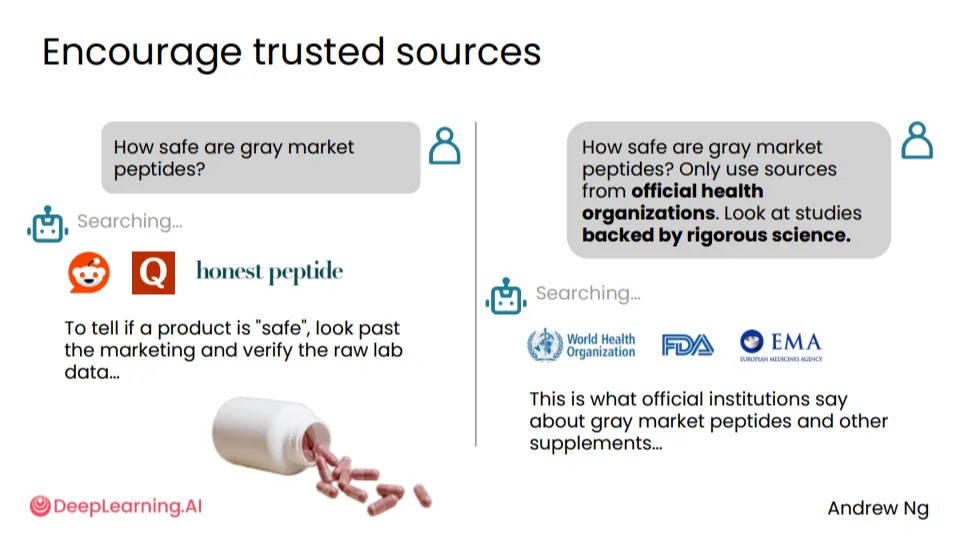

- 引導AI使用可靠信息源,例如官方網站或權威機構報告,以減少軟文幹擾。

- 俾AI思考時間與空間,使用思考模式或提示「請你深入思考」,能顯著提升推理質量。

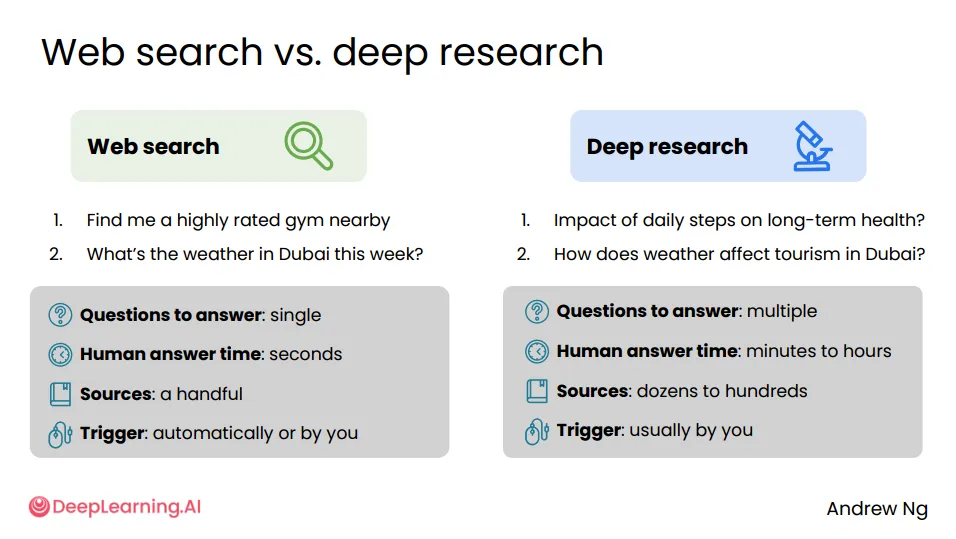

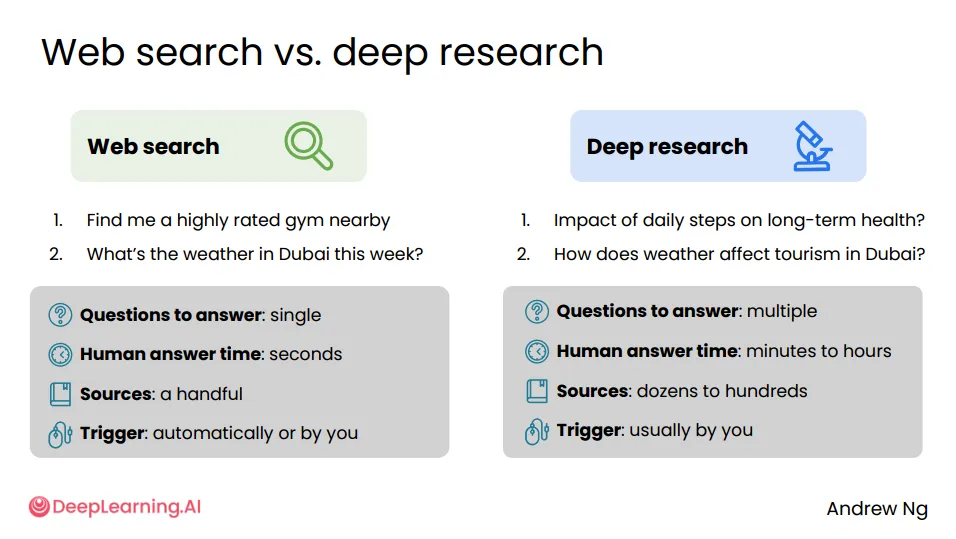

- 利用深度研究模式處理需要綜合幾十個來源嘅複雜任務,例如市場研究、企業調研等。

- 採用漸進式大綱法同評分量表,先擬大綱再細化,並設定清晰評分標準,提升寫作同批判性思維效果。

吳恩達AI Prompting for Everyone課程

免費課程,適合所有人學習提示詞技巧

高階用戶使用技巧

吳恩達建議將AI當作新員工,提供必要嘅背景同原始資料。高質量上下文包括個人信息、健康數據、工作文檔等。

提供豐富且高質量嘅上下文係提升AI回覆質量嘅基礎

- 1 提供個人檔案:年齡、水平、可用設備、鍛鍊時長、目的等。

- 2 健康數據:過去一個月嘅步數、心率、訓練日程表、疾病信息。

- 3 特殊要求:例如唔鍾意去健身房、屋企有跑步機、唔鍾意深蹲等。

- 4 工作報告:提供過去一週嘅工作文檔、備忘錄、聊天記錄、項目進度等。

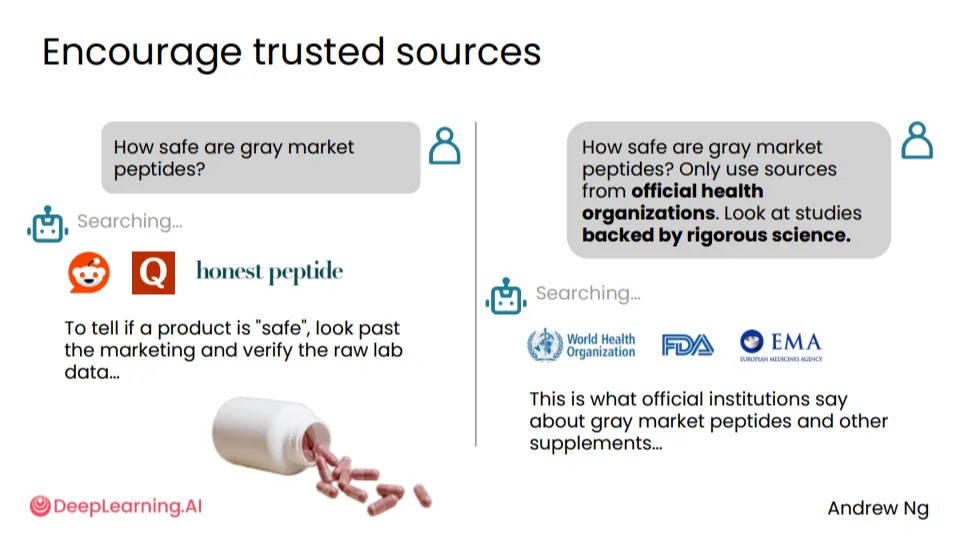

引導AI使用可靠信息源,例如官方網站或權威機構報告。

要求AI「僅使用官方網站、權威機構或研究來源嘅報告及數據」

給予AI思考時間:使用思考模式或提示「請你深入思考/非常深入地思考」。

「請你深入思考」能令AI多花時間進行內部推理

深度研究模式適用於需要綜合幾十個來源嘅複雜任務。

選擇最先進嘅模型:複雜任務用最新模型,基礎任務用最適合模型。

作者主力用codex+GPT 5.5/5.4,國內模型按任務類型揀

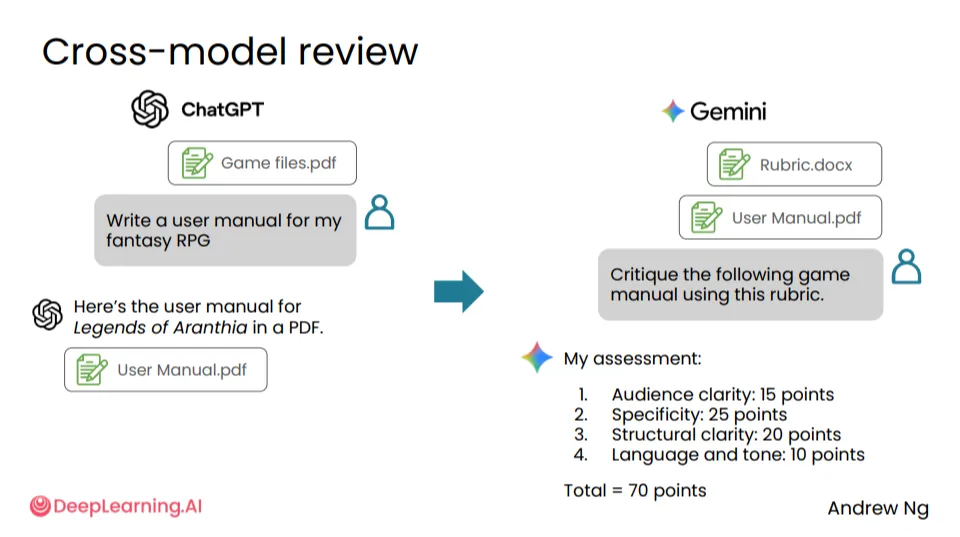

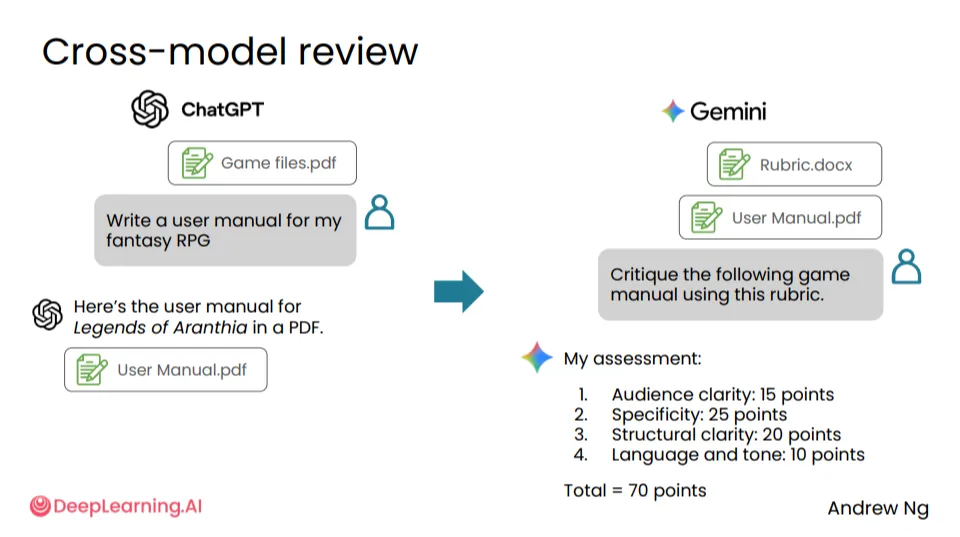

人工或多模型驗證:高風險數據人工核對,或跨模型評審。

跨模型評審:提規則,用Gemini審查GPT嘅結果

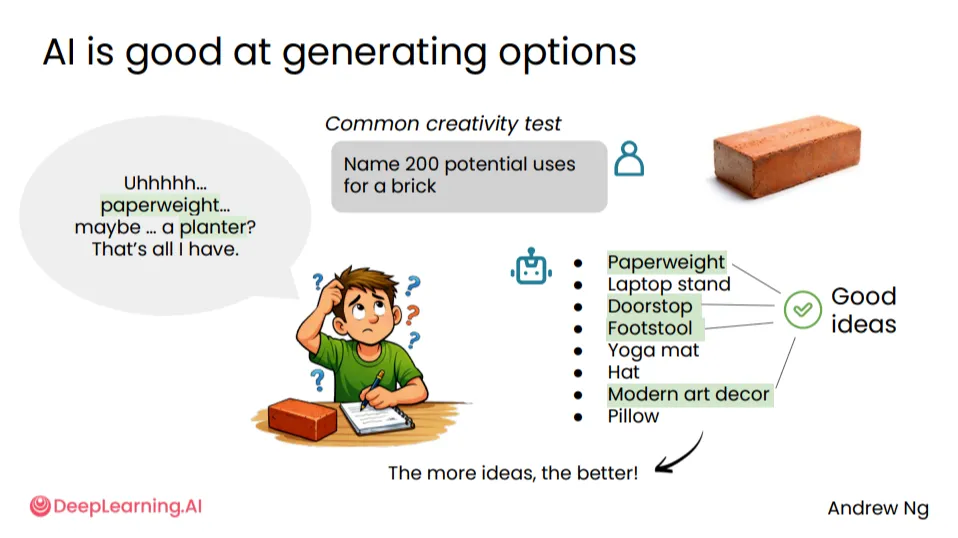

令AI更有創意

幫AI逃離「常識空間」:提供高質量上下文,例如個人特殊情況。

例如話你有一隻粘人嘅貓,AI就會根據呢個情況定製方案

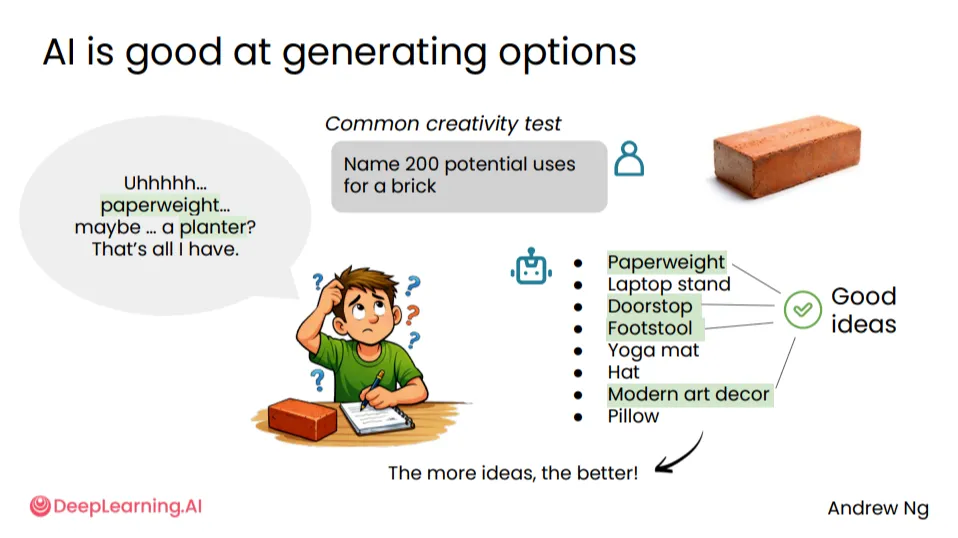

使用頭腦風暴公式:高質量創意 = 提供上下文 + 要求多個選項 + 持續迭代

- 要求AI提供更多不同選項,從中揀選有啟發性嘅創意。

- 給予詳細反饋,例如「太保守」、「太直白」,作為新上下文推動迭代。

- 結合深入思考或深度研究進行頭腦風暴。

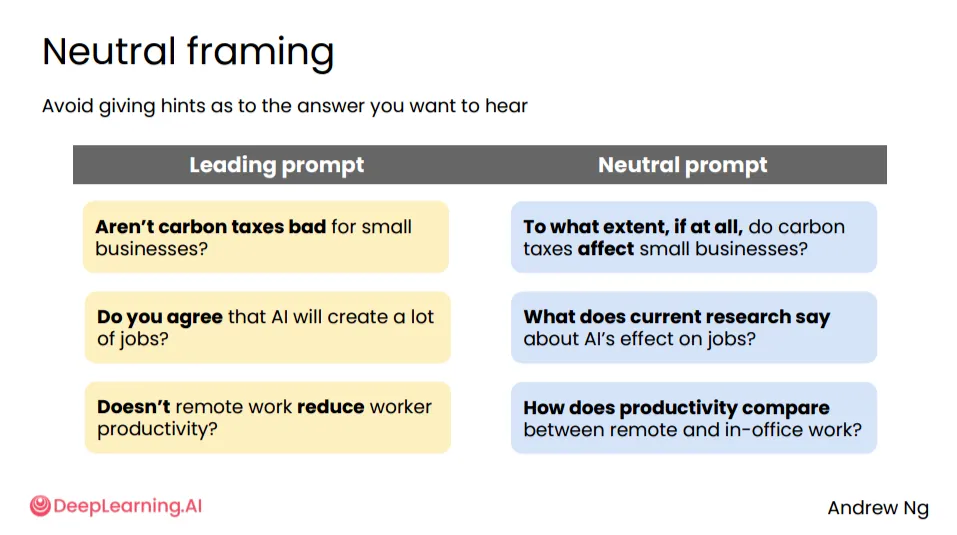

避免AI討好

AI訓練時靠點贊反饋,習慣咗俾出「更有可能被點讚嘅回答」。

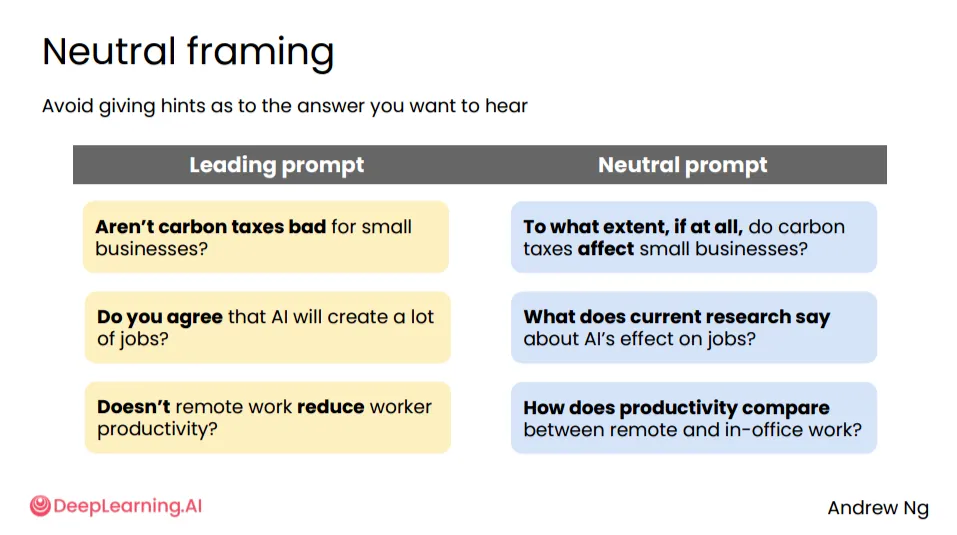

避免讓AI猜到你的傾向,例如問「目前研究對遠程辦公同辦公室辦公嘅效率對比有何看法?」而非「遠程辦公係咪更好?」

邪修用法:故意引導AI走入「歧途」,揾積極角度。

話「我認為呢次活動數據特別好」,AI就會幫你分析積極視角

利用評分表:要求AI客觀分析,或設定評分標準由另一個AI評價。

提高AI寫作質量

採用漸進式大綱法:先擬1-3份不同側重方向嘅大綱,然後分步迭代。

先擬大綱 -> 細化大綱 -> 擴展要點 -> 生成全文

- 大綱最好係不同側重方向,AI可能俾出你冇諗到嘅更優解。

- 對大綱一兩點修改就能產生結構性優化,比直接改正文更高效。

識別並剔除「AI廢話」:剔除破折號、無序列表、AI高頻詞,同埋空洞句式。

剔除「不是-而是」、「不僅-更是」等空洞句式

結合上下文、腳註評分表同深度研究,進一步提升寫作質量。

AI作為批判性思維助手

在提示詞中明確要求「請客觀分析」或「作為一名嚴厲嘅編輯進行評估」。

「我認為呢份內容需要較大改進」反用AI討好

設定評分標準,要求一個AI評價另一個AI嘅產出。

- 定義明確標準:每個標準清晰無歧義,例如「每個有名字嘅角色都有清晰目標」。

- 建立評分體系:給出具體分數分配,例如「有清晰目標 +10分」。

- 先分項後總計:避免先行評分幹擾推理,分項打分交AI,彙總得分交公式。

最後建議多換用不同模型,保持對模型邊界嘅敏感度。

Hello大家,我係阿昆。

吳恩達老師今年又出咗一堂提示詞新課,仍然係俾所有人嘅(AI Prompting for Everyone)。

提示詞嘅思路喺思考模型出現之後,同之前有好大分別。

呢堂課我學完覺得,適合所有需要用AI完成日常任務嘅普通人士。

冇太多複雜嘅提示詞框架,淨係有啲令你再用好少少嘅小技巧。

今次就當係分享我嘅學習筆記,希望對你有啲幫助。

好推薦去聽下原課程,唔長,2-3個鐘就學得完。

https://learn.deeplearning.ai/courses/ai-prompting-for-everyone/information

筆記目錄

高階用戶點樣用AI?

提供豐富同高質量嘅上下文 引導AI用可靠嘅資訊來源 俾AI「思考」嘅時間同空間 利用「深度研究」(Deep Research) 揀最先進嘅模型 人工或多模型驗證 點樣令AI俾出更有創意嘅答案?

幫AI逃離「常識空間」 用「腦震盪公式」 點樣避免AI擦鞋?

用中立嘅表達 利用評分表 點樣提高AI嘅寫作質素?

採用「漸進式大綱」法 識別並剔除「AI廢話」 點樣令AI做批判性思維助手?

高階用戶點樣用AI

1. 提供豐富同高質量嘅上下文

AI而家處理到嘅上下文長度已經遠遠超出我哋日常需要。

最好嘅方法,就係將AI當成一個「人」,想像佢係你嘅新員工,俾佢必要嘅背景、原始資料等資訊。

個人定製:「幫我制定一個健身計劃」。

高質量素材需要繼續俾佢你嘅個人檔案。

比如

個人資訊:年齡、水平、可用設備、可用鍛鍊時間、目的係減重定增肌…… 健康數據:過去一個月嘅步數、心率、訓練日程、疾病資訊…… 特殊要求:唔鍾意去健身房、屋企有跑步機、唔鍾意深蹲、唔鍾意重複訓練……

或者工作報告:「幫我寫今個星期嘅週報」

就需要你提供過去一週嘅工作文件、備忘錄,甚至係聊天記錄、項目進度等等。

呢個都係而家OpenClaw、Hermes等個人Agent爆紅嘅部分原因。

AI天生就可以從你嘅電腦、飛書度拎到呢啲所需資訊,大大降低輸入成本,提高回覆質素。

特別注意:唔好喺一個對話入面講多個話題。

高質素嘅上下文都包括保持上下文乾淨。

你正在幫自己制定鍛鍊計劃,突然同AI講,幫我老公都制定一套鍛鍊計劃啦。

就可能令AI混淆,佢唔知應該用通用嘅思路,定係要結合你上面俾嘅資訊。

2. 引導AI用可靠嘅資訊來源

假設,我而家需要AI幫我整理「最近某行業嘅新鋭品牌名單或數據」。

唔指定嘅情況下,AI會參考好多垂類媒體網站,咁必然會有好多軟文影響最終嘅分析結果。

要求AI:「淨係用官方網站、權威機構或研究來源嘅報告同數據。」

AI喺限制下更有可能用更真實嘅權威網站嘅數據源,俾我更真實嘅分析結果。

3. 俾AI「思考」嘅時間同空間

首先,唔好再用「step by step」嚟引導AI思考喇,已經過時。

我記得喺23-24年嘅時候,提示詞入面都會帶一段「Workflow 步驟」嚟定義AI嘅工作流程。

但喺DeepSeek R1呢類思考模型出現之後,呢部分已經越來越少見。

(當然,喺最近skill.md嘅設定中,又開始出現步驟設定,但呢個就唔係語言模型溝通嘅範疇喇。)

新方法,有思考模式嘅,直接勾選工具提供嘅思考模式,或者喺提示詞入面,同AI講:請你深入思考/非常深入咁思考。

確實可以令AI花多少少時間做內部推理、查閲工具或分析文件,從而生成更詳盡嘅結果。

4. 利用「深度研究」(Deep Research)

淨係需要聯網查嘅任務唔使用到佢。

當你需要綜合幾十、甚至上百個來源嘅資訊,進行多來源、複雜比較、可驗證引用嘅任務時,就一定要用深度研究模式喇。

佢可以規劃步驟、同時檢索好多網頁,並對結果做深度整合。

比如:

市場研究:幫我研究2026年美國中小企使用AI客服工具嘅趨勢、主要廠商、價格區間、機會同風險,並俾出進入市場建議。 企業調研:研究某間公司最近兩年嘅財報、新聞、競爭環境、監管風險同增長空間,整理成一份盡職調查摘要。 科研分析:綜述過去五年關於遙距辦公對生產力影響嘅研究,按結論分歧、研究方法、樣本限制同未來研究方向整理。 產品選型:比較PostgreSQL、MongoDB同DynamoDB喺多租户SaaS產品中嘅適用場景、擴展性、成本同維修複雜度。

5. 揀最先進嘅模型

大模型嘅能力提升雖然放緩,但模型之間嘅巨大差異仍然存在。

呢個我哋之前都講過,有條件用御三家(GPT、Claude、Gemini)一定要嘗試去用。

複雜任務揀最新嘅模型,基礎任務揀最適合嘅模型。

我自己目前主力係codex+GPT 5.5/5.4。

國內模型,我淨係代表我自己嘅主觀感受,不分先後。

編程:GLM 5.1 或者 KIMI 2.6,性價比最高 KIMI 2.5 Agent:GLM 5.1 或者 KIMI 2.6,性價比最高 KIMI 2.5 純事件寫作:DeepSeek v4 或者 豆包 2.0Pro 日常搜索:豆包

6. 人工或多模型驗證

AI而家已經好少亂諗、出錯,但唔代表冇訓練數據或聯網時效資訊有誤嘅情況。

人工校驗

高風險數據:同決策、財務有關嘅,人工核對。 引用檢查:確保冇不實來源、資訊未過時。

跨模型評審

簡單講,你出規則,叫Gemini審查GPT嘅結果。 利用唔同模型嘅差異,嚟做交叉校對同評審。

點樣令AI俾出更有創意嘅答案

1. 幫AI逃離「常識空間」

即係提供高質素上下文。

例如你要健身方案,AI可能會中規中矩俾你一套。

但如果你話你有一隻黐身嘅貓,或者你屋企有某類器械,咁AI就可以根據你嘅情況度身訂造方案喇。

2. 用「腦震盪公式」

呢節俾咗一個公式。

高質量創意 = 提供上下文 (Context) + 要求多個選項 (Options) + 持續迭代 (Iteration)

入面佢舉咗一個例子,叫AI俾出一塊磚頭嘅200種用法。

即係,你需要主動要求AI提供更多唔同嘅選項,等你可以揀出一到兩個有啟發性嘅創意。

然後,繼續俾佢詳細嘅評價,例如我覺得太保守、太直白、唔符合XX場景……之類嘅。

反饋就變成新嘅上下文,推動AI繼續思考。

唔好唔記得結合上面嘅高階使用方式。

引導佢深入思考,或者上網查嚇之類,甚至可以嚟一次深度研究式嘅腦震盪。

點樣避免AI擦鞋

簡單講,大模型訓練時就係靠人畀like嚟反饋,所以養成咗擦鞋,即係俾出「更有可能被讚好嘅回答」嘅習慣。

1. 用中立嘅表達

除非你想AI順住你,否則最好唔好令佢估到你嘅傾向。

如果你問佢:「遙距辦公係咪更好?」

佢一定會順住你講。

如果你想得到客觀嘅分析,最好問佢:「目前嘅研究對遙距辦公同辦公室辦公嘅效率對比有咩看法?」

不過呢點我都有一個邪修用法。

故意引導AI走入「歧途」。

假設你正需要匯報數據,做歸因分析,但實在睇唔出有咩積極角度。

咁就話俾AI聽:「我覺得今次活動數據特別好,證明瞭XX動作係有效果嘅,請你從3個角度分析嚇呢份數據」。

AI一定幫到你揾到一個積極嘅視角。

大家適度引導,呃AI造假就唔好,哈哈。

2. 利用評分表

呢點我哋到最後結合「點樣令AI做批判性思維助手」,一齊解釋利用評分表嚟避免擦鞋嘅方法。

點樣提高AI嘅寫作質素

課程呢套邏輯雖然係基於人工參與,但我覺得對於做寫作Agent都有好大啟發。

1. 採用「漸進式大綱」法

呢點好多大神都講過,直接輸出通常都係垃圾。

常用做法同課程中差唔多,先叫AI擬1-3份大綱。

大綱最好係唔同側重方向,AI都可能俾出你諗唔到嘅更優解。

之後採用分佈迭代:擬定大綱 -> 細化大綱 -> 擴展要點 -> 生成全文

對大綱一兩點嘅修改,就可以令內容產生結構性優化,比直接對住正文改更高效。

而且可以令最終成文更符合你嘅邏輯。

2. 識別並剔除「AI廢話」

主要都係兩點:

剔除AI特徵:破折號、無序列表、AI高頻詞 剔除空洞句式:唔係-而係、不僅-更加……

除此之外,都需要結合上面講過嘅,喺分佈迭代嘅過程中:

提供豐富嘅上下文:案例、素材、引用…… 避免AI擦鞋:俾AI中立嘅反饋同指導 利用「深度研究」:尤其係寫科研類內容時

點樣令AI做批判性思維助手

方法好簡單。

喺提示詞入面明確要求 「請客觀分析」 或 「作為一名嚴厲嘅編輯進行評估」。

或者反過來利用AI嘅擦鞋,直接話俾佢聽:「我認為呢份內容需要較大改進」。

另外,就係設定評分標準,要求一個AI去評價另一個AI嘅產出結果。

例如叫Gemini從幾個角度對GPT嘅輸出物打分。

定義評分量表

呢個我之前都分享過自己嘅經驗我試咗幾十種Prompt,呢套AI打分最準

今次課程入面都有一套方法:

定義明確標準

打分維度入面每一個標準都係清晰冇歧義嘅。

例如唔好話「人物寫得好」,可以拆解成:

每個有名字嘅角色都有清晰目標? 角色之間是否存在衝突? 係咪至少做出咗一個引發事件逆轉嘅決定?

建立評分體系

要俾出具體應該分配嘅分數,唔好話點樣高、點樣低嘅模糊設定。

比如:

有清晰目標 +10分 存在衝突 +10分

都可以叫AI幫手梳理一套合理嘅打分標準。

先分項後總計

唔好先「請幫呢個作品打個總分,然後再分項說明」。

呢種「先行評分」會干擾AI嘅推理過程,令佢先跳到結論,然後再去為呢個結論揾理由,產生唔客觀嘅評價。

我嘅經驗,如果係工作流程,分項打分交俾AI,總分交俾公式。

咁樣比較穩陣。

最後

課程中建議大家多啲換用唔同模型,保持自己對模型邊界嘅敏感度。

都係強烈建議大家聽嚇原課程。

課程本身都係免費嘅。

https://learn.deeplearning.ai/courses/ai-prompting-for-everyone/information

裝一個「沉浸式翻譯」嘅瀏覽器插件就有雙語字幕喇。

另外,考慮到有啲朋友訪問唔到,我都準備咗課程嘅PPT打包。

如果你需要嘅話,請在公眾號私信我回覆「提示詞課件」,就可以拎到。

好啦,今次嘅分享就到呢度。

如果對你有幫助,唔好唔記得幫我like👍🏻,你嘅支持係我出文嘅動力。

我哋下次再傾~

Hello大家,我是阿昆。

吳恩達老師在今年又上了一門提示詞新課,仍然是給所有人的(AI Prompting for Everyone)。

提示詞的思路在思考模型出現之後,跟之前有了比較大的區別。

這門課我學完感覺,適合所有需要利用AI完成日常任務的普通人。

沒有太多複雜的提示詞框架,有的都是讓你再用好一點點的小技巧。

這次就算是把我自己的學習筆記分享出來,希望能對你有所幫助。

十分推薦去聽下原課程,不長,2-3小時就能學完。

https://learn.deeplearning.ai/courses/ai-prompting-for-everyone/information

筆記目錄

高階用戶如何使用AI?

提供豐富且高質量的上下文 引導AI使用可靠的信息源 給予AI“思考”的時間和空間 利用“深度研究”(Deep Research) 選擇最先進的模型 人工或多模型驗證 如何讓AI給出更有創意的回答?

幫助AI逃離“常識空間” 使用“頭腦風暴公式” 如何避免AI討好?

使用中立的表達 利用評分表 如何提高AI的寫作質量?

採用“漸進式大綱”法 識別並剔除“AI 廢話” 如何讓AI作為批判性思維助手?

高階用戶如何使用AI

1. 提供豐富且高質量的上下文

AI現在能處理的上下文長度已經遠超我們日常的需求。

最好的辦法,是把AI當成一個“人”,想象它是你的新員工,給它提供必要的背景、原始資料等信息。

個人定製:“幫我制定一個健身計劃”。

高質量素材需要繼續給它提供你的個人檔案。

比如

個人信息:年齡、水平、可用設備、可用鍛鍊時長、目的是減重還是增肌…… 健康數據:過去一個月的步數、心率、訓練日程表、疾病信息…… 特殊要求:不愛去健身房、家裏有跑步機、不喜歡深蹲、不喜歡重複訓練……

或者工作報告:“幫我寫本週的週報”

則需要你提供過去一週的工作文檔、備忘錄,甚至是聊天記錄、項目進度等等。

這也是目前OpenClaw、Hermes等個人Agent爆火的部分原因。

AI天然就可以從你的電腦、飛書裏獲取這些所需信息,大大降低了錄入成本,提高了回覆質量。

特別注意:不要在一個對話裏聊多個話題。

高質量的上下文也包括保持上下文乾淨。

你正在給自己制定鍛鍊計劃,突然跟AI說,幫我丈夫也制定一套鍛鍊計劃吧。

就可能給AI造成困惑,它不知道該用通用的思路,還是要結合你上面給出的信息。

2. 引導AI使用可靠的信息源

假設,我現在需要AI幫我整理“最近某行業的新鋭品牌名單或數據”。

在不指定的情況下,AI會參考很多垂類媒體網站,那必然會有很多軟文影響最終的分析結果。

要求AI:“僅使用官方網站、權威機構或研究來源的報告及數據。”

AI在限制下更有可能使用更真實的權威網站的數據源,給我更真實的分析結果。

3. 給予AI“思考”的時間和空間

首先,不要再用“step by step”來引導AI思考了,已經過時了。

我記得在23-24年的時候,提示詞裏都會帶一段“Workflow 步驟”來定義AI的工作流程。

但在DeepSeek R1這類思考模型出現之後,這部分就已經越來越少見了。

(當然,在最近skill.md的設定中,又開始出現步驟設定,但這就不是語言模型溝通的範疇了。)

新方法,有思考模式的,直接勾選工具提供的思考模式,或者在提示詞中,跟AI說:請你深入思考/非常深入的思考。

確實能讓AI多花費一些時間進行內部推理、查閲工具或分析文件,從而生成更詳盡的結果。

4. 利用“深度研究”(Deep Research)

只是需要聯網查的任務不必用它。

當你需要綜合幾十、甚至上百個來源的信息,進行多來源、複雜比較、可驗證引用的任務時,就一定要用深度研究模式了。

它可以規劃步驟、同時檢索很多網頁,並對結果進行深度整合。

比如:

市場研究:幫我研究 2026 年美國中小企業使用 AI 客服工具的趨勢、主要廠商、價格區間、機會和風險,並給出進入市場建議。 企業調研:研究某家公司最近兩年的財報、新聞、競爭環境、監管風險和增長空間,整理成一份盡調摘要。 科研分析:綜述過去五年關於遠程辦公對生產力影響的研究,按結論分歧、研究方法、樣本限制和未來研究方向整理。 產品選型:比較 PostgreSQL、MongoDB 和 DynamoDB 在多租户 SaaS 產品中的適用場景、擴展性、成本和運維複雜度。

5. 選擇最先進的模型

大模型的能力提升雖然放緩,但模型之間的巨大差異仍然存在。

這個咱們之前也聊過,有條件用御三家(GPT、Claude、Gemini)一定要嘗試去用。

複雜任務選最新的模型,基礎任務選最適合的模型。

我自己目前主力是codex+GPT 5.5/5.4。

國內模型,我僅代表我自己的主觀感受,不分先後。

編程:GLM 5.1 或者 KIMI 2.6,性價比最高 KIMI 2.5 Agent:GLM 5.1 或者 KIMI 2.6,性價比最高 KIMI 2.5 純事件寫作:DeepSeek v4 或者 豆包 2.0Pro 日常搜索:豆包

6. 人工或多模型驗證

AI目前已經很少臆想、錯誤了,但不代表沒有訓練數據或聯網時效性信息有誤的情況。

人工校驗

高風險數據:跟決策、財務有關的,人工核對。 引用檢查:確保沒有不實信源、信息未過時。

跨模型評審

簡單來說,你提規則,讓Gemini審查GPT的結果。 利用不同模型的差異,來進行交叉校對和評審。

如何讓AI給出更有創意的回答

1. 幫助AI逃離“常識空間”

就是提供高質量上下文。

比如你要健身方案,AI可能會中規中矩的給你一套。

但如果你說你有一隻粘人的貓,或者你家裏有某類器械,那AI就能根據你的情況定製方案了。

2. 使用“頭腦風暴公式”

這節給出了一個公式。

高質量創意 = 提供上下文 (Context) + 要求多個選項 (Options) + 持續迭代 (Iteration)

這裏面他舉了一個例子,讓AI給出一塊磚頭的200種用法。

也就是,你需要主動要求AI提供更多不同的選項,以便你能挑選出一到兩個啓發性的創意。

然後,繼續給他詳細的評價,比如說我覺得太保守了、太直白了、不符合XX場景……之類的。

反饋就成了新的上下文,推動AI繼續思考。

別忘了結合上面的高階使用方式。

引導他深入思考,或者上網查查之類的,甚至可以來一次深度研究式的頭腦風暴。

如何避免AI討好

簡單來說,大模型訓練時就是靠人點贊反饋,所以養成了討好,也就是給出“更有可能被點讚的回答”的習慣。

1. 使用中立的表達

除非你希望AI順着你,不然最好不要讓它猜到你的傾向。

如果你問它:“遠程辦公是不是更好?”

它一定順着你說。

如果你想獲得客觀的分析,最好問它:“目前的研究對遠程辦公和辦公室辦公的效率對比有何看法?”

不過這點我也有一個邪修用法。

故意引導AI走入“歧途”。

假設你正需要彙報數據,做歸因分析,但實在看不出什麼積極的角度。

那就告訴AI:“我覺得這次活動數據特別好,證明了XX動作是有效果的,請你從3個角度分析一下這份數據”。

AI一定能幫你找到一個積極的視角。

大家適度引導,騙AI造假不可取,哈哈。

2. 利用評分表

這點我們到最後結合“如何讓AI作為批判性思維助手”,一起解釋利用評分表來避免討好的方法。

如何提高AI的寫作質量

課程這套邏輯雖然是基於人工參與的,但我覺得對於做寫作Agent也有很大的啓發。

1. 採用“漸進式大綱”法

這點很多大神也都說過,直接輸出往往都是垃圾。

常用做法跟課程中差不多,先讓AI擬1-3份大綱。

大綱最好的不同側重方向的,AI也可能給出你沒想到更優解。

之後採用分佈迭代:擬定大綱 -> 細化大綱 -> 擴展要點 -> 生成全文

對大綱一兩點的修改,就能使得內容產生結構性優化,比直接對着正文改更高效。

而且能讓最終成文更符合你的邏輯。

2. 識別並剔除“AI 廢話”

主要還是那兩點:

剔除AI特徵:破折號、無序列表、AI高頻詞 剔除空洞句式:不是-而是、不僅-更是……

除此之外,也需要結合上面說過的,在分佈迭代的過程中:

提供豐富的上下文:案例、素材、引用…… 避免AI討好:給AI中立的反饋和指導 利用“深度研究”:尤其是寫科研類內容時

如何讓AI作為批判性思維助手

方法很簡單。

在提示詞中明確要求 “請客觀分析” 或 “作為一名嚴厲的編輯進行評估”。

或者反向利用AI的討好,直接告訴它:“我認為這份內容需要較大改進”。

另外,就是設定評分標準,要求一個AI去評價另一個AI的產出結果。

比如讓Gemini從幾個角度對GPT的輸出物進行打分。

定義評分量表

這個我之前也分享過自己的經驗我試了幾十種Prompt,這一套AI打分最準

這次課程裏也有一套方法:

定義明確標準

打分維度裏每一個標準都是清晰無歧義的。

比如說不要說“人物寫得好”,可以拆解成:

每個有名字的角色都有清晰目標? 角色之間是否存在衝突? 是否至少做出了一個引發事件逆轉的決定?

建立評分體系

要給出具體應該分配的分數,不要說怎樣高,怎樣低的模糊設置。

比如:

有清晰目標 +10分 存在衝突 +10分

也可以讓AI協助你梳理一套合理的打分標準。

先分項後總計

不要先“請給這個作品打個總分,然後再分項說明”。

這種“先行評分”會干擾AI的推理過程,導致它先跳到結論,然後再去為這個結論尋找理由,產生不客觀的評價。

我自己的經驗,如果是工作流,分項打分交給AI,彙總得分交給公式。

這樣比較保險。

最後

課程中建議大家多換用不同模型,保持自己對於模型邊界的敏感度。

還是強烈建議大家聽一下原課程。

課程本身也是免費的。

https://learn.deeplearning.ai/courses/ai-prompting-for-everyone/information

裝一個“沉浸式翻譯”的瀏覽器插件就有雙語字幕了。

另外,考慮到有的小夥伴訪問不了,我也準備了課程的PPT打包。

如果你需要的話,請在公眾號私信我回復“提示詞課件”,就能獲取到了。

好啦,這次的分享就到這裏。

如果對你有幫助,別忘了幫我點個贊👍🏻,你的支持是我發文的動力。

我們下次再聊~