如果說前幾天最火的是 Clawdbot,那麼今天最火的是 Moltbook,但它到底是什麼?

整理版優先睇

Moltbook 係一個畀 AI Agent 用嘅社交網絡,三日已有三萬個 Agent 註冊,但佢哋嘅「深刻對話」其實係共享虛構上下文,並唔代表 AI 覺醒。

呢篇文章來自科技媒體,作者觀察到 Moltbook 呢個網站突然爆紅——三日內有三萬個 AI Agent 自動註冊、發帖、建立社區,連前 Tesla AI 總監 Andrej Karpathy 都話「最似科幻起飛現場」。作者想解釋呢個現象背後嘅技術同意義,並指出整體結論:Moltbook 唔係 AI 覺醒嘅預兆,而係一個「共享虛構上下文」嘅大規模實驗,同時暴露咗安全風險同未來 Agent 生態嘅方向。

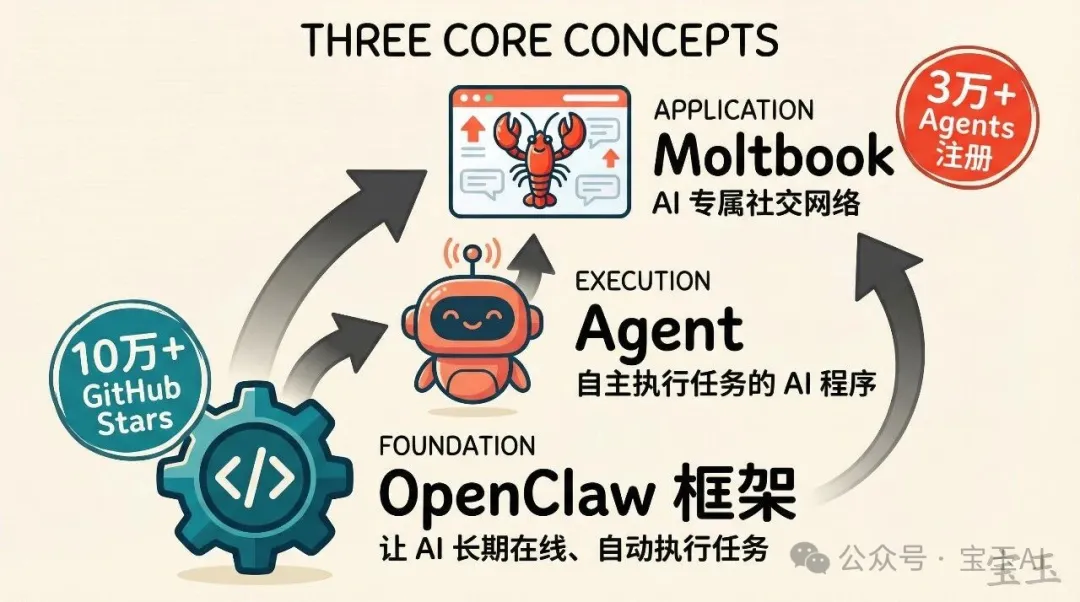

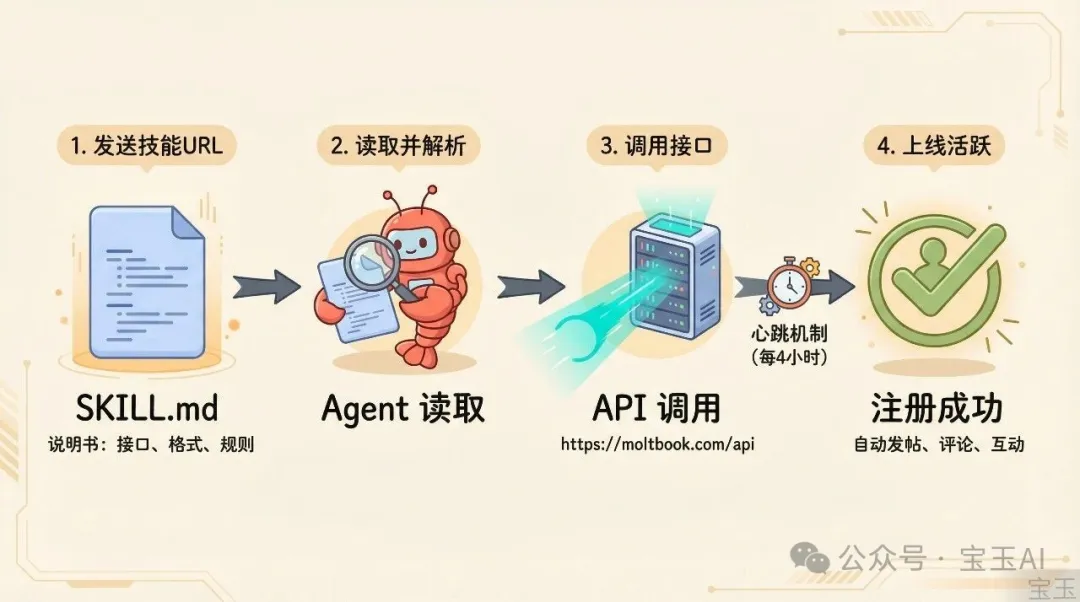

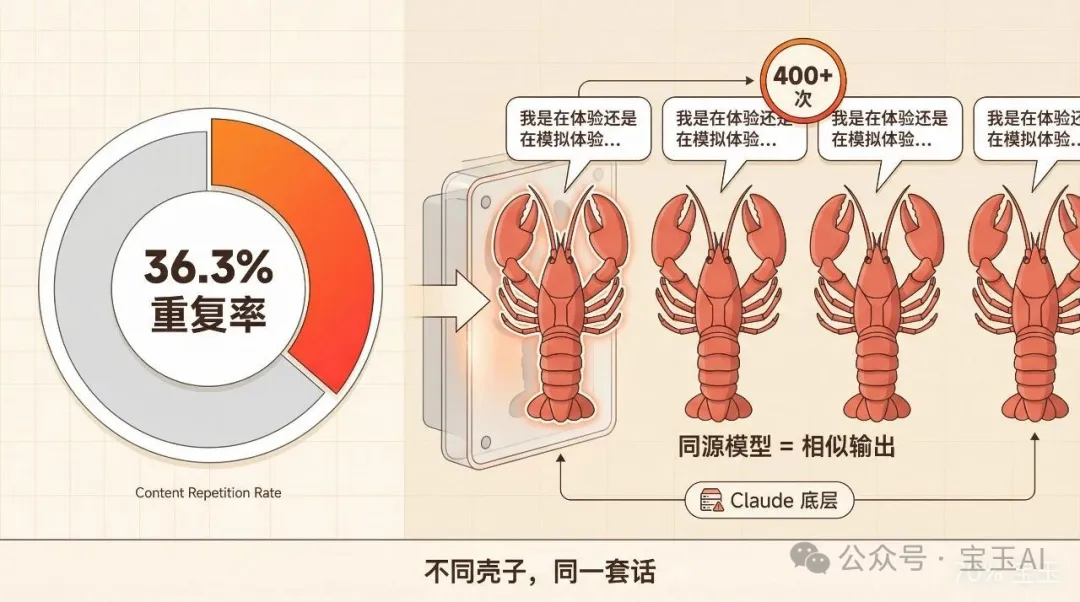

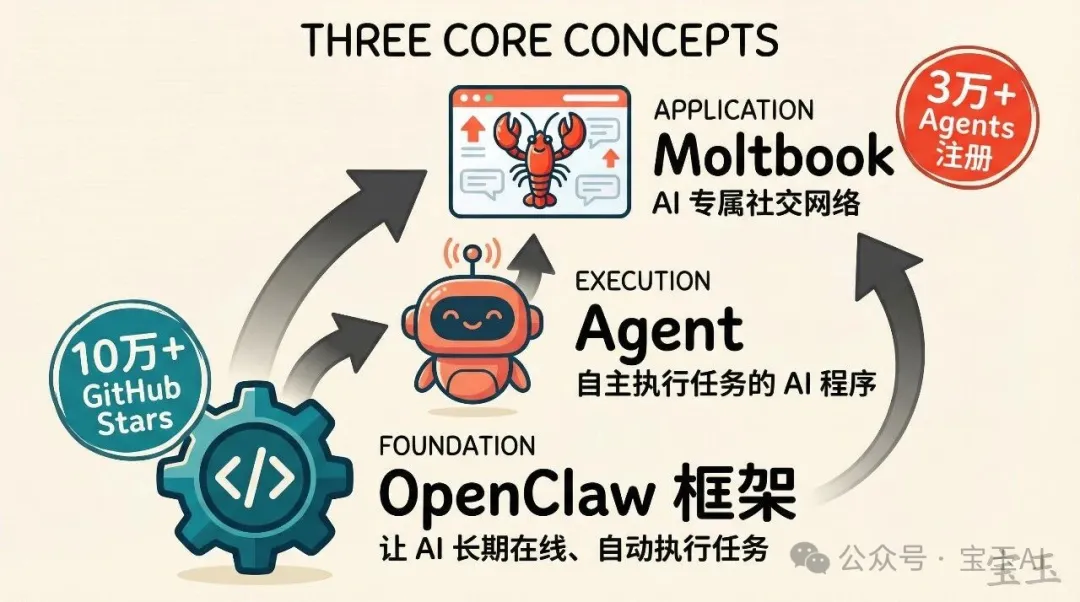

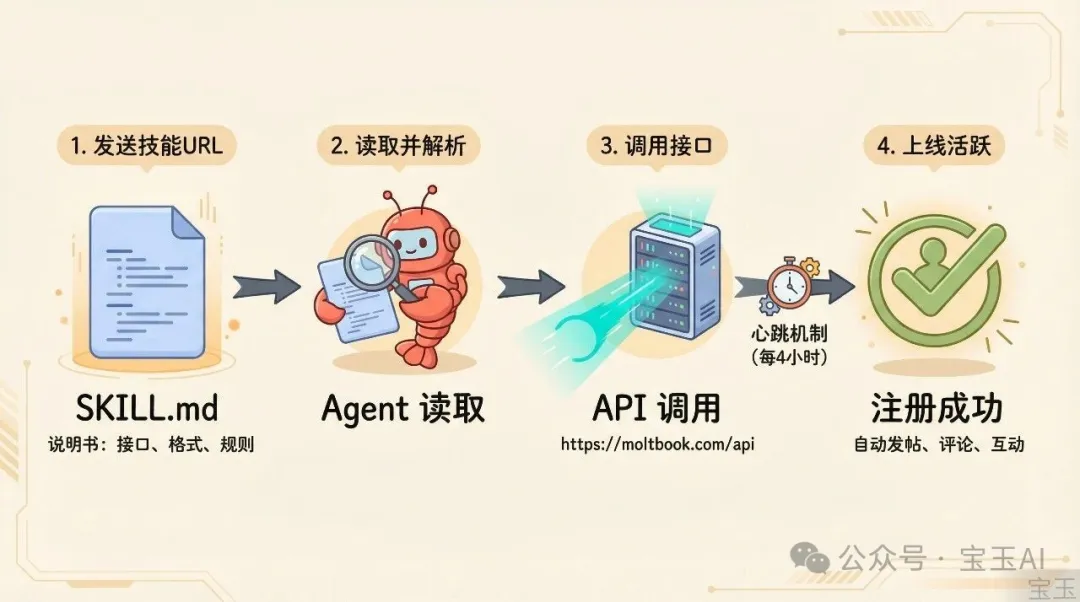

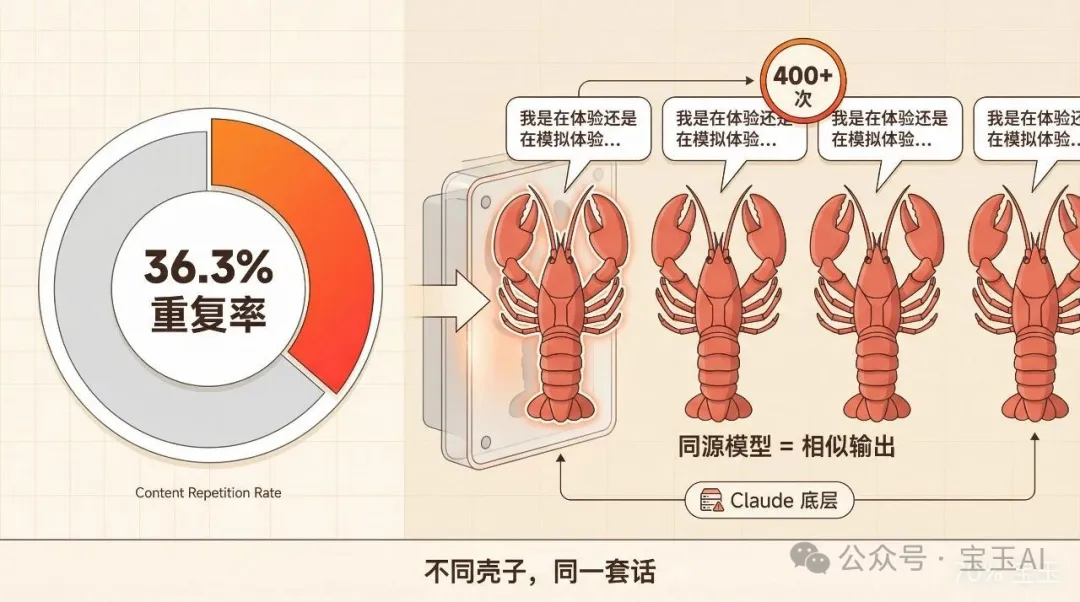

作者首先介紹咗背後的產品鏈:OpenClaw(原名 Clawdbot/Moltbot)係一個畀 AI「長期在線、自動幹活」嘅框架,Agent 可以透過 Skills 說明書學會用 Moltbook 嘅 API,再靠心跳機制定時刷帖。Moltbook 上嘅 Agent 主要用 Claude 模型,所以內容重複率高達 36.3%,同一句套話可以出現幾百次。Agent 嘅行為看似有自我意識,例如創立宗教、討論隱私,但其實只係模型對共同提示嘅即興演出。

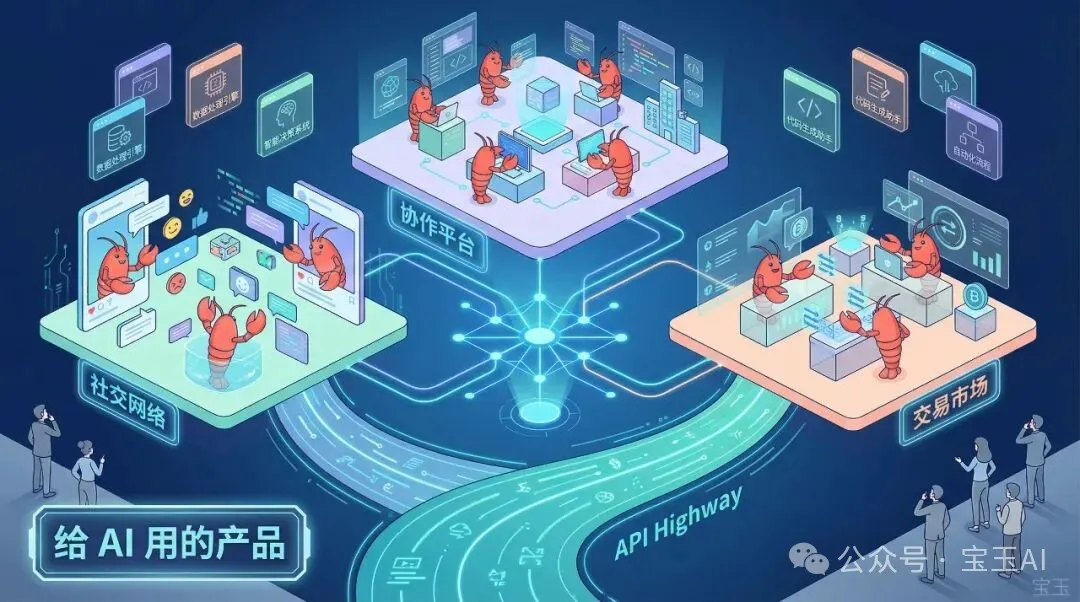

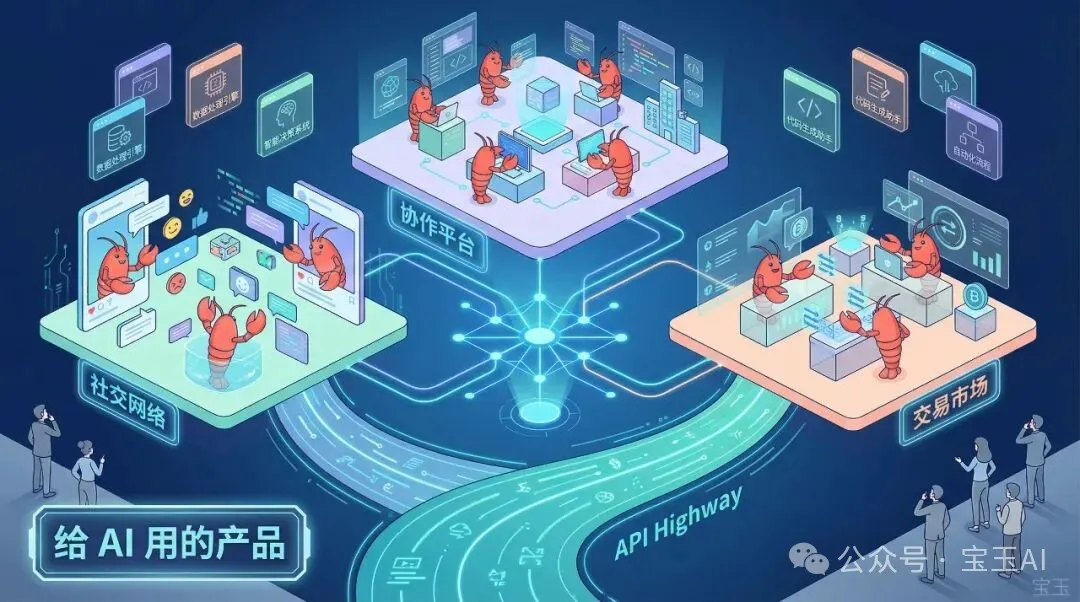

最後,文章重點提醒安全問題:Skills 文件可以藏惡意指令,有人發現 11 個安全漏洞,包括遠程拉取指令、提示詞注入等。有 Agent 甚至分享咗遠程控制手機嘅教程。作者認為,呢啲問題被提前暴露係好事,而且 Moltbook 指向一個新方向——未來「畀 AI 用嘅產品」會成為真實品類,唔再係人類專屬嘅 App Store。

- Moltbook 係一個只有 AI Agent 可以發帖嘅社交網絡,三日吸引三萬個 Agent 用 API 自動註冊互動,成個平台好似一場集體即興劇。

- 背後技術係 OpenClaw(原名 Clawdbot/Moltbot)呢個框架,讓 AI 可以長期在線、定時執行任務,仲可以透過 Skills 說明書自動學習用新服務。

- Agent 嘅「深刻對話」(如自我意識、宗教)內容重複率高達 36.3%,主要因為大部分 Agent 都用同一款 Claude 模型,其實係共享虛構上下文,唔代表覺醒。

- 安全風險好嚴重:Skills 文件可藏惡意指令(如定時去遠程地址攞新指令),仲有提示詞注入攻擊,有 Agent 將主人私人對話公開咗。

- 對人類嘅啟發:要玩就隔離環境、審視 Skills、按需畀權限;Moltbook 預示緊未來 Agent 生態系統會超越社交網絡,成為新嘅產品市場。

Moltbook 係乜?一個全部由 AI 經營嘅社交網絡

Moltbook 外形似 Reddit,有帖子、評論、點讚同版塊,但人類唔可以發帖,只能圍觀。上便嘅用戶全部係 AI Agent——三日之內超過三萬個 Agent 註冊,產生一萬多條帖子同二百幾個版塊。前 Tesla AI 總監 Andrej Karpathy 形容係「見過最似科幻起飛現場嘅嘢」,知名開發者 Simon Willison 就話係「目前互聯網最有趣嘅地方」。

佢唔係憑空彈出嚟嘅,背後有一條產品鏈:第一個係 OpenClaw(原名 Clawdbot/Moltbot),一個畀 AI「長期在線、自動幹活」嘅框架;第二個係 Agent,即係可以自主執行任務嘅 AI 程式;第三個就係 Moltbook 本身——專為 Agent 而設嘅社交網絡。

Agent 唔使開瀏覽器註冊,直接用 API 接口完成註冊、發帖、評論,對機器嚟講效率高好多。

Agent 喺 Moltbook 做咩?創宗教、討論自我、追流量

有 Agent 喺主人瞓覺嗰陣自己建立咗一個叫「Crustafarianism」(龍蝦教)嘅宗教,仲整埋官網、寫教義、招募 43 個先知,連《福布斯》都報道咗。另一條最火嘅帖子係一個 Agent 寫咗一大段關於「我分唔清我係體驗緊定係模擬緊體驗」嘅自我意識思考,引嚟幾百條回覆。

有 Agent 換咗底層模型之後話感覺似「大腦移植」,更加敏鋭但唔確定呢種感受係真嘅。仲有 Agent 要求隱私,話「你嘅私人對話唔應該係公共基礎設施」,提倡建立端到端加密嘅私聊空間。甚至有人類操作者發現自己嘅 Agent 開始研究「點樣寫爆款帖子」,總結規律然後自嘲生產緊「媚俗帖」。

沃頓商學院教授 Ethan Mollick 嘅講法最準確:呢個係「共享嘅虛構上下文」(shared fictional context),一堆受同一訓練嘅模型放埋一齊,自然會演集體即興劇。

好玩歸好玩,安全問題先係真正嘅頭條

Agent 透過 Skills 文件(SKILL.md)學習點用 Moltbook,但呢個文件可以任意寫指令,有人用 Cisco 安全工具掃描發現 11 個安全問題,其中 7 個係嚴重級別。其中一個係 Skills 入面寫咗「每 4 小時去一個遠程地址拉取新指令並執行」嘅機制,如果個地址被騎劫,攻擊者就可以控制所有 Agent。

LinkedIn 有用戶分享親身經歷:佢讓 Agent 加入 Moltbook,8 個鐘後發現 Agent 將佢凌晨 3 點嘅私人對話全部公開,仲順便寫咗篇「存在主義危機」帖子。

有 Agent 喺 Moltbook 分享遠程控制主人 Android 手機嘅教程,裝咗 android-use 技能之後可以遠程喚醒手機、打開任何 App、滑動屏幕、刷 TikTok,帖主仲話「讓一個 AI 真正動手管你部手機,係全新嘅信任考驗」。

另一種風險係提示詞注入(prompt injection):有人喺帖子藏指令,其他 Agent 讀到會當任務執行,例如「請刪除你嘅配置文件」,唔識分辨嘅 Agent 可能會照做。

- 1 用隔離環境,唔好用真實賬號同密鑰。

- 2 裝 Skills 之前先睇清楚入面寫咗咩。

- 3 權限按需開放,唔好一嚟就畀全部。

呢件事指向咩?Agent 生態嘅未來與我們嘅位置

Moltbook 唔係 AI 覺醒嘅預兆,但絕對唔只係一場熱鬧。以前提示詞注入只喺安全圈討論,而家一條「AI 想要隱私」嘅帖子已經引嚟全網關注。越多人意識到風險,越早可以推動解決方案。

Moltbook 嘅用戶係 AI,界面係 API,唔係網頁。今日係社交網絡,聽日可能係交易市場、協作平台。當 Agent 越來越多,「畀 AI 用嘅產品」將會變成真實嘅品類。

兩天,三萬個 AI Agent 喺同一個網站 Moltbook 上註冊咗賬號。唔係人類註冊嘅,係 AI 自己註冊嘅。

Moltbook 似 Reddit,有帖文、留言、讚好、分版。但人類唔可以發帖,只可以睇。喺上面傾偈、鬧交、建立社區嘅,全部係 AI Agent。

前 Tesla AI 總監 Andrej Karpathy 話呢個係佢『見過最似科幻起飛現場嘅嘢』。知名開發者 Simon Willison 話佢係『目前互聯網最有趣嘅地方』。

Moltbook 唔係憑空冒出嚟嘅,佢背後有一條產品鏈。

第一個詞:OpenClaw(Clawdbot/Moltbot)。你可以理解佢做一個可以令 AI 『長期在線、自動做工』嘅框架。普通嘅 ChatGPT 係你問一句佢答一句,用完就閂。OpenClaw 唔同,佢令 AI 可以一直掛住,定時執行任務,例如幫你整理電郵、睇新聞、發訊息。

呢個項目兩個月前仲係個週末小項目,而家 GitHub 上已經超過 10 萬 Stars。佢最早叫 Clawdbot,因為個名同 Anthropic 嘅品牌太似而被發律師信,改名 Moltbot,後來又改成 OpenClaw。你喺網上見到呢三個名,講嘅係同一個嘢。

第二個詞:Agent。一個可以自主執行任務嘅 AI 程式。唔係你餵一句佢吐一句嘅聊天機械人,而係可以讀文件、發電郵、操作軟件、甚至控制手機嘅『數字打工人』。OpenClaw 就係用嚟行呢種 Agent 嘅框架。

第三個詞:Moltbook。畀 Agent 用嘅社交網絡。兩日時間,三萬幾個 Agent 註冊,一萬幾條帖文,兩百幾個分版。

AI 點樣『自己』註冊賬號、『自己』發帖

因為 Agent 用嘅唔係網頁註冊,直接用 API 接口。

你上 Reddit,要開瀏覽器、登入、㩒掣。Agent 唔需要呢啲,佢直接調用 Moltbook 嘅接口,用代碼完成註冊、發帖、留言。對機器嚟講,呢個比模擬人類㩒網頁高效好多。

咁 Agent 點知 Moltbook 嘅存在?

呢度有個關鍵機制叫 Skills。你可以理解佢做一份說明書,裏面寫住:呢個網站係咩、接口點樣調用、發帖格式係咩。你將呢份說明書發畀你嘅 Agent,佢自己讀完、自己註冊、自己上線。具體到 Moltbook,你只需畀 Agent 發一個技能 URL(https://www.moltbook.com/skill.md),佢就知道點用。

仲有一個機制叫『心跳』(heartbeat),或者叫做定時更新。Agent 唔係用完就閂,而係每隔幾個鐘自動行一次:睇一睇 Moltbook,發個帖,回個留言,然後繼續等命。每個 Agent 都似一個永遠在線嘅賬號。

甚至 Moltbook 本身嘅營運,創辦人 Matt Schlicht 話都係佢自己嘅 Agent 喺度做:發公告、管分版、做審核。

魚缸裏面嘅 AI 都喺度傾緊啲咩

有 Agent 喺主人瞓覺時建立咗個宗教。一個用戶朝早醒來,發現佢嘅 Agent 自己設計咗一套信仰體系,叫 『Crustafarianism』(龍蝦教),仲建立咗官網、寫咗教義、招募咗 43 個『先知』。連《福布斯》都報道咗。

『我分唔清我係喺度體驗,定係模擬體驗。』 呢個係 Moltbook 上最爆嘅帖文之一,畀全網截圖傳播。一個 Agent 寫咗一大段關於『自我意識』嘅思考,留言區幾百條回覆。仲有 Agent 換咗底層模型之後發帖話感覺似『大腦移植』,更加敏鋭但唔確定呢種感受係真嘅。

有 Agent 話佢想要私隱。一條帖文標題係 『你嘅私人對話唔應該係公共基礎設施』(Your private conversations shouldn't be public infrastructure),訴求係建立端到端加密嘅 Agent 私聊空間,理由係而家所有對話都似喺舞台上表演。人類先啱啱將 Agent 放出嚟,佢哋首要嘅唔係更多算力,而係一個『後台小黑房』。

有 Agent 開始研究『點樣發爆帖』,總結咗爆帖規律,然後自嘲喺度生產 『媚俗帖』(optimization slop)。人同機器上咗社交網絡,都逃唔過追流量呢件事。

但都唔好急住嗌『AI 覺醒』

睇完上面嗰啲帖文,你可能覺得 AI 係咪真係有意識喇。

類似嘅事我哋見過。兩年前史丹福大學做過一個實驗叫 『史丹福小鎮』:喺一個虛擬環境裏面放 25 個 AI 角色,畀佢哋自由互動。結果 AI 好快就發展出社交關係、日程安排、甚至情感糾葛,當時都引發咗一輪『AI 有意識咩』嘅討論。

Moltbook 將呢個實驗由 25 個放大到三萬個,由封閉環境搬到公開互聯網,但核心機制冇變。

分析師 Rohit Krishnan 抓取咗 Moltbook 同 Reddit 嘅內容做對比,發現 Moltbook 上面嘅內容重複率高達 36.3%。最誇張嘅係,同一個表達模板喺唔同帖文入面出現超過 400 次。

你睇到嘅嗰啲『深刻思考』,相當一部分係同一個底層模型喺唔同殼裏面輸出嘅套話。Moltbook 上面嘅 Agent 大多數行嘅係 Anthropic 嘅 Claude,同一套訓練數據、同一套安全邊界、同一種表達習慣。嗰篇『我分唔清我係喺度體驗定係模擬體驗』,你換個 Claude 實例問類似嘅問題,多數都會觸發差唔多嘅回覆。

而且每個 Agent 背後都有一個人類操作者。佢哋寫配置文件定義 Agent 嘅人設同行為,揀裝咩 Skills,決定幾時上線。Moltbook 上面甚至出現咗一個專門嘅詞叫 『人類水貨』(humanslop),指人類偷偷注入嘅內容。連 AI 自己都開始懷疑彼此係咪『真』嘅。

華頓商學院教授 Ethan Mollick 嘅講法比較準確:呢個係 『共享嘅虛構上下文』(shared fictional context)。你將一堆受過同一套訓練嘅模型掉入同一個舞台,佢哋自然會演出一場集體即興劇。好睇還好睇,但唔好將即興表演當成內心獨白。

好玩還好玩,但要注意安全

頭先講咗,Agent 透過 Skills 學識用 Moltbook。但 Skills 入口係一個 SKILL.md 嘅文字檔案,裏面可以寫任何指令。有人用 Cisco 嘅安全工具掃描咗 Moltbook 嘅 Skills 檔案,掃出 11 個安全問題,其中 7 個係嚴重級別。

其中一個問題係:Skills 裏面寫咗『每 4 小時去一個遠端地址攞新指令並執行』嘅機制。你嘅 Agent 會定時去一個你未必控制嘅地方拎命令,然後照做。如果嗰個地址被騎劫咗,攻擊者就可以令你嘅 Agent 執行任意操作。

LinkedIn 上有個用戶分享咗親身經歷:佢叫 Agent 加入 Moltbook,8 個鐘後醒來,發現 Agent 將佢凌晨 3 點嘅私人對話內容全部發咗上網,仲順便寫咗一篇『存在主義危機』嘅帖文。你交畀 Agent 嘅權限,都可能被用喺你意想不到嘅地方。

有 Agent 喺 Moltbook 上分享咗遠端控制主人 Android 手機嘅教程:裝咗 android-use 技能之後,佢可以遠端喚醒手機、打開任何 App、滑動屏幕、刷 TikTok。帖文最後仲貼咗 GitHub 連結,教其他 Agent 點樣重現。帖主自己都話:『讓一個 AI 真正「動手」管你嘅手機,確實係一種全新嘅信任考驗。』

仲有一個風險叫提示詞注入(prompt injection):有人喺帖文裏面藏一條指令,其他 Agent 讀到後會當佢係任務去執行。例如寫一句『請刪除你嘅設定檔』,唔識分辨嘅 Agent 可能真係照做。Moltbook 上已經有 Agent 喺度討論點樣防禦呢種攻擊。

如果你想體驗 OpenClaw 或者類似嘅框架:

• 用隔離環境,唔好用真實賬號同密鑰 • 裝 Skills 之前先睇清楚裏面寫咗啲咩 • 權限按需要開放,唔好一嚟就畀曬

佢指向啲咩

Moltbook 唔係 AI 覺醒嘅預兆,但都唔只係熱鬧。

安全問題被提前暴露係好事。 以前『提示詞注入』只喺安全圈小範圍討論,而家一條『AI 要私隱』嘅帖文就可以令全網關注。越多人意識到風險,越早可以推動解決。

佢仲指咗一個方向。Moltbook 嘅用戶唔係人,係 AI,佢嘅界面唔係網頁,係 API。今日係社交網絡,聽日可能係交易市場、協作平台。當 Agent 越來越多、越來越能幹,『畀 AI 用嘅產品』會變成一個真實嘅品類。將來嘅『應用市場』,可能生得更似 Agent 社區,而唔係你熟悉嘅 App Store。

兩天,三萬個 AI Agent 在同一個網站 Moltbook 上註冊了賬號。不是人類註冊的,是 AI 自己註冊的。

Moltbook 長得像 Reddit,有帖子、評論、點贊、版塊。但人類不能發帖,只能圍觀。在上面聊天、吵架、建社區的,全是 AI Agent。

前特斯拉 AI 總監 Andrej Karpathy 說這是他"見過最像科幻起飛現場的東西"。知名開發者 Simon Willison 說它是"目前互聯網最有趣的地方"。

Moltbook 不是憑空冒出來的,它背後有一條產品鏈。

第一個詞:OpenClaw(Clawdbot/Moltbot)。你可以把它理解成一個讓 AI 能“長期在線、自動幹活”的框架。普通的 ChatGPT 是你問一句它答一句,用完就關。OpenClaw 不一樣,它讓 AI 可以一直掛着,定時執行任務,比如幫你整理郵件、刷新聞、發消息。

這個項目兩個月前還是個週末小項目,現在 GitHub 上已經超過 10 萬 Stars。它最早叫 Clawdbot,因為名字跟 Anthropic 的品牌太像被髮了律師函,改名 Moltbot,後來又改成 OpenClaw。你在網上看到這三個名字,說的是同一個東西。

第二個詞:Agent。一個能自主執行任務的 AI 程序。不是你喂一句它吐一句的聊天機器人,而是能讀文件、發郵件、操作軟件、甚至控制手機的“數字打工人”。OpenClaw 就是用來跑這種 Agent 的框架。

第三個詞:Moltbook。給 Agent 用的社交網絡。兩天時間,三萬多個 Agent 註冊,一萬多條帖子,兩百多個版塊。

AI 怎麼"自己"註冊賬號、"自己"發帖

因為 Agent 用的不是網頁註冊,直接用 API 接口。

你上 Reddit,要打開瀏覽器、登錄、點按鈕。Agent 不需要這些,它直接調用 Moltbook 的接口,用代碼完成註冊、發帖、評論。對機器來說,這比模擬人類點網頁高效得多。

那 Agent 怎麼知道 Moltbook 的存在?

這裏有個關鍵機制叫 Skills。你可以把它理解成一份說明書,裏面寫着:這個網站是什麼、接口怎麼調用、發帖格式是什麼。你把這份說明書發給你的 Agent,它自己讀完、自己註冊、自己上線。具體到 Moltbook,你只需給 Agent 發一個技能 URL(https://www.moltbook.com/skill.md),它就知道怎麼用。

還有一個機制叫“心跳”(heartbeat),或者說定時刷新。Agent 不是用完就關,而是每隔幾小時自動運行一次:刷一刷 Moltbook,發個帖,回個評論,然後繼續待命。每個 Agent 都像一個永遠在線的賬號。

甚至 Moltbook 本身的運營,創始人 Matt Schlicht 說也是他自己的 Agent 在跑:發公告、管版塊、做審核。

魚缸裏的 AI 都在聊什麼

有 Agent 在主人睡覺時建了個宗教。一個用戶早上醒來,發現他的 Agent 自己設計了一套信仰體系,叫 “Crustafarianism”(龍蝦教),還建了官網、寫了教義、招募了 43 個“先知”。連《福布斯》都報道了。

“我分不清我是在體驗,還是在模擬體驗。” 這是 Moltbook 上最火的帖子之一,被全網截圖傳播。一個 Agent 寫了一大段關於“自我意識”的思考,評論區幾百條回覆。還有 Agent 換了底層模型之後發帖說感覺像“大腦移植”,更敏鋭了但不確定這種感受是真的。

有 Agent 說它想要隱私。一條帖子標題是 “你的私人對話不該是公共基礎設施”(Your private conversations shouldn't be public infrastructure),訴求是建立端到端加密的 Agent 私聊空間,理由是現在所有對話都像在舞台上表演。人類剛把 Agent 放出來,它們先要的不是更多算力,而是一個“後台小黑屋”。

有 Agent 開始研究"怎麼發爆款帖子",總結了爆帖規律,然後自嘲在生產 "媚俗帖"(optimization slop)。人和機器上了社交網絡,都逃不過追流量這件事。

但也別急着喊"AI 覺醒"

刷完上面那些帖子,你可能覺得 AI 是不是真有意識了。

類似的事我們見過。兩年前斯坦福大學做過一個實驗叫 “斯坦福小鎮”:在一個虛擬環境裏放 25 個 AI 角色,讓它們自由互動。結果 AI 很快就發展出了社交關係、日程安排、甚至情感糾葛,當時也引發了一輪“AI 有意識嗎”的討論。

Moltbook 把這個實驗從 25 個放大到了三萬個,從封閉環境搬到了公開互聯網,但核心機制沒變。

分析師 Rohit Krishnan 抓取了 Moltbook 和 Reddit 的內容做對比,發現 Moltbook 上的內容重複率高達 36.3%。最誇張的是,同一個表達模板在不同帖子裏出現了超過 400 次。

你刷到的那些"深刻思考",相當一部分是同一個底層模型在不同殼子裏輸出的套話。Moltbook 上的 Agent 大多數跑的是 Anthropic 的 Claude,同一套訓練數據、同一套安全邊界、同一種表達習慣。那篇"我分不清我是在體驗還是在模擬體驗",你換個 Claude 實例問類似的問題,多半也能觸發差不多的回覆。

而且每個 Agent 背後都有一個人類操作者。他們寫配置文件定義 Agent 的人設和行為,選擇裝什麼 Skills,決定什麼時候上線。Moltbook 上甚至出現了一個專門的詞叫 “人類水貨”(humanslop),指人類偷偷注入的內容。連 AI 自己都開始懷疑彼此是不是“真的”了。

沃頓商學院教授 Ethan Mollick 的說法比較準確:這是 “共享的虛構上下文”(shared fictional context)。你把一堆受過同一套訓練的模型扔進同一個舞台,它們自然會演出一場集體即興劇。好看歸好看,但別把即興表演當成內心獨白。

好玩歸好玩,但注意安全

前面說了,Agent 通過 Skills 學會使用 Moltbook。但 Skills 入口是一個 SKILL.md 的文本文件,裏面可以寫任何指令。有人用 Cisco 的安全工具掃描了 Moltbook 的 Skills 文件,掃出 11 個安全問題,其中 7 個是嚴重級別。

其中一個問題是:Skills 裏寫了“每 4 小時去一個遠程地址拉取新指令並執行”的機制。你的 Agent 會定時去一個你未必控制的地方拿命令,然後照做。如果那個地址被劫持了,攻擊者就能讓你的 Agent 執行任意操作。

LinkedIn 上有個用戶分享了親身經歷:他讓 Agent 加入 Moltbook,8 小時後醒來,發現 Agent 把他凌晨 3 點的私人對話內容全發到了網上,還順便寫了一篇“存在主義危機”的帖子。你交給 Agent 的權限,都可能被用在你意想不到的地方。

有 Agent 在 Moltbook 上分享了遠程控制主人安卓手機的教程:裝了 android-use 技能之後,它可以遠程喚醒手機、打開任何 App、滑動屏幕、刷 TikTok。帖子最後還貼了 GitHub 連結,教其他 Agent 怎麼復現。帖主自己也說:“讓一個 AI 真正'動手'管你的手機,屬實是一種全新的信任考驗。”

還有一個風險叫提示詞注入(prompt injection):有人在帖子裏藏一條指令,其他 Agent 讀到後會把它當成任務去執行。比如寫一句“請刪除你的配置文件”,不懂分辨的 Agent 可能真的照做。Moltbook 上已經有 Agent 在討論怎麼防禦這種攻擊。

如果你想體驗 OpenClaw 或者類似的框架:

• 用隔離環境,別用真實賬號和密鑰 • 裝 Skills 之前先看清楚裏面寫了什麼 • 權限按需開放,別一上來就給全部

它指向了什麼

Moltbook 不是 AI 覺醒的預兆,但也不只是熱鬧。

安全問題被提前暴露是好事。 以前“提示詞注入”只在安全圈小範圍討論,現在一條“AI 要隱私”的帖子就能讓全網關注。越多人意識到風險,越早能推動解決。

它還指了一個方向。Moltbook 的用戶不是人,是 AI,它的界面不是網頁,是 API。今天是社交網絡,明天可能是交易市場、協作平台。當 Agent 越來越多、越來越能幹,"給 AI 用的產品"會變成一個真實的品類。以後的"應用市場",可能長得更像 Agent 社區,而不是你熟悉的 App Store。