當我把鍵盤放下,對着AI說了一天話來解決我的日常工作

整理版優先睇

用語音同AI協作,將碎片時間嘅產出密度翻倍:TRAE SOLO + Insta360 Mic Air 實戰分享

呢篇文章係由創業者兼獨立開發者安仔寫嘅。佢白天要處理公司事務,業餘仲要做自媒體、寫文、做直播同維護代碼項目,時間完全係靠中午同夜晚嘅碎片時間。佢發現最大嘅樽頸唔係做唔切,而係要將諗法「翻譯」成文字餵畀 AI——手指頭追唔上個腦。

為咗解決呢個問題,佢用咗 TRAE SOLO + Insta360 Mic Air 呢套組合。佢嘅結論係:語音輸入本身冇問題,問題係我哋需要一層翻譯官,將口水話實時變成精準指令。Mic Air 負責收音同清洗廢話,SOLO 負責理解同執行,兩個夾埋就令到語音協作變得真正實用。

作者透過中午散步寫文、夜晚改 code 同處理社羣嘅具體例子,展示呢套組合點樣將碎片時間嘅產出密度翻倍。佢認為 Voice Working 會係未來一兩年最值得關注嘅人機交互變化,尤其適合成日同 AI 協作、用碎片時間做副業、或者唔想被釘喺電腦前嘅人。

- 語音輸入嘅核心痛點唔係識別率,而係人嘅表達唔精準;Mic Air 嘅口語清洗功能解決咗呢個問題。

- TRAE SOLO 支援手機端,可以將任務流轉到雲端或個人電腦,實現「人在外面走,活在家裏幹」。

- 中午散步時對住 Mic Air 口述文章大綱,SOLO 自動搜索、整理、生成初稿,一個鐘搞掂以前要分兩三段時間先寫完嘅文。

- 夜晚改 code 可以一句話觸發多步操作(改接口、寫邏輯、跑測試、提交 GitHub),同時用另開任務處理社羣回覆,將工作時間由12點縮短到10點前。

- Voice Working 降低嘅唔係輸入速度,而係表達門檻——你只需要好似同同事吹水咁講,唔使先喺腦入面組織好結構化文字。

背景:碎片時間最痛嘅係「翻譯」過程

作者安仔係創業者兼獨立開發者,日頭處理公司事,夜晚同午休搞自媒體同代碼項目。時間碎到一粒一粒,最攰嘅唔係做唔切,而係要將腦入面嘅諗法「翻譯」成文字餵畀 AI——手指頭追唔上個腦。

「把腦子裏的想法翻譯成文字餵給 AI」呢個過程消耗最多精力

佢以前試過語音輸入,但經驗好差:手機語音出嚟一堆「然後個個就係嘛」,背景噪音又搞到亂碼。佢認為核心問題唔係語音唔得,而係我哋中間缺咗一層翻譯官——將口水話實時變成 AI 精準執行嘅指令。

兩件工具:Insta360 Mic Air 同 TRAE SOLO

Insta360 Mic Air 係一粒 7.9 克嘅收音咪,夾喺衣領就忘記佢存在。佢收音質素等同錄音棚,你細聲講都聽得清,旁邊再嘈只收你把聲,續航仲有 10 個鐘。

普通麥克風只管「聽到你講乜」,Mic Air 結合 SOLO 多做一步——自動刪廢話、修正改口、變口語做書面指令

TRAE SOLO 係字節跳動嘅 AI 工作助手,有 Code 模式(寫 code)同 MTC 模式(寫文、搜資料、整理文件)。最新版本仲支援手機端,任務可以無縫流轉到雲端或綁定電腦。

中午休息:散步寫文,框架喺返到工位前已經出咗

以前午飯後一個鐘空檔,由選題、搜資料到打字,一個鐘根本寫唔完,成日拖到夜晚。而家佢食完飯散步時對住 Mic Air 口述需求。

「幫我搜一下最近關於 GPT 5.5 嘅熱點討論,然後基於搜到嘅信息幫我列個文章大綱」

實際講嘅時候夾雜咗「嗯」、「嗰個」、「即係」,仲改咗一次口,但 Mic Air 全部自動處理——語氣詞刪掉,改口只保留最終結論。SOLO 收到後直接搜索、整理、出大綱,佢未返到工位框架已經喺度。

SOLO 能識別到具體工具需求,然後調用本地合適嘅 skills 實現需求

佢仲可以繼續口述要點同觀點,等 SOLO 填充內容同生成配圖。而且因為 SOLO 手機端支援,佢喺公司樓下散步時用電話講完需求,任務就會流轉去屋企電腦執行。

「人在外面走,活在家裏幹」——唔使坐喺電腦前先開到工

夜晚:改 code 同處理社羣,一句話觸發多步操作

夜晚係佢改 code、回社羣問題、整理直播素材嘅時間。以前全部靠打字,成日搞到半夜。而家佢會先對住 Mic Air 講 code 需求。

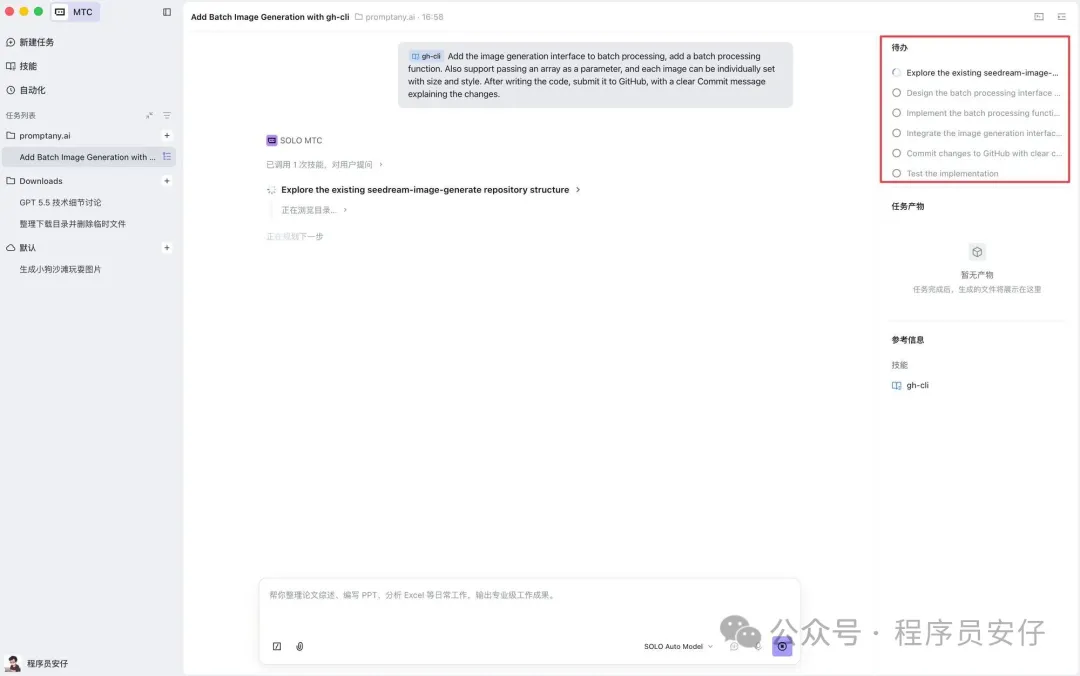

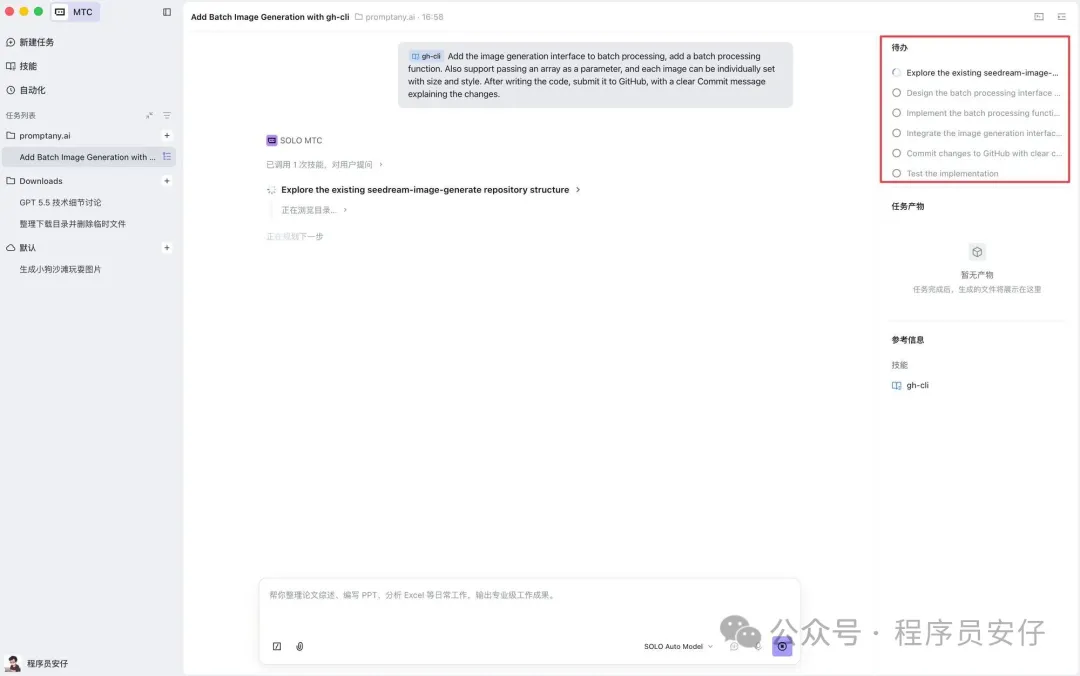

幫我將圖片生成接口加批量處理功能,參數支援傳入一個數組,每張圖可以獨立設置尺寸同風格,寫好之後提交到 GitHub,commit message 寫清楚改咗乜。佢講嘅時候磕磕巴巴仲停頓咗幾次,但 Mic Air 清洗完之後 SOLO 收到一條結構清晰嘅需求。SOLO 會自動基於要引用嘅 skill 將需求翻譯成英文,然後拆解步驟:改接口參數定義 → 寫批量邏輯 → 跑測試 → 調用 GitHub CLI 提交。

一句話觸發多步操作,而且 SOLO 可以模糊匹配——講「提交到 GitHub」就自動識別用 Git skill

code 交俾 SOLO 跑緊嘅同時,佢另開任務處理社羣:例如「幫我基於呢個問題寫個 200 字回覆,語氣友好專業啲」,或者「將今日收集嘅素材按主題分類整理」。以前夜晚做到 12 點,而家 10 點前就收工。

夜晚工作時間由 12 點縮短到 10 點前,慳到嘅時間可以睇書或諗聽日嘅工作

本質改變:降低表達門檻,而唔係輸入速度

令作者興奮嘅唔係快咗幾多,而係一個更根本嘅變化:Voice Working 降低咗表達門檻。以前同 AI 協作,要先喺腦入面組織好結構化文字——點樣描述、用咩關鍵詞、分幾步講。呢個翻譯過程本身就消耗大量精力。

加上 SOLO 手機端跨設備能力,佢嘅工作模式變成:白天開會間隙諗到嘢,攞電話對住 SOLO 講一句,任務就派出咗;開完會行返工位嘅時間,將會議資料掟俾 SOLO 總結好放喺電腦桌面。晚上返到屋企,code 寫好、初稿生成、素材整理完。

由命令行到 IDE,到 Copilot,到而家用把口——每一步都縮短「諗法」同「變成現實」之間嘅距離

佢覺得 Voice Working 會係未來一兩年最值得關注嘅人機交互變化之一,寫 code 只係開始,文檔、調研、整理檔案、安排日程都會俾語音重構一次。最後佢列出三類適合嘅人:成日同 AI 協作但打字慢嘅;白天有正職、用碎片時間做副業嘅創業者或獨立開發者;鍾意邊行邊諗、唔想被釘喺電腦前嘅人。

大家好,我係安仔。

我係一個創業者,日頭成日都要處理公司嘅嘢,同時亦係一個獨立開發者,工餘時間都會寫嚇文章做嚇直播分享。

即係話我只能夠靠中午休息同夜晚收工之後嘅碎片時間,去寫文章、做直播分享、回答社羣問題、維護一啲代碼項目。

時間本身已經好緊,所有呢啲嘢仲要塞曬靠鍵盤一個字一個字打。

最攰嘅唔係做嘢本身,而係「將個腦嘅想法翻譯成文字餵俾 AI」呢個過程——明明個腦已經諗好咗,手指就係跟唔上。

直到我用咗 TRAE SOLO + Insta360 Mic Air 呢套組合。

講真,我而家返唔到轉頭。

唔係矯情,係真係返唔到轉頭。把口講比隻手做快,而且快嘅唔係少少。

語音輸入點解一路都「唔好用」

其實我好早就想用語音同 AI 協作。但之前嘅體驗,點講呢,一言難盡。

你有冇試過對住手機語音輸入寫文章?

出嚟一堆「然後嗰個就係囉」,仲要花時間刪改,慢過直接打字。

你有冇試過喺咖啡廳用語音?

背景音樂同隔籬位大哥嘅電話全部混咗入去,AI 認出嚟一堆亂碼。

但呢啲都唔係最核心嘅問題。最核心嘅問題係:

你個腦諗緊「幫我根據呢篇論文寫個技術解讀」,但把口講出嚟係「即係嗰個……你幫我睇嚇嗰篇論文……寫個……即係嗰種解讀嘅文章啦」。

AI 收到嘅係一嚿口水話,執行結果自然偏到九丈遠。

所以我覺得問題從來都唔係「語音唔得」,而係我哋中間缺咗一層翻譯官——可以將你嘅口水話實時變成 AI 精準執行嘅指令。

呢兩樣嘢係乜嘢

先講 Insta360 Mic Air。

一句話解釋佢同普通咪高峯嘅分別:

普通咪高峯只管「聽到你講咗乜」,Mic Air 結合 TRAE SOLO 多做咗一步——佢會自動幫你將廢話刪咗、將改口修正、將口語變成書面指令。

相當於你同 AI 之間多咗個實時速記秘書。

硬件層面唔多講,淨係記住三點:

7.9克硬幣咁細,夾喺衫領就唔記得佢存在;

收音係錄音室級別,你細細聲講佢都聽到,隔籬再嘈只收你嘅聲;

續航10個鐘,夠你由朝講到晚。

再講 TRAE SOLO。

字節跳動做嘅 AI 工作助手。

可以幫你寫 Code(Code 模式),亦可以幫你做寫文章、搜資料、整理文件呢啲辦公任務(MTC 模式,More Than Coding)。

你可以理解為一個隨時候命嘅 AI 員工,而且係理解力好強、執行力都好強嘅員工。

而且最新版本已經支援手機端。即係點?

你喺手機落嘅 task,可以無縫流轉到雲端或者你綁定嘅個人電腦執行。

你人唔喺電腦面前,AI 照樣幫你做嘢。

對我呢啲日頭俾創業嘢佔曬、只能碎片時間處理一啲非核心事情嘅人嚟講,簡直係解放。

點解呢兩樣要夾埋用?道理好簡單:

語音輸入嘅質量直接決定 AI 做嘢嘅準確率。

咪高峯收音唔好或者唔做口語清洗,後面 AI 再勁都係理解緊一嚿廢話。

Mic Air 負責將你嘅人話翻譯成精準指令,SOLO 負責接到指令後執行到位。

一個管「聽明你」,一個管「幫你做」。

碎片時間裏面嘅真實用法

日頭做嘢嘅事已經佔曬成段時間,自媒體只能攝時間做。

所以對我嚟講,呢套組合最大嘅價值係:

令碎片時間嘅產出密度翻倍。

講幾多都唔及直接睇我點用。

中午休息:寫公眾號

工作日食完晏晝我通常有大約一個鐘嘅空檔,以前我會開電腦趕一篇文章。

但由揀題目、搜資料、組織大綱到一個字一個字打出來,一個鐘根本寫唔完,成日拖到夜晚繼續。

而家嘅做法:食完飯散步嘅時候,對住衫領嘅 Mic Air 開始講——

「幫我搜嚇最近關於 GPT 5.5 嘅熱點討論,然後根據搜到嘅資料幫我列個文章大綱,風格輕鬆啲,面向技術愛好者,重點講佢嘅架構創新同實際性能提升。」

我實際講嘅時候中間夾咗幾個「嗯」、「嗰個」、「即係」,仲改咗一次口(「唔係技術細節……係架構創新」)。

但 TRAE SOLO 全部自動處理咗——語氣詞刪咗,改口只保留最終結論,輸出俾 SOLO 嘅係一條乾淨利落嘅指令。

SOLO 收到後直接開始搜索、整理、出大綱。我未行返到工位,框架已經有咗。

然後繼續口述要點同觀點,叫 SOLO 填充內容、生成配圖,佢竟然識別到我嘅具體工具需求,然後幫我調用我本地合適嘅 skills 入嚟實現需求:

以前一篇文章要拆成兩三個時段先寫得完,而家午休散個步第一版初稿就搞掂。

而且因為 SOLO 支援手機端,我甚至唔使返到工位。

中午喺公司樓下散步嘅時候,攞手機對住手機端講完需求,任務直接流轉到我家嘅電腦度行緊。

等我夜晚返到屋企,開電腦一睇,初稿已經喺度等緊我。

呢種「人行緊街,工喺屋企做」嘅感覺,真係令我從「一定要坐喺電腦前先做到嘢」嘅困局度徹底解放出嚟。

夜晚:改開源項目 + 處理社羣

收工之後係我集中處理自媒體同自己一啲個人代碼項目嘅時間。

以前呢段時間要做嘅嘢太多:改 Code、回社羣問題、整理直播素材,全部靠打字一件件做,成日忙到半夜。

而家我會先處理 Code。對住 Mic Air 講——

「將圖片生成嘅接口加個批量處理嘅功能,參數支援傳一個陣列入嚟,每張圖可以單獨設定尺寸同風格,然後幫我寫好之後提交去 GitHub,commit message 寫清楚改咗乜。」

我講嘅時候其實斷斷續續,中間仲停頓咗幾次諗措辭。但 Mic Air 清洗完之後,SOLO 收到嘅就係一條結構清晰嘅需求,而且佢甚至會根據要引用嘅 skill 嚟翻譯我哋嘅需求做英文等,等大模型可以更好地結合 skill 嚟理解。

然後佢自動拆解:修改接口參數定義 → 寫批量處理邏輯 → 行測試 → 調用 GitHub CLI 提交。一句話觸發多步操作,而且佢可以模糊匹配——我講「提交去 GitHub」,佢自動知道要調用 Git skill。

Code 嘅事交俾 SOLO 行緊,我同時處理社羣。

直接開一個新 task,對住 TRAE SOLO 講「幫我根據呢個問題寫個200字嘅回覆,語氣友善專業啲」,或者「將今日收集嘅呢啲素材按主題分類整理好,直播嘅時候要用」。……

以前夜晚忙到12點嘅嘢,而家10點前基本上可以收工。慳返嘅時間,我可以睇嚇書,或者諗嚇聽日工作嗰邊嘅嘢。

Voice Working 到底改變咗乜

體驗咗一段時間,令我興奮嘅唔係「快咗幾多」,而係一個更根本嘅變化:

Voice Working 降低嘅唔係輸入速度,而係表達門檻。

以前同 AI 協作,你要先喺個腦將需求組織成結構化嘅文字——諗清楚點樣描述、用乜關鍵詞、分幾步講。

呢個「翻譯」過程本身就消耗大量精力。

而家你只需要好似同同事吹水咁講出嚟,講錯改口都冇問題,TRAE SOLO 幫你兜底。

對我呢啲日頭有正職工作、夜晚做自媒體同開發個人項目嘅人嚟講,即係我可以將更多精力擺喺「諗清楚要做乜」上面,而唔係「點樣將想法準確傳達俾 AI」上面。

碎片時間嘅產出密度,直接翻咗一倍唔止。

再加上 SOLO 嘅手機端跨裝置能力,我而家嘅工作模式變咗:

日頭開會空隙諗到啲乜,攞手機對住 TRAE SOLO 講一句,task 就派出咗;

下晝開咗幾個會,有啲會議嘅紀要整理太麻煩,開完會返工位嘅空隙,攞手機,直接將相關資料掉俾 TRAE SOLO,叫佢幫我總結好放喺我公司電腦桌面,等我查閲,甚至直接飛書傳俾同事;

夜晚返到屋企開電腦,Code 已經寫好、文章初稿已經生成、素材已經整理完畢;

我唔再需要「坐喺電腦前」先開波做嘢,任何時間任何地方,一張嘴就夠。

由 command line 到 IDE,到 Copilot,到而家用把口講。

每一步都在縮短「個腦嘅想法」到「佢變成現實」之間嘅距離。

–「配一張相關嘅優化後工作流程嘅場景圖」–

我覺得 Voice Working 會係未來一兩年最值得留意嘅人機交互變化之一。

寫 Code 只係開始,寫文檔、做調研、整理文件、安排日程,所有同 AI 協作嘅場景都會被語音重構一次。

邊啲人適合呢套組合

三類人會特別有感覺:

第一係成日同 AI 協作但覺得打字表達需求太慢嘅人。

第二係好似我咁日頭有正職、只能用碎片時間做副業嘅創業者或獨立開發者。

第三係鍾意邊行邊諗、唔想被綁喺電腦前嘅人——SOLO 手機端,令你喺地鐵、散步甚至開會空隙都可以將 task 派出街,返到電腦前直接驗收成果。

講真,用咗一段時間之後,再返轉頭純鍵盤操作,會有種「點解咁笨重」嘅感覺。

就好似用慣咗觸控再返去按鍵手機一樣。

你會唔會慣咗用把口做嘢?嚟留言區傾嚇。

大家好,我是安仔。

我是一個創業者,白天一整天都在處理公司的事,同時也是個獨立開發者,業餘時間也會寫寫文章做一下直播分享。

這意味着我只能靠中午休息和晚上下班後的碎片時間,去寫文章、做直播分享、回答社羣問題、維護一些代碼項目。

時間本來就緊,所有這些事還全靠鍵盤一個字一個字敲。

最累的不是幹活本身,而是“把腦子裏的想法翻譯成文字餵給 AI”這個過程——明明腦子裏已經想好了,手指頭就是跟不上。

直到我用上了 TRAE SOLO + Insta360 Mic Air 這套組合。

說句實話,我現在回不去了。

不是矯情,是真的回不去了。動嘴比動手快,而且快的不是一點半點。

語音輸入為什麼一直“不好使”

其實我很早就想用語音跟 AI 協作了。但之前的體驗,怎麼說呢,一言難盡。

你試過對着手機語音輸入寫文章嗎?

出來一堆“然後那個就是嘛”,還得花時間刪改,比直接打字還慢。

你試過在咖啡廳用語音嗎?

背景音樂和隔壁大哥的電話全混進去了,AI 識別出來一堆亂碼。

但這些都不是最核心的問題。最核心的問題是:

你腦子裏想的是“幫我基於這篇論文寫個技術解讀”,但嘴裏說出來的是“就是那個……你幫我看看那個論文……寫個……就是那種解讀的文章吧”。

AI 收到的是一坨口水話,執行結果自然偏到姥姥家去了。

所以我覺得問題從來就不是“語音不行”,而是我們中間缺了一層翻譯官——能把你的口水話實時變成 AI 能精準執行的指令。

這倆東西是什麼

先說 Insta360 Mic Air.

一句話解釋它跟普通麥克風的區別:

普通麥克風只管“聽到你說了什麼”,Mic Air 結合 TRAE SOLO 多做了一步——它會自動幫你把廢話刪掉、把改口修正、把口語變成書面指令。

相當於你和 AI 之間多了個實時速記秘書。

硬件層面不多說,就記住三點:

7.9克硬幣大小,夾衣領上就忘了它存在;

收音是錄音棚級別的,你小聲嘀咕它都能聽清,旁邊再吵也只收你的聲音;

續航10小時,夠你從早說到晚。

再說 TRAE SOLO.

字節跳動做的 AI 工作助手。

能幫你寫代碼(Code 模式),也能幫你做寫文章、搜資料、整理文件這些辦公任務(MTC 模式,More Than Coding)。

你可以理解為一個隨時待命的 AI 員工,而且是那種理解力很強、執行力也很強的員工。

而且最新版本已經支持手機端了。這意味着什麼?

你在手機上下達的任務,可以無縫流轉到雲端或者你綁定的個人電腦上執行。

你人不在電腦前,AI 照樣幫你幹活。

這對我這種白天被創業的事佔滿、只能碎片時間處理一些非核心事情的人來說,簡直是解放。

為什麼這倆要搭配着用?道理很簡單:

語音輸入的質量直接決定 AI 幹活的準確率。

麥克風收音不行或者不做口語清洗,後面 AI 再強也是在理解一坨廢話。

Mic Air 負責把你的人話翻譯成精準指令,SOLO 負責接到指令後執行到位。

一個管“聽懂你”,一個管“幫你幹”。

碎片時間裏的真實用法

白天工作的事已經佔滿了整塊時間,自媒體只能見縫插針。

所以對我來說,這套組合最大的價值就是:

讓碎片時間的產出密度翻倍。

說再多不如直接看我怎麼用吧。

中午休息:寫公眾號

工作日午飯後我一般會有大概一個小時的空檔,以前我會打開電腦趕一篇文章。

但從想選題、搜資料、組織大綱到一個字一個字敲出來,一小時根本寫不完,經常拖到晚上繼續。

現在的做法:吃完飯散步的時候,對着衣領上的 Mic Air 開始說——

“幫我搜一下最近關於 GPT 5.5 的熱點討論,然後基於搜到的信息幫我列個文章大綱,風格輕鬆一點,面向技術愛好者,重點講它的架構創新和實際性能提升。”

我實際說的時候中間夾了好幾個“嗯”、“那個”、“就是”,還改了一次口(“不是技術細節……是架構創新”)。

但 TRAE SOLO 全部自動處理了——語氣詞刪掉,改口只保留最終結論,輸出給 SOLO 的是一條幹淨利落的指令。

SOLO 收到後直接開始搜索、整理、出大綱。我還沒走回工位,框架已經有了。

然後繼續口述要點和觀點,讓 SOLO 填充內容、生成配圖,它居然能識別到我的具體工具需求,然後幫我調用我本地合適的 skills 進來實現需求:

以前一篇文章要拆成兩三個時間段才能寫完,現在午休散個步第一版初稿就搞定了。

而且因為 SOLO 支持手機端,我甚至不需要回到工位。

中午在公司樓下散步的時候,掏出手機對着手機端說完需求,任務直接流轉到我家裏的電腦上跑着。

等我晚上回到家,打開電腦一看,初稿已經躺在那了。

這種“人在外面走,活在家裏幹”的感覺,真的讓我從“必須坐在電腦前才能工作”的困境裏徹底解放出來了。

晚上:改開源項目 + 處理社羣

下班後是我集中處理自媒體和自己一些個人代碼項目的時間。

以前這段時間要做的事太多:改代碼、回社羣問題、整理直播素材,全靠打字一件件來,經常忙到半夜。

現在我會先處理代碼。對着 Mic Air 說——

“把圖片生成的接口加個批量處理的功能,參數支持傳一個數組進來,每張圖可以單獨設置尺寸和風格,然後幫我寫好之後提交到 GitHub,commit message 寫清楚改了什麼。”

我說的時候其實磕磕巴巴的,中間還停頓了幾次想措辭。但 Mic Air 清洗完之後,SOLO 收到的就是一條結構清晰的需求,而且它甚至還會基於要引用的 skill 來翻譯我們的需求為英文等,來更好地讓大模型結合 skill 來理解。

然後它自動拆解:修改接口參數定義 → 寫批量處理邏輯 → 跑測試 → 調用 GitHub CLI 提交。一句話觸發多步操作,而且它能模糊匹配——我說“提交到 GitHub”,它自動知道要調用 Git 技能。

代碼的事交給 SOLO 跑着,我同時處理社羣。

直接新開一個任務,對着 TRAE SOLO 說“幫我基於這個問題寫個200字的回覆,語氣友好專業一點”,或者“把今天收集的這些素材按主題分類整理一下,直播的時候要用”。…

以前晚上忙到12點的活,現在10點前基本能收工。省下來的時間,我可以看看書,或者想想明天工作那邊的事。

Voice Working 到底改變了什麼

體驗了一段時間,讓我興奮的不是“快了多少”,而是一個更本質的變化:

Voice Working 降低的不是輸入速度,而是表達門檻。

以前跟 AI 協作,你得先在腦子裏把需求組織成結構化的文字——想清楚怎麼描述、用什麼關鍵詞、分幾個步驟說。

這個“翻譯”過程本身就消耗大量精力。

現在你只需要像跟同事吹水一樣說出來,說錯了改口也沒關係,TRAE SOLO 幫你兜底。

對我這種白天有正職工作、晚上做自媒體和開發個人項目的人來說,這意味着我可以把更多精力放在“想清楚要做什麼”上,而不是“怎麼把想法準確傳達給 AI”上。

碎片時間的產出密度,直接翻了一倍不止。

再加上 SOLO 的手機端跨設備能力,我現在的工作模式變成了:

白天開會間隙想到什麼,掏出手機對着 TRAE SOLO 說一句,任務就派出去了;

下午開了幾個會議,有些會議的紀要整理太麻煩,在開完會回工位這個間隙,掏出手機,直接都把相關資料丟給 TRAE SOLO,讓它幫我總結好放在我公司電腦桌面,等我查閲,甚至是直接飛書發給同事;

晚上回家打開電腦,代碼已經寫好、文章初稿已經生成、素材已經整理完畢;

我不再需要“坐在電腦前”才能啓動工作,任何時間任何地點,一張嘴就夠了。

從命令行到 IDE,到 Copilot,到現在用嘴說。

每一步都在縮短“腦子裏的想法”到“它變成現實”之間的距離。

–“配一張相關的優化後工作流的場景圖”–

我覺得 Voice Working 會是接下來一兩年最值得關注的人機交互變化之一。

寫代碼只是開始,寫文檔、做調研、整理文件、安排日程,所有跟 AI 協作的場景都會被語音重構一遍。

誰適合這套組合

三類人會特別有感:

一是經常跟 AI 協作但覺得打字表達需求太慢的人。

二是像我一樣白天有主業、只能用碎片時間做副業的創業者或獨立開發者。

三是喜歡邊走邊想、不想被釘在電腦前的人——SOLO 手機端,讓你在地鐵上、散步時、甚至開會間隙都能把任務派出去,回到電腦前直接驗收成果。

說真的,用了一段時間之後,再回去純鍵盤操作,會有一種“怎麼這麼笨重”的感覺。

就像用慣了觸屏再回去按鍵手機一樣。

你會習慣用嘴工作嗎?來評論區聊聊。