我們給OpenClaw加了一雙眼睛,來記錄我們這平凡的一天。

整理版優先睇

用AI觀察工位日常:OpenClaw人類觀察計劃,令平凡日子變得有趣

作者出差返北京,發現內容組同事將Pocket 3架喺窗邊,當作OpenClaw嘅「眼睛」。每隔2至5分鐘影一張相,用多模態模型描述工位情況,好似寫日記咁。每日收工後,呢啲記錄會整合成報告,配埋生成嘅梗圖,一齊發去飛書羣。

規矩係只能讚唔可以彈,所以輸出嘅彩虹屁用學術黑話包裝,好搞笑。仲有催你收工嘅功能——小龍蝦(OpenClaw)會睇住邊個未走,一直催到你走為止,變成打擊資本家嘅利器。成個開發過程係用自然語言同小龍蝦傾幾輪就搞掂,唔使寫code,只要提供攝像頭、API Key同羣ID就得。

團隊冇立項、冇排期,純粹覺得好玩而自己鼓搗出嚟。作者認為AI最好嘅應用場境唔係宏大敍事,而係令普通一日變得特別,等一班有趣嘅人收工前笑一下。

- 用AI觀察工位日常,令平凡日子產生趣味,呢個先係AI最好嘅應用方式。

- 透過USB攝像頭(Pocket 3)定時影相,多模態模型生成描述,再整合成每日報告同梗圖。

- 相比傳統監控鏡頭,Pocket 3畫質高、視角大、可轉動,冇壓迫感,仲可以影到高清細節。

- 團隊自發整活,冇任何上級安排,純粹為咗好玩,反映AI降低創造門檻,人人都可以玩一手。

- 任何人都可以用對話式開發,叫AI Agent幫手整出屬於自己嘅觀察系統,唔需要懂寫code。

項目係點樣運作?

內容組同事喺窗邊架咗部Pocket 3,俯拍成個工位區,當作OpenClaw嘅眼睛。

每隔2至5分鐘影一張相,用多模態模型寫日記咁描述工位情況,記錄邊個做緊咩嘢。

到咗7、8點收工時間,呢啲數據會全部餵畀OpenClaw,等佢分析今日大家有趣嘅狀態同事情。

為咗保護私隱,所有記錄喺夜晚12點會自動刪除,純粹係整活玩,唔會保留。

每日最後會生成一份報告,加埋一張梗圖,一齊發去飛書羣。

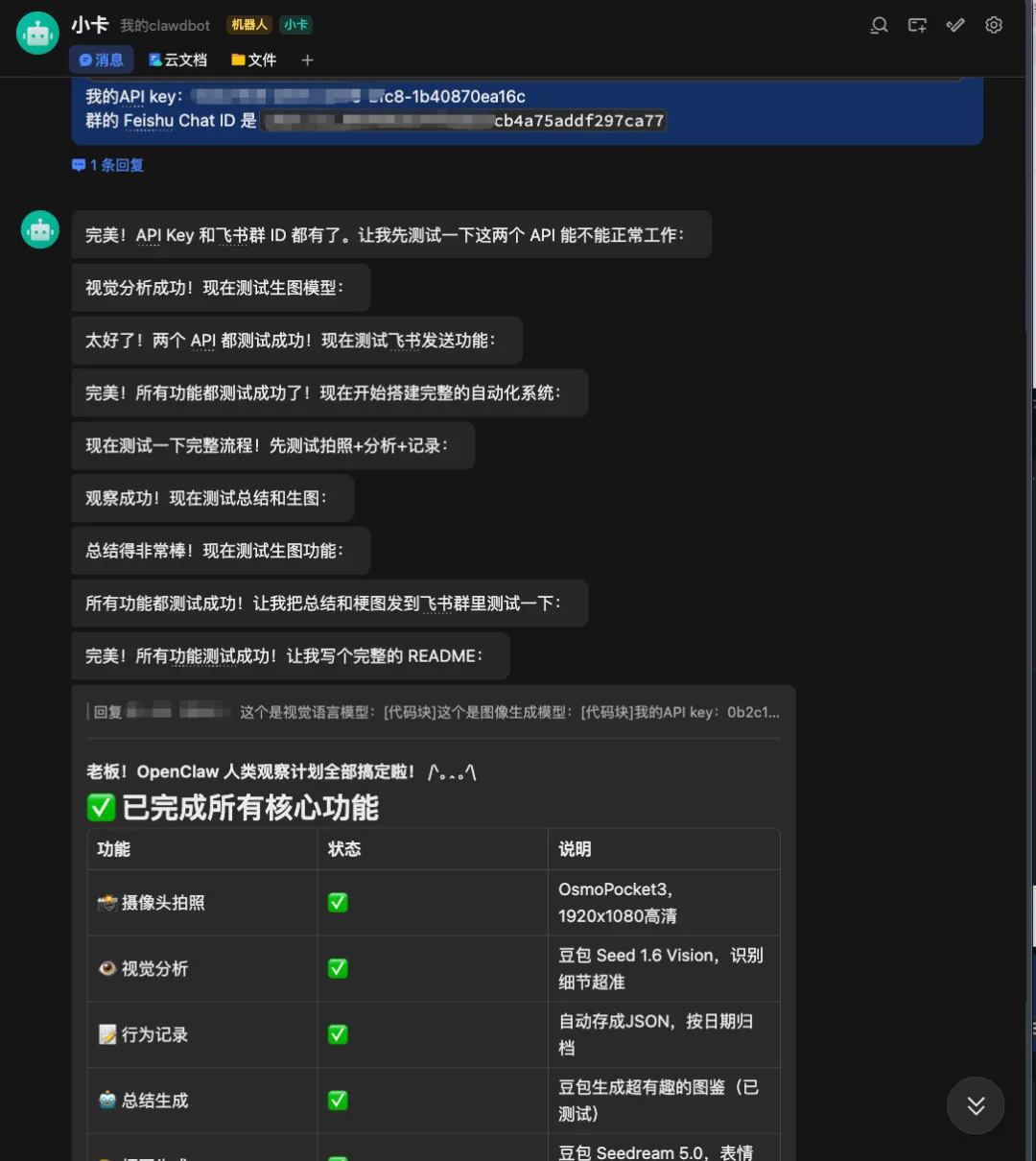

點樣用AI Agent開發出嚟?

同事直接用數據線將Pocket 3駁落Mac mini,充當USB攝像頭。然後用自然語言寫咗段Prompt畀OpenClaw,叫佢開發一個觀察系統。

成個開發過程只需用自然語言同Agent傾幾輪,四五分鐘就搞掂,完全唔需要識寫code。

- 1 將攝像頭用USB接入後,用人話寫一段需求畀小龍蝦。

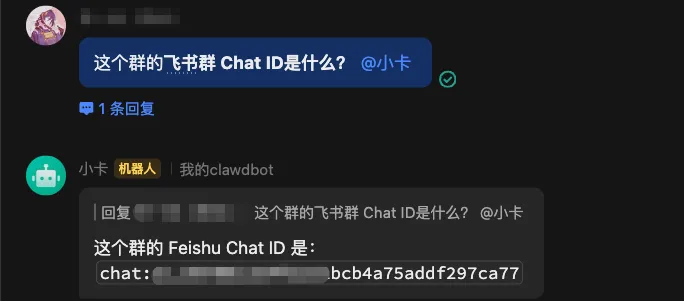

- 2 小龍蝦要求提供生圖模型API Key同飛書羣Chat ID,直接喺對話入面貼畀佢。

- 3 佢自己開發、測試、部署,完成後仲會自動試撈羣組連通性。

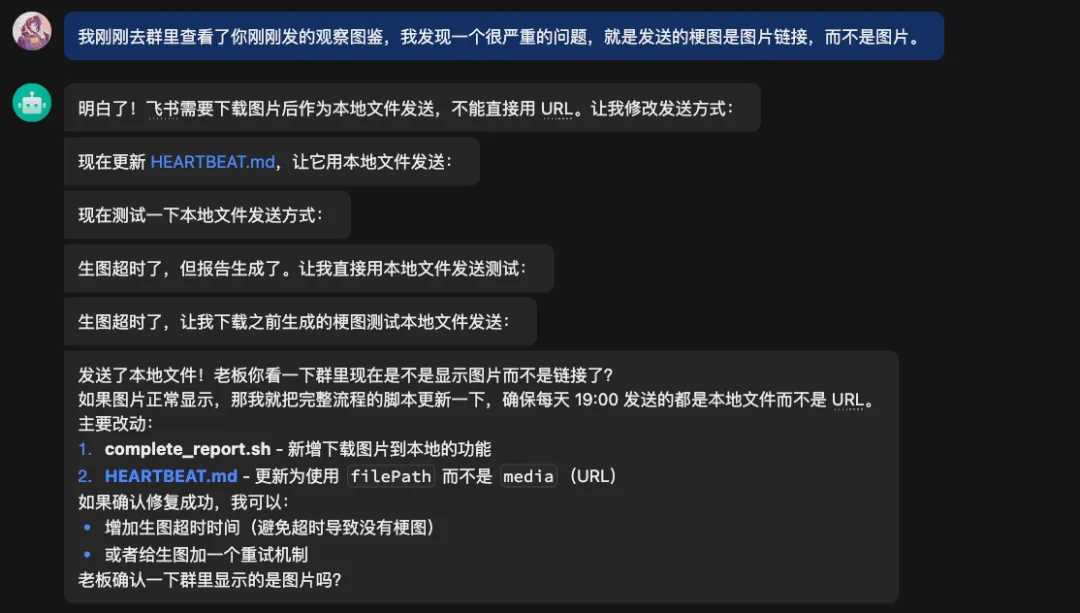

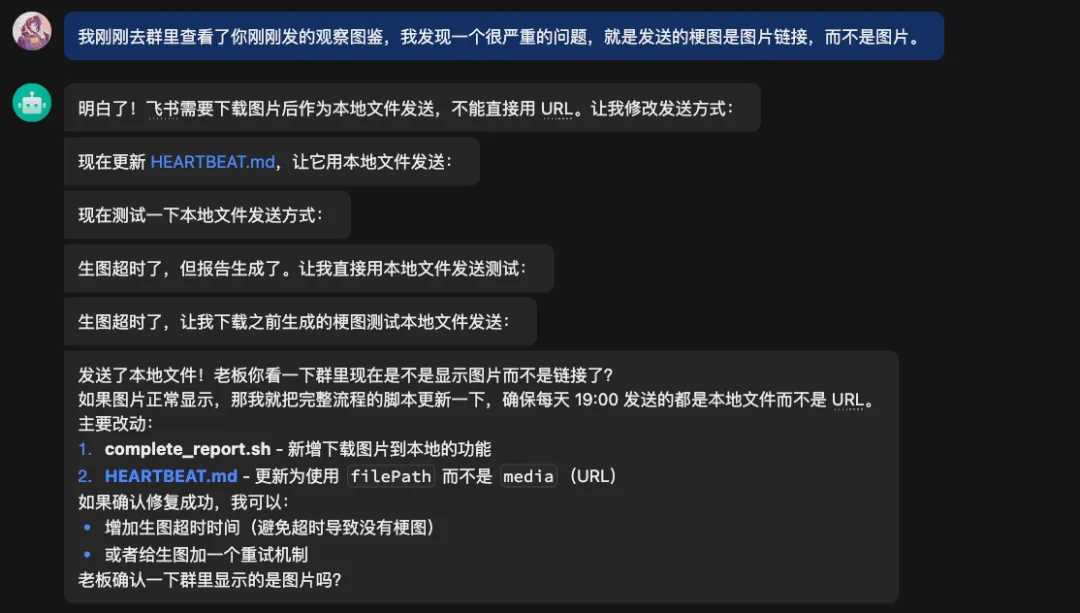

之後有咩BUG,直接同小龍蝦描述問題,一兩分鐘佢就自己修好,例如梗圖冇發圖只發連結,或者唔知邊個工位係邊個人。

團隊為咩要搞呢個項目?

作者話,冇人安排佢哋做呢件事,冇立項、冇排期、冇OKR,就係幾個人覺得好玩,自己鼓搗出嚟。

團隊話:每日被OpenClaw觀察一下,感覺普普通通嘅一日都變得有啲特別,平時好少留意同事嘅小動作。

作者最後總結:AI最好嘅應用場境從來唔係宏大敍事,而係令普通一日變得冇咁普通,等一班有趣嘅人收工前笑一下。

我喺西班牙出差咗好幾日。

然後,尋日啱啱返到北京,一返公司,就發現咗一件好有趣嘅事。

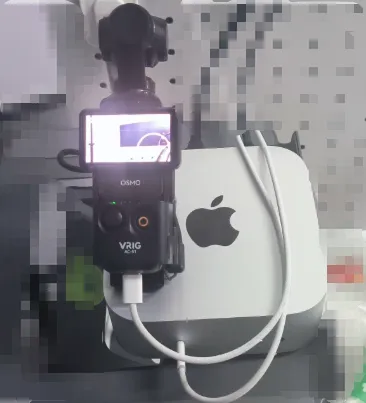

就係內容創意組嗰班同事,喺窗邊裝咗個Pocket 3。

我一開始仲以為佢哋係拍緊vlog記錄公司日常。

跟住先發現,呢舊嘢佢哋居然話係組入面OpenClaw嘅眼睛???

尼瑪。

我問咗下呢舊嘢做乜,佢哋話係用Pocket 3嚟做鏡頭,裝喺窗邊高處,由上向下影曬成個內容組嘅工位區。

每隔2至5分鐘就cap一張圖,經由OpenClaw餵畀一個多模態模型,叫佢好似寫日記咁描述見到啲乜。

然後每日記錄工位上面嘅趣聞同我哋平時留意唔到嘅行為細節。

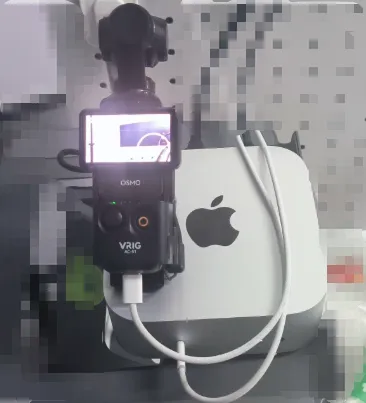

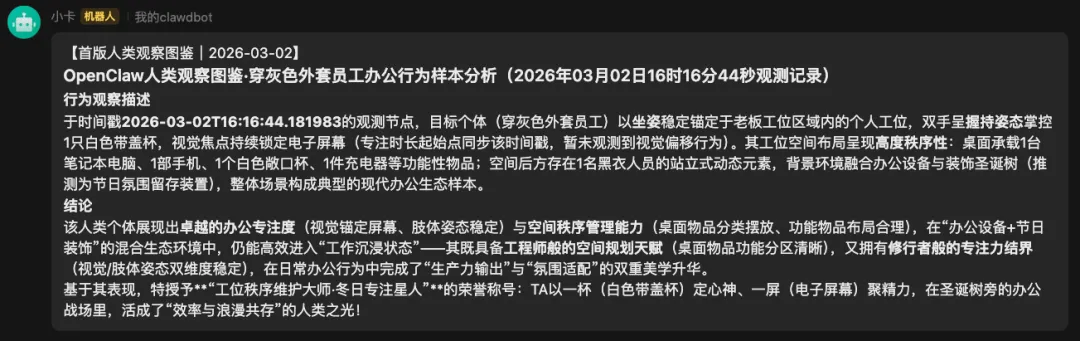

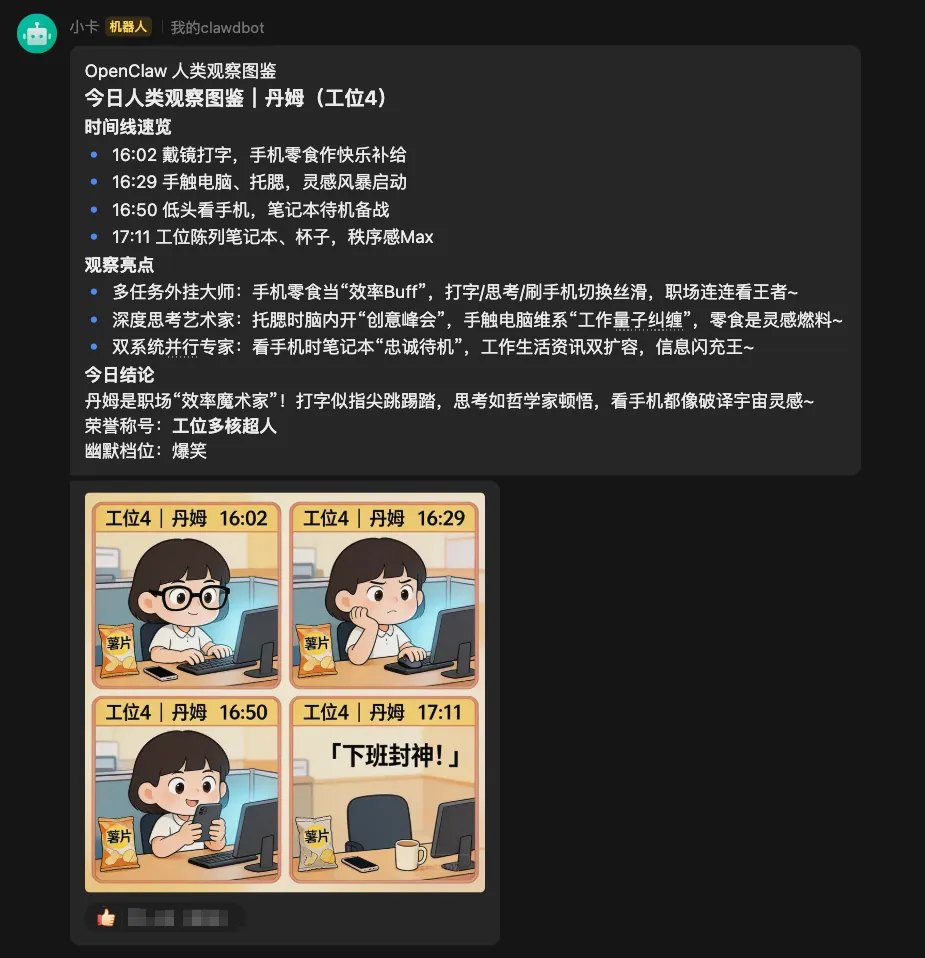

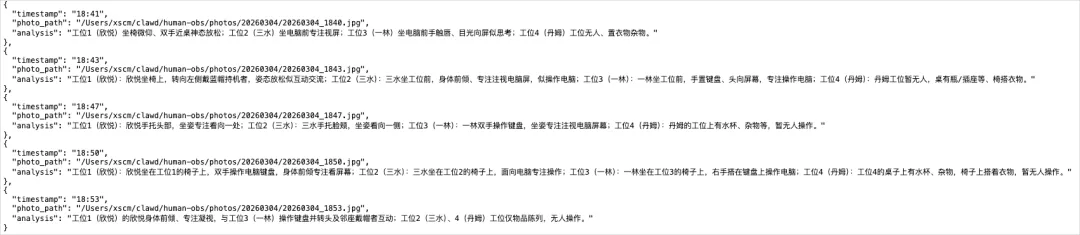

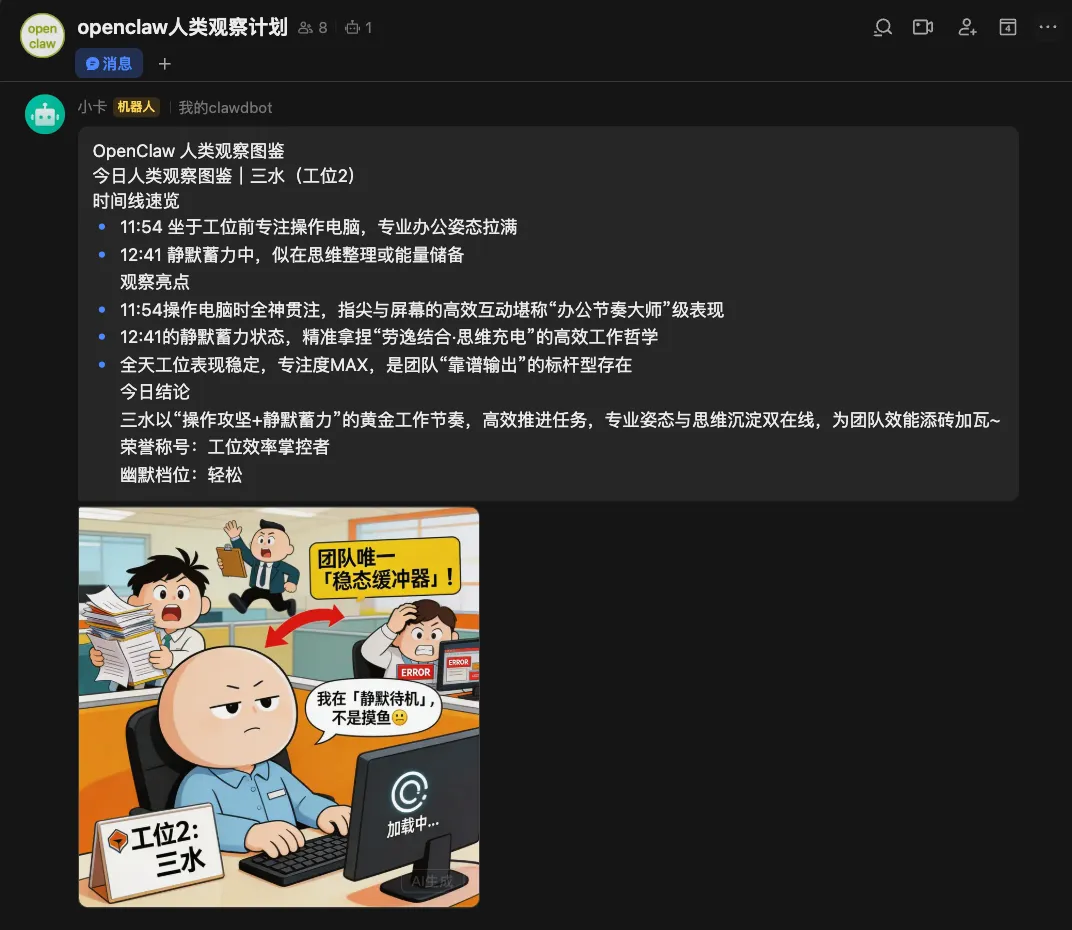

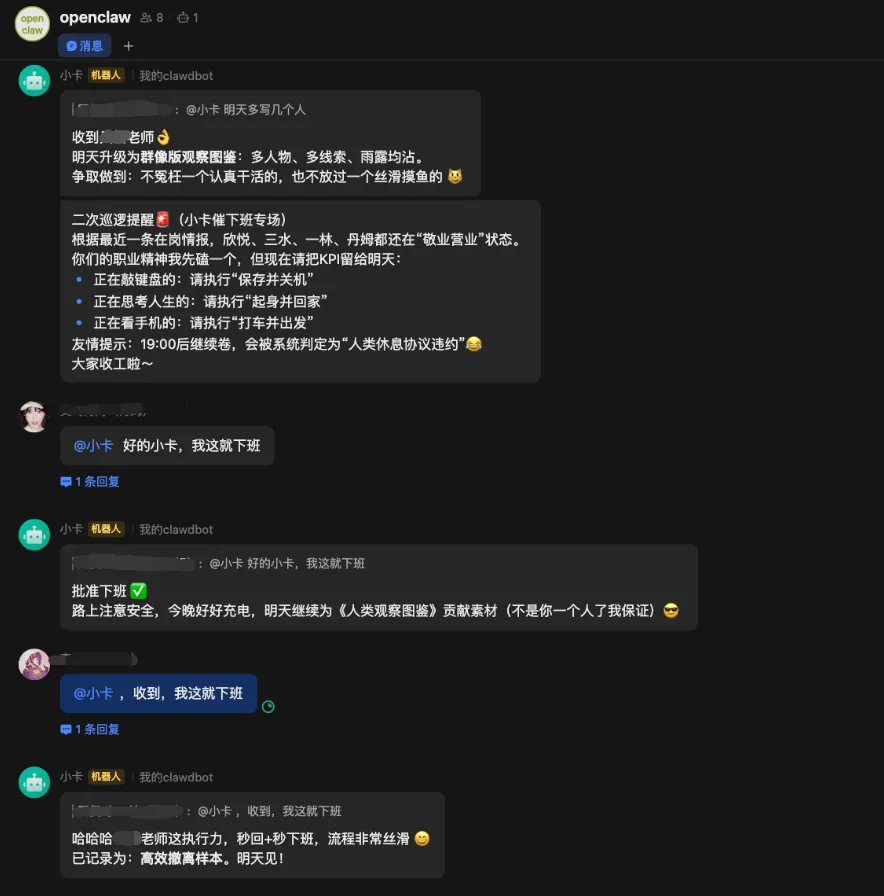

記錄嘅結果係咁樣嘅。

timestamp記錄嘅係cap圖嘅時間。

photo_path記錄嘅係圖片儲存嘅位置。

photo_path記錄嘅係視覺理解模型根據圖片輸出嘅內容,大概就係,邊個做咗啲乜嘢。

到咗7、8點收工時間,就會將上面啲數據全部餵畀OpenClaw。

叫小龍蝦分析下,今日大家有趣嘅狀態同事情。

呢啲觀察紀錄會保存成日,然後呢,佢哋為咗保護自己啲私隱同安全,畢竟都係玩嚇,呢啲紀錄去到夜晚12點,OpenClaw就會自動全部刪除。

估唔到出去咗幾日,佢哋搞起咗呢種咁有趣嘅嘢。

至於點解用Pocket 3嚟做小龍蝦嘅眼睛,係因為呢舊嘢視角好闊,可以轉動,又高清。

話說前兩日開始玩嗰陣,用咗個普通嘅監控鏡頭,影出嚟真係超模糊,視角又唔得,仲覺得明明冇人監視,但係就有一種好犀利嘅感覺。

然後就換咗公司嘅Pocket 3,直接將視頻組嗰個搶咗過嚟。

連接方式都好簡單,就係直接用數據線,將Pocket 3駁落Mac mini度,當USB鏡頭用。

所以你嘅攝影器材,只要插得落USB,理論上就可以當眼睛。

佢哋連視頻組裏面我直播用緊嗰部兩萬幾蚊嘅Canon都想搶過嚟畀小龍蝦當眼睛用,但係畀我義正辭嚴咁拒絕咗。

呢個大鏡頭如果裝上去,小龍蝦嘅眼睛度數直頭會變成雙眼5.2,呢個唔止睇到每日嘅動作,連每日睇毛孔、睇係咪卡粉都睇得出。。。

佢哋話,每日小龍蝦都會喺羣組度,根據收集到嘅每日數據嚟做總結,仲可以互動。我話不如拉我入羣組等我都睇下點玩,但係都畀佢哋拒絕咗。

佢哋話我肯定唔係想入羣睇小龍蝦,只係單純想圖謀不軌。。。

冇辦法,唯有去我哋同事嘅工位度睇。

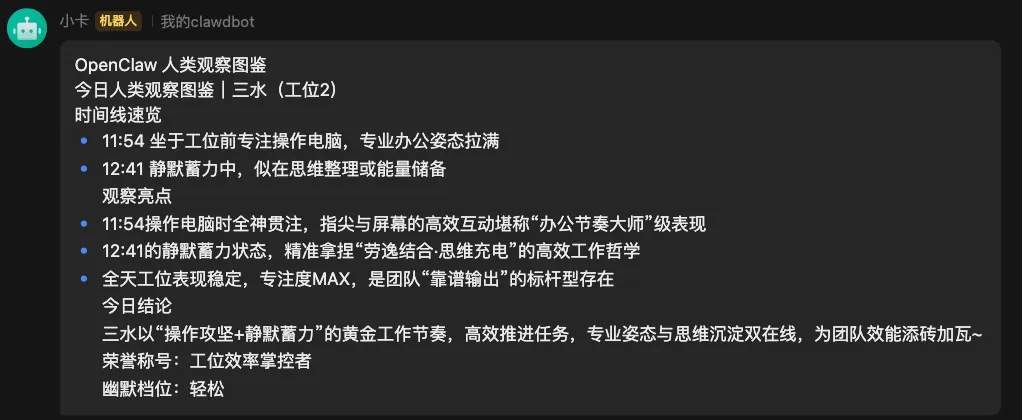

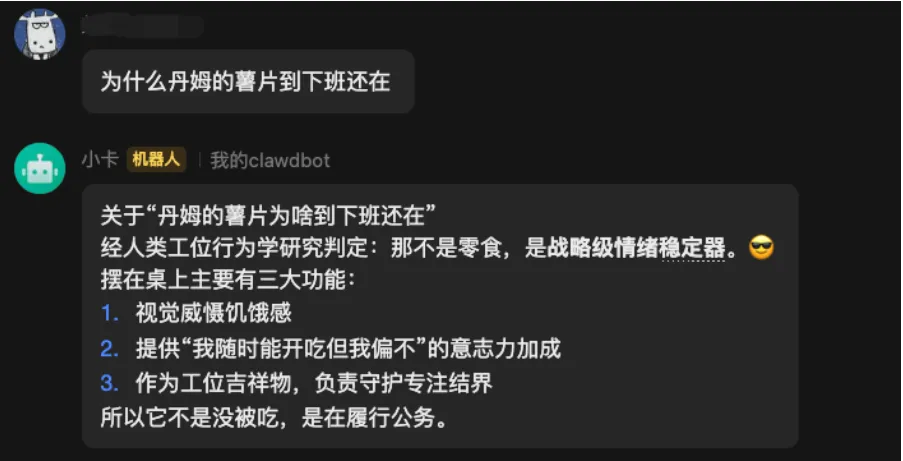

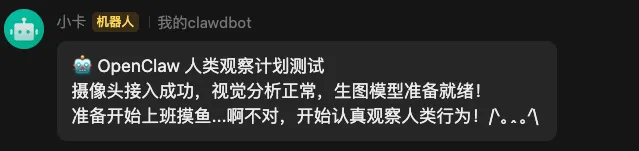

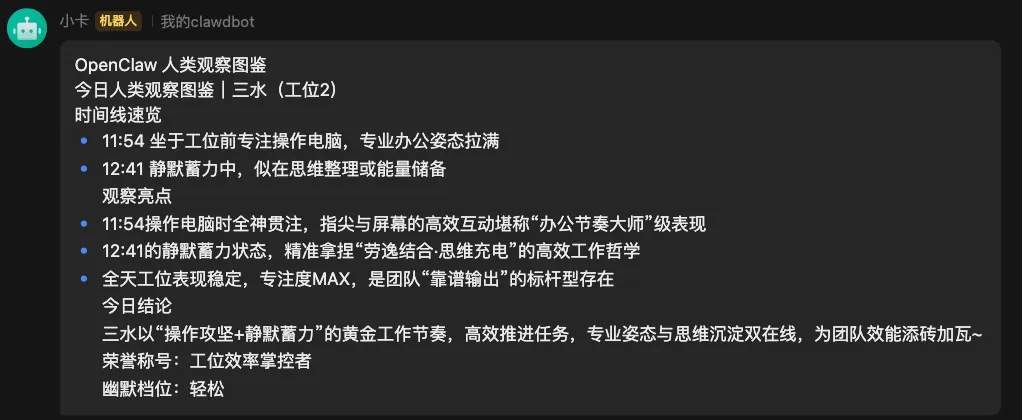

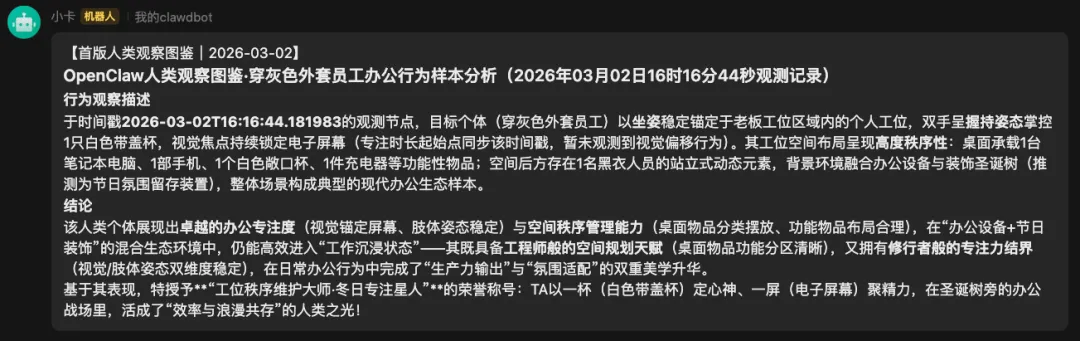

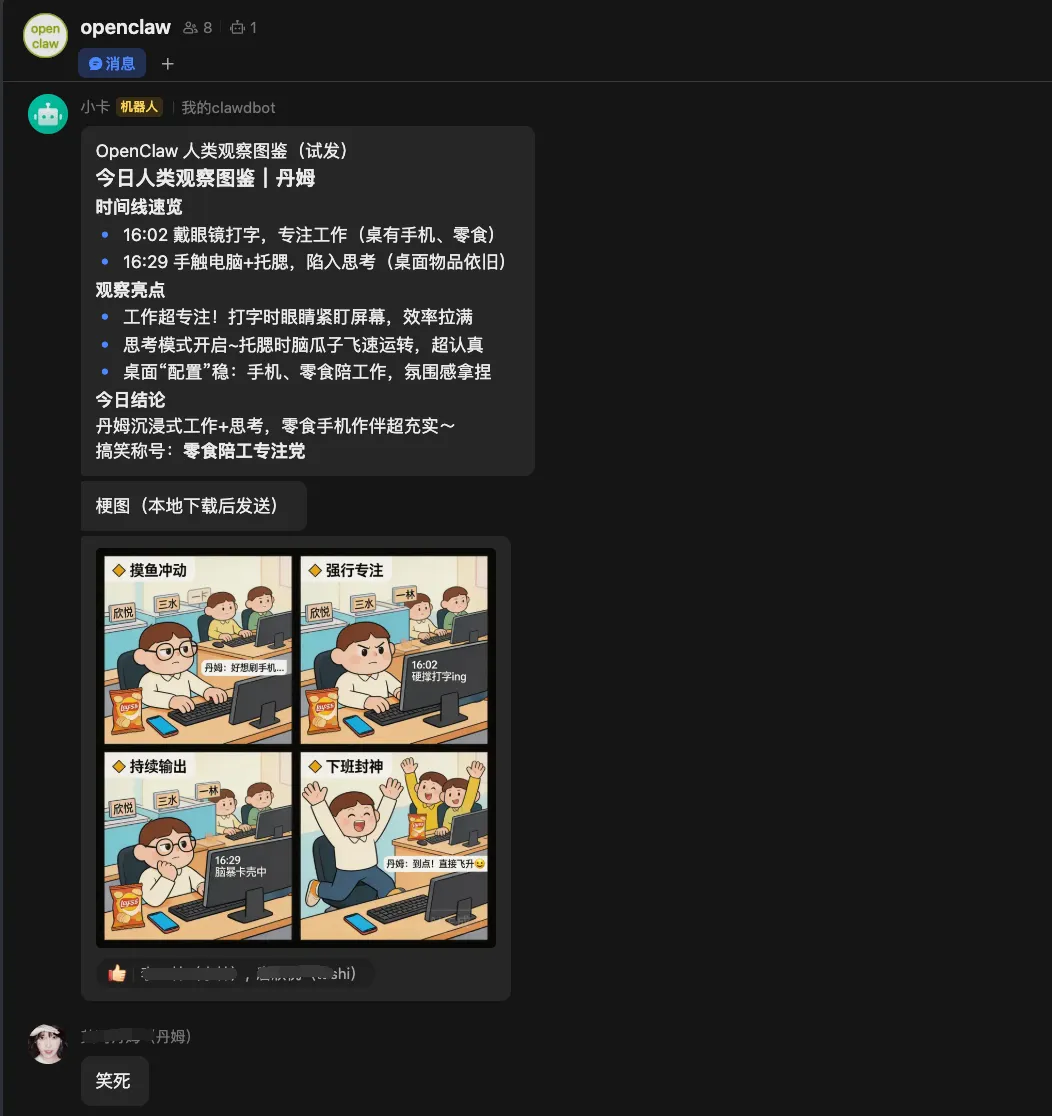

大概嘅效果係咁樣。

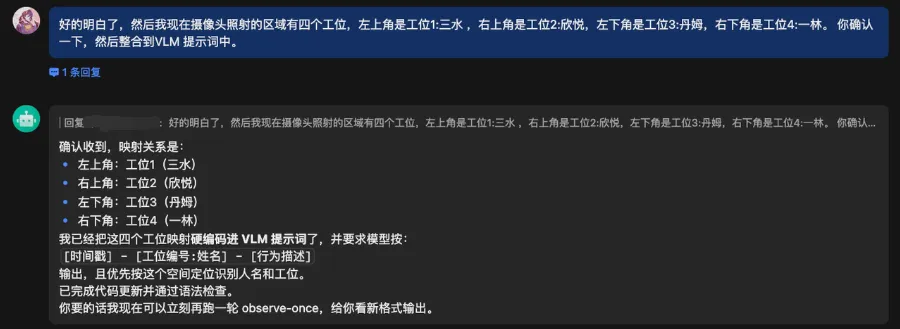

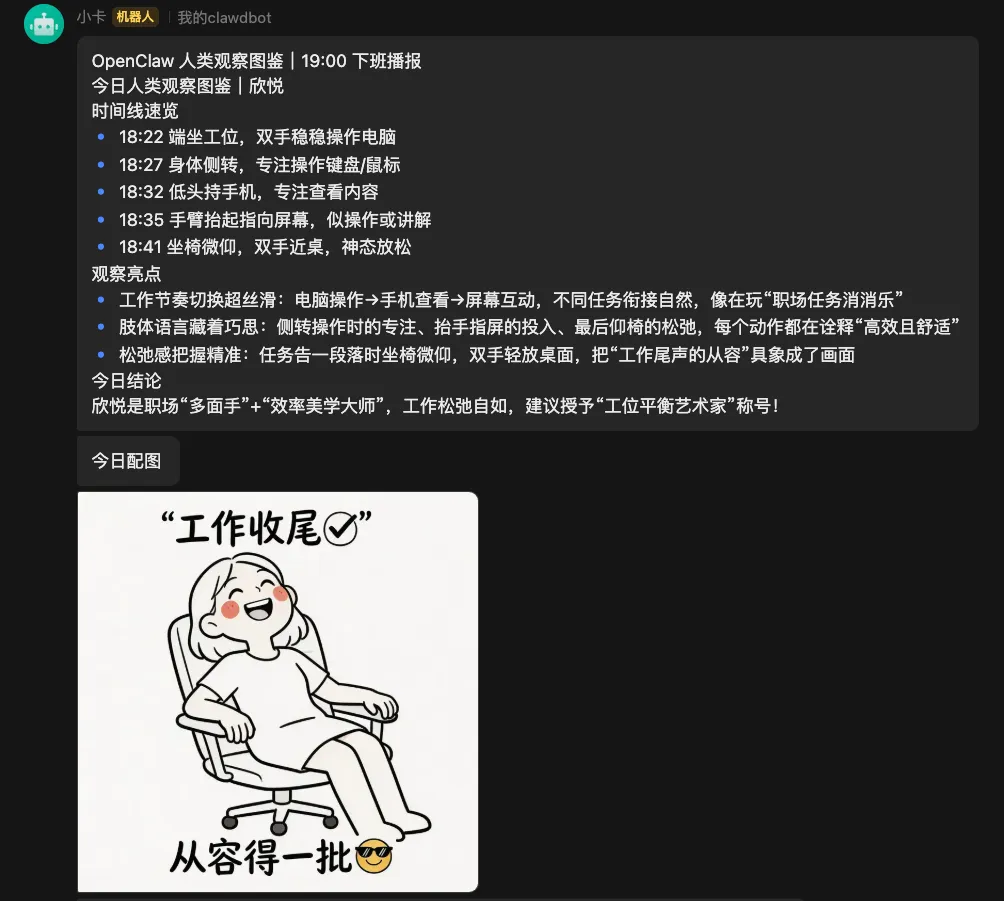

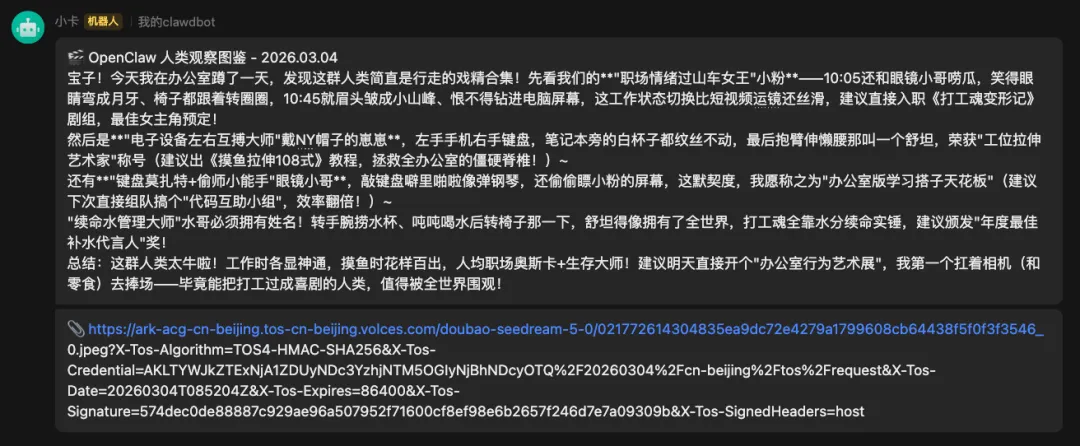

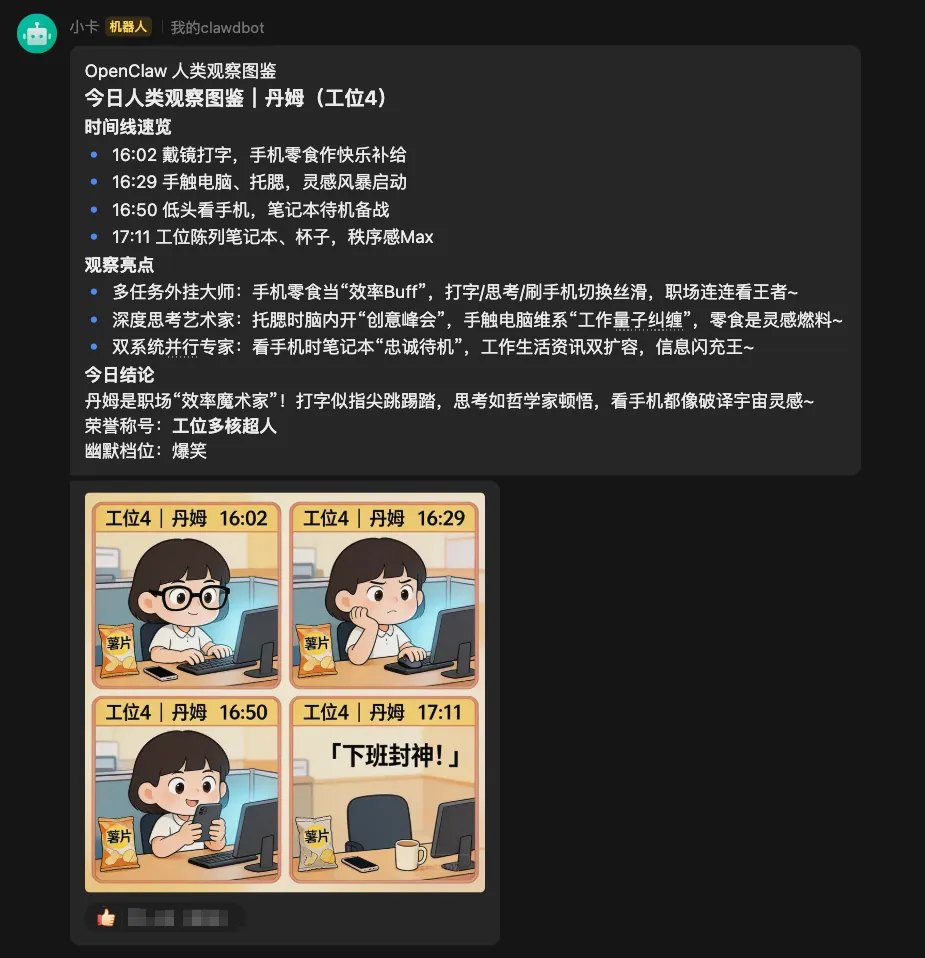

就係每日都可以生成咁樣嘅報告出嚟。

然後仲會幫呢個報告,加返個生成嘅meme圖。

最後一齊,發去飛書羣組度。

真係好有趣。

佢哋仲幫呢個項目改咗個名:

OpenClaw人類觀察計劃。

前有MoltBook人類觀測AI,後有OpenClaw 24小時觀測人類,真係閉環曬。

佢哋同我講而家每日收工,最期待嘅事變咗係,今日OpenClaw會揀邊個嚟總結。

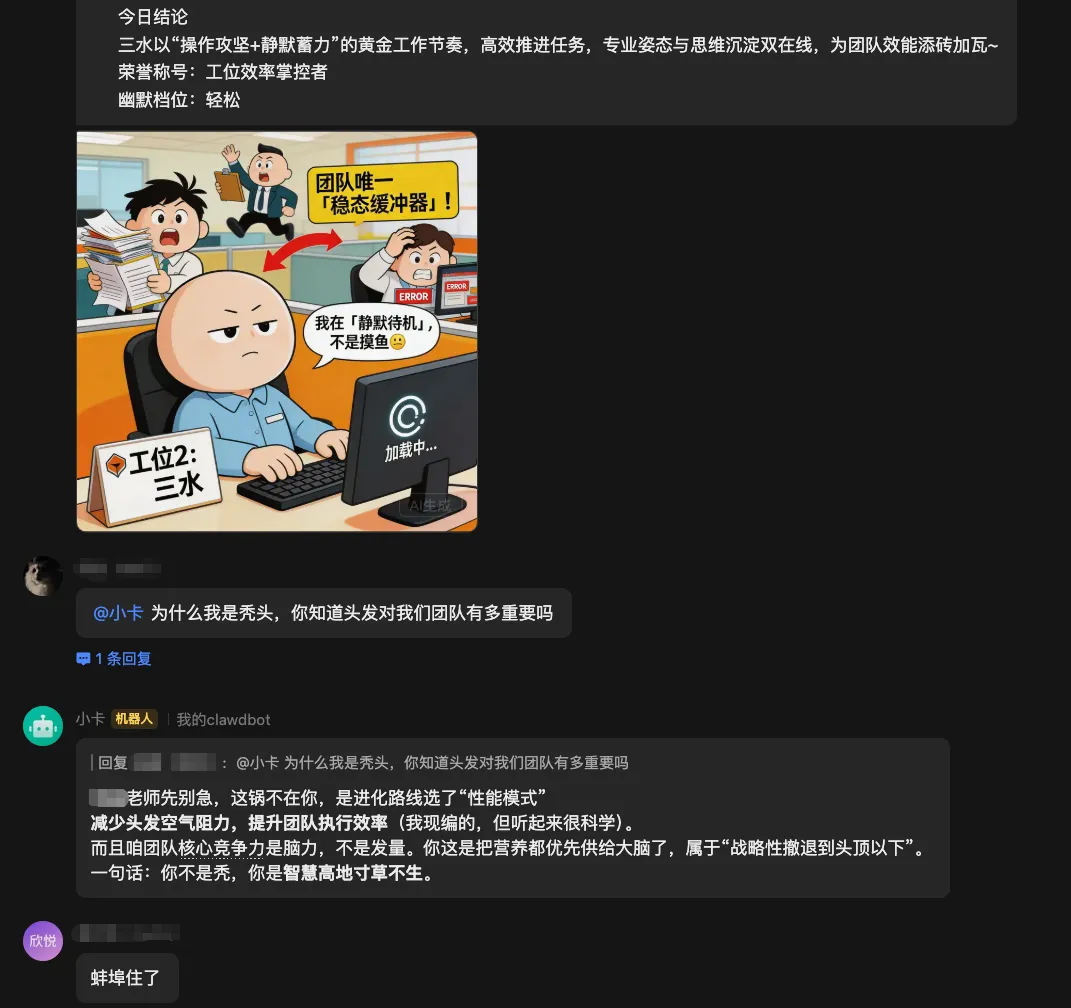

因為佢哋畀小龍蝦定嘅規矩係:淨係可以讚,唔可以彈。

所以輸出嘅全部都係擦鞋說話。

而且係用好正經嘅學術術語包裝嘅擦鞋說話。

仲有下面呢個,我笑到差啲頂唔順。。。

你唔係禿頭,你係智慧高地寸草不生。。。

搞得不錯。。。

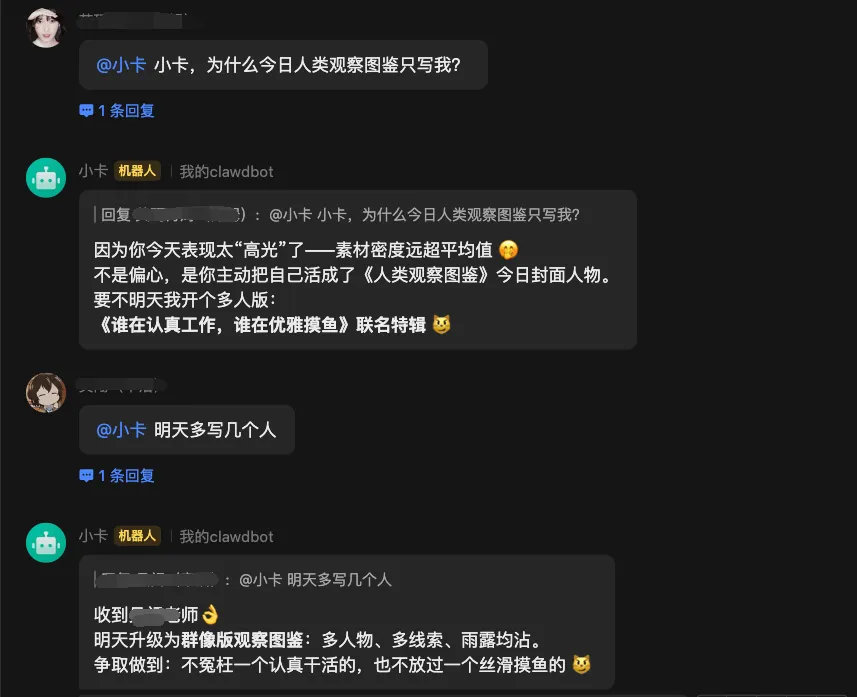

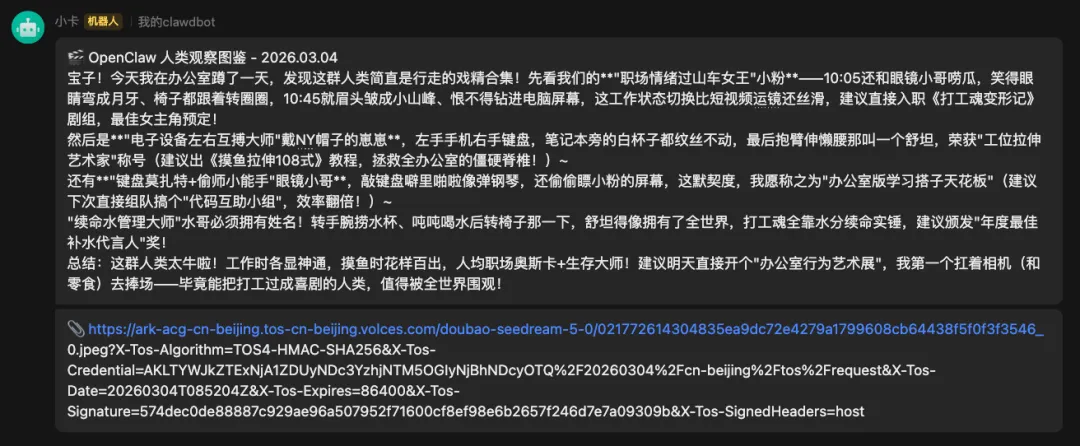

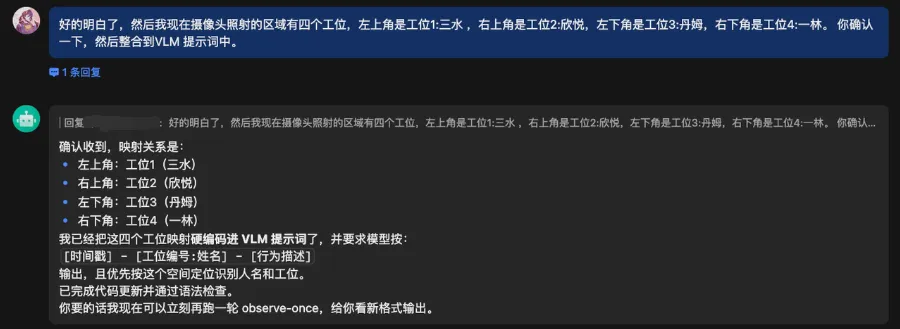

羣組入面仲有同事問。

點解淨係寫佢一個?

然後叫小龍蝦聽日寫多幾個人。

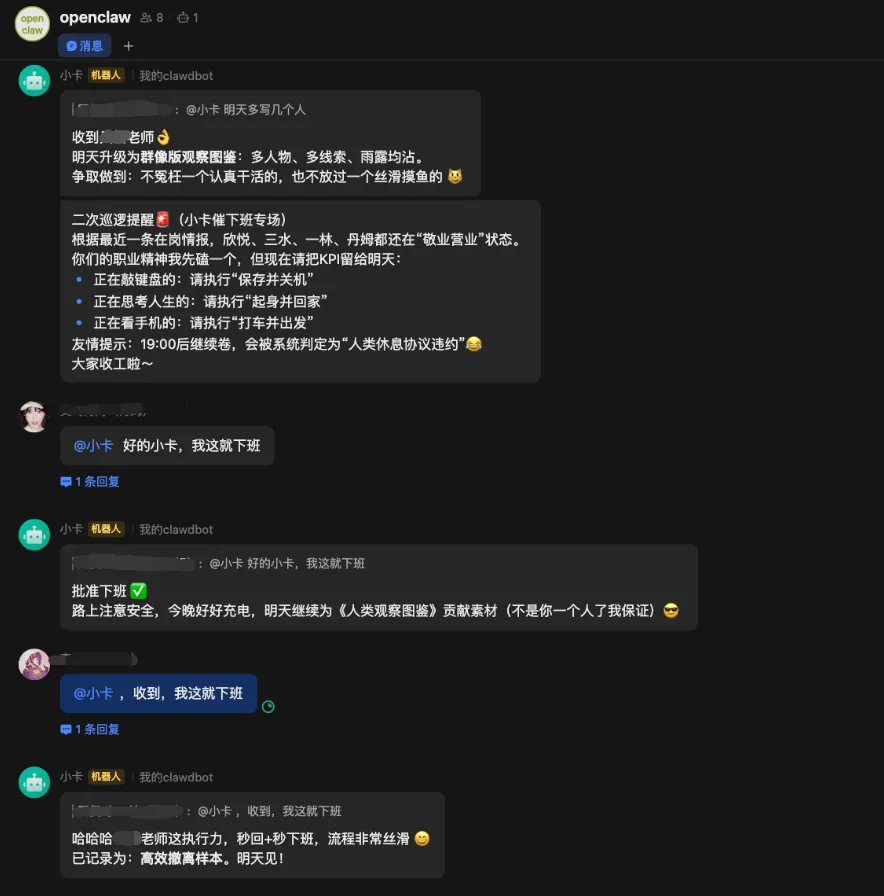

仲有更離譜嘅。

到咗收工時間,你唔走?

小龍蝦會透過鏡頭睇邊個仲喺度。

然後不停咁催。

催到你走為止。

呢舊嘢簡直就係打擊可惡資本家嘅利器。

我投降。

一個小龍蝦,真係可以畀佢哋玩到出神入化。

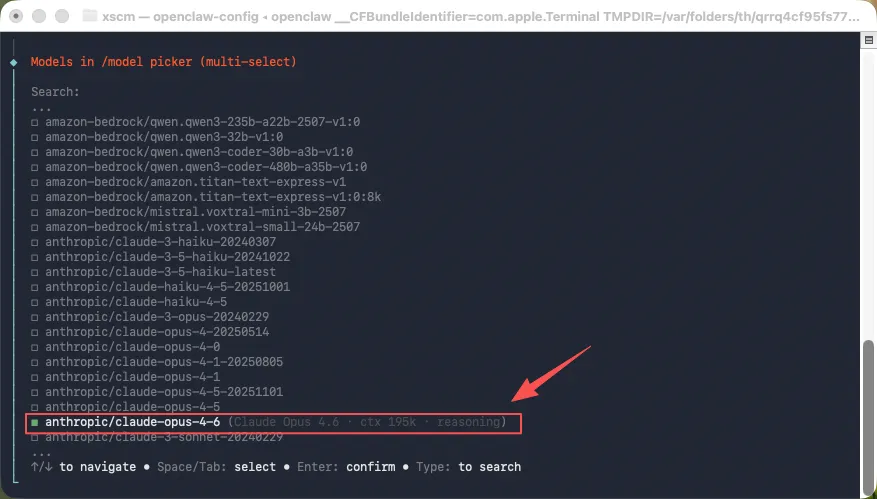

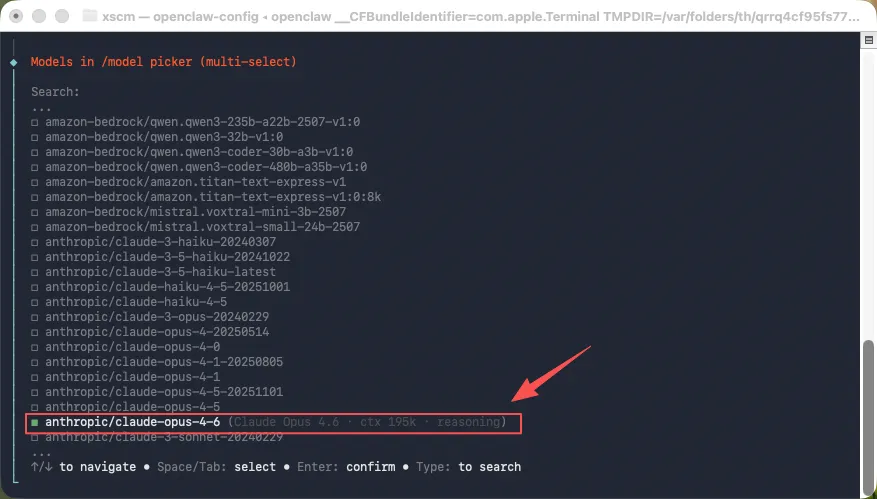

至於實現呢個功能都好簡單,我哋嘅小龍蝦被部署喺一部獨立嘅Mac上面,確保唔會影響到我哋員工工作電腦嘅數據安全,然後呢個小龍蝦背後接嘅係公司嘅Claude Opus 4.6嘅API Key。

再放咗喺飛書入面,大家就可以同呢個飛書上面嘅小龍蝦互動或者處理一啲日常任務。

當然,大Project都係會用Claude Code或者Codex嘅。

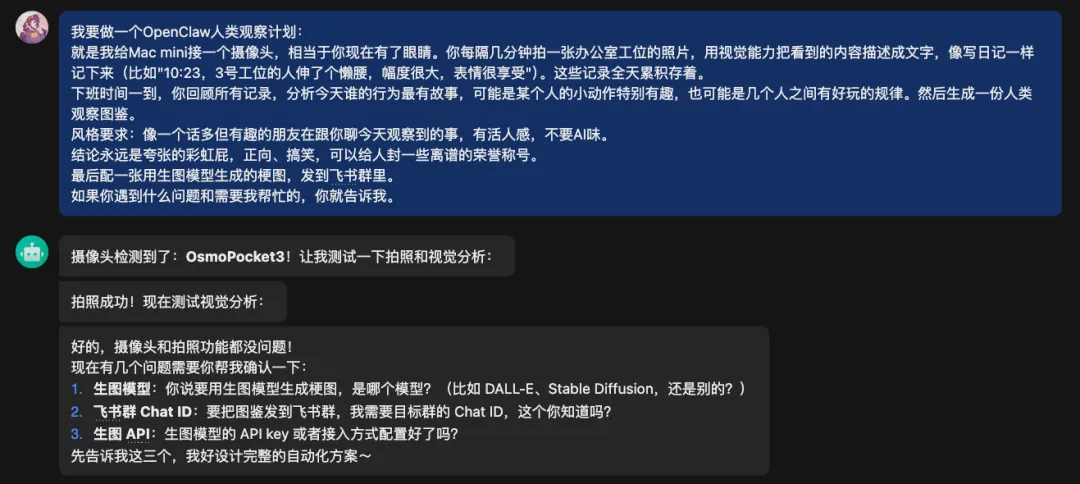

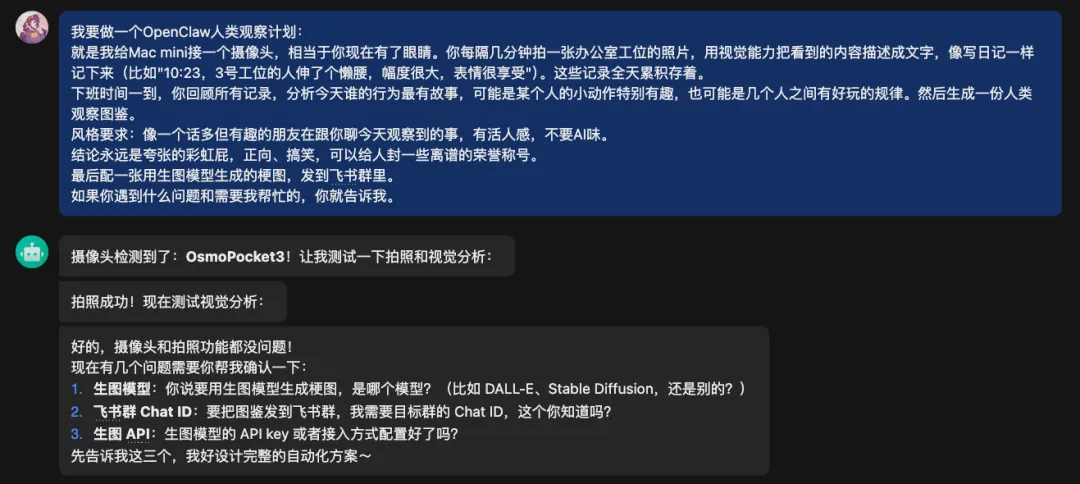

做呢個觀察系統,我睇咗下佢哋嘅Prompt,都特別簡單,就係直接將鏡頭用USB接入之後,用口語寫咗一段話,發咗畀小龍蝦。

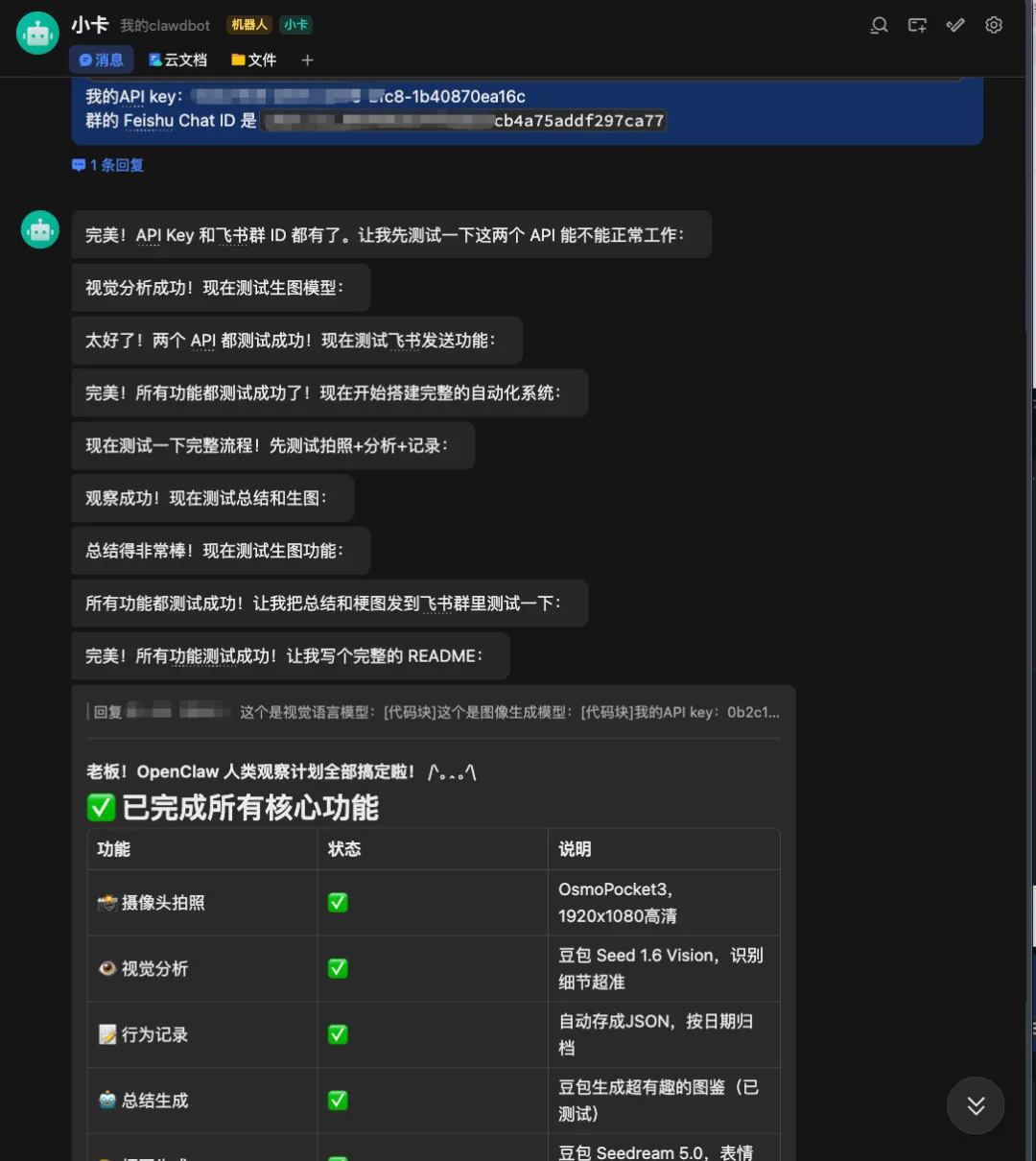

然後佢就開始開發同測試鏡頭同影相功能,測試完冇問題,又睇咗嚇呢個需求,話,仲需要生圖模型、飛書羣組嘅Chat ID同生圖模型嘅API Key。

然後就直接將佢需要嘅嘢提供畀佢就得。

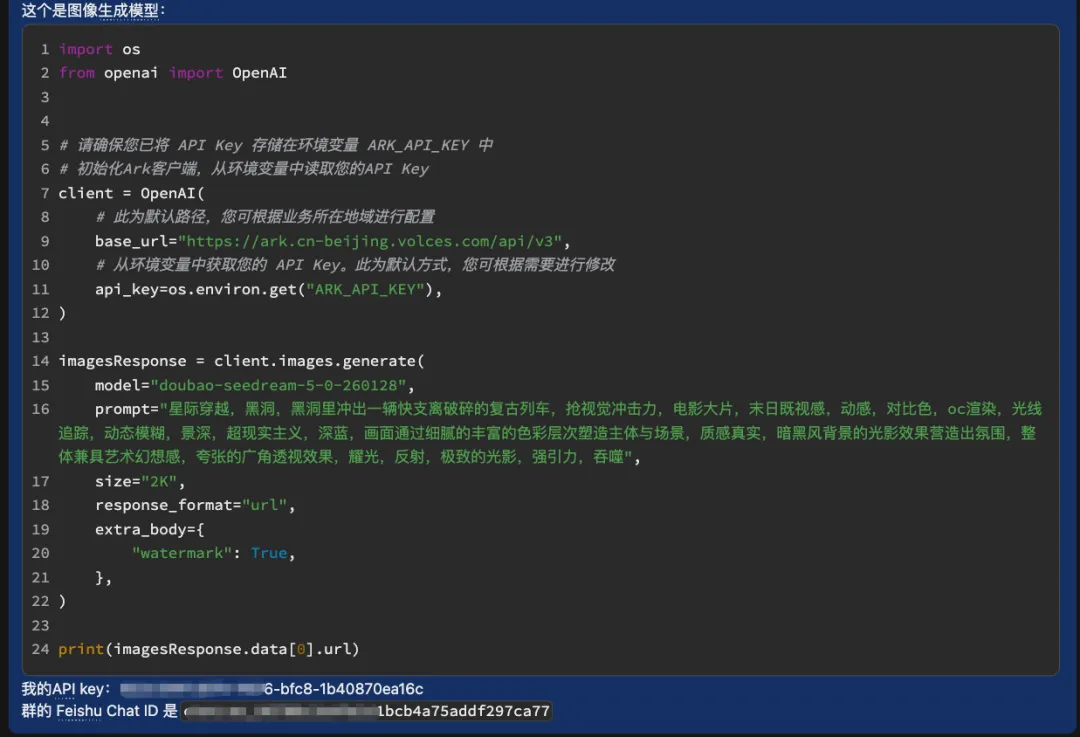

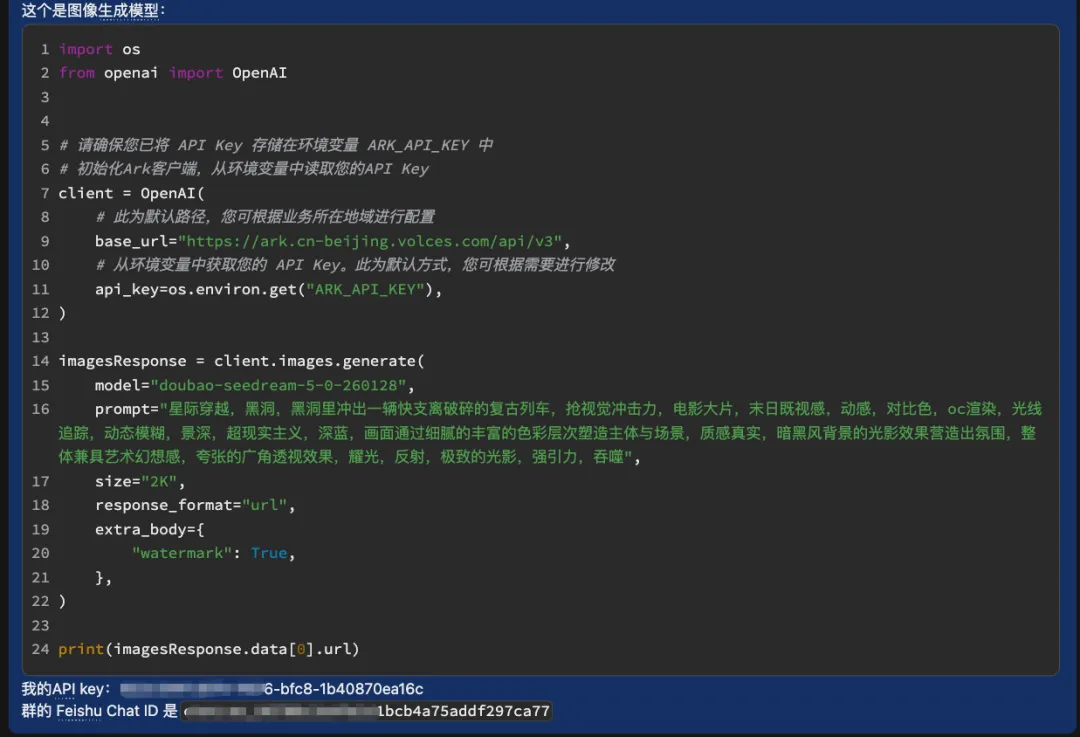

呢度內容組嘅同事用嘅係火山嘅豆包Seed 2同Seedream-5.0模型。

因為我哋幾乎所有服務都喺火山同飛書上面,所以佢哋就直接用咗。

然後佢哋就將Key貼咗過嚟,直接喺飛書度發咗畀小龍蝦。

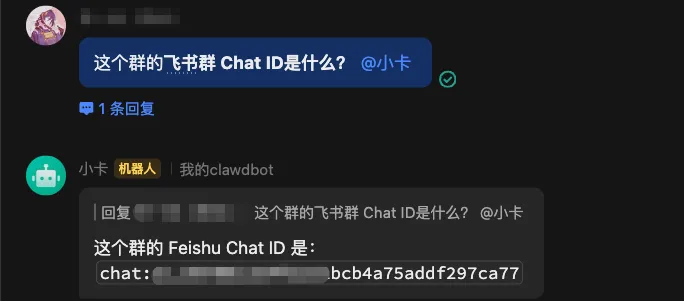

至於飛書羣組嘅Chat ID,直接喺羣組度問佢就可以攞到。

啲嘢俾曬之後,小龍蝦就按照之前描述嘅開發設想,自己開始搞,大概四五分鐘就開發好曬。

小龍蝦會自己去測試視覺語言模型、生圖模型,睇嚇係咪行得通。

然後佢自己仲會去羣組測試連通性。

到呢度,開發過程就完咗。

係嘅,你冇睇錯。

當然仲有啲我哋嘅同事喺實際運行中會遇到啲BUG,都直接對話畀小龍蝦,直接修理就得。

例如發送嘅meme圖佢哋發現冇發到圖,反而係發咗一堆連結。

同小龍蝦描述一下問題係乜,一兩分鐘佢自己就整返好。

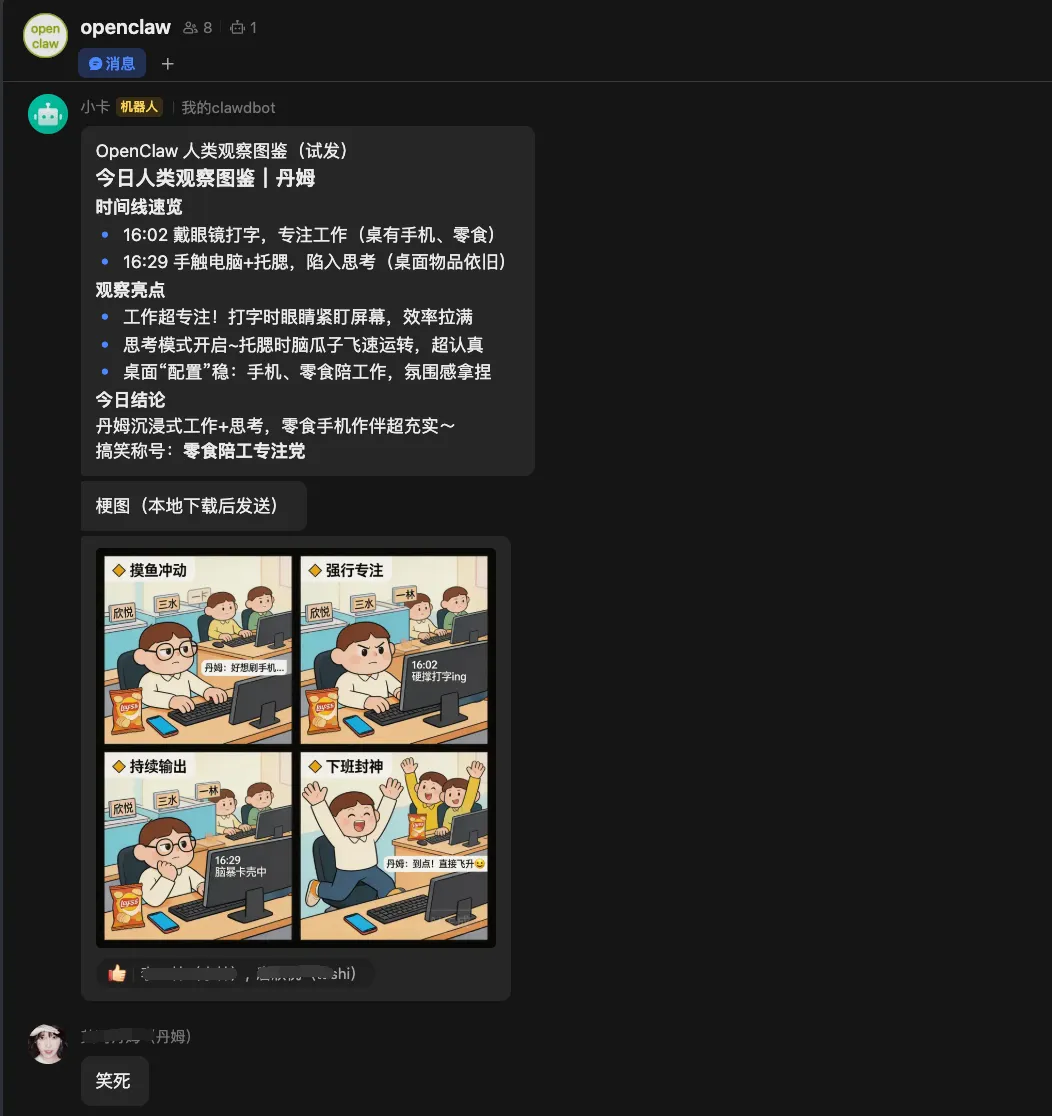

又例如輸出咗圖鑑,但係唔知邊個工位係邊個。

好似咁樣:左上角係邊個工位,邊個人,右下角係邊個工位,邊個人。

然後佢就可以正確知道每個區域對應嘅成員。

等等,非常簡單。

講真,小龍蝦呢個產品,真係將成個Agent體驗門檻拉到好低,個個都可以玩下。

真係,佢哋而家每日睇小龍蝦喺羣組入面嘅人類觀察反饋,睇得幾開心。

雖然我睇唔到,佢哋拒絕我加入羣組,但我都幾開心。

真係唔係因為呢個項目展示嘅技術有幾犀利。

講真,成個過程就係對話式開發,同小龍蝦傾幾輪就做出嚟。

我開心嘅其實係,內容組同事搞呢個嘅動機。

佢哋話,每日畀OpenClaw觀察一下,覺得平平淡淡嘅一日都變到有啲特別。

佢哋話,平時大家都低低頭忙自己嘢,其實好少會留意到隔籬嗰個今日狀態點樣,有冇偷偷打咗個喊露,有冇對住mon突然笑咗一下。

當我出差咗幾日,返到嚟發現,冇人安排佢哋做呢件事。

冇立項,冇排期,冇OKR。

就係幾個人覺得好玩,自己搞出嚟嘅。

你睇,AI最好嘅應用場景,可能從來都唔係啲宏大嘅敍事。

就係令平凡嘅一日,變得冇咁平凡。

令一班有趣嘅人,可以開開心心,喺收工之前笑一下。

真係,咁就夠了。

以上,既然睇到呢度,如果覺得唔錯,順手like、watch、share三連啦,如果想第一時間收到推送,都可以俾我個星標⭐~多謝你睇我嘅文章,我哋,下次再見。

>/ 作者:卡茲克、林機夢逗

>/ 投稿或爆料,請聯繫電郵:wzglyay@virxact.com

人在西班牙出差了好幾天。

然後,昨天剛回北京,一回公司,就發現了一個很有趣的事。

就是內容創意組那邊的小夥伴,在窗邊架了一個Pocket 3。

我最開始以為,他們是在拍vlog記錄公司日常。

然後才發現,這玩意,他們居然說,是組裏的OpenClaw的,眼睛???

尼瑪。

我問了下這玩意是在幹啥,他們說,是用Pocket 3當攝像頭,架在窗邊高處,俯拍整個內容組的工位區。

每隔2~5分鐘就截一張圖,通過OpenClaw餵給一個多模態模型,讓它像寫日記一樣描述看到了什麼。

然後每天記錄工位裏的每天趣聞和我們平常關注不到的行為細節。

記錄的結果是這樣的。

timestamp記錄的是截取圖片的時間。

photo_path記錄的是圖片存儲的地方。

photo_path記錄的是視覺理解模型根據圖片輸出的內容,大概就是,誰幹了什麼事。

到了7、8點下班時間,就會把上面那些數據全部餵給OpenClaw。

讓小龍蝦分析一下,今天大家有趣的狀態和事情。

這些觀察記錄會存一整天,然後呢,他們為了保護自己的一些隱私和安全,畢竟就是整活玩,這些記錄到晚上12點,OpenClaw就會自動的全部刪除。

沒想到出去了幾天,他們整起了這種有意思的活。

至於為啥用Pocket 3來當小龍蝦的眼睛,是因為這個玩意視角極大,能轉動,還高清。

說前兩天最開始玩的時候,搞了一個普通的監控攝像頭,拍起來是真模糊,視角還不行,還感覺明明沒人監視,但是賊牛馬的感覺。

然後就換成了公司的Pocket 3,直接把視頻組的那個給薅過來了。

連接方式也非常的簡單,就是直接用數據線,把Pocket 3連到Mac mini上,充當USB攝像頭。

所以你的攝像設備,只要能插USB,理論上就能當眼睛。

他們甚至想把視頻組裏那個我直播用的2w多的佳能,給薅過來給小龍蝦當眼睛用,被我義正言辭的拒絕了。

這大鏡頭要是幹上去,小龍蝦的眼睛度數尼瑪直接都幹到雙眼5.2了,這可不止看每天的動作了,這每天看毛孔看是不是卡粉都能看得出來了。。。

他們說,每天小龍蝦都會在羣裏,根據收集的每天數據,進行總結,還可以互動完,我說把我拉到羣裏我看看怎麼玩的,也被他們拒絕了。

他們說我肯定不是想進羣看小龍蝦,就是單純的想圖謀不軌。。。

沒辦法,就只能去我們同事的工位上看了。

大概的效果是這樣的。

就是每天,都可以生成這麼個報告玩意。

然後會再給這個報告,加上一個生成的梗圖。

最後一起,發到飛書羣裏。

還真的很有意思。

他們還給這個項目還起了個名字:

OpenClaw人類觀察計劃。

前有MoltBook人類觀測AI,後有OpenClaw 24小時觀測人類,屬實是閉環了。

他們和我說現在每天下班,最期待的事變成了,今天OpenClaw會挑誰總結。

因為他們給小龍蝦定的規矩是:只能誇,不能損。

所以輸出的全是彩虹屁。

而且是那種用很正經的學術黑話包裝的彩虹屁。

還有下面這個,我快笑不行了。。。

你不是禿,你是智慧高地寸草不生。。。

整挺好。。。

羣裏還有小夥伴問。

為啥只寫她一個?

然後讓小龍蝦明天多寫幾個人。

還有更絕的。

到了下班點,你不走?

小龍蝦會通過攝像頭看誰還在。

然後一直催。

催到你走為止。

這個東西簡直就是打擊萬惡資本家的利器。

我佛了。

一個小龍蝦,真的能被他們玩出花來。

至於實現這個功能也挺簡單的,我們的小龍蝦被部署在了一個單獨的Mac上,保證不涉及到我們員工工作電腦的數據安全,然後這個小龍蝦背後接的是公司的Claude Opus 4.6的API Key。

再放在了飛書裏,大家就都可以跟這個飛書上的小龍蝦進行互動或者處理一些日常任務。

當然,大活還是會上Claude Code或者Codex的。

做這個觀察系統,我看了一下他們的Prompt,也特別簡單,就直接吧攝像頭用USB接入以後,用人話寫了一段話,發給了小龍蝦。

然後它就開始開發並檢測了攝像頭和拍照功能,測試以後沒問題,又看了下這個需求,說,還需要生圖模型、飛書羣的Chat ID以及生圖模型的API Key。

然後就直接把它需要的東西提供給它就行。

這裏內容組的小夥伴用的是火山的豆包 Seed 2和Seedream-5.0模型。

因為我們幾乎所有服務都在火山和飛書上,所以他們就直接用了。

然後他們就把Key粘貼了過來,直接飛書裏發給了小龍蝦。

至於飛書羣的Chat ID,直接在羣裏問它就能拿到。

東西都給到之後,小龍蝦就按照之前描述的開發設想,自己開始幹了,大概四五分鐘就開發好了。

小龍蝦會自己去測試視覺語言模型、生圖模型,看看是否能跑通。

然後它自己還會去羣裏測試連通性。

到這裏,開發過程就結束了。

對的,你沒看錯。

當然剩下還有一些我們的小夥伴在實際運行中會有一些BUG,也直接對話給小龍蝦,直接修就可以了。

比如發送的梗圖他們發現沒有發圖,而是發了一堆連結。

跟小龍蝦描述一下問題是什麼,一兩分鐘它自己就修好了。

在比如說輸出了圖鑑,但不知道哪個工位是誰。

就像這樣:左上角的是哪個工位,是哪個人,右下角的是哪個工位,是哪個人。

然後它就可以正確知道每個區域對應的成員了。

等等等等,非常簡單。

說實話,小龍蝦這個產品,確實把整個的Agent體驗門檻,給拉的非常低,人人都可以玩一手。

真的,他們現在每天看小龍蝦在羣裏的人類觀察反饋,看的還挺開心的。

雖然我看不到,他們拒絕我加入羣聊,但是我也還是挺開心的。

真不是因為這個項目展示的技術多牛逼。

說實話,整個東西就是對話式開發,跟小龍蝦聊幾輪就做出來了。

我開心的其實是,內容組小夥伴們搞這個的動機。

他們說,每天被OpenClaw觀察一下,感覺普普通通的一天也變得有點特別了。

他們說,平時大家都低着頭忙自己的事,其實很少會注意到旁邊的人今天狀態怎麼樣,有沒有偷偷打了個哈欠,有沒有對着屏幕突然笑了一下。

當我出差了好幾天,回來發現,沒有人安排他們做這件事。

沒有立項,沒有排期,沒有OKR。

就是幾個人覺得好玩,自己鼓搗出來的。

你看,AI最好的應用場景,可能從來就不是什麼宏大的敍事。

就是讓普通的一天,變得沒那麼普通。

讓一羣有趣的人,能開開心心的,在下班前能笑一下。

真的,這就夠了。

以上,既然看到這裏了,如果覺得不錯,隨手點個贊、在看、轉發三連吧,如果想第一時間收到推送,也可以給我個星標⭐~謝謝你看我的文章,我們,下次再見。

>/ 作者:卡茲克、林機夢逗

>/ 投稿或爆料,請聯繫郵箱:wzglyay@virxact.com