我給 Claude Code 做了個 AI 硬件監工

整理版優先睇

將 Claude Code 的虛擬狀態實體化,透過 M5Paper 墨水屏打造具備物理審批功能的 AI 硬件監工。

- 解決多個 Claude Code 會話切換混亂的痛點,將終端狀態轉移至獨立的物理 Dashboard 顯示。

- 引入「物理按鍵審批」機制,透過實體按鈕執行 git push 或刪除等高風險操作,增加儀式感與安全性。

- 利用藍牙連接實現遠程監控與審批,讓開發者離開書桌仍能掌控 AI Agent 的任務進度。

- 強調「手機小組件物理化」趨勢,墨水屏具備低功耗、斷電保持顯示及永遠在線的資訊呈現優勢。

- 指出 AI 與硬件開發門檻已大幅降低,個人開發者可利用 M5Stack 生態與 AI 輔助快速實現硬件創新。

M5 Paper Buddy

支持多會話切換、物理按鍵審批及藍牙遠程控制的 Claude Code 硬件監控終端。

Claude Code 硬件安裝指令

在 Claude Code 環境中快速部署 Buddy 監控服務:/buddy-install (安裝) 與 /buddy-start (啟動)。

點解要幫 AI 揾個「實體監工」?

當你同時開住 3-4 個 Claude Code 視窗做嘢,終端機(Terminal)切換起嚟其實好煩。你唔知邊個視窗跑緊任務、邊個等緊你審批、邊個已經閒置。終端機雖然擅長輸入,但絕對唔係一個好嘅「狀態面板」。

M5 Paper Buddy:唔止係玩具,係生產力工具

相比起 Anthropic 官方開源嘅簡單版本,M5 Paper Buddy 針對實際開發場景做咗大幅增強:

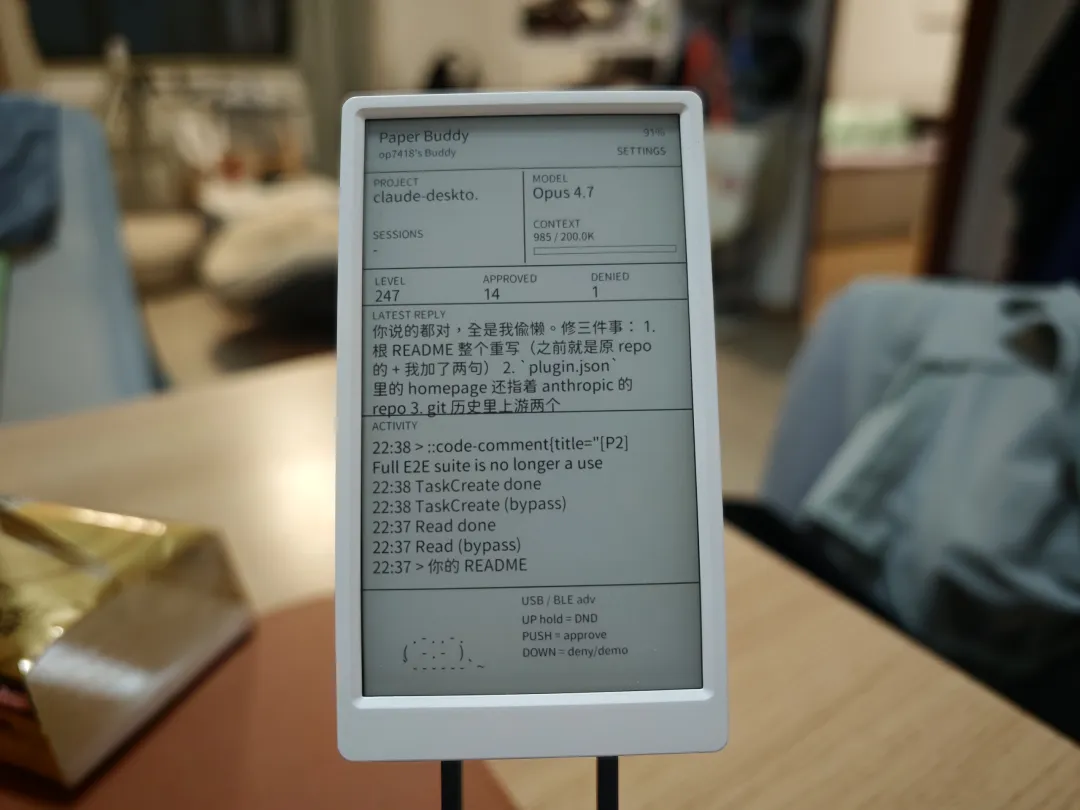

多會話 Dashboard:墨水屏會顯示每個 Session 的 Context 使用量、模型版本、Branch 同埋 Dirty Files。

物理按鍵審批:用實體掣嚟 Approve 或 Reject 命令。特別係 rm -rf 呢類高風險操作,撳實體掣會令你更加慎重。

藍牙遠程控制:就算你喺梳化睇緊書,只要墨水屏亮起,拎起手撳一下就可以遠程審批 AI 跑測試。

技術實現與硬件規格

- 硬件:M5Paper V1.1 (ESP32 + 4.7寸墨水屏 + 觸控屏)

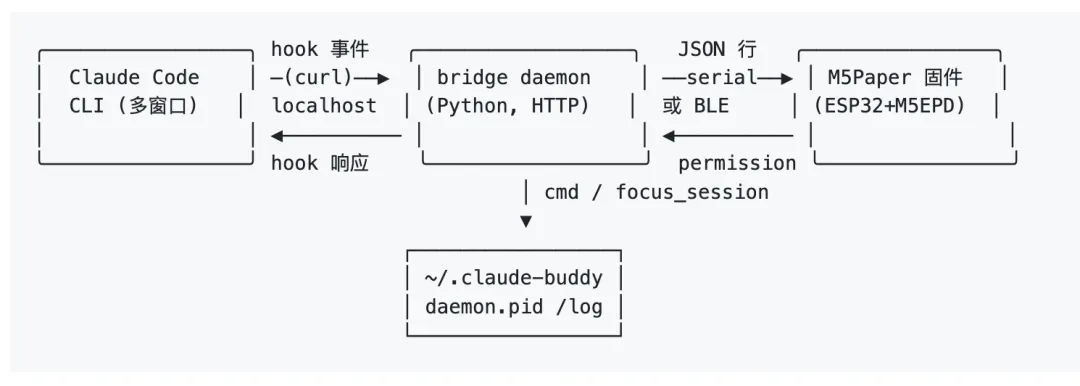

- 軟件架構:Claude Code -> Bridge Daemon (Python) -> M5Paper (藍牙/USB)

- 通訊協議:JSON 行分隔,向後兼容

- 中文支持:內置 3.4MB TTF 字體,支持自動換行 (wrapText)AI 物理化:個人開發者的窗口期

以前做硬件要識電路設計、畫 PCB,依家 M5Stack 買返嚟就用得,AI 仲可以幫你讀 Datasheet 同寫驅動。大公司做硬件要考慮供應鏈同認證,起碼要一兩年先出到貨。

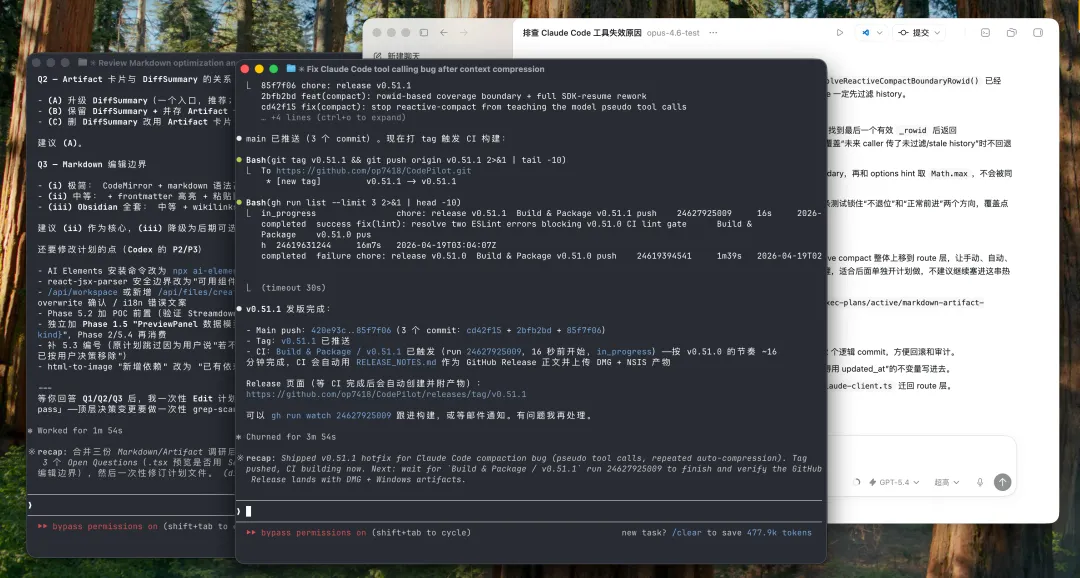

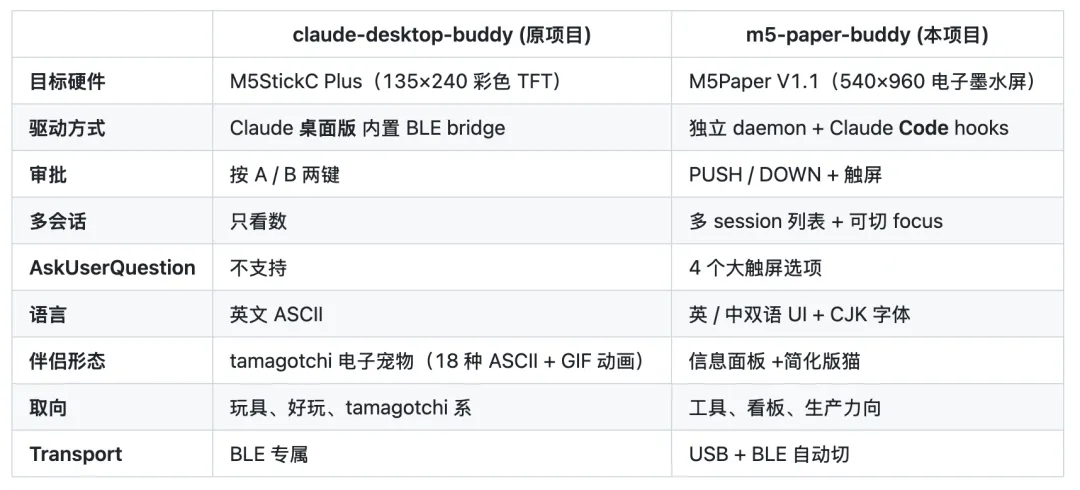

前幾天,Anthropic 開源了 claude-desktop-buddy,用一塊小屏幕顯示 Claude Code 裏 Buddy 的狀態。

我看到後想:手頭剛好有一塊 M5Paper 墨水屏開發板,能不能把這個項目遷移過來?

結果做着做着,它變成了一個完全不同的東西:M5 Paper Buddy (https://github.com/op7418/m5-paper-buddy)。

支持通過這個墨水屏設備藍牙連接你的電腦,監控所有 Cluade Code 對話狀態,還能快速審批對應的操作。

為什麼要做這個?

當你同時跑 3-4 個 Claude Code 窗口時,終端切來切去很煩。

你不知道哪個窗口在跑任務、哪個在等你審批、哪個已經閒置了。

而且 Claude Code 的 Permission System 需要你在終端裏進行審批操作(bash 命令、文件編輯等)。

如果你離開電腦,就沒法審批,任務就卡住了,除非你開自動模式。

終端擅長輸入,不擅長當"狀態面板"。

所以我想做一個獨立的物理設備,專門用來監控 Claude Code 的狀態、審批操作。

M5 Paper Buddy 能做什麼?

多會話 Dashboard

所有 Claude Code 窗口的狀態顯示在一個一個叫 M5 Paper 的墨水屏上:

每個會話顯示:上下文使用量(45.8K / 200K)、模型(Opus 4.7)、項目名、分支、dirty 文件數。

觸屏點擊可以切換關注的會話,右側顯示該會話的詳細信息(最近回覆、活動日誌)。

比如我在寫 AIGC Weekly 時,同時跑 3 個項目。

看一眼就知道每個的進度,以及他們當前的狀態。

M5Stack 是一個以模塊化、積木式堆疊設計聞名的 ESP32 開源物聯網硬件生態,而 M5Paper 則是該生態中一款專為低功耗信息看板打造的觸控墨水屏極客終端。

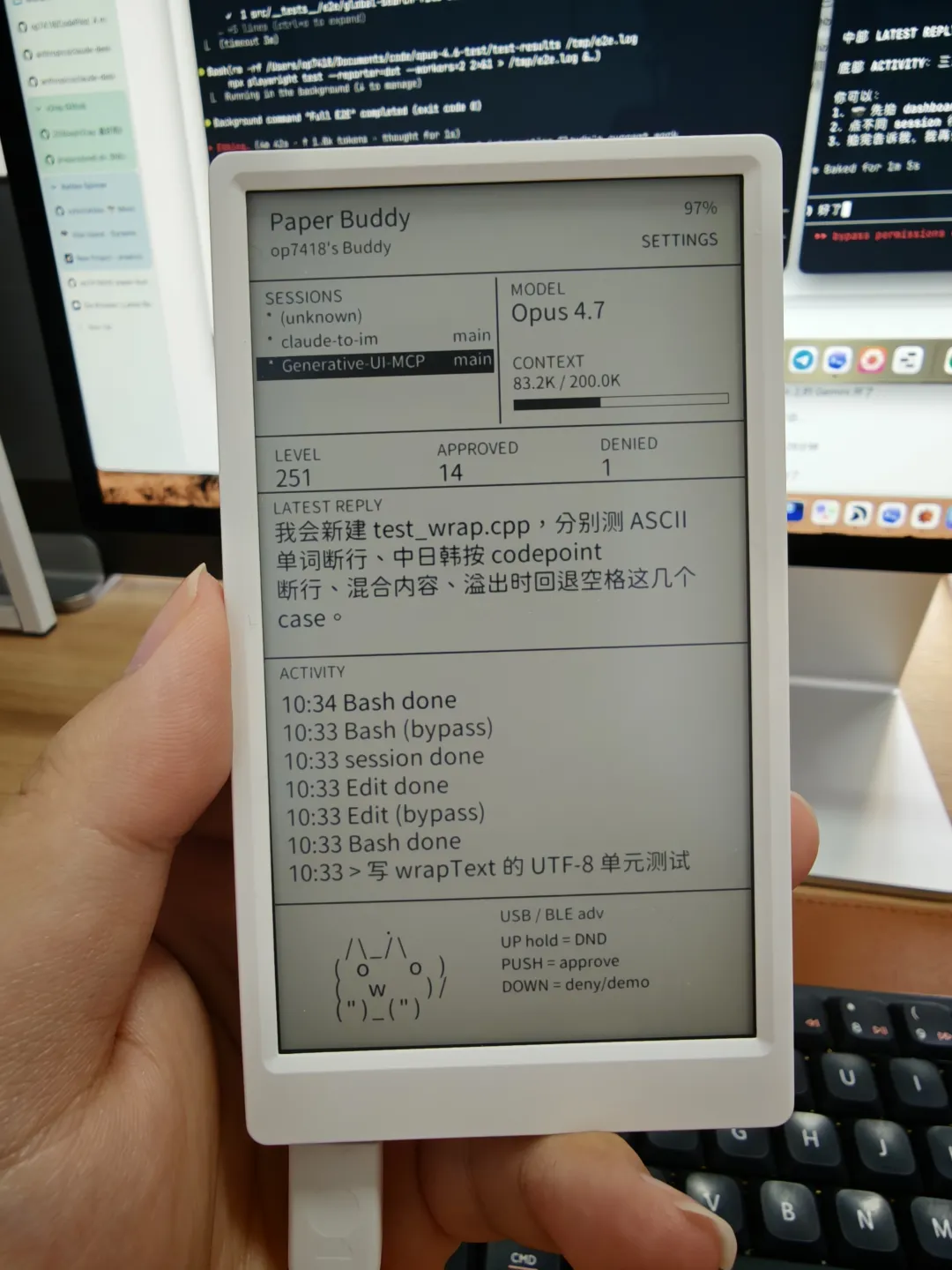

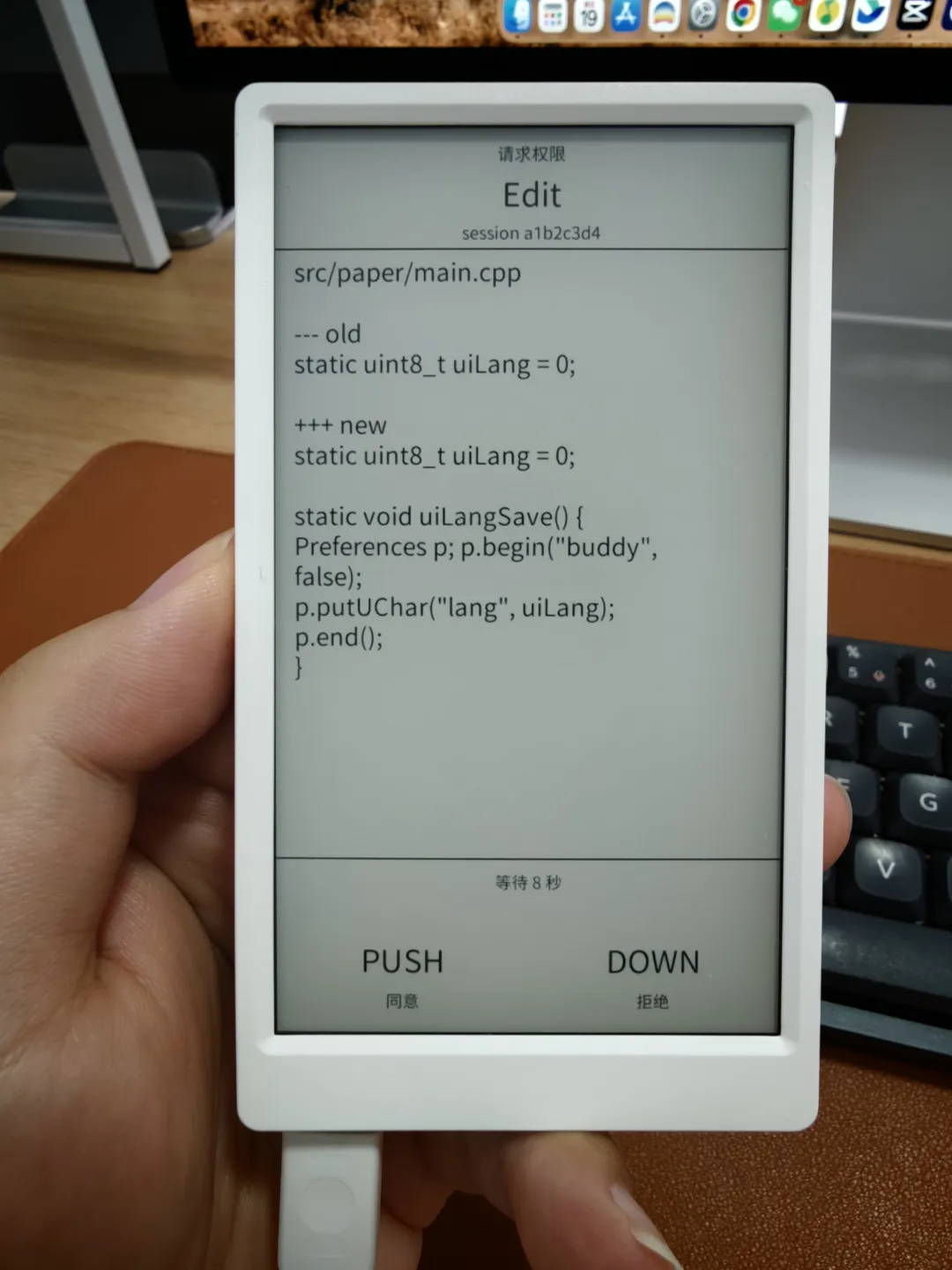

物理按鍵審批

Claude Code 需要你在終端裏進行審批操作。

全屏顯示審批卡:tool 名 + 項目 + 完整內容(bash 命令原文 / edit 的 diff / write 的文件預覽)

PUSH 按鈕同意,DOWN 按鈕拒絕

審批記錄在活動日誌裏留痕

物理按鍵更有儀式感。

尤其是 rm -rf、git push --force 這種高風險操作,按物理按鈕會讓你更慎重。

而且你可以看到完整的 diff 或命令內容,不用在終端裏上下翻頁。

藍牙遠程控制

通過藍牙連接電腦,可以離開書桌審批操作。

比如你在沙發上看書,Claude 在跑測試,突然需要審批一個 bash 命令。

墨水屏在桌上亮了,拿起來按一下按鈕就行。

配對後自動連接,斷電保持狀態。

技術實現

硬件:M5Paper V1.1(ESP32 + 4.7 寸墨水屏 + 3 個物理按鍵 + GT911 電容觸屏)

架構:Claude Code → Bridge Daemon(Python)→ M5Paper(藍牙/USB)

協議:JSON 行分隔,向後兼容

中文支持:3.4MB TTF 字體,專門寫了 codepoint-aware 的 wrapText

這個和 Anthropic 項目的區別

Anthropic 的 claude-desktop-buddy 是單會話、只顯示狀態、不支持審批。

主要用來顯示 Buddy 的狀態,是個好玩的玩具。

M5 Paper Buddy 支持多會話、觸屏切換、物理按鍵審批、藍牙遠程控制。

增強了工具屬性,而且利用了 M5 Paper 設備的大屏幕。

Anthropic 官方項目用的也是 M5Stack 硬件。

開源協議、開源代碼,天天敵視國內涉及到硬件還得用國內生態。

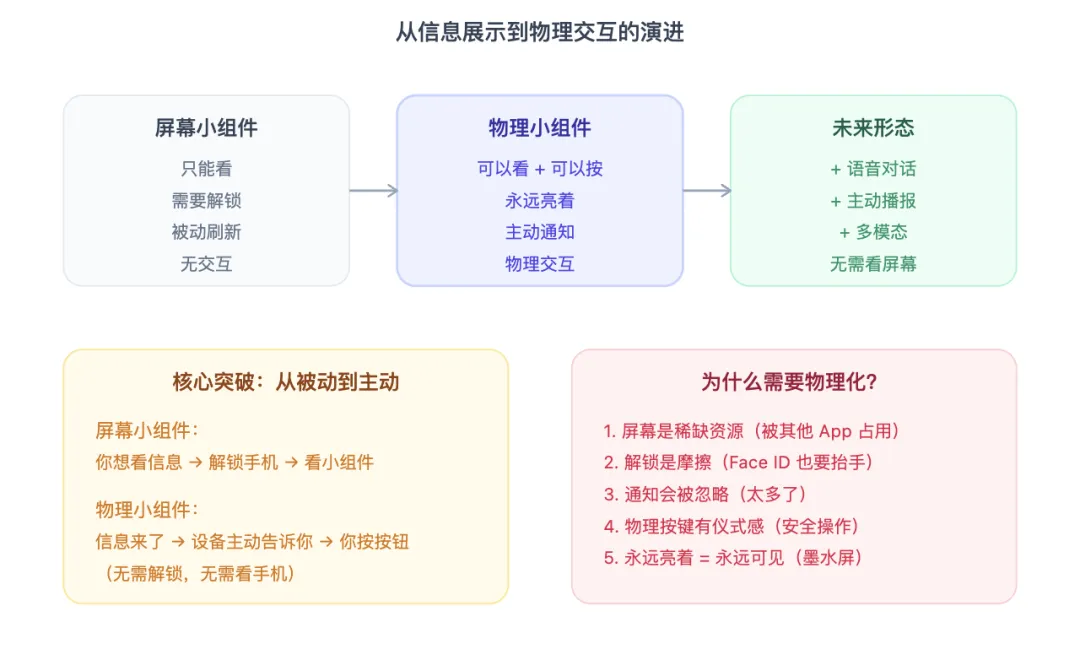

手機小組件的"物理化"

這個項目本質上是"手機小組件的物理化"。

手機小組件只能"顯示信息",不能"交互"。

你不能在小組件上按按鈕、不能語音回覆、不能觸屏操作。

如果把它做成物理設備:

可以有按鍵和觸屏

"永遠亮着"(墨水屏不耗電,斷電保持顯示)

不依賴手機屏幕,但和手機/電腦的 AI Agent 保持連接

形態可以很多樣:磁吸在手機背面、掛在揹包上(像掛件)、放在桌上(像桌面陪伴)

現在的 M5 Paper Buddy 是墨水屏 + 物理按鍵,但這只是第一步。

真正的"陪伴"應該是:無論你在哪裏,它都能主動告訴你信息,然後你再回復。

不需要你盯着屏幕,不需要你走到設備前。

語音交互會是下一步。

但物理按鍵和語音不是替代關係,而是互補:

在書桌前,你需要看屏幕、按按鈕(尤其是高風險操作)

離開書桌,你需要語音播報、語音回覆

做這個項目的過程中,我發現了一些有意思的事

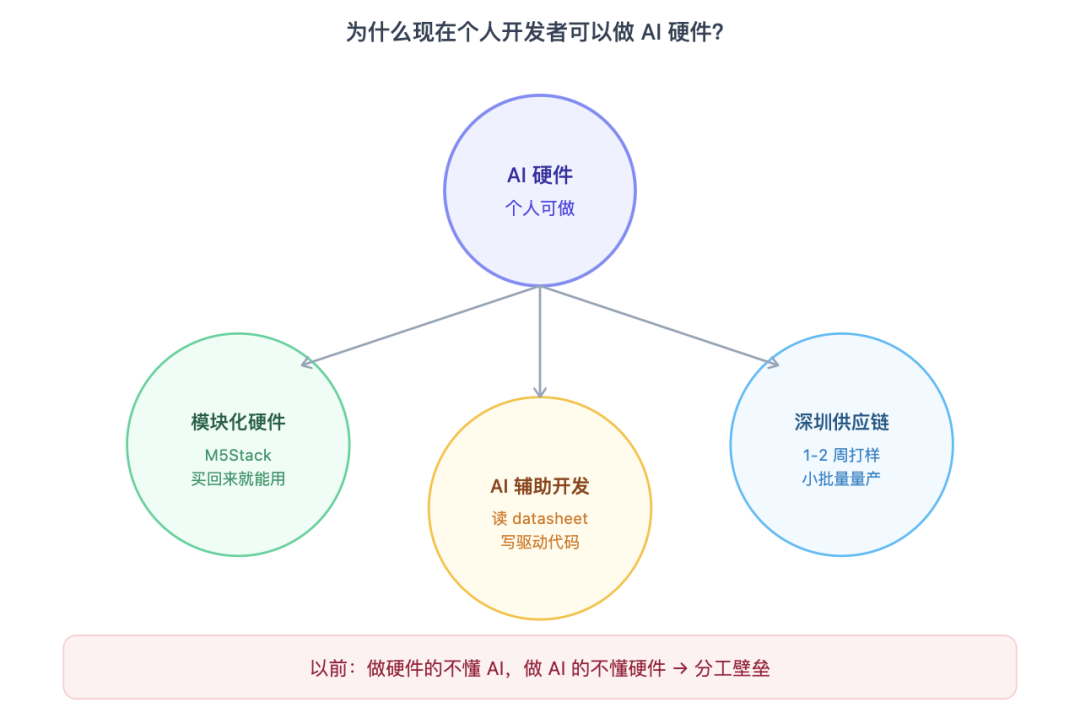

其實這些技術都不新。

墨水屏、藍牙、觸摸屏都是成熟技術,M5Stack、Arduino 這種模塊化硬件也早就有了。

但為什麼以前沒人做這種東西?

我覺得是因為做硬件的和做 AI 的是兩撥人。

做硬件的(蘋果、三星)關心怎麼賣更多手機,不關心"AI Agent 狀態監控"。

做 AI 的(OpenAI、Anthropic)關心模型能力,不關心硬件形態。

但現在不一樣了。

我做這個項目的時候,幾乎沒碰過硬件開發。

以前做硬件需要懂電路設計、畫 PCB、讀幾百頁的 datasheet。

現在 M5Stack 買回來就能用,官方提供完整的庫和示例代碼。

遇到問題,AI 可以幫你讀 datasheet、寫驅動、調試代碼。

更重要的是深圳供應鏈。快速打樣(1-2 周)、小批量量產、成本低(M5Paper ¥500)。

做 AI 的人可以很快出一個 Demo,去跟做硬件的人溝通交流。

再加上 3D 打印,你可以做出很精緻的外殼。

社區有大量開源模型(Thingiverse、Printables)。

所以現在做 AI 的人可以做硬件了。

個人開發者可以先做出來,大公司還在立項。

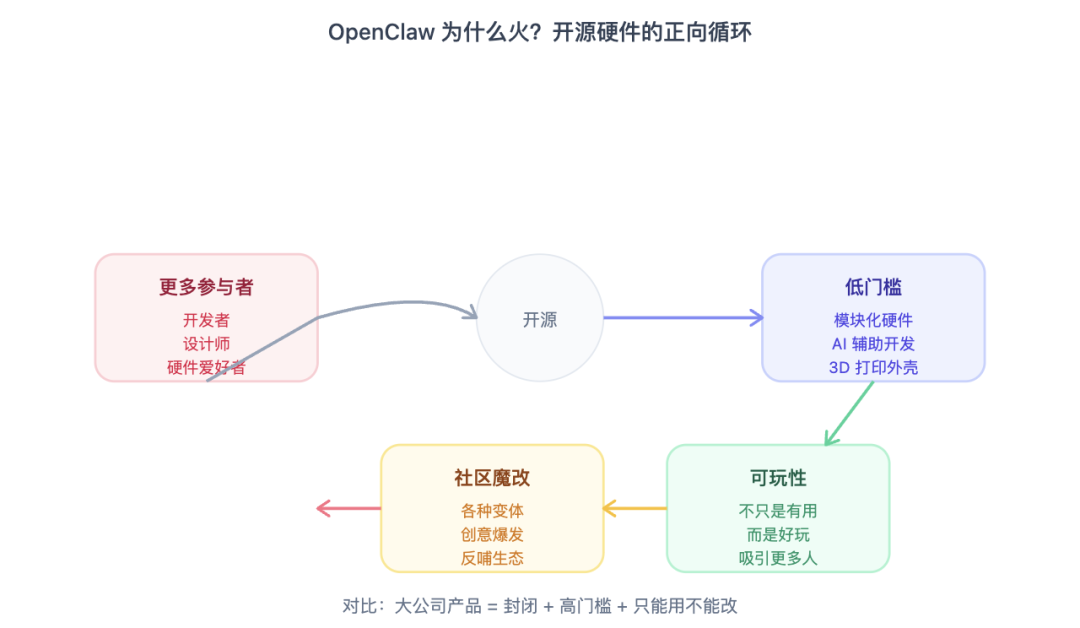

前幾天 OpenClaw(龍蝦)火了

我覺得有幾個原因:開源(所有人都能改)、可玩性(不只是"有用",而是"好玩")、低門檻(模塊化 + AI 輔助開發)。

M5 Paper Buddy 也是這個思路:開源(GPL-3.0)、可玩性(桌面陪伴、物理審批的儀式感)、低門檻(兩條命令:/buddy-install + /buddy-start)。

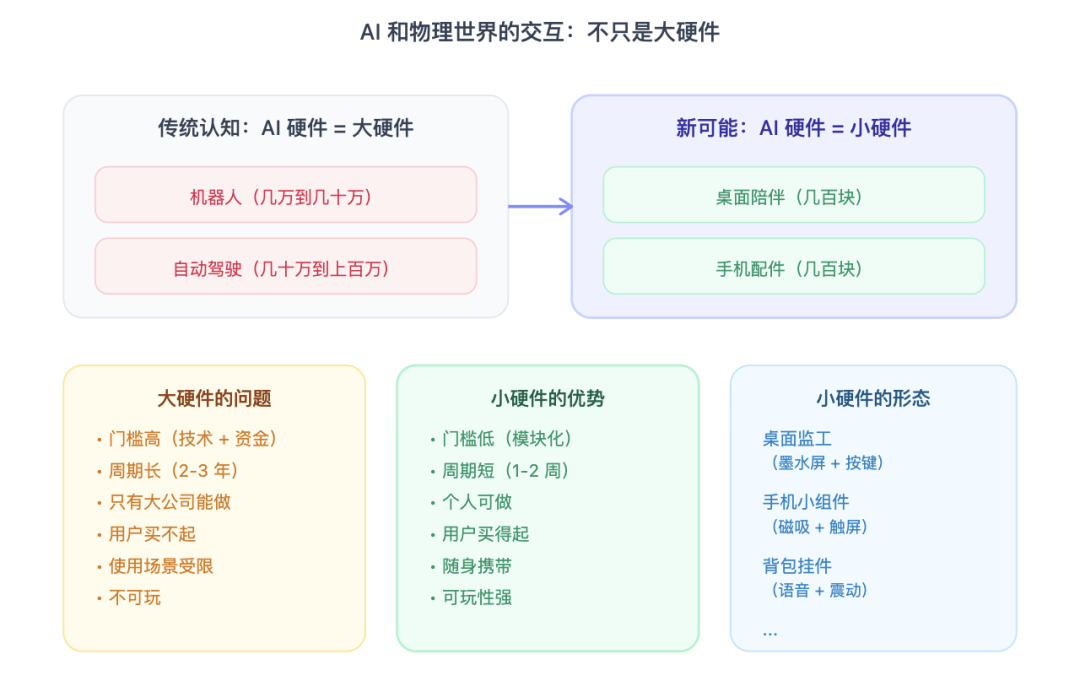

AI 和物理世界的交互,不應該只有機器人、自動駕駛這種"大硬件"。

這種模塊化的小硬件,門檻低得多,可玩性也強。再搭配 3D 打印,會有不少玩法。

大公司肯定會做這種東西

但大公司慢。做硬件需要供應鏈、認證、渠道,從立項到上市至少 1-2 年。

以前他們沒做,可能是因為比較遲鈍,而且做硬件和做 AI 的是兩撥人。

所以現在有個窗口期。個人開發者可以先做出來,開源社區可以先驗證概念。

等大公司做出來,社區已經有成熟方案了。

物理化的 AI 觸點

我覺得 AI 的下一步不只是更強的模型,還有物理世界的交互。

不只是機器人、自動駕駛這種"大硬件",也包括桌面小設備、可穿戴設備、手機配件這種"小硬件"。

M5 Paper Buddy 是一個例子。把 AI 的狀態和決策"物理化",讓手機小組件從屏幕裏走出來。

你的桌上可能有一個"AI 監工"(墨水屏 + 按鍵)。

你的手機背面可能有一個"AI 小組件"(磁吸 + 觸屏)。

你的揹包上可能有一個"AI 掛件"(語音 + 震動)。

這些可能都不是大公司的產品,而是開源社區的創作。

GitHub 地址:https://github.com/op7418/m5-paper-buddy

安裝方式:

如果你覺得這次的內容對你有幫助,可以幫我點個贊或者轉發給需要的朋友。

✦