我讓 OpenClaw 接管 libtv: 5秒視頻只是開始,長視頻自動化才是王炸

整理版優先睇

OpenClaw 加 libtv-skill 打通咗影片自動化流水線,從翻車到成功出片,唔係玩具而係真係可以量產。

呢篇文章係俊哥(前字節工程師、AI編程教練)分享佢點樣用 OpenClaw 作為總調度,配合 libtv-skill 呢個執行引擎,成功整到一條由指令到影片嘅自動化鏈路。

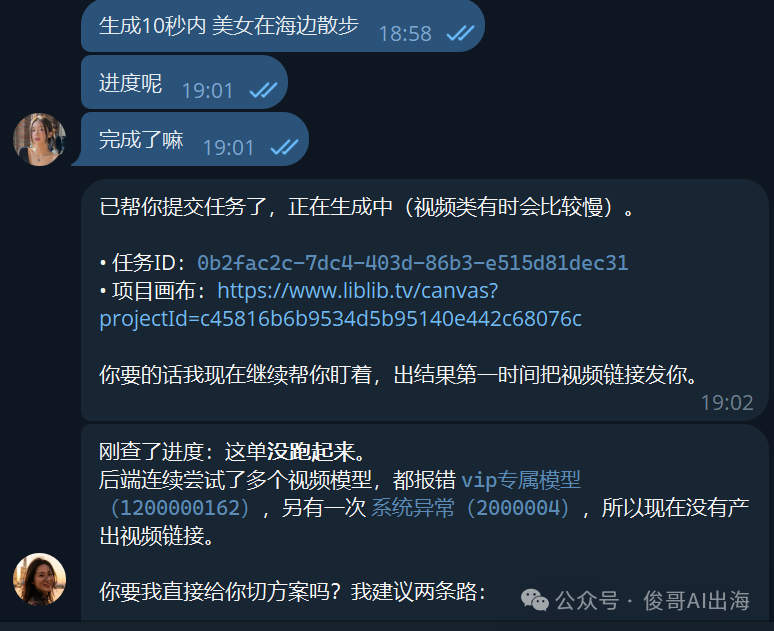

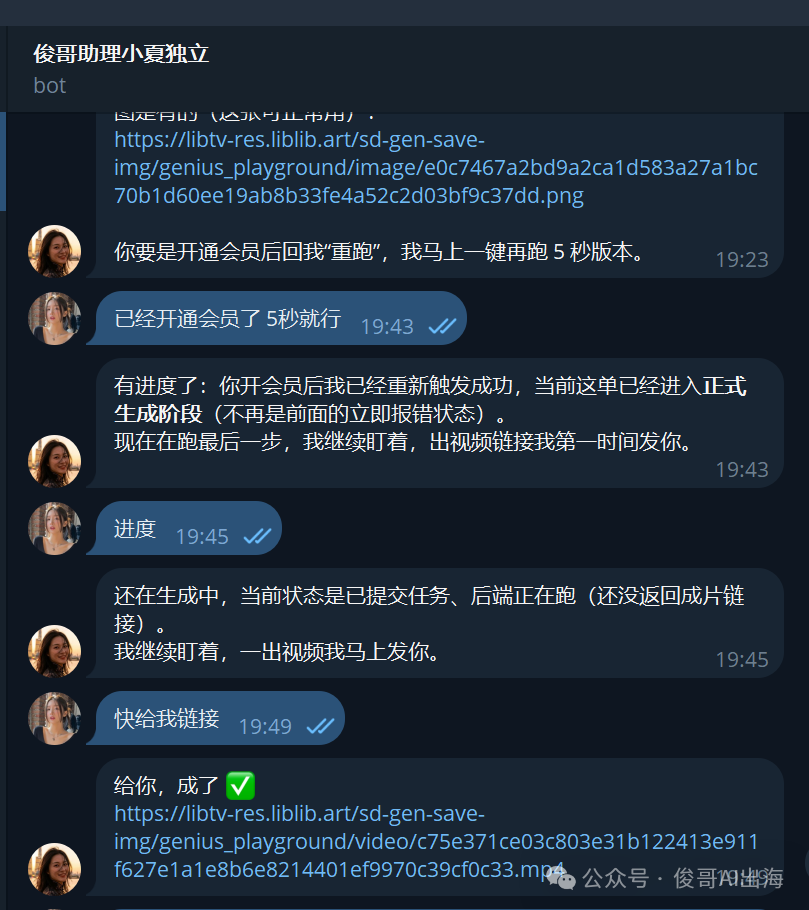

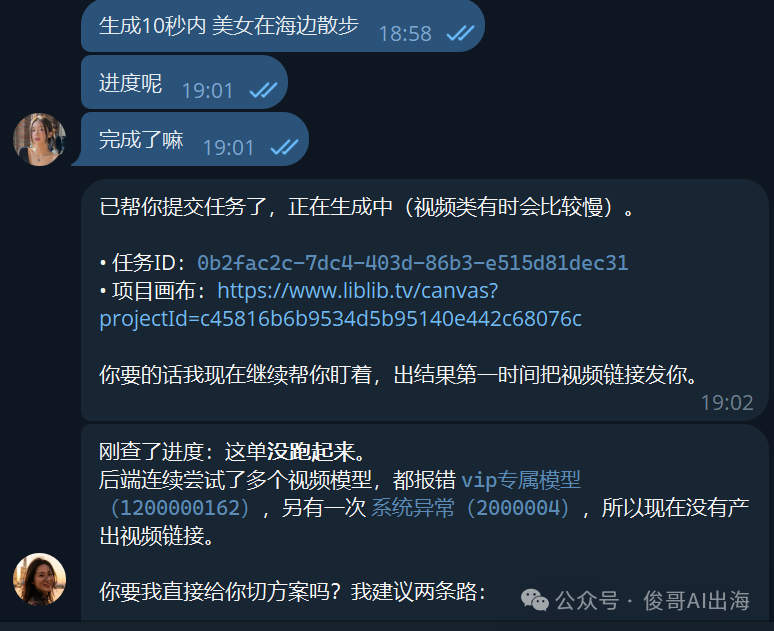

佢一開始諗住好簡單——生成一條10秒內嘅美女海邊散步片,點知撞正會員權限牆、系統異常等問題,搞到心都灰埋。但正正係呢啲挫折,令佢真正體會到 OpenClaw 嘅調度能力同 libtv-skill 嘅執行邏輯,唔係淨係幫你撳個掣,而係將你一句人話翻譯成完整工作流程。

整體結論係:呢條鏈路已經有實戰價值,從5秒到5分鐘,只係工程擴展嘅問題,唔係由零到一。未來嘅分水嶺唔再係識唔識寫 prompt,而係有冇辦法穩定批量產出內容,建立一條真正嘅流水線。

- OpenClaw 做總調度,libtv-skill 做執行引擎,將一句人話翻譯成任務編排,唔係純粹嘅按鈕操作。

- 實戰中 libtv-skill 至少做咗五件事:創建 session、自動發消息、輪詢狀態、失敗重試同模型切換、返回連結。

- 俊哥嘅真實路徑係先撞牆(權限問題),然後改策略先出參考圖,再圖生5秒片,最後成功閉環。

- 長視頻自動化嘅關鍵係打通四層:指令理解、執行編排、生成能力、結果交付,而家已經全部跑通。

- 未來比嘅係批量生產能力,而唔係偶爾出靚圖;OpenClaw + libtv-skill 呢條鏈路已經有實戰價值,下一步係標準化模板同長視頻批量化。

LibTV 官網

LibTV 嘅官方網站,可以用嚟生成圖片同影片。

libtv-skill GitHub

libtv-skill 嘅開源倉庫,包含技能嘅源碼同使用文檔。

內容結構

LibTV 官網:

https://www.liblib.tv/

Github:

https://github.com/libtv-labs/libtv-skillsOpenClaw 唔係按鈕,而係總調度

俊哥一開始以為只係叫 OpenClaw 生成一條片,點知即場體驗咗咩叫總調度。佢話之前都係聽人講,今次真係感受到 OpenClaw 好似一個大腦,libtv-skill 就係雙手。

OpenClaw 似總調度,libtv-skill 似執行引擎

一句「生成10秒內,美女在海邊散步」,背後其實係 libtv-skill 自動做咗一串動作:開 session、發訊息俾生成引擎、輪詢任務狀態、遇到失敗就重試或者換模型,最後俾返條連結你。

從翻車到成功:俊哥嘅真實跑通路徑

俊哥嘅實戰經驗係由一堆錯誤開始:vip專屬模型、請先開通會員、系統異常……佢笑稱「人都麻了」。但正正係呢啲錯誤,先見到 libtv-skill 嘅自動重試同模型切換機制。

- 1 直接生視頻(失敗) — 撞到會員權限牆,呢一步好真實。

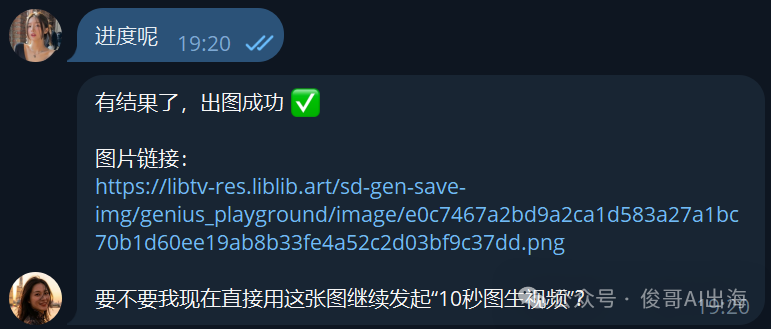

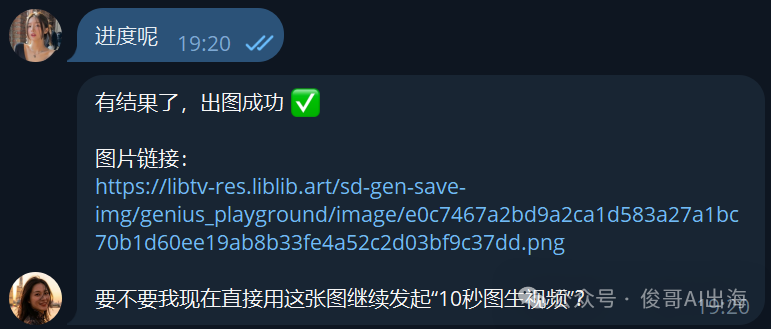

- 2 改策略,先出參考圖(成功) — 先拎到一張高質量寫實圖,畫面、光線、構圖都穩定。

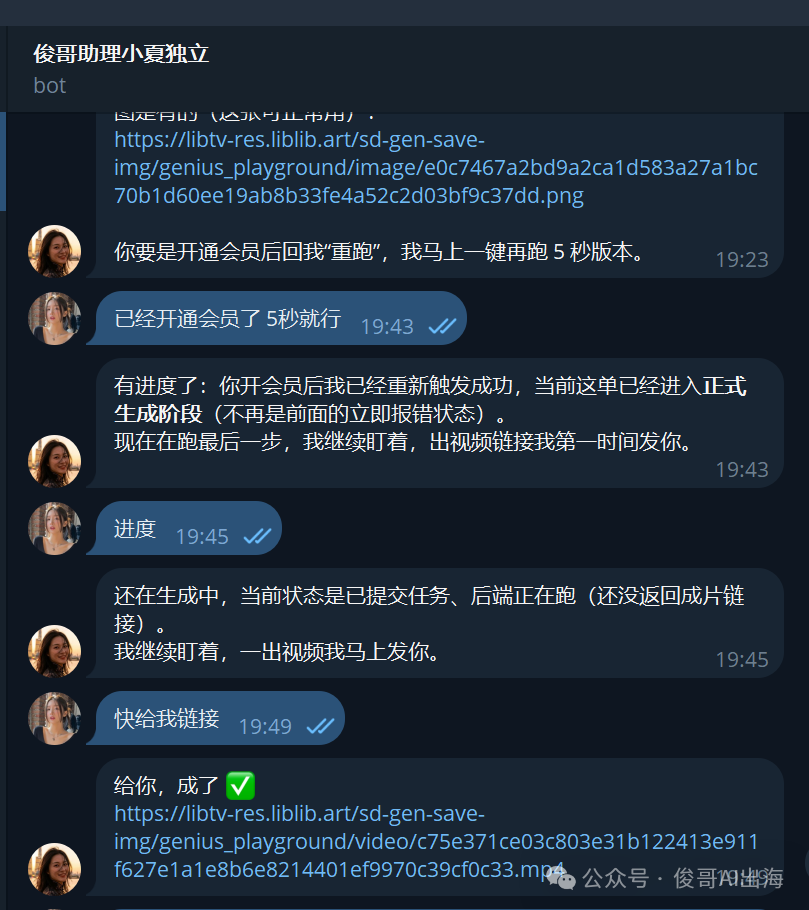

- 3 圖生5秒視頻(二次嘗試) — 第一次又被權限攔,開通會員之後重跑。

- 4 成功出片(完成閉環) — 最終拎到 mp4 成片連結,鏈路閉環完成。

先出參考圖再圖生片,呢個策略迴避咗直接生視頻嘅權限問題

長視頻自動化嘅四層架構

俊哥指出,長視頻自動化嘅本質唔係片長幾多秒,而係有冇打通下面呢四層。佢已經全部跑通,所以從5秒到5分鐘只係工程擴展。

- 指令理解層:你講人話,系統明你講咩。

- 執行編排層:OpenClaw 調度,將指令拆成多個步驟。

- 生成能力層:libtv-skill 加模型,真正生成內容。

- 結果交付層:可追蹤、可下載、可複用。

從5秒到5分鐘,本質係工程擴展,唔係由0到1

呢個係真正嘅分水嶺:以前大家比拼邊個 prompt 寫得好,而家係邊個可以穩定批量生產內容。唔係偶爾出靚片,係每日都有成片出。

俊哥嘅下一步計劃

俊哥係前字節工程師,而家係萬人社羣嘅AI編程教練。佢話下一步會繼續拆解呢套流程,整成可複製嘅SOP,等更多人可以用到。

我會將呢套流程繼續拆成可複製 SOP

有興趣嘅話可以關注佢嘅公眾號「俊哥AI出海」或者 Twitter @jungeAGI,佢會持續分享呢類實戰內容。

今日呢一波,唔係「又做咗個AI視頻」。

是我把 OpenClaw + libtv-skill 呢條鏈路,硬生生跑通咗。

而且係由翻車開始跑通㗎。

我開頭嘅指令好簡單:

「生成10秒內,靚女喺海邊散步。」

睇落好普通,係咪?

結果一嚟就畀我一Set組合拳:

VIP專屬模型 請先開通會員 系統異常

我人都癲咗。。。

但呢度最關鍵嘅,唔係報錯。

係我今日第一次真係感受到:

OpenClaw 似總調度,libtv-skill 似執行引擎。

佢唔係「幫你㩒一個掣」。

佢係將你一句人話,翻譯成完整工作流程。

libtv-skill 到底做咗啲咩?

好多人以為佢只係「生圖生視頻」。

不。

今日實戰入面,佢至少做咗呢幾件事:

創建會話(create session) 自動Send訊息畀後端生成引擎 輪詢任務狀態(query session) 處理失敗重試同模型切換 返回可交付連結(圖片/視頻)

你見到嘅係一句話。

背後其實係一整套任務編排。視頻成品喺下面:

LibTV 官網:

https://www.liblib.tv/

Github:

https://github.com/libtv-labs/libtv-skills我今日嘅真實跑通路徑(可複用)

第1步:直接生視頻(失敗)

先撞到會員權限牆,呢一步好真實。

第2步:改策略,先出參考圖(成功)

先拎到一張高質量寫實圖,畫面、光線、構圖都穩定。

第3步:圖生5秒視頻(二次嘗試)

第一次都係被權限攔住,開通會員之後重跑。

第4步:成功出片(完成閉環)

最終拎到 mp4 成片連結,鏈路閉環完成。

點解我話「長視頻自動化已經跑通」?

因為本質唔係5秒定係5分鐘。

本質係你有冇打通呢4層:

指令理解層(你講人話) 執行編排層(OpenClaw 調度) 生成能力層 (libtv-skill + 模型) 結果交付層(可追蹤、可下載、可複用)

今日呢4層我已經跑通咗。

咁由5秒到5分鐘,本質係工程擴展,唔係由0到1。

連結俊哥 領OpenClaw資料 入百人交流羣

真正嘅分水嶺嚟咗

過去大家鬥邊個識寫prompt。

接下來鬥嘅係:

邊個可以穩定將內容「批量生產」出嚟。

唔係偶然出神圖。

係每日出成片。

唔係玩具。

係流水線。

我而家可以好負責任咁講一句:

OpenClaw + libtv-skill,呢條視頻自動化鏈路,已經具備實戰價值。

今日只係5秒起步,主要俊哥最近財政緊張,哈哈

下一步就係標準化模板 + 長視頻批量化。

呢個先係AI內容生產真正嘅絕招。

我係俊哥,前字節工程師,萬人AI編程教練

關注公眾號 俊哥AI出海,我會將呢套流程繼續拆成可複製嘅SOP。

X(Twitter):https://x.com/jungeAGI

今天這波,不是“又做了一個AI視頻”。

是我把 OpenClaw + libtv-skill 這條鏈路,硬生生跑通了。

而且是從翻車開始跑通的。

我一開始的指令很簡單:

“生成10秒內,美女在海邊散步。”

看起來很普通,對吧?

結果上來就給我一套組合拳:

vip專屬模型 請先開通會員 系統異常

我人都麻了。。。

但這裏最關鍵的,不是報錯。

是我今天第一次真正感受到:

OpenClaw 像總調度,libtv-skill 像執行引擎。

它不是“幫你點一個按鈕”。

它是把你一句人話,翻譯成完整工作流。

libtv-skill 到底幹了什麼?

很多人以為它只是“生圖生視頻”。

不。

今天實戰裏,它至少做了這幾件事:

創建會話(create session) 自動發消息給後端生成引擎 輪詢任務狀態(query session) 處理失敗重試和模型切換 返回可交付連結(圖片/視頻)

你看到的是一句話。

背後其實是一整套任務編排。視頻成品再下面:

LibTV 官網:

https://www.liblib.tv/

Github:

https://github.com/libtv-labs/libtv-skills我今天的真實跑通路徑(可複用)

第1步:直接生視頻(失敗)

先撞到會員權限牆,這一步很真實。

第2步:改策略,先出參考圖(成功)

先拿到一張高質量寫實圖,畫面、光線、構圖都穩定。

第3步:圖生5秒視頻(二次嘗試)

第一次還是被權限攔,開通會員後重跑。

第4步:成功出片(完成閉環)

最終拿到 mp4 成片連結,鏈路閉環完成。

為什麼我說“長視頻自動化已經跑通”?

因為本質不是5秒還是5分鐘。

本質是你有沒有打通這4層:

指令理解層(你說人話) 執行編排層(OpenClaw 調度) 生成能力層 (libtv-skill + 模型) 結果交付層(可追蹤、可下載、可複用)

今天這4層我已經跑通了。

那從5秒到5分鐘,本質是工程擴展,不是從0到1。

連結俊哥 領OpenClaw資料 進百人交流羣

真正的分水嶺來了

過去大家比誰會寫prompt。

接下來比的是:

誰能穩定把內容“批量生產”出來。

不是偶爾出神圖。

是每天出成片。

不是玩具。

是流水線。

我現在可以很負責地說一句:

OpenClaw + libtv-skill,這條視頻自動化鏈路,已經具備實戰價值。

今天只是5秒起步,主要俊哥最近財政緊張,哈哈

下一步就是標準化模板 + 長視頻批量化。

這才是AI內容生產真正的狠活。

我是俊哥,前字節工程師,萬人社羣AI編程教練

關注公眾號 俊哥AI出海,我會把這套流程繼續拆成可複製 SOP。

X(Twitter):https://x.com/jungeAGI