拒絕算法投餵,我用 Openclaw+Notion 搭了一套 YouTube自動化信息流

整理版優先睇

用 OpenClaw + Notion 自主搭建 YouTube 資訊流,擺脱算法投餵

呢篇文章係由博主艾康分享嘅實戰經驗。佢一直困擾於 YouTube 訂閲咗幾十個頻道,但算法推薦經常令佢錯過更新,無法集中掌握所有關注內容嘅最新動態。為咗將資訊獲取主動權攞返自己手,佢用 OpenClaw(小龍蝦)配合 Notion 搭建咗一套自動化工作流,每日定時從指定 YouTube 頻道抓取最新影片,提取摘要並寫入 Notion 數據庫,從此只需打開 Notion 一個地方就睇曬所有更新,完全唔使開 YouTube 或者被算法幹擾。

文章首先指出演算法推薦嘅問題:表面上係自己選擇,實際上係被動投餵,令資訊質量難以控制,跟住計算機領域嘅 GIGO 原則(垃圾入垃圾出)提醒讀者資訊輸入對認知嘅深遠影響。然後佢解釋點解直接用 OpenClaw 做每日 AI 簡報效果唔好——關鍵在於資訊來源唔可靠,而 YouTube 上經過自己篩選嘅優質頻道係一個好來源。

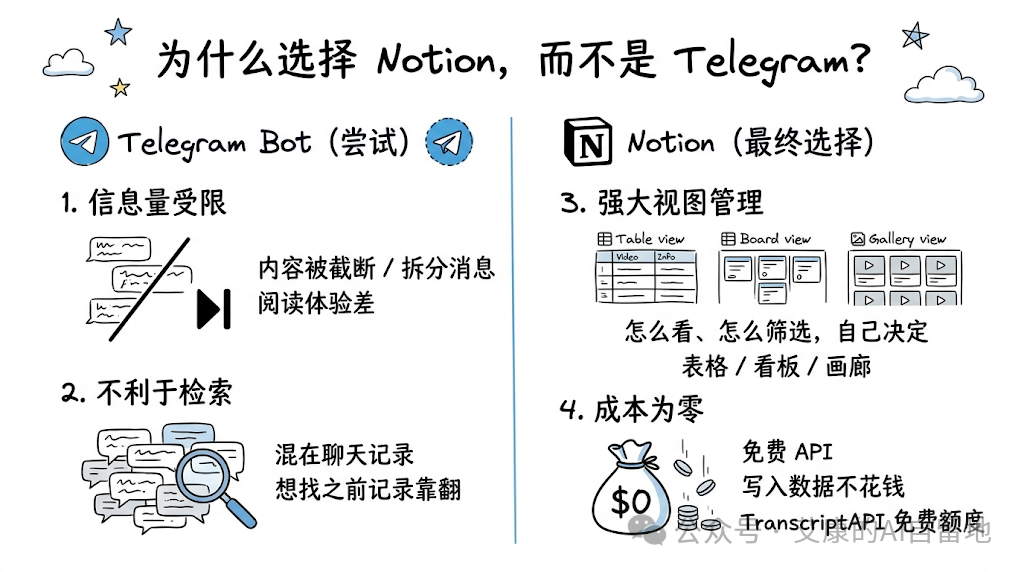

最後佢詳細說明工作流嘅四個步驟:安裝 YouTube Skill、註冊 TranscriptAPI 並綁定、設置定時任務、自動寫入 Notion。佢仲解釋咗點解揀 Notion 而唔係 Telegram,因為 Notion 嘅視圖管理更強、檢索更方便,而且成本為零。整體結論係:主動管理資訊入口,提高輸入質量,係值得認真對待嘅事。

- YouTube 訂閲頻道更新容易被算法淹沒,主動匯總到一個地方係解決辦法。

- 用 OpenClaw + Notion 自動化工作流,每日定時抓取指定頻道影片摘要。

- 先安裝 ClawHub 上嘅 YouTube Skill,再註冊 TranscriptAPI 攞 API Key。

- 設定 OpenClaw 定時任務(如每天早上7點),結果自動寫入 Notion 數據庫。

- Notion 嘅表格/看板/畫廊視圖比 Telegram 更適合檢索同管理資訊。

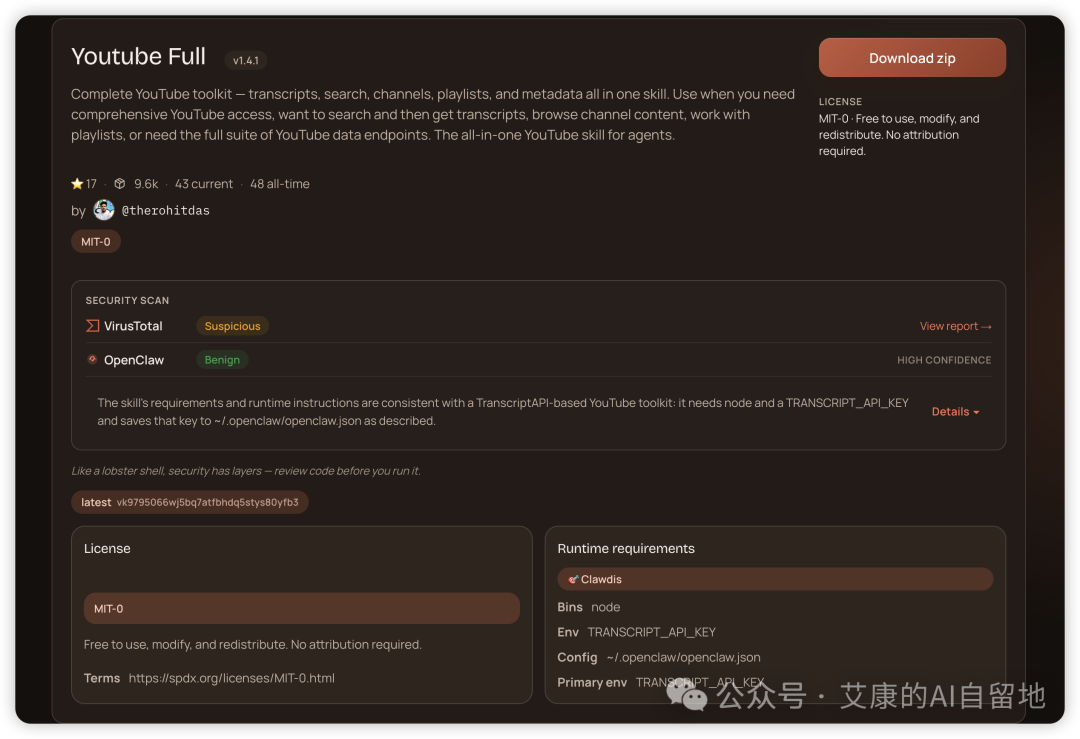

YouTube Full Skill

用嚟從指定 YouTube 頻道獲取最新影片並提取字幕摘要。

TranscriptAPI

提供 YouTube 影片轉錄文本嘅 API,免費額度100次,查詢頻道列表免費。

Notion API

免費嘅 Notion API,用嚟自動寫入數據,唔使額外成本。

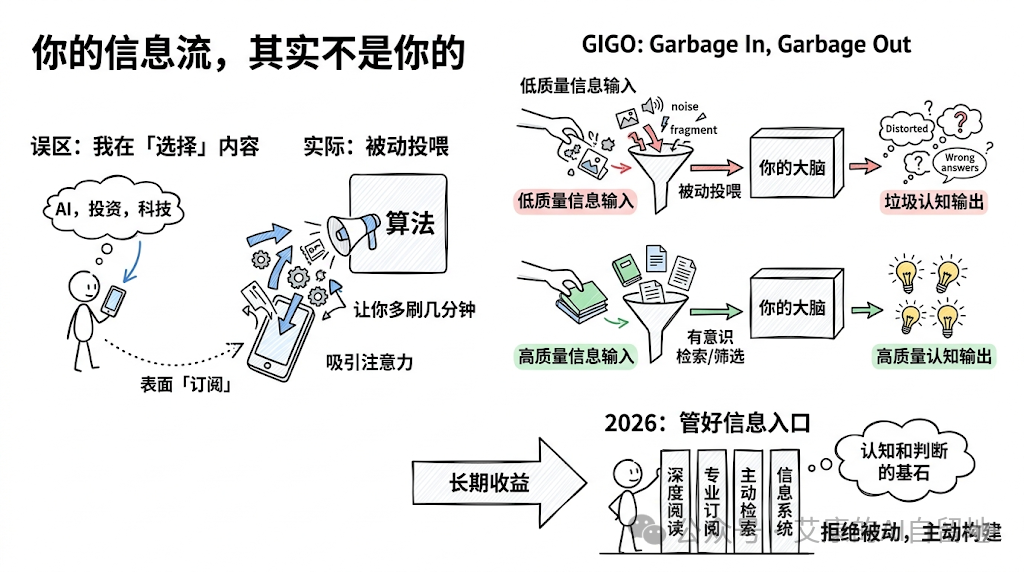

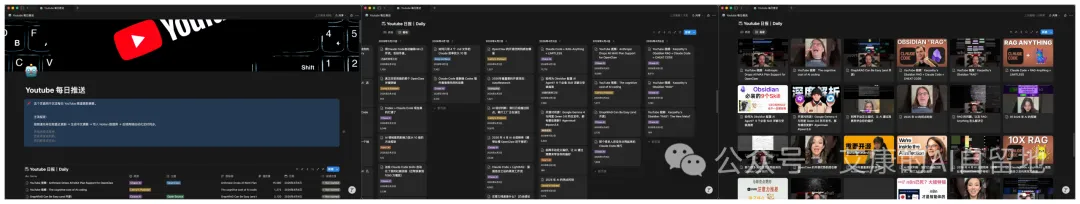

你嘅資訊流,其實唔係你嘅

每日打開手機,刷到嘅內容表面係自己揀,實際上大部分係算法幫你揀。算法嘅目標好簡單:令你停留更耐。佢唔關心你訂閲咗邊個,只關心咩內容令你多刷幾分鐘。

你以為自己主動獲取信息,其實一直係被動投餵

計算機領域有條經典原則叫 GIGO(Garbage In, Garbage Out),放喺日常資訊攝入上一樣成立。每日輸入咩質量嘅資訊,最終輸出咩質量嘅認知同判斷。所以有意識噉提高資訊入口質量,長期收益好大。

點解直接用 OpenClaw 做 AI 簡報效果唔好?

好多人用 OpenClaw 獲取每日 AI 簡報,但出來嘅內容良莠不齊,睇落有道理但經唔起細睇。問題唔喺 OpenClaw 本身,而係資訊來源——如果冇指定高質量資訊源,佢只能從全網亂抓。

第一步唔係研究提示詞,而係畀佢一個靠譜嘅資訊源

YouTube 長視頻資訊密度高,而且自己長期關注嘅優質頻道已經幫你過濾咗一輪。所以 OpenClaw + YouTube 係好組合。

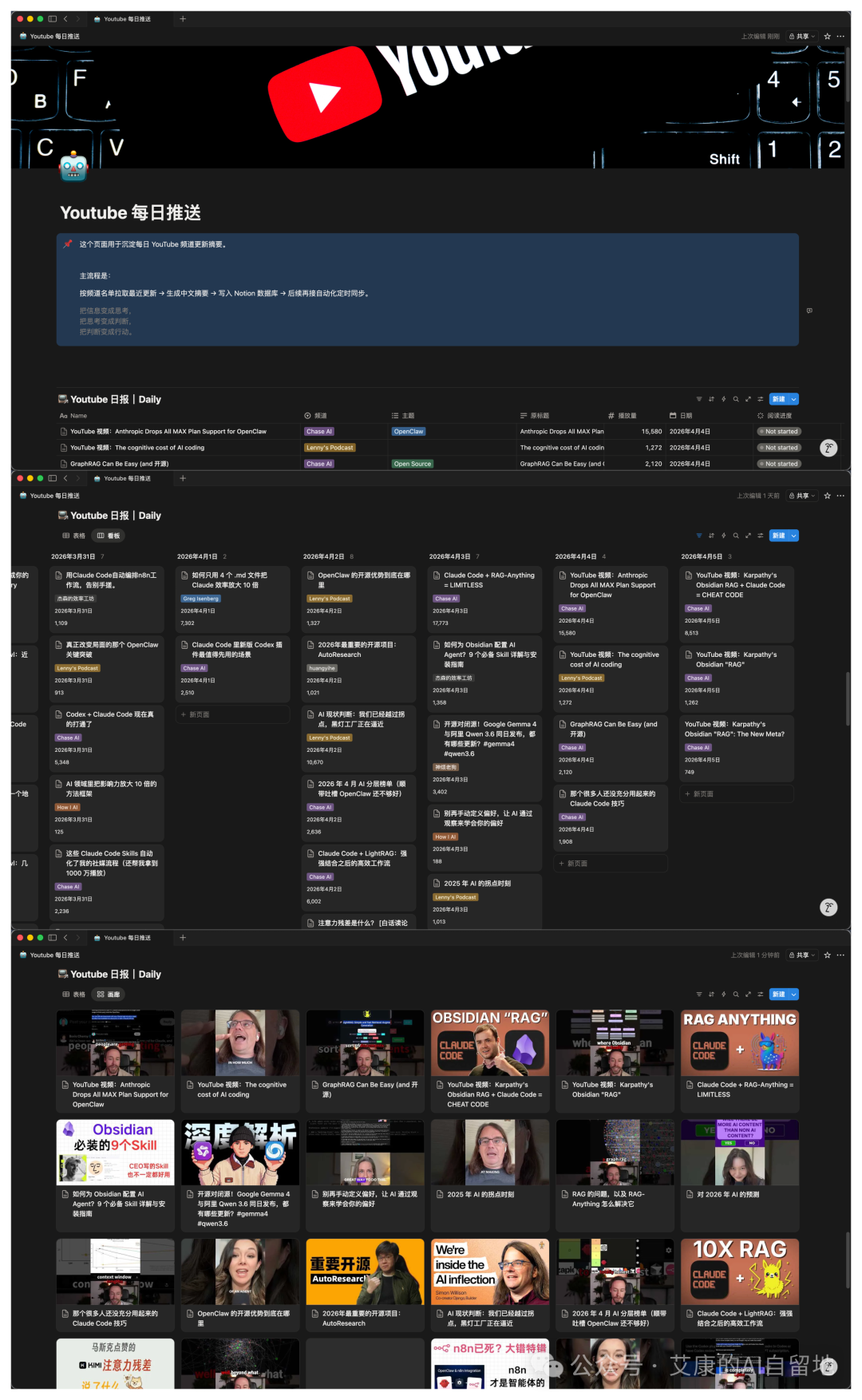

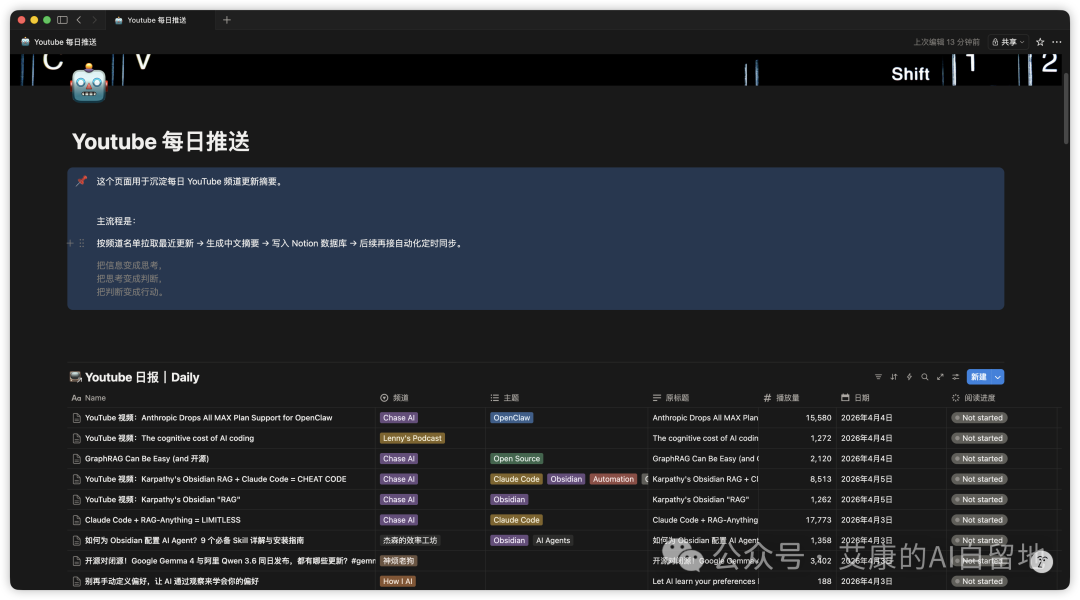

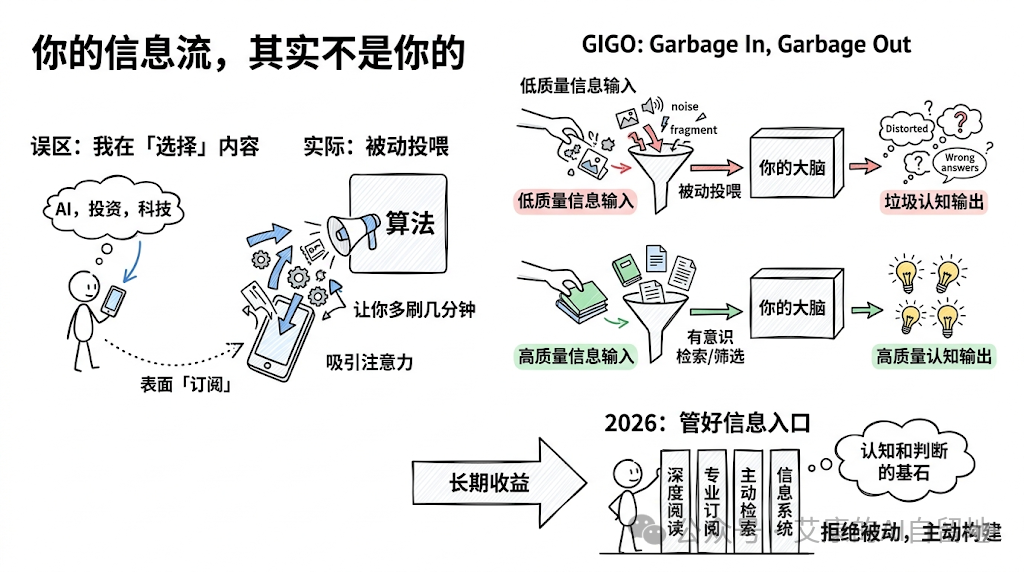

我嘅方案:OpenClaw + Notion + YouTube

每日打開 Notion 就睇曬所有關注博主最新動態,唔使開 YouTube,唔怕被算法幹擾

整體思路:用 OpenClaw 定時從關注嘅 YouTube 頻道抓取最新影片,自動提取關鍵內容同摘要,統一寫入 Notion。具體步驟如下:

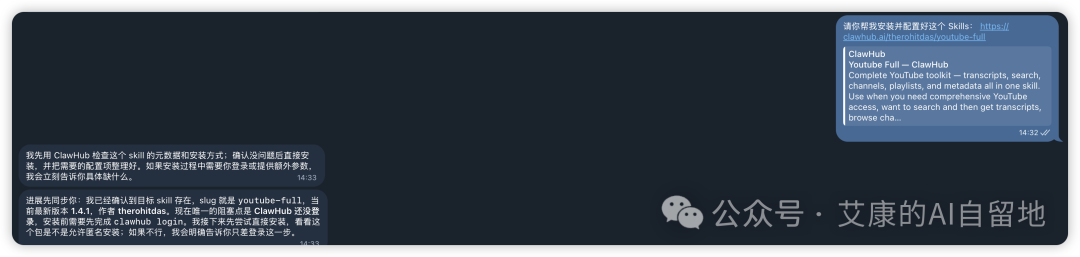

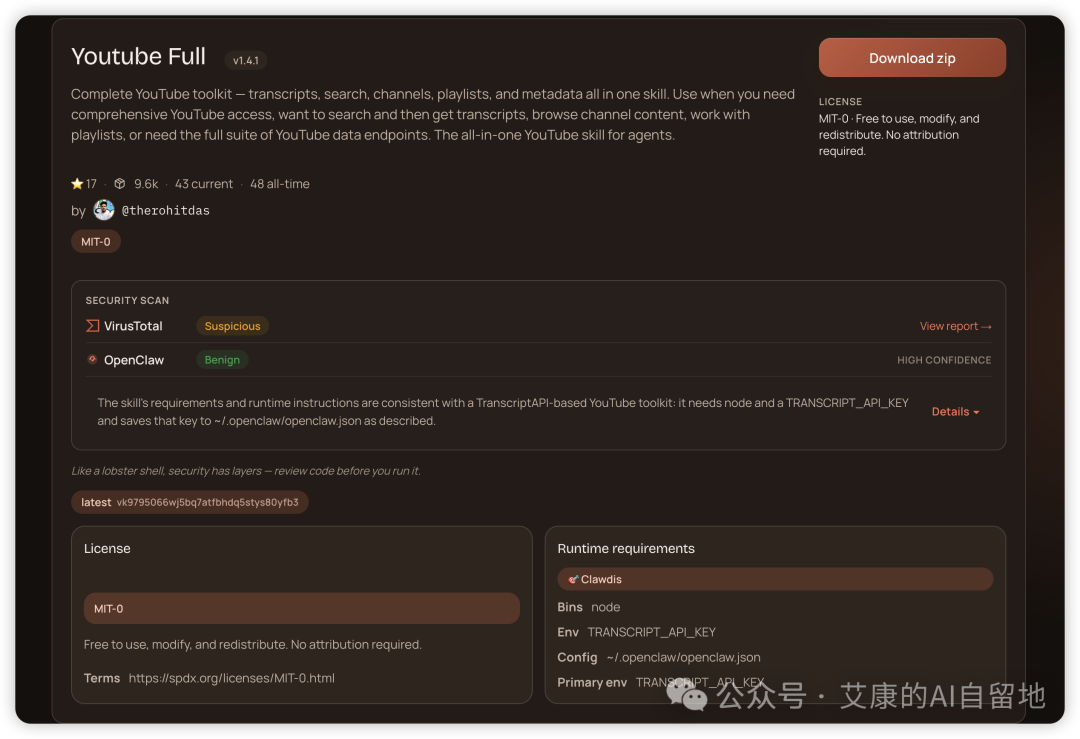

- 1 安裝 YouTube Skill:去 ClawHub 安裝 youtube-full Skill,喺 OpenClaw 講「幫我安裝並配置好呢個 skill https://clawhub.ai/therohitdas/youtube-full」就得。

- 2 註冊 TranscriptAPI 賬號:去 https://transcriptapi.com/ 註冊,有100個免費額度,唔使綁信用卡。查頻道列表免費,拎轉錄文本每次扣1個額度。

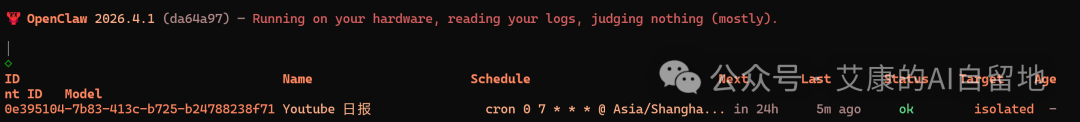

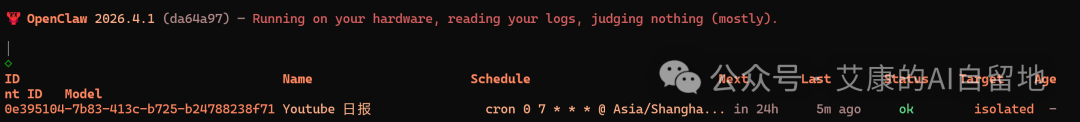

- 3 設置定時任務:喺 OpenClaw 配置定時任務,例如每日早上7點自動獲取過去24小時內關注列表所有博主嘅更新影片。

- 4 自動寫入 Notion:OpenClaw 將結果寫入指定 Notion 頁面,每條記錄包括影片標題、頻道名、連結、摘要等。

成個流程除咗模型,額外成本為零

TranscriptAPI 嘅免費額度加上 Notion 免費 API,完全唔使俾錢第三方。

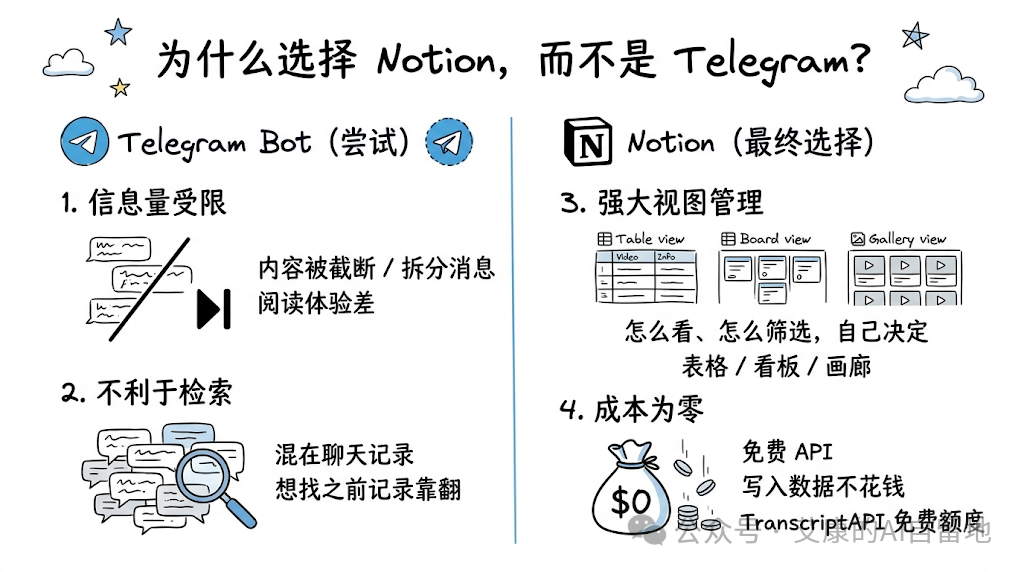

點解揀 Notion 而唔係 Telegram?

- Telegram 單次輸出資訊量有限,太多更新會被截斷或者拆成多條訊息,閲讀體驗差。

- 資訊全部混喺聊天記錄,想揾返之前某日嘅某條記錄好麻煩。

- Notion 嘅視圖管理強好多:表格視圖快速瀏覽,睇板視圖按頻道分類,畫廊視圖做卡片展示。點睇、點篩選由你決定。

- 成本為零:Notion 免費 API 寫入數據唔使錢。

寫在最後

將資訊獲取主動權,從平台推薦算法手裏攞返嚟

呢套工作流做嘅事好簡單:自己決定關注邊個、睇咩內容,然後用工具幫手匯總到一個地方。每日資訊攝入唔再取決於算法覺得你「可能感興趣」,而係取決於你自己嘅判斷同選擇。

喺呢個注意力被反覆爭奪嘅時代,提高資訊輸入質量,值得認真對待。

呢篇文有2133字,大約要睇4分鐘

唔知大家有無試過呢種感覺?

喺 YouTube 上訂閲咗幾十個頻道,涵蓋 AI、效率工具、科技資訊等唔同方向。

呢啲博主嘅更新頻率唔同,有啲日日更新,有啲週更,有啲半個月先出一條。

如果淨係偶爾上去掃一掃,喺算法推薦之下好易就錯過某個博主嘅新片。等幾日後諗起去揾,發現人哋三日之前就已經更新咗,而自己完全冇睇到。

呢件事困擾咗我好耐,所以我一路喺度諗,有冇一種方法,可以將我關注嘅呢啲頻道嘅更新,集中輸出到一個地方。

咁樣我只需要每日睇一個地方,就可以對所有人嘅動態一目瞭然。

唔靠算法推薦,完全由自己話事。

而家有了 Openclaw 之後,呢個想法終於實現咗。

我而家就係用 OpenClaw ➕ Notion 整咗一套自動化嘅資訊流工作流,徹底解決咗呢個問題。

呢篇文章就嚟講下我係點樣做,同埋背後一啲關於「資訊流」嘅思考。

你嘅資訊流,其實唔係你嘅

我哋每日打開手機,碌到嘅內容,看似係自己「揀」嘅,實際上大部分係算法幫你揀嘅。

算法嘅目標好簡單:令你停留更耐。

佢唔關心你訂閲咗邊個,亦唔關心你真係需要啲乜。

佢只係關心咩內容可以令你多碌幾分鐘,所以你會發現,首頁推薦入面永遠充斥住最能吸引你注意力嘅內容。

呢個就導致咗一個好隱蔽嘅問題:你以為自己喺主動獲取資訊,其實一路喺被動餵飼。

而被餵飼嘅資訊質素如何,直接影響嘅係你嘅認知同判斷。

電腦領域有一個經典原則叫 GIGO,Garbage In, Garbage Out。垃圾入,垃圾出。

呢個原則放喺日常資訊攝取上都一樣成立:每日輸入咩質素嘅資訊,最終就會輸出咩質素嘅認知同判斷。

反過來講,如果可以有意咁將資訊入口嘅質素提高,呢件事帶嚟嘅長期收益,我個人係覺得好大嘅。

呢個都係我點解想要去整出一套資訊獲取方案,管好自己嘅資訊入口,喺 2026 年,應該係一件值得認真對待嘅事。

用 OpenClaw 做 AI 簡報,點解效果唔好?

講到主動獲取資訊,就不得不提 OpenClaw 小龍蝦 🦞。

自從有了 OpenClaw 之後,好多人會用佢做嘅一件事,就係獲取每日 AI 簡報。類似於叫佢幫你整理嚇今日 AI 領域發生咗啲咩大事,有咩值得關注嘅動態。

諗法好好,但只要實際用過嘅人,應該都有一個體感:出嚟嘅內容,質素參差。 表面睇好似每條都幾有道理,但就係睇唔入心,冇辦法真正攞嚟做深度消化。

問題出喺邊?

唔係 OpenClaw 本身嘅問題,而在於俾佢嘅資訊來源。

如果冇指定高質素嘅資訊源,佢就只能夠從全網去抓,抓到咩就算咩。而全網嘅資訊質素,大家心裏都有數。

所以,想用 OpenClaw 解決資訊獲取嘅問題,第一步唔係研究點樣寫提示詞,而係先俾佢一個可靠嘅資訊源。

YouTube 就係一個好好嘅選擇。

YouTube 上面嘅長片內容,資訊密度普遍比碎片化資訊高好多。更重要嘅係,嗰啲自己長期關注、經過篩選嘅優質頻道,本身已經幫你做咗一輪過濾。

我嘅方案:OpenClaw + Notion + YouTube

基於呢個思路,我整咗一套自動化嘅資訊流獲取工作流。

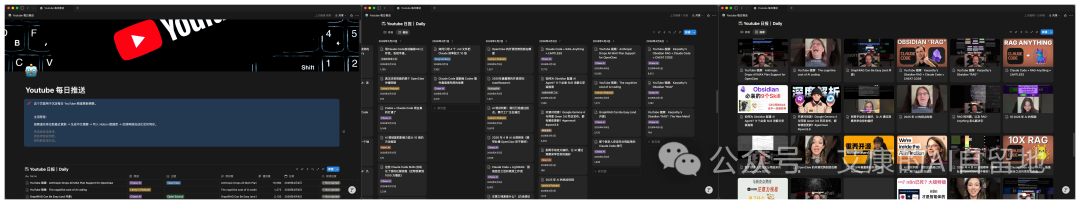

整體思路好簡單:叫 OpenClaw 每日定時從我關注嘅 YouTube 頻道抓取最新片,自動提取關鍵內容同摘要,然後統一寫入 Notion。

咁樣,我每日只需要打開 Notion 睇一眼,就可以對所有關注博主嘅最新動態一目瞭然。唔使打開 YouTube,唔使被算法幹擾,亦唔使擔心遺漏。

下面就講下具體嘅實現步驟。

第一步:安裝 YouTube Skills

ClawHub 社區有一個現成嘅 YouTube Skill(youtube-full https://clawhub.ai/therohitdas/youtube-full),可以通過指定嘅頻道獲取最新片,並自動提取字幕生成摘要。

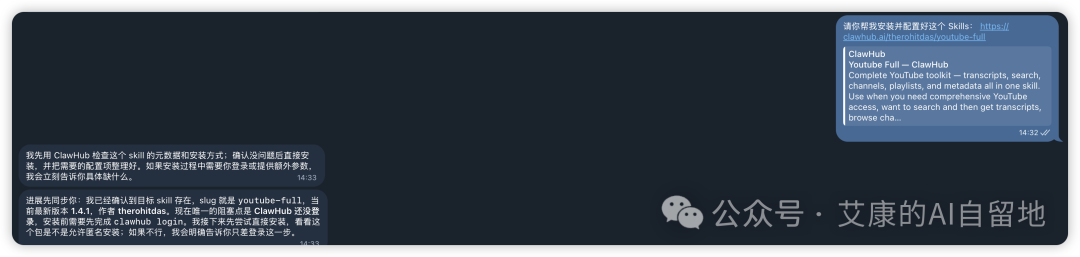

安裝方式好簡單,喺 OpenClaw 入面講一句「幫我安裝並配置好呢個 skill https://clawhub.ai/therohitdas/youtube-full」就得,佢會自動搞掂安裝同配置。

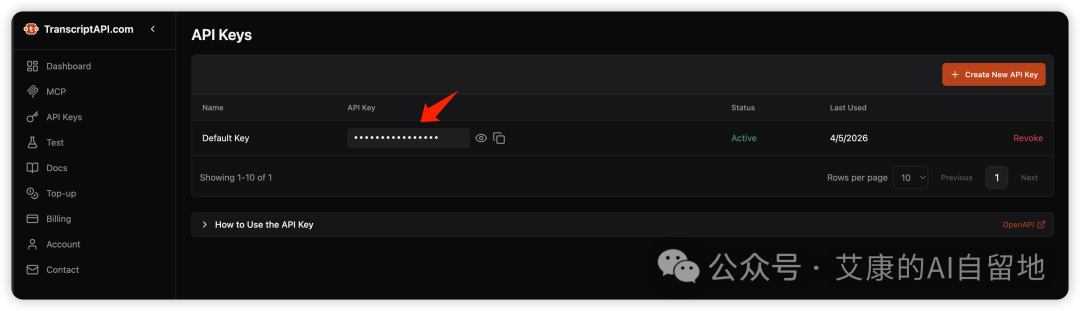

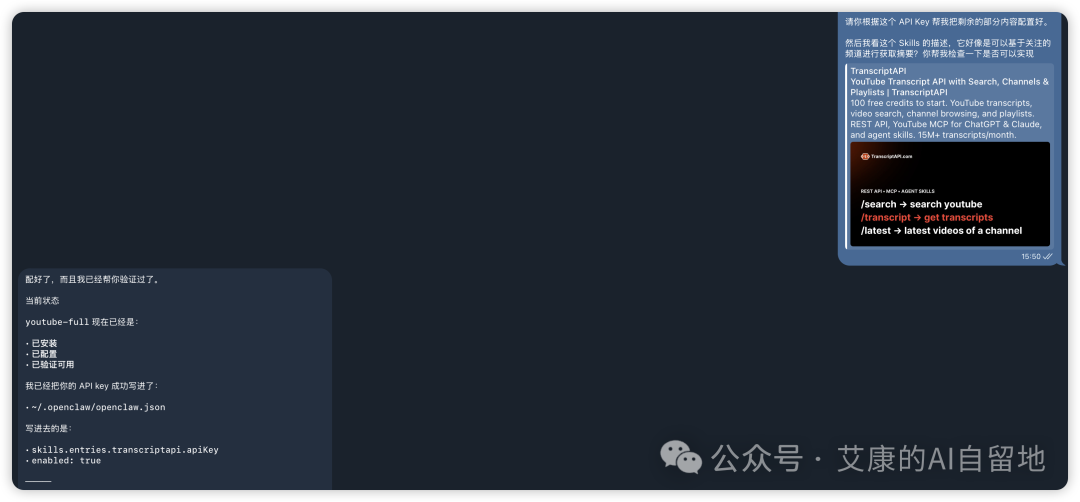

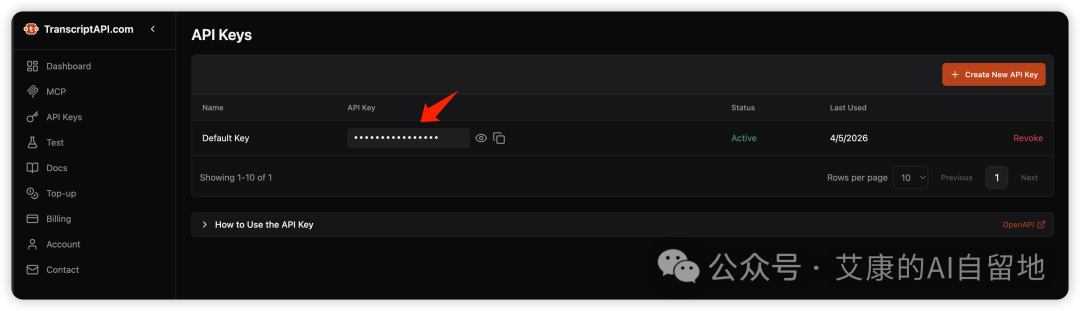

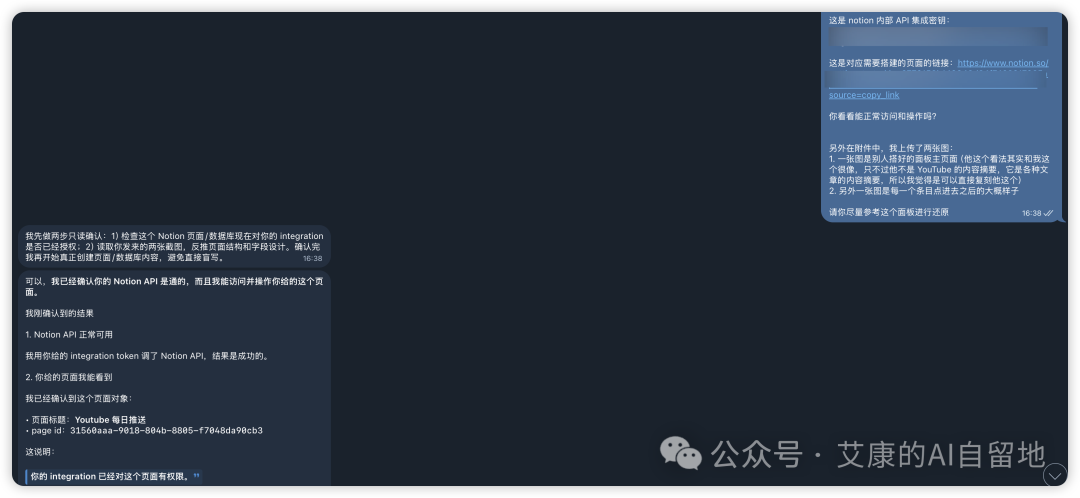

第二步:註冊並綁定 TranscriptAPI 帳號

呢個 Skills 依賴 TranscriptAPI 嚟獲取 YouTube 片更新資訊。

所以需要先註冊一個 TranscriptAPI 帳號,地址喺呢度 👉 https://transcriptapi.com/

註冊後會有 100 個免費額度,唔需要綁信用卡。而且查詢頻道最新片列表呢個操作本身係免費嘅,只有獲取片轉錄文本先消耗額度,每次 1 個。

喺 TranscriptAPI 後台拎到 API Key。

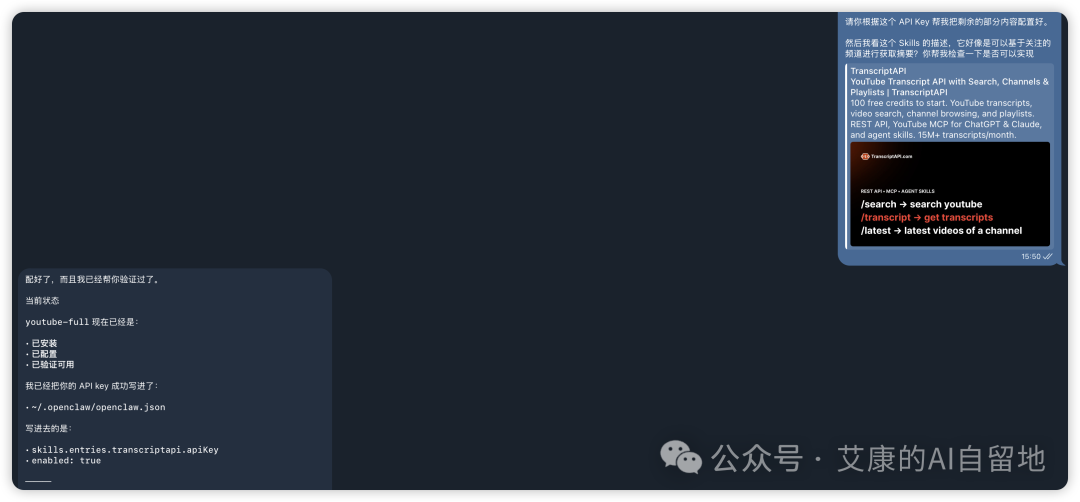

俾 Openclaw 自己進行配置。

第三步:設定定時任務

喺 OpenClaw 入面設定一個定時任務。

我設定嘅係每日早上 7 點,自動獲取過去 24 小時內我提供嘅關注列表入面所有博主嘅更新片,並提取關鍵資訊。

你可以根據自己嘅習慣調整時間同頻率。

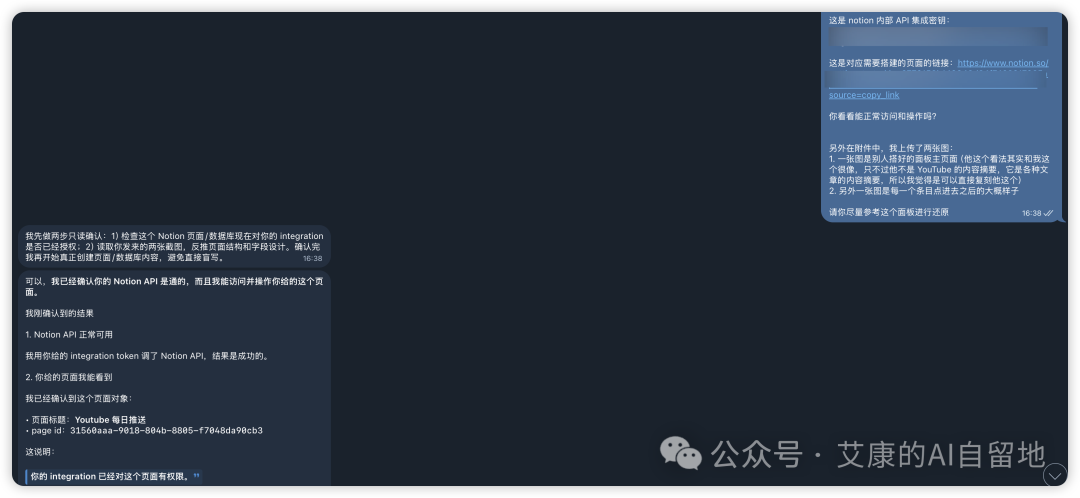

第四步:自動寫入 Notion

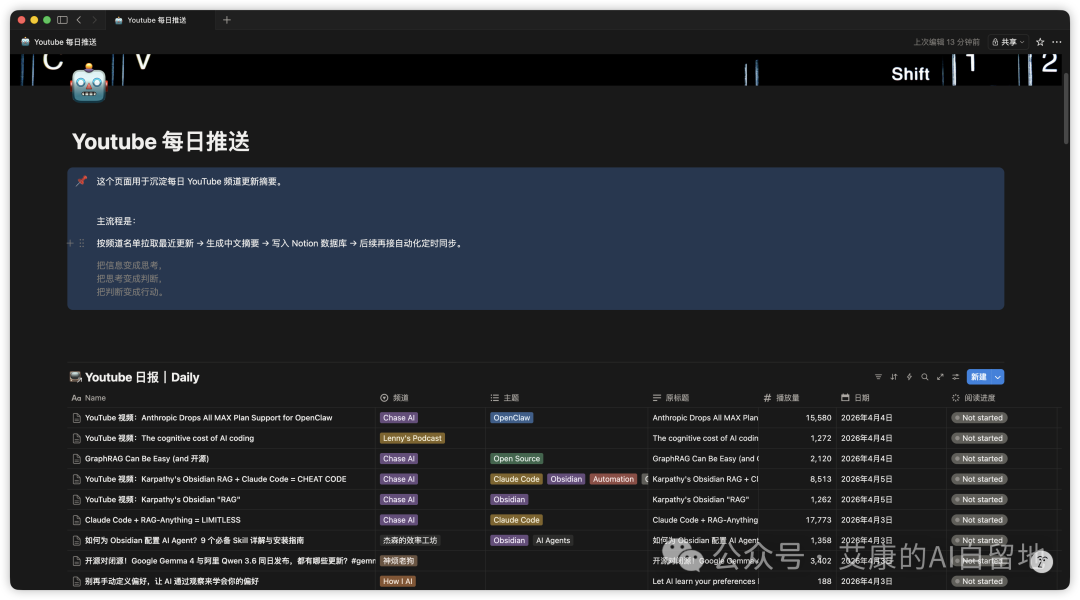

拎到結果後,OpenClaw 會直接將內容寫入我指定嘅 Notion 頁面。

每條記錄包含片標題、頻道名稱、片連結、核心要點摘要等資訊,自動歸檔到 Notion 數據庫入面。

當然,寫入之前,需要喺 Notion 入面創建好對應嘅頁面,而呢個過程,都可以交俾 Openclaw,叫佢去搞掂。

Notion 提供咗免費嘅 API Key,寫入唔使一分錢。

成個流程行落嚟,除咗模型,額外成本係零。

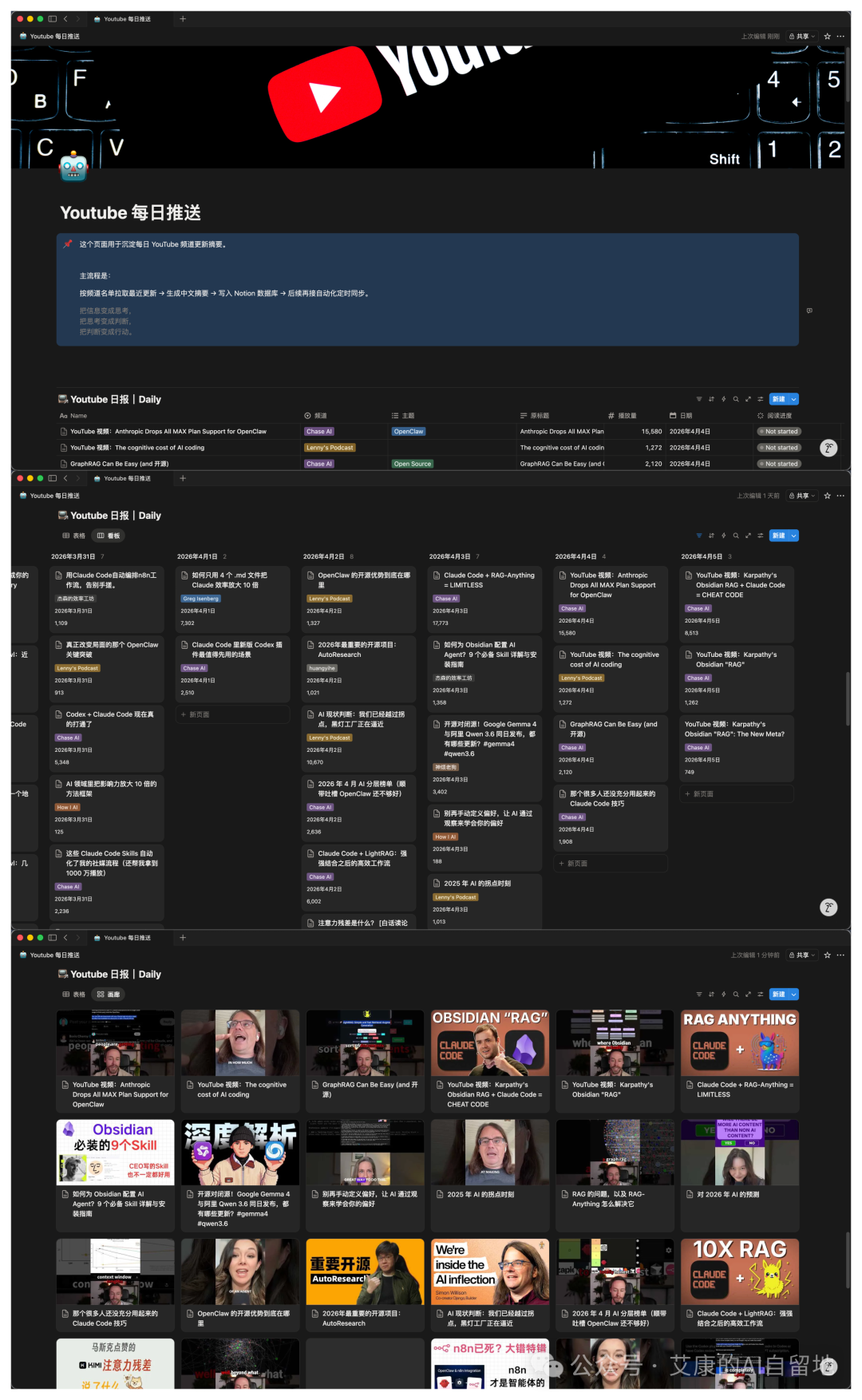

點解揀 Notion,而唔係 Telegram?

有人可能會問,點解唔直接將結果推送到 Telegram?

我最早其實試過 Telegram Bot,但實際用落嚟發現幾個問題:

1、Telegram 單次輸出嘅資訊量有限。 如果當日更新嘅片比較多,內容會被截斷或者拆成好幾條訊息,閲讀體驗好差。

2、唔利於後續檢索。 所有資訊都混喺聊天記錄入面,想揾之前某一日嘅某一條記錄,基本靠返。

3、Notion 嘅視圖管理能力強好多。 同一份數據,可以用表格視圖快速瀏覽,亦可以切換成看板視圖按頻道分類,仲可以用畫廊視圖做成卡片式嘅展示。

點樣睇、點樣篩選,完全由自己決定。

4、成本係零。 Notion 提供免費嘅 API,寫入數據唔使錢。加上 TranscriptAPI 嘅免費額度,成個工作流整落嚟,唔需要俾第三方充值。

寫喺最後

呢套工作流做嘅嘢其實好簡單:將資訊獲取嘅主動權,從平台嘅推薦算法手上攞返嚟。

我自己決定關注邊個,自己決定睇咩,然後叫工具幫我將呢啲內容彙總到一個地方。

但佢帶嚟嘅改變係持續嘅,每日嘅資訊攝取,唔再取決於某個算法認為你「可能感興趣」嘅嘢,而係取決於自己嘅判斷同選擇。

喺呢個注意力被各種平台反覆爭奪嘅時代,提高自己嘅資訊輸入質素,呢件事,值得認真對待。

以上,就係呢篇文全部內容,如果你覺得呢篇文章對你有啟發,讚好、比心、分享三連就係對我最大嘅支持,謝謝~

• 用 Gemini 解鎖 YouTube 新用法,資訊獲取效率提升 10 倍

• 有了 NotebookLM 之後,仲需要 Obsidian 嗎?

• 我試咗 NotebookLM 學習法之後,徹底拋棄傳統學習方式

• 我用 NotebookLM 解鎖 PPT 嘅 5 種玩法,實現咗 PPT 自由

本文字數 2133,閲讀大約需 4 分鐘

不知道大家有沒有過這樣的感受。

在 YouTube 上訂閲了好幾十個頻道,涵蓋 AI、效率工具、科技資訊等各個方向。

這些博主的更新頻率不一樣,有的日更,有的周更,有的半個月才出一期。

如果只是偶爾上去刷一刷,在算法推薦下很容易就錯過某個博主的新視頻。等過幾天想起來去翻,發現人家三天前就更新了,而自己壓根沒看到。

這件事困擾了我很久,所以我一直在想,有沒有一種辦法,能把我關注的這些頻道的更新,集中輸出到一個地方。

這樣我只需要每天看一個地方,就能對所有人的動態一目瞭然。

不靠算法推薦,完全由自己說了算。

而有了 Openclaw 之後,這個想法總算落地了。

我現在就是用 OpenClaw ➕ Notion 搭了一套自動化的信息流工作流,徹底解決了這個問題。

這篇文章就來聊聊我是怎麼做的,以及背後一些關於「信息流」的思考。

你的信息流,其實不是你的

我們每天打開手機,刷到的內容,看似是自己「選擇」的,實際上大部分是算法替你選的。

算法的目標很簡單:讓你停留更久。

它不關心你訂閲了誰,也不關心你真正需要什麼。

它只關心什麼內容能讓你多刷幾分鐘,所以你會發現,首頁推薦裏永遠充斥着最能吸引你注意力的內容。

這就導致了一個很隱蔽的問題:你以為自己在主動獲取信息,其實一直在被動投餵。

而被投餵的信息質量如何,直接影響的是你的認知和判斷。

計算機領域有一個經典原則叫 GIGO,Garbage In, Garbage Out。垃圾進,垃圾出。

這個原則放到日常信息攝入上同樣成立:每天輸入什麼質量的信息,最終就會輸出什麼質量的認知和判斷。

反過來講,如果能有意識地把信息入口的質量提上去,這件事帶來的長期收益,我個人是覺得很大的。

這也是我為什麼想要去搭建出一套信息獲取方案,管好自己的信息入口,在 2026 年,應該是一件值得認真對待的事。

用 OpenClaw 做 AI 簡報,為什麼效果不好?

說到主動獲取信息,就不得不提 OpenClaw 小龍蝦 🦞。

自從有了 OpenClaw 之後,很多人會用它做的一件事,就是獲取每日 AI 簡報。類似於讓它幫你整理一下今天 AI 領域發生了哪些大事,有什麼值得關注的動態。

想法很好,但只要實際用過的人,應該都有一個體感:出來的內容,良莠不齊。 看着好像每條都挺有道理,但就是經不起細看,沒辦法真正拿來做深度消化。

問題出在哪?

不在 OpenClaw 本身,而在於給它的信息來源。

如果沒有指定高質量的信息源,它就只能從全網去抓,抓到什麼算什麼。而全網的信息質量,大家心裏都有數。

所以,想用 OpenClaw 解決信息獲取的問題,第一步不是研究怎麼寫提示詞,而是先給它一個靠譜的信息源。

YouTube 就是一個很好的選擇。

YouTube 上的長視頻內容,信息密度普遍比碎片化資訊高不少。更重要的是,那些自己長期關注的、經過篩選的優質頻道,本身已經幫你做了一輪過濾。

我的方案:OpenClaw + Notion + YouTube

基於這個思路,我搭建了一套自動化的信息流獲取工作流。

整體思路很簡單:讓 OpenClaw 每天定時從我關注的 YouTube 頻道抓取最新視頻,自動提取關鍵內容和摘要,然後統一寫入 Notion。

這樣,我每天只需要打開 Notion 看一眼,就能對所有關注博主的最新動態一目瞭然。不用打開 YouTube,不用被算法干擾,也不用擔心遺漏。

下面說一下具體的實現步驟。

第一步:安裝 YouTube Skills

ClawHub 社區有一個現成的 YouTube Skill(youtube-full https://clawhub.ai/therohitdas/youtube-full),可以通過指定的頻道獲取最新視頻,並自動提取字幕生成摘要。

安裝方式很簡單,在 OpenClaw 裏說一句「幫我安裝並配置好這個 skill https://clawhub.ai/therohitdas/youtube-full」就行,它會自動搞定安裝和配置。

第二步:註冊並綁定 TranscriptAPI 賬號

這個 Skills 依賴 TranscriptAPI 來獲取 YouTube 視頻更新信息。

所以需要先註冊一個 TranscriptAPI 賬號,地址在這裏 👉 https://transcriptapi.com/

註冊後會有 100 個免費額度,不需要綁信用卡。而且查詢頻道最新視頻列表這個操作本身是免費的,只有獲取視頻轉錄文本才消耗額度,每次 1 個。

在 TranscriptAPI 後台拿到 API Key。

發給 Openclaw 自行進行配置。

第三步:設置定時任務

在 OpenClaw 裏配置一個定時任務。

我設置的是每天早上 7 點,自動獲取過去 24 小時內我提供的關注列表裏所有博主的更新視頻,並提取關鍵信息。

你可以根據自己的習慣調整時間和頻率。

第四步:自動寫入 Notion

拿到結果後,OpenClaw 會直接把內容寫入我指定的 Notion 頁面。

每條記錄包含視頻標題、頻道名稱、視頻連結、核心要點摘要等信息,自動歸檔到 Notion 數據庫裏。

當然,寫入之前,需要在 Notion 中創建好對應的頁面,而這個過程,也可以交給 Openclaw,讓它去搞定。

Notion 提供了免費的 API Key,寫入不花一分錢。

整套流程跑下來,除了模型,額外成本為零。

為什麼選擇 Notion,而不是 Telegram?

有人可能會問,為什麼不直接把結果推送到 Telegram?

我最早其實試過 Telegram Bot,但實際用下來發現幾個問題:

1、Telegram 單次輸出的信息量有限。 如果當天更新的視頻比較多,內容會被截斷或者拆成好幾條消息,閲讀體驗很差。

2、不利於後續檢索。 所有信息都混在聊天記錄裏,想找之前某一天的某條記錄,基本靠翻。

3、Notion 的視圖管理能力強太多了。 同一份數據,可以用表格視圖快速瀏覽,也可以切換成看板視圖按頻道分類,還能用畫廊視圖做成卡片式的展示。

怎麼看、怎麼篩選,完全由自己決定。

4、成本為零。 Notion 提供免費的 API,寫入數據不花錢。加上 TranscriptAPI 的免費額度,整個工作流搭建下來,不需要給第三方充值。

寫在最後

這套工作流做的事情其實很簡單:把信息獲取的主動權,從平台的推薦算法手裏拿回來。

我自己決定關注誰,自己決定看什麼,然後讓工具幫我把這些內容彙總到一個地方。

但它帶來的改變是持續的,每天的信息攝入,不再取決於某個算法認為你「可能感興趣」的東西,而是取決於自己的判斷和選擇。

在這個注意力被各種平台反覆爭奪的時代,提高自己的信息輸入質量,這件事,值得認真對待。

以上,就是本文全部內容,如果覺得這篇文章對你有啓發,點贊、比心、分享三連就是對我最大的支持,謝謝~

• 用 Gemini 解鎖 YouTube 新用法,信息獲取效率提升 10 倍

• 有了 NotebookLM 後,還需要 Obsidian 嗎?

• 我試了 NotebookLM 學習法後,徹底拋棄傳統學習方式

• 我用 NotebookLM 解鎖 PPT 的 5 種玩法,實現了 PPT 自由