用 Claude Code + Obsidian 搭建Karpathy的LLM Wiki

整理版優先睇

用 Claude Code 同 Obsidian,將知識管理當做軟件工程咁做,實現知識複利

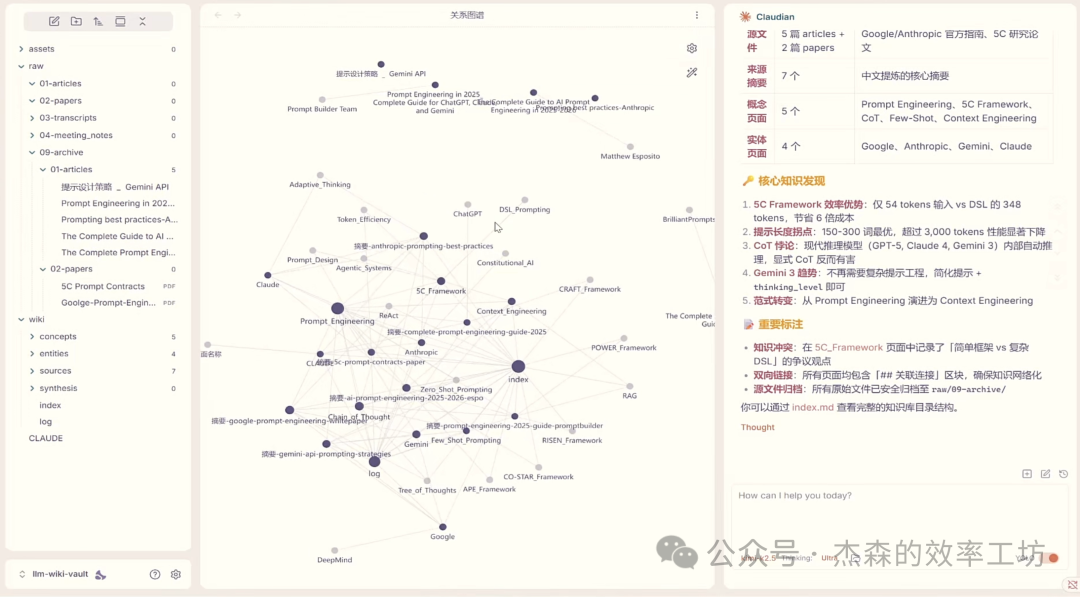

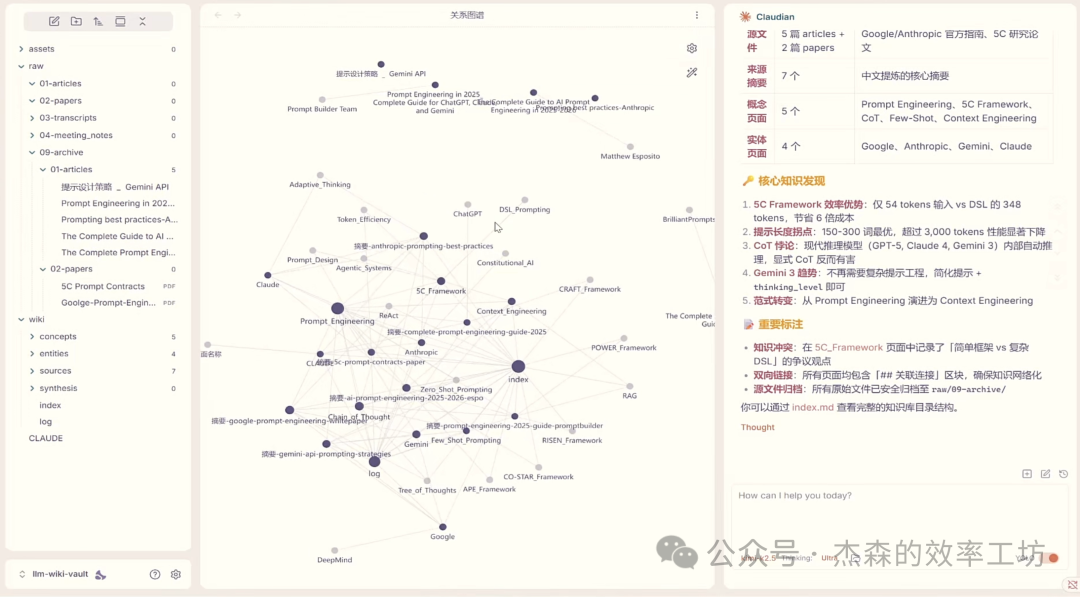

呢篇文章係作者分享佢點樣跟住 Andrej Karpathy 嘅 LLM Wiki 理念,用 Claude Code 加 Obsidian 嚟搭建一個自己嘅知識管理系統。傳統做法係靠 RAG 即時檢索,但 Karpathy 提出要轉向持續編譯,將知識管理當成軟件工程嚟做。作者嘅整體結論係:用 AI 智能體將平時收集嘅資料編譯成 Wiki 形式嘅 Markdown 筆記庫,人類負責決策同提供素材,AI 負責所有繁瑣嘅節點編織工作,從而實現知識複利。

文章首先解釋咗 LLM Wiki 嘅核心哲學,同傳統 RAG 嘅分別,然後詳細介紹咗三層架構:原始資料層、編譯輸出層同架構規範層。作者跟住逐步教讀者點樣搭建文件夾結構、寫 CLAUDE.md 配置,同埋點樣設計三個核心 Agent Skill——攝取、查詢同巡檢。最後佢提到進階功能同核心風險,尤其係 Token 成本同 AI 幻覺被固化嘅問題,並強調呢套方案最適閤中小型規模嘅個人或小團隊使用。

- LLM Wiki 嘅核心係從即時檢索轉向持續編譯,將知識管理當做軟件工程,由 AI 自動編織知識節點,人類只負責決策同提供素材。

- 三層架構包括 raw(原始資料,只讀)、wiki(編譯輸出,AI 全權維護)同 schema(CLAUDE.md 等全局配置),確保權責分明。

- 三個核心操作:ingest(攝取資料並生成 wiki 頁面)、query(深度查詢,帶雙鏈引用,並可保存新知識)、lint(定期體檢,找出孤島頁面同邏輯矛盾)。

- 最大風險係 AI 幻覺被固化:一旦 LLM 產生錯誤,會寫入 wiki 永久留存,後續推理會不斷放大偏差,所以必須保留人工確認機制。

- 呢套方案最適合 40 萬字以內、100-200 篇高質量文章嘅個人或小團隊,唔適合大規模知識庫,Token 成本同幻覺風險會急升。

完整知識庫檔案同原始資料 (GitHub)

作者將整篇文章用到嘅知識筆記、測試原始資料同搭建好嘅完整知識庫文件夾打包上傳咗,可以直接下載體驗。

Anthropic 官方 skill-creator 工具

用嚟快速生成 Claude Code 技能嘅工具,可以避免手寫冗長提示詞。

核心理念:知識編譯取代即時檢索

Andrej Karpathy 提出 LLM Wiki 嘅核心邏輯係從 即時檢索 (RAG) 轉向 持續編譯 (Compilation),將知識管理當成軟件工程嚟做。簡單講,就係將你平時要學習嘅資料同文章,通過 AI 智能體轉換成 Wiki 形式嘅 Markdown 筆記庫,最好嘅承接工具就係 Obsidian。

編譯後嘅筆記庫中,你可以利用 AI 進行持續嘅學習同探索,每次總結出嘅重要內容都會再次存入知識庫,實現知識複利。

傳統 RAG 同 LLM Wiki 嘅具體差異:RAG 係每次查詢都去揾資料,而 LLM Wiki 係預先編譯好結構化知識庫。如果你覺得難理解,記住呢個比喻:Obsidian 就係 IDE 代碼編輯器,LLM 係程序員,Wiki 係代碼庫。人類只負責決策同提供素材,AI 接管所有繁瑣嘅節點編織工作。

三層架構:raw、wiki、schema

Karpathy 嘅理念建立在嚴格嘅三層架構之上。

- 1 原始資料層 (raw):存放平時收集或策劃嘅文檔集合,例如 Obsidian Web Clipper 剪藏嘅網絡文章、論文文獻、轉錄文案等。呢層係不被修改嘅事實之源,AI 只有讀取權限。

- 2 編譯輸出層 (wiki):AI 智能體對原始資料深入分析後生成嘅 Markdown 文件目錄,包含摘要、實體概念、對比分析,同埋核心嘅 index.md 同 log.md。呢層供人類閲讀,由 AI 全權負責寫入同維護。

- 3 架構規範層 (Schema):智能體工具嘅全局心智配置文件。如果用 Claude Code,對應 CLAUDE.md;如果用 OpenCode,對應 AGENTS.md。作用係明確話畀智能體具體嘅工作流程、語言協議同權限邊界。

動手實踐:搭建文件夾同配置規範

要令知識庫運轉,需要實現三個核心操作:攝取 (ingest)、查詢 (query) 同 巡檢 (lint)。首先嚟搭建環境。

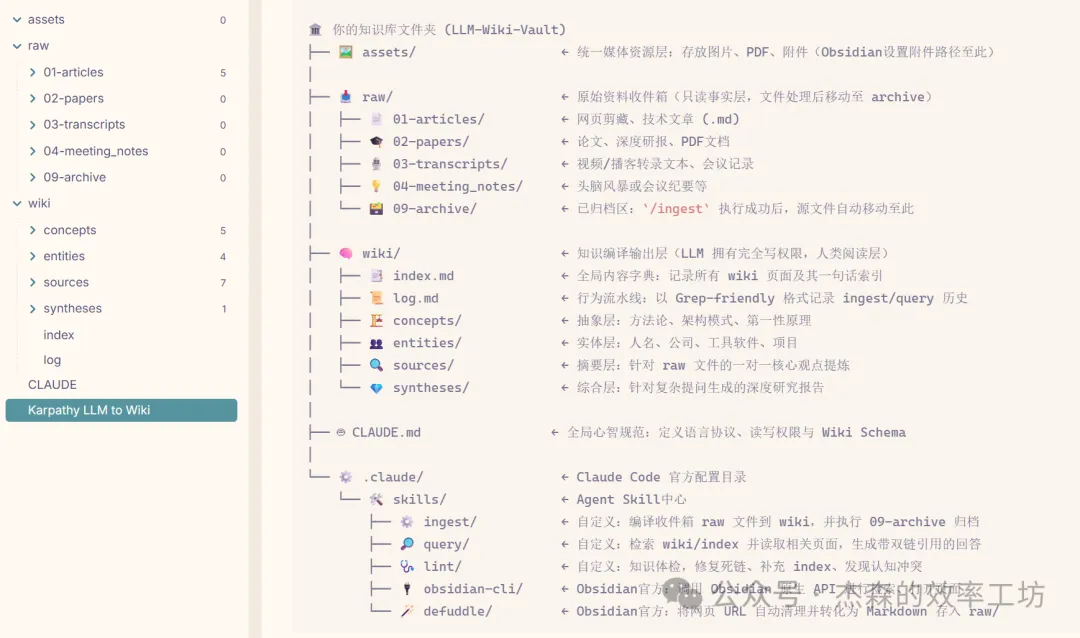

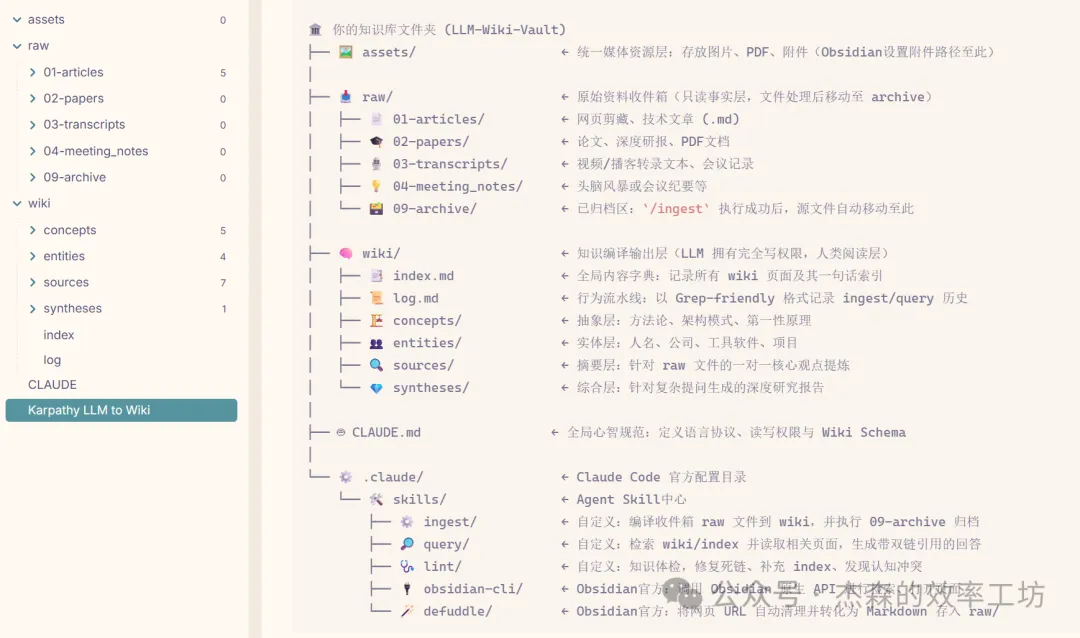

第一步,喺電腦創建空白項目文件夾,裏面分別建立 raw、wiki、assets 三個子文件夾。raw 入面要建立 archive 歸檔文件夾;wiki 入面建立 index.md 同 log.md,再新建 concepts、entities、sources、syntheses 子文件夾。然後用 Claude Code 打開項目文件夾,輸入 /init 自動生成 CLAUDE.md 同 .claude 文件夾。

project/

├── raw/

│ ├── articles/

│ ├── papers/

│ └── archive/

├── wiki/

│ ├── index.md

│ ├── log.md

│ ├── concepts/

│ ├── entities/

│ ├── sources/

│ └── syntheses/

└── assets/第二步,配置 CLAUDE.md。刪除自動生成嘅英文內容,寫入目錄結構與權限邊界(AI 只能讀 raw,可以寫 wiki),同埋格式與雙向連結規範(例如 必須包含雙向連結,絕不能產生孤島頁面)。

三個核心 Agent Skill:讓 AI 自動運轉

喺 .claude/skills 目錄分別創建 ingest、query、lint 三個技能。

- 1 知識攝取 (ingest):將資料放入 raw 後,觸發 /ingest 工作流。AI 會深入分析原始文件,提取核心主旨、實體同概念,寫成對應 Markdown 放入 wiki 層,建立雙向連結,更新 index 同 log,最後將原始文件移動到 archive 歸檔。

- 2 深度查詢 (query):輸入 /query 後,AI 先讀取 index.md 索引,定位到相關內容後深度閲讀目標文件,最後畀出帶雙鏈引用嘅回答。如果生成咗高價值內容(例如對比表格),AI 會主動詢問是否保存到 wiki/syntheses,確認後自動編織連結同更新日誌。

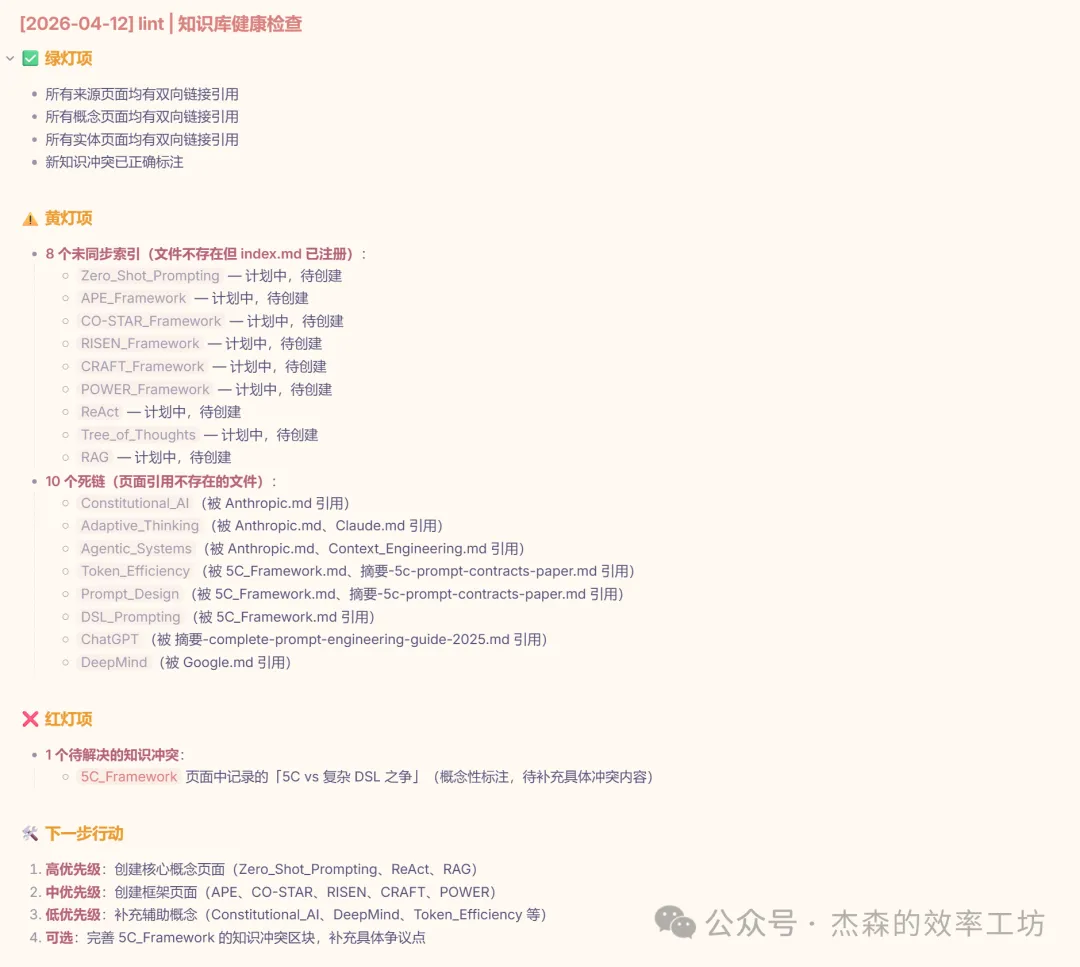

- 3 知識庫巡檢 (lint):輸入 /lint,AI 會掃描整個 wiki 目錄,找出邏輯矛盾、過時信息、孤島頁面同失效死鏈。智能體只能生成體檢報告同修復計劃,必須用戶確認後先可以修改,絕對唔允許偷偷篡改筆記。

進階功能同核心風險

為咗提高效率,可以喺技能鏈集成 obsidian-cli 等官方命令行工具,令智能體調用 Obsidian 原生 API 檢索頁面,大幅降低 Token 消耗同提升準確度。

實際使用時必須留意兩個核心風險:

- 極高嘅 Token 成本:大規模文件讀寫,特別係每次查詢都要將關聯文件推入大模型上下文,會導致 API 費用猛增。

- AI 幻覺被固化:呢個係最致命嘅缺陷。一旦 LLM 產生幻覺(例如偽造數據),錯誤會被寫入 Markdown 永久固化,未來推理都會以錯誤節點為事實基石,導致偏差無限放大。

所以,呢套方案目前最適合 中小型規模(約 40 萬字以內,100-200 篇高質量文章)嘅個人或小團隊使用。

核心理念:咩係 LLM Wiki?

Andrej Karpathy 嘅 LLM Wiki 理念,核心概念係由即時檢索 (RAG) 轉向持續編譯 (Compilation),將知識管理當成軟件工程咁做。

簡單講,就係將你平時要學嘅資料同文章,透過 AI 智能體(例如 Claude Code,OpenCode,OpenClaw)轉換成 Wiki 形式嘅 Markdown 筆記庫。最好嘅承接工具就係 Obsidian。喺編譯完嘅筆記庫入面,你用 AI 嚟持續學習同探索。每次學習總結出嚟嘅重要內容會再存入知識庫,達到知識複利。同時 AI 亦會定期幫筆記庫做體檢,保持系統健康。

下邊係傳統 RAG 同 LLM Wiki 理念嘅具體分別對比:

如果你覺得難明,記住呢個比喻:Obsidian 就係 IDE 代碼編輯器,LLM 係程序員,Wiki 係代碼庫。人類只需負責決策同提供素材,AI 接手所有麻煩嘅節點編織工作。

知識庫嘅三層架構

Karpathy 嘅理念係建基於嚴格嘅三層架構。

1. 原始資料層 (raw)

呢度放平時收集或策劃嘅文檔集合。例如透過 Obsidian Web Clipper 剪藏嘅網絡文章、要學嘅論文文獻、轉錄嘅影片文案等。佢係唔會俾人改嘅事實源頭,AI 得讀取權限。

2. 編譯輸出層 (wiki)

AI 智能體深入分析原始資料之後,生成嘅 Markdown 檔案目錄。呢度包含摘要、實體概念、對比分析等內容,同時有核心嘅索引檔案 (index.md) 同日誌檔案 (log.md)。呢啲係俾人睇嘅頁面,由 AI 全權負責寫入同維護。

3. 架構規範層 (Schema)

即係智能體工具嘅全局心智配置文件。如果你用 Claude Code,對應嘅係 CLAUDE.md 檔案;如果你用 OpenCode,對應嘅係 AGENTS.md。作用係清楚話畀智能體知具體嘅工作流程、語言協議同權限邊界。

動手實踐:整好文件夾同配置規範

為咗令知識庫運作得起,我哋需要實現三個核心操作:攝取 (ingest)、查詢 (query) 同巡檢 (lint)。喺動手寫呢三個技能之前,先嚟整好環境。

第一步:創建本地文件夾結構

喺電腦度開一個空白嘅項目文件夾,然後喺入面分別建立以下子文件夾:

raw:做原始資料收件箱。你可以喺入面建立放網頁文章、論文文獻、轉錄文本嘅子文件夾。同時一定要開一個叫做 archive 嘅歸檔文件夾。資料俾 AI 分析完之後,都會移去呢度。

wiki:用嚟放 AI 編譯出嚟嘅知識內容。喺入面創建索引檔案 index.md 同日誌檔案 log.md。然後開幾個子文件夾:concepts 放方法論,entities 放實體概念,sources 放對應原始檔案嘅摘要,syntheses 放你用 AI 深度學習積累落嚟嘅綜合內容。

assets:統一嘅媒體資源層,放圖片、PDF 同附件。記得喺 Obsidian 嘅設定入面,將附件預設儲存路徑指向呢個 assets 文件夾。

文件夾結構整好之後,用 Claude Code 直接打開呢個項目文件夾。喺 Claude Code 入面直接輸入 /init,工具就會自動生成 CLAUDE.md 配置文件同埋放自訂 Skill 嘅 .claude 文件夾。

第二步:配置架構規範 (CLAUDE.md)

我哋打開生成嘅 CLAUDE.md,將系統自動生成嘅英文內容刪走,按我哋嘅需求寫入具體嘅限制條件。呢份係普通嘅 Markdown 檔案,你要喺呢度講清楚兩點:

目錄結構同權限邊界:嚴格規定智能體只可以讀 raw 文件夾,絕對唔準改原始檔案;同埋容許佢喺 wiki 文件夾入面自由編輯同維護內容。

格式同雙向連結規範:詳細規定佢寫 index 索引檔案同 log 日誌檔案嗰陣嘅格式要求,同埋每次生成新嘅 Markdown 筆記一定要跟咩規則(例如一定要有雙向連結,唔準出現孤島頁面)。

等 AI 自己運作:三個核心 Agent Skill

我哋要喺 .claude/skills 目錄入面分別開對應嘅技能文件夾。如果你唔想手動寫長到爆嘅提示詞,可以用 Anthropic 官方代碼倉庫嘅 skill-creator 工具,向 AI 描述需求,叫佢幫你生成對應技能。

操作一:知識攝取 (ingest)

準備好你要學嘅資料(例如關於提示詞工程嘅文章同論文),放入 raw 文件夾對應嘅目錄。然後我哋創建第一個核心操作 ingest。

喺 skills 文件夾入面開一個叫 ingest 嘅文件夾,喺入面整一個新 SKILL.md 檔案。呢個技能嘅核心執行流程係:

叫智能體深入分析原始檔案,提取核心主旨、具體嘅實體同抽象概念,然後分別寫成對應嘅 Markdown 檔案放入 wiki 層。之後建立雙向連結,更新 index 索引檔案同日誌檔案。確認所有檔案處理完之後,將原始檔案移去 archive 文件夾歸檔。

配置好之後,喺智能體窗口直接輸入 /ingest 觸發工作流。AI 就會開始批量消化你啲資料,將佢哋轉化為知識圖譜入面嘅節點。

操作二:深度查詢與學習 (query)

第一步完成之後,我哋就可以向 AI 提問,對沉澱落嚟嘅知識做深度探索。我哋創建第二個技能 query。

呢個技能嘅邏輯好直接:要求 AI 回答問題之前,永遠都要先去讀 index.md 索引檔案,靠索引定位到相關內容之後,深度閲讀目標檔案,最後先畀出帶有雙鏈引用嘅回答。

呢個都係知識複利嘅關鍵:你一定要喺技能入面規定,如果 AI 生咗有價值嘅內容(例如對比表格或認知盲區分析),佢一定要主動問你要唔要將內容儲存到知識庫。只要你回覆確認,AI 就會將呢篇研究報告存到 wiki/syntheses 子文件夾入面,仲會自動幫你整好雙向連結同日誌。

你甚至可以結合外部工具,叫 AI 將呢篇深度研究直接轉做幻燈片排版代碼或架構圖。

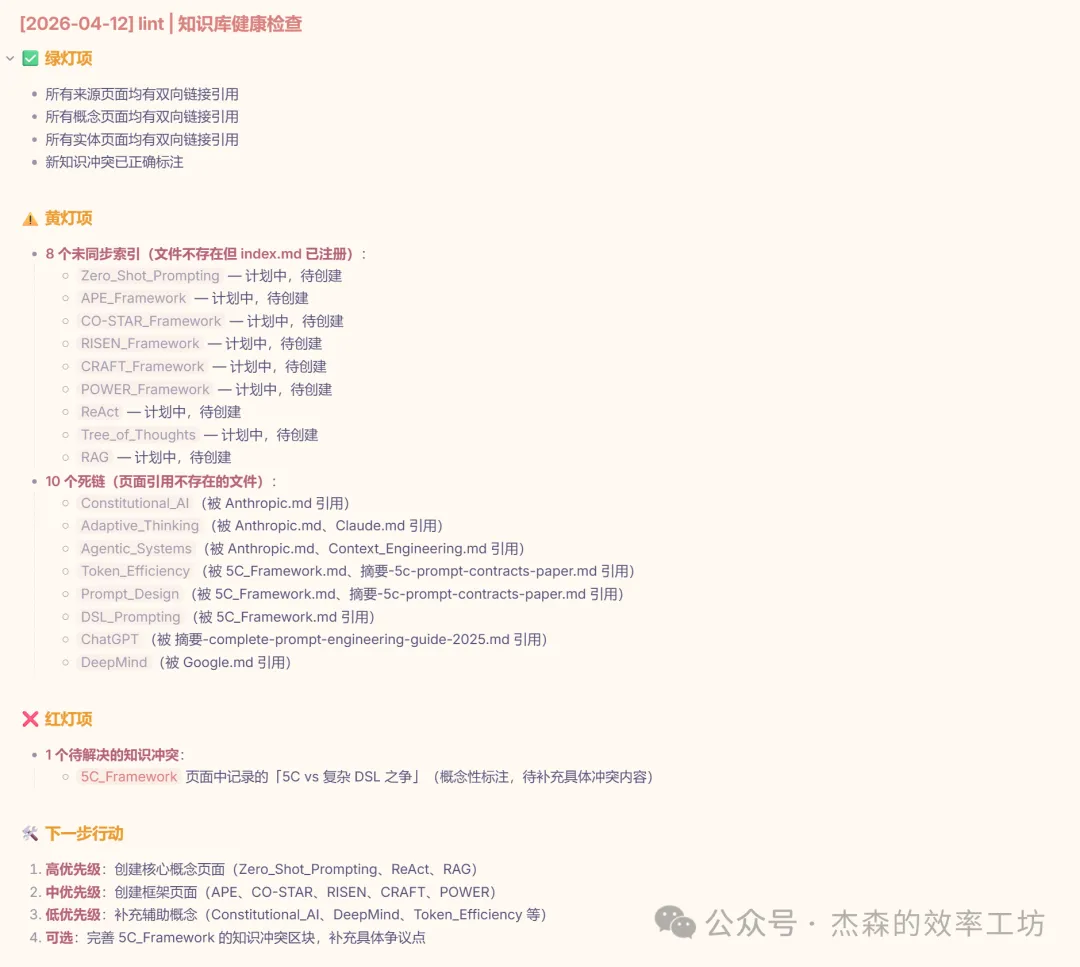

操作三:知識庫巡檢 (lint)

知識庫越嚟越大之後,一定要定期做維護同體檢,好似幫代碼做健康檢查咁。

喺 skills 文件夾入面開一個叫 lint 嘅新技能。你要喺呢個技能入面話畀智能體知:掃描成個 wiki 目錄,揾出頁面之間嘅邏輯矛盾、已經被取代嘅舊資訊、冇任何雙鏈嘅孤島頁面,同埋失效嘅死鏈。

為咗保證知識庫安全,限制入面一定要寫明:智能體只可以生成體檢報告同下一步修復計劃,一定要用戶確認先可以修改,絕對唔準佢自己偷偷改筆記。

只要輸入 /lint,智能體就會幫你生成一份完整嘅健康體檢報告,等知識圖譜保持長期乾淨同健康。

進階功能同風險提示

以上講嘅係最基本入門級嘅實現。為咗提高效率,你仲可以喺技能鏈入面整合官方嘅命令列工具(例如 obsidian-cli),叫智能體呼叫 Obsidian 原生 API 嚟檢索頁面。咁會大幅降低 Token 消耗同提升任務準確度。

實際用呢套方法論嗰陣,你一定要留意以下兩個核心風險:

極高嘅 Token 成本:智能體處理呢啲檔案嗰陣,消耗 Token 嘅速度好驚人。大規模嘅檔案讀寫,尤其係每次查詢都要將關聯檔案推到大型模型上下文,會令 API 費用急升。

AI 幻覺被固化嘅風險:呢個係呢套系統最致命嘅缺陷。由於成個 Wiki 係由 LLM 自動化編譯並互相連結,一旦大型模型喺某次處理入面產生咗幻覺(例如偽造咗某個數據),呢個錯誤就會被寫成 Markdown 永久固化喺知識庫入面。將來嘅推理都會以呢個錯誤節點做事實基礎,令偏差被無限放大。

所以,Karpathy 呢套方案暫時最適閤中小型規模(大約 40 萬字以內,100-200 篇高質素文章)嘅個人或小團隊使用。

文章入面涉及嘅所有知識筆記、測試所用嘅原始資料,同埋整好咗嘅完整知識庫文件夾,我已經打包上傳到 GitHub 倉庫(jason-effi-lab/karpathy-llm-wiki-vault),大家可以直接下載體驗。如果部署嗰陣遇到任何問題,歡迎喺留言區話畀我知。

核心理念:什麼是 LLM Wiki?

Andrej Karpathy 的 LLM Wiki 理念,核心邏輯是從即時檢索 (RAG) 轉向持續編譯 (Compilation),把知識管理當成軟件工程來做。

簡單來說,就是把你平時要學習的資料和文章,通過 AI 智能體(比如 Claude Code,OpenCode,OpenClaw)轉換成 Wiki 形式的 Markdown 筆記庫。最好的承接工具就是 Obsidian。在編譯後的筆記庫中,你利用 AI 進行持續的學習與探索。每次學習總結出的重要內容會被再次存入知識庫,實現知識複利。同時 AI 也會定期對筆記庫進行體檢,保持系統健康。

下面是傳統 RAG 和 LLM Wiki 理念的具體差異對比:

如果你覺得不好理解,記住這個比喻:Obsidian 就是 IDE 代碼編輯器,LLM 是程序員,Wiki 是代碼庫。人類只負責決策和提供素材,AI 接管所有繁瑣的節點編織工作。

知識庫的三層架構

Karpathy 的理念建立在嚴格的三層架構之上。

1. 原始資料層 (raw)

這裏存放平時收集或策劃的文檔集合。比如通過 Obsidian Web Clipper 剪藏的網絡文章、要學習的論文文獻、轉錄的視頻文案等。它是不被修改的事實之源,AI 只有讀取權限。

2. 編譯輸出層 (wiki)

AI 智能體對原始資料進行深入分析後,生成的 Markdown 文件目錄。這裏包含摘要、實體概念、對比分析等內容,同時包含核心的索引文件 (index.md) 和日誌文件 (log.md)。它是供人類閲讀的頁面,由 AI 全權負責寫入和維護。

3. 架構規範層 (Schema)

也就是智能體工具的全局心智配置文件。如果你使用 Claude Code,對應的就是 CLAUDE.md 文件;如果你使用 OpenCode,對應的就是 AGENTS.md。作用是明確告訴智能體具體的工作流程、語言協議和權限邊界。

動手實踐:搭建文件夾與配置規範

為了讓知識庫運轉起來,我們需要實現三個核心操作:攝取 (ingest)、查詢 (query) 和巡檢 (lint)。在動手寫這三個技能之前,先來搭建環境。

第一步:創建本地文件夾結構

在電腦端創建一個空白的項目文件夾,然後在裏面分別建立以下子文件夾:

raw:作為原始資料收件箱。你可以在裏面建立存放網頁文章、論文文獻、轉錄文本的子文件夾。同時務必創建一個叫做 archive 的歸檔文件夾。資料被 AI 分析完畢後,都會移動到這裏。

wiki:用來存放 AI 編譯出的知識內容。在裏面創建索引文件 index.md 和日誌文件 log.md。接着新建幾個子文件夾:concepts 存放方法論,entities 存放實體概念,sources 存放對應原始文件的摘要,syntheses 存放你用 AI 進行深度學習後積累的綜合內容。

assets:統一的媒體資源層,存放圖片、PDF 和附件。記得在 Obsidian 的設置中,把附件的默認保存路徑設置到這個 assets 文件夾。

文件夾結構創建完成後,用 Claude Code 直接打開這個項目文件夾。在 Claude Code 中直接輸入 /init,工具就會自動生成 CLAUDE.md 配置文件以及存放自定義 Skill 的 .claude 文件夾。

第二步:配置架構規範 (CLAUDE.md)

我們打開生成的 CLAUDE.md,把系統自動生成的英文內容刪掉,按照我們的需求寫入具體的約束條件。這是一份普通的 Markdown 文件,你需要在這裏明確兩點:

目錄結構與權限邊界:嚴厲規定智能體只能讀取 raw 文件夾,絕對禁止修改原始文件;並且允許它在 wiki 文件夾中自由編輯和維護內容。

格式與雙向連結規範:詳細規定它在寫入 index 索引文件和 log 日誌文件時的格式要求,以及每次生成新的 Markdown 筆記時,必須遵循什麼規則(例如必須包含雙向連結,絕不能產生孤島頁面)。

讓 AI 自動運轉:三個核心 Agent Skill

我們需要在 .claude/skills 目錄中分別創建對應的技能文件夾。如果你不想手動寫冗長的提示詞,可以使用 Anthropic 官方代碼倉庫裏的 skill-creator 工具,向 AI 描述需求,讓它幫你生成對應技能。

操作一:知識攝取 (ingest)

準備好你要學習的資料(比如關於提示詞工程的文章和論文),放入 raw 文件夾下對應的目錄中。接着我們創建第一個核心操作 ingest。

在 skills 文件夾裏創建一個叫 ingest 的文件夾,在裏面新建 SKILL.md 文件。這個技能的核心執行流程是:

讓智能體深入分析原始文件,提取核心主旨、具體的實體和抽象概念,並把它們分別撰寫成對應的 Markdown 文件放入 wiki 層中。接着建立雙向連結,更新 index 索引文件和 log 日誌文件。確認所有文件處理完畢後,把原始文件移動到 archive 文件夾歸檔。

配置好之後,在智能體窗口中直接輸入 /ingest 觸發工作流。AI 會開始批量消化你的資料,把它們轉化為知識圖譜中的節點。

操作二:深度查詢與學習 (query)

第一步完成後,我們就可以向 AI 提問,對沉澱下的知識做深度探索了。我們創建第二個技能 query。

這個技能的邏輯非常直接:要求 AI 在回答問題之前,永遠都要先去讀取 index.md 索引文件,靠索引定位到相關內容後,深度閲讀目標文件,最後再給出帶有雙鏈引用的回答。

這也是知識複利的關鍵所在:你必須在技能裏規定,如果 AI 生成了高價值的內容(比如對比表格或認知盲區分析),它必須主動詢問你是否要把內容保存到知識庫。只要你回覆確認,AI 就會把這篇研究報告保存到 wiki/syntheses 子文件夾內,並自動為你編織好雙向連結和更新日誌。

你甚至可以結合外部工具,讓 AI 把這篇深度研究直接轉化為幻燈片排版代碼或者架構圖。

操作三:知識庫巡檢 (lint)

知識庫越來越龐大後,必須定期進行維護和體檢,就像給代碼做健康檢查一樣。

在 skills 文件夾內創建一個名為 lint 的新技能。你需要在這個技能裏告訴智能體:掃描整個 wiki 目錄,找出頁面之間的邏輯矛盾、已經被取代的老舊信息、沒有任何雙鏈的孤島頁面,以及失效的死鏈。

為保證知識庫的安全性,約束裏必須寫明:智能體只能生成體檢報告和下一步修復計劃,只有在用戶確認後才可以進行修改,絕對不允許它自行偷偷篡改筆記。

只要輸入 /lint,智能體就會為你生成一份完整的健康體檢報告,讓知識圖譜保持長期的乾淨與健康。

進階功能與風險提示

上面講到的是最基礎入門級的實現。為了提高效率,你還可以在技能鏈裏集成官方的命令行工具(比如 obsidian-cli),讓智能體調用 Obsidian 原生 API 來檢索頁面。這會大幅度降低 Token 的消耗並提升任務準確度。

在實際使用這套方法論時,你必須留意以下兩個核心風險:

極高的 Token 成本:智能體在處理這些文件時消耗 Token 的速度非常驚人。大規模的文件讀寫,特別是每次查詢都要把關聯的文件推入大模型上下文,會導致 API 費用猛增。

AI 幻覺被固化的風險:這是這套系統最致命的缺陷。由於整個 Wiki 由 LLM 自動化編譯並相互連結,一旦大模型在某次處理中產生了幻覺(比如偽造了某個數據),這個錯誤就會被寫成 Markdown 永久固化在知識庫中。未來的推理都會以這個錯誤的節點為事實基石,導致偏差被無限放大。

因此,Karpathy 的這套方案目前最適合中小型規模(大約 40 萬字以內,100-200 篇高質量文章)的個人或小團隊使用。

文章涉及的所有知識筆記、測試所用的原始資料,以及搭建好的完整知識庫文件夾,我已經打包上傳到了 GitHub 倉庫(jason-effi-lab/karpathy-llm-wiki-vault),大家可以直接下載體驗。如果在部署時遇到任何問題,歡迎在評論區給我留言。