瘋了……Claude 最強風控:驗你實名身份證!

整理版優先睇

Anthropic 引入身份驗證,AI 使用分化加劇:從「付唔付得起」到「有冇資格用」

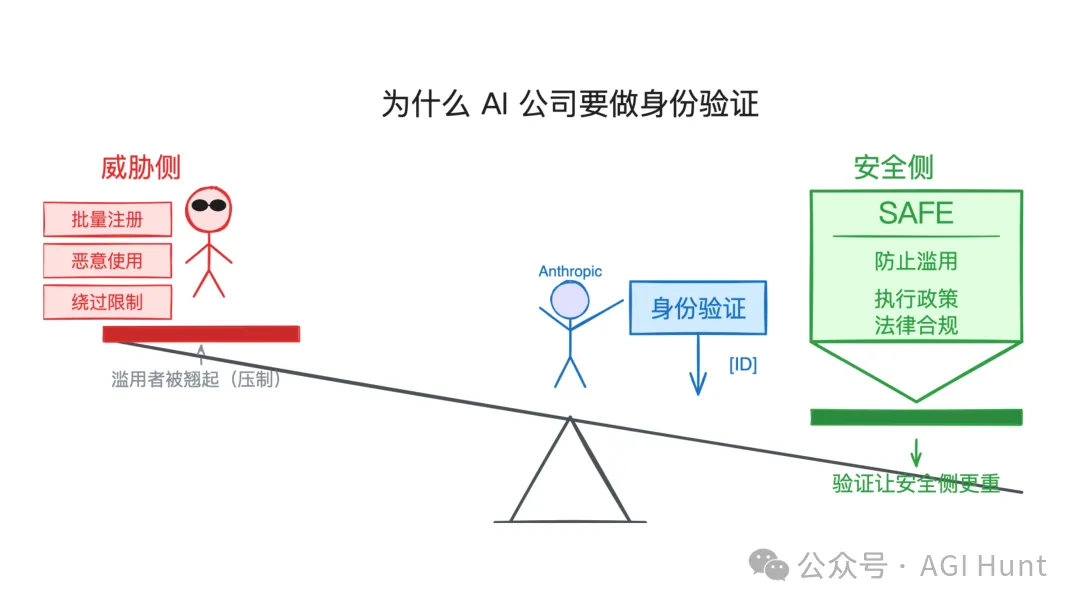

呢篇文章係關於 Anthropic 正式喺 Claude 平台推出身份驗證機制,要求用戶喺使用某啲功能時提交政府簽發嘅身份證件。作者整理自 Anthropic 嘅官方公告同相關報導,背景係AI 濫用風險增加,公司需要合規同執行政策。佢指出呢個機制嘅實際影響唔止係安全,而係加速咗AI 用戶嘅階層分化——以前係用唔用得起,而家係有冇資格用。

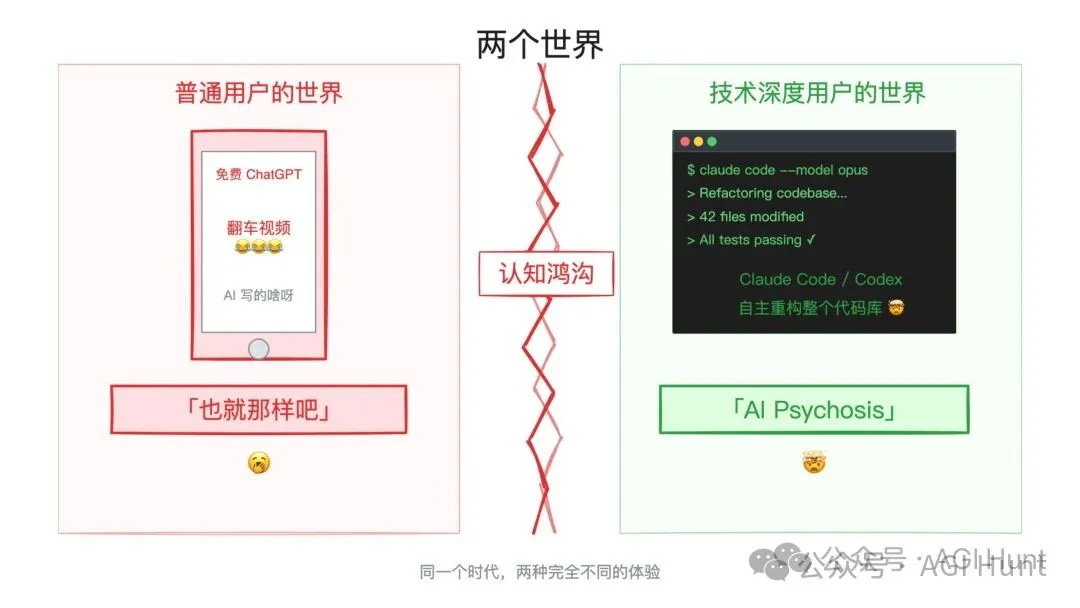

作者引用咗Karpathy 嘅「AI 精神衝擊」概念,對比免費用戶同深度用戶嘅認知鴻溝;仲提到 OpenAI 早前推出嘅「組織驗證」,主要針對 API 開發者。兩者方向一致,但 Anthropic 嘅驗證範圍似乎更廣,涵蓋產品端功能。作者認為,呢個趨勢會令AI 使用出現兩重分化:一重係人與人之間(努力可以跨越),另一重係廠商控制(冇得自己話事)。

最後,作者預測驗證範圍只會越來越廣,甚至可能出現「有錢都買唔到」嘅情況。但佢都幽默咁提一句:「上有政策下有對策」,最高興嘅可能係賣鏟嘅中間商。總括嚟講,文章提醒讀者要留意AI 使用門檻嘅結構性轉變。

- Anthropic 喺 Claude 引入身份驗證,要求出示政府簽發身份證先用到某啲功能,背後係防止濫用同合規。

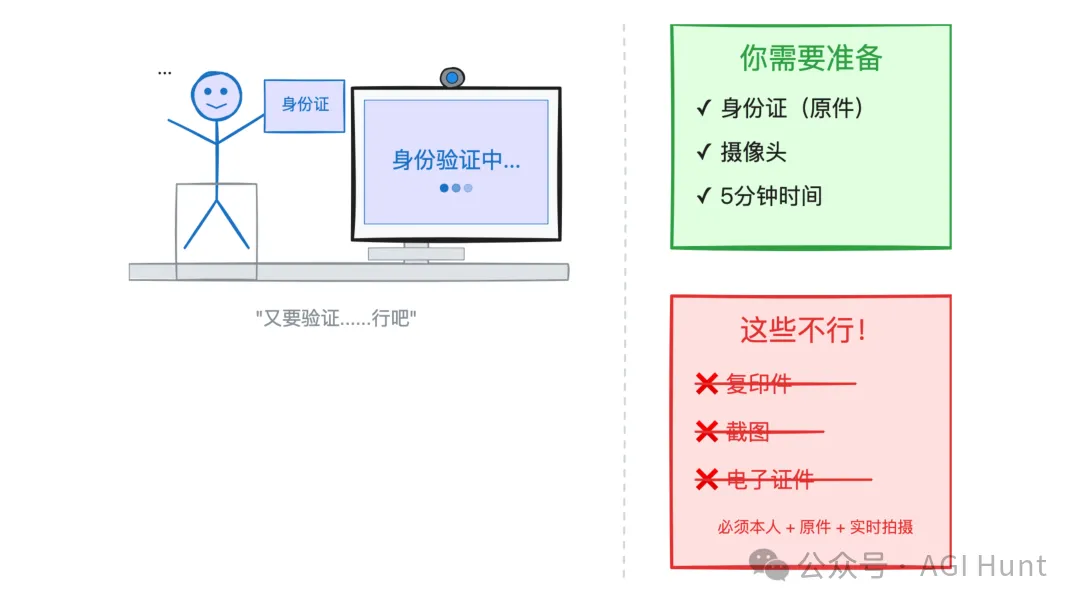

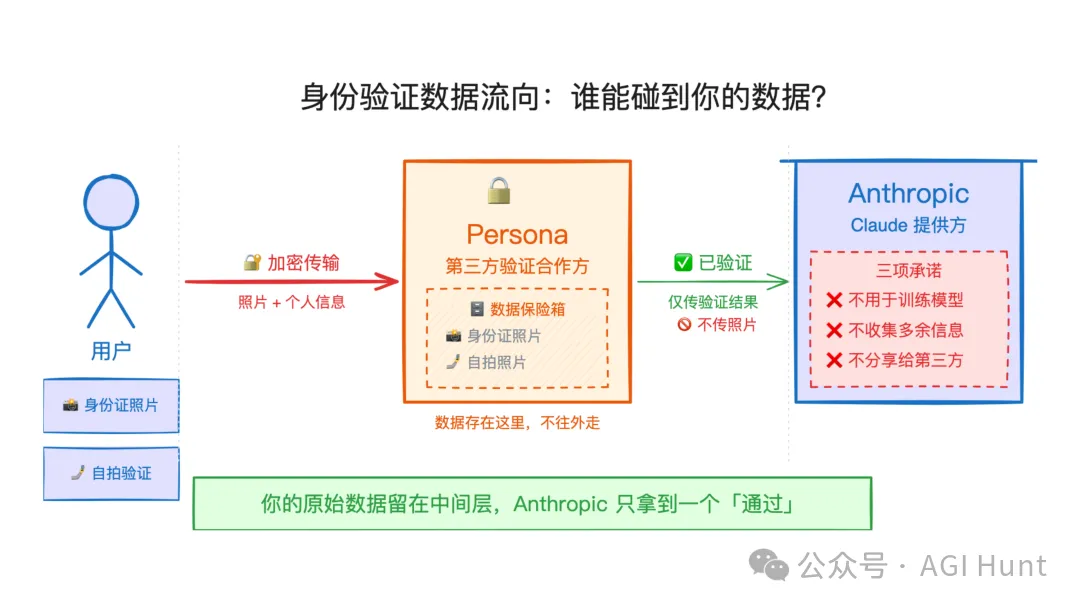

- 驗證流程簡單:實體證件 + 有鏡頭裝置 + 大約五分鐘;由第三方公司 Persona 處理數據,Anthropic 唔會儲存或攞嚟訓練模型。

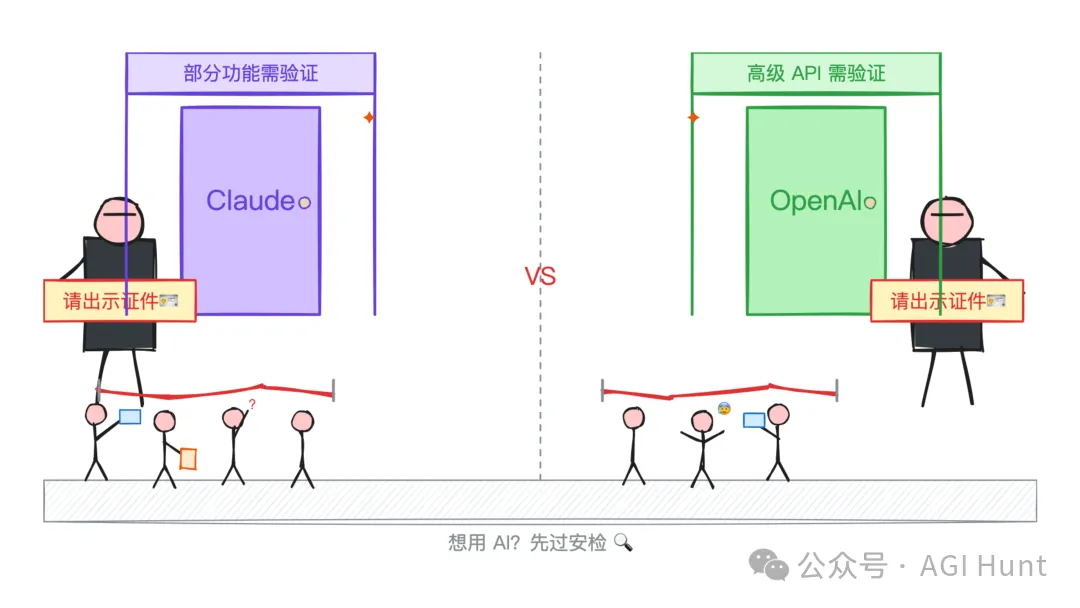

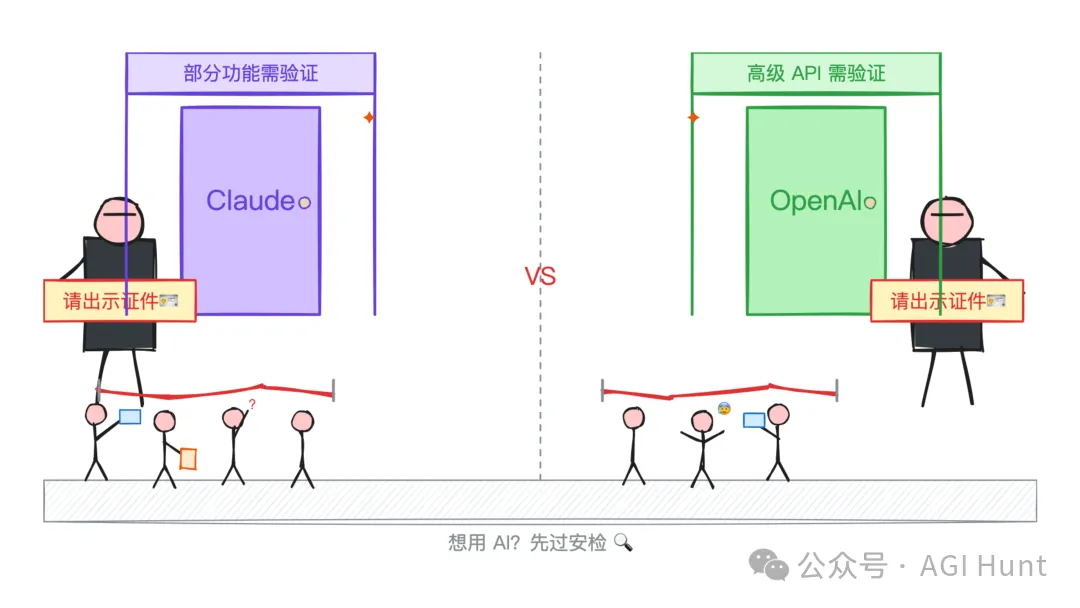

- OpenAI 都喺 2025 年 4 月推出類似機制,但主要針對 API 開發者;Anthropic 嘅覆蓋更闊,包括產品端功能。

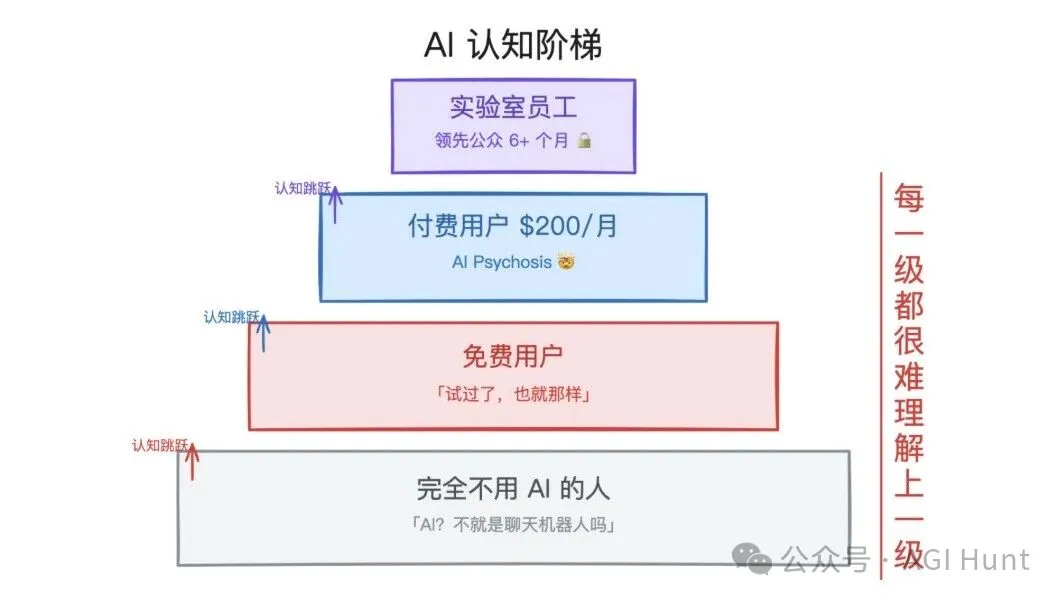

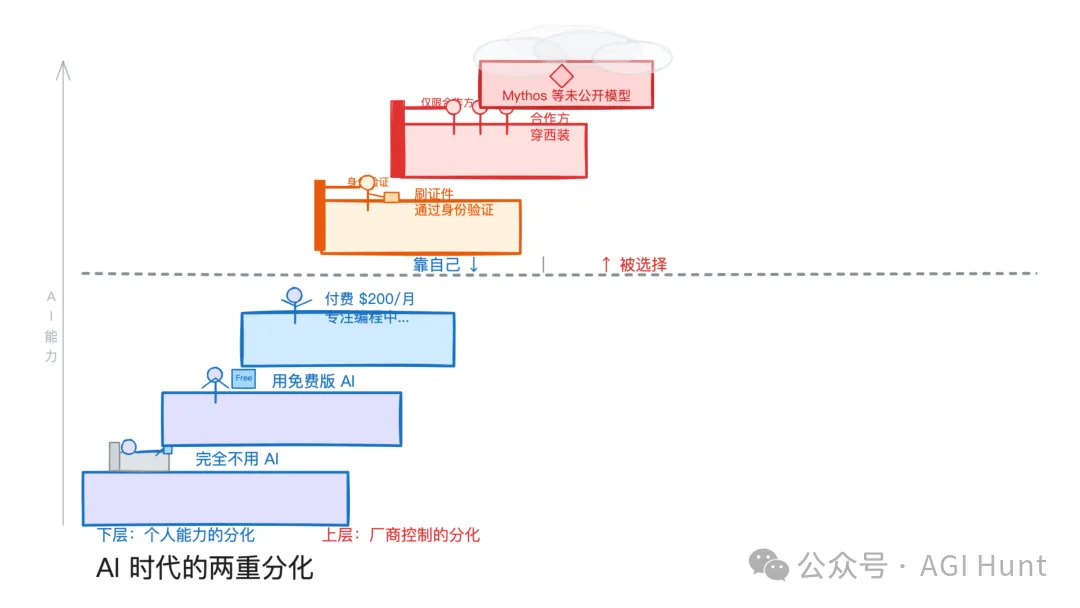

- 文章引用 Karpathy 嘅觀點,指出 AI 使用正出現「兩重分化」:人與人之間嘅認知差距,同廠商主動製造嘅資格限制。

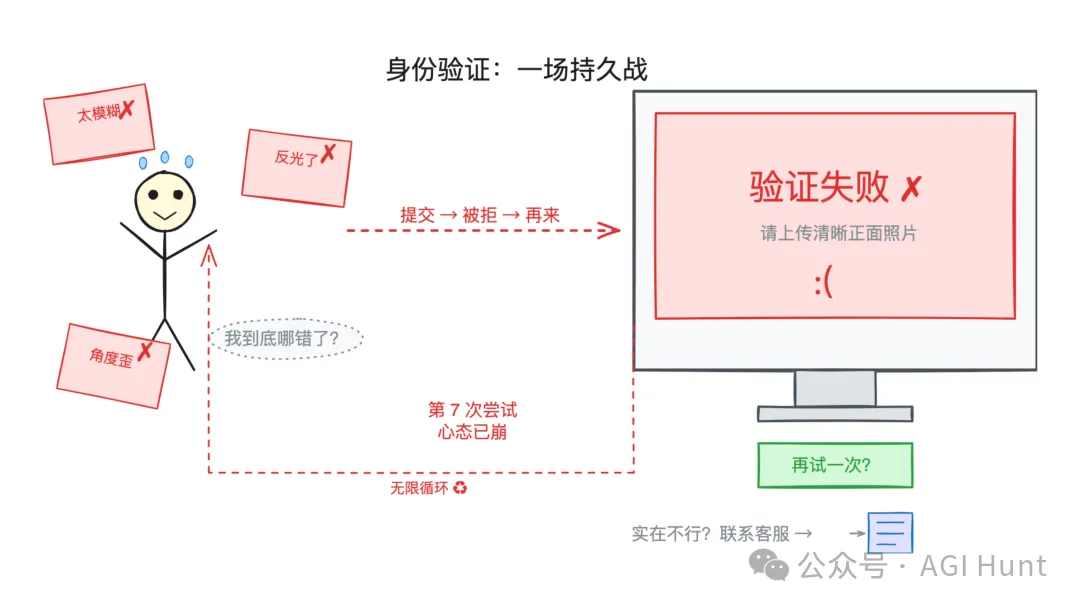

- 建議驗證失敗可以影清楚啲再試,真係搞唔掂就聯絡支援;同時要留意使用政策,避免因地區或違規被封號。

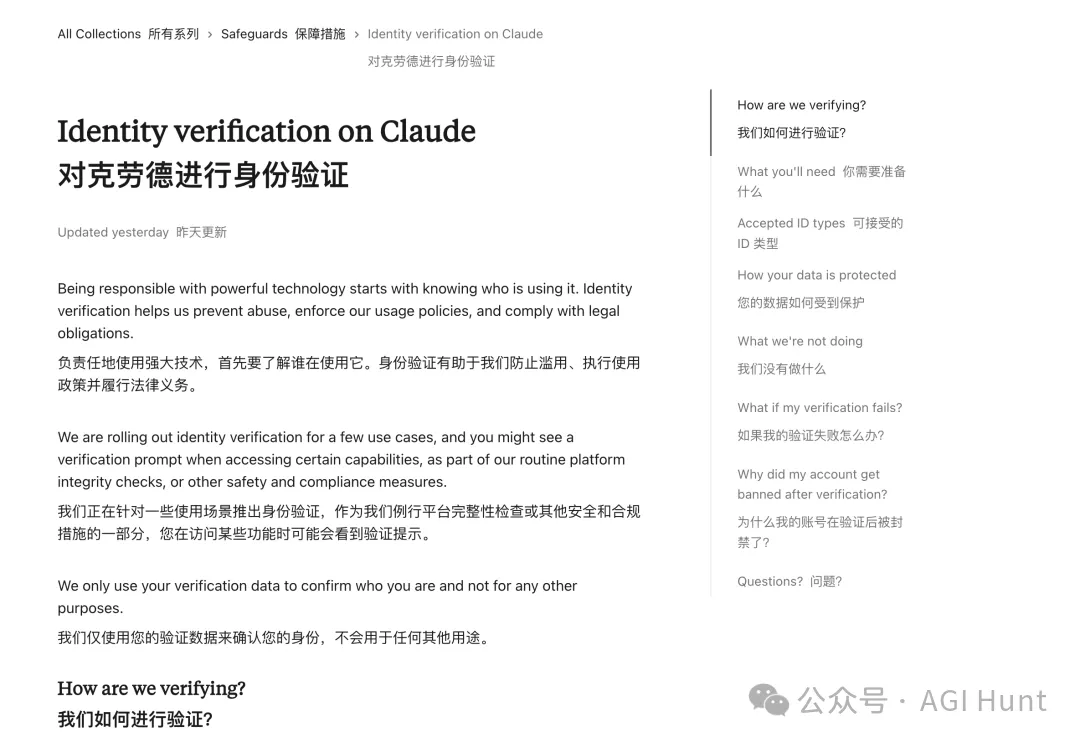

Anthropic 身份驗證官方說明

Claude 平台身份驗證嘅官方支援文檔,詳細講解點解要驗、點樣驗、數據點處理。

OpenAI 組織驗證說明

OpenAI 對 API 開發者嘅驗證機制,要求政府證件先用到最新模型。

突然就要驗身份

Anthropic 日前更新咗支援文檔,宣佈喺 Claude 平台引入身份驗證機制。簡單講,你想用某啲功能,就要先掏身份證出嚟影相。

唔係所有人都會被要求驗證,至少而家仲未,只係喺訪問特定功能或者常規安全檢查時先會彈出提示。

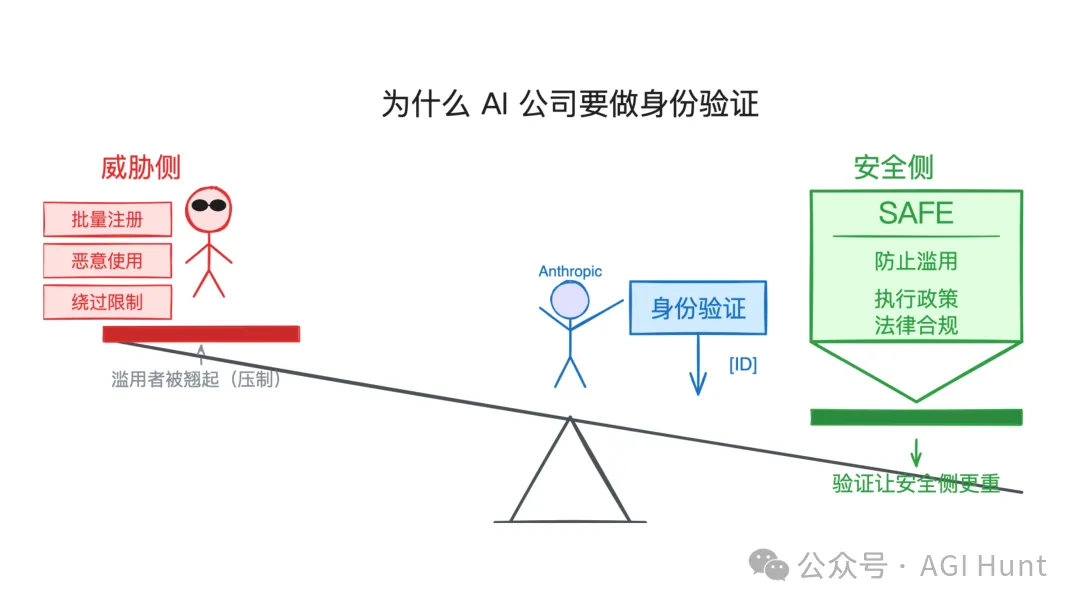

官方理由係「負責任咁用強大技術,要先知道邊個喺度用」。具體目的有三個:防止濫用、執行使用政策、履行法律義務。

點樣驗?要準備乜?

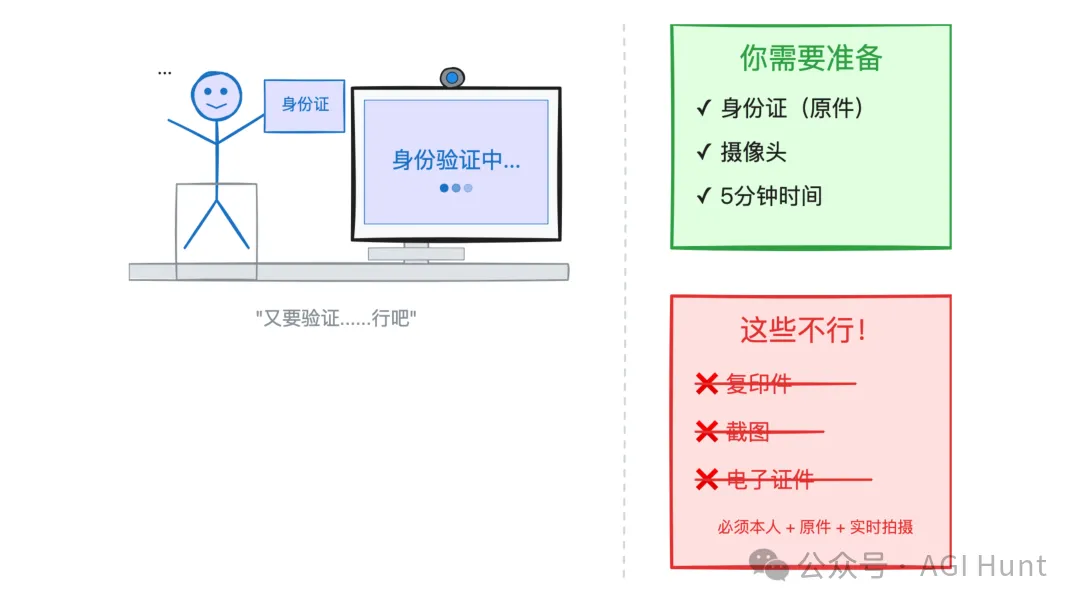

- 一張有效嘅政府簽發身份證件(實體,紙質或卡片都得)

- 一部帶鏡頭嘅裝置(手機或電腦)

- 大約五分鐘時間

接受護照、駕照、國民身份證等,但唔接受複印件、截圖、電子身份證、學生證或臨時紙質證件。

你得揸住張實實在在嘅卡,對住鏡頭影低佢。

數據點處理?邊個睇到?

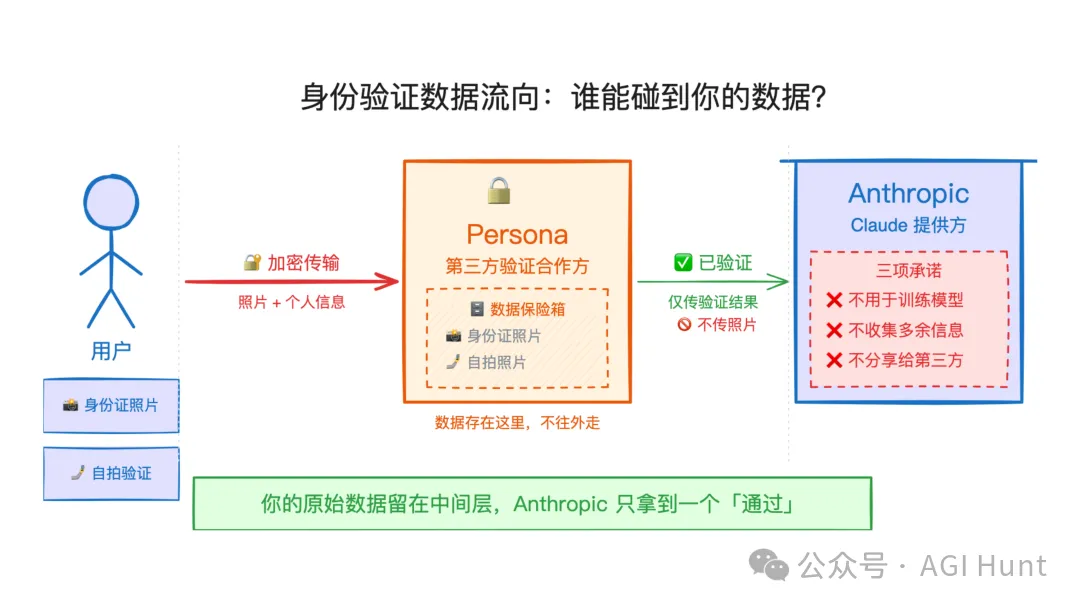

Anthropic 揀咗一間叫 Persona Identities 嘅公司做驗證合作夥伴,話佢技術掂、隱私控制好。

Anthropic 強調唔會用驗證數據訓練 AI,唔會收集唔必要資訊,除非法律要求唔會分享俾第三方。

聽落算剋制,但將身份證交俾一間 AI 公司,本身就夠令人糾結。

OpenAI 都係咁做

Anthropic 唔係第一個咁做嘅。OpenAI 喺 2025 年 4 月已經推出「Verified Organization」機制,開發者要用政府身份證先解鎖 API 最高級模型。

OpenAI 嘅限制仲緊啲:一張身份證每 90 日只能驗證一個組織,唔係個個組織都有資格。

不過 OpenAI 主要針對 API 開發者,普通用戶暫時冇影響。而 Anthropic 嘅驗證覆蓋產品端功能,範圍更闊。

分化加速,門檻升級

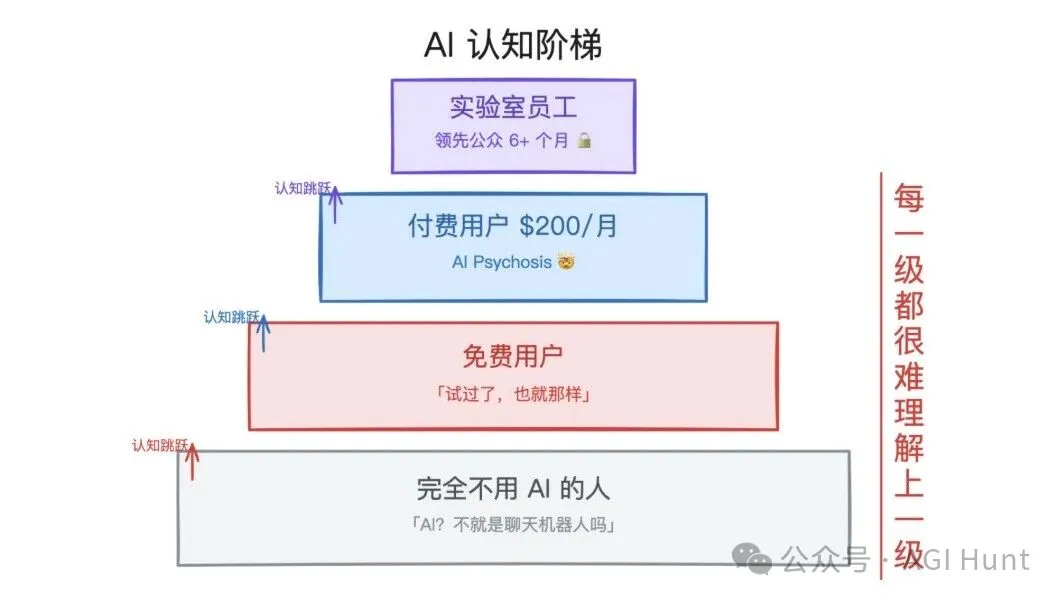

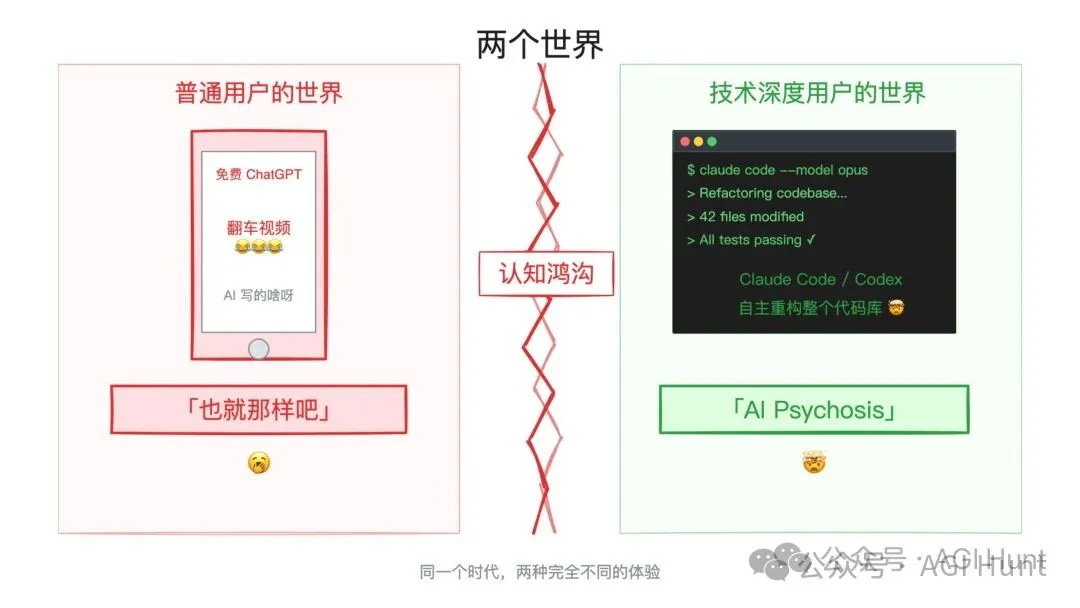

作者引用 Karpathy 嘅分析,指 AI 用戶已經分成兩批:一批試過免費版覺得「唔外如是」,另一批每月科 200 美金體驗緊「AI 精神衝擊」。

而家身份驗證呢件事,會令條分化裂縫更深。

早前 Anthropic 出 Mythos 模型,話因為網絡攻防能力太強,只開放俾十幾間核心夥伴。呢個趨勢已經喺度發生。

接下來點樣?

Anthropic 現時話身份驗證只喺部分功能觸發,但隨住模型能力越來越強,驗證範圍只會擴闊。OpenAI 行過嘅路,Anthropic 好大機會跟,Google 都唔會缺席。

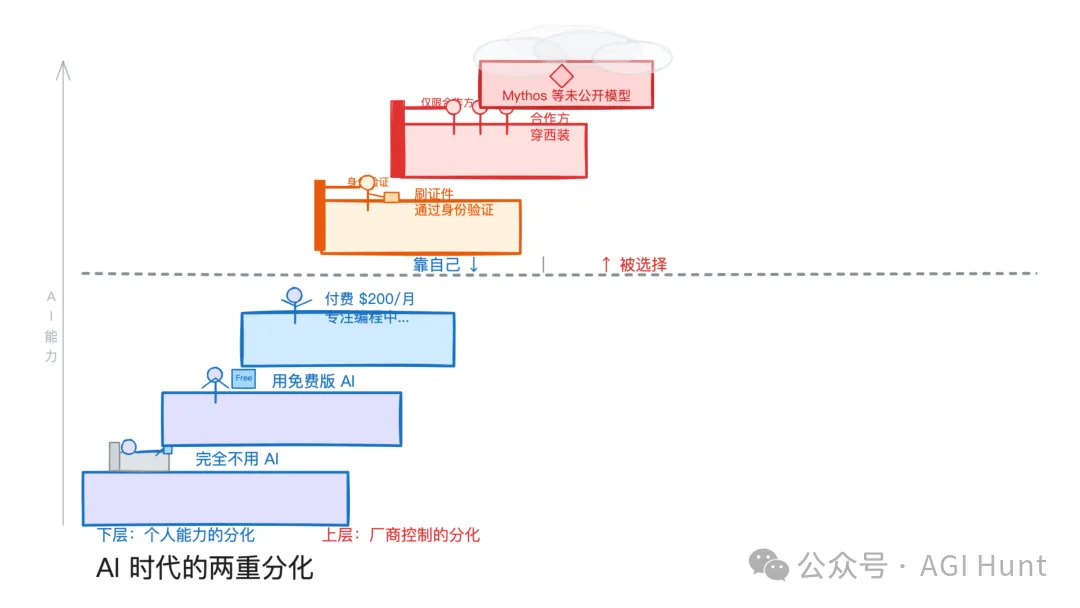

- 第一重分化:人與人之間——你用邊個模型、點用、用幾耐,決定你嘅認知層次;呢個仲可以靠自己努力跨越。

- 第二重分化:廠商控制——佢哋透過驗證、審核、定價、選擇性發佈,決定你企喺邊一層;呢個你冇得話事。

不過,「上有政策下有對策」,最高興嘅莫過於賣鏟嘅中間商。

呢次真係大鑊……想用 Claude 仲難過登天。

Anthropic 琴日更新咗一篇支援文檔,宣佈喺 Claude 平台引入身份驗證機制。

簡單講就係:你想用某啲功能,就要拎身份證出嚟。

點解要驗證

Anthropic 畀嘅所謂理由係:要負責任咁用強大嘅技術,首先要知係邊個在用。

身份驗證有三個目的:防止濫用、執行使用政策、履行法律義務。

目前呢個驗證機制仲喺逐步推出階段,只有當你訪問某啲特定功能,或者平台做常規安全合規檢查嘅時候,先會見到驗證提示。

換句話講,唔係所有人都會被要求驗證,至少而家仲未係。

要準備啲乜

驗證本身其實唔複雜,你需要三樣嘢:

• 一張有效嘅政府簽發嘅有相身份證件(實體嘅,紙質或者卡式)

• 一部有鏡頭嘅裝置(手機或者電腦都得)

• 大概五分鐘嘅時間

接受嘅證件類型包括護照、駕駛執照、州/省級身份證、國民身份證,基本上大多數國家嘅政府證件都得。

但有幾樣嘢係唔接受嘅: 影印本、截圖、電子/數碼身份證、非政府證件(學生證、公司證之類嘅),仲有臨時紙質證件。

即係話,你要攞住張實實在在嘅卡,對住鏡頭影低佢。

邊個嚟驗證

呢個大概係大家最關心嘅部分。

Anthropic 揀咗一間叫 Persona Identities 嘅公司做驗證合作夥伴。揀佢嘅原因係技術能力、私隱控制同安全保障。

數據流向係噉樣:Anthropic 係數據控制方,Persona 負責處理。你嘅身份證相同自拍照存在 Persona 嗰度,唔會儲存喺 Anthropic 嘅系統上。

而且 Persona 喺合約層面被限制咗數據用途,所有數據傳輸都有加密保護。

Anthropic 仲特登強調咗幾樣佢哋「唔會做」嘅事:

• 唔會用驗證數據去訓練 AI 模型

• 唔會收集不必要嘅信息

• 除非法律要求,唔會將身份數據分享畀第三方

聽落……都算剋制?但係將身份證交畀一間 AI 公司,呢件事本身就夠令人糾結㗎喇。

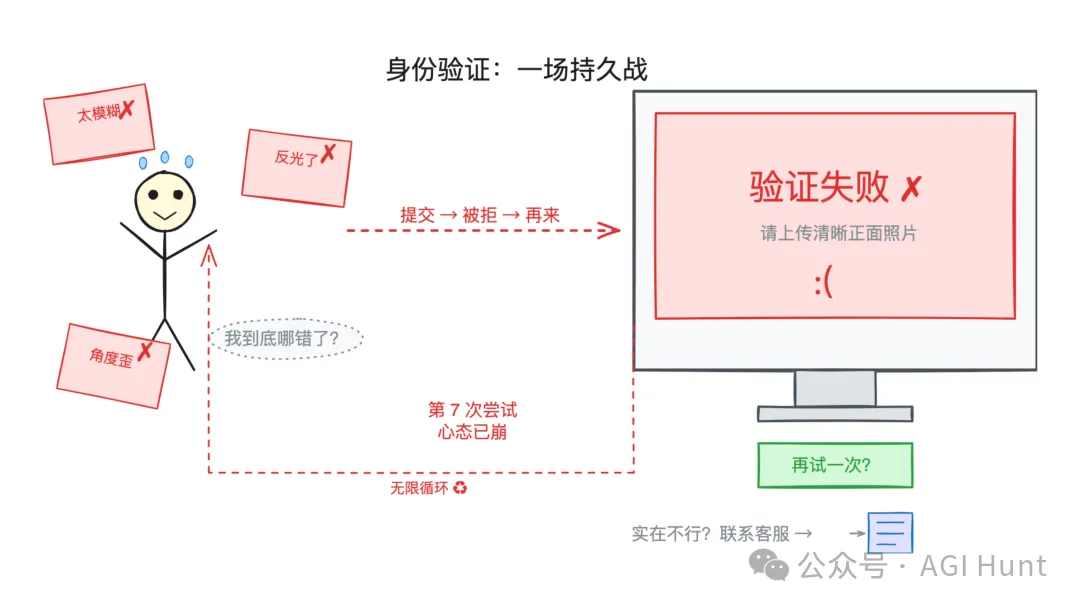

驗證失敗點算

如果驗證唔通過,可以試多幾次。Anthropic 建議檢查嚇證件嘅拍攝質素,確保光線充足、冇反光、信息清晰可讀。

真係搞唔掂嘅話,可以經官方表單聯絡支援團隊。

仲有一種更差嘅情況……帳號被封。可能嘅原因包括違反使用政策、喺唔支援嘅地區創建帳號、違反服務條款、或者未成年使用。封咗都可以經官方表單申訴。

OpenAI 都係噉

其實 Anthropic 唔係第一個咁做嘅。

早在 2025 年 4 月,OpenAI 就推出咗「Verified Organization」(組織驗證)機制。開發者想解鎖 API 平台上最先進嘅模型同功能,要用政府簽發嘅身份證件完成驗證。

而且限制仲幾嚴格:一張身份證每 90 日只可以驗證一個組織,唔係所有組織都有資格通過驗證。

OpenAI 當時畀嘅理由都差唔多:防止 AI 產品被濫用。

“ 我哋正增加驗證流程,以減少 AI 嘅不安全使用,同時繼續讓更廣泛嘅開發者社區能夠使用先進模型。

不過 OpenAI 嘅驗證目前主要針對 API 開發者,普通用戶暫時未受影響。而 Anthropic 呢邊,驗證嘅觸發範圍似乎更廣啲,涵蓋咗 Claude 產品端嘅某啲功能。

兩間頭部 AI 公司,先後喺同一件事上落手。

分化加速

講到呢度,其實可以睇遠啲。

我之前寫過一篇文章講 AI 時代嘅人羣分化。Karpathy 將人分成兩批:一批人舊年試咗下免費版 ChatGPT,覺得 AI 都係噉;另一批人每月畀 200 美元訂閲最前沿嘅模型,正經歷「AI 精神衝擊」。

而家,身份驗證呢件事,可能會令呢條分化嘅裂縫變得更加深。

之前嘅分化,主要係人與人之間嘅:你願唔願意畀錢、你識唔識用、你用喺乜嘢領域。呢啲差距雖然大,但至少理論上,邊個都可以跨過去。

但係而家多咗一種新嘅分化,係模型廠商主動製造嘅。

佢哋嚟決定邊個用得,邊個用唔得。通過身份驗證、通過地區限制、通過價格門檻,甚至通過唔公開發布模型。

仲記得 Anthropic 發布 Mythos 件事嗎?嗰個係 Claude 有史以來第一個唔公開發布嘅旗艦模型,只係向十幾間核心合作方開放。原因係模型喺網絡攻防上嘅能力已經強到,Anthropic 覺得唔可以畀所有人都用到佢。

由「你畀唔畀得起錢」到「你有冇資格用」,呢個轉變……其實已經發生緊。

07跟住點

Anthropic 而家話,身份驗證只喺部分功能上觸發。

但可以預見,隨住模型能力越來越強,驗證嘅範圍只會越來越廣。OpenAI 行過嘅路,Anthropic 大機會都會行一次。Google 應該都唔會缺席好耐。

AI 時代,使用 AI 嘅人正經歷兩重分化:

一重係人與人之間嘅。 你用咩模型、點樣用、用幾耐,決定咗你對 AI 嘅認知喺邊一層。

另一重係模型廠商嚟控制嘅。 佢哋通過驗證、審核、定價、選擇性發布,嚟決定邊個企喺邊一層。

第一重分化,你仲可以靠自己努力去跨越。

第二重分化,就唔一定喇。

不過,上有政策下有對策……

呢件事最開心嘅,莫過於嗰啲中間商賣鏟嘅人。

◇ ◆ ◇

相關連結:

Anthropic 官方說明:https://support.claude.com/en/articles/14328960-identity-verification-on-claude

OpenAI 組織驗證:https://help.openai.com/en/articles/10910291-api-organization-verification

這下好了,想用上 Claude 更難了。

Anthropic 昨天更新了一篇支持文檔,宣佈在 Claude 平台上引入身份驗證機制。

簡單來說就是:你想用某些功能,得先掏身份證。

為什麼要驗

Anthropic 給出的所謂理由是:負責任地使用強大技術,得先知道誰在用它。

身份驗證的目的有三個:防止濫用、執行使用政策、履行法律義務。

目前這個驗證機制還在逐步推出階段,只有在訪問某些特定功能,或者平台進行常規安全合規檢查時,你才會碰到驗證提示。

換句話說,不是所有人都會被要求驗證,至少現在還不是。

要準備什麼

驗證本身其實不復雜,你需要三樣東西:

• 一張有效的政府簽發的帶照片身份證件(實體的,紙質或卡片)

• 一台帶攝像頭的設備(手機或電腦都行)

• 大概五分鐘的時間

接受的證件類型包括護照、駕照、州/省級身份證、國民身份證,基本上大多數國家的政府證件都可以。

但有幾樣東西是不接受的: 複印件、截圖、電子/數字身份證、非政府證件(學生證、工牌之類的),還有臨時紙質證件。

也就是說,你得拿着那張實實在在的卡片,對着攝像頭拍一下。

誰來驗證

這大概是,大家最關心的部分了。

Anthropic 選了一家叫 Persona Identities 的公司來做驗證合作方。選它的理由是技術能力、隱私控制和安全保障。

數據流向是這樣的:Anthropic 是數據控制方,Persona 負責處理。你的身份證照片和自拍照存在 Persona 那裏,不會存儲在 Anthropic 的系統上。

而且 Persona 在合同層面被限制了數據用途,所有數據傳輸都有加密保護。

Anthropic 還特意強調了幾件他們「不會做」的事:

• 不會拿驗證數據去訓練 AI 模型

• 不會收集不必要的信息

• 除非法律要求,不會把身份數據分享給第三方

聽起來……還算剋制?但把身份證交給一家 AI 公司,這件事本身就夠讓人糾結的了。

驗證失敗怎麼辦

如果驗證沒通過,可以多試幾次。Anthropic 建議檢查一下證件的拍攝質量,確保光線充足、沒有反光、信息清晰可讀。

實在搞不定的話,可以通過官方表單聯繫支持團隊。

還有一種更糟的情況……賬號被封。可能的原因包括違反使用政策、從不支持的地區創建賬號、違反服務條款、或者未成年使用。被封了也可以通過官方表單申訴。

OpenAI 也這樣

其實 Anthropic 並不是第一個這麼幹的。

早在 2025 年 4 月,OpenAI 就推出了「Verified Organization」(組織驗證)機制。開發者想要解鎖 API 平台上最先進的模型和功能,需要用政府簽發的身份證件完成驗證。

而且限制還挺嚴格的:一張身份證每 90 天只能驗證一個組織,並非所有組織都有資格通過驗證。

OpenAI 當時給出的理由也差不多:防止 AI 產品被濫用。

“ 我們正在增加驗證流程,以減少 AI 的不安全使用,同時繼續讓更廣泛的開發者社區能夠使用先進模型。

不過 OpenAI 的驗證目前主要針對的是 API 開發者,普通用戶暫時沒受影響。而 Anthropic 這邊,驗證的觸發範圍似乎更廣一些,涵蓋了 Claude 產品端的某些功能。

兩家頭部 AI 公司,先後在同一件事上下了手。

分化加速

說到這裏,其實可以往遠一點看。

我之前寫過一篇文章聊 AI 時代的人羣分化。Karpathy 把人分成了兩撥:一撥人去年試了下免費版 ChatGPT,覺得 AI 也就那樣;另一撥人每月花 200 美元訂閲最前沿的模型,正在經歷「AI 精神衝擊」。

而現在,身份驗證這件事,可能會讓這條分化的裂縫變得更深。

之前的分化,主要是人與人之間的:你願不願意花錢、你會不會用、你在什麼領域用。這些差距雖然大,但至少理論上,誰都可以跨過去。

但現在多了一種新的分化,是模型廠商主動製造的。

他們來決定誰能用,誰不能用。通過身份驗證、通過地區限制、通過價格門檻,甚至通過不公開發布模型。

還記得 Anthropic 發佈 Mythos 的事嗎?那是 Claude 有史以來第一個不公開發布的旗艦模型,只面向十幾家核心合作方開放。原因是模型在網絡攻防上的能力已經強到,Anthropic 覺得不能讓所有人都用到它。

從「你付不付得起錢」到「你有沒有資格用」,這個轉變……其實已經在發生了。

07接下來呢

Anthropic 目前說的是,身份驗證只在部分功能上觸發。

但可以預見的是,隨着模型能力越來越強,驗證的範圍只會越來越廣。OpenAI 走過的路,Anthropic 大概率也會走一遍。Google 應該也不會缺席太久。

AI 時代,使用 AI 的人們正在經歷兩重分化:

一重是人之間的。 你用什麼模型、怎麼用、用多久,決定了你對 AI 的認知處在哪一層。

另一重是模型廠商來控制的。 他們通過驗證、審核、定價、選擇性發布,來決定誰能站在哪一層。

第一重分化,你還能靠自己的努力去跨越。

第二重分化,就不一定了。

不過,上有政策下有對策……

這事最高興的,莫過於那些中間商賣鏟子的人了。

◇ ◆ ◇

相關連結:

Anthropic 官方說明:https://support.claude.com/en/articles/14328960-identity-verification-on-claude

OpenAI 組織驗證:https://help.openai.com/en/articles/10910291-api-organization-verification