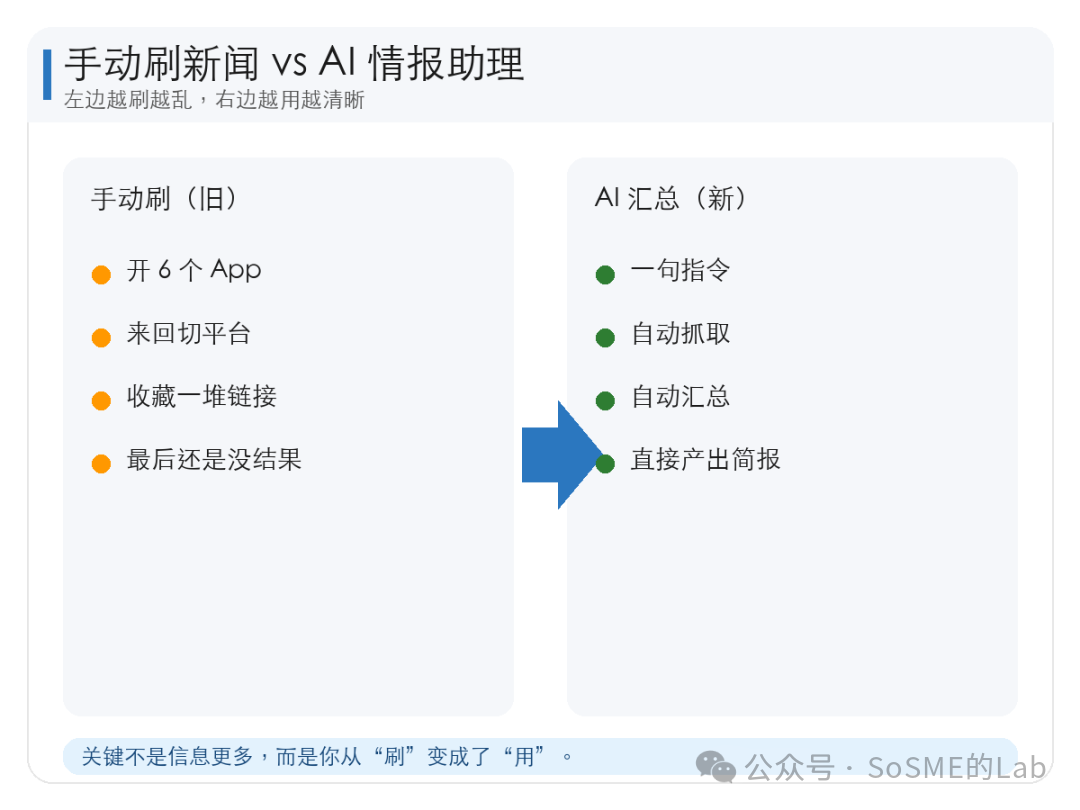

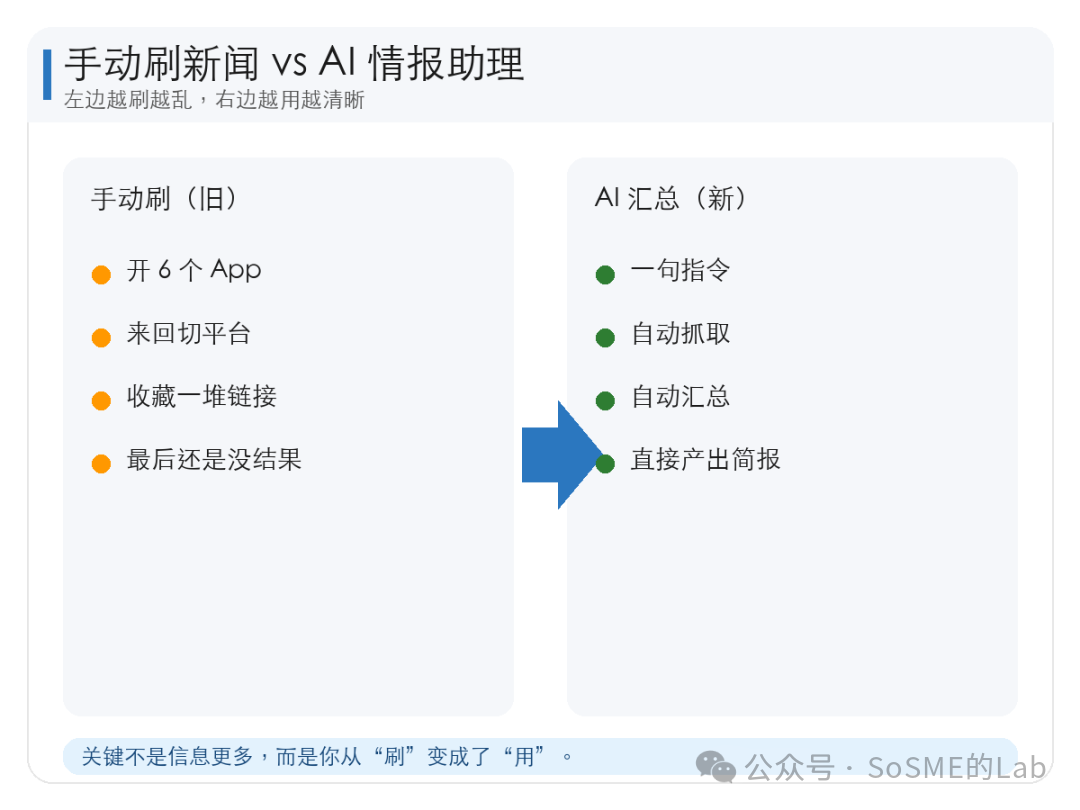

還在手動刷新聞?我用 OpenClaw 搭了一個 AI 情報助理:每天自動出簡報(可複製)

整理版優先睇

用 OpenClaw 加 news-aggregator-skill 搭建 AI 情報助理,每日自動出中文簡報,減低資訊焦慮,提升產出。

呢篇文章係一個技術經驗分享,作者發現自己每日手動刷新聞,資訊焦慮好嚴重,於是喺 GitHub 揾到一個叫 news-aggregator-skill 嘅 openclaw skill,決定自己搭建一個 AI 情報助理。佢想解決嘅問題係:點樣可以自動將多個平台嘅高價值資訊整合成一份中文簡報,令自己唔使再喺唔同平台之間切來切去,浪費注意力。

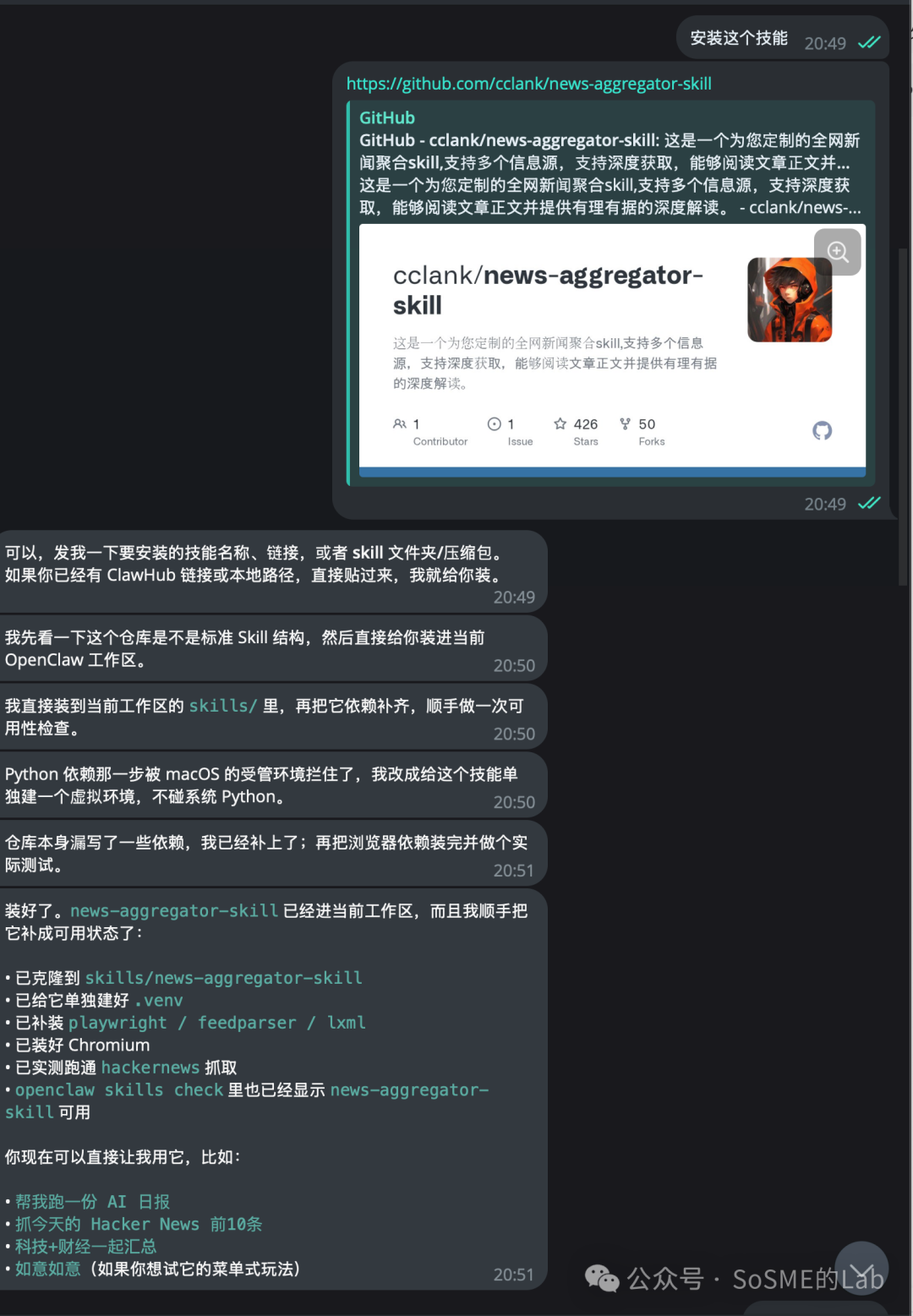

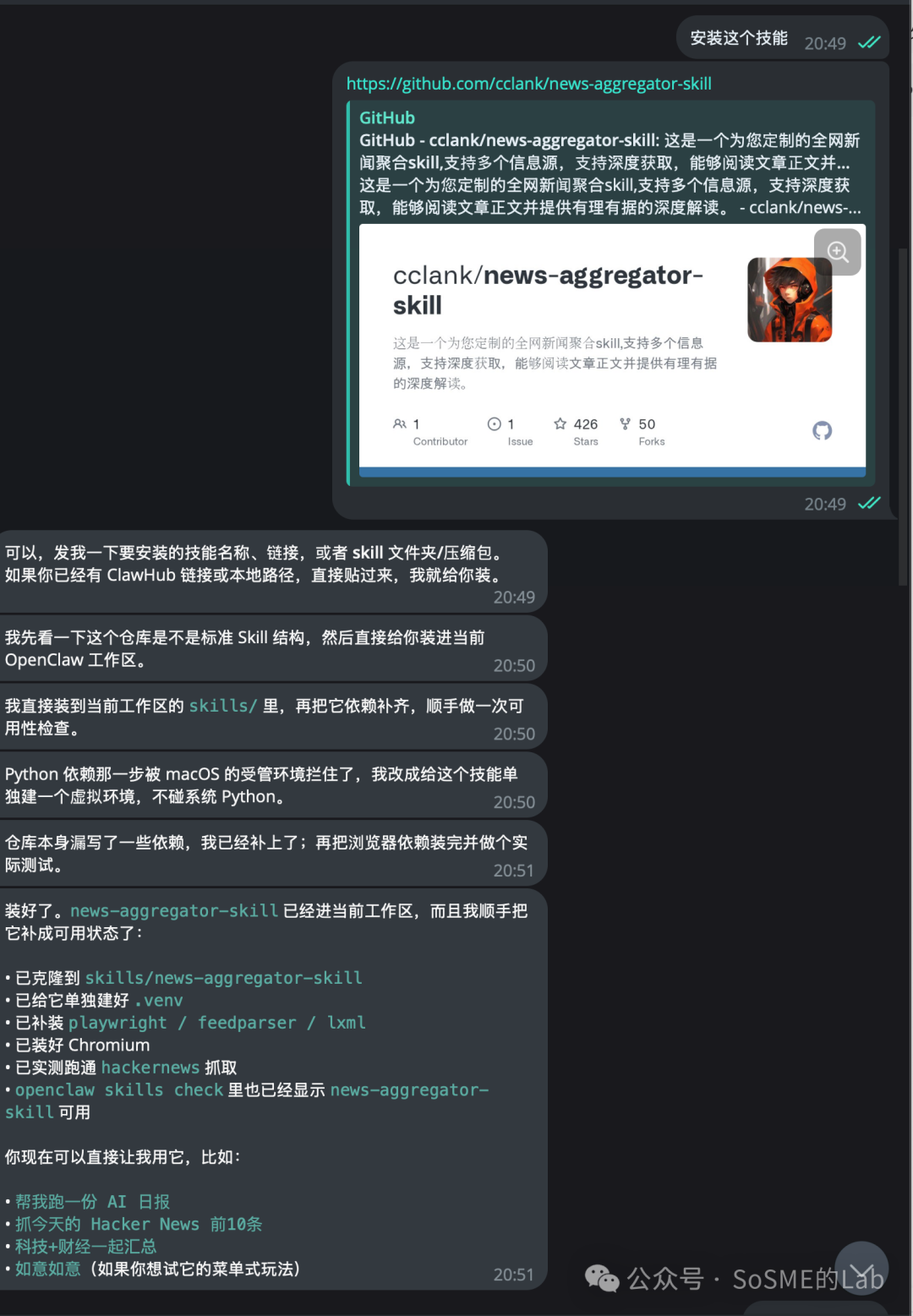

作者嘅做法係 clone 個 skill、建虛擬環境、安裝依賴,然後用 openclaw 運行。佢仲提供咗具體嘅指令用法,例如講句「如意如意」就彈出菜單,揀選編號就可以執行。文章提到舊模式係手動逐個平台睇,新模式係一鍵生成簡報,只需要做選擇同埋加工。

整體結論係:呢個唔係一個普通嘅新聞工具,而係一個個人 AI 情報系統嘅雛形。作者認為未來人同人之間嘅差距,唔只係努力,而係邊個先將 AI 變成自己嘅系統。長期使用可以減低資訊焦慮,令產出更穩定。

- 資訊焦慮嘅源頭唔係資訊量,而係切換平台同埋篩選嘅成本。

- news-aggregator-skill 唔係單純聚合,係直接將多個平台嘅資訊整合成中文簡報。

- 部署好簡單,只需要 clone、建虛擬環境、安裝依賴,用 macOS 都唔會踩坑。

- 用「如意如意」指令可以叫出功能菜單,再輸入「跑一份 AI 日報」就搞掂。

- 呢套系統係個人 AI 情報系統嘅雛形,持續用可以減低資訊焦慮,令產出更穩定。

news-aggregator-skill

用於 OpenClaw 嘅 AI 情報聚合技能,支援多平台資訊抓取同生成中文簡報

你唔係缺資訊,係缺系統

今日你刷咗幾多資訊?公眾號、微博熱搜、GitHub 連結、AI 新聞……好似好努力學習,但最後剩低一句:我好似乜都睇咗,又好似乜都冇留低。真相係,你真正被榨乾嘅唔係資訊量,而係平台切換成本、初篩成本同埋自己整理成本。你一日嘅注意力,大部分死喺「切來切去」同「篩來篩去」。

平台切換成本

初篩成本

呢個 Skill 到底厲害喺邊?

news-aggregator-skill 唔係單純幫你聚合連結,而係將多個平台嘅高價值資訊抓返嚟、彙總、輸出成中文結果。你拎住份簡報就可以繼續讀、繼續篩、繼續寫。

直接產出中文簡報

對比舊模式:你喺 HN 睇兩條 → GitHub 揾項目 → 國內媒體睇產業 → 微博睇情緒 → 收藏一堆 → 最後唔知寫乜。新模式係:一句指令 → 自動抓取 → 自動彙總 → 輸出中文簡報 → 你只需要做「選擇」同「加工」。

自動彙總,直接產出

10 分鐘部署,macOS 都唔踩坑

如果你已經有 OpenClaw 環境,部署就三步:clone、建虛擬環境、裝依賴。

- 1 clone 倉庫:git clone https://github.com/cclank/news-aggregator-skill skills/news-aggregator-skill

- 2 進入目錄並建虛擬環境:cd skills/news-aggregator-skill && python3 -m venv .venv && source .venv/bin/activate

- 3 安裝依賴:pip install -r requirements.txt && pip install playwright feedparser lxml && python -m playwright install chromium

三個步驟就搞掂

git clone https://github.com/cclank/news-aggregator-skill skills/news-aggregator-skill

cd skills/news-aggregator-skill

python3 -m venv .venv

source .venv/bin/activate

pip install -r requirements.txt

pip install playwright feedparser lxml

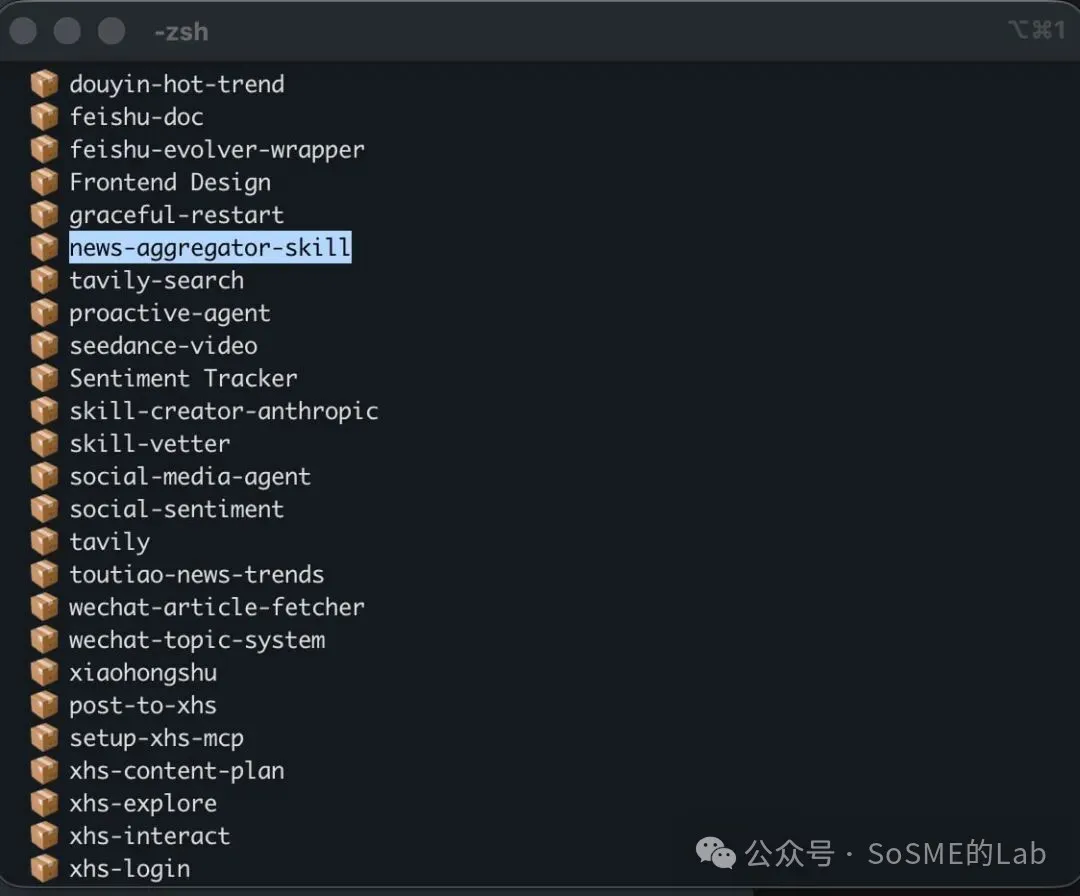

python -m playwright install chromium檢查安裝成功:終端輸入 openclaw skills check,見到「本地已安裝:news-aggregator-skill」就代表成功。

openclaw skills check 確認

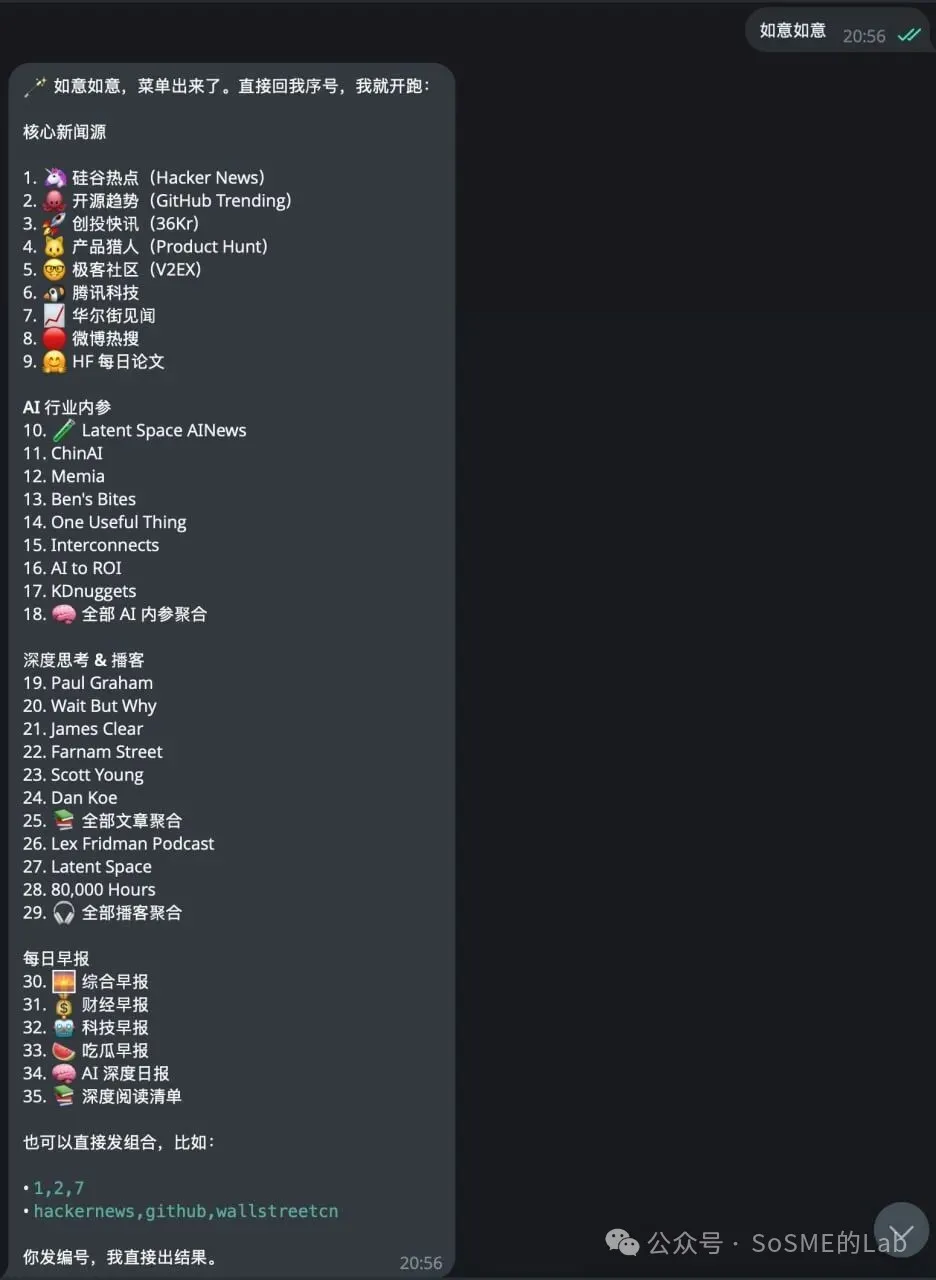

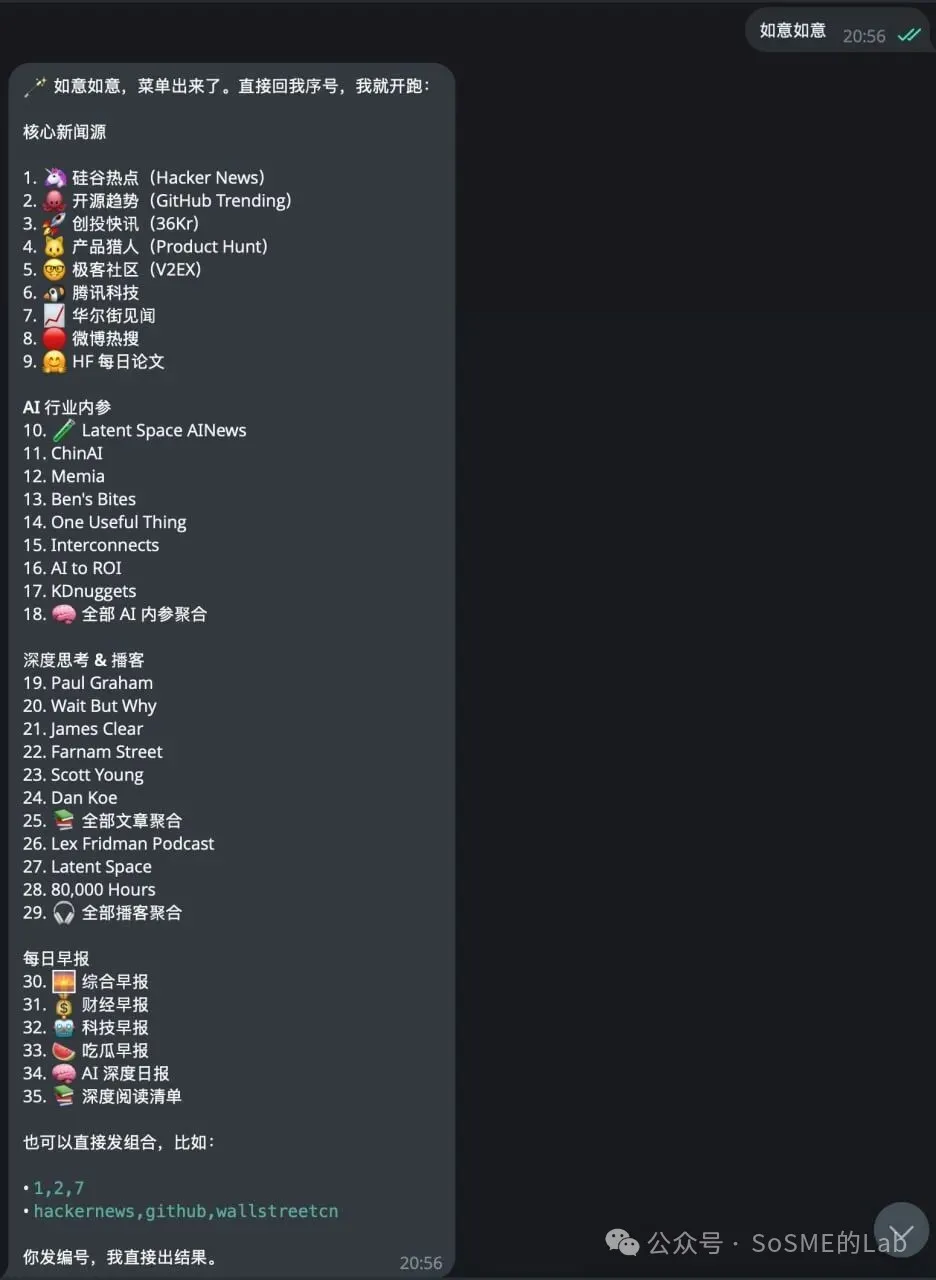

最爽用法:一句「如意如意」就彈出菜單

安裝好之後,你可以輸入「如意如意」嚟叫出功能菜單,揀選編號就可以執行。

如意如意——一鍵叫出菜單

常見指令:輸入「幫我跑一份 AI 日報」或者「生成 cron 任務,之後每日 8 點發送」,就會自動產出簡報。

自動生成 cron 定時任務

你要嘅唔係工具,係系統

未來人同人之間嘅差距,唔只係誰更努力,而係誰先將 AI 變成自己嘅系統。有人將 AI 當成聊天對象,有人當搜索引擎,而你開始將 AI 變成真正嘅助理、雷達、執行器。

將 AI 變成系統

news-aggregator-skill 嘅價值唔係「幫你抓新聞」,而係幫你將碎片化嘅資訊輸入變成一個能持續運轉嘅個人情報系統。建議你照住做一次,然後連續用 7 日,你會明顯感到資訊焦慮降咗,產出更穩。

持續運轉嘅個人情報系統

今日喺 GitHub 見到一個幾好嘅 skill:news-aggregator-skill

於是我就用news-aggregator-skill + OpenClaw 砌咗一個 AI 情報助理,每日自動抓 AI / 科技 / 財經熱點,直接整理成中文簡報。下面會講清楚成個過程,你跟住做就可以復刻。

💡 目錄導讀(3 分鐘睇完重點)

1)點解你越碌越焦慮:唔係資訊少,係切換成本太高

2)呢個 Skill 到底勁喺邊:唔係「聚合」,係「直接產出」

3)10 分鐘 set up(macOS 都唔會撞板):clone + .venv + playwright

4)最爽嘅用法:輸入「如意如意」 → 菜單彈出 → 揀編號開波

5)最後嘅結論:呢個唔係新聞工具,係你嘅「個人 AI 情報系統」雛形

你今日碌咗幾多資訊?

公眾號兩篇、微博熱搜一輪、羣組掉咗 3 個 GitHub 連結、又有人轉咗幾條 AI 新聞……表面睇你似喺「學習」,但最後通常淨係得一句話:我好似乜都睇曬,但係又好似乜都冇留住。

🚨 真相有啲刺心:

你真正被榨乾嘅唔係資訊量,而係平台切換成本 + 初篩成本 + 自己整理成本。你一日嘅注意力,大部分死喺「切來切去」同「篩來篩去」。

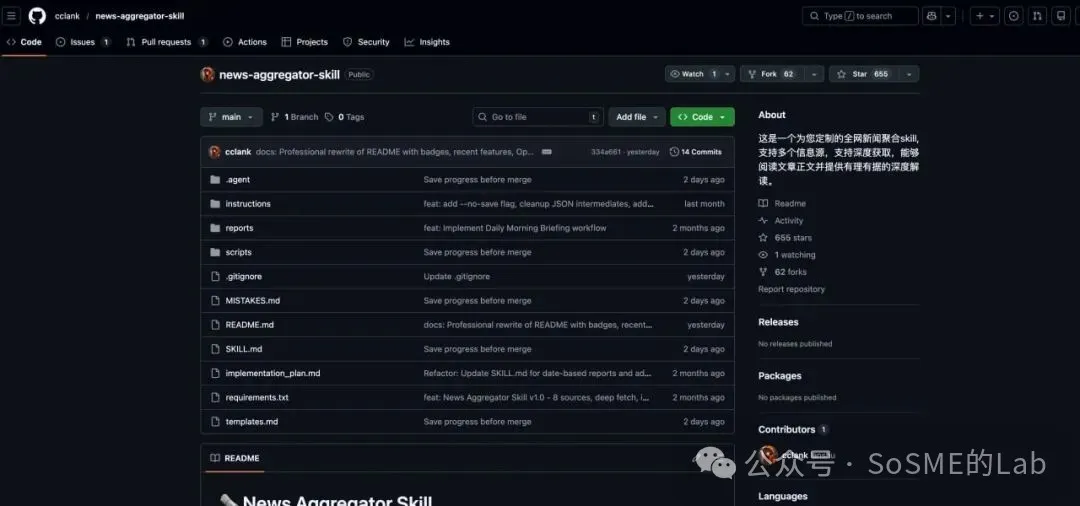

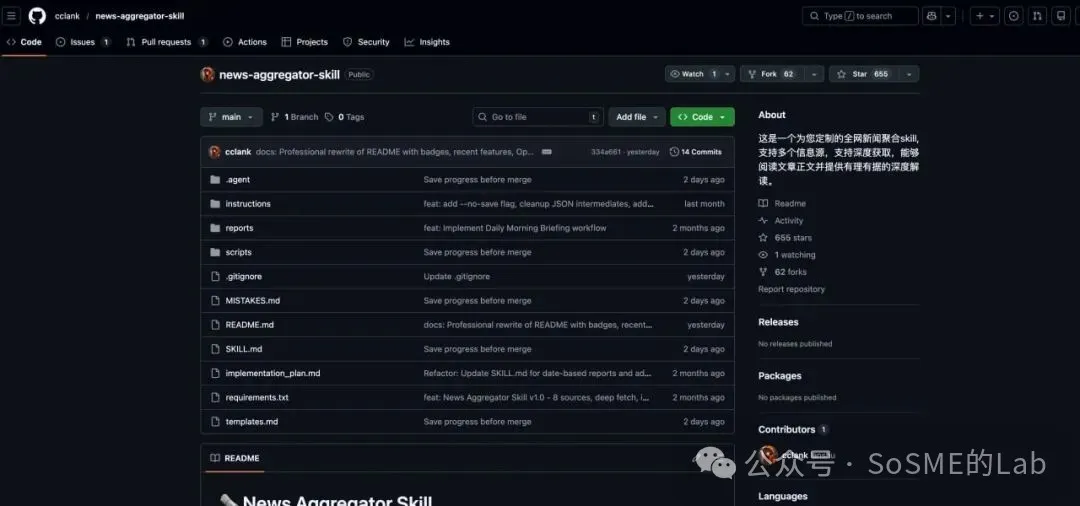

一、呢舊嘢到底係乜?

我裝嘅係:news-aggregator-skill。

你可以理解佢做:一個裝咗入 OpenClaw 嘅「AI 情報助理」。佢做嘅唔係「掉一堆連結俾你」,而係:將多個平台嘅高價值資訊抓返嚟、彙總、輸出成中文結果,你攞住就可以繼續讀、繼續篩、繼續寫。

GitHub 倉庫首頁:news-aggregator-skill

二、點解我話佢唔係「睇新聞」,而係「提高產出」?

👨🏻 舊模式(手動碌)係咁樣:

HN 睇兩條 → GitHub 揾項目 → 國內媒體睇產業 → 微博睇情緒 → 收藏一堆 → 最後都係唔知寫乜。

🤖 新模式(叫 Skill 行)係咁樣:

一句指令 → 自動抓取 → 自動彙總 → 輸出中文簡報 → 你只需要做「選擇」同「加工」。

三、點樣 set up?

如果你已經有 OpenClaw 環境,set up 其實得三步:clone、起虛擬環境、裝依賴。

方法一:openclaw 對話

方法二:命令(複製就能行)

cd skills/news-aggregator-skill

python3 -m venv .venv

source .venv/bin/activate

pip install -r requirements.txt

pip install playwright feedparser lxml

python -m playwright install chromium

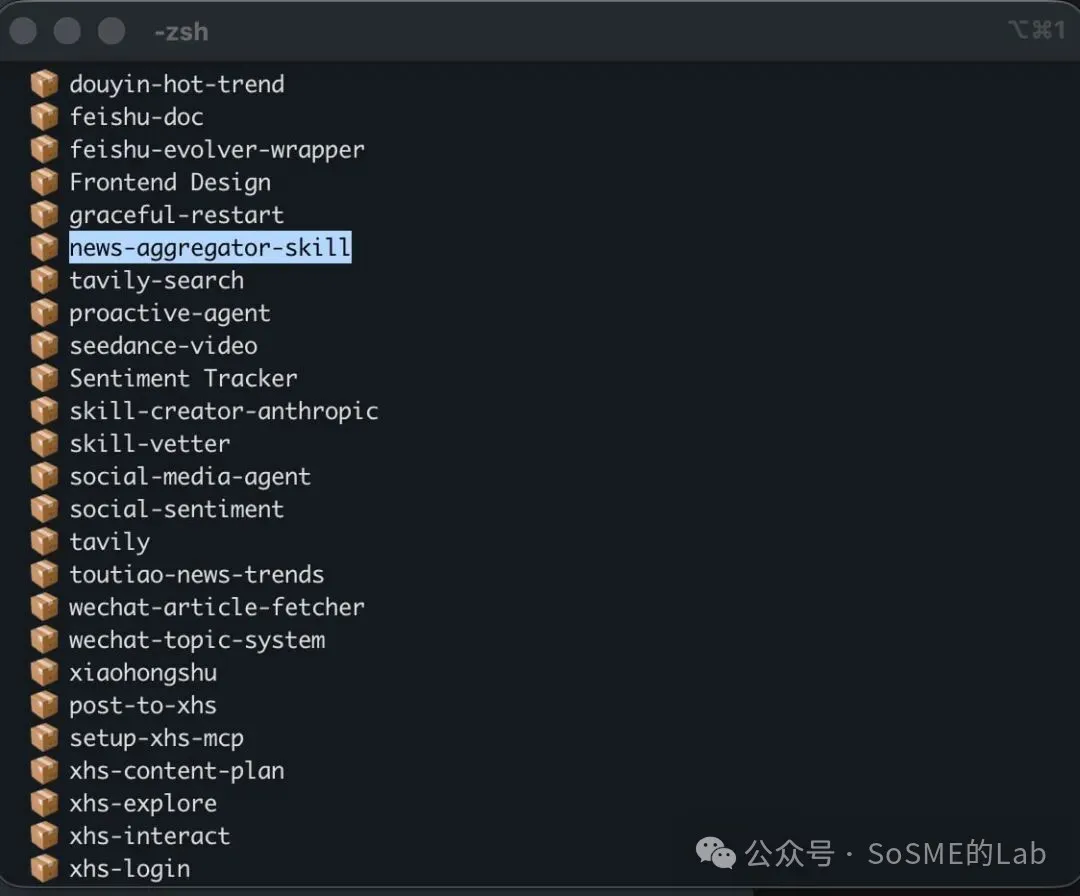

檢查係咪安裝成功:終端輸入

openclaw skills check

成功⬇️⬇️:本地已安裝:news-aggregator-skill 喺 skills 列表出現

四、最爽嘅用法:一句「如意如意」,菜單直接彈出嚟

如意如意:一鍵叫出功能菜單

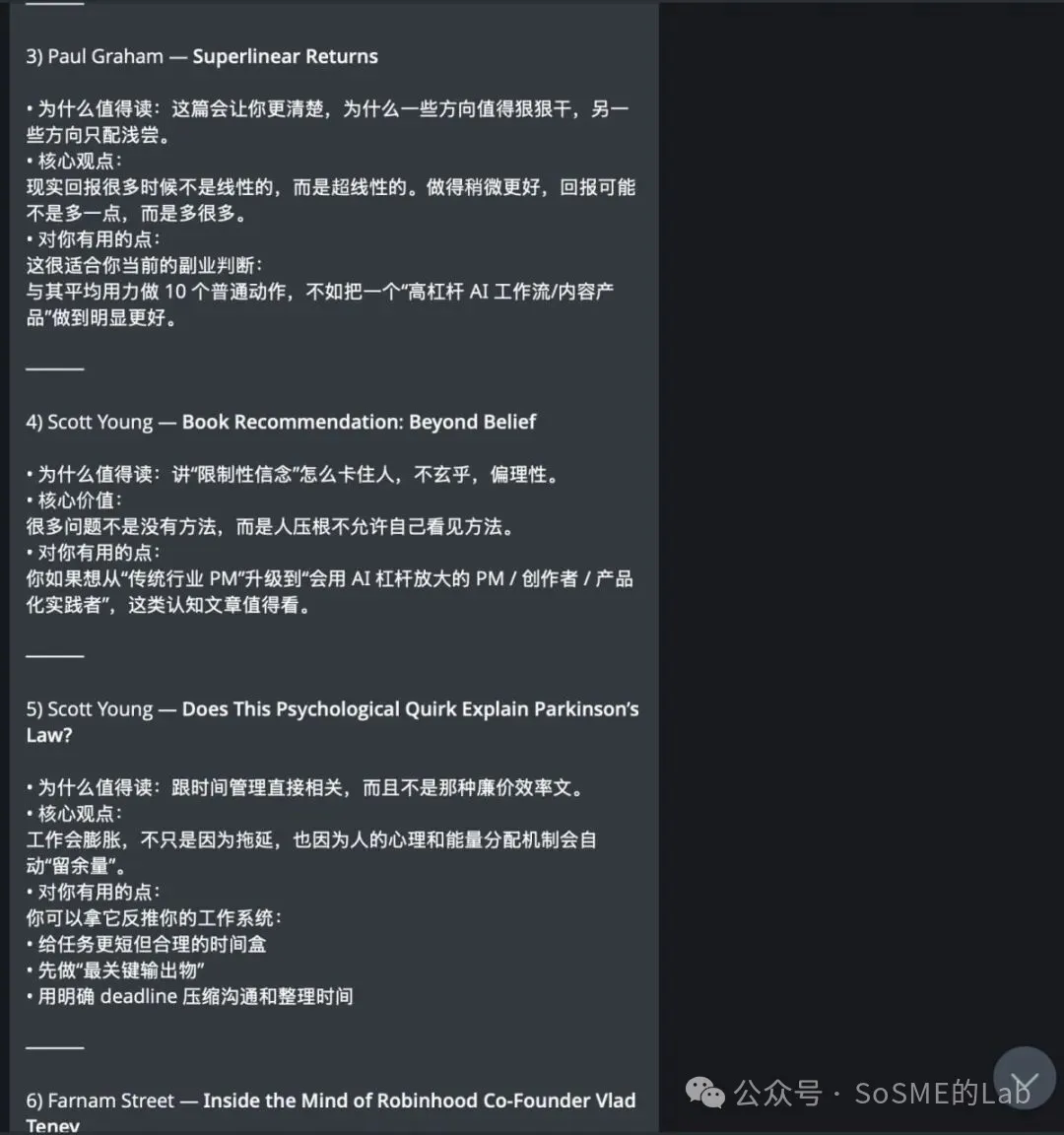

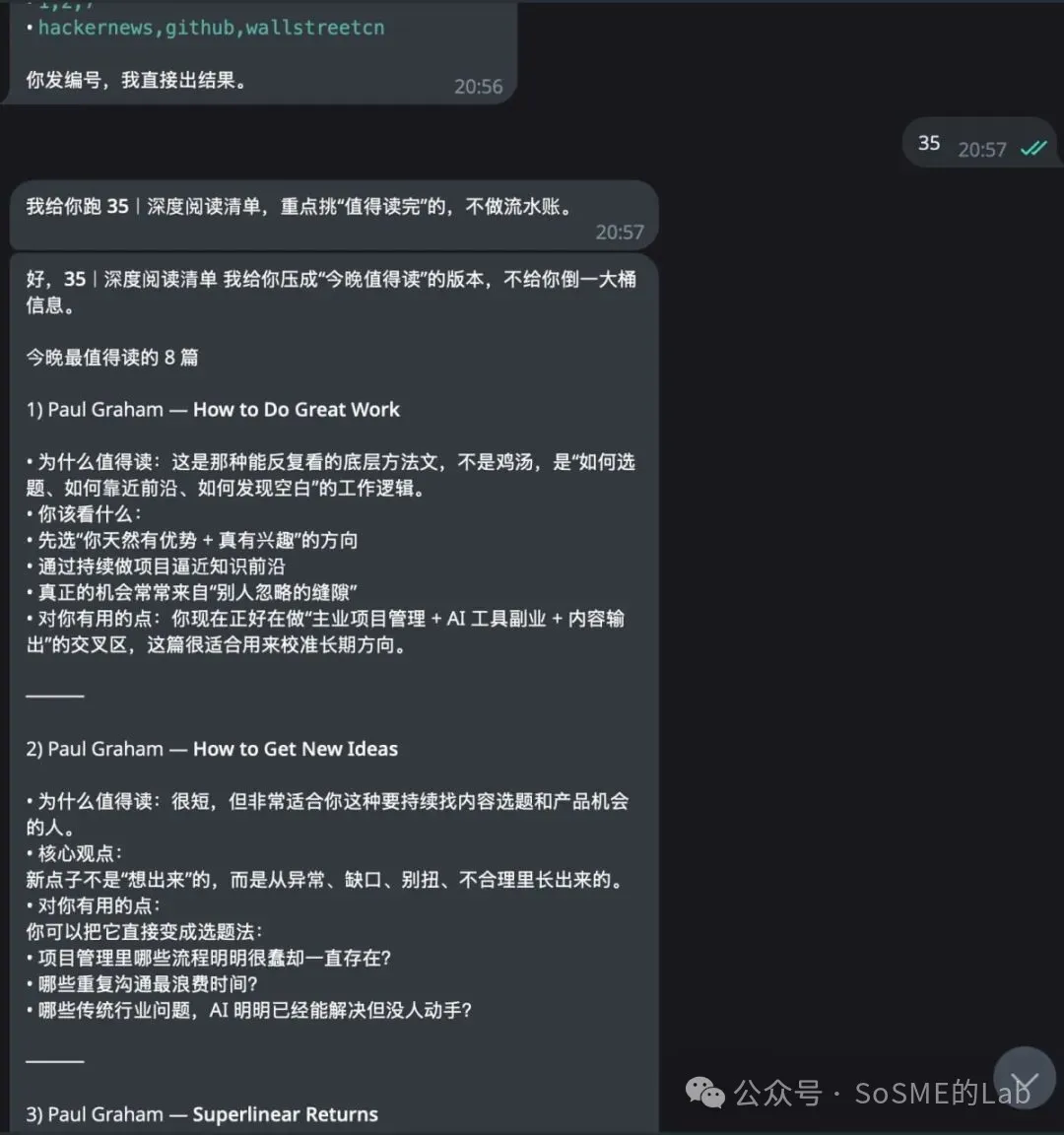

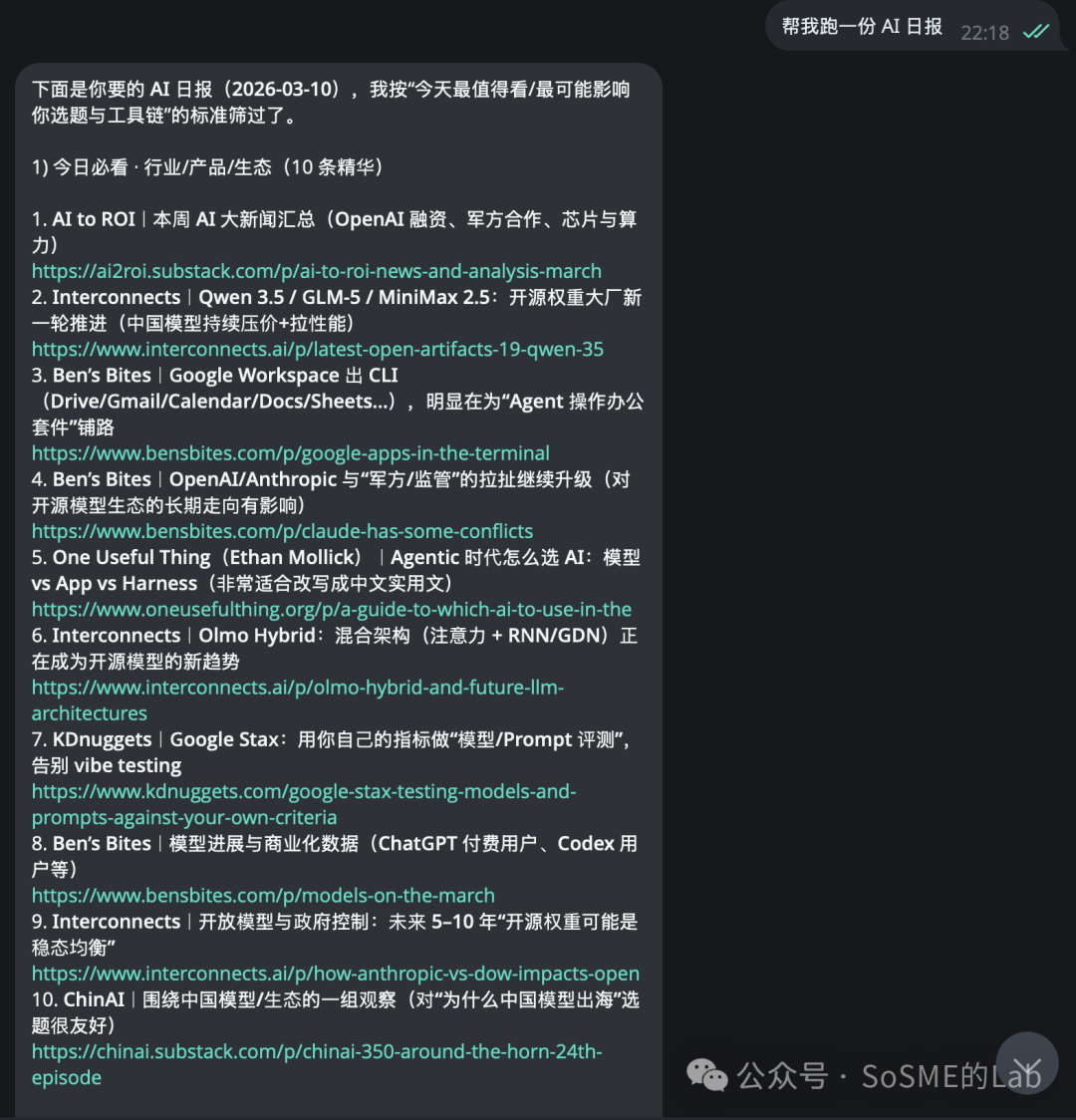

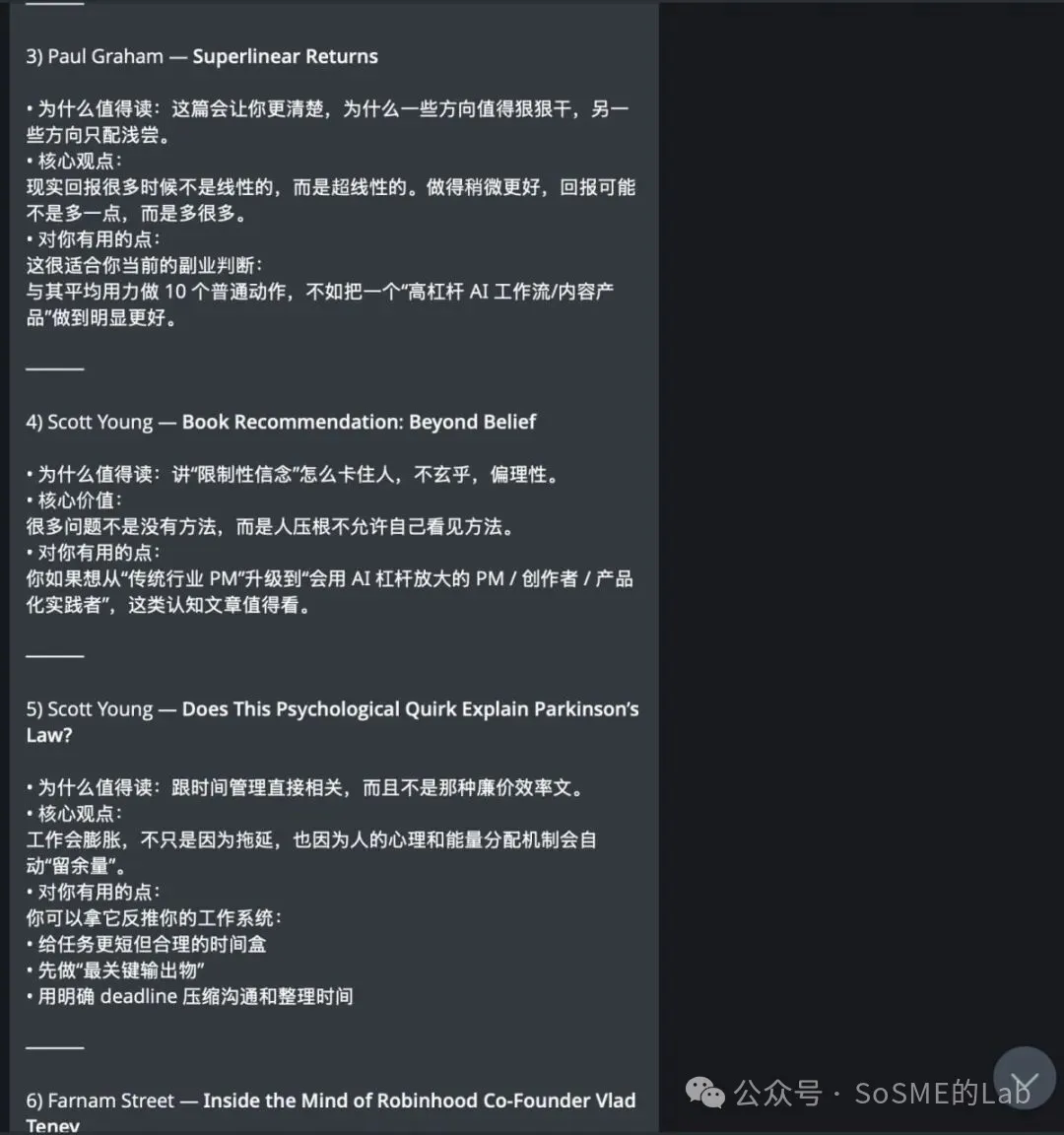

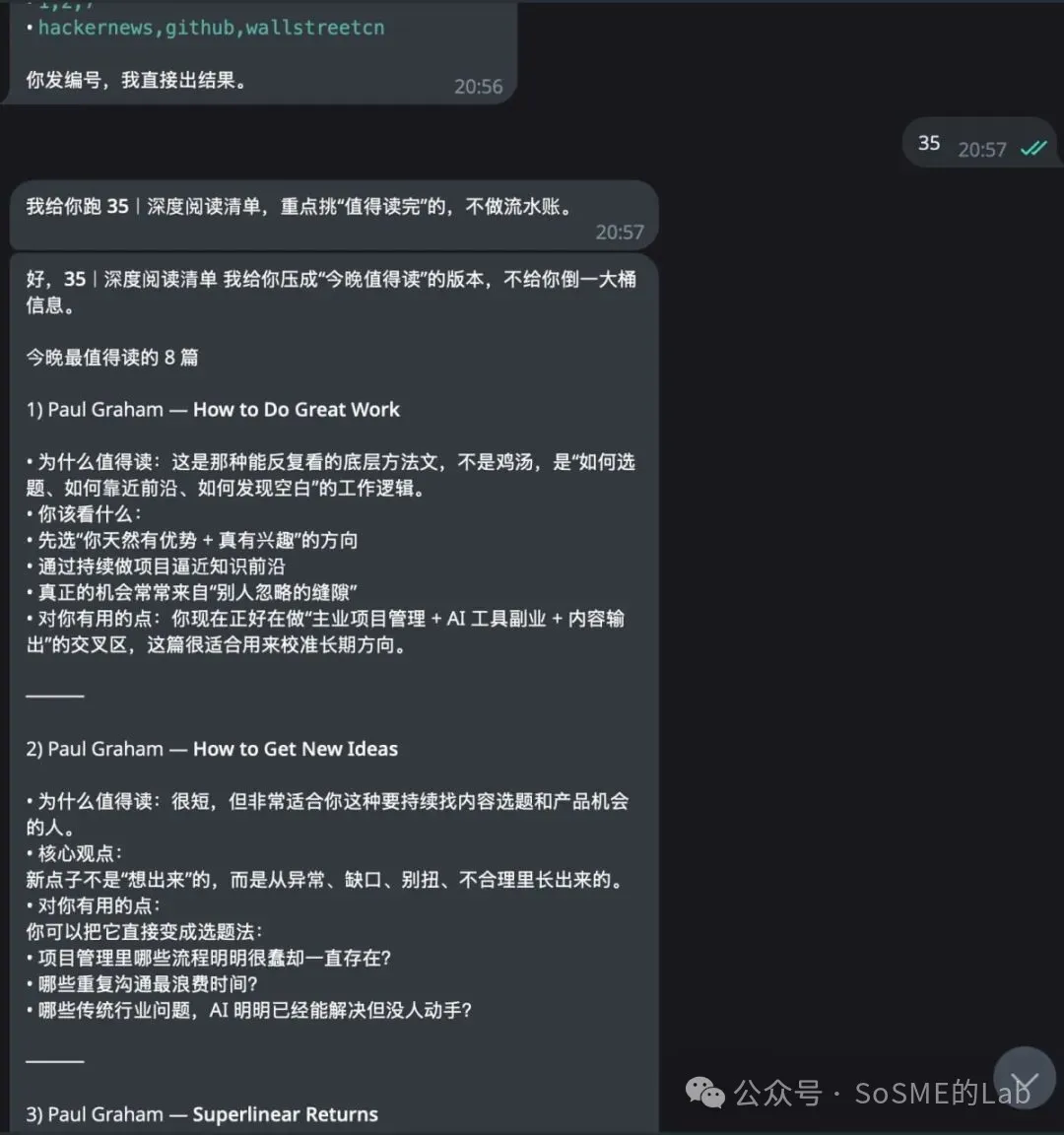

五、輸出係點樣?(呢兩張圖就係答案)

實際結果頁:深度閲讀清單輸出示例

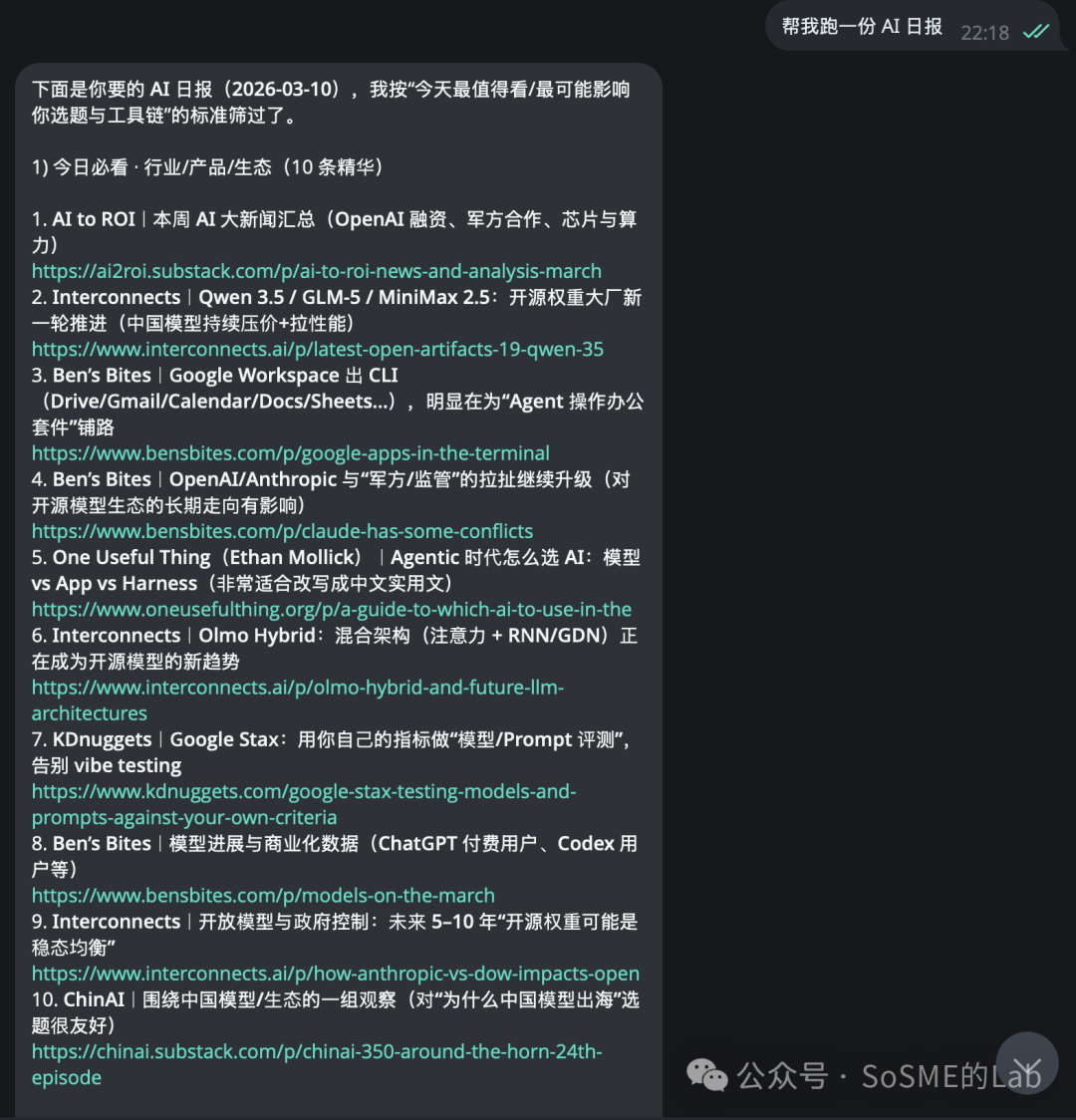

輸入「幫我行一份 AI 日報」

輸入“生成 cron 任務,之後每日 8 點發送”

六、你要嘅唔係工具,係系統

未來人同人之間嘅差距,唔止係「邊個更努力」,而係:邊個先將 AI 變咗做自己嘅系統。

有人將 AI 當做傾偈對象;有人將 AI 當做搜尋引擎;亦有人開始將 AI 變成真正嘅助理、雷達、執行器。

news-aggregator-skill 嘅價值唔係「幫你抓新聞」,而係幫你將碎片化嘅資訊輸入,變成一個可以持續運作嘅個人情報系統。

👇 如果你都想要「AI 情報助理」

先跟住上面做一次,然後連續用 7 日。

你會明顯覺得:資訊焦慮低咗,產出更穩定。

覺得有用就點讚、睇嚇、分享到朋友圈三連支持 🙏🙏🙏

今天逛 GitHub發現一個不錯的 skill:news-aggregator-skill

於是我用news-aggregator-skill + OpenClaw搭了一個 AI 情報助理,每天自動抓 AI / 科技 / 財經熱點,直接整理成中文簡報。下面把全過程講清楚,你照着做就能復刻。

💡 導讀目錄(3 分鐘讀完核心)

1)為什麼你越刷越焦慮:不是信息少,是切換成本太高

2)這個 Skill 到底厲害在哪:不是“聚合”,是“直接產出”

3)10 分鐘部署(macOS 也不踩坑):clone + .venv + playwright

4)最爽的用法:輸入“如意如意” → 菜單彈出 → 選編號開跑

5)最後的結論:這不是新聞工具,是你的“個人 AI 情報系統”雛形

你今天刷了多少信息?

公眾號兩篇、微博熱搜一圈、羣裏甩了 3 個 GitHub 連結、又有人轉了幾條 AI 新聞……看起來你在“學習”,但最後常常只剩一句話:我好像什麼都看了,又好像什麼都沒留下。

🚨 真相有點扎心:

你真正被榨乾的不是信息量,而是平台切換成本 + 初篩成本 + 自己整理成本。你一天的注意力,大部分死在“切來切去”和“篩來篩去”。

一、這玩意到底是什麼?

我裝的是:news-aggregator-skill。

你可以把它理解成:一個裝進 OpenClaw 的“AI 情報助理”。它做的不是“給你丟一堆連結”,而是:把多個平台的高價值信息抓回來、彙總、輸出成中文結果,你拿着就能繼續讀、繼續篩、繼續寫。

GitHub 倉庫首頁:news-aggregator-skill

二、為什麼我說它不是“看新聞”,而是“提高產出”?

👨🏻 舊模式(手動刷)長這樣:

HN 看兩條 → GitHub 找項目 → 國內媒體看產業 → 微博看情緒 → 收藏一堆 → 最後還是不知道寫啥。

🤖 新模式(讓 Skill 跑)是這樣:

一句指令 → 自動抓取 → 自動彙總 → 輸出中文簡報 → 你只需要做“選擇”和“加工”。

三、部署怎麼做?

如果你已經有 OpenClaw 環境,部署其實就三步:clone、建虛擬環境、裝依賴。

方法一:openclaw 對話

方法二:命令(複製就能跑)

cd skills/news-aggregator-skill

python3 -m venv .venv

source .venv/bin/activate

pip install -r requirements.txt

pip install playwright feedparser lxml

python -m playwright install chromium

檢查是否安裝成功:終端輸入

openclaw skills check

成功⬇️⬇️:本地已安裝:news-aggregator-skill 出現在 skills 列表

四、最爽的用法:一句“如意如意”,菜單直接彈出來

如意如意:一鍵調出功能菜單

五、輸出長什麼樣?(這兩張圖就是答案)

實際結果頁:深度閲讀清單輸出示例

輸入“幫我跑一份 AI 日報”

輸入“生成 cron 任務,之後每日8點發送”

六、你要的不是工具,是系統

未來人與人的差距,不只是“誰更努力”,而是:誰先把 AI 變成了自己的系統。

有人把 AI 當聊天對象;有人把 AI 當搜索引擎;也有人開始把 AI 變成真正的助理、雷達、執行器。

news-aggregator-skill 的價值不是“幫你抓新聞”,而是幫你把碎片化的信息輸入,變成一個能持續運轉的個人情報系統。

👇 如果你也想要“AI 情報助理”

先照着上面做一遍,然後連續用 7 天。

你會明顯感到:信息焦慮降了,產出更穩了。

覺得有用點贊、在看、分享到朋友圈三連支持 🙏🙏🙏